18 Mei 2025·8 menit

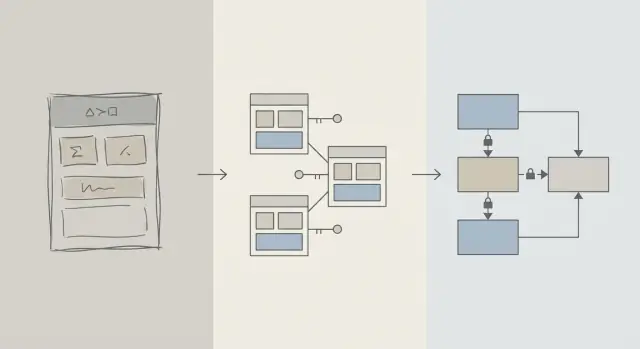

Desain Skema Dulu: Aplikasi Lebih Cepat daripada Tuning Query Awal

Kemenangan performa awal biasanya datang dari desain skema yang lebih baik: tabel, kunci, dan constraint yang tepat mencegah query lambat dan penulisan ulang yang mahal di kemudian hari.

Skema vs Optimisasi Query: Maksudnya

Ketika sebuah aplikasi terasa lambat, naluri pertama sering kali adalah "memperbaiki SQL." Naluri itu masuk akal: satu query terlihat, terukur, dan mudah disalahkan. Anda bisa menjalankan EXPLAIN, menambah indeks, mengubah JOIN, dan kadang langsung melihat peningkatan.

Tetapi di tahap awal produk, masalah kecepatan sama besarnya kemungkinan berasal dari bentuk data seperti dari teks query itu sendiri. Jika skema memaksa Anda melawan basis data, tuning query berubah menjadi siklus whack-a-mole.

Desain skema (penjelasan sederhana)

Desain skema adalah bagaimana Anda mengorganisir data: tabel, kolom, relasi, dan aturan. Ini mencakup keputusan seperti:

- "Hal" apa yang pantas punya tabel sendiri (users, orders, events)

- Bagaimana tabel berhubungan (one-to-many, many-to-many)

- Apa yang harus unik atau wajib (constraints)

- Bagaimana Anda merepresentasikan status dan riwayat (timestamps, status fields, audit records)

Desain skema yang baik membuat cara alami untuk mengajukan pertanyaan juga menjadi cara yang cepat.

Optimisasi query (penjelasan sederhana)

Optimisasi query adalah memperbaiki cara mengambil atau memperbarui data: menulis ulang query, menambah indeks, mengurangi pekerjaan yang tidak perlu, dan menghindari pola yang memicu pemindaian besar.

Keduanya penting—tapi waktunya lebih penting

Artikel ini bukan tentang "skema baik, query buruk." Ini soal urutan kerja: benahi dasar-dasar skema basis data dulu, lalu tune query yang memang perlu. Anda akan belajar mengapa keputusan skema mendominasi performa awal, bagaimana mengenali saat skema benar-benar menjadi hambatan, dan bagaimana mengembangkannya dengan aman seiring aplikasi tumbuh. Ditujukan untuk tim produk, pendiri, dan pengembang yang membangun aplikasi dunia nyata—bukan spesialis basis data.

Mengapa Desain Skema Mengarahkan Sebagian Besar Performa Awal

Performa awal biasanya bukan soal SQL yang jenius—melainkan seberapa banyak data yang dipaksa untuk disentuh oleh basis data.

Struktur menentukan seberapa banyak yang dipindai

Sebuah query hanya bisa selektif sejauh model data mengizinkannya. Jika Anda menyimpan "status", "type", atau "owner" dalam field yang longgar (atau tersebar di tabel yang tidak konsisten), basis data seringkali harus memindai jauh lebih banyak baris untuk menemukan kecocokan.

Skema yang baik mengecilkan ruang pencarian secara alami: kolom yang jelas, tipe data konsisten, dan tabel yang berfokus membuat query memfilter lebih awal dan membaca lebih sedikit halaman dari disk atau memori.

Kunci yang hilang menciptakan pekerjaan mahal

Ketika primary key dan foreign key hilang (atau tidak ditegakkan), relasi jadi tebak-tebakan. Itu memindahkan pekerjaan ke lapisan query:

- Join menjadi lebih besar karena tidak ada jalur join yang dapat diandalkan dan diindeks.

- Filter menjadi lebih kompleks karena Anda mengompensasikan duplikat, null, dan nilai yang "hampir cocok".

Tanpa constraint, data buruk menumpuk—sehingga query makin lambat saat baris bertambah.

Indeks mengikuti skema (dan tidak bisa memperbaiki segalanya)

Indeks paling berguna ketika mereka cocok dengan jalur akses yang dapat diprediksi: join berdasarkan foreign key, filter oleh kolom yang terdefinisi, pengurutan oleh field yang umum. Jika skema menyimpan atribut penting di tabel yang salah, mencampur makna dalam satu kolom, atau bergantung pada parsing teks, indeks tidak bisa menyelamatkan Anda—Anda masih memindai dan mentransformasikan terlalu banyak.

Cepat secara default

Dengan relasi yang bersih, identifier yang stabil, dan batasan tabel yang masuk akal, banyak query sehari-hari menjadi "cepat secara default" karena mereka menyentuh lebih sedikit data dan menggunakan predikat yang sederhana dan ramah indeks. Optimisasi query kemudian menjadi langkah penyelesaian—bukan pertarungan api yang terus-menerus.

Realita Tahap Awal: Perubahan Itu Konstan

Produk tahap awal jarang punya "persyaratan yang stabil"—mereka punya eksperimen. Fitur diluncurkan, ditulis ulang, atau hilang. Tim kecil menyeimbangkan tekanan roadmap, dukungan, dan infrastruktur dengan waktu terbatas untuk meninjau keputusan lama.

Yang paling sering berubah

Bukan teks SQL yang paling sering berubah. Yang berubah adalah makna data: status baru, relasi baru, field "oh, kita juga perlu melacak...", dan alur kerja baru yang tidak terbayangkan saat peluncuran. Perubahan itu normal—dan itulah alasan keputusan skema sangat penting di awal.

Mengapa memperbaiki skema nanti lebih sulit daripada memperbaiki query

Menulis ulang query biasanya reversible dan lokal: Anda bisa mengirimkan perbaikan, mengukurnya, dan rollback jika perlu.

Menulis ulang skema berbeda. Setelah Anda menyimpan data pelanggan nyata, setiap perubahan struktur menjadi proyek:

- Migrasi yang mengunci tabel atau memperlambat penulisan saat puncak

- Backfill untuk mengisi kolom baru atau membangun ulang data turunan

- Dual-write atau shadow tables untuk menjaga aplikasi tetap berjalan selama transisi

- Risiko downtime jika perubahan tidak bisa dilakukan secara online

Bahkan dengan tooling yang baik, perubahan skema memperkenalkan biaya koordinasi: pembaruan kode aplikasi, urutan deployment, dan validasi data.

Bagaimana keputusan awal menumpuk

Saat basis data kecil, skema yang canggung bisa terlihat "baik-baik saja." Ketika baris bertambah dari ribuan menjadi jutaan, desain yang sama menciptakan pemindaian yang lebih besar, indeks yang lebih berat, dan join yang lebih mahal—kemudian setiap fitur baru dibangun di atas fondasi itu.

Jadi tujuan tahap awal bukan kesempurnaan. Ini memilih skema yang bisa menyerap perubahan tanpa memaksa migrasi berisiko setiap kali produk belajar sesuatu yang baru.

Prinsip Desain yang Mencegah Query Lambat

Sebagian besar masalah "query lambat" di awal bukan soal trik SQL—melainkan ambiguitas dalam model data. Jika skema membuat tidak jelas apa yang direpresentasikan sebuah record, atau bagaimana record berelasi, setiap query jadi lebih mahal untuk ditulis, dijalankan, dan dipelihara.

Mulai dengan seperangkat entitas inti yang kecil

Mulailah dengan menamai hal-hal yang produk Anda tidak bisa berfungsi tanpanya: users, accounts, orders, subscriptions, events, invoices—apa pun yang benar-benar pusat. Lalu definisikan relasi secara eksplisit: one-to-many, many-to-many (biasanya dengan join table), dan ownership (siapa yang "memiliki" apa).

Cek praktis: untuk setiap tabel, Anda harus bisa menyelesaikan kalimat "Satu baris di tabel ini merepresentasikan ___." Jika tidak bisa, tabel tersebut kemungkinan mencampur konsep, yang nanti memaksa filter dan join yang kompleks.

Buat penamaan dan kepemilikan membosankan konsisten

Konsistensi mencegah join tak sengaja dan perilaku API yang membingungkan. Pilih konvensi (snake_case vs camelCase, *_id, created_at/updated_at) dan patuhi.

Juga putuskan siapa yang memiliki sebuah field. Contoh: "billing_address" milik order (snapshot pada waktu pembelian) atau milik user (default saat ini)? Keduanya bisa valid—tetapi mencampurnya tanpa maksud jelas menciptakan query lambat dan rentan error untuk "menemukan kebenaran."

Pilih tipe data yang cocok dengan kenyataan

Gunakan tipe yang menghindari konversi saat runtime:

- Gunakan timestamp dengan aturan zona waktu yang Anda pahami.

- Gunakan decimals untuk uang (bukan floats).

- Gunakan enums atau tabel referensi untuk kategori yang diketahui.

Saat tipe salah, basis data tidak bisa membandingkan secara efisien, indeks jadi kurang berguna, dan query sering perlu casting.

Jangan gandakan fakta tanpa rencana

Menyimpan fakta yang sama di banyak tempat (mis. order_total dan sum(line_items)) menciptakan drift. Jika Anda meng-cache nilai turunan, dokumentasikan, tetapkan sumber kebenaran, dan tegakkan pembaruan secara konsisten (sering melalui logika aplikasi ditambah constraint).

Kunci dan Constraint: Kecepatan Dimulai dari Integritas Data

Basis data yang cepat biasanya basis data yang dapat diprediksi. Kunci dan constraint membuat data Anda dapat diprediksi dengan mencegah kondisi "tidak mungkin"—relasi yang hilang, identitas ganda, atau nilai yang tidak berarti seperti yang aplikasi kira. Kebersihan itu berdampak langsung pada performa karena basis data bisa membuat asumsi lebih baik saat merencanakan query.

Primary keys: setiap tabel butuh identifier yang stabil

Setiap tabel sebaiknya punya primary key (PK): kolom (atau kombinasi kecil kolom) yang mengidentifikasi baris secara unik dan tidak pernah berubah. Ini bukan sekadar aturan teori basis data—ini yang memungkinkan Anda melakukan join dengan efisien, cache dengan aman, dan mereferensi record tanpa tebak-tebakan.

PK yang stabil juga menghindari solusi mahal. Jika tabel tidak punya identifier sejati, aplikasi mulai "mengidentifikasi" baris dengan email, nama, timestamp, atau bundel kolom—mengakibatkan indeks yang lebih lebar, join yang lebih lambat, dan kasus tepi ketika nilai-nilai itu berubah.

Foreign keys: integritas yang membantu optimizer

Foreign key (FK) menegakkan relasi: orders.user_id harus menunjuk ke users.id yang ada. Tanpa FK, referensi invalid masuk (orders untuk user yang dihapus, komentar untuk post yang hilang), dan setiap query harus memfilter dengan defensif, left-join, dan menangani null.

Dengan FK, query planner sering bisa mengoptimalkan join dengan lebih percaya karena relasi eksplisit dan terjamin. Anda juga lebih kecil kemungkinannya mengumpulkan orphan rows yang membengkakkan tabel dan indeks seiring waktu.

Constraint sebagai pembatas untuk data yang bersih dan cepat

Constraint bukan birokrasi—mereka pembatas:

- UNIQUE mencegah duplikat yang memaksa aplikasi melakukan lookup dan pembersihan ekstra. Contoh: satu

users.emailyang kanonik. - NOT NULL menghindari logika tiga-state dan cabang penanganan null yang mengejutkan di query.

- CHECK menjaga nilai dalam himpunan yang diketahui (mis.

status IN ('pending','paid','canceled')).

Data lebih bersih berarti query lebih sederhana, lebih sedikit kondisi fallback, dan lebih sedikit join "untuk berjaga-jaga."

Anti-pola umum yang memperlambat Anda

- Tidak ada foreign key: Anda akan membayar di kemudian hari dengan pekerjaan pembersihan orphan dan logika query yang rumit.

- Duplikasi field email (mis.

users.emaildancustomers.email): Anda mendapat identitas yang bertentangan dan indeks duplikat. - String status bebas: typo seperti "Cancelled" vs "canceled" menciptakan segmen tersembunyi yang memecah filter dan pelaporan.

Jika ingin cepat di awal, buatlah sulit menyimpan data buruk. Basis data akan memberi Anda rencana yang lebih sederhana, indeks yang lebih kecil, dan lebih sedikit kejutan performa.

Normalisasi vs Denormalisasi: Keseimbangan Praktis

Rencanakan migrasi sebelum rilis

Gunakan mode perencanaan untuk memetakan langkah migrasi sebelum mengubah data produksi.

Normalisasi sederhana: simpan setiap "fakta" di satu tempat agar Anda tidak menduplikasi data di seluruh basis data. Ketika nilai yang sama disalin ke banyak tabel atau kolom, pembaruan berisiko—satu salinan berubah, salinan lain tidak, dan aplikasi mulai menampilkan jawaban yang bertentangan.

Normalisasi (default): satu fakta, satu rumah

Dalam praktik, normalisasi berarti memisahkan entitas sehingga pembaruan bersih dan dapat diprediksi. Contoh: nama dan harga produk milik tabel products, bukan diulang di setiap baris order. Nama kategori milik categories, direferensikan oleh ID.

Ini mengurangi:

- data duplikat (lebih sedikit penyimpanan, lebih sedikit inkonsistensi)

- kesalahan pembaruan (ubah sekali, tercermin di mana-mana)

- kebingungan "nilai mana yang benar?"

Ketika over-normalization menyakiti

Normalisasi bisa berlebihan ketika Anda memecah data menjadi banyak tabel kecil yang terus-menerus harus di-join untuk layar sehari-hari. Basis data mungkin masih mengembalikan hasil yang benar, tetapi pembacaan umum menjadi lebih lambat dan kompleks karena setiap permintaan membutuhkan banyak join.

Gejala khas tahap awal: sebuah halaman "sederhana" (seperti daftar riwayat order) membutuhkan 6–10 join, dan performa bervariasi tergantung traffic dan kehangatan cache.

Pendekatan praktis: normalisasi fakta inti, denormalisasi untuk baca terpanas

Keseimbangan yang masuk akal:

- Normalisasikan fakta inti dan kepemilikan (sumber kebenaran). Simpan atribut produk di

products, nama kategori dicategories, dan relasi lewat foreign key. - Denormalisasikan dengan hati-hati untuk read terpopuler—tetapi hanya ketika Anda bisa menjelaskan manfaatnya dan bagaimana menjaga konsistensinya.

Denormalisasi berarti menggandakan sedikit data untuk membuat query yang sering jadi lebih murah (lebih sedikit join, daftar lebih cepat). Kata kuncinya adalah hati-hati: setiap field yang digandakan butuh rencana untuk tetap diperbarui.

Contoh: products, categories, dan order items

Setup ter-normalisasi bisa terlihat seperti:

products(id, name, price, category_id)categories(id, name)orders(id, customer_id, created_at)order_items(id, order_id, product_id, quantity, unit_price_at_purchase)

Perhatikan keuntungan halus: order_items menyimpan unit_price_at_purchase (bentuk denormalisasi) karena Anda butuh akurasi historis meskipun harga produk berubah nanti. Duplikasi itu disengaja dan stabil.

Jika layar paling sering adalah "orders dengan ringkasan item", Anda mungkin juga menduplikasi product_name ke order_items untuk menghindari join ke products pada setiap daftar—tetapi hanya jika Anda siap menjaga sinkronisasinya (atau menerima bahwa itu snapshot saat pembelian).

Strategi Indeks Mengikuti Skema, Bukan Sebaliknya

Indeks sering diperlakukan seperti tombol "percepat" ajaib, tetapi mereka hanya bekerja baik ketika struktur tabel mendukungnya. Jika Anda masih sering mengganti nama kolom, memecah tabel, atau mengubah cara record berelasi, set indeks Anda juga akan sering berubah. Indeks bekerja paling baik ketika kolom (dan cara aplikasi memfilter/mengurutkan berdasarkan mereka) cukup stabil sehingga Anda tidak membangun ulangnya setiap minggu.

Mulai dari pertanyaan yang paling sering diajukan aplikasi Anda

Anda tidak perlu prediksi sempurna, tetapi Anda perlu daftar singkat query yang paling penting:

- "Temukan user berdasarkan email."

- "Tampilkan order terbaru untuk customer."

- "Daftar invoice berdasarkan status, terbaru dulu."

Pernyataan-pernyataan itu diterjemahkan langsung ke kolom mana yang layak diberi indeks. Jika Anda tidak bisa mengatakannya dengan lantang, biasanya itu masalah kejelasan skema—bukan masalah pengindeksan.

Indeks komposit, dijelaskan sederhana

Indeks komposit mencakup lebih dari satu kolom. Urutan kolom penting karena basis data bisa menggunakan indeks secara efisien dari kiri ke kanan.

Misalnya, jika Anda sering memfilter berdasarkan customer_id lalu mengurutkan berdasarkan created_at, indeks pada (customer_id, created_at) biasanya berguna. Urutan terbalik (created_at, customer_id) mungkin tidak membantu query yang sama sebanyak itu.

Jangan mengindeks segalanya

Setiap indeks tambahan punya biaya:

- Tulis lebih lambat: insert/update harus memperbarui setiap indeks.

- Lebih banyak penyimpanan: indeks bisa menjadi bagian besar dari ukuran basis data.

- Lebih banyak kompleksitas: indeks ekstra membuat pemeliharaan dan tuning lebih sulit.

Skema yang bersih dan konsisten menyempitkan indeks yang "benar" ke sedikit yang cocok dengan pola akses nyata—tanpa membayar pajak penulisan dan penyimpanan terus-menerus.

Performa Penulisan: Biaya Tersembunyi dari Skema Berantakan

Rancang skema di chat

Ubah entitas, kunci, dan constraint menjadi skema PostgreSQL saat Anda membangun.

Aplikasi lambat tidak selalu disebabkan oleh pembacaan. Banyak masalah performa awal muncul saat insert dan update—signup user, proses checkout, background job—karena skema yang berantakan membuat setiap penulisan melakukan pekerjaan ekstra.

Mengapa penulisan menjadi mahal

Beberapa pilihan skema diam-diam menggandakan biaya setiap perubahan:

- Baris lebar: memasukkan puluhan (atau ratusan) kolom ke satu tabel sering berarti baris lebih besar, I/O lebih banyak, dan churn cache lebih tinggi—meskipun sebagian besar kolom jarang digunakan.

- Terlalu banyak indeks: indeks mempercepat baca, tetapi setiap insert/update juga harus memperbarui setiap indeks.

- Triggers dan cascade: trigger dapat menyembunyikan pekerjaan (insert/update ekstra) di balik

INSERTsederhana. Cascade foreign key bisa benar dan membantu, tetapi tetap menambah kerja pada waktu tulis yang tumbuh dengan data terkait.

Read-heavy vs write-heavy: pilih rasa sakit Anda dengan sengaja

Jika beban kerja Anda read-heavy (feeds, halaman pencarian), Anda bisa menanggung lebih banyak pengindeksan dan kadang denormalisasi selektif. Jika write-heavy (ingest event, telemetry, order volume tinggi), prioritaskan skema yang menjaga penulisan sederhana dan dapat diprediksi, lalu tambahkan optimisasi baca hanya bila diperlukan.

Pola tahap awal yang umum merugikan penulisan

- Audit logs: bagus untuk kepatuhan, tetapi hindari logging snapshot besar pada setiap update.

- Event tables: tabel append-only skala baik, tetapi bisa membengkak jika Anda menyimpan payload redundant.

- Soft deletes: nyaman, namun menambah ukuran indeks dan bisa memperlambat update serta query kecuali direncanakan dengan hati-hati.

Jaga penulisan tetap sederhana sambil mempertahankan riwayat

Pendekatan praktis:

- Simpan "current state" di satu tabel, dan history di tabel append-only terpisah.

- Buat row history sempit (hanya yang benar-benar perlu: siapa/kapan/apa yang berubah).

- Tambahkan indeks pada history berdasarkan pola akses nyata (biasanya

entity_id,created_at). - Hindari trigger untuk auditing di awal; pilih penulisan eksplisit dari aplikasi agar biayanya terlihat dan bisa diuji.

Jalur tulis yang bersih memberi ruang kepala—dan membuat optimisasi query nanti jauh lebih mudah.

Bagaimana ORM dan API Memperbesar Keputusan Skema

ORM membuat pekerjaan basis data terasa mudah: Anda mendefinisikan model, memanggil metode, dan data muncul. Namun jebakannya adalah ORM juga dapat menyembunyikan SQL mahal sampai itu benar-benar menyakitkan.

ORM: kenyamanan yang bisa menutupi pola lambat

Dua jebakan umum:

- Join yang tidak efisien:

.include()atau serializer bersarang yang tampak sederhana bisa berubah menjadi join lebar, duplikat baris, atau sort besar—terutama jika relasi tidak didefinisikan jelas. - N+1 queries: Anda mengambil 50 record, lalu ORM diam-diam menjalankan 50 query lagi untuk memuat data terkait. Ini sering bekerja di development dan runtuh di bawah trafik nyata.

Skema yang dirancang baik mengurangi kemungkinan pola ini muncul dan membuatnya lebih mudah dideteksi bila terjadi.

Relasi yang jelas membuat penggunaan ORM lebih aman

Saat tabel punya foreign key, unique constraint, dan not-null rule yang eksplisit, ORM bisa menghasilkan query yang lebih aman dan kode Anda bisa mengandalkan asumsi yang konsisten.

Contoh: menegakkan bahwa orders.user_id harus ada (FK) dan users.email itu unik mencegah kelas kasus tepi yang berubah menjadi pengecekan di level aplikasi dan kerja query tambahan.

API mengubah keputusan skema menjadi perilaku produk

Desain API Anda adalah turunan dari skema:

- ID yang stabil (dan tipe kunci yang konsisten) membuat URL, caching, dan state sisi-klien lebih sederhana.

- Pagination paling baik saat Anda bisa mengurutkan berdasarkan kolom terindeks, monotonic (sering

created_at+id). - Filtering menjadi dapat diprediksi saat kolom merepresentasikan atribut nyata (bukan string yang dibebani atau JSON blob) dan constraint menjaga nilai tetap bersih.

Jadikan itu workflow, bukan misi penyelamatan

Perlakukan keputusan skema sebagai engineering kelas satu:

- Gunakan migrasi untuk setiap perubahan, direview seperti kode (/blog/migrations).

- Tambahkan "review skema" ringan untuk endpoint baru: tabel apa, kunci apa, constraint apa, bentuk query apa.

- Di staging, log query ORM dan tandai pola N+1 sebelum produksi (/blog/orm-performance-checks).

Jika Anda membangun dengan alur cepat berbasis chat (mis. menghasilkan React app plus backend Go/PostgreSQL di Koder.ai), bantu menjadikan "review skema" bagian dari percakapan sejak awal. Anda bisa iterasi cepat, tetapi tetap ingin constraint, kunci, dan rencana migrasi dibuat dengan sengaja—terutama sebelum trafik datang.

Tanda Peringatan Dini Bahwa Skema Anda Menjadi Bottleneck

Beberapa masalah performa bukan sekadar "SQL buruk" melainkan basis data yang melawan bentuk data Anda. Jika Anda melihat masalah serupa di banyak endpoint dan laporan, itu sering sinyal skema, bukan peluang tuning query.

Gejala umum yang perlu diwaspadai

Filter lambat adalah tanda klasik. Jika kondisi sederhana seperti "temukan orders berdasarkan customer" atau "filter berdasarkan tanggal pembuatan" konsisten lambat, masalahnya mungkin foreign key yang hilang, tipe yang tidak cocok, atau kolom yang tidak bisa diindeks secara efektif.

Tanda merah lain adalah jumlah join yang meledak: query yang seharusnya join 2–3 tabel malah berantai 6–10 tabel hanya untuk menjawab pertanyaan dasar (sering karena lookup over-normalized, pola polymorphic, atau desain "segala ada di satu tabel").

Perhatikan juga nilai yang tidak konsisten di kolom yang berperilaku seperti enum—terutama field status ("active", "ACTIVE", "enabled", "on"). Inkonsistensi memaksa query defensif (LOWER(), COALESCE(), OR-chains) yang tetap lambat tak peduli seberapa banyak Anda tuning.

Checklist skema (cepat untuk diverifikasi)

- Indeks hilang pada foreign key (join jadi full scan saat tabel tumbuh).

- Tipe data salah (mis. ID disimpan sebagai string, tanggal disimpan sebagai teks, uang sebagai float).

- Tabel EAV (Entity–Attribute–Value) digunakan untuk data inti: fleksibel di awal, tetapi filter/sort berubah menjadi banyak join dan predikat sulit diindeks.

Diagnostik sederhana tanpa alat khusus

Mulailah dengan cek realitas: jumlah baris per tabel, dan kardinalitas untuk kolom kunci (berapa banyak nilai distinct). Jika kolom "status" diharapkan 4 nilai tapi Anda menemukan 40, skema sudah bocor kompleksitas.

Lalu lihat rencana query untuk endpoint lambat Anda. Jika Anda sering melihat sequential scans pada kolom join atau set hasil perantara besar, skema dan pengindeksan kemungkinan akar masalah.

Terakhir, aktifkan dan tinjau slow query logs. Ketika banyak query berbeda lambat dengan cara serupa (tabel sama, predikat sama), itu biasanya masalah struktural yang layak diperbaiki di level model.

Mengembangkan Skema dengan Aman Saat Anda Tumbuh

Tambahkan constraint dengan cara aman

Modelkan PK, FK, dan check di awal untuk mencegah kueri lambat nantinya.

Keputusan skema awal jarang bertahan setelah berhadapan dengan pengguna nyata. Tujuannya bukan "mendapatkan sempurna"—melainkan mengubahnya tanpa merusak produksi, kehilangan data, atau membekukan tim selama seminggu.

Proses perubahan ringan dan dapat diulang

Workflow praktis yang bisa skala dari aplikasi satu orang ke tim lebih besar:

- Modelkan: Tuliskan bentuk baru (tabel/kolom, relasi, dan apa yang menjadi sumber kebenaran). Sertakan contoh record dan edge case.

- Migrasi: Tambahkan struktur baru dengan cara backward-compatible (kolom/tabel baru dulu; hindari langsung menghapus atau mengganti nama).

- Backfill: Isi field baru dari data lama dalam batch. Lacak progres agar bisa dilanjutkan.

- Validasi: Tambahkan constraint hanya setelah data bersih (mis. NOT NULL, foreign keys). Jalankan pengecekan yang membandingkan output lama vs baru.

Feature flags dan dual writes (gunakan hemat)

Kebanyakan perubahan skema tidak butuh pola rollout kompleks. Pilih "expand-and-contract": tulis kode yang bisa membaca lama dan baru, lalu alihkan penulisan setelah Anda yakin.

Gunakan feature flags atau dual writes hanya saat benar-benar perlu (trafik tinggi, backfill panjang, atau banyak layanan). Jika dual write, tambahkan monitoring untuk mendeteksi drift dan tentukan sisi mana yang menang saat konflik.

Rollback dan pengujian migrasi yang mencerminkan kenyataan

Rollback aman dimulai dari migrasi yang reversible. Latih jalur "undo": menghapus kolom baru mudah; memulihkan data yang ditimpa tidaklah demikian.

Uji migrasi pada volume data yang realistis. Migrasi yang selesai dalam 2 detik di laptop bisa mengunci tabel selama menit di produksi. Gunakan jumlah baris dan indeks mirip produksi, dan ukur waktu eksekusi.

Di sinilah tooling platform bisa mengurangi risiko: deployment andal plus snapshot/rollback (dan kemampuan mengekspor kode bila perlu) membuat iterasi skema dan logika aplikasi lebih aman. Jika memakai Koder.ai, manfaatkan snapshots dan planning mode ketika akan memperkenalkan migrasi yang mungkin butuh urutan hati-hati.

Dokumentasikan keputusan untuk orang berikutnya (termasuk Anda di masa depan)

Simpan log skema singkat: apa yang berubah, mengapa, dan trade-off yang diterima. Tautkan dari /docs atau README repo. Sertakan catatan seperti "kolom ini sengaja didenormalisasi" atau "foreign key ditambahkan setelah backfill pada 2025-01-10" supaya perubahan di masa depan tidak mengulangi kesalahan lama.

Kapan Mengoptimalkan Query (dan Urutan Operasi yang Masuk Akal)

Optimisasi query penting—tetapi ia paling bernilai ketika skema Anda tidak melawan Anda. Jika tabel tidak punya kunci jelas, relasi inkonsisten, atau "satu baris per hal" dilanggar, Anda bisa menghabiskan jam tuning query yang minggu depan akan ditulis ulang.

Urutan prioritas praktis

-

Perbaiki blocker skema terlebih dahulu. Mulai dengan apa pun yang membuat query benar-benar sulit: primary key yang hilang, foreign key yang tidak konsisten, kolom yang mencampur banyak makna, sumber kebenaran yang diduplikasi, atau tipe yang tidak cocok dengan kenyataan (mis. tanggal disimpan sebagai string).

-

Stabilkan pola akses. Setelah model data mencerminkan bagaimana aplikasi berperilaku (dan kemungkinan akan berperilaku untuk beberapa sprint ke depan), tuning query jadi lebih tahan lama.

-

Optimalkan query teratas—bukan semua query. Gunakan logs/APM untuk mengidentifikasi query paling lambat dan paling sering. Satu endpoint yang dipanggil 10.000 kali sehari biasanya lebih penting daripada laporan admin yang jarang.

80/20 dari tuning query awal

Sebagian besar kemenangan awal datang dari sejumlah kecil langkah:

- Tambahkan indeks yang tepat untuk filter dan join yang paling umum (dan verifikasi bahwa indeks benar-benar digunakan).

- Kembalikan lebih sedikit kolom (hindari

SELECT *, terutama pada tabel yang lebar). - Hindari join yang tidak perlu—kadang join ada hanya karena skema memaksa Anda untuk "menemukan" atribut dasar.

Tetapkan ekspektasi: ini berkelanjutan, tapi fondasi didahulukan

Pekerjaan performa tidak pernah selesai, tetapi tujuannya membuatnya dapat diprediksi. Dengan skema yang bersih, setiap fitur baru menambah beban secara bertahap; dengan skema yang berantakan, setiap fitur menambah kebingungan terakumulasi.

Checklist minggu ini

- Daftar 5 query paling lambat dan 5 query paling sering.

- Untuk masing-masing, konfirmasi: primary key ada, join adalah key-to-key, dan tipe data benar.

- Tambahkan satu indeks yang cocok dengan filter/order dominan.

- Ganti

SELECT *di satu jalur panas. - Ukur ulang dan simpan catatan sederhana "sebelum/sesudah" untuk sprint berikutnya.