22 Apr 2025·8 menit

Samsung SDS dan Skalabilitas IT Perusahaan: Saat Uptime Menjadi Produk

Panduan praktis tentang bagaimana platform enterprise ala Samsung SDS skalakan di ekosistem mitra di mana uptime, kontrol perubahan, dan kepercayaan adalah produk.

Mengapa “keandalan adalah produk” dalam ekosistem perusahaan

Saat sebuah perusahaan bergantung pada platform bersama untuk menjalankan keuangan, manufaktur, logistik, HR, dan saluran pelanggan, uptime berhenti menjadi atribut “bagus untuk dimiliki”. Itu menjadi hal yang dijual. Bagi organisasi seperti Samsung SDS—yang beroperasi sebagai penyedia layanan dan platform TI skala besar—keandalan bukan sekadar fitur layanan; itu adalah layanan.

Apa arti sebenarnya dari “keandalan adalah produk”

Dalam aplikasi konsumen, gangguan singkat mungkin hanya mengganggu. Dalam ekosistem perusahaan, itu bisa menunda pengakuan pendapatan, menghambat pengiriman, merusak pelaporan kepatuhan, atau memicu penalti kontraktual. “Keandalan adalah produk” berarti keberhasilan diukur kurang oleh fitur baru dan lebih oleh hasil seperti:

- proses bisnis selesai tepat waktu

- integrasi kritis tetap sehat

- kinerja dapat diprediksi saat puncak

- pemulihan cepat saat insiden terjadi

Ini juga berarti engineering dan operasi bukanlah “fase” terpisah. Mereka bagian dari janji yang sama: pelanggan dan pemangku kepentingan internal mengharapkan sistem bekerja—secara konsisten, terukur, dan di bawah tekanan.

Apa itu “ekosistem” dalam istilah perusahaan

Keandalan perusahaan jarang soal satu aplikasi. Itu soal jaringan ketergantungan di antaranya:

- afiliasi dan perusahaan grup yang berbagi identitas, jaringan, dan platform inti

- vendor yang menyediakan alat SaaS, feed data, dan komponen infrastruktur

- pelanggan dan mitra yang terintegrasi lewat API, EDI, portal, dan aplikasi mobile

- regulator dan auditor yang mengharapkan jejak audit, kontrol, dan pelaporan

Keterkaitan ini memperbesar blast radius kegagalan: satu layanan yang menurun dapat mengguncang puluhan sistem hilir dan kewajiban eksternal.

Harapkan apa dari artikel ini

Tulisan ini berfokus pada contoh dan pola yang dapat diulang—bukan rincian internal atau kepemilikan. Anda akan belajar bagaimana perusahaan mendekati keandalan melalui model operasi (siapa yang memiliki apa), keputusan platform (standarisasi yang tetap mendukung kecepatan pengiriman), dan metrik (SLO, kinerja insiden, dan target yang selaras dengan bisnis).

Di akhir, Anda seharusnya bisa memetakan ide-ide yang sama ke lingkungan Anda sendiri—apakah Anda menjalankan organisasi TI sentral, tim layanan bersama, atau grup platform yang mendukung ekosistem bisnis yang bergantung.

Samsung SDS dalam konteks: layanan, platform, dan skala perusahaan

Samsung SDS sering dikaitkan dengan menjalankan dan memodernisasi TI perusahaan yang kompleks: sistem yang membuat organisasi besar beroperasi setiap hari. Alih-alih fokus pada satu aplikasi atau lini produk, pekerjaannya lebih dekat ke “pipa” perusahaan—platform, integrasi, operasi, dan layanan yang membuat alur kerja bisnis kritis dapat diandalkan.

Apa yang biasanya termasuk dalam “layanan dan platform perusahaan”

Dalam praktiknya, ini biasanya mencakup beberapa kategori yang banyak perusahaan besar perlukan bersamaan:

- Layanan cloud dan infrastruktur: membangun, memigrasi, dan mengoperasikan lingkungan hybrid; fondasi komputasi, penyimpanan, dan jaringan yang standar.

- Layanan keamanan: manajemen identitas dan akses, pemantauan, manajemen kerentanan, dan operasi keamanan yang harus berjalan terus-menerus.

- Platform data dan analitik: pipeline, kontrol kualitas data, tata kelola, dan sistem yang mengubah aktivitas mentah menjadi pelaporan tepercaya.

- Dukungan ERP dan logistik: inti operasional—pengadaan, inventori, pengiriman, keuangan—di mana menit downtime bisa memblokir pekerjaan nyata.

- Operasi terkelola (manajemen layanan TI): pemantauan 24/7, respons insiden, koordinasi perubahan, dan perbaikan layanan berkelanjutan.

Mengapa “skala” berbeda di konglomerat dan ekosistem mitra

Skala bukan hanya soal volume lalu lintas. Di dalam konglomerat dan jaringan mitra besar, skala soal luasnya: banyak unit bisnis, rezim kepatuhan berbeda, banyak geografi, dan campuran layanan cloud modern berdampingan dengan sistem legacy yang masih penting.

Kelebihan itu menciptakan realitas operasi berbeda:

- Anda melayani banyak pelanggan internal dengan prioritas yang bertentangan.

- Anda mengintegrasikan di antara vendor, anak perusahaan, dan mitra, bukan sekadar tim internal.

- Anda mendukung alur kerja jangka panjang (penagihan, pemenuhan, penggajian) di mana “cukup baik” jarang dapat diterima.

Kendala utama: sistem bersama memberi daya pada alur kerja kritis

Kendala tersulit adalah coupling ketergantungan. Ketika platform inti dibagikan—identitas, jaringan, pipeline data, ERP, middleware integrasi—masalah kecil bisa bergulir ke luar. Layanan autentikasi yang lambat bisa terlihat seperti “aplikasi mati”. Penundaan pipeline data bisa menghentikan pelaporan, peramalan, atau pengiriman kepatuhan.

Inilah sebabnya penyedia enterprise seperti Samsung SDS sering dinilai bukan oleh fitur tetapi oleh hasil: seberapa konsisten sistem bersama menjaga ribuan alur kerja hilir tetap berjalan.

Ekosistem memperbesar risiko: ketergantungan bersama dan blast radius

Platform perusahaan jarang gagal sendirian. Dalam ekosistem bergaya Samsung SDS, gangguan “kecil” di satu layanan dapat menyebar ke pemasok, mitra logistik, unit bisnis internal, dan saluran pelanggan—karena semua mengandalkan set ketergantungan bersama yang sama.

Ketergantungan bersama yang sering terlupakan

Perjalanan perusahaan biasanya melewati rantai komponen ekosistem yang familiar:

- Identitas dan akses: SSO, federasi, penyedia MFA, peran dan hak akses bersama.

- Jaringan dan konektivitas: VPN, private link, DNS, gateway, WAF/CDN, aturan routing mitra.

- Pertukaran data: data master bersama, kode referensi, message broker, layanan transfer berkas.

- Penagihan dan hak akses: pemeriksaan langganan, pembuatan faktur, batas kredit, metering penggunaan.

- Layanan kepatuhan dan audit: logging, retensi, manajemen kunci enkripsi, pelaporan regulasi.

Saat salah satu menurun, itu bisa memblokir banyak “jalur bahagia” sekaligus—checkout, pembuatan pengiriman, pengembalian, penagihan, atau onboarding mitra.

Pilihan integrasi membentuk blast radius

Ekosistem berintegrasi lewat “pipa” berbeda, masing-masing dengan pola kegagalan sendiri:

- API (real-time): sensitif terhadap latensi, throttling, dan kompatibilitas mundur.

- EDI (pertukaran mitra standar): pemetaan rapuh dan ekspektasi skema yang ketat.

- Job batch (transfer terjadwal): kegagalan senyap yang muncul berjam-jam kemudian sebagai selisih rekonsiliasi.

- Event stream (nyaris real-time): replay, ordering, dan lag konsumen dapat memperbesar cacat.

Risiko kunci adalah kegagalan terkorleasi: banyak mitra bergantung ke endpoint yang sama, penyedia identitas yang sama, atau dataset bersama yang sama—sehingga satu kesalahan menjadi banyak insiden.

Mode kegagalan unik pada ekosistem

Ekosistem memperkenalkan masalah yang jarang terlihat di sistem tunggal-perusahaan:

- Mismatch versi antara produsen dan konsumen (drift skema API/EDI).

- Batas kontrak (rate limit, ukuran payload, asumsi timeout) yang terlampaui saat puncak.

- Identitas bersama di mana satu masalah direktori mengunci banyak organisasi.

- Kepemilikan ambigu: “bukan sistem kami” menunda triase sementara outage berkembang.

Mengurangi blast radius dimulai dengan memetakan ketergantungan dan perjalanan mitra secara eksplisit, lalu merancang integrasi yang menurun dengan anggun alih-alih gagal total (lihat juga /blog/reliability-targets-slos-error-budgets).

Fondasi platform: standarisasi tanpa melambatkan pengiriman

Standarisasi hanya membantu jika membuat tim lebih cepat. Di ekosistem perusahaan besar, fondasi platform sukses ketika mereka menghilangkan keputusan yang diulang (dan kesalahan yang diulang) sambil tetap memberi ruang kepada tim produk untuk mengirim.

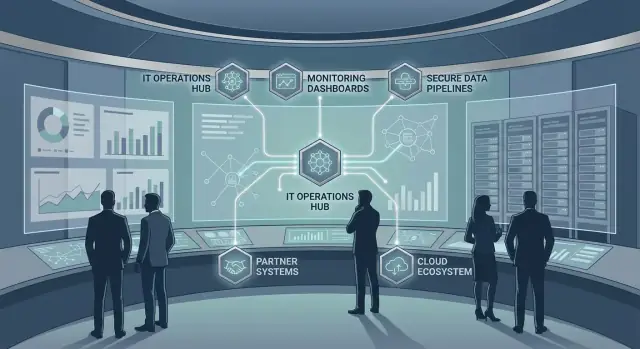

Arsitektur platform berlapis yang dapat diskalakan

Cara praktis memandang platform adalah sebagai lapisan yang jelas, masing-masing dengan kontrak berbeda:

- Lapisan infrastruktur: compute, storage, network, primitive identitas, dan hardening dasar.

- Lapisan runtime: runtime Kubernetes/VM, registri kontainer, runner CI/CD, dan manajemen konfigurasi.

- Lapisan layanan bersama: logging/metrics, secret, API gateway, messaging, service discovery, feature flag.

- Platform bisnis: kapabilitas domain yang dapat digunakan ulang—data pelanggan, penagihan, pemrosesan dokumen, integrasi ERP—diekspose lewat API yang stabil.

Pemecahan ini menjaga kebutuhan "kelas-enterprise" (keamanan, ketersediaan, auditabilitas) dibangun di platform ketimbang diimplementasikan ulang oleh tiap aplikasi.

Golden paths: jalan beraspal, bukan aturan ketat

Golden paths adalah template dan alur kerja yang disetujui yang membuat opsi aman dan handal menjadi opsi termudah: kerangka layanan standar, pipeline pra-konfigurasi, dashboard default, dan stack yang sudah teruji. Tim boleh menyimpang bila perlu, tapi mereka melakukannya dengan sengaja dan bertanggung jawab atas kompleksitas tambahan.

Polanya berkembang menjadi starter kit yang diproduktikan—termasuk scaffolding, pembuatan lingkungan, dan default "day-2" (health check, dashboard, aturan alert). Di beberapa platform seperti Koder.ai, tim bahkan bisa menggenerasi aplikasi kerja melalui alur berbasis chat, lalu menggunakan mode perencanaan, snapshot, dan rollback untuk menjaga perubahan dapat dibalik sambil tetap bergerak cepat. Intinya bukan merek tooling—melainkan membuat jalur handal menjadi lintasan paling mudah.

Multi-tenant vs dedicated: memilih isolasi yang tepat

Platform multi-tenant mengurangi biaya dan mempercepat onboarding, tetapi memerlukan guardrail kuat (kuota, kontrol noisy-neighbor, batasan data yang jelas). Lingkungan dedicated lebih mahal, namun dapat menyederhanakan kepatuhan, isolasi performa, dan jendela perubahan khusus pelanggan.

Mengurangi beban kognitif bagi tim aplikasi

Pilihan platform yang baik mengecilkan permukaan keputusan harian: lebih sedikit percakapan “Library logging mana?”, “Bagaimana kita merotasi secret?”, “Apa pola deployment?”. Tim fokus pada logika bisnis sementara platform menegakkan konsistensi—dan itulah cara standarisasi meningkatkan kecepatan pengiriman alih-alih memperlambatnya.

Target keandalan: SLO, error budget, dan hasil bisnis

Penyedia TI perusahaan tidak melakukan “keandalan” sebagai hal opsional—keandalan adalah bagian dari apa yang dibeli pelanggan. Cara praktis mewujudkannya adalah menerjemahkan ekspektasi menjadi target terukur yang bisa dipahami dan dikelola oleh semua pihak.

SLO dan SLI dalam bahasa sederhana

SLI (Service Level Indicator) adalah pengukuran (misal: “persentase transaksi checkout yang berhasil”). SLO (Service Level Objective) adalah target untuk pengukuran itu (misal: “99.9% transaksi checkout berhasil setiap bulan”).

Mengapa penting: kontrak dan operasi bisnis bergantung pada definisi yang jelas. Tanpa itu, tim bertengkar setelah insiden tentang apa yang dimaksud dengan “bagus”. Dengan definisi itu, Anda bisa menyelaraskan pengiriman layanan, dukungan, dan ketergantungan mitra di papan skor yang sama.

Pilih indikator yang cocok dengan risiko bisnis

Tidak semua layanan harus dinilai hanya dari uptime. Target relevan untuk perusahaan meliputi:

- Ketersediaan: Dapatkah pengguna memulai dan menyelesaikan proses bisnis?

- Latensi: Cukup cepat untuk memenuhi harapan pelanggan dan produktivitas internal?

- Kebenaran data: Apakah laporan, faktur, inventori, atau keputusan identitas akurat dan konsisten?

Untuk platform data, “99.9% uptime” masih bisa berarti kegagalan bulan jika dataset kunci terlambat, tidak lengkap, atau salah. Memilih indikator yang tepat mencegah rasa percaya palsu.

Error budget: menyeimbangkan perubahan dan stabilitas

Error budget adalah jumlah “buruk” yang diizinkan (downtime, permintaan gagal, pipeline terlambat) yang disiratkan oleh SLO. Itu mengubah keandalan menjadi alat keputusan:

- Jika Anda masih dalam anggaran, Anda bisa mengirim perubahan lebih cepat.

- Jika anggaran cepat terkuras, Anda melambat, memperbaiki isu sistemik, dan memperketat praktik perubahan.

Ini membantu penyedia enterprise menyeimbangkan komitmen pengiriman dengan ekspektasi uptime—tanpa mengandalkan opini atau hirarki.

Frekuensi pelaporan dan audiensnya

Pelaporan efektif disesuaikan:

- Engineer (harian/mingguan): tren SLI, kontributor utama pembakaran anggaran, perbaikan yang dapat dilakukan.

- Eksekutif (bulanan/kuartalan): dampak bisnis, outlook risiko, kebutuhan investasi.

- Mitra (sesuai kesepakatan): SLO bersama, kinerja ketergantungan, kesiapan eskalasi.

Tujuannya bukan menambahkan dashboard—melainkan visibilitas yang konsisten dan selaras kontrak tentang apakah hasil keandalan mendukung bisnis.

Observability dan respons insiden di skala perusahaan

Rencanakan perubahan sebelum dirilis

Gunakan mode perencanaan untuk menimbang perubahan, kepemilikan, dan rollback sebelum membuat kode.

Saat uptime adalah bagian dari apa yang dibeli pelanggan, observability tidak boleh dianggap enteng atau sekadar proyek tim tooling. Pada skala perusahaan—terutama di ekosistem dengan mitra dan platform bersama—respons insiden yang baik dimulai dengan melihat sistem seperti yang dirasakan operator: end-to-end.

Dasar yang benar-benar Anda butuhkan

Tim berkinerja tinggi memperlakukan log, metrik, trace, dan synthetic check sebagai satu sistem koheren:

- Metrik memberi tahu apa yang berubah (latensi, rasio error, saturasi).

- Log memberi tahu apa yang terjadi (konteks, ID, titik keputusan).

- Trace menunjukkan di mana pecahnya lintas layanan.

- Synthetic check menunjukkan apa yang dirasakan pengguna (bisa login, bayar, sinkronisasi data?).

Tujuannya adalah jawaban cepat atas: “Apakah ini berdampak pada pengguna?”, “Seberapa besar blast radius?”, dan “Apa yang berubah baru-baru ini?”

Alerting yang dapat ditindaklanjuti (dan lebih sedikit halaman berisik)

Lingkungan perusahaan menghasilkan sinyal tak berujung. Bedanya antara alert usable dan tidak adalah apakah alert terikat ke gejala yang dirasakan pelanggan dan ambang yang jelas. Utamakan alert pada indikator bergaya SLO (error rate, p95 latency) dibandingkan counter internal. Setiap halaman harus menyertakan: layanan terdampak, dampak yang mungkin, ketergantungan utama, dan langkah diagnostik awal.

Peta layanan lintas batas mitra

Ekosistem sering gagal di titik sambungan. Pelihara peta layanan yang menunjukkan ketergantungan—platform internal, vendor, penyedia identitas, jaringan—dan buat terlihat di dashboard serta saluran insiden. Bahkan jika telemetri mitra terbatas, Anda masih bisa memodelkan ketergantungan menggunakan synthetic check, metrik edge, dan ID permintaan bersama.

Runbook dan on-call: otomatisasi vs dokumentasi

Otomatiskan tindakan berulang yang mengurangi waktu mitigasi (rollback, nonaktifkan feature flag, alihkan trafik). Dokumentasikan keputusan yang memerlukan penilaian (komunikasi pelanggan, jalur eskalasi, koordinasi mitra). Runbook yang baik singkat, diuji selama insiden nyata, dan diperbarui sebagai bagian dari tindak lanjut post-incident—bukan disimpan saja.

Kontrol perubahan yang melindungi uptime sekaligus memungkinkan kecepatan

Lingkungan perusahaan seperti ekosistem yang didukung Samsung SDS tidak bisa memilih antara “aman” dan “cepat.” Triknya adalah menjadikan kontrol perubahan sebuah sistem yang dapat diprediksi: perubahan berisiko rendah mengalir cepat, sementara perubahan berisiko tinggi mendapat pengawasan yang layak.

Bergerak cepat dengan rilis kecil yang dapat dibalik

Rilis besar menyebabkan outage besar. Tim menjaga uptime tinggi dengan melakukan pengiriman dalam potongan kecil dan mengurangi jumlah hal yang bisa salah sekaligus.

Feature flag membantu memisahkan “deploy” dari “release,” sehingga kode bisa sampai produksi tanpa langsung memengaruhi pengguna. Canary deploy (merilis ke subset kecil terlebih dahulu) memberi peringatan dini sebelum perubahan mencapai setiap unit bisnis, integrasi mitra, atau wilayah.

Tata kelola yang memuaskan auditor tanpa memblokir tim

Governance rilis bukan hanya kertas kerja—itu cara perusahaan melindungi layanan kritis dan membuktikan kontrol.

Model praktis meliputi:

- Aturan persetujuan jelas berdasarkan risiko (rutin vs berdampak tinggi)

- Segregasi tugas (penulis perubahan bukan satu-satunya yang bisa menyetujuinya)

- Jejak audit otomatis dari pipeline CI/CD dan tiket ITSM

Tujuannya membuat “cara yang benar” menjadi cara termudah: persetujuan dan bukti terekam sebagai bagian dari alur pengiriman normal, bukan disusun kemudian.

Jendela perubahan, periode blackout, dan kalender bisnis

Ekosistem punya titik stres yang dapat diprediksi: penutupan keuangan akhir bulan, event ritel puncak, pendaftaran tahunan, atau cutover mitra besar. Jendela perubahan menyelaraskan deployment dengan siklus tersebut.

Periode blackout harus eksplisit dan dipublikasikan, sehingga tim merencanakan lebih awal daripada terburu-buru melakukan pekerjaan berisiko tinggi menjelang pembekuan.

Rollback dan fail-forward untuk platform dan integrasi

Tidak setiap perubahan bisa di-rollback bersih—terutama perubahan skema atau integrasi lintas perusahaan. Kontrol perubahan yang kuat memerlukan keputusan sebelumnya:

- Jalur rollback (cara kembali ke versi sebelumnya dengan cepat)

- Rencana fail-forward (cara mem-patch aman ketika rollback tidak mungkin)

Saat tim mendefinisikan jalur ini terlebih dulu, insiden menjadi koreksi terkontrol alih-alih improvisasi berkepanjangan.

Rekayasa resiliensi: merancang untuk kegagalan dan pemulihan

Pilih paket yang tepat

Mulai di paket gratis, lalu beralih ke Pro, Business, atau Enterprise saat kebutuhan meningkat.

Rekayasa resiliensi dimulai dengan asumsi sederhana: sesuatu akan rusak—API upstream, segmen jaringan, node database, atau ketergantungan pihak ketiga yang Anda tidak kendalikan. Di ekosistem perusahaan (tempat penyedia ala Samsung SDS beroperasi di banyak unit bisnis dan mitra), tujuannya bukan “tanpa kegagalan,” melainkan kegagalan terkontrol dengan pemulihan yang dapat diprediksi.

Pola resiliensi yang mengurangi dampak pelanggan

Beberapa pola yang konsisten efektif pada skala:

- Redundansi: banyak instance, zona, atau wilayah sehingga satu kesalahan tidak menghentikan layanan.

- Load shedding: ketika kapasitas terlampaui, tolak atau tunda pekerjaan non-kritis (mis. laporan latar) untuk menjaga alur kritis (pembayaran, pencatatan pesanan) tetap hidup.

- Graceful degradation: sajikan pengalaman lebih sederhana saat ketergantungan gagal—data cache, mode read-only, atau fitur terbatas—daripada outage penuh.

Kuncinya mendefinisikan perjalanan pengguna mana yang “harus bertahan” dan merancang fallback khusus untuk mereka.

Disaster recovery: memilih RTO/RPO per sistem

Perencanaan DR menjadi praktis saat setiap sistem punya target eksplisit:

- RTO (Recovery Time Objective): seberapa cepat Anda harus memulihkan layanan.

- RPO (Recovery Point Objective): seberapa banyak kehilangan data (waktu) yang dapat diterima.

Tidak semua hal butuh angka yang sama. Layanan autentikasi pelanggan mungkin memerlukan RTO menit dan RPO nyaris nol, sementara pipeline analitik internal dapat menolerir jam. Menyelaraskan RTO/RPO dengan dampak bisnis mencegah pengeluaran berlebihan sambil tetap melindungi yang penting.

Replikasi dan trade-off konsistensi

Untuk alur kerja kritis, pilihan replikasi penting. Replikasi sinkron dapat meminimalkan kehilangan data tetapi meningkatkan latensi atau mengurangi ketersediaan saat masalah jaringan. Replikasi asinkron memperbaiki performa dan uptime tetapi berisiko kehilangan tulis terbaru. Desain yang baik membuat trade-off ini eksplisit dan menambahkan kontrol pengimbang (idempotensi, job rekonsiliasi, atau status “pending” yang jelas).

Uji pemulihan, bukan hanya bangun kemampuan

Resiliensi hanya bernilai jika diuji:

- Latihan failover untuk membuktikan runbook DR dan jalur akses

- Game day yang mensimulasikan kegagalan ketergantungan dan overload

- Drill chaos dalam scope aman untuk memvalidasi degradasi anggun dan aturan shedding

Jalankan secara rutin, lacak waktu untuk pulih, dan masukkan temuan ke standar platform dan kepemilikan layanan.

Keamanan dan kepatuhan sebagai persyaratan keandalan

Kegagalan keamanan dan celah kepatuhan tak hanya menciptakan risiko—mereka menciptakan downtime. Di ekosistem perusahaan, satu akun yang salah konfigurasi, server yang belum ditambal, atau jejak audit yang hilang bisa memicu pembekuan layanan, perubahan darurat, dan outage yang berdampak pada pelanggan. Memperlakukan keamanan dan kepatuhan sebagai bagian dari keandalan membuat “tetap hidup” menjadi tujuan bersama.

Identitas dan akses lintas organisasi

Saat banyak anak perusahaan, mitra, dan vendor terhubung ke layanan yang sama, identitas menjadi kontrol keandalan. SSO dan federasi mengurangi proliferasi password dan membantu pengguna mendapatkan akses tanpa solusi berisiko. Sama pentingnya adalah prinsip least privilege: akses harus berbatas waktu, berbasis peran, dan ditinjau secara berkala agar akun yang dikompromikan tidak bisa menjatuhkan sistem inti.

Operasi keamanan yang melindungi uptime

Operasi keamanan bisa mencegah insiden—atau menciptakannya lewat gangguan tak terencana. Kaitkan pekerjaan keamanan ke keandalan operasional dengan menjadikannya dapat diprediksi:

- Patching dan remediasi kerentanan pada jadwal yang dipublikasikan, dengan jendela pemeliharaan jelas

- Kontrol endpoint diuji dampaknya terhadap performa sebelum roll-out luas

- Verifikasi otomatis (health check, grup canary) sehingga pembaruan tidak diam-diam menurunkan layanan

Kepatuhan: logging, retensi, privasi, kesiapan audit

Kebutuhan kepatuhan (retensi, privasi, jejak audit) paling mudah dipenuhi saat dirancang ke dalam platform. Logging terpusat dengan bidang konsisten, kebijakan retensi yang ditegakkan, dan ekspor terkontrol akses membuat audit tidak berubah menjadi kebakaran—dan menghindari momen “bekukan sistem” yang mengganggu pengiriman.

Risiko rantai pasokan dan pihak ketiga

Integrasi mitra memperluas kapabilitas sekaligus blast radius. Kurangi risiko pihak ketiga dengan baseline keamanan yang didefinisikan kontraktual, API berversi, aturan penanganan data yang jelas, dan pemantauan kesehatan ketergantungan berkelanjutan. Jika mitra gagal, sistem Anda harus menurun dengan anggun bukan gagal tak terduga.

Platform data: menskalakan kepercayaan, lineage, dan kebenaran

Saat perusahaan berbicara tentang uptime, sering kali mereka maksudkan aplikasi dan jaringan. Namun untuk banyak alur kerja ekosistem—penagihan, pemenuhan, risiko, dan pelaporan—kebenaran data sama pentingnya secara operasional. Batch yang “berhasil” tetapi menerbitkan identifier pelanggan yang salah dapat menimbulkan jam-jam insiden hilir di seluruh mitra.

Data master dan kualitas data sebagai permukaan keandalan

Data master (pelanggan, produk, vendor) adalah titik referensi yang bergantung pada banyak hal. Memperlakukan itu sebagai permukaan keandalan berarti mendefinisikan seperti apa “baik” (kelengkapan, keunikan, ketepatan waktu) dan mengukurnya terus menerus.

Pendekatan praktis adalah melacak sejumlah kecil indikator kualitas yang berorientasi bisnis (mis. “% pesanan yang dipetakan ke pelanggan valid”) dan memberikan alert saat mereka menyimpang—sebelum sistem hilir gagal.

Pipeline skala: batch, streaming, dan reprocessing aman

Pipeline batch cocok untuk jendela pelaporan yang dapat diprediksi; streaming lebih baik untuk operasi nyaris real-time. Pada skala, keduanya butuh guardrail:

- Backpressure agar satu konsumen yang kelebihan beban tidak diam-diam menyebabkan penundaan di seluruh rantai

- Tulisan idempoten dan identifier run yang jelas sehingga reprocessing tidak menduplikasi record

- Kemampuan replay agar Anda bisa pulih dari kesalahan upstream tanpa perbaikan manual yang berisiko

Tata kelola: lineage, katalog, dan stewardship

Kepercayaan meningkat ketika tim bisa menjawab tiga pertanyaan dengan cepat: Dari mana field ini berasal? Siapa yang menggunakannya? Siapa yang menyetujui perubahannya?

Lineage dan katalog bukan proyek dokumentasi semata—mereka alat operasional. Pasangkan dengan stewardship yang jelas: pemilik bernama untuk dataset kritis, kebijakan akses yang ditetapkan, dan review ringan untuk perubahan berdampak tinggi.

Mencegah masalah data ekosistem dengan kontrak

Ekosistem sering gagal di batasnya. Kurangi insiden terkait mitra dengan kontrak data: skema berversi, aturan validasi, dan ekspektasi kompatibilitas. Validasi saat ingest, karantina record buruk, dan terbitkan umpan balik error yang jelas sehingga masalah diperbaiki di sumbernya bukan ditambal di hilir.

Organisasi dan tata kelola: siapa yang memiliki keandalan ujung ke ujung

Bangun layanan di chat

Hasilkan aplikasi React, Go, dan PostgreSQL dari chat, lalu sempurnakan langkah demi langkah.

Keandalan pada skala perusahaan paling sering gagal di celah: antar tim, antar vendor, dan antara “run” dan “build.” Tata kelola bukan birokrasi demi birokrasi—itu cara membuat kepemilikan eksplisit sehingga insiden tidak berubah menjadi debat berjam-jam tentang siapa yang harus bertindak.

Memilih model operasi (dan jujur tentang trade-off)

Ada dua model umum:

- Operasi terpusat: tim bersama menjalankan banyak layanan. Ini cepat menstandarkan tooling dan praktik, tapi berisiko menjadi pabrik tiket dan memperlambat tim produk.

- Tim berorientasi produk: tim memiliki layanan ujung ke ujung (build + run). Ini meningkatkan akuntabilitas dan pembelajaran, tetapi memerlukan dukungan platform yang kuat dan ekspektasi konsisten.

Banyak perusahaan mendarat pada hibrida: tim platform menyediakan paved roads, sementara tim produk memiliki keandalan untuk apa yang mereka kirim.

Katalog layanan dan batas yang jelas

Organisasi yang andal menerbitkan katalog layanan yang menjawab: Siapa pemilik layanan ini? Jam dukungan berapa? Ketergantungan apa yang kritis? Apa jalur eskalasinya?

Sama pentingnya adalah batas kepemilikan: tim mana yang punya database, middleware integrasi, identitas, aturan jaringan, dan monitoring. Saat batas tidak jelas, insiden jadi masalah koordinasi bukan masalah teknis.

Mengelola vendor dan mitra sebagai ketergantungan kelas-satu

Di lingkungan berat ekosistem, keandalan bergantung pada kontrak. Gunakan SLA untuk komitmen ke pelanggan, OLA untuk serah-terima internal, dan kontrak integrasi yang menspesifikasikan versioning, rate limit, jendela perubahan, dan ekspektasi rollback—agar mitra tidak bisa merusak Anda tanpa disengaja.

Loop perbaikan berkelanjutan

Tata kelola harus menegakkan pembelajaran:

- Postmortem tanpa menyalahkan dengan item tindakan yang terlacak

- Problem management untuk menghapus penyebab berulang

- Perencanaan kapasitas yang terkait event bisnis (puncak, peluncuran, migrasi)

Jika dilakukan dengan baik, tata kelola mengubah keandalan dari “tugas semua orang” menjadi sistem yang terukur dan dimiliki.

Yang bisa ditiru untuk perusahaan Anda: rencana starter pragmatis

Anda tidak perlu “menjadi Samsung SDS” untuk mendapat manfaat dari prinsip operasi yang sama. Tujuannya adalah mengubah keandalan menjadi kapabilitas yang dikelola: terlihat, terukur, dan diperbaiki dalam langkah-langkah kecil yang dapat diulang.

1) Peta apa yang sebenarnya Anda jalankan (dan apa yang bergantung padanya)

Mulailah dengan inventaris layanan yang cukup baik untuk dipakai minggu depan, bukan sempurna.

- Daftar 20–50 layanan kritis bisnis teratas (portal pelanggan, pipeline data, identitas, integrasi, job batch).

- Untuk tiap layanan, catat: pemilik, pengguna, jam puncak, ketergantungan utama (DB, API, jaringan, vendor), dan mode kegagalan yang diketahui.

- Buat peta ketergantungan yang menyorot komponen bersama dengan “blast radius” tinggi (SSO, queue pesan, store data inti).

Ini menjadi tulang punggung untuk prioritisasi, respons insiden, dan kontrol perubahan.

2) Pilih beberapa SLO yang akan dikenali bisnis

Pilih 2–4 SLO berdampak tinggi di berbagai area risiko (ketersediaan, latensi, kesegaran, kebenaran). Contoh:

- “Checkout API: 99.9% permintaan berhasil per 30 hari”

- “Login karyawan: p95 < 1s selama jam kerja”

- “Feed keuangan harian: terkirim sebelum 07:00 dengan <0.1% record hilang”

Lacak error budget dan gunakan untuk memutuskan kapan menjeda pekerjaan fitur, mengurangi volume perubahan, atau berinvestasi memperbaiki.

3) Perbaiki observability sebelum membeli lebih banyak tooling

Tool sprawl sering menyembunyikan celah dasar. Pertama, standarkan seperti apa “visibilitas yang baik”:

- Dashboard konsisten yang terikat ke SLO

- Alerting yang memanggil manusia hanya untuk isu berdampak pelanggan

- Sekumpulan runbook minimal untuk skenario kegagalan teratas

Jika Anda tidak bisa menjawab “apa yang rusak, di mana, dan siapa pemiliknya?” dalam beberapa menit, tambahkan kejelasan sebelum menambahkan vendor.

4) Standarkan pola integrasi (khususnya untuk mitra)

Ekosistem sering gagal di sambungan. Terbitkan pedoman mitra yang mengurangi variabilitas:

- Pola API yang disetujui (timeout, retry, idempotensi)

- Aturan versioning dan deprecation

- Rate limit dan perilaku fallback yang aman

- Checklist onboarding dan kontak eskalasi insiden

Perlakukan standar integrasi seperti produk: terdokumentasi, direview, dan diperbarui.

Langkah berikutnya

Jalankan pilot 30 hari pada 3–5 layanan, lalu perluas. Untuk template dan contoh lebih banyak, lihat /blog.

Jika Anda memodernisasi cara tim membangun dan mengoperasikan layanan, membantu menstandarkan tidak hanya runtime dan observability tetapi juga alur pembuatan dapat berguna. Platform seperti Koder.ai (platform “vibe-coding” berbasis chat) bisa mempercepat pengiriman sambil menjaga kontrol enterprise—mis. menggunakan mode perencanaan sebelum menghasilkan perubahan, dan mengandalkan snapshot/rollback saat bereksperimen. Jika Anda mengevaluasi dukungan terkelola atau bantuan platform, mulailah dengan kendala dan hasil di /pricing (bukan janji—hanya cara membingkai opsi).

Pertanyaan umum

Apa arti sesungguhnya dari “keandalan adalah produk” dalam ekosistem perusahaan?

Artinya para pemangku kepentingan merasakan keandalan itu sendiri sebagai nilai inti: proses bisnis selesai tepat waktu, integrasi tetap sehat, kinerja dapat diprediksi saat puncak, dan pemulihan cepat saat terjadi gangguan. Di ekosistem perusahaan, bahkan degradasi singkat bisa menghentikan penagihan, pengiriman, penggajian, atau pelaporan kepatuhan—jadi keandalan menjadi “barang” utama yang dikirimkan, bukan sekadar atribut di balik layar.

Mengapa gangguan kecil bisa berdampak besar di perusahaan besar?

Karena alur kerja perusahaan biasanya sangat terhubung ke platform bersama (identitas, ERP, pipeline data, middleware integrasi). Gangguan kecil dapat bereskalasi menjadi pesanan yang terblokir, penutupan keuangan yang tertunda, kegagalan onboarding mitra, atau penalti kontraktual. “Radius ledakan” (blast radius) biasanya jauh lebih besar daripada komponen yang bermasalah.

Apa ketergantungan bersama yang paling mungkin menciptakan blast radius besar?

- SSO/federasi/MFA dan layanan direktori

- DNS, gateway, WAF/CDN, VPN/tautan privat

- Message broker, layanan transfer berkas, layanan data master

- Pemeriksaan tagihan/entitlement dan metering

- Logging pusat, retensi, manajemen kunci, pelaporan/audit

Jika salah satu dari ini menurun, banyak aplikasi hilir dapat tampak “mati” secara bersamaan meski sebenarnya sehat.

Bagaimana cara memetakan ketergantungan ekosistem tanpa proyek dokumentasi besar?

Gunakan inventaris “cukup baik” dan peta ketergantungan:

- Daftar 20–50 layanan kritis bisnis teratas

- Untuk tiap layanan: pemilik, pengguna, jam puncak, dan ketergantungan utama (DB, API, jaringan, vendor)

- Tambahkan perjalanan mitra (jalur API/EDI/batch/stream)

- Sorot komponen bersama yang banyak digunakan (blast radius tinggi)

Hasil tersebut menjadi dasar prioritisasi SLO, alerting, dan kontrol perubahan tanpa perlu proyek dokumentasi yang menelan waktu berbulan-bulan.

Bagaimana memilih SLO yang mencerminkan dampak bisnis (bukan metrik pencitraan)?

Pilih beberapa indikator yang terikat pada hasil, bukan sekadar uptime:

- Ketersediaan untuk menyelesaikan transaksi kritis (bukan “server hidup” saja)

- Latensi (mis. p95 selama jam kerja)

- Kesegaran dan kebenaran data untuk pipeline (terkirim sebelum tenggat, persentase record yang hilang/tersalah rendah)

Mulai dengan 2–4 SLO yang dikenali bisnis dan perluas saat tim mulai mempercayai pengukuran tersebut.

Apa itu error budget, dan bagaimana pengaruhnya terhadap keputusan pengiriman sehari-hari?

Anggaran error adalah jumlah “kesalahan” yang diperbolehkan oleh sebuah SLO (permintaan gagal, downtime, pipeline terlambat). Gunakan sebagai kebijakan operasional:

- Jika masih dalam anggaran, teruskan pengiriman fitur

- Jika anggaran cepat terkuras, kurangi volume perubahan dan perbaiki masalah sistemik

Dengan begitu, trade-off keandalan menjadi aturan keputusan eksplisit, bukan keputusan yang ditentukan oleh opini atau eskalasi ad-hoc.

Fondasi platform apa yang membantu menstandarkan keandalan tanpa memperlambat tim?

Pendekatan berlapis yang praktis:

- Infrastruktur: komputasi/penyimpanan/jaringan/primitive identitas yang dipahat aman

- Runtime: standar Kubernetes/VM, registry kontainer, runner CI/CD, manajemen konfigurasi

- Shared services: logging/metrics, secret, API gateway, messaging, service discovery

- Business platforms: kapabilitas domain yang bisa dipakai ulang (data pelanggan, penagihan, pemrosesan dokumen, integrasi ERP) diekspos via API yang stabil

Ini memindahkan kebutuhan kelas-enterprise (keamanan, ketersediaan, auditabilitas) ke platform sehingga tiap tim aplikasi tidak mengulang kontrol keandalan yang sama.

Apa itu “golden paths,” dan mengapa penting untuk keandalan pada skala besar?

Golden paths adalah template jalur yang telah disetujui: skeleton layanan standar, pipeline pra-konfigurasi, dashboard default, dan stack yang sudah dikenal aman. Manfaatnya:

- Pilihan aman/handal menjadi opsi termudah

- Penyimpangan dilakukan dengan sengaja dan memiliki pemilik (dengan beban operasional yang jelas)

- Onboarding menjadi lebih cepat dan konsisten

Buat golden path seolah-olah produk: dipelihara, versi, dan diperbaiki berdasarkan pelajaran insiden.

Kapan harus memilih platform multi-tenant versus lingkungan dedicated?

- Multi-tenant: lebih murah dan cepat onboarding, tetapi butuh kuota, kontrol noisy-neighbor, dan batasan data yang ketat

- Dedicated: biaya lebih tinggi, tetapi lebih mudah untuk isolasi performa, pemisahan kepatuhan, dan jendela perubahan khusus pelanggan

Pilih berdasarkan risiko: tempatkan beban kerja sensitif kepatuhan/performa tinggi di lingkungan dedicated, dan gunakan multi-tenant untuk beban kerja yang dapat menoleransi kapasitas bersama dengan pengaman.

Seperti apa respons insiden dan observability skala-perusahaan di lingkungan yang banyak mitra?

Prioritaskan visibilitas end-to-end dan koordinasi:

- Kaitkan alert ke gejala yang dirasakan pelanggan (error rate/latency bergaya SLO), bukan counter internal

- Gunakan peta layanan yang mencakup vendor/mitra dan ketergantungan bersama utama

- Simpan runbook singkat dan teruji untuk mitigasi umum (rollback, nonaktifkan feature flag, alihkan trafik)

- Jalankan postmortem tanpa menyalahkan dengan action item yang terlacak

Jika telemetri mitra terbatas, tambahkan synthetic check di titik sambungan dan korelasikan dengan ID permintaan bersama bila memungkinkan.