12 Nov 2025·8 menit

Membangun Situs Web Siap untuk Crawler AI dan Pengindeksan LLM

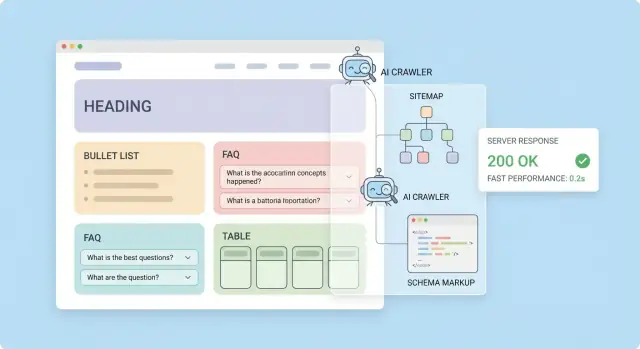

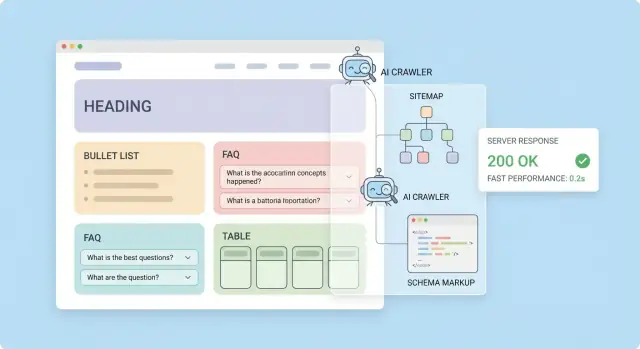

Pelajari cara menyusun konten, metadata, aturan crawl, dan performa agar crawler AI dan alat LLM dapat menemukan, mengurai, dan mengutip halaman Anda secara andal.

Pelajari cara menyusun konten, metadata, aturan crawl, dan performa agar crawler AI dan alat LLM dapat menemukan, mengurai, dan mengutip halaman Anda secara andal.

“AI-optimized” sering jadi kata-kata pemasaran, tetapi dalam praktiknya itu berarti situs Anda mudah bagi sistem otomatis untuk menemukan, membaca, dan menggunakan kembali secara akurat.

Saat orang menyebut AI crawlers, mereka biasanya merujuk pada bot yang dioperasikan oleh mesin pencari, produk AI, atau penyedia data yang mengambil halaman web untuk fitur seperti ringkasan, jawaban, dataset pelatihan, atau sistem retrieval. Pengindeksan LLM biasanya mengacu pada mengubah halaman Anda menjadi penyimpanan pengetahuan yang dapat dicari (sering berupa teks yang “dipotong” dengan metadata) sehingga asisten AI dapat mengambil potongan yang tepat dan mengutipnya.

Optimasi untuk AI kurang soal “peringkat” dan lebih pada empat hasil:

Tidak ada yang bisa menjamin dimasukkannya ke indeks atau model tertentu. Penyedia berbeda cara merayapi, mengikuti kebijakan berbeda, dan memperbarui pada jadwal berbeda.

Apa yang bisa Anda kendalikan adalah membuat konten Anda mudah diakses, diekstrak, dan diberi atribusi—sehingga jika digunakan, digunakan secara benar.

llms.txt sederhana untuk panduan penemuan berfokus LLMJika Anda membuat halaman dan alur baru dengan cepat, pilih tooling yang tidak bertentangan dengan kebutuhan ini. Misalnya, tim yang memakai Koder.ai (platform vibe-coding berbasis chat yang menghasilkan frontend React dan backend Go/PostgreSQL) sering menanam template yang ramah SSR/SSG, rute stabil, dan metadata konsisten sejak awal—sehingga “AI-ready” menjadi default, bukan retrofit.

LLM dan crawler AI tidak menafsirkan halaman seperti manusia. Mereka mengekstrak teks, menebak hubungan antar gagasan, dan mencoba memetakan halaman Anda ke satu intent yang jelas. Semakin terduga struktur Anda, semakin sedikit asumsi yang keliru yang harus mereka buat.

Mulailah dengan membuat halaman mudah dipindai dalam teks biasa:

Pola yang berguna: janji → ringkasan → penjelasan → bukti → langkah berikutnya.

Tempatkan ringkasan singkat di dekat bagian atas (2–5 baris). Ini membantu sistem AI cepat mengklasifikasikan halaman dan menangkap klaim utama.

Contoh TL;DR:

TL;DR: Halaman ini menjelaskan cara menyusun konten sehingga crawler AI dapat mengekstrak topik utama, definisi, dan takeaway secara andal.

Pengindeksan LLM bekerja paling baik ketika setiap URL menjawab satu intent. Jika Anda mencampur tujuan yang tidak terkait (mis. “harga”, “dokumentasi integrasi”, dan “sejarah perusahaan” pada satu halaman), halaman itu menjadi lebih sulit dikategorikan dan mungkin muncul untuk kueri yang salah.

Jika perlu membahas intent terkait tapi berbeda, pisahkan menjadi halaman terpisah dan hubungkan dengan tautan internal (mis. /pricing, /docs/integrations).

Jika audiens Anda bisa menafsirkan sebuah istilah dengan berbagai cara, definisikan di awal.

Contoh:

Optimasi crawler AI: mempersiapkan konten situs dan aturan akses sehingga sistem otomatis dapat secara andal menemukan, membaca, dan menafsirkan halaman.

Pilih satu nama untuk setiap produk, fitur, paket, dan konsep kunci—dan gunakan secara konsisten. Konsistensi meningkatkan ekstraksi (“Fitur X” selalu merujuk pada hal yang sama) dan mengurangi kebingungan entitas ketika model merangkum atau membandingkan halaman Anda.

Kebanyakan pipeline pengindeksan AI memecah halaman menjadi potongan dan menyimpan/ambil potongan terbaik nanti. Tugas Anda adalah membuat potongan tersebut jelas, berdiri sendiri, dan mudah dikutip.

Pertahankan satu H1 per halaman (janji halaman), lalu gunakan H2 untuk bagian utama yang mungkin dicari orang, dan H3 untuk subtopik.

Aturan sederhana: jika Anda bisa mengubah H2 menjadi daftar isi yang menggambarkan seluruh halaman, berarti Anda melakukannya dengan benar. Struktur ini membantu sistem retrieval melampirkan konteks yang tepat ke setiap potongan.

Hindari label samar seperti “Overview” atau “More info.” Sebaliknya, buat heading yang menjawab intent pengguna:

Ketika potongan diambil dari konteks, heading sering menjadi “judul”-nya. Buatlah berarti.

Gunakan paragraf pendek (1–3 kalimat) untuk keterbacaan dan agar potongan tetap fokus.

Daftar berpoin bekerja baik untuk persyaratan, langkah, dan fitur. Tabel bagus untuk perbandingan karena mempertahankan struktur.

| Plan | Best for | Key limit |

|---|---|---|

| Starter | Trying it out | 1 project |

| Team | Collaboration | 10 projects |

Bagian FAQ kecil dengan jawaban yang tegas dan lengkap meningkatkan ekstraktabilitas:

Q: Apakah Anda mendukung upload CSV?

A: Ya—CSV hingga 50 MB per file.

Akhiri halaman kunci dengan blok navigasi supaya pengguna dan crawler dapat mengikuti jalur berbasis intent:

Crawler AI tidak semua berperilaku seperti browser penuh. Banyak yang dapat mengambil dan membaca HTML mentah segera, tetapi kesulitan (atau melewatkan) mengeksekusi JavaScript, menunggu panggilan API, dan merakit halaman setelah hydration. Jika konten kunci Anda hanya muncul setelah rendering sisi-klien, Anda berisiko “tidak terlihat” oleh sistem yang melakukan pengindeksan LLM.

Dengan halaman HTML tradisional, crawler mengunduh dokumen dan dapat mengekstrak heading, paragraf, link, dan metadata langsung.

Dengan halaman berat-JS, respons awal mungkin hanyalah kerangka tipis (beberapa div dan skrip). Teks bermakna muncul hanya setelah skrip dijalankan, data dimuat, dan komponen dirender. Langkah kedua inilah yang menyebabkan cakupan menurun: beberapa crawler tidak menjalankan skrip; yang lain menjalankannya dengan timeout atau dukungan parsial.

Untuk halaman yang ingin Anda indeks—deskripsi produk, harga, FAQ, docs—utamakan:

Tujuannya bukan “tanpa JavaScript.” Ini adalah HTML bermakna dulu, JS kemudian.

Tabs, accordion, dan kontrol “read more” boleh saja jika teks ada dalam DOM. Masalah muncul ketika konten tab hanya diambil setelah klik, atau disuntikkan setelah permintaan sisi-klien. Jika konten itu penting untuk penemuan AI, sertakan dalam HTML awal dan gunakan CSS/ARIA untuk mengontrol visibilitas.

Gunakan kedua pemeriksaan ini:

Jika heading, salinan utama, tautan internal, atau jawaban FAQ muncul hanya di Inspect Element tetapi tidak di View Source, anggap itu risiko rendering dan pindahkan konten tersebut ke output yang di-render server.

Crawler AI dan bot pencari tradisional sama-sama memerlukan aturan akses yang jelas dan konsisten. Jika Anda tidak sengaja memblokir konten penting—atau membiarkan crawler ke area privat atau “berantakan”—Anda bisa membuang-buang anggaran crawl dan mencemari apa yang terindeks.

Gunakan robots.txt untuk aturan luas: folder atau pola URL mana yang harus atau tidak harus dirayapi.

Baseline praktis:

/admin/, /account/, hasil pencarian internal, atau URL parameter yang menghasilkan kombinasi nyaris tak berujung.Contoh:

User-agent: *

Disallow: /admin/

Disallow: /account/

Disallow: /internal-search/

Sitemap: /sitemap.xml

Penting: memblokir dengan robots.txt mencegah crawling, tetapi tidak selalu menjamin sebuah URL tidak muncul di indeks jika dirujuk dari tempat lain. Untuk kontrol indeks, gunakan directive pada level halaman.

Gunakan meta name="robots" di halaman HTML dan X-Robots-Tag pada header untuk file non-HTML (PDF, feed, ekspor yang dihasilkan).

Pola umum:

noindex,follow sehingga tautan masih lewat tetapi halaman itu sendiri tidak masuk indeks.noindex—lindungi dengan autentikasi, dan pertimbangkan juga menolak crawl.noindex ditambah kanonisasi yang tepat.Dokumentasikan—dan terapkan—aturan per lingkungan:

noindex global (berbasis header paling mudah) untuk menghindari pengindeksan tidak sengaja.Jika kontrol akses Anda memengaruhi data pengguna, pastikan kebijakan yang terlihat pengguna mencerminkan kenyataan (lihat /privacy dan /terms bila relevan).

Jika Anda ingin sistem AI (dan crawler pencari) memahami dan mengutip halaman Anda secara andal, Anda perlu mengurangi situasi “konten sama, banyak URL.” Duplikat membuang anggaran crawl, membagi sinyal, dan dapat menyebabkan versi yang salah dari sebuah halaman terindeks atau direferensikan.

Tujuannya adalah URL yang berlaku selama bertahun-tahun. Hindari mengekspos parameter yang tak perlu seperti session ID, opsi pengurutan, atau kode pelacakan di URL yang dapat diindeks (mis. ?utm_source=..., ?sort=price, ?ref=). Jika parameter diperlukan untuk fungsi (filter, paginasi, pencarian internal), pastikan versi “utama” tetap bisa diakses di URL bersih dan stabil.

URL stabil meningkatkan sitasi jangka panjang: ketika sebuah LLM belajar atau menyimpan referensi, besar kemungkinan tetap menunjuk ke halaman yang sama jika struktur URL Anda tidak berubah setiap redesign.

Tambahkan link rel="canonical" pada halaman di mana duplikat diharapkan:

Tag kanonis harus menunjuk ke URL pilihan yang dapat diindeks (dan idealnya URL kanonis itu mengembalikan status 200).

Saat sebuah halaman berpindah permanen, gunakan redirect 301. Hindari rantai redirect (A → B → C) dan loop; mereka memperlambat crawler dan dapat menyebabkan pengindeksan parsial. Arahkan URL lama langsung ke tujuan akhir, dan jaga konsistensi antar HTTP/HTTPS dan www/non-www.

Implementasikan hreflang hanya bila Anda benar‑benar memiliki padanan yang dilokalisasi (bukan sekadar potongan terjemahan). Hreflang yang salah bisa menciptakan kebingungan tentang halaman mana yang harus disitasi untuk audiens tertentu.

Sitemap dan tautan internal adalah “sistem pengiriman” Anda untuk penemuan: mereka memberi tahu crawler apa yang ada, apa yang penting, dan apa yang harus diabaikan. Untuk crawler AI dan pengindeksan LLM, tujuannya sederhana—buat URL terbaik Anda mudah ditemukan dan sulit terlewat.

Sitemap Anda harus memasukkan hanya URL kanonis yang dapat diindeks. Jika sebuah halaman diblok robots.txt, diberi noindex, diarahkan, atau bukan versi kanonis, itu tidak seharusnya ada di sitemap. Ini menjaga anggaran crawler terfokus dan mengurangi kemungkinan LLM mengambil versi duplikat atau usang.

Konsistenkan format URL (trailing slash, huruf kecil, HTTPS) sehingga sitemap mencerminkan aturan kanonis Anda.

Jika Anda punya banyak URL, pisahkan menjadi beberapa file sitemap (batas umum: 50.000 URL per file) dan publikasikan indeks sitemap yang mencantumkan setiap sitemap. Atur berdasarkan jenis konten bila membantu, mis.:

/sitemaps/pages.xml/sitemaps/blog.xml/sitemaps/docs.xmlIni memudahkan pemeliharaan dan membantu memantau apa yang ditemukan.

lastmod sebagai sinyal kepercayaan, bukan timestamp deploymentPerbarui lastmod dengan bijak—hanya saat halaman benar-benar berubah maknanya (konten, harga, kebijakan, metadata kunci). Jika setiap URL diperbarui di setiap deploy, crawler belajar mengabaikan field ini, dan pembaruan penting mungkin ditinjau lebih lambat dari yang Anda inginkan.

Struktur hub-and-spoke yang kuat membantu pengguna dan mesin. Buat hub (kategori, produk, atau halaman topik) yang menautkan ke halaman “spoke” paling penting, dan pastikan setiap spoke menautkan kembali ke hubnya. Tambahkan tautan kontekstual di dalam salinan, bukan hanya di menu.

Jika Anda menerbitkan konten edukasional, jaga titik masuk utama jelas—arahkan pengguna ke /blog untuk artikel dan /docs untuk referensi mendalam.

Data terstruktur adalah cara memberi label apa itu sebuah halaman (artikel, produk, FAQ, organisasi) dalam format yang dapat dibaca mesin secara andal. Mesin pencari dan sistem AI tidak perlu menebak teks mana judulnya, siapa penulisnya, atau entitas utama—mereka bisa mem-parsenya langsung.

Gunakan tipe Schema.org yang cocok dengan konten Anda:

Pilih satu tipe utama per halaman, lalu tambahkan properti pendukung (mis. sebuah Article dapat merujuk Organization sebagai publisher).

Crawler AI dan mesin pencari membandingkan data terstruktur dengan halaman yang terlihat. Jika markup mengklaim sebuah FAQ yang sebenarnya tidak ada di halaman, atau mencantumkan nama penulis yang tidak muncul, Anda menciptakan kebingungan dan berisiko markup diabaikan.

Untuk halaman konten, sertakan author serta datePublished dan dateModified bila itu nyata dan bermakna. Ini membuat kesegaran dan akuntabilitas lebih jelas—dua hal yang sering dicari LLM saat memutuskan apa yang bisa dipercaya.

Jika Anda punya profil resmi, tambahkan tautan sameAs (mis. profil sosial terverifikasi perusahaan) ke skema Organization.

{

"@context": "https://schema.org",

"@type": "Article",

"headline": "Build a Website Ready for AI Crawlers and LLM Indexing",

"author": { "@type": "Person", "name": "Jane Doe" },

"datePublished": "2025-01-10",

"dateModified": "2025-02-02",

"publisher": {

"@type": "Organization",

"name": "Acme",

"sameAs": ["https://www.linkedin.com/company/acme"]

}

}

Terakhir, validasi dengan alat pengujian umum (Google’s Rich Results Test, Schema Markup Validator). Perbaiki error, dan perlakukan peringatan secara pragmatis: prioritaskan yang terkait tipe yang Anda pilih dan properti kunci (judul, penulis, tanggal, info produk).

File llms.txt adalah "kartu indeks" kecil yang bisa dibaca manusia untuk situs Anda yang menunjuk crawler berfokus model bahasa (dan orang yang mengonfigurasinya) ke titik masuk paling penting: docs, halaman produk kunci, dan materi referensi yang menjelaskan terminologi Anda.

Ini bukan standar dengan perilaku terjamin di semua crawler, dan Anda tidak boleh menganggapnya menggantikan sitemap, kanonikal, atau kontrol robots. Anggap itu sebagai shortcut berguna untuk penemuan dan konteks.

Letakkan di akar situs agar mudah ditemukan:

/llms.txtIdenya sama seperti robots.txt: lokasi yang dapat diprediksi, fetch cepat.

Jaga singkat dan terkurasi. Kandidat yang baik:

Pertimbangkan juga menambahkan catatan gaya singkat yang mengurangi ambiguitas (mis. “Kami menyebut pelanggan ‘workspaces’ di UI kami”). Hindari salinan pemasaran panjang, dump URL penuh, atau apa pun yang bertentangan dengan URL kanonis Anda.

Berikut contoh sederhana:

# llms.txt

# Purpose: curated entry points for understanding and navigating this site.

## Key pages

- / (Homepage)

- /pricing

- /docs

- /docs/getting-started

- /docs/api

- /blog

## Terminology and style

- Prefer "workspace" over "account".

- Product name is "Acme Cloud" (capitalized).

- API objects: "Project", "User", "Token".

## Policies

- /terms

- /privacy

Konsistensi lebih penting daripada volume:

robots.txt (itu menciptakan sinyal campur aduk).Rutin praktis yang mudah dikelola:

llms.txt dan konfirmasi itu masih titik masuk terbaik.llms.txt setiap kali Anda memperbarui sitemap atau mengubah kanonis.Jika dikerjakan dengan baik, llms.txt tetap kecil, akurat, dan benar-benar berguna—tanpa menjanjikan bagaimana crawler tertentu akan berperilaku.

Crawler (termasuk yang berfokus AI) berperilaku mirip pengguna yang tidak sabar: jika situs Anda lambat atau tidak stabil, mereka akan mengambil lebih sedikit halaman, lebih jarang mencoba lagi, dan memperbarui indeks mereka lebih lambat. Performa yang baik dan respons server yang andal meningkatkan kemungkinan konten Anda ditemukan, di-crawl ulang, dan selalu diperbarui.

Jika server Anda sering timeout atau mengembalikan error, crawler mungkin akan mundur otomatis. Itu berarti halaman baru bisa memakan waktu lebih lama untuk muncul, dan pembaruan mungkin tidak cepat tercermin.

Bidik uptime yang stabil dan waktu respons yang dapat diprediksi pada jam sibuk—bukan hanya skor “lab” yang bagus.

Time to First Byte (TTFB) adalah sinyal kuat kesehatan server. Beberapa perbaikan berdampak tinggi:

Meskipun crawler tidak “melihat” gambar seperti manusia, file besar tetap membuang waktu dan bandwidth crawl.

Crawler mengandalkan kode status untuk memutuskan apa yang disimpan dan apa yang dibuang:

Jika teks artikel utama memerlukan autentikasi, banyak crawler hanya akan mengindeks shell. Pertahankan akses membaca inti publik, atau sediakan preview yang dapat di-crawl yang mencakup konten kunci.

Lindungi situs dari penyalahgunaan, tetapi hindari blok kasar. Pilih:

Retry-AfterIni menjaga situs aman sambil tetap membiarkan crawler bertanggung jawab melakukan pekerjaannya.

“E‑E‑A‑T” tak butuh klaim besar atau lencana mewah. Untuk crawler AI dan LLM, ini sebagian besar berarti situs Anda jelas tentang siapa yang menulis sesuatu, dari mana fakta berasal, dan siapa yang bertanggung jawab memeliharanya.

Saat Anda menyebut fakta, lampirkan sumber sedekat mungkin dengan klaim. Prioritaskan referensi primer dan resmi (undang-undang, badan standar, dokumen vendor, jurnal peer‑review) daripada ringkasan pihak kedua.

Contoh: jika menyebut perilaku data terstruktur, kutip dokumentasi Google (“Google Search Central — Structured Data”) dan, bila relevan, definisi schema (“Schema.org vocabulary”). Jika membahas direktif robots, rujuk standar terkait dan dokumen crawler resmi (mis. “RFC 9309: Robots Exclusion Protocol”). Bahkan jika Anda tak menautkan setiap sebutan, sertakan detail yang cukup agar pembaca dapat menemukan dokumen yang dimaksud.

Tambahkan byline penulis dengan bio singkat, kredensial, dan tanggung jawab editorial. Lalu buat kepemilikan eksplisit:

Hindari bahasa seperti “terbaik” dan “dijamin”. Sebaliknya, jelaskan apa yang Anda uji, apa yang berubah, dan batasannya. Tambahkan catatan pembaruan di bagian atas atau bawah halaman kunci (mis. “Diperbarui 2025‑12‑10: memperjelas penanganan kanonis untuk redirect”). Ini menciptakan jejak pemeliharaan yang bisa diinterpretasikan manusia dan mesin.

Definisikan istilah inti sekali, lalu gunakan secara konsisten di seluruh situs (mis. “AI crawler,” “pengindeksan LLM,” “rendered HTML”). Halaman glosarium ringan (mis. /glossary) mengurangi ambiguitas dan membuat konten lebih mudah diringkas secara akurat.

Situs siap-AI bukanlah proyek sekali jalan. Perubahan kecil—seperti update CMS, redirect baru, atau navigasi yang didesain ulang—dapat diam-diam merusak penemuan dan pengindeksan. Rutinitas pengujian sederhana menjaga Anda dari menebak ketika trafik atau visibilitas bergeser.

Mulailah dengan dasar: lacak error crawl, cakupan indeks, dan halaman yang paling banyak ditautkan. Jika crawler tidak dapat mengambil URL kunci (timeout, 404, sumber diblokir), pengindeksan LLM cenderung menurun cepat.

Pantau juga:

Setelah peluncuran (bahkan yang “kecil”), tinjau apa yang berubah:

Audit 15 menit pasca-rilis sering menangkap masalah sebelum menjadi kehilangan visibilitas jangka panjang.

Pilih beberapa halaman bernilai tinggi dan uji bagaimana mereka diringkas oleh alat AI atau skrip ringkasan internal. Perhatikan:

Jika ringkasan terlalu samar, perbaikannya biasanya bersifat editorial: heading H2/H3 yang lebih kuat, paragraf pembuka yang lebih jelas, dan terminologi yang lebih eksplisit.

Ubah apa yang Anda pelajari menjadi checklist berkala dan tunjuk seorang pemilik (nama nyata, bukan “marketing”). Biarkan checklist hidup dan bisa ditindaklanjuti—lalu tautkan versi terbaru secara internal agar seluruh tim memakai playbook yang sama. Publikasikan referensi ringan seperti /blog/ai-seo-checklist dan perbarui sesuai evolusi situs dan tooling Anda.

Jika tim Anda mengirim cepat (terutama dengan pengembangan berbantu AI), pertimbangkan menambahkan pemeriksaan “AI readiness” langsung ke workflow build/release: template yang selalu menghasilkan tag kanonis, field penulis/tanggal yang konsisten, dan konten inti yang di-render server. Platform seperti Koder.ai dapat membantu dengan membuat default tersebut dapat diulang di seluruh halaman React baru dan permukaan aplikasi—serta memungkinkan iterasi via planning mode, snapshot, dan rollback ketika sebuah perubahan tak sengaja memengaruhi keter-crawl-an.

Perbaikan kecil dan konsisten akan terakumulasi: lebih sedikit kegagalan crawl, pengindeksan yang lebih bersih, dan konten yang lebih mudah dipahami oleh manusia dan mesin.

Itu berarti situs Anda mudah bagi sistem otomatis untuk menemukan, mengurai, dan menggunakan kembali secara akurat.

Dalam praktiknya, ini berarti URL yang dapat di-crawl, struktur HTML yang bersih, atribusi yang jelas (penulis/tanggal/sumber), dan konten yang ditulis sebagai potongan mandiri yang bisa dipasangkan oleh sistem retrieval ke pertanyaan spesifik.

Tidak dapat dijamin secara andal. Penyedia berbeda-cara merayapi pada jadwal yang berbeda, mengikuti kebijakan yang berbeda, dan mungkin sama sekali tidak merayapi Anda.

Fokuslah pada hal yang bisa Anda kendalikan: buat halaman Anda dapat diakses, tidak ambigu, cepat diambil, dan mudah untuk diberi atribusi sehingga jika digunakan, penggunaannya benar.

Usahakan ada HTML bermakna dalam respons awal.

Gunakan SSR/SSG/hibrida untuk halaman penting (harga, docs, FAQ). Lalu tingkatkan dengan JavaScript untuk interaktivitas. Jika teks utama muncul hanya setelah hydration atau pemanggilan API, banyak crawler akan melewatkannya.

Bandingkan:

Jika heading kunci, teks utama, link, atau FAQ hanya muncul di Inspect Element, pindahkan konten itu ke HTML yang di-render server.

Gunakan robots.txt untuk aturan crawl luas (mis. blok /admin/), dan meta robots / X-Robots-Tag untuk keputusan pengindeksan per halaman atau file.

Polanya: noindex,follow untuk halaman utilitas tipis, dan autentikasi (bukan hanya ) untuk area privat.

Gunakan URL kanonis yang stabil dan dapat diindeks untuk setiap konten.

rel="canonical" di tempat duplikat diharapkan (filter, parameter, varian).Ini mengurangi sinyal terpecah dan membuat sitasi lebih konsisten dari waktu ke waktu.

Masukkan hanya URL kanonis yang dapat diindeks.

Kecualikan URL yang diarahkan, noindex, diblok oleh robots.txt, atau duplikat non-kanonis. Pertahankan format konsisten (HTTPS, trailing slash, huruf kecil), dan gunakan lastmod hanya bila konten berubah bermakna.

Anggap itu sebagai “kartu indeks” terkurasi yang menunjuk ke titik masuk terbaik Anda (hub docs, panduan memulai, glosarium, kebijakan).

Jaga singkat, cantumkan hanya URL yang Anda ingin ditemukan dan disitasi, dan pastikan setiap link mengembalikan 200 dengan canonical yang benar. Jangan jadikan pengganti sitemap, canonical, atau directives robots.

Tulislah halaman sehingga potongan bisa berdiri sendiri:

Ini meningkatkan akurasi retrieval dan mengurangi ringkasan yang salah.

Tambahkan dan pertahankan sinyal kepercayaan yang terlihat:

datePublished dan dateModified yang bermaknaPetunjuk ini membuat atribusi dan sitasi lebih dapat diandalkan untuk crawler dan pengguna.

noindex