2025年5月08日·1 分

ベンダー評価とレビューのためのウェブアプリの作り方

ベンダーのスコアカードとレビュー用ウェブアプリの計画、設計、構築方法を、データモデル、ワークフロー、権限設計、レポートのヒントとともに解説します。

画面をスケッチしたりデータベースを選ぶ前に、そのアプリが「何のためにあるのか」、誰が頼りにするのか、そして「良い」とは何かを明確にしてください。ベンダー評価アプリが失敗する最も多い理由は、あらゆる人を同時に満足させようとすること、あるいは「実際にどのベンダーを評価しているのか?」のような基本的な質問に答えられないことです。

目標、ユーザー、適用範囲

誰が使うか(そして彼らが必要とするもの)

まず主要ユーザーグループと彼らの日常的な意思決定を書き出します:

- 調達(Procurement) は一貫したサプライヤースコアカード、ベンダー間の比較ビュー、調達判断を裏付ける監査トレイルを必要とします。\n- ファイナンス(Finance) はコスト差異、支払条件の遵守、予測に影響するリスク信号を重視します。\n- オペレーション(Operations) は迅速な問題解決を望みます:インシデント追跡、是正措置の記録、パフォーマンスが改善しているかの確認。\n- ベンダー(任意のポータル) はフィードバックの可視性、応答方法、スコアの算出方法の明確さを求めます。

有効なコツ:一つの“コアユーザー”(多くの場合は調達)を選び、最初のリリースはそのワークフローに合わせて設計します。次のグループは、それによってどんな新しい機能が可能になるのかを説明できるようになってから追加します。

目指す主要成果

成果は機能ではなく測定可能な変化として書きます。よくある成果は:

- より良いサプライヤー判断(例:証拠に基づく優先ベンダー一覧)\n- より速い問題解決(明確な責任、期限、フォローアップ)\n- より一貫した評価(レビュワーや拠点間のばらつき減少)

これらの成果が後でKPIの選定やレポーティング設計を導きます。

システム内で「ベンダー」が何を意味するか定義する

「ベンダー」は組織構造や契約によって意味が変わります。早めに決めてください:

- 法的主体(親会社)\n- サイト/ロケーション(工場や地域ごとに品質が異なる場合に有用)\n- サービスライン(同じサプライヤが物流と包装など複数のサービスを提供する場合)

選択はスコアの集約、権限、そして一つの施設の不具合が関係全体に影響するかどうかに関わります。

スコアリングアプローチを選ぶ

一般的なパターンは三つです:

- 重み付きKPI:納期%や欠陥率などの数値入力に重みを掛ける。透明性と自動化に優れる。\n- ルーブリック:レビュワーがレベルを選び、ガイダンス文が付く。定性的データに向く。\n- ハイブリッド:計測可能な領域はKPI、協働性や応答性はルーブリックで評価。

スコアの方法はベンダー(や内部監査人)が追跡できるほど理解しやすくしてください。

アプリの成功指標を定義する

導入と価値を検証するためのアプリレベルの指標をいくつか選びます:

- 採用率:直近四半期に少なくとも1件レビューがあるアクティブなベンダーの割合\n- レビューの完了度:必須フィールドの入力、証拠の添付、KPIの提供率\n- サイクルタイム:レビュー開始→承認→ベンダー共有(該当する場合)までの時間

目標とスコープが明確になれば、次のスコアリングモデルとワークフロー設計の土台が整います。

スコアリングモデルとKPI設計

ベンダー評価アプリは、スコアが現場の実感に合っているかどうかで成否が決まります。画面を作る前に、正確なKPI、スケール、ルールを書き下し、調達・オペレーション・ファイナンスが同じように解釈できるようにしてください。

小さく防御可能なKPIセットを選ぶ

ほとんどのチームが認識するコアセットから始めます:

- 納期遵守(例:合意された窓内の出荷%)\n- 品質(欠陥率、返品率、検査合格%)\n- SLA遵守(目標時間内に解決されたチケット、関連するアップタイム)\n- コスト差異(請求額 vs 発注額の差、予期せぬ請求)\n- 応答性(初回応答時間、エスカレーションの解決時間)

定義を測定可能にし、各KPIをデータソースやレビューの質問に紐づけてください。

人が説明できる評価スケールを定義する

1–5(人間向けに簡単)か0–100(より細かい)を選び、各レベルの意味を定義します。例えば「納期遵守:5 = ≥ 98%、3 = 92–95%、1 = < 85%」のようにします。明確な閾値は議論を減らしチーム間の比較を可能にします。

重みづけ、欠損データ、公平性ルール

カテゴリの重みを割り当て(例:納期30%、品質30%、SLA20%、コスト10%、応答性10%)し、契約タイプにより重みが変わる場合はその旨を文書化します。

欠損データの扱いを決めます:

- その期間の分母から除外する、または\n- 中立のデフォルトを適用する、または\n- 「データ不十分」としてスコアを示しランキングをブロックする

どれを選ぶにせよ、一貫して適用し、ドリルダウンビューで可視化して「欠損」を「良好」と誤読されないようにします。

ベンダーごとの複数スコアカード

チームが契約別、地域別、期間別に比較できるように、ベンダーごとに複数のスコアカードをサポートします。これにより特定のサイトやプロジェクトに限定された問題が平均化されて見えなくなるのを防げます。

異議申立てと修正

異議がスコアにどう影響するかを文書化します:指標を遡って修正できるか、異議が一時的にスコアをフラグするか、どの版が「公式」と見なされるか。例えば「修正が承認されたらスコアを再計算し、変更理由を注記する」といった簡単なルールでも混乱を防げます。

データモデルとスキーマの基本

クリーンなデータモデルは、スコアの公平性、レビューの追跡性、レポートの信頼性を保ちます。シンプルな質問に確実に答えられるようにしたい——「なぜこのベンダーは今月72になったのか?」や「前四半期から何が変わったか?」といった問いに、手作業や根拠の乏しい説明なしで答えられることが目標です。

コアエンティティ(保存するもの)

最低限、次のエンティティを定義します:

- Vendor(ベンダー):プロファイル(名称、ステータス、カテゴリ、連絡先)\n- Contract(契約):商業条件と有効期間\n- Order/Invoice(または統合された Transaction):KPIを駆動する運用事実\n- KPI Metric:納期遵守%や欠陥率等の定義\n- Score(スコア):期間ごとの計算結果(総合および指標別)\n- Review(レビュー):定性的フィードバック、評価、証拠となる談話\n- Attachment(添付):レビューや異議に紐づくファイル(メール、写真、PDF)

このセットは「ハード」な計測値と「ソフト」なユーザーフィードバックの両方を扱うワークフローを支えます。

リレーションシップ(データのつながり)

リレーションは明示的にモデル化します:

- Vendor → Contracts:一つのベンダーに複数の契約が存在し得る\n- Vendor → Orders/Invoices:取引は通常ベンダーへ多対一\n- Score → Metric:スコアはメトリック定義と計算バージョンに紐づくべき\n- Review → Period:レビューは明確な期間(年月/四半期)に紐づく必要がある

一般的なアプローチ:

scorecard_period(例:2025-10)\n-vendor_period_score(総合)\n-vendor_period_metric_score(指標ごと、分子/分母を含む)

後で役立つフィールド

ほとんどのテーブルで一貫して持っていると便利なフィールドを追加します:

- タイムスタンプ:

created_at、updated_at、承認用にsubmitted_at、approved_at\n- 作成者・アクター:created_by_user_id、承認者用にapproved_by_user_id\n- ソースシステム:source_systemと外部識別子(erp_vendor_id、crm_account_id、erp_invoice_id)\n- 信頼度/品質:confidenceスコアやdata_quality_flagで不完全なフィードをマーク

これらは監査トレイル、異議処理、信頼できる調達分析を可能にします。

保持、バージョン、変更の履歴

スコアはデータの遅延到着や定義の変更、マッピング修正で変わります。履歴を上書きする代わりにバージョンを保存しましょう:

- 各スコア行に スコアバージョン(または

calculation_run_id)を持たせる\n- 再計算の理由コード(遅延請求、KPI定義の更新、手動修正)を記録する\n- 重要テーブル(スコア、レビュー、承認)に対して追記のみの監査トレイルを検討して、誰がいつ何を変更したかを示せるようにする

保存期間については、生のトランザクションと派生スコアの保持期間を分けることが多いです。派生スコアは長めに保持し(小さい容量で高い報告価値)、生のERP抽出は短めのポリシーにすることがあります。

ERP/CRMマッチングの識別子戦略

外部IDを備考ではなくファーストクラスのフィールドとして扱います:

- 外部IDとシステム名を両方保存(例:ERP_A vs ERP_B)\n- システムごとに一意性を強制(例:

unique(source_system, external_id))\n- ベンダーのマージ/分割時に履歴スコアが正確に保たれるよう、軽量のマッピングテーブルを追加する

これらにより、後半の統合、KPI追跡、レビューのモデレーション、監査可能性の実装が容易になります。

データ取り込みと統合

ベンダー評価アプリは入力データの質で決まります。最初から複数の取り込み経路を計画しておくと良い(最初は一つでも問題ない)。多くのチームは手動入力、履歴の一括アップロード、継続的なAPI同期を組み合わせて使います。

よくあるデータソース

手動入力は小規模サプライヤや一時的インシデント、すぐにレビューを記録したいときに有用です。

CSVアップロードは過去データのブートストラップに便利です。テンプレートを公開しバージョン管理を行って、変更でインポートが壊れないようにします。

API同期は通常ERP/調達ツール(PO、受領、請求)やサービスシステム(チケット、SLA違反)と接続します。全件取得ではなく増分同期(最後のカーソル以降)を優先してください。

不正データを防ぐバリデーション

インポート時に明確なバリデーションルールを設定します:

- 必須フィールド(ベンダーID、日付、指標名/値)\n- 数値レンジ(0–100、負でない数量など)\n- 重複検出(同じベンダー+指標+期間+ソースレコードID)

不正な行はエラーメッセージ付きで保存し、管理者が修正して再アップロードできるようにします。

修正、バックフィル、再計算ログ

インポートは誤りが発生します。再実行(ソースIDで冪等に)、バックフィル(過去期間)、そして何がいつなぜ変わったかを記録する再計算ログをサポートしてください。ベンダーのスコアが変わったときに信頼を守るために重要です。

スケジューリングと可視性

多くのチームはファイナンスや納期指標で日次/週次の取り込み、重要インシデントは準リアルタイムで十分です。

管理者向けのインポートページ(例:/admin/imports)を用意し、ステータス、行数、警告、正確なエラーを表示して開発者の手を借りずに問題を解決できるようにします。

ロール、権限、承認ワークフロー

明確なロールと予測可能な承認経路は「スコアカードの混乱」を防ぎます:競合する編集、突然の評価変更、ベンダーが何を見られるかの不確実性を防ぐため、早期にアクセスルールを定義しUIとAPIで一貫して強制してください。

ロールの種類(何のためにあるか)

実用的な初期ロールセット:

- 管理者(Admin):組織設定、ロール割当、スコアリングテンプレート、モデレーションルールを管理\n- 内部レビュワー(Internal Reviewer):レビュー、証拠、ドラフトのスコア更新を提出\n- 承認者(Approver):公開レビュー、期間のロック、スコア変更の承認などの重要な行為を検証\n- ベンダーユーザー(Vendor User):自社のスコアカードの閲覧、レビューへの応答、必要であれば説明のアップロード\n- 読み取り専用(Read-only):ダッシュボードやベンダープロファイルを閲覧できるが編集不可

実際の行為に結びつく権限

「ベンダーを管理できる」のような曖昧な権限は避け、特定の操作を制御します:

- 表示:誰がレビュー、レビュワー名、添付、履歴スコアを見られるか\n- 編集:誰がドラフトを作成/編集できるか、KPI値や重みを変更できるか\n- 公開:誰がドラフトを公開状態にできるか\n- エクスポート:誰が報告書(CSV/PDF)をダウンロードできるか、スコープ(単一ベンダー vs 全ベンダー)

「自身のベンダーをエクスポート可能」か「全てをエクスポート可能」かで権限を分けることを検討してください。

ベンダーへの可視性ルール

ベンダーユーザーは通常自社データのみを閲覧:自社のスコア、公開されたレビュー、未解決項目の状況など。レビュワーの個人情報はデフォルトで制限(部署や役職のみ表示してフルネームは出さない)し、応答を許可する場合はスレッド化して明確にベンダー由来であることを示します。

信頼性と一貫性のための承認フロー

レビューやスコア変更は**提案(プロポーザル)**として扱います:

- 内部レビュワーがドラフトレビュー/スコア更新を提出\n- 承認者が証拠を確認し、承認、差し戻し、却下のいずれかを実行\n- 承認された項目のみが「現在の」スコアに反映され、ベンダーに見えるようになる

締め処理のタイミングに応じて承認の要否を時間限定にする(例:月次/四半期クロージング時のみ承認必要)といったルールも有効です。

監査トレイル要件

コンプライアンスと説明責任のために、すべての重要なイベントをログに残します:誰が何をいつどこからどのように変更したか(変更前/変更後の値)。監査エントリは検索可能でエクスポート可能にし、不正防止のために追記のみのストレージや不変ログを活用してください。

UXとコア画面

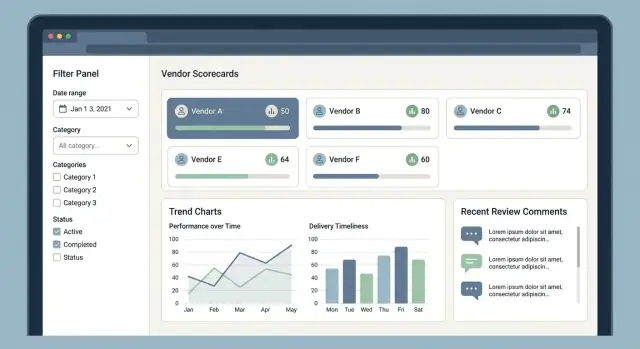

コアアプリを立ち上げる

ベンダー向けのWebアプリ、スコアカード、レビュー、レポートを一元生成

ベンダー評価アプリの成功は、忙しいユーザーが目的のベンダーを素早く見つけ、スコアを一目で理解し、摩擦なく信頼できるフィードバックを残せるかにかかっています。まずは小さな「ホームベース」画面群から始め、すべての数値に説明が付くようにしてください。

1) ベンダー一覧(コマンドセンター)

ここがほとんどのセッションの出発点です。レイアウトはシンプルに:ベンダー名、カテゴリ、地域、現在のスコア帯、ステータス、最終アクティビティ。

フィルタと検索は即時に感じられるべきです:

- カテゴリ、地域、ステータス(アクティブ/保留/ブロック)\n- 日付範囲(例:最終レビュー、最終納期インシデント)\n- スコア帯(A/B/C または 0–100 レンジ)

「EMEAのクリティカルベンダーで70未満」などのよく使うビューを保存できるようにして、毎回フィルタを作り直す手間を省きます。

2) ベンダープロファイル(1ページで多くの答え)

ベンダープロファイルは「誰であるか」と「どのように推移しているか」を要約し、タブを強制しすぎない作りにします。連絡先・契約メタデータをスコア要約の近くに置きます。

3) スコアカードとドリルダウン(なぜかを示す)

総合スコアとKPI内訳(品質、納期、コスト、コンプライアンス)を表示します。各KPIには可視のソースが必要:どのレビュー、問題、メトリクスがそれを生んだのか。

良いパターン:

- KPI → 公式/重み → 寄与項目 → 証拠(コメント、添付、タイムスタンプ)

4) レビューと問題(迅速入力、強い文脈)

レビュー入力はモバイル対応(大きなタッチターゲット、短いフィールド、素早いコメント)にします。レビューは必ず期間に紐づけ、関連する発注書やサイト、プロジェクトがある場合は紐づけてアクション可能にします。

5) レポート(意思決定に使える形)

レポートは「どのサプライヤーが下がっているか」「今月何が変わったか」に答えるべきです。読みやすいチャート、明確なラベル、アクセシビリティのためのキーボード操作を考慮してください。

レビュー、コメント、モデレーション

レビューはスコアの“なぜ”を記録する場所であり、文脈や証拠を保存します。これを一貫性(かつ説明可能)に保つために、レビューはまず構造化されたレコードとし、自由記述はその後位に扱うことを推奨します。

サポートすべきレビュータイプ

状況に応じてテンプレートを分けます:

- 定期レビュー(月次/四半期):パフォーマンスとトレンド追跡のための定期フォーム\n- インシデントベースレビュー:遅延納品、品質欠陥、コンプライアンス問題に紐づくもの\n- プロジェクトクロージングレビュー:契約終了時の総括と学び

各タイプは共通フィールドを持ちつつ、タイプ固有の質問を許容し、無理に当てはめるのを避けます。

構造化フィールド:レビューを検索可能にする

ナラティブに加えて、検索やレポートに使える構造化入力を設けます:

- タグ/カテゴリ(例:物流、品質、コミュニケーション)\n- 強みと課題(片寄ったフィードバックを避けるため別々に)\n- アクションアイテム(担当、期日、ステータス)

これによりフィードバックが単なるテキストではなく追跡可能な作業になります。

証拠の扱い(面倒にしすぎない)

レビュワーがレビューを書く場所で証拠を添付できるようにします:

- ファイル添付(写真、PDF)\n- 共有ドキュメントへのリンク\n- チケット/PO/注文への参照(できれば選択式)

アップロードした人、日時、関連先などのメタデータを保存して、監査時に手がかりが散逸しないようにします。

モデレーションと編集履歴

内部ツールでもモデレーションは必要です。以下を追加します:

- 基本的な不適切語/スパムチェック\n- 重大な主張(安全、詐欺など)用のエスカレーションルール\n- 変更履歴(誰が何を変更したか。赤字訂正も含む)

無言編集は避けてください—透明性はレビュワーとベンダー双方を守ります。

通知、リマインダー、応答SLA

通知ルールを事前に定義します:

- レビュー公開時またはベンダー応答が要求されたときにベンダーへ通知\n- 未完了のアクションアイテムへの内部リマインダー\n- 応答SLA(例:5営業日)と欠損時のエスカレーション

これをうまくやれば、レビューは一度きりの苦情ではなくクローズドループのフィードバックワークフローになります。

アーキテクチャと技術選定

レビュー入力を簡単に

モバイル対応のレビュー機能を追加して、チームが外出先でも事象を記録できるように

最初の設計判断は「最新技術」よりも、信頼できるベンダー評価・レビュー基盤をどれだけ早く安定して出せるかに重心を置いてください。迅速に動きたいなら、仕様から動くプロトタイプを生成できるプラットフォームでワークフローを検証するのが有効です。例えば、Koder.ai のようなvibe-codingプラットフォームはチャットでWeb/バックエンド/モバイルを組み立て、準備ができたらソースをエクスポートできます。これはスコアリングモデルや権限ワークフローを検証する現実的な方法です。

モノリス vs モジュラーサービス(シンプルに保つ)

多くのチームにはモジュラーモノリスがちょうど良い:デプロイ可能な単一アプリだが、モジュール(Vendors、Scorecards、Reviews、Reporting、Admin)に分けて整理する。開発・デバッグが単純で、セキュリティとデプロイも容易です。

重いレポーティング負荷や複数プロダクトチーム、厳格な隔離要件がない限り、分割は慎重に行います。一般的な進化経路は「今はモノリス、必要になったら imports/reporting を切り出す」です。

API設計(実業務に対応するREST)

REST APIは一般的に理解しやすく統合しやすいので推奨です。予測可能なリソースと、システムが実際の仕事をする「タスク」エンドポイントをいくつか用意します。

例:

/api/vendors(ベンダーの作成/更新、ステータス)\n-/api/vendors/{id}/scores(現在スコア、履歴内訳)\n-/api/vendors/{id}/reviews(一覧/作成)\n-/api/reviews/{id}(更新、モデレーション操作)\n-/api/exports(エクスポート要求→ジョブIDを返す)

エクスポートや一括再計算のような重い処理は非同期にしてUIの応答性を保ちます。

バックグラウンドジョブ(取り込み、再計算、通知)

ジョブキューを使う処理:

- サプライヤーデータの取り込み(CSV/SFTP/API)\n- KPIや重み、レビュー変更時の再計算\n- 通知送信(レビュー要求、スコア変更、承認が必要)

これにより失敗時のリトライや手作業の対応を減らせます。

ダッシュボードと重いレポートのキャッシュ

ダッシュボードはコストがかかるため、集計済みメトリクスをキャッシュして意味ある変更時に無効化するかスケジュール更新します。これによりドリルダウンは正確さを保ちつつ「開いたときの画面」を高速にできます。

ドキュメント(開発者と管理者向け)

APIドキュメント(OpenAPI/Swagger)と、内部管理者向けのブログ形式ガイド(例:/blog)を用意します。例えば「スコアの仕組み」「異議レビューの扱い方」「エクスポートの実行方法」などをリンクして、アプリ内から参照できるようにしてください。

セキュリティ、プライバシー、信頼性

ベンダー評価データは契約や評判に影響するため、予測可能で監査可能、非技術者にも分かりやすいセキュリティ制御が必要です。

認証とアクセス制御

適切なサインインオプションを用意します:

- 小規模チーム向けにメール/パスワード(強固なパスワードルールと可能ならMFAを使用)\n- 企業向けにSSO(SAMLまたはOIDC)でアクセス集中管理と即時のアクセス取り消しを可能にする

認証に加え、RBAC(ロールベースのアクセス制御)を導入し、権限は細かく(例:「スコアを見る」vs「レビュー本文を見られる」)設定します。スコア変更、承認、編集については監査トレイルを残してください。

機密データの保護

データは**転送中(TLS)と保存時(DBとバックアップ)**で暗号化します。シークレット(DBパスワード、APIキー、SSO証明書)は以下のように扱います:

- マネージドなシークレットボルトに保管\n- 定期的にローテーション\n- リポジトリにコミットしない

悪用防止と安全なエンドポイント

内部向けでも、パブリックに公開されるエンドポイント(パスワードリセット、招待リンク、レビュー提出フォーム)は悪用され得ます。必要な箇所にレート制限やボット防止(CAPTCHAやリスクスコアリング)を入れ、APIはスコープ付きトークンで保護します。

プライバシーを組み込む設計

レビューには名前やメール、インシデント詳細が含まれることが多いので、デフォルトで個人情報を最小化します(自由記述より構造化フィールドを優先)、保持ルールを定め、必要に応じて内容を匿名化・削除できるツールを提供します。

信頼できる運用でデータを漏らさない

トラブルシューティングに十分なログ(リクエストID、遅延、エラーコード)は残しますが、機密なレビュー本文や添付をログに含めないでください。監視とアラートは失敗したインポート、スコア計算ジョブのエラー、異常なアクセスパターンに対して設定します—ただしログを別の機密データベースにしないよう注意します。

レポーティング、ダッシュボード、説明可能性

ベンダー評価アプリは意思決定を支えるために役立つ必要があります。レポーティングは「誰がどう良いか/何と比較するか/なぜか」を速く答えられるように設計します。

忙しいステークホルダー向けのダッシュボード

まずはエグゼクティブダッシュボード:総合スコア、スコア推移、カテゴリ内訳(品質、納期、コンプライアンス、コスト、サービス等)を要約します。トレンド線は重要です:わずかにスコアが低いが改善中のベンダーは、スコアは高いが下落しているベンダーより価値がある場合があります。

ダッシュボードは期間、事業部/サイト、ベンダーカテゴリ、契約でフィルタ可能にし、一貫したデフォルト(例:直近90日)を設定して複数の人が同じ画面を見たときに比較が効くようにします。

ベンチマークとアクセス制御

ベンチマークは強力だがセンシティブです。同一カテゴリ内での比較(例:「包装資材サプライヤ」)を許可しつつ、権限を守ります:

- 調達リーダーは名称での比較を見られる\n- サイトマネージャは自分が担当するベンダーのみ\n- 一般ステークホルダーには匿名のランクや四分位表示

これにより意図しない情報公開を防ぎつつ選定判断を支援できます。

スコアからソースへのドリルダウン

ダッシュボードはスコア変動を説明するドリルダウンにリンクするべきです:

- 期間別:月次/四半期のロールアップとKPI差分\n- サイト別:特定拠点の問題(ある工場での遅延など)\n- 契約別:パフォーマンスがSLAや商談条件に合致しているか

良いドリルダウンは「何が起きたか」の証拠(関連レビュー、インシデント、チケット、出荷記録)で終わります。

社内共有用のエクスポート

CSV(分析用)とPDF(共有用)をサポートします。エクスポートは画面のフィルタを反映し、タイムスタンプを含め、必要であれば内部利用専用の透かし(および閲覧者ID)を付けて外部転送を抑止します。

説明可能性:スコアの算出方法を示す

ブラックボックス化しないでください。各ベンダースコアは明確な内訳を持つべきです:

- KPIの寄与(重み、原値、正規化)\n- 適用されたペナルティ/ボーナス(例:重大なコンプライアンス違反)\n- 計算ノートとバージョン(フォーミュラ変更が監査可能になる)

ユーザーが計算詳細を見られると、異議は素早く解決され、改善計画の合意も取りやすくなります。

テストと品質チェック

早期に権限を固める

RBACと承認フローを設定し、承認されたスコアのみ正式化されるように

ベンダー評価プラットフォームのテストはバグ検出だけでなく信頼保護が目的です。調達チームはスコアが正しいと確信する必要があり、ベンダーはレビューと承認が一貫して扱われることを期待します。

実際の混乱を反映したテストデータを作る

欠損KPI、遅延提出、インポート間の矛盾、異議申し立てのケース(例:納期SLAに対するベンダーのチャレンジ)などエッジケースを含む小さな再利用可能なテストデータを作成します。活動がない期間や、KPIはあるが日付不正で除外されるケースも含めます。

スコアロジックを単体テストで検証

スコア計算はプロダクトの中核なので、金融計算のようにテストします:

- 重みづけルール(重みが100%に満たない場合の扱い等)\n- 四捨五入や順位の同点処理\n- 閾値(KPIが「良好」から「要注意」に変わるとき)\n- KPI定義変更に対する回帰テスト

単体テストは最終スコアだけでなく中間結果(指標別スコア、正規化、ペナルティ/ボーナス)も検証し、失敗箇所を特定しやすくします。

取り込み、権限、ワークフローを統合テストでカバー

統合テストはエンドツーエンドをシミュレート:サプライヤースコアカードのインポート→権限適用→正しい役割だけが表示/コメント/承認/異議エスカレーションできることを確認します。監査トレイルとブロックされる操作(例:承認済みレビューのベンダーによる編集)に対するテストも含めます。

UATとパフォーマンスチェックで検証

調達部門とパイロットベンダーグループでユーザー受け入れテストを行い、混乱ポイントを洗い出してUI文言、バリデーション、ヘルプヒントを改善します。

最後に、月末/四半期末のピーク負荷を想定したパフォーマンステストを行い、ダッシュボードの読み込み時間、一括エクスポート、並行再計算ジョブを検証します。

ローンチ計画と反復ロードマップ

ベンダー評価アプリは実際に使われて初めて成功します。スプレッドシートを慎重に置き換え、段階的にリリースして何がいつ変わるかの期待値を設定することが大切です。

信頼を築く段階的ローンチ

最小限で有用なスコアカードを提供するところから始めます。

フェーズ1:内部限定スコアカード。 調達と関係者がKPI値を記録し、簡潔なサプライヤースコアカードを生成し、内部メモを残せる場所を提供します。ワークフローを簡素に保ち、一貫性に注力します。

フェーズ2:ベンダーアクセス。 内部スコアリングが安定したらベンダーを招待し、自社スコアカードの閲覧、フィードバックへの応答、状況説明(例:港の閉鎖による遅延)を可能にします。ここで権限と監査トレイルが重要になります。

フェーズ3:自動化。 スコアリングモデルを信用できるようになった段階で統合や定期再計算を追加します。早すぎる自動化は不良データや不明確な定義を増幅する危険があります。

短時間でパイロットを立ち上げたい場合、Koder.aiのようなプラットフォームでコアワークフロー(ロール、レビュー承認、スコアカード、エクスポート)を素早く立ち上げ、調達のステークホルダーと設計を繰り返してからコードをエクスポートして本格化する方法が役立ちます。

マイグレーション計画(スプレッドシートを安全に卒業)

スプレッドシートの置き換えは一斉切替ではなく移行期間を設けるのが安全です。

インポートテンプレートは既存の列(ベンダー名、期間、KPI値、レビュワー、ノート)に合わせます。検証エラー(「不明なベンダー」)やプレビュー、ドライランモードを提供して、データ移行を管理しやすくします。

履歴データを全て移すか直近だけ移すかも決めます。多くのチームは過去4–8四半期を取り込めばトレンド分析に十分で、データ考古学を避けられます。

読んでもらえる研修資料

役割別に短くまとめます:

- レビュワー、承認者、管理者向けの1ページクイックガイド\n- 初回利用時のアプリ内ヒント(どうスコアするか、文脈はどこに書くか、「提出」が何を意味するか)\n- 管理者チェックリスト:カテゴリ作成、KPI定義設定、レビュサイクル構成、アクセス確認

維持と反復

スコア定義はプロダクトとして扱います。KPIは変わり、カテゴリは増え、重みは進化します。

再計算ポリシーを事前に決めます:KPI定義が変わったときに過去スコアを再計算するか、監査性のために元の計算を保存するか。多くは有効日以降のみ再計算する方針を取ります。

次のステップ:価格設定とパッケージ

パイロットを越える段階では、各ティアに含める内容(ベンダー数、レビューサイクル数、統合、上級レポーティング、ベンダーポータルアクセス)を決めます。商用化を進めるならパッケージを定義し、詳細は /pricing にリンクします。

構築か購入かあるいは加速するかを検討する際には「信頼できるMVPをどれだけ早く出せるか」をパッケージの要素として扱うと良いでしょう。Koder.aiのようなプラットフォームは、迅速に構築・反復・デプロイしつつ、最終的にソースをエクスポートして所有するオプションを残せる実用的な橋渡しになります。

よくある質問

ベンダー評価アプリの範囲はどう定めれば、誰にでも合わせようとして失敗しない?

まずは一人の「コアユーザー」に最適化して最初のリリースを設計します(多くの場合は調達担当)。以下を書き出してください:

- 彼らが下す意思決定(例:ベンダーを更新するか代替するか)

- 彼らが信頼する入力データ(KPI、インシデント、請求書、レビュー)

- 必要な出力(スコアカード、比較ビュー、監査トレイル)

ファイナンスやオペレーションの機能は、それがどんな新しい意思決定を可能にするかを明確に説明できるときにのみ追加します。

システム内で「ベンダー」は会社、サイト、またはサービスラインのどれとして扱うべき?

早い段階で一つの定義を決め、データモデルをそれに合わせて設計してください:

- 法的主体(Legal entity):契約レベルの判断や統合レポートに最適。\n- サイト/ロケーション:生産拠点や地域ごとに品質や納期が異なる場合に有効。\n- サービスライン:同一サプライヤが複数のサービスを提供し、成果が異なる場合に有効。

迷う場合は、ベンダーを親エンティティとして、子エンティティ(サイト/サービス単位)を持てるようにしておくと、後で集計・分解がしやすくなります。

重み付きKPI、ルーブリック、ハイブリッドのどれを使うべき?

**Weighted KPI(重み付きKPI)**は運用データが信頼でき、自動化と透明性を重視する場合に有効です。ルーブリックは定性的でチーム間に一貫性がない場合に適します。

実務的なデフォルトはハイブリッド:

- 配送/品質/コスト/SLAはKPIで測る\n- 協働性や応答性、戦略的適合性はルーブリックで評価

いずれを採用するにしても、監査人やベンダーが理解できるように説明可能であることが重要です。

ベンダーパフォーマンス評価の「スターター」KPIセットは何が良い?

多くのステークホルダーが認識し、安定して測定できる小さなセットから始めます:

- 納期遵守(On-time delivery)\n- 品質(欠陥率/返品率/検査合格率)\n- SLA遵守(チケットの処理時間など)\n- コスト差異(請求額とPOの差)\n- 応答性(最初の応答時間、エスカレーションの解決時間)

各KPIについて定義、スケール、データソースを事前に文書化してからUIやレポートを作り始めてください。

チーム間で同じように解釈される評価スケールはどう設計する?

人が口に出して説明できるスケール(一般的に1–5か0–100)を採用し、各レベルの閾値を平易な言葉で定義します。

例:\n\n- 納期遵守:5 = ≥ 98%、3 = 92–95%、1 = < 85%\n 感覚的な数値は避け、明確な閾値によりレビュワー間の不一致を減らし、比較を公平にします。

欠落したKPIデータは不公平にならないようにどう扱う?

KPIごと、あるいはポリシーとして一貫した処理方針を決めて文書化してください:

- その期間の分母から除外する(データが本当に欠落している場合に一般的)\n- 中立デフォルトを適用する(慎重に扱う—問題を隠す可能性あり)\n- 「データ不十分」と表示してランキングをブロックする

また data_quality_flag のようなデータ品質インジケータを保存し、レポートで「低パフォーマンス」と「不明」の違いが分かるようにします。

異議申し立てやスコア修正はどう扱うべき?

争点はワークフローとして扱い、履歴を黙って上書きしないでください:

- 指標/レビューを**異議あり(disputed)**としてマークする\n- 証拠付きで修正を提案できるようにする\n- 承認後に再計算し、変更理由を記録する\n

また

calculation_run_idのようなバージョン識別子を付与して「前四半期から何が変わったか」を答えられるようにしておきます。

ベンダー評価アプリに必要なコアエンティティは何?

最低限のスキーマは次のエンティティを含みます:\n\n- ベンダー(Vendor)、契約(Contract)、取引(Transaction:注文/請求)\n- KPI定義(KPI Metric)、レビュー(Review:定性的フィードバック)\n- スコア(Score:全体)、メトリックスコア(Metric Score:KPIごと)\n- 添付ファイル(Attachment:証拠)\n 追跡性のためにタイムスタンプ、作成者ID、外部システムの外部ID、スコア/計算バージョン参照などのフィールドを追加すると後で助かります。

ERP/CSV/APIからの取り込みで“ゴミデータ”を防ぐには?

最初から複数の取り込み経路を計画してください(最初は1つでも):\n\n- エッジケース向けの手動入力\n- 過去データのためのCSVアップロード(テンプレートを公開してバージョン管理)\n- 継続的な更新のためのAPI同期(ERP/ヘルプデスク等)

インポート時には必須フィールド、数値範囲、重複検出を強制し、不正行はエラーメッセージ付きで保存して管理者が修正・再実行できるようにします。

ベンダーポータルを含める際、どのロール・権限・監査機能が必須?

ロールベースのアクセス制御を使い、変更は提案(プロポーザル)として扱うのが実務的です:\n\n- レビュワーはドラフトを作成(レビューやKPI更新)\n- 承認者が公開/期間のロックを行い、スコアを安定化させる\n- ベンダーユーザーは自社の公開スコアカードとスレッド形式の応答のみを閲覧・投稿

編集・承認・エクスポート・権限変更などすべての重要イベントをbefore/afterを含めてログに残すと、ベンダーが閲覧・応答できるようになった後でも信頼性が維持できます。