2025年12月23日·2 分

セグメンテーションとコホート分析のためのウェブアプリの作り方

顧客のセグメンテーションとコホート分析のための実践的なステップバイステップガイド:データモデル、パイプライン、UI、指標、デプロイまでを網羅。

顧客のセグメンテーションとコホート分析のための実践的なステップバイステップガイド:データモデル、パイプライン、UI、指標、デプロイまでを網羅。

テーブル設計やツール選定より前に、アプリが答えるべき具体的な質問を決めてください。「セグメンテーションとコホート」は範囲が広く、明確なユースケースがないと意思決定に役立たない多機能プロダクトになりがちです。

意思決定で実際に使う数値と判断基準を文章化します。よくある質問:

各質問について、時間窓(日次/週次/月次)と粒度(ユーザー、アカウント、サブスクリプション)を明記しておくと後の設計がブレません。

主要ユーザーとワークフローを特定します:

またダッシュボードをどの頻度で見るか、「ワンクリック」とは何を意味するか、どのデータを真実(authoritative)と見なすかなどの実務的要件も拾います。

最初のバージョンは上位2〜3の質問に信頼できる答えを返すことを目標にします。典型的な MVP 範囲は、コアセグメント、いくつかのコホートビュー(保持、収益)、共有可能なダッシュボードです。

後回しにする項目例:定期エクスポート、アラート、自動化、複雑な多段ロジックなど。

もし最初のリリースまでの時間を短縮したいなら、Koder.ai のようなスキャフォールディングツールで MVP を立ち上げ、セグメントビルダーやコホートヒートマップ、基本 ETL 要件をチャットで記述して React フロントエンドと Go + PostgreSQL バックエンドの動くプロトタイプを生成し、ステークホルダー定義の改善に合わせてスナップショットやロールバックで iter するのも一案です。

成功は測定可能であるべきです。例:

トレードオフが出たときはこれらの指標が判断基準になります。

画面設計や ETL ジョブを書く前に、「顧客」と「アクション」が何を意味するかを決めてください。コホートやセグメンテーションの結果は下層の定義次第で信頼性が決まります。

一次識別子を1つ選び、すべてがどうマップされるかを文書化します:

user_id: 個人レベルの使用と保持に最適account_id: B2B 向け、複数ユーザーが単一支払い主体に紐づく場合に最適anonymous_id: サインアップ前の行動に必要。後で既知ユーザーにマージするルールが必要ID ステッチングのタイミング(例:ログイン時)や、ユーザーが複数アカウントに属する場合の扱いを明示してください。

ユースケースを満たすソースから始め、必要に応じて拡張します:

各ソースについて、システムオブレコードと更新頻度(リアルタイム/時間単位/日次)を記録しておくと「なぜ数値が合わないのか?」の議論を防げます。

報告用の単一タイムゾーン(事業のタイムゾーンか UTC が一般的)を決め、「日」「週」「月」の定義(ISO 週か日曜開始か)を統一します。収益を扱うなら通貨ルール(保存通貨、報告通貨、為替レートの適用タイミング)も定義してください。

平易な言葉で定義を書き、あらゆる場所で再利用します:

この用語集は製品要件と同等に扱い、UI に表示してレポートで参照できるようにしてください。

セグメンテーションアプリはデータモデルで成功が決まります。アナリストが簡単なクエリで一般的な質問に答えられなければ、すべての新しいセグメントがエンジニアリング作業に変わってしまいます。

追跡するすべてに一貫したイベント構造を使ってください。実用的なベースライン:

event_name(例:signup, trial_started, invoice_paid)timestamp(UTCで保存)user_id(アクター)properties(utm_source, device, feature_name のような柔軟な詳細を入れる JSON)event_nameは制御された一覧にし、propertiesは柔軟にしつつ期待されるキーを文書化します。これで報告の一貫性を保ちながらプロダクト変更を阻害しません。

セグメンテーションは主に「属性でユーザー/アカウントをフィルタリングする」作業です。属性はイベントプロパティだけに保持するのではなく、専用テーブルに置いてください。

一般的な属性:

これにより非専門家が「EU の SMB で Pro、パートナー経由」のようなセグメントを簡単に作れます。

プランなどは時間と共に変わります。現在値だけを users や accounts に置くと履歴ベースのコホートがズレます。

代表的な対応パターン:

account_plan_history(account_id, plan, valid_from, valid_to)クエリ速度とストレージ/ETLの複雑さのトレードオフで選びます。

クエリしやすいシンプルなコアモデル:

user_id, account_id, event_name, timestamp, properties)user_id, created_at, region 等)account_id, plan, industry 等)この構造はセグメンテーションとコホート・リテンション分析の両方に自然にマッピングし、製品やチームが増えてもスケールします。

コホート分析はルール次第で信頼性が変わります。UI やクエリ最適化の前に、アプリが使う正確な定義を書き下しておき、すべてのチャートやエクスポートが期待通りに一致するようにしてください。

まず必要なコホートタイプを選びます:

各タイプは単一の一意なアンカーイベント(と場合によってはプロパティ)にマップされる必要があります。コホート参加を不変にするか、履歴データが修正されたときに変更可能にするかも決めてください。

コホートの列(Week 0, Week 1…)の計算方法を明確にします:

小さな選択の違いが数値に影響し、整合性争いの原因になります。

コホート表の各セルが何を表すかを定義します。一般的な指標:

率の分母(例:保持率 = 週Nでアクティブだったユーザー ÷ コホートサイズ(週0))も明示してください。

コホートは端で複雑になります。次のルールを決めておきます:

これらの決定は平易な言葉で文書化し、将来のユーザーや自分のために参照できるようにしてください。

セグメンテーションとコホート分析は流入するデータの信頼性に依存します。良いパイプラインはデータを予測可能にして、毎日同じ意味・同じ形・適切な粒度で届けます。

ほとんどのプロダクトは複数のソースを組み合わせます:

実践的なルール:コアコホートを支える「必須イベント群」(例:signup, first value action, purchase)を定義して始め、その後拡張します。

不良データが広がるのを防ぐために、取り込みに近いところで検証を行います。重点:

拒否や修正の決定は監査ログ(いつ、なぜ)に書き残して、数値変化の説明ができるようにします。

生データは不揃いです。分析用のクリーンなテーブルに変換します:

user_id を account_id/organization_id に結びつけるジョブはスケジュール(またはストリーミング)で走らせ、運用上のガードレールを設けます:

パイプラインはプロダクトとして扱い、監視し、安定させることが重要です。

どこにデータを保存するかで、コホートダッシュボードの応答性が決まります。適切な選択はデータ量、クエリパターン、結果をどれだけ早く必要かによります。

初期は PostgreSQL で十分なことが多いです:馴染みがあり運用コストが低く、SQL に強い。イベント量が中程度で、インデックスやパーティショニングを工夫できるなら機能します。

数億〜数十億件のイベントや多数の並列ダッシュボードユーザーを見込むなら、データウェアハウス(BigQuery、Snowflake、Redshift)や、高速集計向けの OLAP ストア(ClickHouse、Druid)を検討してください。

実用ルール:Postgres で「週別保持をセグメントでフィルタしたクエリ」がチューニング後でも数秒かかるなら、ウェアハウス/OLAP の検討時です。

生イベントは保持しつつ、分析向けにいくつかの構造を追加します:

user_id/account_id と segment_id のマッピング、membership が変わりうる場合は valid_from/valid_toこれによりコホートやセグメントを再計算してもイベントテーブル全体を書き換える必要がありません。

多くのコホートクエリは時間、エンティティ、イベントタイプでフィルタされます。優先順位:

(event_name, event_time))ダッシュボードは同じ集計を何度も繰り返します:コホート保持、週ごとの集計、セグメント別コンバージョンなど。これらをスケジュール(時間単位/日次)で事前に集計し、UI は数千行程度を読むだけで済むようにします。生データはドリルダウン用に残し、既定の操作は高速なサマリーに依存させるのが重要です。

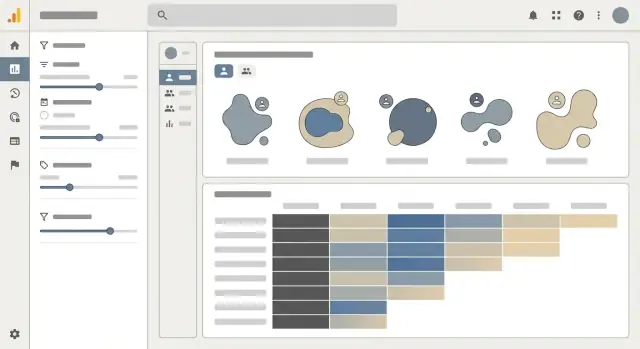

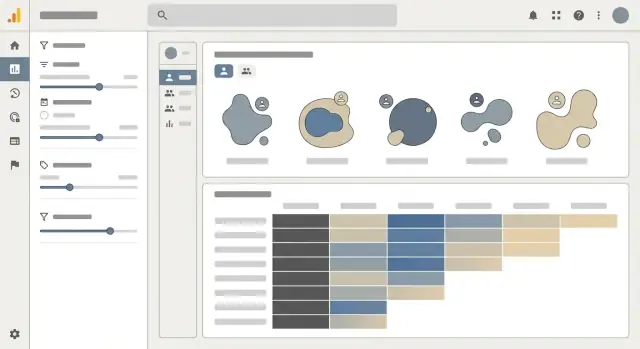

セグメントビルダーの使い勝手がセグメンテーションの採用を左右します。SQL のように感じると使われません。目標は誰が対象かを理解して自然に記述できる「質問ビルダー」です。

まず現実の質問にマップする小さなルールセットを用意します:

Country = United States, Plan is Pro, Acquisition channel = AdsTenure is 0–30 days, Revenue last 30 days > $100Used Feature X at least 3 times in the last 14 days, Completed onboarding, Invited a teammate各ルールはドロップダウンで選べる文にして、内部カラム名は隠します。可能なら例(例:「Tenure = 最初のサインインからの日数」)を表示してください。

非専門家はグループで考えます:「US かつ Pro かつ Feature X を使った」や「(US または Canada) かつ churned ではない」といった例です。扱いやすくするため:

セグメントを名前・説明・オーナー/チーム付きで保存できるようにし、ダッシュボードやコホートビューで再利用・バージョン管理できるようにします。

ビルダー上でルールを変えるたびに推定または正確なセグメントサイズを表示してください。速度向上のためにサンプリングを使う場合は明示します:

また「ユーザーを1回だけカウントする」か「イベントをカウントする」か、行動ルールで使われる時間窓も示してください。

比較はファーストクラスの機能にします:同一ビューで セグメントA vs セグメントB を簡単に選べるようにします。ユーザーにチャートを複製させないため、“Compare to…” セレクタで保存済みセグメントや即席セグメントを受け付け、ラベルと色は一貫させてください。

コホートダッシュボードはパターンを即座に読み取らせ、詳細を掘れることが重要です。SQL やデータモデルを知らなくても答えにたどり着けることが目的です。

コホートのコアビューはヒートマップにしますが、パズルにしないでください。各行はコホート定義とサイズを明確に表示(例:「Week of Oct 7 — 3,214 users」)。各セルは保持率%と絶対数を切り替えられるようにします。

列ヘッダ(“Week 0, Week 1…” または 実際の日付)を一貫させ、行ラベルの横にコホートサイズを表示して信頼度の判断を助けます。

各指標ラベル(Retention, Churn, Revenue, Active users)にツールチップを付け、次を明示します:

短いツールチップは長いヘルプページより効果的で、誤解をその場で防げます。

ヒートマップ上に最も使われるフィルタを配置し、操作が戻せるようにします:

有効なフィルタをチップで表示し、ワンクリックのリセットを用意して探索を促します。

現在のビュー(フィルタと%/数表示を含む)を CSV エクスポート できるようにし、設定を保存した共有リンクを提供します。共有時は権限を越えてアクセスを付与しないように必ずチェックしてください。

「リンクをコピー」アクションには短い確認と /settings/access への案内を表示すると良いでしょう。

セグメンテーションとコホート分析は顧客データを扱うため、セキュリティとプライバシーは後付けにできません。製品機能として扱うことでユーザーを守り、サポート負荷を減らし、スケール時のコンプライアンスも維持できます。

ターゲットに合う認証(B2Bなら SSO、SMB ならメール/パスワード、または両方)を選び、シンプルで予測可能なロールを実装します:

UI と API 両方で一貫した権限チェックを行い、エクスポート可能なエンドポイントはサーバー側で必ず権限確認を行ってください。

マルチワークスペース対応なら「だれかが別ワークスペースのデータを見ようとする」と仮定して設計します:

workspace_id を含めるworkspace_id をキーに含めるこれにより分析者がカスタムフィルタを作ったときの意図しないデータ漏洩を防げます。

ほとんどのセグメンテーションとリテンション分析は生の個人データなしで可能です。取り込むデータは最小化してください:

データは保管・転送で暗号化し、API キーや DB 資格情報はシークレットマネージャで管理します。

ワークスペースごとの保持ポリシー(生イベント、派生テーブル、エクスポートの保持期間)を定義し、実際にデータを削除するワークフローを実装します:

削除や保存期間の明確な手順はコホートチャートと同等に重要です。

分析アプリのテストは「ページが表示されるか」だけでは不十分です。小さな計算ミスやフィルタのバグがチームの判断を誤らせることがあります。

小さくて自明なフィクスチャを使ったユニットテストでコホート計算とセグメントロジックを検証します。例:10 人が週1にサインアップし、週2 に 4 人戻れば保持率は 40%。

テスト対象:

これらのテストは CI で走らせ、クエリロジックや集計を変更したら自動検証されるようにします。

分析失敗の多くはデータの問題です。毎回のロードや少なくとも日次で実行される自動チェックを追加します:

チェックが失敗したら、どのイベント、どの時間窓、どの程度基準からずれたかを含むコンテキストでアラートを出します。

現実的な使用を模したパフォーマンステスト(大きな日付範囲、多数のフィルタ、高いカードinality のプロパティ、ネストしたセグメント)を実行し、p95/p99 のクエリ時間を測定して予算を設定します(例:セグメントプレビュー < 2 秒、ダッシュボード < 5 秒)。回帰があればリリース前に検知できます。

最後にプロダクトやマーケティングの現場で UAT を行い、彼らが現在尋ねている「実際の質問」の一覧と期待される回答を集めます。アプリが信頼されている既存の結果を再現できない(または差異の説明ができない)なら出荷準備が整っていません。

セグメンテーションとコホート分析アプリの出荷は「大きなローンチ」よりも安全なループ(リリース→観察→学習→改善)を作ることが重要です。

チームのスキルとアプリの要件に合った方法を選択します。

マネージドホスティング(Git からのデプロイをサポートするプラットフォーム)は、HTTPS、ロールバック、オートスケールを最小限の運用で提供する最速の方法です。

コンテナは環境間で一貫したランタイムを求める場合やクラウド間移行を想定する場合に適します。

サーバーレスは使用が時間帯でスパイクするダッシュボードに向くことがありますが、コールドスタートや長時間の ETL ジョブには注意が必要です。

プロトタイプから本番までスタックを作り直したくないなら、Koder.ai のように React + Go + PostgreSQL の生成からデプロイ、ホスティング、カスタムドメイン、スナップショット/ロールバックをサポートするプラットフォームも選択肢になります。

dev, staging, production の3環境を用意します。dev と staging では実顧客データを使わないでください。プロダクションと同じ列構造・イベントタイプ・エッジケースを持つ安全なサンプルデータをロードしてテストすることで、実用的なテストが行えます。

ステージングはドレスリハーサルとして使い、本番に近いインフラで孤立した資格情報/データベース、フィーチャーフラグを使って新しいコホートルールを検証します。

問題発生時とパフォーマンス低下時に即行動できる観測を設けます:

ETL 失敗やエラー率上昇、クエリタイムアウトの急増にはメールや Slack でのアラートを設定します。

非専門家ユーザーからのフィードバック(月次または隔週)をもとにリリース計画を立てます:混乱するフィルタ、欠けている定義、「なぜこのユーザーがこのコホートにいるのか?」という質問の多い箇所を優先します。

既存レポートを壊さないことを最優先に、意思決定を解放する機能(新しいコホートタイプ、より良い UX デフォルト、明瞭な説明)を追加します。フィーチャーフラグとバージョン化された計算を使えば安全に進化できます。

公開で学びを共有するなら、Koder.ai のようなプラットフォームではビルドに関するコンテンツ作成や紹介でクレジットを得られるプログラムを提供していることがあり、実験コストを抑えながら反復を進められます。

まずアプリが支援すべき2〜3の具体的な意思決定(例:チャネル別の週次1回目保持、プラン別のチャーンリスク)を決め、次を定義します:

これらに確実に答えられるMVPを先に作り、アラートや自動化、複雑なルールは後回しにします。

プレーンな言葉で定義を書き、UIやエクスポート、ドキュメントで共通利用してください。最低限定義すべき項目:

さらに、、を標準化して、チャートやCSVの数値が一致するようにします。

主要な識別子を一つ選び、他の識別子がどうマッピングされるかを明確にします:

user_id:個人レベルの保持/使用状況に最適account_id:B2Bで複数ユーザーが1つの支払い主体に紐づく場合に最適anonymous_id:登録前の行動のために必要。後で既知ユーザーにマージするルールが必要ログイン時など、いつ ID ステッチングを行うか、複数アカウントに属するユーザーやマージの扱いを定義してください。

実用的なベースはevents + users + accountsモデルです:

event_name, timestamp(UTC), user_id, , (JSON)プランやライフサイクルのように時間と共に変わる属性をただ現在値だけで保存すると過去のコホート結果がズレます。よくあるアプローチ:

plan_history(account_id, plan, valid_from, valid_to)クエリ速度を優先するか、ストレージ/ETLの単純さを優先するかで選んでください。

単一のアンカーイベント(サインアップ、初回購入、主要機能の初回利用)にマップするコホートタイプを選びます。次に以下を明確にします:

また、コホート参加を不変にするか(割り当てたら変更しない)を決めてください。遅延修正がある場合のポリシーが重要です。

一般的に以下の扱いが問題を起こします。事前にルールを決めておきましょう:

これらのルールはツールチップやエクスポートのメタデータに書いておくと、関係者の解釈が一貫します。

ソース・オブ・トゥルースに合わせた取り込み経路を用意します:

また早期にバリデーションを入れてデータの汚染を防ぎます(必須フィールド、タイムスタンプの整合性、重複対策)。拒否や修正は監査ログに記録しましょう。

中程度のボリュームならPostgreSQLでも十分です。高いイベント量や多ユーザー同時利用が見込まれるなら、データウェアハウス(BigQuery/Snowflake/Redshift)や高速集計向けのOLAP(ClickHouse/Druid)を検討してください。

ダッシュボードを高速に保つために事前集計するべき例:

segment_membership(メンバーシップの有効期間を含む)詳細はドリルダウン用に生データを残し、既定の体験は高速なサマリーを読むようにします。

予測不能な SQL っぽい体験だと非エンジニアは使いません。次のポイントを押さえた「質問ビルダー」を作りましょう:

これらで現場が自走できるようになります。

コホートダッシュボードは「保持しているか/失っているか、その理由は?」に即答できることが目的です。UI の要点:

セキュリティとプライバシーは製品の機能です。以下は必須です:

workspace_id を全テーブルに入れ、行レベルのアクセス制御(RLS など)で自動的にスコープするaccount_idpropertiesevent_nameは制御された一覧にして、propertiesは柔軟にしつつ期待されるキーを文書化します。これでコホート計算と非エンジニア向けセグメント作成の両方に対応できます。