07 ਅਗ 2025·8 ਮਿੰਟ

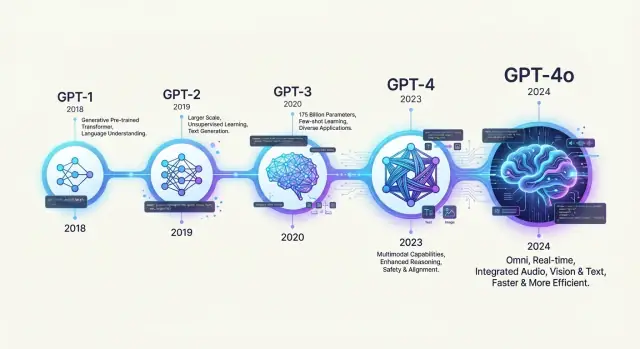

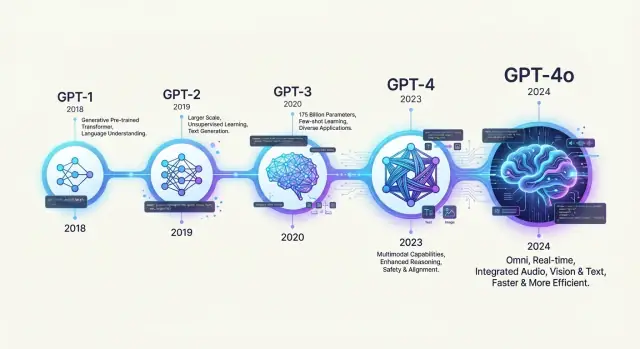

GPT-1 ਤੋਂ GPT-4 ਤੱਕ: OpenAI ਦੇ GPT ਮਾਡਲਾਂ ਦਾ ਇਤਿਹਾਸ

OpenAI ਦੇ GPT ਮਾਡਲਾਂ (GPT-1 ਤੋਂ GPT-4o ਤੱਕ) ਦਾ ਇਤਿਹਾਸ ਵੇਖੋ ਅਤੇ ਜਾਣੋ ਕਿ ਹਰ ਪੀੜੀ ਨੇ ਭਾਸ਼ਾ ਸਮਝ, ਉਪਯੋਗਤਾ ਅਤੇ ਸੁਰੱਖਿਆ ਵਿੱਚ ਕਿਵੇਂ ਤਰੱਕੀ ਕੀਤੀ।

OpenAI ਦੇ GPT ਮਾਡਲਾਂ (GPT-1 ਤੋਂ GPT-4o ਤੱਕ) ਦਾ ਇਤਿਹਾਸ ਵੇਖੋ ਅਤੇ ਜਾਣੋ ਕਿ ਹਰ ਪੀੜੀ ਨੇ ਭਾਸ਼ਾ ਸਮਝ, ਉਪਯੋਗਤਾ ਅਤੇ ਸੁਰੱਖਿਆ ਵਿੱਚ ਕਿਵੇਂ ਤਰੱਕੀ ਕੀਤੀ।

GPT ਮਾਡਲ ਉਹ ਵੱਡੇ ਭਾਸ਼ਾਈ ਮਾਡਲ ਹਨ ਜੋ ਕਿਸੇ ਟੈਕਸਟ ਲੜੀ ਵਿੱਚ ਅਗला ਸ਼ਬਦ ਅਨੁਮਾਨ ਲਗਾਉਣ ਲਈ ਬਣਾਏ ਜਾਂਦੇ ਹਨ। ਇਹ ਬਹੁਤ ਵੱਡੇ ਮਾਤਰਾ ਵਿੱਚ ਟੈਕਸਟ ਪੜ੍ਹਦੇ ਹਨ, ਭਾਸ਼ਾ ਦੇ ਰੁਝਾਨਾਂ ਨੂੰ ਸਿੱਖਦੇ ਹਨ ਅਤੇ ਫਿਰ ਉਹਨਾਂ ਰੁਝਾਨਾਂ ਨੂੰ ਨਵਾਂ ਟੈਕਸਟ ਬਣਾਉਣ, ਪ੍ਰਸ਼ਨਾਂ ਦੇ ਜਵਾਬ ਦੇਣ, ਕੋਡ ਲਿਖਣ, ਦਸਤਾਵੇਜ਼ਾਂ ਦਾ ਸਾਰ ਬਣਾਉਣ ਅਤੇ ਹੋਰ ਕਈ ਕੰਮ ਕਰਨ ਲਈ ਵਰਤਦੇ ਹਨ.

ਮੂਲ ਸੰਕਲਪ ਨਾਮ ਹੀ ਮੁੱਦੇ ਦੀ ਵਿਆਖਿਆ ਕਰਦਾ ਹੈ:

ਇਨ੍ਹਾਂ ਮਾਡਲਾਂ ਦੇ ਵਿਕਾਸ ਨੂੰ ਸਮਝਣਾ ਇਹ ਦਰਸਾਉਂਦਾ ਹੈ ਕਿ ਉਹ ਕੀ ਕਰ ਸਕਦੇ ਹਨ ਅਤੇ ਕੀ ਨਹੀਂ, ਅਤੇ ਕਿਉਂ ਹਰ ਨਵੀਂ ਪੀੜੀ ਸਮਰੱਥਾ ਵਿੱਚ ਮਹੱਤਵਪੂਰਣ ਛਾਲ ਮਹਿਸੂਸ ਹੁੰਦੀ ਹੈ। ਹਰ ਵਰਜ਼ਨ ਵਿਚ ਮਾਡਲ ਦੇ ਆਕਾਰ, ਟ੍ਰੇਨਿੰਗ ਡੇਟਾ, ਉਦੇਸ਼ਾਂ ਅਤੇ ਸੁਰੱਖਿਆ ਕੋਸ਼ਿਸ਼ਾਂ ਬਾਰੇ ਖਾਸ ਤਕਨੀਕੀ ਚੋਣਾਂ ਅਤੇ ਤਰਜੀحات ਦਿੱਤੀਆਂ ਗਈਆਂ।

ਇਹ ਲੇਖ ਇੱਕ ਕ੍ਰਮਵਾਰ, ਉੱਚ-ਸਤਹੀ ਝਲਕ ਦਿੰਦਾ ਹੈ: ਸ਼ੁਰੂਆਤੀ ਭਾਸ਼ਾਈ ਮਾਡਲਾਂ ਅਤੇ GPT-1 ਤੋਂ ਲੈ ਕੇ GPT-2 ਅਤੇ GPT-3 ਤੱਕ, ਇੰਸਟ੍ਰਕਸ਼ਨ ਟਿਊਨਿੰਗ ਅਤੇ ChatGPT, ਅਤੇ ਆਖ਼ਰਕਾਰ GPT-3.5, GPT-4 ਅਤੇ GPT-4o ਪਰਿਵਾਰ ਤੱਕ। ਰਸਤੇ ਵਿੱਚ ਅਸੀਂ ਮੁੱਖ ਤਕਨੀਕੀ ਰੁਝਾਨ, ਵਰਤੋਂ ਦੇ ਪੈਟਰਨ ਅਤੇ ਇਹ ਤਬਦੀਲੀਆਂ ਭਵਿੱਖ ਬਾਰੇ ਕੀ ਸੁਝਾਉਂਦੀਆਂ ਹਨ, ਉਹ ਵੇਖਾਂਗੇ।

GPT ਤੋਂ ਪਹਿਲਾਂ ਭਾਸ਼ਾਈ ਮਾਡਸ NLP ਖੋਜ ਦਾ ਇੱਕ ਕੇਂਦਰੀ ਹਿੱਸਾ ਸਨ। ਸ਼ੁਰੂਆਤੀ ਸਿਸਟਮ n‑gram ਮਾਡਲ ਸਨ, ਜੋ ਪਿਛਲੇ ਨਿਸ਼ਚਿਤ ਖਿੜਕੀ ਵਾਲੇ ਸ਼ਬਦਾਂ ਤੋਂ ਅਗਲਾ ਸ਼ਬਦ ਅਨੁਮਾਨ ਲਗਾਉਂਦੇ ਸਨ ਅਤੇ ਸਧਾਰਨ ਗਿਣਤੀਆਂ ਉਪਯੋਗ ਕਰਦੇ ਸਨ। ਉਹ ਸਪੈਲਿੰਗ ਸੁਧਾਰ ਅਤੇ ਬੁਨਿਆਦੀ ਆਟੋਕੰਪਲੀਟ ਲਈ ਕੰਮ ਆਏ ਪਰ ਲੰਬੇ ਸੰਦਰਭ ਅਤੇ ਡੇਟਾ ਦੀ ਘਾਟ ਨਾਲ ਸੰਘਰਸ਼ ਕਰਦੇ ਰਹੇ।

ਅਗਲਾ ਵੱਡਾ ਕਦਮ ਨਿਊਰਲ ਭਾਸ਼ਾ ਮਾਡਲ ਸੀ। ਫੀਡ‑ਫਾਰਵਰਡ ਨੈਟਵਰਕ ਅਤੇ ਬਾਅਦ ਵਿੱਚ RNNs, ਖਾਸ ਕਰਕੇ LSTMs ਅਤੇ GRUs, ਵਿਭਿੰਨ ਸ਼ਬਦ ਪ੍ਰਤੀਨਿੱਧੀਆਂ ਸਿੱਖਦੇ ਸਨ ਅਤੇ ਸਿਧਾਂਤਕ ਤੌਰ 'ਤੇ ਲੰਬੀਆਂ ਲੜੀਆਂ ਸੰਭਾਲ ਸਕਦੇ ਸਨ। ਉਸੇ ਸਮੇਂ word2vec ਅਤੇ GloVe ਵਰਗੇ ਮਾਡਲਾਂ ਨੇ ਸ਼ਬਦ-ਐਂਬੇਡਿੰਗਸ ਨੂੰ ਪ੍ਰਸਿੱਧ ਕੀਤਾ, ਦਿਖਾਉਂਦੇ ਹੋਏ ਕਿ ਕੱਚੇ ਟੈਕਸਟ ਤੋਂ ਅਨ-ਸੁਪਰਵਾਇਜ਼ਡ ਲਰਨਿੰਗ ਰਿਚ ਸੈਮੈਂਟਿਕ ਬਨਾਵਟ ਕੈਪਚਰ ਕਰ ਸਕਦੀ ਹੈ।

ਪਰ RNN ਸਿਖਣ ਵਿੱਚ ਧੀਮੇ ਅਤੇ ਪੈਰਲਲਾਈਜ਼ ਕਰਨ ਲਈ ਮੁਸ਼ਕਲ ਸਨ ਅਤੇ ਫਿਰ ਵੀ ਬਹੁਤ ਲੰਬੇ ਸੰਦਰਭ ਨਾਲ ਸੰਘਰਸ਼ ਕਰਦੇ ਸਨ। 2017 ਦੇ ਪੇਪਰ "Attention Is All You Need" ਨੇ ਟ੍ਰਾਂਸਫਾਰਮਰ ਆਰਕੀਟੈਕਚਰ ਪੇਸ਼ ਕੀਤਾ, ਜੋ ਇੱਕ ਬੜੀ ਖੋਜੀ ਬਦਲੀ ਸੀ। ਟ੍ਰਾਂਸਫਾਰਮਰ ਨੇ ਰਿਕਰੈਂਸੀ ਦੇ ਬਦਲੇ ਸੈਲਫ‑ਅਟੈਨਸ਼ਨ ਵਰਤੀ, ਜੋ ਕਿਸੇ ਵੀ ਦੋ ਸਥਾਨਾਂ ਨੂੰ ਸੀਧਾ ਜੋੜਨ ਦਿੰਦਾ ਅਤੇ ਟ੍ਰੇਨਿੰਗ ਨੂੰ ਬਹੁਤ ਪੈਰਲਲ ਬਣਾਉਂਦਾ ਹੈ।

ਇਸ ਨਾਲ ਭਾਸ਼ਾ ਮਾਡਲਾਂ ਨੂੰ RNN ਤੋਂ ਬਹੁਤ ਅੱਗੇ ਸਕੇਲ ਕਰਨ ਦਾ ਰਸਤਾ ਖੁਲ ਗਿਆ। ਖੋਜਕਾਰਾਂ ਨੇ ਦੇਖਿਆ ਕਿ ਇੱਕ ਵੱਡਾ ਡਿਕੋਡਰ‑ਓਨਲੀ ਟ੍ਰਾਂਸਫਾਰਮਰ, ਜੋ ਅਗਲੇ ਟੋਕਨ ਦੀ ਭਵਿੱਖਵाणी ਕਰਨ ਲਈ ਇੰਟਰਨੈਟ-ਪੱਧਰੀ ਕੋਰਪਸ 'ਤੇ ਟ੍ਰੇਨ ਕੀਤਾ ਜਾਵੇ, ਬਿਨਾਂ ਟਾਸਕ-ਖ਼ਾਸ ਸੁਪਰਵਿਜ਼ਨ ਦੇ ਸਿੰਟੈਕਸ, ਸੈਮੈਂਟਿਕ ਅਤੇ ਕੁਝ ਤਰ੍ਹਾਂ ਦੀ ਤਰਕਸ਼ੀਲ ਯੋਗਤਾ ਸਿੱਖ ਸਕਦਾ ਹੈ।

OpenAI ਦਾ ਮੁੱਖ ਵਿਚਾਰ ਸੀ ਇਸਨੂੰ ਜਨਰੇਟਿਵ ਪ੍ਰੀ‑ਟ੍ਰੇਨਿੰਗ ਵਜੋਂ ਰੂਪ ਦੇਣਾ: ਪਹਿਲਾਂ ਇੱਕ ਵੱਡੇ ਡਿਕੋਡਰ‑ਕੇਵਲ ਟ੍ਰਾਂਸਫਾਰਮਰ ਨੂੰ ਵਿਆਪਕ ਇੰਟਰਨੈਟ-ਸਕੇਲ ਕੋਰਪਸ 'ਤੇ ਟੈਕਸਟ ਮਾਡਲ ਕਰਨ ਲਈ ਟ੍ਰੇਨ ਕਰੋ, ਫਿਰ ਉਸੇ ਮਾਡਲ ਨੂੰ ਘੱਟ ਐਡੀਸ਼ਨਲ ਟ੍ਰੇਨਿੰਗ ਨਾਲ ਡਾਊਨਸਟਰੀਮ ਟਾਸਕਾਂ ਲਈ ਅਨੁਕੂਲ ਕਰੋ। ਇਹ ਪਹੁੰਚ ਇਕੱਠੇ ਸਧਾਰਨ-ਉਦੇਸ਼ ਮਾਡਲ ਦਾ ਵਾਅਦਾ ਕਰਦੀ ਸੀ, ਬਹੁਤ ਸਾਰੇ ਤੰਗ ਮਾਡਲਾਂ ਦੇ ਬਦਲੇ।

ਇਹ ਧਾਰਣਾ—ਛੋਟੇ, ਟਾਸਕ-ਖ਼ਾਸ ਸਿਸਟਮਾਂ ਤੋਂ ਇੱਕ ਵੱਡੇ, ਜਨਰੇਟਿਵਲੀ ਪ੍ਰੀ‑ਟ੍ਰੇਨਡ ਟ੍ਰਾਂਸਫਾਰਮਰ ਵੱਲ—ਨੇ ਪਹਿਲੇ GPT ਮਾਡਲ ਅਤੇ ਆਉਣ ਵਾਲੇ GPT ਸਿਰੀਜ਼ ਲਈ ਰਸਤਾ ਤਿਆਰ ਕੀਤਾ।

GPT-1 OpenAI ਦਾ ਪਹਿਲਾ ਕਦਮ ਸੀ ਜੋ ਅਸੀਂ ਅੱਜ ਜਾਣਦੇ GPT ਸਿਰੀਜ਼ ਵੱਲ ਚਲਾ ਗਿਆ। 2018 ਵਿੱਚ ਰਿਲੀਜ਼ ਕੀਤਾ ਗਿਆ, ਇਸ ਵਿੱਚ 117 ਮਿਲੀਅਨ ਪੈਰਾਮੀਟਰ ਸਨ ਅਤੇ ਇਹ 2017 ਦੇ Vaswani ਆਦਿ ਵੱਲੋਂ ਪੇਸ਼ ਕੀਤੇ ਗਏ Transformer ਆਰਕੀਟੈਕਚਰ 'ਤੇ ਬਣਿਆ ਸੀ। ਹਾਲਾਂਕਿ ਬਾਅਦ ਦੇ ਮਾਪਦੰਡਾਂ ਮੁਤਾਬਕ ਛੋਟਾ ਸੀ, ਪਰ ਇਸ ਨੇ ਉਹ ਮੁੱਖ ਨੁਸਖਾ ਸਪਸ਼ਟ ਕੀਤਾ ਜੋ ਬਾਅਦ ਵਿੱਚ ਆਏ ਸਾਰੇ GPT ਮਾਡਲਾਂ ਨੇ ਅਪਣਾਇਆ।

GPT-1 ਇੱਕ ਸਧਾਰਨ ਪਰ ਪ੍ਰਭਾਵਸ਼ਾਲੀ ਵਿਚਾਰ ਨਾਲ ਟ੍ਰੇਨ ਕੀਤਾ ਗਿਆ:

ਪ੍ਰੀ‑ਟ੍ਰੇਨਿੰਗ ਦੌਰਾਨ, GPT-1 ਨੇ ਅਗਲੇ ਟੋਕਨ ਦੀ ਭਵਿੱਖਵाणी ਸਿੱਖੀ, ਮੁੱਖ ਤੌਰ 'ਤੇ BooksCorpus ਅਤੇ ਵਿਕੀਪੀਡੀਆ-ਸਟਾਈਲ ਸਰੋਤਾਂ ਤੋਂ ਪ੍ਰਾਪਤ ਟੈਕਸਟ 'ਤੇ। ਇਹ ਦੁਪੱਖੀ ਉਦੇਸ਼—ਅਗਲਾ ਸ਼ਬਦ ਅਨੁਮਾਨ—ਕੋਈ ਮਨੁੱਖੀ ਲੇਬਲਿੰਗ ਲੋੜ ਨਹੀਂ ਰੱਖਦਾ, ਜਿਸ ਨਾਲ ਮਾਡਲ ਭਾਸ਼ਾ, ਅੰਦਾਜ਼ ਅਤੇ ਤੱਥਾਂ ਬਾਰੇ ਵਿਸ਼ਾਲ ਜਾਣਕਾਰੀ ਅਪਨਾਉਂਦਾ ਹੈ।

ਪ੍ਰੀ‑ਟ੍ਰੇਨਿੰਗ ਤੋਂ ਬਾਅਦ, ਉਹੀ ਮਾਡਲ ਕਈ ਪ੍ਰਮੁੱਖ NLP ਬੈਂਚਮਾਰਕਾਂ 'ਤੇ ਫਾਈਨ‑ਟਿਊਨ ਕੀਤਾ ਗਿਆ: ਸੈਂਟੀਮੈਂਟ ਵਿਸ਼ਲੇਸ਼ਣ, ਪ੍ਰਸ਼ਨ-ਉੱਤਰ, ਟੈਕਸਟਿਆਲ ਐਨਟੇਲਮੈਂਟ ਆਦਿ। ਹਰ ਲੇਬਲਡ ਡੇਟਾਸੈੱਟ ਲਈ ਇੱਕ ਛੋਟਾ ਕਲਾਸੀਫਾਇਰ ਹੈਡ ਜੋੜਿਆ ਗਿਆ ਅਤੇ ਪੂਰੇ ਮਾਡਲ ਨੂੰ (ਜਾਂ ਇਸ ਦੇ ਬਹੁਤੇ ਹਿੱਸੇ) ਏਂਡ‑ਟੂ‑ਏਂਡ ਸਿਖਲਾਈ ਦਿੱਤੀ ਗਈ।

ਮੁੱਖ ਤਰੀਕੇ ਦੀ ਗੱਲ ਇਹ ਸੀ ਕਿ ਉਹੀ ਪ੍ਰੀ‑ਟ੍ਰੇਨਡ ਮਾਡਲ ਥੋੜ੍ਹੀ-ਭੀ ਸੁਧਾਰ ਨਾਲ ਕਈ ਟਾਸਕਾਂ ਲਈ ਅਡੈਪਟ ਕੀਤਾ ਜਾ ਸਕਦਾ ਹੈ, ਨਾ ਕਿ ਹਰ ਟਾਸਕ ਲਈ ਨਵਾਂ ਮਾਡਲ ਸ਼ੁਰੂ ਤੋਂ ਟ੍ਰੇਨ ਕਰਨਾ।

117M ਪੈਰਾਮੀਟਰ ਹੋਣ ਦੇ ਬਾਵਜੂਦ, GPT-1 ਨੇ ਕਈ ਪ੍ਰਭਾਵਸ਼ਾਲੀ ਨਤੀਜੇ ਦਰਸਾਏ:

GPT-1 ਨੇ ਪਹਿਲੇ ਨਿਸ਼ਾਨੇ ਦੇ ਰੂਪ ਵਿੱਚ ਜ਼ੀਰੋ‑ਸ਼ਾਟ ਅਤੇ ਫਿਊ‑ਸ਼ਾਟ ਜਨਰਲਾਈਜ਼ੇਸ਼ਨ ਦੇ ਟੁਕੜੇ ਜਤਾਏ, ਹਾਲਾਂਕਿ ਇਹ ਅਜੇ ਕੇਂਦਰੀ ਥੀਮ ਨਹੀਂ ਸੀ। ਜ਼ਿਆਦਾਤਰ ਮੁਲਾਂਕਣ ਅਜੇ ਵੀ ਹਰੇਕ ਟਾਸਕ ਲਈ ਵੱਖ-ਵੱਖ ਫਾਈਨ‑ਟਿਊਨਿੰਗ 'ਤੇ ਆਧਾਰਿਤ ਸੀ।

GPT-1 ਨੂੰ ਕਦੇ ਵੀ ਉਪਭੋਗਤਾ-ਪ੍ਰਧਾਨ ਰੂਪ ਜਾਂ ਵਿਆਪਕ ਡੈਵਲਪਰ API ਲਈ ਉਦੇਸ਼ ਨਹੀਂ ਕੀਤਾ ਗਿਆ। ਕਈ ਕਾਰਕ ਇਸਨੂੰ ਰਿਸਰਚ ਖੇਤਰ ਤੱਕ ਸੀਮਿਤ ਰੱਖਦੇ:

ਫਿਰ ਵੀ, GPT-1 ਨੇ ਨੁਸਖਾ ਸਥਾਪਿਤ ਕੀਤਾ: ਵਿਆਪਕ ਟੈਕਸਟ ਕੋਰਪਸ 'ਤੇ ਜਨਰੇਟਿਵ ਪ੍ਰੀ‑ਟ੍ਰੇਨਿੰਗ, ਫਿਰ ਸਧਾਰਨ ਟਾਸਕ-ਖ਼ਾਸ ਫਾਈਨ‑ਟਿਊਨਿੰਗ। ਇਸ ਪਹਿਲੇ ਮਾਡਲ ਤੋਂ ਸਾਰੇ ਬਾਅਦ ਆਉਣ ਵਾਲੇ GPT ਵਰਜਨ ਇੱਕ ਤਰੇਕ ਤੇ ਪੈਦਾ ਹੋਏ।

GPT-2, 2019 ਵਿੱਚ ਰਿਲੀਜ਼, ਪਹਿਲਾ ਐਸਾ GPT ਸੀ ਜਿਸ ਨੇ ਗਲੋਬਲ ਧਿਆਨ ਖਿੱਚਿਆ। ਇਸ ਨੇ ਅਸਲ GPT-1 ਆਰਕੀਟੈਕਚਰ ਨੂੰ 117 ਮਿਲੀਅਨ ਤੋਂ 1.5 ਅਰਬ ਪੈਰਾਮੀਟਰ ਤੱਕ ਵਧਾਇਆ, ਦਿਖਾਉਂਦੇ ਹੋਏ ਕਿ ਟ੍ਰਾਂਸਫਾਰਮਰ ਵਧਾਉਣ ਨਾਲ ਕਿੰਨਾ ਅੱਗੇ ਜਾ ਸਕਦਾ ਹੈ।

ਆਰਕੀਟੈਕਚਰਿਕ ਤੌਰ 'ਤੇ, GPT-2 GPT-1 ਵਾਂਗ ਹੀ ਇੱਕ ਡਿਕੋਡਰ-ਕੇਵਲ ਟ੍ਰਾਂਸਫਾਰਮਰ ਸੀ ਜੋ ਅਗਲੇ-ਟੋਕਨ ਭਵਿੱਖਵਾਣੀ 'ਤੇ ਟ੍ਰੇਨ ਕੀਤਾ ਗਿਆ। ਮੁੱਖ ਫਰਕ ਸੀ ਠੋਸ ਸਕੇਲ:

ਇਸ ਵਾਧੇ ਨਾਲ ਫਲੂਐਂਸੀ, ਲੰਬੇ ਪੈਸੀਜਾਂ ਉੱਤੇ ਸੰਗਤਤਾ ਅਤੇ ਪ੍ਰੰਪਟ-ਅਨੁਸਾਰ ਚਾਲੂ ਹੋਣ ਦੀ ਯੋਗਤਾ ਕਾਫੀ ਸੁਧਰੀ।

GPT-2 ਨੇ ਕਾਈ ਖੋਜਕਾਰਾਂ ਨੂੰ ਸੋਚ ਵਿੱਚ ਵੱਡਾ ਬਦਲਾਅ ਕਰ ਦਿੱਤਾ ਕਿ "ਸਿਰਫ" ਅਗਲੇ-ਟੋਕਨ ਭਵਿੱਖਵਾਣੀ ਕੀ ਕਰ ਸਕਦੀ ਹੈ।

ਬਿਨਾਂ ਕਿਸੇ ਫਾਈਨ‑ਟਿਊਨਿੰਗ ਦੇ, GPT-2 ਕੁਝ ਜ਼ੀਰੋ-ਸ਼ਾਟ ਟਾਸਕ ਕਰ ਸਕਦਾ ਸੀ:

ਕੰਮ-ਉਦਾਹਰਨਾਂ ਪ੍ਰੰਪਟ 'ਚ ਕੁਝ ਉਦਾਹਰਨਾਂ ਜੋੜਨ (few-shot) ਨਾਲ ਹੋਰ ਵੀ ਸੁਧਾਰ ਆਇਆ। ਇਹ ਇਸ ਗੱਲ ਦਾ ਇਸ਼ਾਰਾ ਸੀ ਕਿ ਵੱਡੇ ਭਾਸ਼ਾਈ ਮਾਡਲ ਇਨ-ਕੌਂਟੈਕਸਟ ਉਦਾਹਰਨਾਂ ਨੂੰ ਇੱਕ ਅੰਦੇਸ਼ੀ ਪ੍ਰੋਗਰਾਮਿੰਗ ਇੰਟਰਫੇਸ ਵਜੋਂ ਵਰਤ ਸਕਦੇ ਹਨ।

ਉੱਚ ਗੁਣਵੱਤਾ ਜਨਰੇਸ਼ਨ ਕਾਰਨ ਕੁਝ ਪਹਿਲੀਆਂ ਵੱਡੀਆਂ ਜਨਤਕ ਚਰਚਾਵਾਂ ਉਭਰੀਆਂ। OpenAI ਨੇ ਸ਼ੁਰੂ ਵਿੱਚ ਪੂਰੇ 1.5B ਮਾਡਲ ਨੂੰ ਰੋਕਿਆ, ਆਖਣ ਨਾਲ:

ਇਸ ਲਈ OpenAI ਨੇ ਧੀਮੀ-ਥੀਮੀ ਰਿਲੀਜ਼ ਅਪਣਾਈ:

ਇਹ ਕਦਮ ਪਹਿਲੀਆਂ 'AI ਡਿਪਲੋਯਮੈਂਟ ਨੀਤੀਆਂ' ਵਿੱਚੋਂ ਇੱਕ ਸੀ, ਜੋ ਜੋਖਮ ਮੁਲਿਆਂਕਣ ਅਤੇ ਨਿਗਰਾਨੀ ਉੱਤੇ ਮੱਥਾ ਰੱਖਦੀ ਹੈ।

ਛੋਟੇ GPT-2 ਚੈਕਪੌਇੰਟਸ ਨੇ ਵੀ ਖੁੱਲ੍ਹੇ-ਸੋਰਸ ਪ੍ਰੋਜੈਕਟਾਂ ਦੀ ਲਹਿਰ ਸ਼ੁਰੂ ਕੀਤੀ। ਵਿਕਾਸਕਾਰਾਂ ਨੇ ਮਾਡਲਾਂ ਨੂੰ ਕ੍ਰੀਏਟਿਵ ਲਿਖਾਈ, ਕੋਡ ਆਟੋਕੰਪਲੀਟ ਅਤੇ ਪ੍ਰਯੋਗਾਤਮਕ ਚੈਟਬੋਟ ਲਈ ਫਾਈਨ‑ਟਿਊਨ ਕੀਤਾ। ਖੋਜਕਾਰਾਂ ਨੇ ਪੱਖਪਾਤ, ਤੱਥ-ਗਲਤੀਆਂ ਅਤੇ ਫੇਲਯੂਰ ਮੋਡਜ਼ ਦੀ ਜਾਂਚ ਕੀਤੀ।

ਇਹ ਪ੍ਰਯੋਗ ਬੜੇ ਤੌਰ 'ਤੇ ਇਹ ਦਰਸਾਉਂਦੇ ਹਨ ਕਿ ਲੋਕ ਵੱਡੇ ਭਾਸ਼ਾਈ ਮਾਡਲਾਂ ਨੂੰ ਨੈਟਰਲ ਰਿਸਰਚ ਆਈਟਮ ਤੋਂ ਆਮ-ਉਦੇਸ਼ ਟੈਕਸਟ ਇੰਜਣ ਵਜੋਂ ਦੇਖਣ ਲਗੇ। GPT-2 ਦਾ ਪ੍ਰਭਾਵ ਉਮੀਦਾਂ ਸੈੱਟ ਕਰਨ ਅਤੇ ਚਿੰਤਾਵਾਂ ਉੱਠਾਉਣ ਦਾ ਮਾਦਾ ਬਣਿਆ, ਜਿਸਨੇ GPT-3, ChatGPT ਅਤੇ ਬਾਅਦ ਦੇ GPT-4 ਵਰਗੇ ਮਾਡਲਾਂ ਦੀ ਪ੍ਰਤੀਖਾ ਨੂੰ ਰੂਪ ਦਿੱਤਾ।

GPT-3 2020 ਵਿੱਚ ਆਇਆ, ਜਿਸਦਾ ਸਿਰਲੇਖੀਅਨ 175 ਬਿੱਲੀਅਨ ਪੈਰਾਮੀਟਰ ਸੀ—GPT-2 ਨਾਲੋਂ 100x ਵੱਧ। ਇਹ ਨੰਬਰ ਧਿਆਨ ਖਿੱਚਣ ਵਾਲਾ ਸੀ: ਇਹ ਯਾਦਦਾਸ਼ਤ ਸ਼ਕਤੀ ਦਿਖਾਉਂਦਾ ਸੀ, ਪਰ ਬਹੁਤ ਜ਼ਿਆਦਾ ਅਹੰਕਾਰ ਨਹੀਂ—ਅਸਲ ਗੱਲ ਇਹ ਸੀ ਕਿ ਇਸਨੇ ਕੁਝ ਨਵੇਂ ਰਵੱਈਏ ਖੋਲ੍ਹੇ ਜੋ ਛੋਟੇ ਪੈਮਾਨੇ 'ਤੇ ਨਹੀਂ ਦਿਖੇ ਗਏ ਸਨ।

GPT-3 ਨਾਲ ਸਭ ਤੋਂ ਵੱਡੀ ਖੋਜ in-context learning ਸੀ। ਮਾਡਲ ਨੂੰ ਨਿਊ-ਟਾਸਕ 'ਤੇ ਫਾਈਨ‑ਟਿਊਨ ਕਰਨ ਦੀ ਥਾਂ, ਤੁਸੀਂ ਪ੍ਰੰਪਟ ਵਿੱਚ ਕੁਝ ਉਦਾਹਰਨ ਪੇਸਟ ਕਰ ਸਕਦੇ ਸੀ:

ਮਾਡਲ ਆਪਣੇ ਵਜ਼ਨ ਅਪਡੇਟ ਨਹੀਂ ਕਰ ਰਿਹਾ ਸੀ; ਇਹ ਪ੍ਰੰਪਟ ਨੂੰ ਇੱਕ ਅਸਥਾਈ ਟ੍ਰੇਨਿੰਗ ਸੈਟ ਵਾਂਗ ਵਰਤ ਰਿਹਾ ਸੀ। ਇਸ ਨੇ ਜ਼ੀਰੋ-ਸ਼ਾਟ, ਵਨ-ਸ਼ਾਟ, ਅਤੇ ਫਿਊ-ਸ਼ਾਟ ਪ੍ਰਾਂਪਟਿੰਗ ਜੈਸੀਆਂ ਵਿਚਾਰ-ਧਾਰਾਂ ਨੂੰ ਜਨਮ ਦਿੱਤਾ ਅਤੇ ਪਹਿਲੀ ਲਹਿਰ ਦੀ ਪ੍ਰਾਂਪਟ ਇੰਜੀਨੀਅਰਿੰਗ ਦੀ ਸ਼ੁਰੂਆਤ ਕੀਤੀ: ਬਿਨਾਂ ਮਾਡਲ ਨੂੰ ਛੁਹ ਕੇ ਬਿਹਤਰ ਨਤੀਜੇ ਲੈਣ ਲਈ ਨਿਰਦੇਸ਼ ਅਤੇ ਫਾਰਮੈਟਿੰਗ ਸੰਭਾਲਣ।

GPT-2 ਦੇ ਵਿਰੁੱਧ, ਜਿਸ ਦੇ ਵੇਟ ਡਾਊਨਲੋਡ ਕੀਤੇ ਜਾ ਸਕਦੇ ਸਨ, GPT-3 ਮੁੱਖ ਤੌਰ 'ਤੇ ਵਪਾਰਕ API ਰਾਹੀਂ ਉਪਲਬਧ ਕਰਵਾਇਆ ਗਿਆ। OpenAI ਨੇ 2020 ਵਿੱਚ OpenAI API ਦੀ ਪ੍ਰਾਇਵੀਟ ਬੀਟਾ ਸ਼ੁਰੂ ਕੀਤੀ, GPT-3 ਨੂੰ ਇੱਕ ਜਨਰਲ-ਪਰਪਜ਼ ਟੈਕਸਟ ਇੰਜਣ ਵਜੋਂ ਪੋਜ਼ੀਸ਼ਨ ਕਰਦੇ ਹੋਏ ਜੋ ਵਿਕਾਸਕਾਰ HTTP ਰਿਕਵੈਸਟ ਨਾਲ ਕਾਲ ਕਰ ਸਕਦੇ ਸਨ।

ਇਸ ਨਾਲ ਭਾਸ਼ਾਈ ਮਾਡਲ ਰਿਸਰਚ ਆਈਟਮ ਤੋਂ ਇੱਕ ਵਿਸ਼ਾਲ ਪਲੇਟਫਾਰਮ ਵੱਲ ਬਦਲ ਗਏ। ਆਪਣਾ ਮਾਡਲ ਟ੍ਰੇਨ ਕਰਨ ਦੀ ਥਾਂ, ਸਟਾਰਟਅਪ ਅਤੇ ਐਂਟਰਪ੍ਰਾਈਜ਼ ਇੱਕ ਸਿੰਗਲ API key ਨਾਲ ਪਰੋਟੋਟਾਈਪ ਕਰ ਸਕਦੇ ਸਨ ਅਤੇ ਟੋਕਨ ਮੁਤਾਬਕ ਭੁਗਤਾਨ ਕਰਦੇ।

ਸ਼ੁਰੂਆਤੀ ਗ੍ਰਹਿਣਕਾਰਾਂ ਨੇ ਜਲਦੀ ਹੀ ਅਜਿਹੇ ਪੈਟਰਨਾਂ ਦੀ ਜਾਂਚ ਕੀਤੀ ਜੋ ਬਾਅਦ ਵਿੱਚ ਸਾਧਾਰਣ ਮਹਿਸੂਸ ਹੋਏ:

GPT-3 ਨੇ ਇਹ ਸਾਬਤ ਕੀਤਾ ਕਿ ਇੱਕ ਸਿੰਗਲ, ਜਨਰਲ ਮਾਡਲ—API ਰਾਹੀਂ ਪਹੁੰਚ ਯੋਗ—ਕਈ ਕਿਸਮਾਂ ਦੀਆਂ ਐਪਲੀਕੇਸ਼ਨਾਂ ਨੂੰ ਚਲਾ ਸਕਦਾ ਹੈ ਅਤੇ ChatGPT ਅਤੇ ਬਾਅਦ ਦੇ GPT-3.5 ਅਤੇ GPT-4 ਸਿਸਟਮਾਂ ਲਈ ਰਾਹ ਤਿਆਰ ਕੀਤਾ।

ਬੇਸ GPT-3 ਸਿਰਫ਼ ਇੰਟਰਨੈਟ-ਪੱਧਰੀ ਟੈਕਸਟ 'ਤੇ ਅਗਲਾ-ਟੋਕਨ ਭਵਿੱਖਵਾਣੀ ਲਈ ਟ੍ਰੇਨ ਕੀਤਾ ਗਿਆ ਸੀ। ਇਹ ਰੁਪਾਂਤਰ ਕਰਨਾ ਚੰਗਾ ਸੀ, ਪਰ ਲੋਕ ਜੋ ਮੰਗਦੇ ਸਨ ਉਹ ਵਧੀਆ ਤਰੀਕੇ ਨਾਲ ਨਹੀਂ ਮਿਲਦੇ ਸਨ। ਯੂਜ਼ਰਾਂ ਨੂੰ ਅਕਸਰ ਪ੍ਰੰਪਟਾਂ ਨੂੰ ਬਹੁਤ ਧਿਆਨ ਨਾਲ ਬਣਾਉਣਾ ਪੈਂਦਾ ਸੀ, ਅਤੇ ਮਾਡਲ:

ਖੋਜਕਾਰਾਂ ਨੇ ਇਸ ਖੁੰਝਲ ਨੂੰ ਅਲਾਈਨਮੈਂਟ ਸਮੱਸਿਆ ਕਿਹਾ: ਮਾਡਲ ਦਾ ਵਿਹਾਰ ਮਨੁੱਖੀ ਇਰਾਦਿਆਂ, ਮਲਿਆ ਅਤੇ ਸੁਰੱਖਿਆ ਉਮੀਦਾਂ ਨਾਲ ਸਹੀ ਤਰੀਕੇ ਨਾਲ ਮਿਲਦਾ ਨਹੀਂ ਸੀ।

OpenAI ਦੀ InstructGPT (2021–2022) ਇੱਕ ਮੋੜ ਸੀ। ਸਿਰਫ਼ ਕੱਚੇ ਟੈਕਸਟ 'ਤੇ ਟ੍ਰੇਨ ਕਰਨ ਦੀ ਥਾਂ, ਉਹਨਾਂ ਨੇ GPT-3 'ਤੇ ਦੋ ਮੁੱਖ ਪੜਾਵ ਜੋੜੇ:

ਇਸ ਨਾਲ ਉਨ੍ਹਾਂ ਮਾਡਲਾਂ ਨੇ:

ਯੂਜ਼ਰ ਅਧਿਐਨਾਂ ਵਿੱਚ, ਛੋਟੇ InstructGPT ਮਾਡਲ ਵੱਡੇ ਬੇਸ GPT-3 ਮਾਡਲਾਂ ਤੋਂ ਵਧੀਆ ਮੰਨੇ ਗਏ, ਇਹ ਦਰਸਾਉਂਦਾ ਕਿ ਅਲਾਈਨਮੈਂਟ ਅਤੇ ਇੰਟਰਫੇਸ ਗੁਣਵੱਤਾ ਕਈ ਵਾਰੀ ਕੁੱਲ ਆਕਾਰ ਨਾਲੋਂ ਜ਼ਿਆਦਾ ਅਹਿਮ ਹੋ ਸਕਦੀ ਹੈ।

ChatGPT (ਆਖਿਰ 2022) ਨੇ InstructGPT ਪਹੁੰਚ ਨੂੰ ਬਹੁ-ਟਰਨ ਗੱਲਬਾਤ ਵਿੱਚ ਵਧਾਇਆ। ਇਹ ਮੁਢਲੀ ਤੌਰ 'ਤੇ GPT-3.5-ਕਲਾਸ ਮਾਡਲ ਸੀ, ਜਿਸ ਨੂੰ ਗੱਲਬਾਤੀ ਡੇਟਾ 'ਤੇ SFT ਅਤੇ RLHF ਨਾਲ ਫਾਈਨ‑ਟਿਊਨ ਕੀਤਾ ਗਿਆ।

API ਜਾਂ ਡਿਵੈਲਪਰ-ਕੇਂਦਰਿਤ ਪਲੇਯਰਗ੍ਰਾਊਂਡ ਦੀ ਥਾਂ, OpenAI ਨੇ ਇਕ ਸਾਦਾ ਚੈਟ ਇੰਟਰਫੇਸ ਲਾਂਚ ਕੀਤਾ:

ਇਸ ਨੇ ਗੈਰ-ਟੈਕਨੀਕੀ ਯੂਜ਼ਰਾਂ ਲਈ ਬਾਧਾ ਘਟਾਈ: ਕੋਈ ਪ੍ਰਾਂਪਟ ਇੰਜੀਨੀਅਰਿੰਗ ਦੀ ਲੋੜ ਨਹੀਂ, ਕੋਈ ਕੋਡ ਨਹੀਂ—ਸਿਰਫ਼ ਲਿਖੋ ਅਤੇ ਜਵਾਬ ਪਾਓ।

ਨਤੀਜਾ ਇੱਕ ਮੁੱਖ ਧਾਰਾ ਦਾ ਉਭਾਰ ਸੀ: ਟ੍ਰਾਂਸਫਾਰਮਰ ਖੋਜ ਅਤੇ ਅਲਾਈਨਮੈਂਟ ਕੰਮਾਂ 'ਤੇ ਵਰਤ ਕੇ ਬਣਾਈ ਗਈ ਤਕਨਾਲੋਜੀ ਅਚਾਨਕ ਹਰ ਕੋਈ ਵਰਤ ਸਕਦਾ ਸੀ। ਇੰਸਟ੍ਰਕਸ਼ਨ ਟਿਊਨਿੰਗ ਅਤੇ RLHF ਨੇ ਪ੍ਰਣਾਲੀ ਨੂੰ ਸਹਿਯੋਗੀ ਅਤੇ ਪ੍ਰਭਾਵਿਤ ਮਹਿਸੂਸ ਕਰਵਾਇਆ, ਜਦਕਿ ਚੈਟ ਇੰਟਰਫੇਸ ਨੇ ਖੋਜੀ ਮਾਡਲ ਨੂੰ ਵਿਆਪਕ ਉਤਪਾਦ ਵਿੱਚ ਬਦਲ ਦਿੱਤਾ।

GPT-3.5 ਉਹ ਮੌਕਾ ਸੀ ਜਦੋਂ ਵੱਡੇ ਭਾਸ਼ਾਈ ਮਾਡਲ ਆਮ ਤੌਰ 'ਤੇ ਇੱਕ ਖੋਜੀ ਅਦੇੜ থেকে ਦੈਨੀਕ ਉਪਯੋਗ ਦੀ ਚੀਜ਼ ਬਣ ਗਏ। ਇਹ GPT-3 ਅਤੇ GPT-4 ਦੇ ਦਰਮਿਆਨ ਰਿਹਾ, ਪਰ ਇਸਦੀ ਅਸਲੀ ਮਹੱਤਤਾ ਇਸਦੀ ਦੋਸਤਾਨਾ ਅਤੇ ਪ੍ਰਾਇਗਮਟਿਕ ਵਰਤੋਂ ਸੀ।

ਤਕਨੀਕੀ ਤੌਰ 'ਤੇ, GPT-3.5 ਨੇ ਮੂਲ GPT-3 ਆਰਕੀਟੈਕਚਰ ਨੂੰ ਬਿਹਤਰ ਟ੍ਰੇਨਿੰਗ ਡੇਟਾ, ਅਪਡੇਟ ਕੀਤੇ ਗਏ ਓਪਟੀਮਾਈਜ਼ੇਸ਼ਨ ਅਤੇ ਵਿਸ਼ਾਲ ਇੰਸਟ੍ਰਕਸ਼ਨ ਟਿਊਨਿੰਗ ਨਾਲ ਸੁਧਾਰਿਆ। ਸੀਰੀਜ਼ ਵਿੱਚ ਆਏ ਮਾਡਲ—ਜਿਵੇਂ text-davinci-003 ਅਤੇ ਬਾਅਦ ਵਿੱਚ gpt-3.5-turbo—ਸਧਾਰਨ ਲਫ਼ਜ਼ਾਂ ਦੀ ਹਦਾਇਤਾਂ ਨੂੰ GPT-3 ਨਾਲੋਂ ਜ਼ਿਆਦਾ ਭਰੋਸੇਯੋਗ ਢੰਗ ਨਾਲ ਫੋਲੋ ਕਰਨ ਲਈ ਟ੍ਰੇਨ ਕੀਤੇ ਗਏ, ਹੋਰ ਸੁਰੱਖਿਅਤ ਜਵਾਬ ਦਿੰਦੇ ਅਤੇ ਬਹਿਰ-ਟਰੋਲ ਗੱਲਬਾਤੀ ਸੰਗਤਤਾ ਨੂੰ ਬਣਾਈ ਰੱਖਦੇ।

ਇਸ ਨੇ GPT-3.5 ਨੂੰ GPT-4 ਵੱਲ ਇਕ ਕੁਦਮ ਬਣਾਇਆ। ਇਹ ਦਿੱਸਦਾ ਸੀ ਕਿ: ਦਰਮਿਆਨੀ ਤਰਕਸ਼ੀਲਤਾ, ਲੰਬੇ ਪ੍ਰੰਪਟਾਂ ਨੂੰ ਹੱਥ ਵਿੱਚ ਰੱਖਣ ਦੀ ਕਾਬਲੀਅਤ, ਅਤੇ ਵਧੀਆ ਸੰਵਾਦਕਲਿਆਨ—ਬਿਨਾਂ GPT-4 ਦੇ ਪੂਰੇ ਜਟਿਲਤਾ ਅਤੇ ਲਾਗਤ ਦੇ।

ChatGPT ਦਾ ਪਹਿਲਾ ਜਨਤਕ ਰਿਲੀਜ਼ ਆਖਿਰ 2022 ਵਿੱਚ GPT-3.5-ਕਲਾਸ ਮਾਡਲ ਨਾਲ ਸੀ, ਜਿਸ ਨੂੰ RLHF ਨਾਲ ਫਾਈਨ‑ਟਿਊਨ ਕੀਤਾ ਗਿਆ ਸੀ। ਇਸ ਨਾਲ ਮਾਡਲ ਨੇ ਕਾਫੀ ਤਰੀਕੇ ਨਾਲ:

ੱਧਿਆਨ ਨਾਲ, ChatGPT ਬਹੁਰੀ ਲੋਕਾਂ ਲਈ ਪਹਿਲੀ ਵਾਰ ਹਥੋਂ-ਹਥ ਇੱਕ ਵੱਡੇ ਭਾਸ਼ਾਈ ਮਾਡਲ ਦਾ ਡਾਇਰੈਕਟ ਤਜ਼ਰਬਾ ਸੀ ਅਤੇ ਇਸਨੇ ਲੋਕਾਂ ਦੀਆਂ ਉਮੀਦਾਂ ਸੈੱਟ ਕੀਤੀਆਂ ਕਿ "AI ਚੈਟ" ਕਿਸ ਤਰ੍ਹਾਂ ਮਹਿਸੂਸ ਕਰੇ।

gpt-3.5-turbo ਅਤੇ ਕਿਉਂ ਇਹ ਡਿਫਾਲਟ ਬਣਿਆਜਦੋਂ OpenAI ਨੇ API ਰਾਹੀਂ gpt-3.5-turbo ਜਾਰੀ ਕੀਤਾ, ਇਸਨੇ ਕੀਮਤ, ਗਤੀ ਅਤੇ ਯੋਗਤਾ ਦਾ ਬਿਹਤਰੀਨ ਸੰਤੁਲਨ ਪ੍ਰਦਾਨ ਕੀਤਾ। ਇਹ ਪਹਿਲਾਂ ਦੇ GPT-3 ਮਾਡਲਾਂ ਤੋਂ ਸਸਤਾ ਤੇ ਤੇਜ਼ ਸੀ, ਫਿਰ ਵੀ ਇੰਸਟ੍ਰਕਸ਼ਨ ਫਾਲੋਅਿੰਗ ਅਤੇ ਸੰਵਾਦ ਗੁਣਵੱਤਾ ਵਿੱਚ ਬਿਹਤਰ ਸੀ।

ਇਸ ਸੰਤੁਲਨ ਨੇ gpt-3.5-turbo ਨੂੰ ਕਈ ਐਪਲੀਕੇਸ਼ਨਾਂ ਲਈ ਮੂਲ ਚੋਣ ਬਣਾ ਦਿੱਤਾ:

GPT-3.5 ਨੇ ਇੱਕ ਪਿਵਟਲ ਰੋਲ ਨਿਭਾਇਆ: ਕਾਫੀ ਸਮਰੱਥਾ, ਆਰਥਿਕਤਾ ਅਤੇ ਇਨਸਾਨੀ ਨਿਰਦੇਸ਼ਾਂ ਨਾਲ ਮਿਲ ਕੇ ਇਹਨਾਂ ਮਾਡਲਾਂ ਨੂੰ ਰੋਜ਼ਮਰਰਾ ਉਤਪਾਦਾਂ ਵਿੱਚ ਤਬਦੀਲ ਕੀਤਾ।

GPT-4, 2023 ਵਿੱਚ ਰਿਲੀਜ਼, "ਵੱਡੇ ਟੈਕਸਟ ਮਾਡਲ" ਤੋਂ ਇੱਕ ਜੀਨਰਲ-ਪਰਪਜ਼ ਸਹਾਇਕ ਵੱਲ ਬਦਲਾਅ ਦਾ ਸੂਚਕ ਸੀ—ਜੋ ਮਜ਼ਬੂਤ ਤਰਕਸ਼ੀਲਤਾ ਅਤੇ ਬਹੁ-ਮੋਡਲ ਇਨਪੁਟ ਰੱਖਦਾ ਸੀ।

GPT-3 ਅਤੇ GPT-3.5 ਨਾਲੋਂ, GPT-4 ਨੇ ਜ਼ਿਆਦਾ ਧਿਆਨ ਦਿੱਤਾ:

ਫਲੈਗਸ਼ਿਪ ਵਿੱਚ gpt-4 ਅਤੇ ਬਾਅਦ ਵਿੱਚ gpt-4-turbo ਸ਼ਾਮਲ ਸਨ, ਜਿਨ੍ਹਾਂ ਦਾ ਮਕਸਦ ਮਹਿੰਗੀ ਦੇ ਨਾਲ-ਨਾਲ ਲਾਗਤ ਅਤੇ ਲੇਟੇਨਸੀ ਘਟਾਉਣਾ ਸੀ।

GPT-4 ਦੀ ਇੱਕ ਮੁੱਖ ਵਿਸ਼ੇਸ਼ਤਾ ਇਸਦੀ ਬਹੁ-ਮੋਡਲ ਸਮਰੱਥਾ ਸੀ: ਟੈਕਸਟ ਦੇ ਇਲਾਵਾ, ਇਹ ਚਿੱਤਰ ਵੀ ਲੈ ਸਕਦਾ ਹੈ। ਯੂਜ਼ਰ ਇਸ ਤਰ੍ਹਾਂ ਕਰ ਸਕਦੇ ਸਨ:

ਇਸ ਨਾਲ GPT-4 ਸਿਰਫ਼ ਟੈਕਸਟ-ਅਧਾਰਿਤ ਮਾਡਲ ਨਹੀਂ ਰਹਿੰਦਾਂ, ਪਰ ਇੱਕ ਜਨਰਲ ਤਰਕਸ਼ੀਲ ਇੰਜਣ ਬਣ ਜਾਂਦਾ ਹੈ ਜੋ ਭਾਸ਼ਾ ਰਾਹੀਂ ਸੰਚਾਰ ਕਰਦਾ ਹੈ।

GPT-4 ਨੂੰ ਟ੍ਰੇਨ ਅਤੇ ਟਿਊਨ ਕੀਤਾ ਗਿਆ ਸੀ ਇਕ ਮਜ਼ਬੂਤ ਧਿਆਨ ਸੁਰੱਖਿਆ ਅਤੇ ਅਲਾਈਨਮੈਂਟ ਉੱਤੇ:

gpt-4 ਅਤੇ gpt-4-turbo ਵਰਗੇ ਮਾਡਲ ਗੰਭੀਰ ਉਤਪਾਦਕ ਹਲਾਂ ਲਈ ਮੁੱਖ ਚੋਣ ਬਣ ਗਏ: ਗਾਹਕ ਸਹਾਇਤਾ, ਕੋਡਿੰਗ ਸਹਾਇਕ, ਸਿੱਖਿਆ ਟੂਲਸ ਅਤੇ ਜਾਣਕਾਰੀ-ਖੋਜ। GPT-4 ਨੇ GPT-4o ਅਤੇ GPT-4o mini ਵਰਗੇ ਬਾਅਦ ਦੇ ਵੈਰੀਅੰਟਾਂ ਲਈ ਨੀਂਹ ਰੱਖੀ, ਜੋ ਸਮਰੱਥਾ ਦੇ ਨਾਲ-ਨਾਲ ਕੁਸ਼ਲਤਾ ਅਤੇ ਤੁਰੰਤ ਵਿਉਂਤਾਂ ਉੱਤੇ ਧਿਆਨ ਦਿੱਤੀਆਂ।

GPT-4o ("omni") "ਜਿੰਨਾ ਹੋ ਸਕੇ ਸਭ ਤੋਂ ਸਮਰੱਥ" ਤੋਂ ਬਦਲ ਕੇ "ਤੇਜ਼, ਸਸਤਾ, ਅਤੇ ਹਮੇਸ਼ਾਂ-ਚਾਲੂ" ਵਾਲੀ ਦਿਸ਼ਾ ਵੱਲ ਭੇਜਦਾ ਹੈ। ਇਹ GPT-4-ਕਲਾਸ ਗੁਣਵੱਤਾ ਦੇ ਦਿਣ ਦਿਣ ਵਿਚ ਕਾਫੀ ਘੱਟ ਖ਼ਰਚ 'ਤੇ ਅਤੇ ਲਗਭਗ ਰੀਅਲ-ਟਾਈਮ ਤਜਰਬੇ ਲਈ ਬਣਾਇਆ ਗਿਆ ਹੈ।

GPT-4o ਟੈਕਸਟ, ਵਿਜ਼ਨ ਅਤੇ ਆਡੀਓ ਨੂੰ ਇੱਕ ਹੀ ਮਾਡਲ ਵਿੱਚ ਇਕੱਠਾ ਕਰਦਾ ਹੈ। ਵੱਖਰੇ ਹਿੱਸੇ ਜੋੜਨ ਦੀ ਥਾਂ, ਇਹ ਨੈਟਿਵ ਤੌਰ 'ਤੇ ਸੰਭਾਲਦਾ ਹੈ:

ਇਹ ਇੰਟਿਗ੍ਰੇਸ਼ਨ ਲੇਟੇਨਸੀ ਅਤੇ ਜਟਿਲਤਾ ਘਟਾਉਂਦੀ ਹੈ। GPT-4o ਲੱਗਭਗ ਤੁਰੰਤ ਜਵਾਬ ਦੇ ਸਕਦਾ ਹੈ, ਜਿਹੜਾ ਲੀਵ-ਸਟ੍ਰੀਮ ਜਵਾਬ ਕਰਨ ਅਤੇ ਮੋਡਲ ਵਿਚ ਸੋਚਣ ਦੇ ਦੌਰਾਨ ਨਤੀਜੇ ਸਕ੍ਰੀਨ ਕਰ ਸਕਦਾ ਹੈ।

GPT-4o ਦਾ ਮੁੱਖ ਮਕਸਦ ਕੁਸ਼ਲਤਾ ਵਧਾਉਣਾ ਸੀ: ਪ੍ਰਤੀ ਡਾਲਰ ਵਧੀਆ ਪ੍ਰਦਰਸ਼ਨ ਅਤੇ ਕਮ ਲੇਟੇਨਸੀ। ਇਸ ਨਾਲ OpenAI ਅਤੇ ਵਿਕਾਸਕਾਰ ਇਹ ਕਰ ਸਕਦੇ ਹਨ:

ਨਤੀਜਾ ਇਹ ਹੈ ਕਿ ਕਈ ਖਾਸੀਅਤਾਂ ਜੋ ਪਹਿਲਾਂ ਮਹਿੰਗੇ API ਤੱਕ ਸੀਮਿਤ ਸਨ, ਹੁਣ ਵਿਦਿਆਰਥੀਆਂ, ਸ਼ੌਕੀਨ ਲੋਕਾਂ, ਛੋਟੇ ਸਟਾਰਟਅਪਾਂ ਅਤੇ ਨਵੇਂ ਪ੍ਰਯੋਗਕਾਰਾਂ ਲਈ ਵੀ ਆਸਾਨੀ ਨਾਲ ਉਪਲਬਧ ਹੋ ਗਈਆਂ ਹਨ।

GPT-4o mini ਦਸਦਾ ਹੈ ਕਿ ਪਹੁੰਚ ਹੋਰ ਵੀ ਵਧਾ ਸਕਦੀ ਹੈ: ਕੁਝ ਚੋਟੀ ਦੀ ਸਮਰੱਥਾ ਤੇ ਤਿਆਗ ਕਰਕੇ ਇਹ ਗਤੀ ਅਤੇ ਬਹੁਤ ਘੱਟ ਲਾਗਤ ਪ੍ਰਦਾਨ ਕਰਦਾ ਹੈ। ਇਹ ਮੁੱਖ ਤੌਰ 'ਤੇ ਉਚਿਤ ਹੈ:

4o mini ਦੇ ਆਰਥਿਕ ਹੋਣ ਕਾਰਨ, ਵਿਕਾਸਕਾਰ ਇਸਨੂੰ ਐਪਾਂ, ਗਾਹਕ ਪੋਰਟਲਾਂ, ਅੰਦਰੂਨੀ ਟੂਲਾਂ ਜਾਂ ਘੱਟ-ਬਜਟ ਸੇਵਾਵਾਂ ਵਿੱਚ ਅਸਾਨੀ ਨਾਲ ਐਬਡ ਕਰ ਸਕਦੇ ਹਨ।

ਇਕੱਠੇ, GPT-4o ਅਤੇ GPT-4o mini ਅਧੁਨਿਕ GPT ਖਾਸੀਅਤਾਂ ਨੂੰ ਰੀਅਲ-ਟਾਈਮ, ਗੱਲਬਾਤੀ ਅਤੇ ਬਹੁ-ਮੋਡਲ ਵਰਤੋਂ ਲਈ ਵਿਆਪਕ ਰੂਪ ਵਿੱਚ ਲਿਆਉਂਦੇ ਹਨ ਅਤੇ ਇਸ ਨਾਲ ਵਧੇਰੇ ਲੋਕ ਅਤੇ ਸੰਸਥਾਵਾਂ ਉਹਨਾਂ ਨਾਲ ਬਿਲਡ ਕਰ ਸਕਦੇ ਹਨ।

ਹਰ ਵਰਜ਼ਨ ਵਿੱਚ ਕੁਝ ਤਕਨੀਕੀ ਧਾਰਾਵਾਂ ਸਤਤ ਚੱਲਦੀਆਂ ਹਨ: ਸਕੇਲ, ਫੀਡਬੈਕ, ਸੁਰੱਖਿਆ, ਅਤੇ ਵਿਸ਼ੇਸ਼ੀਕਰਨ। ਇਹ ਮਿਲ ਕੇ ਦੱਸਦੀਆਂ ਹਨ ਕਿ ਹਰ ਨਵੀਂ ਰਿਲੀਜ਼ ਸਿਰਫ਼ ਵੱਡੀ ਹੀ ਨਹੀਂ ਲੱਗਦੀ, ਸਗੋਂ ਗੁਣਵੱਤੀ ਵਿੱਚ ਵੀ ਵੱਖਰੀ ਮਹਿਸੂਸ ਹੁੰਦੀ ਹੈ।

GPT ਦੀ ਪ੍ਰਗਤੀ ਦੇ ਪਿੱਛੇ ਇੱਕ ਮੁੱਖ ਖੋਜ ਸਕੇਲਿੰਗ ਲਾਅ ਹਨ: ਜੇ ਤੁਸੀਂ ਮਾਡਲ ਪੈਰਾਮੀਟਰ, ਡੇਟਾ ਸਾਈਜ਼ ਅਤੇ ਕੰਪਿਊਟ ਨੂੰ ਸੰਤੁਲਿਤ ਤਰੀਕੇ ਨਾਲ ਵਧਾਉਂਦੇ ਹੋ, ਤਾਂ ਪ੍ਰਦਰਸ਼ਨ ਅਕਸਰ ਸਧਾਰਨ ਅਤੇ ਭਵਿੱਖਬਾਣੀਯੋਗ ਤਰੀਕੇ ਨਾਲ ਸੁਧਰਦਾ ਹੈ।

ਸ਼ੁਰੂਆਤੀ ਮਾਡਲਾਂ ਨੇ ਦਿਖਾਇਆ:

ਇਸ ਨਾਲ ਇੱਕ ਪ੍ਰਣਾਲੀ ਬਣੀ:

ਕੱਚੇ GPT ਮਾਡਲ ਸ਼ਕਤੀਸ਼ਾਲੀ ਹਨ ਪਰ ਯੂਜ਼ਰ ਉਮੀਦਾਂ ਨਾਲ ਨਿਰਪੱਖ ਰਹਿੰਦੇ ਹਨ। RLHF ਉਨ੍ਹਾਂ ਨੂੰ ਸਹਾਇਕ ਏਜੰਟਾਂ ਵਾਂਗ ਬਦਲਦਾ ਹੈ:

ਸਮੇਂ ਦੇ ਨਾਲ ਇਹ ਇੰਸਟ੍ਰਕਸ਼ਨ-ਟਿਊਨਿੰਗ + RLHF ਵਿਚ ਬਦਲ ਗਿਆ: ਪਹਿਲਾਂ ਬਹੁਤ ਸਾਰੇ ਇੰਸਟ੍ਰਕਸ਼ਨ‑ਰੇਸਪਾਂਸ ਜੋੜਿਆਂ 'ਤੇ ਫਾਈਨ‑ਟਿਊਨ, ਫਿਰ RLHF ਨਾਲ ਰਵੱਈਏ ਨੂੰ ਨਿੱਖਾਰਨਾ। ਇਹ ਮਿਲਾਪ ChatGPT-ਸ਼ੈਲੀ ਸੰਵਾਦਾਂ ਦਾ ਆਧਾਰ ਬਣਦਾ ਹੈ।

ਸਮਰੱਥਾ ਵਧਣ ਨਾਲ, ਵਿਸ਼ਲੇਸ਼ਣਾਤਮਕ ਸੁਰੱਖਿਆ ਮੁਲਾਂਕਣ ਅਤੇ ਨੀਤੀ ਲਾਗੂ ਕਰਨ ਦੀ ਲੋੜ ਵੀ ਵਧੀ।

ਤਕਨੀਕੀ ਪੈਟਰਨ ਵਿੱਚ ਸ਼ਾਮਲ ਹਨ:

ਇਹ ਮਕੈਨਿਜ਼ਮ ਮੁੜ-ਮੁੜ ਅਨੁਸਰਿਤ ਹੋਕੇ ਨਵੀਆਂ ਫੇਲਯੂਰ ਮੋਡਜ਼ ਨੂੰ ਪਛਾਣਦੇ ਹਨ ਅਤੇ ਟ੍ਰੇਨਿੰਗ ਡੇਟਾ, ਰਿਵਾਰਡ ਮਾਡਲ ਅਤੇ ਫਿਲਟਰਾਂ ਵਿੱਚ ਸੁਧਾਰ ਲੈਂਦੇ ਹਨ।

ਪਹਿਲੇ ਰਿਲੀਜ਼ ਇਕ ਫਲੈਗਸ਼ਿਪ ਮਾਡਲ 'ਤੇ ਕੇਂਦਰਿਤ ਸਨ। ਸਮੇਂ ਦੇ ਨਾਲ ਰੁਝਾਨ ਓਹ ਹੋਇਆ ਕਿ ਮਾਡਲ ਪਰਿਵਾਰ ਬਣਾਏ ਜਾਣ:

ਇਹ ਮੂਲ ਰਾਜ਼: ਸਾਂਝੇ ਬੇਸ ਆਰਕੀਟੈਕਚਰ ਅਤੇ ਟ੍ਰੇਨਿੰਗ ਪਾਈਪਲਾਈਨ, ਫਿਰ ਟਾਰਗੇਟਡ ਫਾਈਨ‑ਟਿਊਨਿੰਗ ਅਤੇ ਸੁਰੱਖਿਆ ਲੇਅਰਾਂ ਨਾਲ ਪੋਰਟਫੋਲਿਓ ਤਿਆਰ ਕਰਨਾ। ਇਹ ਬਹੁ-ਮਾਡਲ ਰਣਨੀਤੀ ਹੁਣ GPT ਵਿਕਾਸ ਦੀ ਇੱਕ ਮੱਖੀ ਰੁਝਾਨ ਬਣ ਚੁੱਕੀ ਹੈ।

GPT ਮਾਡਲ ਭਾਸ਼ਾ-ਅਧਾਰਤ AI ਨੂੰ ਇੱਕ ਖੋਜੀ ਟੂਲ ਤੋਂ ਉਹ ਇੰਫਰਾਸਟਰਕਚਰ ਬਣਾਉਣ ਵਿੱਚ ਸਫਲ ਰਹੇ ਜੋ ਬਹੁਤ ਲੋਕਾਂ ਅਤੇ ਸੰਸਥਾਵਾਂ ਹੁਣ ਆਪਣੇ ਉਤਪਾਦਾਂ 'ਚ ਬੁਨਿਆਦੀ ਢੰਗ ਨਾਲ ਵਰਤਦੇ ਹਨ।

ਡਿਵੈਲਪਰਾਂ ਲਈ GPT ਮਾਡਲ ਇੱਕ ਲਚਕੀਲਾ "ਭਾਸ਼ਾ ਇੰਜਣ" ਵਾਂਗ ਵਰਤਦੇ ਹਨ। ਹੱਥ-ਹਥ ਨਿਯਮਾਂ ਲਿਖਣ ਦੀ ਥਾਂ, ਉਹ ਸੁਭਾਵਿਕ-ਭਾਸ਼ਾ ਪ੍ਰੰਪਟ ਭੇਜਦੇ ਹਨ ਅਤੇ ਟੈਕਸਟ, ਕੋਡ ਜਾਂ ਢਾਂਚਾਬੱਧ ਆউਟਪੁਟ ਲੈਂਦੇ ਹਨ।

ਇਸ ਨੇ ਸਾਫਟਵੇਅਰ ਡਿਜ਼ਾਈਨ ਨੂੰ ਬਦਲ ਦਿੱਤਾ:

ਅਸਲ ਵਿੱਚ, ਬਹੁਤ ਸਾਰੇ ਉਤਪਾਦ ਹੁਣ GPT ਨੂੰ ਇੱਕ ਕੋਰ ਕੰਪੋਨੇਟ ਵਜੋਂ ਵਰਤਦੇ ਹਨ, ਨਾ ਕਿ ਸਿਰਫ਼ ਇੱਕ ਐਡ‑ਆਨ ਵਜੋਂ।

ਕੰਪਨੀਆਂ GPT ਮਾਡਲਾਂ ਦਾ ਉਪਯੋਗ ਅੰਦਰੂਨੀ ਅਤੇ ਗਾਹਕ-ਮੁੱਖ ਤੌਰ 'ਤੇ ਦੋਹਾਂ ਲਈ ਕਰਦੀਆਂ ਹਨ।

ਅੰਦਰੂਨੀ ਤੌਰ 'ਤੇ, ਟੀਮਾਂ ਸਪੋਰਟ ਟ੍ਰਾਇਅਜ, ਈਮੇਲ ਅਤੇ ਰਿਪੋਰਟ ਡਰਾਫਟ, ਪ੍ਰੋਗ੍ਰਾਮਿੰਗ ਸਹਾਇਤਾ ਅਤੇ ਦਸਤਾਵੇਜ਼ ਅਤੇ ਲੌਗ ਵਿਸ਼ਲੇਸ਼ਣ ਆਦਿ ਨੁਹਾਰਦੀਆਂ ਹਨ। ਬਾਹਰੀ ਤੌਰ 'ਤੇ, GPT ਚੈਟਬੋਟ, ਪ੍ਰੋਡਕਟੀਵਿਟੀ ਕੋਪਾਈਲਟ, ਕੋਡਿੰਗ ਸਹਾਇਕ, ਸਮੱਗਰੀ ਅਤੇ ਮਾਰਕੀਟਿੰਗ ਟੂਲ ਅਤੇ ਖੇਤਰ ਖ਼ਾਸ ਕੋਪਾਈਲਟ (ਫ਼ਾਇਨੈਂਸ, ਕਾਨੂੰਨ, ਹੈਲ्थਕੇਅਰ) ਲਈ ਬਿਆਨ ਕੀਤਾ ਜਾਂਦਾ ਹੈ।

API ਅਤੇ ਹੋਸਟ ਕੀਤੇ ਉਤਪਾਦਾਂ ਨਾਲ ਅੱਗੇ-ਪਿੱਛੇ ਇੰਫਰਾਸਟਰਕਚਰ ਜਾਂ ਮਾਡਲ ਪਾਕੇਜ ਕਰਨ ਦੀ ਲੋੜ ਘੱਟ ਹੋ ਗਈ, ਜਿਸ ਨਾਲ ਛੋਟੇ ਤੇ ਮੱਧਮ ਆਕਾਰ ਦੇ ਸੰਗਠਨਾਂ ਲਈ ਵਿਸ਼ੇਸ਼ ਤੌਰ 'ਤੇ ਰੁਕਾਵਟ ਘੱਟ ਹੋਈ।

ਖੋਜਕਾਰ GPT ਨੂੰ ਵਿਚਾਰ-ਜਨਰੇਟ ਕਰਨ, ਪ੍ਰਯੋਗਾਂ ਲਈ ਕੋਡ ਬਣਾਉਣ, ਪੇਪਰਾਂ ਦੇ ਡਰਾਫਟ ਲਿਖਣ ਅਤੇ ਖ਼ਿਆਲਾਂ ਨੂੰ ਖੁਦਰੇ ਤਰੀਕੇ ਨਾਲ ਪਰਖਣ ਲਈ ਵਰਤਦੇ ਹਨ। ਸਿੱਖਿਆ ਅਤੇ ਵਿਦਿਆਰਥੀ GPT ਨੂੰ ਵਿਆਖਿਆਵਾਂ, ਅਭਿਆਸ ਪ੍ਰਸ਼ਨ, ਟਿਛਰੰਗ ਅਤੇ ਭਾਸ਼ਾ ਸਹਾਇਤਾ ਲਈ ਵਰਤਦੇ ਹਨ।

ਲੇਖਕ, ਡਿਜ਼ਾਈਨਰ ਅਤੇ ਰਚਨਾਕਾਰ GPT ਨੂੰ ਆਉਟਲਾਈਨ, ਆਈਡੀਆਸ਼ਨ, ਸੰਸਾਰ-ਰਚਨਾ ਅਤੇ ਡਰਾਫਟ ਸੁਧਾਰ ਲਈ ਵਰਤਦੇ ਹਨ। ਇਹ ਮਾਡਲ ਬਦਲ ਦੇਣ ਵਾਲਾ ਨਹੀਂ, ਸਗੋਂ ਇੱਕ ਸਹਿਯੋਗੀ ਹੈ ਜੋ ਖੋਜ ਨੂੰ ਤੇਜ਼ ਕਰਦਾ ਹੈ।

GPT ਮਾਡਲਾਂ ਦੇ ਫੈਲਾਅ ਨਾਲ ਗੰਭੀਰ ਚਿੰਤਾਵਾਂ ਵੀ ਉਭਰੀਆਂ ਹਨ। ਕੁਝ ਨੌਕਰੀਆਂ ਆਟੋਮੇਸ਼ਨ ਨਾਲ ਬਦਲ ਸਕਦੀਆਂ ਹਨ, ਜਦਕਿ ਹੋਰਾਂ ਲਈ ਨਵੀਆਂ ਮੁਲਕਤਾਂ ਬਣ ਸਕਦੀਆਂ ਹਨ, ਜਿਸ ਨਾਲ ਕਰਮਚਾਰੀਆਂ ਨੂੰ ਨਵੀਆਂ ਕੁਸ਼ਲਤਾਵਾਂ ਸਿੱਖਣ ਦੀ ਲੋੜ ਹੋ ਸਕਦੀ ਹੈ।

ਕਿਉਂਕਿ GPT ਮਨੁੱਖੀ ਡੇਟਾ 'ਤੇ ਟ੍ਰੇਨ ਹੁੰਦਾ ਹੈ, ਇਹ ਸ਼ਾਮਿਲ ਸਮਾਜਿਕ ਪੱਖਪਾਤਾਂ ਨੂੰ ਦਰਸਾ ਸਕਦਾ ਹੈ। ਇਹ ਯਥਾਰਥ-ਲਗਦਾ ਪਰ ਗਲਤ ਜਾਣਕਾਰੀ ਬਣਾਉਣ ਅਤੇ ਵਿਸ਼ਵਸਨੀਯਤਾ ਘਟਾਉਣ ਵਾਲਾ ਵੀ ਹੋ ਸਕਦਾ ਹੈ। ਇਸ ਲਈ ਅਲਾਈਨਮੈਂਟ ਤਕਨੀਕਾਂ, ਵਰਤੋਂ ਨੀਤੀਆਂ, ਨਿਗਰਾਨੀ ਅਤੇ ਖੋਜ-ਅਧਾਰਿਤ ਟੁੱਲਾਂ ਉੱਤੇ ਕੰਮ ਹੋ ਰਿਹਾ ਹੈ। ਸ਼ਕਤੀਸ਼ਾਲੀ ਨਵੇਂ ਉਪਯੋਗਾਂ ਅਤੇ ਸੁਰੱਖਿਆ, ਨਿਆਇਕਤਾ ਅਤੇ ਭਰੋਸੇ ਦੇ ਬੈਲੰਸ ਨੂੰ ਕਾਇਮ ਰੱਖਣਾ ਇੱਕ ਜਾਰੀ ਚੈਲੰਜ ਹੈ।

ਜਦੋਂ GPT ਮਾਡਲ ਹੋਰ ਸਮਰੱਥ ਹੋ ਰਹੇ ਹਨ, ਮੁੱਖ ਸਵਾਲ ਹੁਣ "ਕੀ ਅਸੀਂ ਇਨ੍ਹਾਂ ਨੂੰ ਬਣਾ ਸਕਦੇ ਹਾਂ?" ਤੋਂ ਬਦਲ ਕੇ "ਅਸੀਂ ਇਨ੍ਹਾਂ ਨੂੰ ਕਿਵੇਂ ਬਣਾਈਏ, ਡਿਪਲੋਏ ਅਤੇ ਸ਼ਾਸਿਤ ਕਰੀਏ?" ਵੱਲ ਜਾ ਚੁੱਕੇ ਹਨ।

ਕੁਸ਼ਲਤਾ ਅਤੇ ਪਹੁੰਚ. GPT-4o ਅਤੇ GPT-4o mini ਐਸਾ ਭਵਿੱਖ ਦਿਖਾਉਂਦੇ ਹਨ ਜਿੱਥੇ ਉੱਚ-ਗੁਣਵੱਤਾ ਮਾਡਲ ਸਸਤੇ ਦਾਮ 'ਤੇ, ਛੋਟੇ ਸਰਵਰਾਂ 'ਤੇ ਅਤੇ ਅੰਤ ਵਿੱਚ ਨਿੱਜੀ ਡਿਵਾਈਸਾਂ 'ਤੇ ਚੱਲ ਸਕਦੇ ਹਨ। ਮੁੱਖ ਸਵਾਲ:

ਨਿੱਜੀਕਰਨ ਬਿਨਾਂ ਓਵਰਫਿਟਿੰਗ. ਯੂਜ਼ਰ ਇਹ ਚਾਹੁੰਦੇ ਹਨ ਕਿ ਮਾਡਲ ਪਸੰਦ, ਸ਼ੈਲੀ ਅਤੇ ਵਰਕਫਲੋ ਯਾਦ ਰੱਖੇ ਬਿਨਾਂ ਡੇਟਾ ਲੀਕ ਜਾਂ ਵਿਆਪਕ ਪੱਖਪਾਤ ਦੇ। ਖੁਲੇ ਸਵਾਲ:

ਭਰੋਸੇਯੋਗਤਾ ਅਤੇ ਤਰਕ: ਸਿੱਖੀਆਂ ਮਾਡਲ ਹੁਣ ਵੀ ਹੈਲੂਸਿਨੇਟ ਕਰਦੇ ਹਨ, ਚੁੱਪ ਚਾਪ ਫੇਲ ਹੁੰਦੇ ਹਨ ਜਾਂ ਦਿਸਟ੍ਰੀਬਿਊਸ਼ਨ-ਸ਼ਿਫਟ 'ਤੇ ਅਣਪ੍ਰਤਿਆਸ਼ਿਤ ਤਰੀਕੇ ਨਾਲ ਵਰਤੋਂ ਕਰਦੇ ਹਨ। ਖੋਜ ਇਹਨਾਂ ਉੱਤੇ ਕੰਮ ਕਰ ਰਹੀ ਹੈ:

ਪੈਮਾਨੇ ਤੇ ਸੁਰੱਖਿਆ ਅਤੇ ਅਲਾਈਨਮੈਂਟ. ਜਿਵੇਂ ਮਾਡਲ ਟੂਲ ਅਤੇ ਆਟੋਮੇਸ਼ਨ ਰਾਹੀਂ ਵੱਧ ਏਜੰਸੀ ਪ੍ਰਾਪਤ ਕਰਦੇ ਹਨ, ਉਨ੍ਹਾਂ ਨੂੰ ਮਨੁੱਖੀ ਮੂਲ ਯਾਂੀਆਂ ਨਾਲ ਅਨੁਕੂਲ ਬਣਾਈ ਰੱਖਣ ਅਤੇ ਅਪਡੇਟ ਦੇ ਦੌਰਾਨAligned ਰਹਿਣਾ ਇੱਕ ਮੁਸ਼ਕਲ ਚੈਲੰਜ ਹੈ। ਇਹ ਸ਼ਾਮਲ ਕਰਦਾ ਹੈ ਸੱਭਿਆਚਾਰਕ ਬਹੁਤਾ: ਕਿਸ ਦੀਆਂ ਮੁੱਲਾਂ ਅਤੇ ਨਾਰੀਆਂ ਨੂੰ ਐਨਕੋਡ ਕੀਤਾ ਜਾ ਰਿਹਾ ਹੈ ਅਤੇ ਮੇਲ-ਜੋਲ ਵਿੱਚ ਵਿਵਾਦਾਂ ਨੂੰ ਕਿਵੇਂ ਹਲ ਕੀਤਾ ਜਾਵੇ।

ਨਿਯਮ ਅਤੇ ਮਿਆਰ. ਸਰਕਾਰਾਂ ਅਤੇ ਉਦਯੋਗ ਗਰੁੱਪ ਪਾਰਦਰਸ਼ਤਾ, ਡੇਟਾ ਉਪਯੋਗ, ਵਾਟਰਮਾਰਕਿੰਗ ਅਤੇ ਘਟਨਾ ਰਿਪੋਰਟਿੰਗ ਲਈ ਨਿਯਮ ਤਿਆਰ ਕਰ ਰਹੇ ਹਨ। ਖੁਲੇ ਸਵਾਲ:

ਭਵਿੱਖੀ GPT ਸਿਸਟਮ ਸੰਭਵ ਹੈ ਕਿ ਹੋਰ ਕੁਸ਼ਲ, ਹੋਰ ਨਿੱਜੀਕਰਣਯੋਗ ਅਤੇ ਸੰਗਠਨਾਂ ਵਿੱਚ ਹੋਰ ਗੁੰਥੇ ਹੋਣਗੇ। ਨਵੇਂ ਯੋਗਤਾਵਾਂ ਦੇ ਨਾਲ-ਨਾਲ, ਹੋਰ ਰਸਮੀ ਸੁਰੱਖਿਆ ਅਭਿਆਸ, ਸੁਤੰਤਰ ਮੁਲਾਂਕਣ ਅਤੇ ਯੂਜ਼ਰ ਕੰਟਰੋਲ ਦੀ ਉਮੀਦ ਕਰੋ। GPT-1 ਤੋਂ GPT-4 ਤੱਕ ਦੀ ਇਤਿਹਾਸ ਦੀ ਯਾਤਰਾ ਮੁਸੱਲਾ ਤਰੱਕੀ ਦਿਖਾਉਂਦੀ ਹੈ, ਪਰ ਇਹ ਵੀ ਸਾਬਤ ਕਰਦੀ ਹੈ ਕਿ ਤਕਨੀਕੀ ਤਰੱਕੀ ਨੂੰ ਸ਼ਾਸਨ, ਸਮਾਜਿਕ ਪ੍ਰਤੀਕਿਰਿਆ ਅਤੇ ਅਸਲੀ ਦੁਨੀਆਂ ਦੇ ਪ੍ਰਭਾਵਾਂ ਨਾਲ ਨਾਲ ਹੀ ਅੱਗੇ ਲਿਜਾਇਆ ਜਾਣਾ ਚਾਹੀਦਾ ਹੈ।

GPT (Generative Pre-trained Transformer) ਮਾਡਲ ਵੱਡੀਆਂ ਨਿਊਰਲ ਨੈੱਟਵਰਕ ਹਨ ਜਿਨ੍ਹਾਂ ਨੂੰ ਇੱਕ ਲੜੀ ਵਿੱਚ ਅਗਲਾ ਸ਼ਬਦ ਅਨੁਮਾਨ ਲਗਾਉਣ ਲਈ ਸਿਖਾਇਆ ਜਾਂਦਾ ਹੈ। ਇਸ ਤਰ੍ਹਾਂ ਦੇ ਵਿਸ਼ਾਲ ਟੈਕਸਟ ਡੇਟਾਸੈੱਟ 'ਤੇ ਸਿਖਲਾਈ ਦੇ ਨਾਲ, ਇਹ ਗ੍ਰਾਮਰ, ਲਿਖਣ ਦੀ ਸ਼ੈਲੀ, ਤੱਥ ਅਤੇ ਸੋਚਣ ਦੇ ਰੁਝਾਨ ਸਿੱਖ ਲੈਂਦੇ ਹਨ। ਇੱਕ ਵਾਰੀ ਸਿਖ ਗਿਆ, ਇਹ ਕਰ ਸਕਦੇ ਹਨ:

ਇਤਿਹਾਸ ਜਾਣਨ ਨਾਲ ਇਹ ਸਪਸ਼ਟ ਹੁੰਦਾ ਹੈ:

ਇਹ ਹਕੀਕਤਾਂ ਸੰਭਾਵਨਾਵਾਂ ਅਤੇ ਸੀਮਾਵਾਂ ਨੂੰ ਸਮਝਣ ਵਿੱਚ ਮਦਦ ਕਰਦੀਆਂ ਹਨ: GPT ਸ਼ਕਤਿਸ਼ਾਲੀ ਪੈਟਰਨ-ਸਿੱਖਣ ਵਾਲੇ ਹੰਨ, ਪਰ ਅਕਿਫ਼ੀਰ ਨਹੀਂ।

ਮੁੱਖ ਮਾਈਲਸਟੋਨ ਵਿੱਚ ਸ਼ਾਮਲ ਹਨ:

ਇੰਸਟ੍ਰਕਸ਼ਨ ਟਿਊਨਿੰਗ ਅਤੇ RLHF ਮਾਡਲਾਂ ਨੂੰ ਲੋਕਾਂ ਦੀ ਅਸਲੀ ਮੰਗ ਨਾਲ ਬਧੀਆ ਜੋੜਦੀਆਂ ਹਨ।

ਇਨ੍ਹਾਂ ਦੇ ਮਿਲਾਪ ਨਾਲ:

GPT-4 ਪਿਛਲੇ ਮਾਡਲਾਂ ਨਾਲੋਂ ਕਈ ਤਰੀਕਿਆਂ ਵਿੱਚ ਵੱਖਰਾ ਹੈ:

ਇਹ ਤਬਦੀਲੀਆਂ GPT-4 ਨੂੰ ਇੱਕ ਸਿਰਫ਼ ਟੈਕਸਟ ਜਨਰੇਟਰ ਤੋਂ ਇੱਕ ਜਨਰਲ-ਪਰਪਜ਼ ਸਹਾਇਕ ਵੱਲ ਲਿਜਾਂਦੀਆਂ ਹਨ।

GPT-4o ਅਤੇ GPT-4o mini ਗਤੀ, ਲਾਗਤ ਅਤੇ ਤੁਰੰਤ ਵਰਤੋਂ ਲਈ ਅਧਿਕਤਮ ਹਨ:

ਇਹ ਮਾਡਲ ਉੱਚ-ਗੁਣਵੱਤਾ ਖ਼ਾਸੀਅਤਾਂ ਨੂੰ ਵਿਆਪਕ ਤੌਰ 'ਤੇ ਆਰਥਿਕ ਬਣਾਉਂਦੇ ਹਨ।

ਡਿਵੈਲਪਰ ਆਮ ਤੌਰ 'ਤੇ GPT ਮਾਡਲਾਂ ਨੂੰ ਵਰਤਦੇ ਹਨ:

API ਰਾਹੀਂ ਪਹੁੰਚ ਹੋਣ ਕਾਰਨ, ਟੀਮਾਂ ਨੂੰ ਆਪਣੇ ਸਿਰੇ 'ਤੇ ਮਾਡਲ ਨਹੀਂ ਬਣਾਉਣੇ ਪੈਂਦੇ।

ਮੌਜੂਦਾ GPT ਮਾਡਲਾਂ ਦੀਆਂ ਮੁੱਖ ਸੀਮਾਵਾਂ ਹਨ:

ਆਮ ਤੌਰ 'ਤੇ ਮਹੱਤਵਪੂਰਨ ਵਰਤੋਂ ਲਈ ਜਵਾਬਾਂ ਦੀ ਪੁਸ਼ਟੀ, retrieval ਅਤੇ ਹੋਰ ਵੈਲਿਡੇਟਰਾਂ ਨਾਲ ਚੇਕ ਕਰਨਾ ਅਤੇ ਮਨੁੱਖੀ ਨਿਗਰਾਨੀ ਰੱਖਣੀ ਚਾਹੀਦੀ ਹੈ।

ਲੇਖ ਵਿੱਚ ਦਿਖਾਏ ਗਏ ਕਈ ਰੁਝਾਨ ਭਵਿੱਖ ਦੇ GPT ਸਿਸਟਮਾਂ ਨੂੰ ਆਕਾਰ ਦੇਣਗੇ:

ਲੇਖ ਕੁਝ ਪ੍ਰਾਇਕਟਿਕ ਸੁਝਾਵ ਦਿੰਦਾ ਹੈ:

ਸੰਤੁਲਿਤ ਨਜ਼ਰੀਏ ਨਾਲ, ਭਵਿੱਖ ਦੇ ਸਿਸਟਮ ਹੋਰ ਸਮਰੱਥ, ਨਿੱਜੀਕਰਣਯੋਗ ਅਤੇ ਕੰਟਰੋਲ-ਯੋਗ ਹੋਣਗੇ, ਪਰ ਇਸਦੇ ਨਾਲ-ਨਾਲ ਸੁਰੱਖਿਆ ਅਤੇ ਨਿਰੀਖਣ ਦੇ ਤਰੀਕੇ ਵੀ ਜ਼ਰੂਰੀ ਹੋਣਗੇ।

GPT ਨੂੰ ਪ੍ਰਭਾਵਸ਼ਾਲੀ ਤਰੀਕੇ ਨਾਲ ਵਰਤਣ ਦਾ مطلب ਹੈ ਕਿ ਇਸਦੀਆਂ ਤਾਕਤਾਂ ਨੂੰ ਸੁਰੱਖਿਅਤ ਪ੍ਰਯੋਗ ਦੇ ਨਾਲ ਜੋੜਿਆ ਜਾਵੇ।