12 ਨਵੰ 2025·8 ਮਿੰਟ

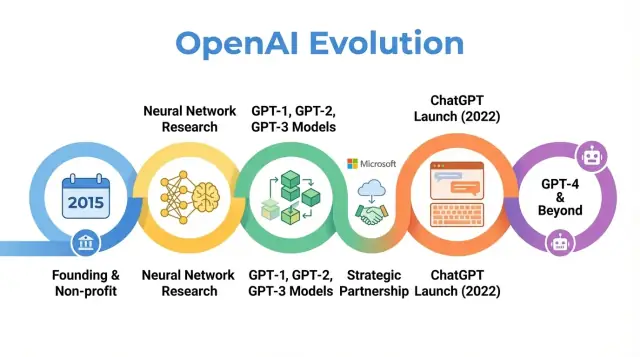

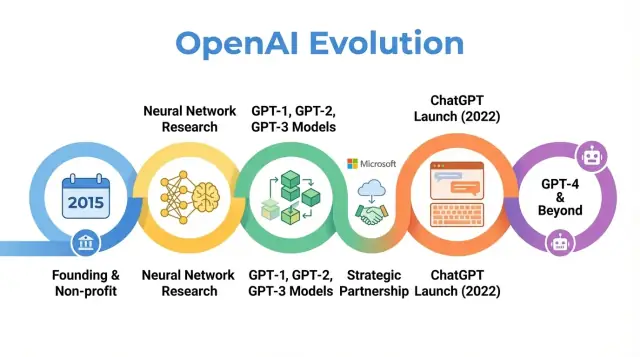

ਗੈਰ-ਨਫੇ ਵਾਲੇ ਲੈਬ ਤੋਂ ਏਆਈ ਅਗੂ: OpenAI ਦਾ ਇਤਿਹਾਸ

OpenAI ਦੇ ਇਤਿਹਾਸ ਦੀ ਖੋਜ ਕਰੋ — ਇਸਦੇ ਗੈਰ-ਲਾਭਕਾਰੀ ਸ਼ੁਰੂਆਤ, ਪ੍ਰਮੁੱਖ ਰਿਸਰਚ ਮਾਈਲਸਟੋਨ, ChatGPT ਅਤੇ GPT-4 ਦੇ ਲਾਂਚ ਅਤੇ ਇਸਦੇ ਬਦਲਦੇ ਮਿਸ਼ਨ ਦਾ ਵੇਰਵਾ।

OpenAI ਦੇ ਇਤਿਹਾਸ ਦੀ ਖੋਜ ਕਰੋ — ਇਸਦੇ ਗੈਰ-ਲਾਭਕਾਰੀ ਸ਼ੁਰੂਆਤ, ਪ੍ਰਮੁੱਖ ਰਿਸਰਚ ਮਾਈਲਸਟੋਨ, ChatGPT ਅਤੇ GPT-4 ਦੇ ਲਾਂਚ ਅਤੇ ਇਸਦੇ ਬਦਲਦੇ ਮਿਸ਼ਨ ਦਾ ਵੇਰਵਾ।

OpenAI ਇੱਕ AI ਰਿਸਰਚ ਅਤੇ ਡਿਪਲੋਇਮੈਂਟ ਕੰਪਨੀ ਹੈ ਜਿਸਦੇ ਕੰਮ ਨੇ ਲੋਕਾਂ ਦੇ ਸੋਚਣ ਦੇ ਢੰਗ ਨੂੰ ਪ੍ਰਭਾਵਿਤ ਕੀਤਾ ਹੈ—ਸ਼ੁਰੂਆਤੀ ਰਿਸਰਚ ਪੇਪਰਾਂ ਤੋਂ ਲੈ ਕੇ ChatGPT ਵਰਗੇ ਉਤਪਾਦਾਂ ਤੱਕ। ਇਹ ਸਮਝਣਾ ਕਿ OpenAI ਕਿਵੇਂ ਵਿਕਸਤ ਹੋਇਆ—2015 ਵਿੱਚ ਸਾਧਾ ਗੈਰ-ਲਾਭਕਾਰੀ ਲੈਬ ਹੋਣ ਤੋਂ ਲੈ ਕੇ ਏਆਈ ਖੇਤਰ ਦਾ ਕੇਂਦਰੀ ਖਿਡਾਰੀ ਬਣਨ ਤੱਕ—ਇਸ ਗੱਲ ਨੂੰ ਵਿਆਖਿਆ ਕਰਨ ਵਿੱਚ ਮਦਦ ਕਰਦਾ ਹੈ ਕਿ ਆਧੁਨਿਕ ਏਆਈ ਅੱਜ ਇਸ ਤਰ੍ਹਾਂ ਕਿਉਂ ਦਿੱਸਦਾ ਹੈ।

OpenAI ਦੀ ਕਹਾਣੀ ਸਿਰਫ ਮਾਡਲ ਰਿਲੀਜ਼ਾਂ ਦੀ ਲੜੀ ਨਹੀਂ ਹੈ। ਇਹ ਮਿਸ਼ਨ, ਪ੍ਰੇਰਕਾਂ, ਤਕਨੀਕੀ ਉਪਲਬਧੀਆਂ ਅਤੇ ਜਨਤਕ ਦਬਾਅ ਦੇ ਅੰਤਰਕਿਰਿਆ ਦਾ ਇੱਕ ਕੇਸ ਅਧਿਐਨ ਹੈ। ਸੰਗਠਨ ਨੇ ਸ਼ੁਰੂ ਵਿੱਚ ਖੁੱਲ੍ਹੇ ਰਿਸਰਚ ਅਤੇ ਵਿਸ਼ਾਲ ਲਾਭ 'ਤੇ ਜ਼ੋਰ ਦਿੱਤਾ, ਫਿਰ ਪੂੰਜੀ ਆਕਰਸ਼ਣ ਲਈ ਰੀਸਟਰਕਚਰ ਕੀਤਾ, Microsoft ਨਾਲ ਡੂੰਘੀ ਭਾਈਚਾਰਾ ਬਣਾਇਆ, ਅਤੇ ਉਹ ਉਤਪਾਦ ਲਾਂਚ ਕੀਤੇ ਜੋ ਸੌਂਖਿਆਂ ਮਿਲੀਅਨਾਂ ਲੋਕਾਂ ਦੁਆਰਾ ਵਰਤੇ ਜਾਂਦੇ ਹਨ।

OpenAI ਦਾ ਇਤਿਹਾਸ ਕੁਝ ਵੱਡੇ ਰੁਝਾਨਾਂ ਨੂੰ ਰੌਸ਼ਨ ਕਰਦਾ ਹੈ:

ਮਿਸ਼ਨ ਅਤੇ ਮੁੱਲ: OpenAI ਦੀ ਸਥਾਪਨਾ ਦਾ ਉਦੇਸ਼ ਇਹ ਸੀ ਕਿ AGI ਦਾ ਫਾਇਦਾ ਸਾਰੀ ਮਨੁੱਖਤਾ ਲਈ ਹੋਵੇ। ਸਮੇਂ ਦੇ ਨਾਲ ਇਹ ਮਿਸ਼ਨ ਕਿਵੇਂ ਵੀਖਿਆ ਗਿਆ ਅਤੇ ਸੋਧਿਆ ਗਿਆ—ਇਹ ਦਿਖਾਉਂਦਾ ਹੈ ਕਿ ਆਦਰਸ਼ਵਾਦ ਅਤੇ ਵਪਾਰਕ ਹਕੀਕਤਾਂ ਵਿਚਕਾਰ ਕਿਹੜੀਆਂ ਟਕਰਾਵਾਂ ਹਨ।

ਰਿਸਰਚ ਉਪਲਬਧੀਆਂ: ਸ਼ੁਰੂਆਤੀ ਪ੍ਰੋਜੈਕਟਾਂ ਤੋਂ GPT-3, GPT-4, DALL·E ਅਤੇ Codex ਵਰਗੀਆਂ ਸਿਸਟਮਾਂ ਤੱਕ ਦਾ ਪ੍ਰਗਟੀ ਪ੍ਰਦਰਸ਼ਨ ਵੱਡੇ-ਪੈਮਾਨੇ ਦੇ ਫਾਊਂਡੇਸ਼ਨ ਮਾਡਲਾਂ ਵਲ ਵਧਣ ਨੂੰ ਦਰਸਾਉਂਦਾ ਹੈ ਜੋ ਅੱਜ ਦੇ ਬਹੁਤ ਸਾਰੇ AI ਐਪਲੀਕੇਸ਼ਨਾਂ ਨੂੰ ਚਲਾਉਂਦੇ ਹਨ।

ਸ਼ਾਸਨ ਅਤੇ ਸੰਰਚਨਾ: ਇੱਕ ਅਸਲੀ ਗੈਰ-ਲਾਭਕਾਰੀ ਨਿਰਧਾਰਿਤ ਸੰਸਥਾ ਤੋਂ capped-profit ਇਕਾਈ ਵੱਲ ਵਾਲਾ ਕਦਮ ਅਤੇ ਜਟਿਲ ਗਵਰਨੈਂਸ ਮਕੈਨਿਜ਼ਮ ਬਣਾਉਣ ਦੀ ਕੋਸ਼ਿਸ਼ ਦਿਖਾਉਂਦੀ ਹੈ ਕਿ ਸ਼ਕਤੀਸ਼ਾਲੀ ਤਕਨੀਕਾਂ ਨੂੰ ਕਿਵੇਂ ਨਿਯੰਤਰਿਤ ਕੀਤਾ ਜਾ ਸਕਦਾ ਹੈ।

ਜਨਤਕ ਪ੍ਰਭਾਵ ਅਤੇ ਨਿਗਰਾਨੀ: ChatGPT ਅਤੇ ਹੋਰ ਰਿਲੀਜ਼ਾਂ ਨਾਲ, OpenAI ਇੱਕ ਐਸੇ ਰਿਸਰਚ ਲੈਬ ਤੋਂ ਹਾਊਸਹੋਲਡ ਨਾਂ ਬਣ ਗਿਆ ਜੋ ਸੁਰੱਖਿਆ, alignment ਅਤੇ ਨਿਯਮਾਂ ਬਾਰੇ ਵਿਆਪਕ ਚਰਚਾ ਦਾ ਕੇਂਦਰੀ ਕੀਤਾ ਗਿਆ।

ਇਹ ਲੇਖ 2015 ਤੋਂ ਆਖਰੀ ਵਿਕਾਸਾਂ ਤਕ OpenAI ਦੀ ਯਾਤਰਾ ਦੀ ਪਾਲਨਾ ਕਰਦਾ ਹੈ, ਦਿਖਾਉਂਦਾ ਹੈ ਕਿ ਹਰ ਪੜਾਅ ਕਿਵੇਂ AI ਰਿਸਰਚ, ਅਰਥਸ਼ਾਸ਼ਤਰ ਅਤੇ ਗਵਰਨੈਂਸ ਵਿੱਚ ਵੱਡੇ ਬਦਲਾਵਾਂ ਦੀ ਪਰਤੀਬਿੰਬ ਹੈ—ਅਤੇ ਇਹ ਭਵਿੱਖ ਲਈ ਕੀ ਮਾਇਨੇ ਰੱਖਦਾ ਹੈ।

OpenAI ਦੀ ਸਥਾਪਨਾ ਦਸੰਬਰ 2015 ਵਿੱਚ ਹੋਈ, ਜਦੋਂ ਮਸ਼ੀਨ ਲਰਨਿੰਗ—ਖ਼ਾਸ ਕਰਕੇ ਡੀਪ ਲਰਨਿੰਗ—ਤੇਜ਼ੀ ਨਾਲ ਸੁਧਾਰ ਰਹੀ ਸੀ ਪਰ ਅਜੇ ਵੀ ਜਨਰਲ ਇੰਟੈਲੀਜੈਂਸ ਤੋਂ ਦੂਰ ਸੀ। ਇਮੇਜ ਰਿਕਗਨੀਸ਼ਨ ਮੈਟਰਿਕਸ ਸੁਧਰ ਰਹੇ ਸਨ, ਸਪੀਚ ਸਿਸਟਮ ਬਿਹਤਰ ਹੋ ਰਹੇ ਸਨ, ਅਤੇ Google, Facebook ਅਤੇ Baidu ਵਰਗੀਆਂ ਕੰਪਨੀਆਂ AI 'ਤੇ ਵੱਡੇ ਪੈਮਾਨੇ 'ਤੇ ਨਿਵੇਸ਼ ਕਰ ਰਹੀਆਂ ਸਨ।

ਕਈ ਰਿਸਰਚਰਾਂ ਅਤੇ ਟੈਕ ਲੀਡਰਾਂ ਵਿੱਚ ਚਿੰਤਾ ਸੀ ਕਿ ਐਡਵਾਨਸਡ AI ਕੁਝ ਸੰਕੁਚਿਤ ਕੰਪਨੀਆਂ ਜਾਂ ਸਰਕਾਰਾਂ ਦੇ ਹੱਥ ਵਿੱਚ ਕੇਂਦ੍ਰਿਤ ਹੋ ਸਕਦੀ ਹੈ। OpenAI ਨੂੰ ਇੱਕ ਸੰਤੁਲਨ ਵਜੋਂ ਸੋਚਿਆ ਗਿਆ: ਇੱਕ ਅਜਿਹਾ ਰਿਸਰਚ ਸੰਗਠਨ ਜੋ ਲੰਬੇ ਸਮੇਂ ਦੀ ਸੁਰੱਖਿਆ ਅਤੇ ਫਾਇਦੇ ਦੀ ਵਿਆਪਕ ਵੰਡ 'ਤੇਕੇਂਦ੍ਰਿਤ ਹੋਵੇ, ਨਾ ਕਿ ਸਿਰਫ਼ ਸੰਗ੍ਰਹਿਤ ਵਪਾਰਕ ਲਾਭ ਤੇ।

ਸ਼ੁਰੂ ਤੋਂ ਹੀ, OpenAI ਨੇ ਆਪਣਾ ਮਿਸ਼ਨ AGI ਦੇ ਪਰਿਭਾਸ਼ਾ ਉੱਤੇ ਰੱਖਿਆ, ਸਿਰਫ਼ ਨਿਯਮਤ ਮਸ਼ੀਨ ਲਰਨਿੰਗ ਉੱਨਤੀ ਨਹੀਂ। ਮੂਲ ਬਿਆਨ ਇਹ ਸੀ ਕਿ OpenAI ਇਹ ਯਕੀਨੀ ਬਣਾਉਣ 'ਤੇ ਕੰਮ ਕਰੇਗਾ ਕਿ AGI, ਜੇ ਬਣੀ, ਤਾਂ "ਸਭ ਮਨੁੱਖਤਾ ਲਈ ਲਾਭਦਾਇਕ" ਹੋਵੇ।

ਇਸ ਮਿਸ਼ਨ ਦੇ ਕੁਝ ਨਿਰਧਾਰਿਤ ਪ੍ਰਭਾਵ ਸਨ:

ਸ਼ੁਰੂਆਤੀ ਬਲੌਗ ਪੋਸਟਾਂ ਅਤੇ ਸੰਸਥਾਪਕ ਚਾਰਟਰ ਨੇ ਖੁੱਲ੍ਹਾਪਣ ਅਤੇ ਸਾਵਧਾਨੀ ਦੋਹਾਂ 'ਤੇ ਜ਼ੋਰ ਦਿੱਤਾ: OpenAI ਆਪਣਾ ਕੰਮ ਬਹੁਤ ਕੁਝ ਪ੍ਰਕਾਸ਼ਿਤ ਕਰੇਗਾ, ਪਰ ਸ਼ਕਤੀਸ਼ਾਲੀ ਸਮਰੱਥਾਵਾਂ ਜਾਰੀ ਕਰਨ ਦੇ ਸਮਾਜਿਕ ਪ੍ਰਭਾਵਾਂ ਬਾਰੇ ਵੀ ਸੋਚੇਗਾ।

OpenAI ਇੱਕ ਗੈਰ-ਲਾਭਕਾਰੀ ਰਿਸਰਚ ਲੈਬ ਵਜੋਂ ਸ਼ੁਰੂ ਹੋਇਆ। ਸ਼ੁਰੂਆਤੀ ਫੰਡਿੰਗ ਦੀਆਂ ਵਚਨਾਂ ਲਗਭਗ $1 ਬਿਲੀਆਨ ਦੇ ਆਸ‑ਪਾਸ ਦਿੱਤੀਆਂ ਗਈਆਂ, ਹਾਲਾਂਕਿ ਇਹ ਤੁਰੰਤ ਨਕਦੀ ਰਾਸ਼ੀ ਦੀ ਥਾਂ ਲੰਬੇ ਸਮੇਂ ਦੀ ਵਚਨਬੱਧੀ ਸੀ। ਮੁੱਖ ਆਰੰਭੀ ਸਹਾਇਕਾਂ ਵਿੱਚ Elon Musk, Sam Altman, Reid Hoffman, Peter Thiel, Jessica Livingston, ਅਤੇ YC Research ਸ਼ਾਮਿਲ ਸਨ, ਨਾਲ ਹੀ Amazon Web Services ਅਤੇ Infosys ਵਰਗੀਆਂ ਕੰਪਨੀਆਂ ਦੀ ਸਹਾਇਤਾ।

ਸ਼ੁਰੂਆਤੀ ਲੀਡਰਸ਼ਿਪ ਟੀਮ ਨੇ ਸਟਾਰਟਅਪ, ਰਿਸਰਚ ਅਤੇ ਆਪਰੇਸ਼ਨ ਦਾ ਮਿਸ਼ਰਣ ਦਿੱਤਾ:

ਇਸ ਮਿਲਾਪ ਨੇ OpenAI ਦੀ ਸ਼ੁਰੂਆਤੀ ਸੰਸਕ੍ਰਿਤੀ ਬਣਾਈ: AI ਦੀਆਂ ਸਰਹੱਦਾਂ ਨੂੰ ਧੱਕਣ ਦੀ ਬਹੁਤ ਵੱਡੀ ਲਾਲਸਾ, ਪਰ ਇੱਕ ਮਿਸ਼ਨ-ਚਲਤ ਗੈਰ-ਲਾਭਕਾਰੀ ਵਜੋਂ ਲੰਬੇ ਸਮੇਂ ਦੇ ਗਲੋਬਲ ਪ੍ਰਭਾਵ ਨੂੰ ਧਿਆਨ ਵਿੱਚ ਰੱਖਦੇ ਹੋਏ।

ਜਦੋਂ OpenAI 2015 'ਚ ਗੈਰ-ਲਾਭਕਾਰੀ ਰਿਸਰਚ ਲੈਬ ਵਜੋਂ ਲਾਂਚ ਹੋਇਆ, ਉਸਦਾ ਜਨਤਕ ਵਚਨ ਸਧਾਰਨ ਪਰ ਮਹੱਤਵਪੂਰਨ ਸੀ: ਜ਼ਿਆਦਾ ਸੰਭਵਤया ਵਸਤਾਂ ਨੂੰ ਸਾਂਝਾ ਕਰਦੇ ਹੋਏ AI ਨੂੰ ਅੱਗੇ ਵਧਾਉਣਾ।

ਸ਼ੁਰੂਆਤੀ ਸਾਲਾਂ ਨੂੰ "ਡਿਫੌਲਟ ਵਜੋਂ ਖੁੱਲ੍ਹਾ" ਫਿਲਸਫ਼ਾ ਨੇ ਪਰਿਭਾਸ਼ਿਤ ਕੀਤਾ। ਰਿਸਰਚ ਪੇਪਰ ਤੇਜ਼ੀ ਨਾਲ ਪੋਸਟ ਕੀਤੇ ਜਾਂਦੇ ਸਨ, ਕੋਡ ਅਕਸਰ ਜਾਰੀ ਹੁੰਦਾ ਸੀ, ਅਤੇ ਅੰਦਰੂਨੀ ਟੂਲਾਂ ਨੂੰ ਜਨਤਕ ਪ੍ਰੋਜੈਕਟਾਂ ਵਿੱਚ ਬਦਲਿਆ ਜਾਂਦਾ ਸੀ। ਵਿਚਾਰ ਇਹ ਸੀ ਕਿ ਵਿਗਿਆਨਕ ਤਰੱਕੀ ਅਤੇ ਨਿਗਰਾਨੀ ਨੂੰ ਤੇਜ਼ ਕਰਨਾ ਇੱਕਲੱਥ ਕੰਪਨੀ ਵਿੱਚ ਸਮਰੱਥਾਵਾਂ ਨੂੰ ਕੇਂਦ੍ਰਿਤ ਕਰਨ ਨਾਲੋਂ ਸੁਰੱਖਿਅਤ ਅਤੇ ਜ਼ਿਆਦਾ ਲਾਭਦਾਇਕ ਤੇਜ਼ੀ ਨਾਲ ਅੱਗੇ ਵਧੇਗੀ।

ਇਸ ਦੇ ਨਾਲ, ਸੁਰੱਖਿਆ ਪਹਿਲਾਂ ਤੋਂ ਹੀ ਚਰਚਾ ਦਾ ਹਿੱਸਾ ਸੀ। ਟੀਮ ਨੇ ਗੱਲ ਕੀਤੀ ਕਿ ਕਦੋਂ ਖੁੱਲ੍ਹਾਪਣ ਦੁਰਵਰਤੋਂ ਦਾ ਖ਼ਤਰਾ ਵਧਾ ਸਕਦਾ ਹੈ ਅਤੇ ਸਟੇਜਡ ਰਿਲੀਜ਼ ਅਤੇ ਨੀਤੀ ਸਮੀਖਿਆਵਾਂ ਲਈ ਖਾਕੇ ਬਣਾਏ, ਹਾਲਾਂਕਿ ਇਹ ਵਿਚਾਰ ਅਗਲੇ ਗਵਰਨੈਂਸ ਪ੍ਰਕਿਰਿਆਵਾਂ ਨਾਲੋਂ ਕਾਫੀ ਅਣਅਨੁਪਾਤਿਕ ਸਨ।

OpenAI ਦੀਆਂ ਪਹਿਲੀਆਂ ਵਿਗਿਆਨਕ ਫੋਕਸ ਖੇਤਰ ਸ਼ਾਮਿਲ ਸਨ:

ਇਹ ਪ੍ਰੋਜੈਕਟ ਮੁਕੱਦਰ ਤੌਰ 'ਤੇ ਪੋਲਿਸ਼ਡ ਉਤਪਾਦਾਂ ਵਾਰੇ ਨਹੀਂ ਸਨ, ਬਲਕਿ ਡੀਪ ਲਰਨਿੰਗ, ਕੰਪਿਊਟ ਅਤੇ ਸਮਝਦਾਰ ਟ੍ਰੇਨਿੰਗ ਰੀਜੀਮਾਂ ਨਾਲ ਕੀ ਸੰਭਵ ਹੈ, ਇਹ ਪਰਖਣ ਲਈ ਸਨ।

ਇਸ ਯੁੱਗ ਦੀਆਂ ਸਭ ਤੋਂ ਪ੍ਰਭਾਵਸ਼ਾਲੀ ਆਉਟਪੁੱਟਾਂ ਵਿੱਚੋਂ ਦੋ ਸਨ OpenAI Gym ਅਤੇ Universe।

ਦੋਨੋ ਪ੍ਰੋਜੈਕਟਾਂ ਨੇ ਗੈਰ-ਪ੍ਰੋਪਰਾਇਟਰੀ ਫਾਇਦੇ ਦੀ ਬਜਾਏ ਸਾਂਝੇ ਇੰਫਰਾਸਟ੍ਰੱਕਚਰ 'ਤੇ ਵਚਨਬੱਧਤਾ ਦਿਖਾਈ।

ਗੈਰ-ਲਾਭਕਾਰੀ ਯੁੱਗ ਦੌਰਾਨ, OpenAI ਨੂੰ ਅਕਸਰ ਇੱਕ ਮਿਸ਼ਨ-ਚਲਤ ਵਵਧਾਰਕ ਵਜੋਂ ਵੇਖਿਆ ਜਾਂਦਾ ਸੀ ਜੋ ਵੱਡੇ ਟੈਕ ਫਰਮਾਂ ਦੇ AI ਲੈਬਾਂ ਦਾ ਵਿਰੋਧੀ ਸੀ। ਪੀਅਰਾਂ ਨੇ ਇਸਦੀ ਰਿਸਰਚ ਗੁਣਵੱਤਾ, ਕੋਡ ਅਤੇ ਮਾਹੌਲਾਂ ਦੀ ਉਪਲਬਧਤਾ ਅਤੇ ਸੁਰੱਖਿਆ ਚਰਚਾਵਾਂ ਵਿੱਚ ਸ਼ਾਮਿਲ ਹੋਣ ਦੀ ਤਿਆਰੀ ਨੂੰ ਮੁਲਿਆੰਕਿਤ ਕੀਤਾ।

ਮੀਡੀਆ ਕਵਰੇਜ ਨੇ ਉੱਘੜੀ ਪ੍ਰੈਕਤਿਸ਼ਨ ਕੀਤੀ—ਉੱਚ-ਪ੍ਰੋਫ਼ਾਈਲ ਫੰਡਰਾਂ, ਗੈਰ-ਵਪਾਰਕ ਸੰਰਚਨਾ ਅਤੇ ਖੁੱਲ੍ਹਾ ਪ੍ਰਕਾਸ਼ਨ ਕਰਨ ਦੇ ਵਾਅਦੇ ਦੀ ਅਨੋਖੀ ਮਿਲਾਪ। ਇਹ ਪ੍ਰਤੀਸ਼ਠਾ—ਇੱਕ ਪ੍ਰਭਾਵਸ਼ਾਲੀ, ਖੁੱਲ੍ਹਾ ਰਿਸਰਚ ਲੈਬ ਜੋ ਲੰਮੇ ਸਮੇਂ ਦੇ ਨਤੀਜਿਆਂ ਦੀ ਚਿੰਤਾ ਕਰਦੀ ਹੈ—ਨੇ ਉਮੀਦਾਂ ਸੈੱਟ ਕੀਤੀਆਂ ਜੋ ਬਾਅਦ ਵਿੱਚ ਸੰਗਠਨ ਦੇ ਹਰ ਰਣਨੀਤਿਕ ਬਦਲਾਅ 'ਤੇ ਪ੍ਰਤੀਕਿਰਿਆਆਂ ਨੂੰ ਰੂਪ ਦਿਉਂਦੀਆਂ ਰਹੀਆਂ।

OpenAI ਦੇ ਇਤਿਹਾਸ ਵਿੱਚ ਮੁੜ-ਮੋੜ ਉਹ ਸੀ ਜਦੋਂ ਇਸਨੇ ਵੱਡੇ transformer-ਅਧਾਰਿਤ ਭਾਸ਼ਾਈ ਮਾਡਲਾਂ 'ਤੇ ਧਿਆਨ ਕੇਂਦ੍ਰਿਤ ਕੀਤਾ। ਇਸ ਬਦਲਾਅ ਨੇ OpenAI ਨੂੰ ਇੱਕ ਮੁੱਖ ਫਾਊਂਡੇਸ਼ਨ ਮਾਡਲ ਪ੍ਰਦਾਤਾ ਵਜੋਂ ਬਦਲ ਦਿੱਤਾ, ਜਿਸ 'ਤੇ ਹੋਰ ਲੋਕ ਆਪਣੇ ਉਤਪਾਦ ਬਣਾਉਂਦੇ ਹਨ।

GPT-1 ਬਾਦ ਵਿੱਚ ਦੇਖੀ ਗਈਆਂ ਚੀਜ਼ਾਂ ਦੇ ਮੁਕਾਬਲੇ ਵਿੱਚ ਨਿੱਜੀ ਸੀ—117 ਮਿਲੀਅਨ ਪੈਰਾਮੀਟਰ, BookCorpus 'ਤੇ ਟ੍ਰੇਨ—ਪਰ ਇਹ ਇੱਕ ਜਰੂਰੀ ਪ੍ਰੂਫ਼ ਆਫ਼ ਕਾਂਸੈਪਟ ਸੀ।

ਇੱਕ ਵੱਖਰਾ ਮਾਡਲ ਹਰ NLP ਟਾਸਕ ਲਈ ਬਣਾਉਣ ਦੀ ਬਜਾਏ, GPT-1 ਨੇ ਦਿਖਾਇਆ ਕਿ ਇੱਕ ਹੀ transformer ਮਾਡਲ, ਸਧਾਰਨ ਉਦੇਸ਼ (ਅਗਲਾ ਸ਼ਬਦ ਅਨੁਮਾਨ ਲਗਾਉਣਾ) ਨਾਲ, ਝਟ-ਸਾ ਪ੍ਰੀ-ਟ੍ਰੇਨਿੰਗ ਅਤੇ ਥੋੜੀ ਫਾਈਨ-ਟਿਊਨਿੰਗ ਨਾਲ ਸਵਾਲ-ਉੱਤਰ, ਸੈਂਟੀਮੈਂਟ ਵਿਸ਼ਲੇਸ਼ਣ ਅਤੇ ਟੈਕਸਟਿਕਲ ਐਨਟੇਲਮੈਂਟ ਵਰਗੇ ਟਾਸਕਾਂ 'ਤੇ ਢਲ ਸਕਦਾ ਹੈ।

OpenAI ਦੀ ਅੰਦਰੂਨੀ ਯੋਜਨਾ ਲਈ, GPT-1 ਨੇ ਤਿੰਨ ਵਿਚਾਰ ਸਾਬਤ ਕੀਤੇ:

GPT-2 ਨੇ ਇਸੇ ਮੁਢਲੇ ਨुसਖੇ ਨੂੰ ਬਹੁਤ ਅੱਗੇ ਧੱਕਿਆ: 1.5 ਬਿਲੀਅਨ ਪੈਰਾਮੀਟਰ ਅਤੇ ਵੱਡੇ ਵੈੱਬ-ਉਤਪੱਤ ਡੇਟਾ ਤੇ ਟ੍ਰੇਨਿੰਗ। ਇਸਦੇ ਆਉਟਪੁੱਟ ਅਕਸਰ ਹੈਰਾਨ ਕਰਨ ਵਾਲੇ ਸਨ: ਕਈ-ਪੈਰਾਗ੍ਰਾਫ ਲੇਖ, ਕਹਾਣੀਆਂ ਅਤੇ ਸੰਖੇਪ ਜੋ ਇਨਸਾਨੀ ਲਿਖਤ ਵਰਗੇ ਲੱਗਦੇ ਸਨ।

ਇਹ ਸਮਰੱਥਾਵਾਂ ਦੁਰਵਰਤੋਂ ਬਾਰੇ ਚਿੰਤਾਵਾਂ ਜਨਮ ਦਿੰਦੀਆਂ ਹਨ: ਆਟੋਮੇਟਿਕ ਪ੍ਰਚਾਰ, ਸਪੈਮ, ਹੈਰਾਸਮੈਂਟ ਅਤੇ ਫੇਕ ਨਿਊਜ਼ ਵੱਡੇ ਪੱਧਰ 'ਤੇ। ਪੂਰੇ ਮਾਡਲ ਨੂੰ ਤੁਰੰਤ ਜਾਰੀ ਕਰਨ ਦੀ ਬਜਾਏ, OpenAI ਨੇ ਇੱਕ ਸਟੇਜਡ ਰਿਲੀਜ਼ ਰਣਨੀਤੀ ਅਪਣਾਈ:

ਇਹ ਉਹ ਪਹਿਲਾ ਵੱਡਾ ਮਿਸਾਲ ਸੀ ਜਿਥੇ OpenAI ਨੇ ਖੁੱਲ੍ਹੀ ਤੌਰ 'ਤੇ ਮੁਕਾਬਲੇ ਅਤੇ ਸੁਰੱਖਿਆ ਨੂੰ ਨਿਰਯਾਤ ਫੈਸਲਿਆਂ ਨਾਲ ਜੋੜਿਆ, ਅਤੇ ਇਸਨੇ ਸੰਗਠਨ ਦੇ disclosure, openness ਅਤੇ ਜ਼ਿੰਮੇਵਾਰੀ ਬਾਰੇ ਸੋਚ ਨੂੰ ਪ੍ਰਭਾਵਿਤ ਕੀਤਾ।

GPT-3 ਨੇ ਮੁੜ ਵਧੇ—ਇਸ ਵਾਰ 175 ਬਿਲੀਅਨ ਪੈਰਾਮੀਟਰ। ਫਾਈਨ-ਟਿਊਨਿੰਗ 'ਤੇ ਨਿਰਭਰ ਕਰਨ ਦੀ ਬਜਾਏ, GPT-3 ਨੇ "few-shot" ਅਤੇ "zero-shot" ਲਰਨਿੰਗ ਦਰਸਾਈ: ਮਾਡਲ ਅਕਸਰ ਸਿਰਫ ਪ੍ਰਾਂਪਟ ਵਿੱਚ ਨਿਰਦੇਸ਼ਾਂ ਅਤੇ ਕੁਝ ਉਦਾਹਰਣਾਂ ਦੇਖ ਕੇ ਨਵਾਂ ਟਾਸਕ ਕਰ ਸਕਦਾ ਸੀ।

ਇਹ ਦਰਜੇ ਦੀ ਜਨਰੈਲਟੀ ਨੇ OpenAI ਅਤੇ ਉਦਯੋਗ ਦੋਹਾਂ ਦੇ ਸੋਚਣ ਦੇ ਢੰਗ ਨੂੰ ਬਦਲ ਦਿੱਤਾ। ਕਈ ਨੈਰਵ ਮਾਡਲ ਬਣਾਉਣ ਦੀ ਬਜਾਏ, ਇੱਕ ਵੱਡਾ ਮਾਡਲ ਬਹੁਪੱਖੀ ਇੰਜਣ ਵਜੋਂ ਕੰਮ ਕਰ ਸਕਦਾ ਸੀ:

ਅਹਮ ਗੱਲ ਇਹ ਸੀ ਕਿ OpenAI ਨੇ GPT-3 ਨੂੰ open-source ਨਾ ਕਰਕੇ commercial API ਰਾਹੀਂ ਪਹੁੰਚ ਦਿੱਤੀ। ਇਸ ਫੈਸਲੇ ਨੇ ਇੱਕ ਰਣਨੀਤਿਕ ਪਲਿਟ ਫੇਰਬਦਲ ਦਰਸਾਇਆ:

GPT-1, GPT-2 ਅਤੇ GPT-3 OpenAI ਦੇ ਇਤਿਹਾਸ ਵਿੱਚ ਇੱਕ ਸਪਸ਼ਟ ਰੁਟ ਦਰਸਾਉਂਦੀਆਂ ਹਨ: transformers ਦੇ ਸਕੇਲ ਕਰਨ, ਉਭਰਦੀਆਂ ਸਮਰੱਥਾਵਾਂ ਦੀ ਖੋਜ, ਸੁਰੱਖਿਆ ਅਤੇ ਦੁਰਵਰਤੋਂ ਨਾਲ ਸੰਘਰਸ਼, ਅਤੇ ChatGPT ਅਤੇ GPT-4 ਵਰਗੇ ਉਤਪਾਦਾਂ ਲਈ ਵਪਾਰਕ ਬੁਨਿਆਦ ਰੱਖਣਾ।

2018 ਤੱਕ, OpenAI ਦੇ ਨੇਤਾਵਾਂ ਨੂੰ ਲੱਗਣ ਲੱਗਾ ਕਿ ਛੋਟੀ ਦਾਨ-ਫੰਡਿੰਗ ਵਾਲੀ ਲੈਬ ਰੂਪ ਰੇਖਾ ਤੇ ਰਹਿ ਕੇ ਬਹੁਤ ਵੱਡੇ AI ਸਿਸਟਮਾਂ ਨੂੰ ਬਣਾਉਣਾ ਅਤੇ ਸੁਰੱਖਿਅਤ ਰੱਖਣਾ ਸੰਭਵ ਨਹੀਂ ਰਹੇਗਾ। ਫਰੰਟੀਅਰ ਮਾਡਲਾਂ ਨੂੰ ਟ੍ਰੇਨ ਕਰਨਾ ਪਹਿਲਾਂ ਹੀ ਦਹਾਂ-ਦਹਾਂ ਲੱਖਾਂ ਡਾਲਰ ਦੀ ਲਾਗਤ ਮੰਗ ਰਿਹਾ ਸੀ, ਅਤੇ ਲਾਗਤ ਦਾ ਰੁਝਾਨ ਭਵਿੱਖ ਵਿੱਚ ਹੋਰ ਉੱਚਾ ਦਿਖਾਈ ਦੇ ਰਿਹਾ ਸੀ। ਟਾਪ ਰਿਸਰਚਰਾਂ ਨੂੰ ਆਕਰਸ਼ਿਤ ਕਰਨ, ਪੈਮਾਨੇ ਵਾਲੇ ਪ੍ਰਯੋਗ ਕਰਨ ਅਤੇ ਲੰਬੇ ਸਮੇਂ ਲਈ ਕੁਲਾਉਡ ਇਨਫਰਾਸਟ੍ਰਕਚਰ ਜ਼ਿੰਦਗੀ ਬਰਕਰਾਰ ਰੱਖਣ ਲਈ, OpenAI ਨੂੰ ਇੱਕ ਐਸੇ ਢਾਂਚੇ ਦੀ ਲੋੜ ਸੀ ਜੋ ਗੰਭੀਰ ਪੂੰਜੀ ਆਕਰਸ਼ਿਤ ਕਰ ਸਕੇ ਪ੍ਰੰਤੂ ਮੂਲ ਮਿਸ਼ਨ ਨਹੀਂ ਛੱਡੇ।

2019 ਵਿੱਚ OpenAI ਨੇ OpenAI LP ਲਾਂਚ ਕੀਤਾ—ਇੱਕ ਨਵਾਂ "capped-profit" ਲਿਮਿਟਡ ਪਾਰਟਨਰਸ਼ਿਪ। ਮਕਸਦ ਸੀ ਵੱਡੇ ਬਾਹਰੀ ਨਿਵੇਸ਼ ਨੂੰ ਖੋਲ੍ਹਣਾ ਜਦੋਂ ਕਿ ਗੈਰ-ਲਾਭਕਾਰੀ ਮਿਸ਼ਨ ਨੂੰ ਫੈਸਲਾ-ਕਰਣ ਦੀ ਸਿਖਰਤਾ ਵਿੱਚ ਰੱਖਣਾ।

ਰਿਵਾਇਤੀ ਵੈਂਚਰ-ਬੈਕਡ ਸਟਾਰਟਅਪ ਅੰਤ ਵਿੱਚ ਅਣਕੈਪਡ ਰਿਟਰਨ ਦੀ ਭਾਲ ਵਿੱਚ ਹੁੰਦੇ ਹਨ। OpenAI ਦੇ ਸੰਸਥਾਪਕਾਂ ਨੂੰ ਚਿੰਤਾ ਸੀ ਕਿ ਇਹ ਦਬਾਅ ਸੁਰੱਖਿਆ, openness ਜਾਂ ਧੀਰੇ-ਧੀਰੇ ਨਿਰਯਾਤ 'ਤੇ ਬਦਲਾਅ ਲਿਆ ਸਕਦਾ ਹੈ। LP ਸੰਰਚਨਾ ਇੱਕ ਸਮਝੌਤਾ ਸੀ: ਇਹ ਇੰਵੈਸਟਮੈਂਟ-ਜਿਹਾ ਹਿੱਸਾ ਜਾਰੀ ਕਰ ਸਕਦੀ ਸੀ ਅਤੇ ਪੈਮਾਨੇ ਤੇ ਪੂੰਜੀ ਉਗਾਹ ਸਕਦੀ ਸੀ, ਪਰ ਕਈ ਨਿਯਮਾਂ ਦੇ ਤਹਿਤ।

capped-profit ਮਾਡਲ ਵਿੱਚ, ਨਿਵੇਸ਼ਕਾਂ ਅਤੇ ਕਰਮਚਾਰੀਆਂ ਨੂੰ ਉਹਨਾਂ ਦੀਆਂ ਹਿਸਸਿਆਂ 'ਤੇ ਰਿਟਰਨ ਮਿਲ ਸਕਦੇ ਹਨ, ਪਰ ਇਹ ਰਿਟਰਨ ਉਨ੍ਹਾਂ ਦੀ ਮੁਲ ਨੂੰ ਇੱਕ ਨਿਰਧਾਰਿਤ ਗੁਣਾ ਤੱਕ ਹੀ ਸੀਮਤ ਰਹਿੰਦੀ ਹੈ (ਸ਼ੁਰੂਆਤੀ ਨਿਵੇਸ਼ਕਾਂ ਲਈ ਅਕਸਰ 100x ਤੱਕ ਦਾ ਜ਼ਿਕਰ ਕੀਤਾ ਗਿਆ, ਬਾਅਦ ਵਾਲੇ ਚਰਨਾਂ ਵਿੱਚ ਘੱਟ ਕੈਪ)। ਉਸ ਕੈਪ ਤੱਕ ਪਹੁੰਚਣ ਮਗਰੋਂ ਬਾਅਦ, ਹੋਰ ਕੀਮਤ ਗੈਰ-ਲਾਭਕਾਰੀ ਮਾਤਾ ਕੋਠੀ ਨੂੰ ਜਾਵੇਗੀ ਅਤੇ ਉਸਨੂੰ ਮਿਸ਼ਨ ਦੇ ਅਨੁਸਾਰ ਵਰਤਿਆ ਜਾਣਾ ਚਾਹੀਦਾ ਹੈ।

ਇਹ ਪੰਪਾ-ਸਟਾਰਟਅਪ ਮਾਡਲ ਨਾਲ ਬੜੀ ਤਰ੍ਹਾਂ ਬੇੋਇੰਤਕ ਹੈ, ਜਿਥੇ ਇਕੱਤਰ ਕੀਤੀ ਕੀਮਤ ਅਨੰਤ ਤਕ ਵੱਧ ਸਕਦੀ ਹੈ ਅਤੇ ਸ਼ੇਅਰਹੋਲਡਰ ਮੂਲ ਲਕੜੀ ਹੁੰਦੇ ਹਨ।

OpenAI Nonprofit ਇਸ ਗੱਲ ਨੂੰ ਕੰਟਰੋਲ ਕਰਨ ਵਾਲੀ ਇਕਾਈ ਰਹਿੰਦੀ ਹੈ। ਉਸਦਾ ਬੋਰਡ OpenAI LP ਦੀ ਨਿਗਰਾਨੀ ਕਰਦਾ ਹੈ ਅਤੇ ਇਸਨੂੰ ਇਹ ਯਕੀਨੀ ਬਣਾਉਣ ਲਈ ਚਾਰਟਰ ਕੀਤਾ ਗਿਆ ਹੈ ਕਿ ਫੈਸਲੇ ਮਨੁੱਖਤਾ ਦੇ ਹਿੱਤਾਂ ਨੂੰ ਕਿਸੇ ਖਾਸ ਗਰੁੱਪ ਦੇ ਹਿਤਾਂ ਉੱਤੇ ਪ੍ਰਾਥਮਿਕਤਾ ਨਹੀਂ ਦੇਂਦੇ।

ਆਧਿਕਾਰਕ ਤੌਰ 'ਤੇ:

ਇਹ ਗਵਰਨੈਂਸ ਡਿਜ਼ਾਈਨ OpenAI ਨੂੰ ਵਪਾਰਿਕ ਸੰਗਠਨ ਵਰਗੇ ਫੰਡਰ ਅਤੇ ਭਰਤੀ ਲਚੀਲਾਪਨ ਦੇਣ ਲਈ ਡਿਜ਼ਾਈਨ ਕੀਤਾ ਗਿਆ ਸੀ, ਪਰ ਮਿਸ਼ਨ-ਫਰਸਟ ਕੰਟਰੋਲ ਨੂੰ ਬਰਕਰਾਰ ਰੱਖਦਾ ਹੈ।

ਰਿਸਟਰਕਚਰ ਨੇ ਅੰਦਰੂਨੀ ਅਤੇ ਬਾਹਰੀ ਤਰ੍ਹਾਂ ਚਰਚਾਵਾਂ ਜਨਮ ਦਿੱਤੀਆਂ। ਸਮਰਥਕ ਕਹਿੰਦੇ ਸਨ ਕਿ ਇਹ ਇੱਕਮਾਤਰ ਵਿਹਾਰਕ ਤਰੀਕਾ ਸੀ ਜੋ cutting-edge AI ਰਿਸਰਚ ਲਈ ਲਾਜ਼ਮੀ ਬਿਲੀਆਂ ਪ੍ਰਾਪਤ ਕਰਨ ਅਤੇ ਫਿਰ ਵੀ ਲਾਭ-ਪ੍ਰੇਰਣਾ ਨੂੰ ਸੀਮਿਤ ਕਰਨ ਲਈ। ਆਲੋਚਕ ਪੁੱਛਦੇ ਰਹੇ ਕਿ ਕੋਈ ਵੀ ਢਾਂਚਾ ਜੋ ਵੱਡੇ ਰਿਟਰਨ ਵੀਨਦੀ ਹੈ, ਕੀ ਉਹ ਵਾਸਤਵ ਵਿੱਚ ਵਪਾਰਕ ਦਬਾਅ ਤੋਂ ਬਚ ਸਕਦਾ ਹੈ, ਅਤੇ ਕੀ caps ਕਾਫੀ ਘੱਟ ਹਨ ਜਾਂ ਸਖ਼ਤੀ ਨਾਲ ਲਾਗੂ ਕੀਤੇ ਜਾਣਗੇ।

ਵਾਸਤਵ ਵਿੱਚ, OpenAI LP ਨੇ Microsoft ਵਰਗੀਆਂ ਵੱਡੀਆਂ ਰਣਨੀਤਿਕ ਨਿਵੇਸ਼ਾਂ ਲਈ ਰਸਤਾ ਖੋਲ੍ਹਿਆ, ਅਤੇ ਸੰਗਠਨ ਨੂੰ ਮੁਕਾਬਲੇਯੋਗ ਮੁਆਵਜ਼ਾ ਪੈਕੇਜ ਦੇ ਕੇ ਰਿਸਰਚ ਟੀਮਾਂ ਨੂੰ ਵਧਾਉਣ ਦੀ ਸਮਰੱਥਾ ਦਿੱਤੀ। ਇਸ ਨਾਲ GPT-3 ਅਤੇ GPT-4 ਵਰਗੇ ਮਾਡਲਾਂ ਲਈ ਟ੍ਰੇਨਿੰਗ ਰਨਾਂ ਦੇ ਪੈਮਾਨੇ ਵਧੇ ਅਤੇ ChatGPT ਜਿਹੇ ਸਿਸਟਮਾਂ ਨੂੰ ਵਿਸ਼ਵ ਪੱਧਰ 'ਤੇ ਡਿਪਲੋਇ ਕਰਨ ਲਈ ਇਨਫਰਾਸਟ੍ਰਕਚਰ ਬਣਾਉਣਾ ਸੰਭਵ ਹੋਇਆ—ਸਾਰੇ ਇਹ ਫਿਰ ਵੀ ਗੈਰ-ਲਾਭਕਾਰੀ ਮੁਲਾਂਕਣ ਨਾਲ ਬੈਕਡ ਹੁੰਦੇ ਹਨ।

2019 ਵਿੱਚ OpenAI ਅਤੇ Microsoft ਨੇ ਇੱਕ ਬਹੁ ਸਾਲਾਂ ਦੀ ਭਾਈਚਾਰਾ ਦੀ ਘੋਣਾ ਕੀਤੀ ਜਿਸ ਨੇ ਦੋਹਾਂ ਕੰਪਨੀਆਂ ਦੀ ਏਆਈ ਭੂਮਿਕਾ ਨੂੰ ਰੂਪ ਦਿੱਤਾ। Microsoft ਨੇ ਲੱਗਭਗ $1 ਬਿਲੀਅਨ ਦੀ ਰਿਪੋਰਟ ਕੀਤੀ ਨਿਵੇਸ਼ ਦਿੱਤੀ, ਜਿਸ ਵਿੱਚ ਨਕਦੀ ਅਤੇ Azure cloud credits ਸ਼ਾਮਿਲ ਸਨ, ਅਤੇ ਇਸਦੇ ਬਦਲੇ Microsoft ਨੂੰ OpenAI ਦਾ preferred commercial partner ਬਣਾਇਆ ਗਿਆ।

ਇਹ ਸੌਦਾ OpenAI ਦੀ ਕੋਸ਼ਿਸ਼ ਲਈ ਵਿਸ਼ਾਲ ਕੋਮਪਿਊਟ ਸੰਸਾਧਨਾਂ ਦੀ ਲੋੜ ਨੂੰ ਪੂਰਾ ਕਰਨ ਦੇ ਨਾਲ Microsoft ਨੂੰ cutting‑edge AI ਦੇ ਉਹ ਸਮਰੱਥਾ ਲੈਣ ਦੀ ਆਸਥਾ ਦਿੱਤੀ ਜੋ ਉਸਦੇ ਉਤਪਾਦਾਂ ਅਤੇ ਕਲਾਉਡ ਪਲੇਟਫਾਰਮ ਨੂੰ ਵੱਖਰਾ ਕਰ ਸਕਦੀ ਸੀ। ਆਉਣਾ ਦੇ ਸਾਲਾਂ ਵਿੱਚ ਇਹ ਰਿਸ਼ਤਾ ਹੋਰ ਵੀ ਗਹਿਰਾ ਹੋਇਆ।

OpenAI ਨੇ Microsoft Azure ਨੂੰ ਆਪਣਾ ਪ੍ਰਾਇਮਰੀ ਕਲਾਉਡ ਪਲੇਟਫਾਰਮ ਚੁਣਿਆ ਕਈ ਕਾਰਨਾਂ ਕਰਕੇ:

ਇਸ ਨਾਲ Azure GPT‑3, Codex ਅਤੇ ਬਾਅਦ ਵਿੱਚ GPT‑4 ਵਰਗੇ ਮਾਡਲਾਂ ਦੀ ਟ੍ਰੇਨਿੰਗ ਅਤੇ ਸੇਵਾ ਲਈ ਡਿਫੌਲਟ ਵਾਤਾਵਰਣ ਬਣ ਗਿਆ।

ਭਾਈਚਾਰੇ ਨੇ OpenAI ਦੇ ਵਰਕਲੋਡ ਲਈ Azure 'ਤੇ ਦੁਨੀਆਂ ਦੇ ਸਭ ਤੋਂ ਵੱਡੇ AI ਸੁਪਰਕੰਪਿYouਟਿੰਗ ਸਿਸਟਮਾਂ ਵਿੱਚੋਂ ਇੱਕ ਬਣਵਾਇਆ। Microsoft ਨੇ ਇਨ੍ਹਾਂ ਕਲੱਸਟਰਾਂ ਨੂੰ ਆਪਣੇ AI ਸਮਰੱਥਾਵਾਂ ਦੇ ਪ੍ਰਤੀਕ ਵਜੋਂ ਉਭਾਰਿਆ, ਜਦਕਿ OpenAI ਨੇ ਉਨ੍ਹਾਂ ਦਾ ਆਧਾਰ ਬਣਾ ਕੇ ਮਾਡਲ ਆਕਾਰ, ਟ੍ਰੇਨਿੰਗ ਡੇਟਾ ਅਤੇ ਪ੍ਰਯੋਗ ਦਰ ਤੇਜ਼ੀ ਨਾਲ ਅਗੇ ਵਧਾਉਣ ਲਈ ਉਪਯੋਗ ਕੀਤਾ।

ਇਹ ਸਾਂਝੀ ఇంట੍ਰాҫਟਰਕਚਰ ਉਨ੍ਹਾਂ ਦੇ ਗਾਹਕ-ਭਾਈਚਾਰੇ ਮੱਧ ਰੇਖਾ ਨੂੰ ਮਿਟਾਉਂਦਾ: OpenAI ਨੇ ਅਸਲ ਵਿੱਚ Azure ਦੇ AI ਰੋਡਮੈਪ ਨੂੰ ਪ੍ਰਭਾਵਿਤ ਕੀਤਾ, ਅਤੇ Azure ਨੂੰ OpenAI ਦੀਆਂ ਜ਼ਰੂਰਤਾਂ ਲਈ ਟਿਊਨ ਕੀਤਾ ਗਿਆ।

Microsoft ਨੂੰ ਕੁਝ OpenAI ਤਕਨੀਕਾਂ 'ਤੇ ਵਿਸ਼ੇਸ਼ ਲਾਇਸੈਂਸਿੰਗ ਅਧਿਕਾਰ ਮਿਲੇ, ਖ਼ਾਸ ਕਰਕੇ GPT‑3 ਜਿਹੇ ਮਾਡਲਾਂ ਲਈ। ਇਸ ਨਾਲ Microsoft ਨੂੰ OpenAI ਮਾਡਲਾਂ ਨੂੰ ਆਪਣੀਆਂ ਉਤਪਾਦ ਰੇਖਾ—Bing, Office, GitHub Copilot, Azure OpenAI Service—ਵਿੱਚ ਸ਼ਾਮਿਲ ਕਰਨ ਦਾ ਮੌਕਾ ਮਿਲਿਆ, ਜਦਕਿ ਹੋਰ ਕੰਪਨੀਆਂ ਉਨ੍ਹਾਂ ਨੂੰ OpenAI ਦੀ ਆਪਣੀ API ਰਾਹੀਂ ਪ੍ਰਾਪਤ ਕਰਦੀਆਂ ਹਨ।

ਇਹ ਵਿਸ਼ੇਸ਼ਤਾ ਵਿਚਾਰ-ਚਰਚਾ ਨੂੰ ਤੇਜ਼ ਕਰਦੀ ਹੈ: ਸਮਰਥਕ ਕਹਿੰਦੇ ਹਨ ਕਿ ਇਸ ਨਾਲ ਵੱਧ ਪੈਮਾਨੇ 'ਤੇ ਸੁਰੱਖਿਅਤ ਤੌਰ 'ਤੇ AI ਫੈਲਾਉਣ ਲਈ ਫੰਡ ਅਤੇ ਵੰਡ ਮਿਲੀ; ਆਲੋਚਕ ਚਿੰਤਾ ਕਰਦੇ ਹਨ ਕਿ ਇਸ ਨਾਲ frontier ਮਾਡਲਾਂ ਤੇ ਇੱਕ ਮੁੱਖ ਟੈਕ ਕੰਪਨੀ ਦੀ ਪ੍ਰਭਾਵਸ਼ੀਲਤਾ ਕੇਂਦ੍ਰਿਤ ਹੋ ਸਕਦੀ ਹੈ।

ਇਸ ਦੇ ਨਾਲ-ਨਾਲ, ਭਾਈਚਾਰੇ ਨੇ OpenAI ਨੂੰ ਮੈਨਸਟਰੀਮ ਵਿਜ਼ੀਬਿਲਟੀ ਦਿੱਤੀ। Microsoft ਦੇ ਬ੍ਰਾਂਡਿੰਗ, ਉਤਪਾਦ ਇਕਤੀकरण ਅਤੇ ਐਂਟਰਪਰਾਈਜ਼ ਸੇਲ ਚੈਨਲਾਂ ਨੇ OpenAI ਸਿਸਟਮਾਂ ਨੂੰ ਰਿਸਰਚ ਡੈਮੋ ਤੋਂ ਰੋਜ਼ਮਰਾ ਦੇ ਟੂਲਾਂ ਵਿੱਚ ਬਦਲਣ ਵਿੱਚ ਮਦਦ ਕੀਤੀ, ਜਿਸ ਨਾਲ OpenAI ਨੂੰ ਇਕ ਸੁਤੰਤਰ ਰਿਸਰਚ ਲੈਬ ਅਤੇ ਇੱਕ ਕੇਂਦਰੀ Microsoft AI ਭਾਈਚਾਰੇ ਦੋਹਾਂ ਵਜੋਂ ਵੇਖਿਆ ਗਿਆ।

ਜਿਵੇਂ‑ਜਿਵੇਂ OpenAI ਦੇ ਮਾਡਲਾਂ ਭਾਸ਼ਾ ਨੂੰ ਸਮਝਣ ਅਤੇ ਰਚਨ ਕਰਨ ਵਿੱਚ ਵਧੇਰੇ ਕੁਸ਼ਲ ਹੋਏ, ਟੀਮ ਨੇ ਨਵੇਂ ਮੋਡਾਲਿਟੀ ਨੂੰ ਧੱਕਿਆ: ਚਿੱਤਰ ਅਤੇ ਕੋਡ। ਇਸ ਬਦਲਾਅ ਨਾਲ OpenAI ਦਾ ਕੰਮ ਲਿਖਤ ਅਤੇ ਗੱਲਬਾਤ ਤੋਂ ਦ੍ਰਿਸ਼, ਰਚਨਾਤਮਕਤਾ ਅਤੇ ਸੋਫਟਵੇਅਰ ਵਿਕਾਸ ਤੱਕ ਫੈਲ ਗਿਆ।

CLIP (Contrastive Language–Image Pretraining), ਜੋ 2021 ਦੀ ਸ਼ੁਰੂਆਤ ਵਿੱਚ ਐਲਾਨ ਕੀਤਾ ਗਿਆ, ਮਾਡਲਾਂ ਨੂੰ ਆਪਣੇ ਵਰਗੇ ਇਨਸਾਨੀ ਤਰੀਕੇ ਨਾਲ ਦੁਨੀਆ ਨੂੰ ਸਮਝਣ ਵੱਲ ਇੱਕ ਵੱਡਾ ਕਦਮ ਸੀ।

ਇਸ ਦੇ ਬਦਲੇ ਵਿੱਚ, CLIP ਨੇ ਸੈਂਕੜਿਆਂ ਮਿਲੀਅਨ ਇਮੇਜ–ਕੈਪਸ਼ਨ ਜੋੜਿਆਂ ਤੋਂ ਸਿੱਖਿਆ ਜੋ ਪਬਲਿਕ ਵੈਬ ਤੋਂ(scraped) ਲਈ ਗਈਆਂ। ਇਹਨਾਂ ਨੂੰ ਸਿੱਖਣ ਲਈ ਇਹਨਾਂ ਮਾਡਲਾਂ ਨੂੰ ਇਕ-ਦੂਜੇ ਨਾਲ ਮਿਲਾਉਣ ਅਤੇ ਗਲਤ ਵਰਣਨਾਂ ਤੋਂ ਵੱਖਰਾ ਕਰਨ ਲਈ ਟ੍ਰੇਨ ਕੀਤਾ ਗਿਆ।

ਇਸ ਨਾਲ CLIP ਅਣਜਾਣ ਟਾਸਕਾਂ 'ਤੇ ਵੀ ਅਚਾਨਕ ਸਮਰੱਥਾਵਾਂ ਮਿਲੀਆਂ:

CLIP ਬਾਅਦ ਵਿੱਚ ਜਨਰੇਟਿਵ ਇਮੀਜ ਵਰਕ ਲਈ ਇੱਕ ਫਾਊਂਡੇਸ਼ਨ ਬਣ ਗਿਆ।

DALL·E (2021) ਨੇ GPT-ਸ਼ੈਲੀ ਆਰਕੀਟੈਕਚਰਾਂ ਨੂੰ ਚਿੱਤਰਾਂ 'ਤੇ ਲਾਗੂ ਕੀਤਾ, ਟੈਕਸਟ ਪ੍ਰਾਂਪਟਾਂ ਤੋਂ ਸਿੱਧੇ ਤੌਰ 'ਤੇ ਤਸਵੀਰਾਂ ਬਣਾਈਆਂ: "an armchair in the shape of an avocado" ਜਾਂ "a storefront sign that says 'openai'"। ਇਸਨੇ ਦਿਖਾਇਆ ਕਿ ਭਾਸ਼ਾ ਮਾਡਲਾਂ ਨੂੰ ਸੁਤੰਤਰ ਤੌਰ 'ਤੇ ਸਮਰੱਥ ਤਸਵੀਰਾਂ ਬਣਾਉਣ ਲਈ ਵਿਆਪਕ ਕੀਤਾ ਜਾ ਸਕਦਾ ਹੈ।

DALL·E 2 (2022) ਨੇ ਰੈਜ਼ੋਲੂਸ਼ਨ, ਵਾਸਤਵਿਕਤਾ ਅਤੇ ਨਿਯੰਤਰਣ ਵਿੱਚ ਮਹੱਤਵਪੂਰਨ ਸੁਧਾਰ ਕੀਤੇ। ਇਸਨੇ ਇਹ ਫੀਚਰ ਪੇਸ਼ ਕੀਤੇ:

ਇਹ ਸਿਸਟਮ ਡਿਜ਼ਾਈਨਰਾਂ, ਮਾਰਕੀਟਰਾਂ, ਕਲਾਕਾਰਾਂ ਅਤੇ ਸ਼ੌਕੀਨਾਂ ਲਈ ਵਿਚਾਰ ਪ੍ਰੋਟੋਟਾਈਪ ਕਰਨ ਦੇ ਢੰਗ ਨੂੰ ਬਦਲਕੇ ਕਈ ਰਚਨਾਤਮਕ ਕੰਮਾਂ ਨੂੰ ਪ੍ਰਾਂਪਟ-ਆਧਾਰਿਤ ਨਿਰਮਾਣ ਦਿਸ਼ਾ ਵੱਲ ਖੀਚ ਲਏ।

Codex (2021) ਨੇ GPT-3 ਪਰਿਵਾਰ ਨੂੰ ਸੋਦ-ਕੋਡ ਲਈ ਅਨੁਕੂਲ ਕੀਤਾ, ਅਤੇ ਵੱਡੇ ਪਬਲਿਕ ਕੋਡਬੇਸਾਂ 'ਤੇ ਟ੍ਰੇਨ ਕੀਤਾ ਗਿਆ। ਇਸ ਨੇ Python, JavaScript ਅਤੇ ਹੋਰ ਭਾਸ਼ਾਵਾਂ ਲਈ ਕੁਦਰਤੀ-ਭਾਸ਼ਾ ਨੂੰ ਕੰਮ ਕਰਦੇ ਕੋਡ ਸਨਿੱਪਟਸ ਵਿੱਚ ਤਬਦੀਲ ਕਰਨ ਦੀ ਸਮਰੱਥਾ ਦਿਖਾਈ।

GitHub Copilot, ਜੋ Codex 'ਤੇ ਬਣਿਆ, ਨੇ ਇਸਨੂੰ ਦੈਨੰਦਿਨ ਵਿਕਾਸ ਟੂਲਾਂ ਵਿੱਚ ਲਿਆਇਆ। ਪ੍ਰੋਗ੍ਰਾਮਰਾਂ ਨੂੰ ਪੂਰੀਆਂ ਫੰਕਸ਼ਨਾਂ, ਟੈਸਟ ਅਤੇ ਬੂਆਇਲਰਪਲੇਟ ਸੁਝਾਵਾਂ ਮਿਲਣ ਲੱਗੇ, ਅਤੇ ਕੁਦਰਤੀ-ਭਾਸ਼ਾ ਹਦਾਇਤਾਂ ਨਾਲ ਕੰਮ ਕਰਨ ਦੇ ਤਰੀਕੇ ਬਦਲੇ।

ਸੋਫਟਵੇਅਰ ਵਿਕਾਸ ਲਈ, Codex ਇੱਕ постепенный ਬਦਲਾਅ ਦਿਖਾਉਂਦਾ ਹੈ:

CLIP, DALL·E ਅਤੇ Codex ਨੇ ਦਰਸਾਇਆ ਕਿ OpenAI ਦਾ ਢੰਗ ਟੈਕਸਟ ਤੋਂ ਆਗੇ ਵਿਜ਼ਨ ਅਤੇ ਕੋਡ ਤੱਕ ਫੈਲ ਸਕਦਾ ਹੈ, ਜਿਸ ਨਾਲ ਉਸਦੀ ਰਿਸਰਚ ਕਲਾ, ਡਿਜ਼ਾਈਨ ਅਤੇ ਇੰਜੀਨੀਅਰਿੰਗ 'ਤੇ ਪ੍ਰਭਾਵ ਵਧ ਗਿਆ।

OpenAI ਨੇ ChatGPT ਨੂੰ 30 ਨਵੰਬਰ 2022 ਨੂੰ ਇੱਕ ਮੁਫਤ "ਰੀਸਰਚ ਪ੍ਰੀਵਿਊ" ਵਜੋਂ ਲਾਂਚ ਕੀਤਾ, ਇੱਕ ਛੋਟੀ ਬਲੌਗ ਪੋਸਟ ਅਤੇ ਟਵੀਟ ਰਾਹੀਂ। ਇਹ ਮਾਡਲ GPT‑3.5 'ਤੇ ਆਧਾਰਿਤ ਸੀ ਅਤੇ ਗੱਲਬਾਤ ਲਈ optimized ਸੀ, ਜਿਸ ਵਿੱਚ ਕੁਝ ਹਾਨਿਕਾਰਕ ਜਾਂ ਅਸੁਰੱਖਿਅਤ ਬੇਨਤੀਆਂ ਨੂੰ ਠੁੱਕਣ ਲਈ ਗਾਰਡਰੇਲ ਵੀ ਸਨ।

ਉਪਯੋਗਤਾ ਲੱਗਾਤਾਰ ਵਧੀ। ਮਿਲੀਅਨ ਲੋਕ ਕੁੱਝ ਦਿਨਾਂ ਵਿੱਚ ਸਾਈਨਅਪ ਹੋ ਗਏ, ਅਤੇ ChatGPT ਏਕ ਸਭ ਤੋਂ ਤੇਜ਼ ਵਿਕਸਿਤ ਉਪਭੋਗਤਾ ਐਪਲੀਕੇਸ਼ਨਾਂ ਵਿੱਚੋਂ ਇੱਕ ਬਣ ਗਿਆ। ਗੱਲਬਾਤਾਂ ਦੀਆਂ ਸਕ੍ਰੀਨਸ਼ਾਟਾਂ ਸੋਸ਼ਲ ਮੀਡੀਆ 'ਤੇ ਵਿਆਪਕ ਹੋ ਗਈਆਂ—ਲੋਕਾਂ ਨੇ ਇਸ ਦੀ ਸਮਰੱਥਾ ਟੈਸਟ ਕੀਤੀ ਕਿ ਇਹ ਨਿਬੰਧ ਲਿਖ ਸਕਦਾ, ਕੋਡ ਨੂੰ ਡਿਬੱਗ ਕਰ ਸਕਦਾ, ਈਮੇਲ ਡਾਰਾਫਟ ਕਰ ਸਕਦਾ ਅਤੇ ਮੁਸ਼ਕਲ ਵਿਸ਼ਿਆਂ ਨੂੰ ਸਧਾਰਨ ਭਾਸ਼ਾ ਵਿੱਚ ਸਮਝਾ ਸਕਦਾ ਹੈ।

ChatGPT ਦੀ ਖਿੱਚ ਇਸਦੀ ਬਹੁਪੱਖੀਤਾ ਵਿੱਚ ਸੀ, ਨਾ ਕਿ ਕਿਸੇ ਇੱਕ ਵੱਖਰੇ ਉਪਯੋਗ ਵਿੱਚ।

ਸਿੱਖਿਆ ਵਿੱਚ, ਵਿਦਿਆਰਥੀ ਇਸਦਾ ਇਸਤੇਮਾਲ ਪਾਠਾਂ ਦਾ ਸੰਖੇਪ ਬਣਾਉਣ, ਅਭਿਆਸ ਪ੍ਰਸ਼ਨਾਂ ਤਿਆਰ ਕਰਨ, ਲੇਖਾਂ ਦਾ ਅਨੁਵਾਦ ਜਾਂ ਸਰਲ ਕਰਨ ਅਤੇ ਗਣਿਤ ਜਾਂ ਵਿਗਿਆਨ ਸਮੱਸਿਆਵਾਂ ਦੇ ਕਦਮ-ਬ-ਕਦਮ ਸਮਾਧਾਨ ਲੈਣ ਲਈ ਕਰਦੇ ਹਨ। ਅਧਿਆਪਕ ਸਿਲੇਬਸ ਡਿਜ਼ਾਈਨ, ਰੂਬ੍ਰਿਕ ਬਣਾਉਣ ਅਤੇ ਵੱਖ-ਵੱਖ-ਸਿੱਖਣ ਸਮੱਗਰੀ ਤਿਆਰ ਕਰਨ ਲਈ ਇਸਦੀ ਪਰਖ ਕਰ ਰਹੇ ਹਨ, ਹਾਲਾਂਕਿ ਸਕੂਲ ਇਹ ਫੈਸਲਾ ਕਰਨ ਦੀ ਚਰਚਾ ਕਰ ਰਹੇ ਹਨ ਕਿ ਇਸ ਨੂੰ ਕਿੱਥੇ ਅਤੇ ਕਿਵੇਂ ਆਗਿਆ ਦਿਓ।

ਕੰਮ 'ਤੇ, ਪੇਸ਼ੇਵਰ ChatGPT ਨੂੰ ਈਮੇਲ, ਮਾਰਕੀਟਿੰਗ ਕਾਪੀ ਅਤੇ ਰਿਪੋਰਟਾਂ ਦਾ ਡਰਾਫਟ ਬਣਾਉਣ, ਪ੍ਰਜ਼ੇੰਟੇਸ਼ਨ ਦੇ ਖਾਕੇ ਤਿਆਰ ਕਰਨ, ਕੋਡ ਸਨਿੱਪਟਸ ਜਨਰੇਟ ਕਰਨ ਅਤੇ ਪ੍ਰੋਡਕਟ ਵਿਚਾਰ-ਚਾਰਚਾ ਵਿਚ ਸਹਾਇਕ ਵਜੋਂ ਵਰਤਦੇ ਹਨ। ਫ੍ਰੀਲਾਂਸਰਾਂ ਅਤੇ ਛੋਟੇ ਕਾਰੋਬਾਰਾਂ ਨੇ ਇਸਨੂੰ ਲੋ-ਕੌਸਟ ਸਹਾਇਕ ਦੇ ਤੌਰ ਤੇ ਵਰਤਿਆ।

ਰੋਜ਼ਮਰਾ ਦੀ ਸਮੱਸਿਆ-ਹੱਲ ਵਿੱਚ, ਲੋਕ ਯਾਤਰਾ ਯੋਜਨਾਵਾਂ, ਫ੍ਰਿਜ਼ ਵਿੱਚ ਮੌਜੂਦ ਚੀਜ਼ਾਂ ਤੋਂ ਖਾਣੇ ਬਣਾਉਣ ਲਈ ਵਿਚਾਰ, ਬੁਨਿਆਦੀ ਕਾਨੂੰਨੀ ਅਤੇ ਸਿਹਤ-ਸੰਬੰਧੀ ਵਿਆਖਿਆਵਾਂ (ਅਕਸਰ ਪੇਸ਼ੇਵਰ ਸਲਾਹ ਮੰਗਣ ਦੀ ਸਲਾਹ ਸਮੇਤ) ਅਤੇ ਨਵੀਂ ਭਾਸ਼ਾ ਜਾਂ ਹੁਨਰ ਸਿੱਖਣ ਵਿੱਚ ਮਦਦ ਲਈ ChatGPT ਰੁੱਖਦੇ ਹਨ।

ਆਰੰਭਿਕ ਰੀਸਰਚ ਪ੍ਰੀਵਿਊ ਮੁਫ਼ਤ ਸੀ ਤਾਂ ਕਿ ਫਲੌਜ਼, ਦੁਰਵਰਤੋਂ ਅਤੇ ਗੁੰਮ ਹੋਈਆਂ ਸਮਰੱਥਾਵਾਂ 'ਤੇ ਫੀਡਬੈਕ ਇਕੱਠਾ ਕੀਤਾ ਜਾ ਸਕੇ। ਵਰਤੋਂ ਵਧਣ ਨਾਲ OpenAI ਨੂੰ ਉੱਚ ਇਨਫਰਾਸਟ੍ਰਕਚਰ ਲਾਗਤਾਂ ਦਾ ਸਾਹਮਣਾ ਕਰਨਾ ਪਿਆ ਅਤੇ ਉਪਭੋਗਤਾ ਭਰੋਸੇ ਲਈ ਵਿਸ਼ਵਾਸਯੋਗ ਪਹੁੰਚ ਦੀ ਮੰਗ ਹੋਈ।

ਫਰਵਰੀ 2023 ਵਿੱਚ, OpenAI ਨੇ ChatGPT Plus ਪ੍ਰਾਰੇਸ਼ ਲਾਂਚ ਕੀਤਾ—ਇੱਕ ਸਬਸਕ੍ਰਿਪਸ਼ਨ ਜੋ ਤੇਜ਼ ਜਵਾਬ, ਪੀਕ ਸਮਿਆਂ 'ਤੇ ਪ੍ਰਾਥਮਿਕਤਾ ਅਤੇ GPT‑4 ਵਰਗੇ ਨਵੇਂ ਮਾਡਲਾਂ ਅਤੇ ਫੀਚਰਾਂ ਲਈ ਐਰਲੀ ਐਕਸੈੱਸ ਦਿੰਦਾ ਹੈ। ਇਸ ਨਾਲ ਇੱਕ ਰਿਕਰਿੰਗ ਰੈਵਨਿਊ ਸਟਰੀਮ ਬਣੀ ਰਹੀ, ਫਿਰ ਵੀ ਇੱਕ ਮੁਫ਼ਤ ਟੀਅਰ ਜਨਤਕ ਪਹੁੰਚ ਲਈ ਬਣਾਈ ਰੱਖੀ।

ਵਕਤ ਦੇ ਨਾਲ, OpenAI ਨੇ ਕਾਰੋਬਾਰੀ-ਕੇਂਦਰਤ ਵਿਕਲਪ ਵੀ ਸ਼ਾਮਿਲ ਕੀਤੇ: ਇਕੋ ਸੰਵਾਦੀ ਮਾਡਲਾਂ ਲਈ API ਪਹੁੰਚ, ਉਤਪਾਦ ਅਤੇ ਵਰਕਫਲੋਜ਼ ਵਿੱਚ ਇੰਟੇਗਰੇਸ਼ਨ ਲਈ ਟੂਲ, ਅਤੇ ChatGPT Enterprise ਅਤੇ ਟੀਮ ਯੋਜਨਾਵਾਂ ਜਿਹੜੀਆਂ ਉਚੇਰੇ ਸੁਰੱਖਿਆ, ਐਡਮਿਨ ਕੰਟਰੋਲ ਅਤੇ ਅਨੁਕੂਲਤਾ ਫੀਚਰਾਂ ਦੀ ਲੋੜ ਰੱਖਦੀਆਂ ਸੰਗਠਨ ਲਈ ਹਨ।

ChatGPT ਦੀ ਅਚਾਨਕ ਦਰਸ਼ਨੀਤਾ ਲੰਬੇ ਸਮੇਂ ਤੋਂ ਚੱਲ ਰਹੀਆਂ AI ਚਰਚਾਵਾਂ ਨੂੰ ਤੇਜ਼ ਕਰ ਗਈ।

ਨਿਯੰਤਰਕ ਅਤੇ ਨੀਤਿਨਿਰਮਾਤਾ ਗੋਪਨੀਯਤਾ, ਡੇਟਾ ਸੁਰੱਖਿਆ ਅਤੇ ਮੌਜੂਦਾ ਕਾਨੂੰਨਾਂ ਦੇ ਅਨੁਸਾਰ ਪਾਲਣਾ ਬਾਰੇ ਚਿੰਤਿਤ ਰਹੇ, ਖ਼ਾਸ ਕਰਕੇ ਯੂਰਪੀ ਯੂਨੀਅਨ ਵਰਗੇ ਖੇਤਰਾਂ ਵਿੱਚ। ਕੁਝ ਅਥਾਰਟੀਜ਼ ਨੇ ChatGPT ਨੂੰ ਅਰਥਤ: ਤੱਥਾਂ ਅਤੇ ਡੇਟਾ ਪ੍ਰਕਿਰਿਆ ਕਰਨ ਦੇ ਢੰਗ ਦੀ ਜਾਂਚ ਕੀਤੀ ਅਤੇ ਕੁਝ ਸਮੇਂ ਲਈ ਰੋਕ ਜਾਂ ਜਾਂਚ ਕੀਤੀ।

ਅਧਿਆਪਕਾਂ ਨੇ ਨਕਲ ਅਤੇ ਅਕਾਦਮਿਕ ਇਮਾਨਦਾਰੀ ਬਾਰੇ ਚਿੰਤਾ ਦਰਸਾਈ ਕਿਉਂਕਿ ਵਿਦਿਆਰਥੀ ਆਸਾਨੀ ਨਾਲ ਨਿਬੰਧ ਅਤੇ ਹੋਮਵਰਕ ਜਨਰੇਟ ਕਰ ਸਕਦੇ ਸਨ। ਇਸ ਨਾਲ ਕੁਝ ਸਕੂਲਾਂ ਵਿੱਚਬੈਨ ਜਾਂ ਸਖ਼ਤ ਨੀਤੀਆਂ ਹੋਈਆਂ, ਦੂਜੇ ਥਾਂ ਅਸਾਈਨਮੈਂਟਾਂ ਨੂੰ ਪ੍ਰਕਿਰਿਆ ਤੇ ਮੁੱਖ ਧਿਆਨ ਦੇਣ ਜਾਂ ਮੌਖਿਕ ਪ੍ਰੀਖਿਆਵਾਂ ਵੱਲ ਬਦਲਿਆ ਗਿਆ।

ਨੈਤਿਕਤਾ ਅਤੇ ਰਿਸਰਚਰਾਂ ਨੇ misinformation, AI 'ਤੇ ਅਤਿ-ਨਿਰਭਰਤਾ, ਅਤੇ ਰਿਸਪਾਂਸ ਵਿੱਚ ਪੱਖਪਾਤ ਦੇ ਖ਼ਤਰੇ ਉੱਠਾਏ। ਟ੍ਰੇਨਿੰਗ ਡੇਟਾ, ਕਾਪੀਰਾਈਟ ਅਤੇ ਕਲਾਕਾਰਾਂ ਅਤੇ ਲੇਖਕਾਂ ਦੇ ਅਧਿਕਾਰਾਂ ਬਾਰੇ ਵੀ ਪ੍ਰਸ਼ਨ ਉਠੇ ਜੋ ਮਾਡਲ ਦੇ ਵਿਹਾਰ ਨੂੰ ਪ੍ਰਭਾਵਿਤ ਕਰ ਸਕਦੇ ਹਨ।

OpenAI ਲਈ, ChatGPT ਇੱਕ ਮੋੜਦਾਰ ਸੀ: ਇਸਨੇ ਸੰਗਠਨ ਨੂੰ ਇੱਕ ਮੁੱਖ ਰਿਸਰਚ-ਕੇਂਦਰ ਤੋਂ ਇੱਕ ਕੰਪਨੀ ਵਿੱਚ ਬਦਲ ਦਿੱਤਾ ਜੋ ਇਸ ਗੱਲਬਾਤ ਦੇ ਕੇਂਦਰ ਵਿੱਚ ਹੈ ਕਿ ਤਾਕਤਵਰ ਭਾਸ਼ਾਈ ਮਾਡਲਾਂ ਨੂੰ ਕਿਵੇਂ ਨਿਰਯਾਤ, ਗਵਰਨ ਅਤੇ ਰੋਜ਼ਾਨਾ ਜੀਵਨ ਵਿੱਚ ਸ਼ਾਮਿਲ ਕੀਤਾ ਜਾਣਾ ਚਾਹੀਦਾ ਹੈ।

OpenAI ਨੇ GPT-4 ਨੂੰ ਮਾਰਚ 2023 ਵਿੱਚ ਰਿਲੀਜ਼ ਕੀਤਾ ਜੋ GPT-3.5 ਤੋਂ ਇੱਕ ਵੱਡਾ ਕਦਮ ਸੀ—ਉਹ ਮਾਡਲ ਜੋ ਸ਼ੁਰੂ ਵਿੱਚ ChatGPT ਨੂੰ ਚਲਾਉਂਦਾ ਸੀ। GPT-4 ਨੇ ਤਰਕ, ਜਟਿਲ ਸੂਤਰਾਂ ਨੂੰ ਫਾਲੋ ਕਰਨ ਅਤੇ ਲੰਬੀਆਂ ਗੱਲਬਾਤਾਂ ਵਿੱਚ ਕੋਹਿਰੈਂਸ ਬਰਕਰਾਰ ਰੱਖਣ ਵਿੱਚ ਸੁਧਾਰ ਕੀਤਾ। ਇਹ ਨੁੰਹ-ਨੁੰਹ ਪ੍ਰਾਂਪਟਾਂ ਨੂੰ ਸੰਭਾਲਣ ਵਿੱਚ ਵੀ ਕਾਫੀ ਮਹਿਰ ਹੋ ਗਿਆ—ਉਦਾਹਰਨ ਲਈ ਕਾਨੂੰਨੀ ਧਾਰਾਂ ਦੀ ਵਿਆਖਿਆ, ਤਕਨੀਕੀ ਪੇਪਰਾਂ ਦਾ ਸੰਖੇਪ ਬਣਾਉਣਾ, ਜਾਂ ਅਸਪਸ਼ਟ ਮੰਗਾਂ ਤੋਂ ਕੋਡ ਡ੍ਰਾਫਟ ਕਰਨਾ।

GPT-3.5 ਨਾਲੋਂ GPT-4 ਨੇ ਕਈ ਸਪਸ਼ਟ ਫੇਲਅਰ ਮੋਡ ਘਟਾ ਦਿੱਤੇ: ਜਦੋਂ ਸਰੋਤਾਂ ਲਈ ਪੁੱਛਿਆ ਜਾਂਦਾ ਸੀ ਤਾਂ ਇਹ ਘੱਟ ਜ਼ਿਆਦਾ ਉਤਪਾਦਨ ਕਰਦਾ, ਗਣਿਤ ਅਤੇ ਤਰਕ ਦੀਆਂ ਗਲਤੀਆਂ ਦੇ ਐਜ ਕੇਸਾਂ ਨੂੰ ਜ਼ਿਆਦਾ ਭਲਾਭੰਗੀ ਤਰੀਕੇ ਨਾਲ ਹੱਲ ਕੀਤਾ ਅਤੇ ਬਾਰ-ਬਾਰ ਪੁੱਛੇ ਜਾਣ 'ਤੇ ਨਤੀਜੇ ਹੋਰ ਅਨੁਕੂਲ ਦਿੱਤੇ।

GPT-4 ਨੇ multimodal ਸਮਰੱਥਾਵਾਂ ਪੇਸ਼ ਕੀਤੀਆਂ: ਟੈਕਸਟ ਦੇ ਇਲਾਵਾ, ਇਸ ਵਿੱਚ ਕੁਝ ਸੰਰਚਨਾਵਾਂ ਵਿੱਚ ਇਮੇਜਾਂ ਨੂੰ ਇੰਪੁੱਟ ਵਜੋਂ ਲਿਆ ਜਾ ਸਕਦਾ ਹੈ। ਇਸ ਨਾਲ ਵਰਤੋਂ-ਮਾਮਲੇ ਜਿਵੇਂ ਚਾਰਟਾਂ ਦਾ ਵਰਣਨ, ਹੱਥੀ ਲਿਖਤ ਨੋਟਾਂ ਪੜ੍ਹਨਾ, UI ਸਕ੍ਰੀਨਸ਼ਾਟ ਦੀ ਵਿਆਖਿਆ ਜਾਂ ਫੋਟੋਆਂ ਤੋਂ ਸੰਰਚਿਤ ਜਾਣਕਾਰੀ ਠੀਕ ਕਰਨੀ ਆਸਾਨ ਹੋ ਗਈ।

ਮਿਆਰੀ ਬੈਂਚਮਾਰਕਾਂ 'ਤੇ GPT-4 ਨੇ ਪਹਿਲੇ ਮਾਡਲਾਂ ਨਾਲੋਂ ਕਾਫੀ ਬਿਹਤਰ ਨਤੀਜੇ ਦਿਖਾਏ। ਇਸਨੇ ਕਈ ਪ੍ਰੋਫੈਸ਼ਨਲ ਇਮਤਿਹਾਨਾਂ—ਜਿਵੇਂ ਬਾਰ ਪਰੀਖਿਆ, SAT ਅਤੇ ਵੱਖ-ਵੱਖ ਐਡਵਾਂਸਡ ਪਲੇਸਮੈਂਟ ਟੈਸਟਾਂ—'ਤੇ ਨੇੜੇ‑ਟਾਪ ਪਰਸੈਂਟਾਈਲ ਸਕੋਰ ਹਾਸਲ ਕੀਤੇ। ਇਹ ਕੋਡਿੰਗ ਅਤੇ ਤਰਕ-ਸੰਬੰਧੀ ਬੈਂਚਮਾਰਕਾਂ 'ਤੇ ਵੀ ਸੁਧਾਰ ਦਿਖਾਉਂਦਾ ਹੈ, ਜਿਸ ਨਾਲ ਭਾਸ਼ਾ ਸਮਝਣ ਅਤੇ ਸਮੱਸਿਆ-ਹੱਲ ਕਰਨ ਦੀ ਬੇਹਤਰੀ ਦਰਸਾਈ ਗਈ।

GPT-4 ਨੇ ਜਲਦੀ ਹੀ OpenAI ਦੀ API ਦੀ ਮੁੱਖ ਹੱਡੀ ਬਣਕੇ ਇੱਕ ਨਵੀਂ ਲਹਿਰ ਤੀਜੀ-ਪੱਖੀ ਉਤਪਾਦਾਂ ਨੂੰ ਚਲਾਇਆ: ਪ੍ਰੋਡਕਟਿਵਿਟੀ ਸੂਟਾਂ ਵਿੱਚ AI copilots, ਕੋਡਿੰਗ ਸਹਾਇਕ, ਗ੍ਰਾਹਕ ਸਹਾਇਤਾ ਟੂਲ, ਸਿੱਖਿਆ ਪਲੇਟਫਾਰਮ, ਅਤੇ ਕਾਨੂੰਨ, ਫਾਇਨੈਂਸ ਅਤੇ ਹੈਲਥਕੇਅਰ ਵਰਗੇ ਖੇਤਰਾਂ ਵਿੱਚ ਵਰਟੀਕਲ-ਖ਼ਾਸ ਐਪਲੀਕੇਸ਼ਨ।

ਇਹ ਤਰੱਕੀਆਂ ਹੋਣ ਦੇ ਬਾਵਜੂਦ, GPT-4 ਅਜੇ ਵੀ hallucinate ਕਰਦਾ ਹੈ, ਅਨਸਾਫ਼ ਜਾਂ ਪੱਖਪਾਤ ਵਾਲੇ ਨਤੀਜੇ ਦੇ ਸਕਦਾ ਹੈ, ਅਤੇ ਅਸਲ ਸਮਝ ਜਾਂ ਅਪ-ਟੂ‑ਡੇਟ ਤੱਥੀ ਜਾਣਕਾਰੀ ਦੀ ਘਾਟ ਰੱਖਦਾ ਹੈ। OpenAI ਨੇ GPT-4 ਲਈ alignment ਰਿਸਰਚ 'ਤੇ ਭਾਰੀ ਧਿਆਨ ਦਿੱਤਾ—ਜਿਸ ਵਿੱਚ RLHF, red‑teaming, ਅਤੇ ਸਿਸਟਮ-ਸਤਰ ਸੁਰੱਖਿਆ ਨਿਯਮ ਸ਼ਾਮਿਲ ਹਨ—ਪਰ ਇਹ ਜ਼ੋਰ ਦਿੱਤਾ ਜਾਂਦਾ ਹੈ ਕਿ ਖ਼ਤਰੇ ਤੇ ਦੁਰਵਰਤੋਂ ਨੂੰ ਸੰਭਾਲਣ ਲਈ ਸੰਭਾਲੇ ਹੋਏ ਨਿਰਯਾਤ, ਨਿਗਰਾਨੀ ਅਤੇ ਲਗਾਤਾਰ ਰਿਸਰਚ ਦੀ ਲੋੜ ਹੈ।

ਸ਼ੁਰੂਆਤੀ ਸਾਲਾਂ ਤੋਂ ਹੀ OpenAI ਨੇ ਸੁਰੱਖਿਆ ਅਤੇ alignment ਨੂੰ ਆਪਣਾ ਮੂਲ ਮਿਸ਼ਨ ਦੱਸਿਆ—ਇਹ ਉਪਲਬਧੀਆਂ ਨਹੀਂ ਕਿ ਉਤਪਾਦ ਲਾਂਚ ਕਰਨ ਬਾਅਦ ਦੀ ਪਛਾੜ। ਸੰਗਠਨ ਨੇ ਮੁੜ-ਮੁੜ ਕਿਹਾ ਕਿ ਉਸਦਾ ਲਕਸ਼ highly capable AI ਸਿਸਟਮ ਬਣਾਉਣਾ ਹੈ ਜੋ ਮਨੁੱਖੀ ਮੁੱਲਾਂ ਦੇ ਅਨੁਕੂਲ ਹੋਵੇ ਅਤੇ ਇਸ ਤਰ੍ਹਾਂ ਡਿਪਲੋਇ ਕੀਤਾ ਜਾਵੇ ਕਿ ਹਰ ਕਿਸੇ ਨੂੰ ਲਾਭ ਹੋਵੇ, ਨਾ ਕਿ ਸਿਰਫ਼ ਉਸਦੇ ਸ਼ੇਅਰਹੋਲਡਰਾਂ ਜਾਂ ਪਹਿਲਾਂ ਵਾਲੇ ਸਾਥੀਆਂ ਨੂੰ।

2018 ਵਿੱਚ OpenAI ਨੇ OpenAI Charter ਜਾਰੀ ਕੀਤਾ, ਜਿਸਨੇ ਉਸਦੀ ਪ੍ਰਾਥਮਿਕਤਾਵਾਂ ਨੂੰ ਰੂਪ ਦਿੱਤਾ:

Charter ਅਸਲ ਵਿੱਚ ਗਵਰਨੈਂਸ ਦੀ ਦਿਸ਼ਾ-ਨਿਰਦੇਸ਼ਕ ਹੈ, ਜੋ ਕਿ ਰਿਸਰਚ ਦਿਸ਼ਾਵਾਂ, ਨਿਰਯਾਤ ਦੀ ਗਤੀ ਅਤੇ ਬਾਹਰੀ ਭਾਈਚਾਰਿਆਂ ਨਾਲ ਮੁਲਾਕਾਤਾਂ 'ਤੇ ਫੈਸਲਾ ਕਰਨ ਵਿੱਚ ਪ੍ਰਭਾਵ ਪਾਉਂਦਾ ਹੈ।

ਜਦ ਮਾਡਲਾਂ ਹੋਰ ਸਮਰੱਥ ਹੋ ਗਏ, OpenAI ਨੇ ਆਪਣੀ ਮੁੱਖ ਰਿਸਰਚ ਟੀਮਾਂ ਨਾਲ ਨਾਲ ਸਮਰੱਥਾ-ਨਿਰਪੇਖ ਸੁਰੱਖਿਆ ਅਤੇ ਗਵਰਨੈਂਸ ਫੰਕਸ਼ਨ ਬਣਾਏ:

ਇਹ ਗਰੂਪ GPT‑4 ਅਤੇ DALL·E ਵਰਗੇ ਮਾਡਲਾਂ ਲਈ ਲਾਂਚ ਫੈਸਲਿਆਂ, ਪਹੁੰਚ ਟੀਅਰਾਂ ਅਤੇ ਵਰਤੋਂ ਨੀਤੀਆਂ 'ਤੇ ਪ੍ਰਭਾਵ ਪਾਉਂਦੇ ਹਨ।

ਇੱਕ ਪਰਿਭਾਸ਼ਿਤ ਤਕਨੀਕੀ ਦ੍ਰਿਸ਼ਟਿਕੋਣ ਰਹੀ ਹੈ reinforcement learning from human feedback (RLHF)। ਮਨੁੱਖੀ ਲੇਬਲਰ ਮਾਡਲ ਆਉਟਪੁੱਟਾਂ ਦੀ ਸਮੀਖਿਆ ਕਰਦੇ ਹਨ, ਉਹਨਾਂ ਨੂੰ ਰੈਂਕ ਕਰਦੇ ਹਨ, ਅਤੇ ਇੱਕ ਰਿਵਾਰਡ ਮਾਡਲ ਸਿਖਾਇਆ ਜਾਂਦਾ ਹੈ। ਮੁੱਖ ਮਾਡਲ ਨੂੰ ਫਿਰ ਇਸ ਰਿਵਾਰਡ ਮਾਡਲ ਦੇ ਨਜ਼ਦੀਕ ਜਵਾਬ ਬਣਾਉਣ ਲਈ Optimize ਕੀਤਾ ਜਾਂਦਾ ਹੈ, ਜਿਸ ਨਾਲ ਜ਼ਹਿਰੀਲੇ, ਪੱਖਪਾਤपूर्ण ਜਾਂ ਅਸੁਰੱਖਿਅਤ ਨਤੀਜੇ ਘਟਦੇ ਹਨ।

ਸਮੇਂ ਦੇ ਨਾਲ, OpenAI ਨੇ RLHF ਨੂੰ ਹੋਰ ਤਕਨੀਕਾਂ ਨਾਲ ਜੋੜਿਆ: ਸਿਸਟਮ-ਸਤਰ ਸੁਰੱਖਿਆ ਨੀਤੀਆਂ, ਸਮੱਗਰੀ ਫਿਲਟਰ, ਖ਼ਾਸ ਡੋਮੇਨ ਲਈ ਫਾਈਨ-ਟਿਊਨਿੰਗ ਅਤੇ ਮਾਨੀਟਰਨਗ ਟੂਲ ਜੋ ਉੱਚ-ਖ਼ਤਰੇ ਵਾਲੇ ਉਪਯੋਗ ਨੂੰ ਸੀਮਿਤ ਜਾਂ ਫਲੈਗ ਕਰ ਸਕਦੇ ਹਨ।

OpenAI ਨੇ ਸਰਕਾਰੀ ਵਚਨਾਂ, ਮਾਡਲ ਰਿਪੋਰਟਿੰਗ ਅਭਿਆਸਾਂ ਅਤੇ frontier model safety ਮਿਆਰਾਂ ਵਰਗੇ ਜਨਤਕ ਸੁਰੱਖਿਆ ਫਰੇਮਵਰਕਾਂ ਵਿੱਚ ਭਾਗ ਲਿਆ ਹੈ। ਇਸਨੇ ਅਕਾਦਮਿਕਾਂ, ਸਿਵਿਲ-ਸੋਸਾਇਟੀ ਸੰਸਥਾਵਾਂ ਅਤੇ ਸੁਰੱਖਿਆ ਰਿਸਰਚਰਾਂ ਨਾਲ ਮੁਲਿਆੰਕਣ, red‑teaming ਅਤੇ ਆਡੀਟ 'ਤੇ ਸਹਿਯੋਗ ਕੀਤਾ ਹੈ।

ਇਹ ਸਹਿਆੋਗ, Charter ਅਤੇ ਵਿਕਸਤ ਵਰਤੋਂ ਨੀਤੀਆਂ OpenAI ਦੀਆਂ ਵੱਧ-ਸਮਰੱਥਾ ਵਾਲੀਆਂ AI ਪ੍ਰਣਾਲੀਆਂ ਨੂੰ ਗਵਰਨ ਕਰਨ ਦੇ ਢਾਂਚੇ ਦਾ ਮੂਲ ਹਨ।

OpenAI ਦੀ ਤੇਜ਼ ਉਤਥਾਨ ਨੇ ਆਲੋਚਨਾ ਅਤੇ ਅੰਦਰੂਨੀ ਤਣਾਅ ਨਾਲ ਛਾਂਵਾਰ ਕੀਤੀ, ਜਿਨ੍ਹਾਂ ਵਿੱਚ ਵੱਧਤਰ ਤੁਲਨ੍ਹਾ ਇਸ ਗੱਲ 'ਤੇ ਕੇਂਦਰਿਤ ਰਹੀ ਕਿ ਕੀ ਸੰਗਠਨ ਅਜੇ ਵੀ ਆਪਣੀ ਮੂਲ ਮਿਸ਼ਨ—ਵਿਸ਼ਾਲ, ਸੁਰੱਖਿਅਤ ਲਾਭ—ਦੇ ਨਾਲ ਖਰਾ ਠਰਦਾ ਹੈ।

ਸ਼ੁਰੂ ਵਿੱਚ, OpenAI ਨੇ ਖੁੱਲ੍ਹੇ ਪ੍ਰਕਾਸ਼ਨ ਅਤੇ ਸਾਂਝੇਦਾਰੀ 'ਤੇ ਜ਼ੋਰ ਦਿੱਤਾ। ਜਿਵੇਂ‑ਜਿਵੇਂ GPT-2, GPT-3 ਅਤੇ GPT-4 ਹੋਰ ਸਮਰੱਥ ਹੋਏ, ਕੰਪਨੀ ਨੇ ਸੀਮਤ ਰਿਲੀਜ਼, API-ਕੇਵਲ ਪਹੁੰਚ ਅਤੇ ਘੱਟ ਤਕਨੀਕੀ ਵੇਰਵਾ ਦੇ ਰੁਖ ਨੂੰ ਅਪਣਾਇਆ।

ਆਲੋਚਕ ਕਹਿੰਦੇ ਹਨ ਕਿ ਇਹ ਬਦਲਾਅ "OpenAI" ਨਾਮ ਦੇ ਨਾਲ ਦਿੱਤੇ ਗਏ ਵਚਨ ਨਾਲ ਟਕਰਾਉਂਦਾ ਹੈ। ਕੰਪਨੀ ਦੇ ਸਮਰਥਕ ਤर्क ਦਿੰਦੇ ਹਨ ਕਿ ਪੂਰੇ ਮਾਡਲ ਵਜ਼ਨ ਅਤੇ ਟ੍ਰੇਨਿੰਗ ਵੇਰਿਆ ਨੂੰ ਰੋਕਣਾ ਦੁਰਵਰਤੋਂ ਅਤੇ ਸੁਰੱਖਿਆ ਕਾਰਨਾਂ ਲਈ ਲਾਜ਼ਮੀ ਹੈ।

OpenAI ਨੇ ਸੁਰੱਖਿਆ ਮੁਲਿਆੰਕਣ, ਸਿਸਟਮ ਕਾਰਡ ਅਤੇ ਨੀති ਦਸਤਾਵੇਜ਼ ਜਾਰੀ ਕਰਕੇ ਇਸਦਾ ਜਵਾਬ ਦਿੱਤਾ, ਪਰ ਕੋਰ ਮਾਡਲ ਵਜ਼ਨ ਪ੍ਰੋਪ੍ਰਾਈਟਰੀ ਰੱਖੇ। ਇਹ ਉਨ੍ਹਾਂ ਦੁਆਰਾ ਖੁੱਲ੍ਹਾਪਣ, ਸੁਰੱਖਿਆ ਅਤੇ ਮੁਕਾਬਲੇ ਦੇ ਦਬਾਅ ਵਿਚਕਾਰ ਇੱਕ ਸੰਤੁਲਨ ਵਜੋਂ ਪੇਸ਼ ਕੀਤਾ ਗਿਆ।

ਜਦ OpenAI ਨੇ Microsoft ਨਾਲ ਆਪਣੀ ਭਾਈਚਾਰਾ ਨੂੰ ਗਹਿਰਾ ਕੀਤਾ—Azure ਵਿੱਚ ਮਾਡਲਾਂ ਦੇ ਇੰਟੇਗ੍ਰੇਸ਼ਨ ਅਤੇ Copilot ਵਰਗੀਆਂ ਉਤਪਾਦਾਂ—ਨਿਰੀਖਣਕਾਰਾਂ ਨੇ ਕੁਝ ਚਿੰਤਾਵਾਂ ਉਠਾਈਆਂ ਕਿ ਕਿਤਨਾ ਕੁਂਦਰੀਕਰਨ ਹੋ ਰਿਹਾ ਹੈ।

ਆਲੋਚਕ ਚਿੰਤਾ ਕਰਦੇ ਹਨ ਕਿ ਕੁਝ ਕੰਪਨੀਆਂ ਹੁਣ frontier ਮਾਡਲਾਂ ਅਤੇ ਉਨ੍ਹਾਂ ਦੇ ਪਿਛੋਕੜ ਬਜ਼ੋਉਲ ਇਨਫਰਾਸਟ੍ਰਕਚਰ 'ਤੇ ਨਿਯੰਤਰਣ ਰੱਖਦੀਆਂ ਹਨ। ਹੋਰ ਲੋਕ ਕਹਿੰਦੇ ਹਨ ਕਿ aggressive commercialization (ChatGPT Plus, enterprise ਪੇਸ਼ਕਸ਼ਾਂ, ਅਤੇ ਵਿਸ਼ੇਸ਼ ਲਾਇਸੈਂਸਿੰਗ) ਮੂਲ ਗੈਰ-ਲਾਭਕਾਰੀ ਮਿਸ਼ਨ ਤੋਂ ਵੱਖਰਾ ਹੋ ਸਕਦਾ ਹੈ।

OpenAI ਦੀ ਲੀਡਰਸ਼ਿਪ ਰੈਵਨਿਊ ਨੂੰ ਮਹਿੰਗੀ ਰਿਸਰਚ ਫੰਡ ਕਰਨ ਲਈ ਜ਼ਰੂਰੀ ਦੱਸਦੀ ਹੈ, ਇਸਦੇ ਨਾਲ capped-profit ਸੰਰਚਨਾ ਅਤੇ ਚਾਰਟਰ ਜਿਸ 'ਤੇ ਮਨੁੱਖਤਾ ਦੇ ਹਿੱਤਾਂ ਨੂੰ ਪ੍ਰਾਥਮਿਕਤਾ ਦਿੱਤੀ ਗਈ—ਇਹ ਦਿਖਾਉਂਦੇ ਹਨ ਕਿ ਕੰਪਨੀ ਫਿਰ ਵੀ ਜਨਤਕ ਲਾਭ ਲਈ ਕੁਝ ਰਾਹ ਰੱਖਦੀ ਹੈ। ਇਸਦੇ ਨਾਲ-ਨਾਲ, ਮੁਕਤ ਐਕਸੈੱਸ ਟੀਅਰ, ਰਿਸਰਚ ਭਾਈਚਾਰਿਆਂ ਅਤੇ ਕੁਝ open-source ਟੂਲਾਂ ਜਾਰੀ ਕਰਨ ਵਾਲੇ ਪ੍ਰੋਗਰਾਮ ਵੀ ਜਨਤਕ ਲਾਭ ਦਰਸਾਉਣ ਲਈ ਸ਼ੁਰੂ ਕੀਤੇ ਗਏ।

ਅੰਦਰੂਨੀ ਝਗੜੇ ਇਸ ਗੱਲ 'ਤੇ ਵਾਰ-ਵਾਰ ਉਭਰੇ ਕਿ ਕਿੰਨੀ ਤੇਜ਼ੀ ਨਾਲ ਅੱਗੇ ਵਧਣਾ ਚਾਹੀਦਾ ਹੈ, ਕਿੰਨਾ ਖੁੱਲ੍ਹਾ ਰਹਿਣਾ ਚਾਹੀਦਾ ਹੈ, ਅਤੇ ਸੁਰੱਖਿਆ ਨੂੰ ਕਿਵੇਂ ਤਰਜੀਹ ਦੇਣੀ ਚਾਹੀਦੀ ਹੈ।

Dario Amodei ਅਤੇ ਹੋਰ 2020 ਵਿੱਚ Anthropic ਬਣਾਉਣ ਲਈ ਨਿਕਲੇ, ਜਿਨ੍ਹਾਂ ਨੇ ਸੁਰੱਖਿਆ ਅਤੇ ਗਵਰਨੈਂਸ 'ਤੇ ਵੱਖਰੇ ਨਜ਼ਰੀਏ ਦਰਸਾਏ। ਬਾਅਦ ਵਿੱਚ ਕੁਝ ਮੁੱਖ ਸੁਰੱਖਿਆ ਰਿਸਰਚਰਾਂ, ਜਿਵੇਂ Jan Leike (2024 ਵਿੱਚ) ਨੇ ਇਤਮਿਨਾਨ ਨਾ ਹੋਣ ਕਾਰਨ ਸੰਗਠਨ ਛੱਡ ਦਿੱਤਾ, ਜਿਸ ਨਾਲ ਲੋਕਾਂ ਨੇ ਸੋਚਿਆ ਕਿ ਸ਼ੌਰਟ-ਟਰਮ ਪ੍ਰੋਡਕਟ ਲਕਸ਼ ਮੌਲ-ਬਰ ਵੱਧ ਰਹੇ ਹਨ।

ਸਭ ਤੋਂ ਜ਼ਿਆਦਾ ਵੇਖਣਯੋਗ ਟੁੱਟ-ਫੁੱਟ ਨਵੰਬਰ 2023 ਵਿੱਚ ਹੋਈ, ਜਦੋਂ ਬੋਰਡ ਨੇ ਅਚਾਨਕ CEO Sam Altman ਨੂੰ ਹਟਾ ਦਿੱਤਾ, ਭਰੋਸੇ ਖ਼ਤਮ ਹੋਣ ਦਾ ਜਿਹਾ ਕਾਰਨ ਦੱਸਿਆ। ਤੇਜ਼ ਕਰਮਚਾਰੀ ਪ੍ਰਤੀਕਿਰਿਆ ਅਤੇ Microsoft ਅਤੇ ਹੋਰ ਸਟੇਕਹੋਲਡਰਾਂ ਦੀ ਮਦਦ ਨਾਲ Altman ਵਾਪਸ ਆ ਗਿਆ, ਬੋਰਡ ਨੂੰ ਮੁੜ ਬਣਾਇਆ ਗਿਆ ਅਤੇ OpenAI ਨੇ ਗਵਰਨੈਂਸ ਸੁਧਾਰ ਦਾ ਵਾਅਦਾ ਕੀਤਾ, ਜਿਸ ਵਿੱਚ ਨਵਾਂ Safety and Security Committee ਸ਼ਾਮਿਲ ਹੈ।

ਇਹ ਘਟਨਾਵਾਂ ਦਰਸਾਉਂਦੀਆਂ ਹਨ ਕਿ ਸੰਸਥਾ ਅਜੇ ਵੀ ਤੇਜ਼ ਨਿਰਯਾਤ, ਵਪਾਰਕ ਸਫਲਤਾ ਅਤੇ ਆਪਣੀਆਂ ਜ਼ਿੰਮੇਵਾਰੀਆਂ ਵਿਚਕਾਰ ਸਮਝੌਤਾ ਕਰਨ ਦੇ ਢੰਗ ਤੇ ਕੰਮ ਕਰ ਰਹੀ ਹੈ।

OpenAI ਇੱਕ ਛੋਟੀ, ਰਿਸਰਚ-ਕੇਂਦਰਤ ਗੈਰ-ਲਾਭਕਾਰੀ ਲੈਬ ਤੋਂ ਇੱਕ ਕੇਂਦਰੀ ਇਨਫਰਾਸਟ੍ਰਕਚਰ ਪ੍ਰਦਾਤਾ ਵਿੱਚ ਬਦਲ ਗਿਆ ਹੈ, ਜੋ ਨਵੇਂ ਟੂਲਾਂ ਨੂੰ ਬਣਾਉਣ, ਨਿਯਮਿਤ ਕਰਨ ਅਤੇ ਸਮਝਣ ਦੇ ਢੰਗਾਂ ਨੂੰ ਪ੍ਰਭਾਵਿਤ ਕਰ ਰਿਹਾ ਹੈ।

ਮਾਡਲਾਂ ਪ੍ਰਕਾਸ਼ਿਤ ਕਰਨ ਦੀ ਥਾਂ, OpenAI ਹੁਣ ਇੱਕ ਪੂਰਾ ਪਲੇਟਫਾਰਮ ਚਲਾਉਂਦਾ ਹੈ ਜੋ startups, ਐਂਟਰਪਰਾਈਜ਼ ਅਤੇ ਇਕੱਲੇ ਡਿਵੈਲਪਰਾਂ ਦੁਆਰਾ ਵਰਤਿਆ ਜਾਂਦਾ ਹੈ। GPT-4, DALL·E ਅਤੇ ਭਵਿੱਖੀ ਸਿਸਟਮਾਂ ਲਈ APIs ਰਾਹੀਂ ਇਹ ਬਣ ਗਿਆ ਹੈ:

ਇਹ ਪਲੇਟਫਾਰਮ ਭੂਮਿਕਾ ਇਹ ਵੀ ਦਿਖਾਉਂਦੀ ਕਿ OpenAI ਹੁਣ ਸਿਰਫ ਰਿਸਰਚ ਅੱਗੇ ਨਹੀਂ ਵਧਾ ਰਿਹਾ—ਇਹ ਉਸ ਤਰੀਕੇ ਦੀ ਨਿਯਤੀਆਂ ਸੈੱਟ ਕਰਦਾ ਹੈ ਜਿੰਨ੍ਹਾਂ 'ਤੇ ਲੱਖਾਂ ਲੋਕ ਪਹਿਲੀ ਵਾਰੀ ਸ਼ਕਤੀਸ਼ਾਲੀ AI ਦਾ ਅਨੁਭਵ ਕਰਦੇ ਹਨ।

OpenAI ਦਾ ਕੰਮ ਮੁਕਾਬਲੇਦਾਰਾਂ ਅਤੇ ਓਪਨ-ਸੋਰਸ ਕਮਿਊਨਿਟੀਆਂ ਨੂੰ ਨਵੇਂ ਮਾਡਲ, ਟਰੇਨਿੰਗ ਤਰੀਕੇ ਅਤੇ ਸੁਰੱਖਿਆ ਐਪ੍ਰੋਚ ਲਿਆਉਣ ਲਈ ਉਤੇਜਿਤ ਕਰਦਾ ਹੈ। ਇਹ ਮੁਕਾਬਲਾ ਤਰੱਕੀ ਨੂੰ ਤੇਜ਼ ਕਰਦਾ ਹੈ ਪਰ ਖੁੱਲ੍ਹਾਪਣ, ਕੇਂਦਰੀਕਰਨ ਅਤੇ ਵਿਵਸਾਯੀਕਰਨ ਬਾਰੇ ਚਰਚਾਵਾਂ ਨੂੰ ਵੀ ਤੇਜ਼ ਕਰਦਾ ਹੈ।

ਸਰਕਾਰਾਂ ਅਤੇ ਨਿਯੰਤਰਕਾਂ ਦੀਆਂ ਅੱਖਾਂ OpenAI ਦੀਆਂ ਪ੍ਰਥਾਵਾਂ, ਪਾਰਦਰਸ਼ਤਾ ਰਿਪੋਰਟਾਂ ਅਤੇ alignment ਰਿਸਰਚਾਂ ਵੱਲ ਵਧ ਰਹੀਆਂ ਹਨ ਜਦੋਂ ਉਹ AI ਦੇ ਨਿਰਯਾਤ, ਸੁਰੱਖਿਆ ਮੁਲਾਂਕਣ ਅਤੇ ਜ਼ਿੰਮੀਦਾਰ ਵਰਤੋਂ ਲਈ ਨਿਯਮ ਲਿਖਦੇ ਹਨ। ChatGPT, GPT-4 ਅਤੇ ਭਵਿੱਖੀ ਸਿਸਟਮਾਂ ਬਾਰੇ ਜਨਤਕ ਗੱਲਾਂ-ਬਾਤ ਇਸ ਗੱਲ ਨੂੰ ਆਕਾਰ ਦਿੰਦੀਆਂ ਹਨ ਕਿ ਸਮਾਜ ਏਆਈ ਦੇ ਖ਼ਤਰੇ ਅਤੇ ਲਾਭ ਨੂੰ ਕਿਵੇਂ ਸੋਚਦਾ ਹੈ।

ਜਿਵੇਂ-ਜਿਵੇਂ ਮਾਡਲ ਹੋਰ ਸਮਰੱਥ ਹੁੰਦੇ ਹਨ, OpenAI ਦੀ ਭੂਮਿਕਾ ਬਾਰੇ ਅਣਸੁੱਲਝੇ ਮੁੱਦੇ ਹੋਰ ਮਹੱਤਵਪੂਰਨ ਹੋ ਜਾਂਦੇ ਹਨ:

ਇਹ ਪ੍ਰਸ਼ਨ ਨਿਰਧਾਰਿਤ ਕਰਨਗੇ ਕਿ ਭਵਿੱਖੀ AI ਪ੍ਰਣਾਲੀਆਂ ਮੌਜੂਦਾ ਅਸਮਾਨਤਾਵਾਂ ਨੂੰ ਵਧਾਉਣਗੀਆਂ ਜਾਂ ਘਟਾਉਣਗੀਆਂ।

ਡਿਵੈਲਪਰ ਅਤੇ ਕਾਰੋਬਾਰ ਕਰ ਸਕਦੇ ਹਨ:

ਵਿਅਕਤੀਗਤ ਤੌਰ 'ਤੇ:

OpenAI ਦਾ ਭਵਿੱਖੀ ਪ੍ਰਭਾਵ ਸਿਰਫ਼ ਉਸ ਦੇ ਅੰਦਰੂਨੀ ਫੈਸਲਿਆਂ 'ਤੇ ਨਹੀਂ ਨਿਰਭਰ ਕਰੇਗਾ, ਬਲਕਿ ਸਰਕਾਰਾਂ, ਮੁਕਾਬਲੇਦਾਰਾਂ, ਸਿਵਿਲ-ਸਮਾਜ ਅਤੇ ਹਰਦਮ ਵਰਤੋਂਕਾਰਾਂ ਦੇ ਤਰੀਕਿਆਂ 'ਤੇ ਵੀ ਜੋ ਇਹਨਾਂ ਸਿਸਟਮਾਂ ਨਾਲ ਮਦਦ, ਆਲੋਚਨਾ ਅਤੇ ਜ਼ਿੰਮੇਵਾਰੀ ਦੀ ਮੰਗ ਕਰਨਗੇ।

OpenAI ਨੂੰ 2015 ਵਿੱਚ ਇੱਕ ਗੈਰ-ਲਾਭਕਾਰੀ ਰਿਸਰਚ ਲੈਬ ਵਜੋਂ ਸਥਾਪਿਤ ਕੀਤਾ ਗਿਆ ਸੀ ਜਿਸਦਾ ਮਕਸਦ ਇਹ ਯਕੀਨੀ ਬਣਾਉਣਾ ਸੀ ਕਿ ਜੇ ਕਦੇ artificial general intelligence (AGI) ਬਣੀ, ਤਾਂ ਉਸਦਾ ਫਾਇਦਾ ਸਾਰੇ ਮਨੁੱਖਤਾ ਲਈ ਹੋਵੇ।

ਇਸਦੀ ਰਚਨਾ ਨੂੰ ਕੁਝ ਮੁੱਖ ਕਾਰਕਾਂ ਨੇ ਰੂਪ ਦਿੱਤਾ:

ਇਹ ਉਤਪੱਤੀ ਦੀ ਕਹਾਣੀ ਅੱਜ ਵੀ OpenAI ਦੀ ਸੰਰਚਨਾ, ਸਾਂਝੇਦਾਰੀਆਂ ਅਤੇ ਜਨਤਕ ਵਚਨਾਂ 'ਤੇ ਅਸਰ ਕਰਦੀ ਹੈ।

AGI (artificial general intelligence) ਉਹ AI ਪ੍ਰਣਾਲੀਆਂ ਹਨ ਜੋ ਕਿਸੇ ਇੱਕ ਕੰਮ ਲਈ ਬਣੀ ਕਾਢੀਆਂ ਸਿਸਟਮਾਂ ਤੋਂ ਵੱਖ—ਵੱਖ, ਮਨੁੱਖੀ ਦਰਜੇ ਦੇ ਕਈ ਬੌਧਿਕ ਕੰਮਾਂ ਨੂੰ ਕਰ ਸਕਣ।

OpenAI ਦਾ ਮਿਸ਼ਨ ਇਹ ਹੈ:

ਇਹ ਮਿਸ਼ਨ OpenAI Charter ਵਿੱਚ ਆਧਾਰਤ ਹੈ ਅਤੇ ਰਿਸਰਚ ਦਿਸ਼ਾਵਾਂ ਅਤੇ ਨਿਰਯਾਤ ਫੈਸਲਿਆਂ 'ਤੇ ਪ੍ਰਭਾਵ ਪਾਉਂਦਾ ਹੈ।

OpenAI ਨੇ ਖਾਲੀ ਗੈਰ-ਨਫੇ ਵਾਲੇ ਢਾਂਚੇ ਤੋਂ ਇੱਕ “capped‑profit” ਲਿਮਿਟਡ ਪਾਰਟਨਰਸ਼ਿਪ (OpenAI LP) ਵੱਲ ਵਧਿਆ ਤਾਂ ਜੋ cutting‑edge AI ਰਿਸਰਚ ਲਈ ਵੱਡਾ ਪੂੰਜੀ ਇਕੱਤਰ ਕੀਤਾ ਜਾ ਸਕੇ, ਪਰ ਮਿਸ਼ਨ ਨੂੰ ਅਗਲਾ ਰੱਖਿਆ ਜਾ ਸਕੇ।

ਮੁੱਖ ਨੁਕਤੇ:

ਇਹ ਗਵਰਨੈਂਸ ਦਾ ਇੱਕ ਪ੍ਰਯੋਗ ਹੈ ਅਤੇ ਇਸ ਦੀ ਪ੍ਰਭਾਵਸ਼ੀਲਤਾ 'ਤੇ ਅਜੇ ਵੀ ਗੱਲਬਾਤ ਚੱਲ ਰਹੀ ਹੈ।

Microsoft OpenAI ਨੂੰ ਵੱਡੇ ਪੱਧਰ ਦੇ ਕੁਲਾਉਡ ਕੋਮਪਿਊਟ (Azure) ਅਤੇ ਰਿਪੋਰਟ ਕੀਤੇ ਗਏ ਰੁਪਏ ਦੇ ਰੂਪ ਵਿੱਚ ਲੱਖਾਂ-ਕਰੋੜਾਂ ਦਾਨ ਦਿੱਤਾ।

ਇਸ ਭਾਈਚਾਰੇ ਵਿੱਚ ਸ਼ਾਮਿਲ ਹਨ:

ਬਦਲੇ ਵਿੱਚ, OpenAI ਨੂੰ ਵਿਸ਼ਾਲ ਪੈਮਾਨੇ 'ਤੇ ਮਾਡਲਾਂ ਨੂੰ ਟ੍ਰੇਨ ਅਤੇ ਡਿਪਲੋਇ ਕਰਨ ਲਈ ਸੰਸਾਧਨ ਮਿਲਦੇ ਹਨ, ਜਦਕਿ Microsoft ਨੂੰ ਆਪਣੇ ਈਕੋਸਿਸਟਮ ਲਈ ਅਲੱਗ AI ਸਮਰੱਥਾ ਪ੍ਰਾਪਤ ਹੁੰਦੀ ਹੈ।

GPT ਸੀਰੀਜ਼ ਨੇ ਸਕੇਲ, ਸਮਰੱਥਾ ਅਤੇ ਨਿਯੁਕਤੀ ਰਣਨੀਤੀ ਵਿੱਚ ਇਕ ਕ੍ਰਮ ਦਰਸਾਇਆ:

ਅਰੰਭ ਵਿੱਚ OpenAI "ਖੁੱਲ੍ਹਾ ਡਿਫੌਲਟ" ਨੀਤੀ ਰੱਖਦਾ ਸੀ—ਕਾਘਜ਼, ਕੋਡ ਅਤੇ ਟੂਲ ਜਾਰੀ ਕੀਤੇ ਜਾਂਦੇ ਸਨ। ਜਿਵੇਂ-जਿਵੇਂ ਮਾਡਲ ਸ਼ਕਤੀਸ਼ਾਲੀ ਹੋਏ, ਇਹ ਨੀਤੀ ਬਦਲੀ:

OpenAI ਦਾ ਦਲੀਲ ਹੈ ਕਿ ਇਹ ਦੁਰਵਰਤੋਂ ਦੇ ਖ਼ਤਰੇ ਘਟਾਉਣ ਲਈ ਜ਼ਰੂਰੀ ਹੈ। ਆਲੋਚਕ ਕਹਿੰਦੇ ਹਨ ਕਿ ਇਸ ਨਾਲ ਨਾਮ "OpenAI" ਦੀ ਵਚਨਬੱਧਤਾ ਕੁਝ ਘੱਟਦੀ ਹੈ ਅਤੇ ਸ਼ਕਤੀ ਕੇਂਦ੍ਰਿਤ ਹੋਣ ਦਾ ਖ਼ਤਰਾ ਵਧਦਾ ਹੈ।

OpenAI ਦੀ ਮੁੱਖ ਕੋਸ਼ਿਸ਼ ਰਹੀ ਹੈ ਕਿ ਏਆਈ ਸਿਸਟਮ ਸੁਰੱਖਿਅਤ ਅਤੇ alignment ਵਾਲੇ ਹੋਣ। ਇਸ ਲਈ ਉਹਨਾਂ ਨੇ ਸੰਗਠਨਾਤਮਕ ਤੌਰ 'ਤੇ ਅਤੇ ਤਕਨੀਕੀ ਤਰੀਕਿਆਂ ਨਾਲ ਕੰਮ ਕੀਤਾ:

ਇਹ ਉਪਾਈ ਜੋਖਮਾਂ ਨੂੰ ਘਟਾਉਂਦੇ ਹਨ ਪਰ hallucinations, bias ਅਤੇ ਦੁਰਵਰਤੋਂ ਵਰਗੀ ਸਮੱਸਿਆਵਾਂ ਨੂੰ ਪੂਰੀ ਤਰ੍ਹਾਂ ਨਹੀਂ ਹਟਾਉਂਦੇ।

ChatGPT, ਜੋ 2022 ਦੇ ਅਖੀਰ ਵਿੱਚ ਰਿਲੀਜ਼ ਹੋਇਆ, ਨੇ ਭਾਸ਼ਾਈ ਮਾਡਲਾਂ ਨੂੰ ਆਮ ਲੋਕਾਂ ਲਈ ਸਿੱਧਾ ਉਪਯੋਗੀ ਬਣਾ ਦਿੱਤਾ।

ਇਸ ਨੇ AI ਗ੍ਰਹਿਣਯੋਗਤਾ ਵਿੱਚ ਬਦਲਾਅ ਲਿਆਂਦਾ:

ਇਸ ਦੀ ਜਨਤਾ ਵਿੱਚ ਉਪਲਬਧਤਾ ਨੇ OpenAI ਦੇ ਗਵਰਨੈਂਸ, ਵਪਾਰਿਕ ਮਾਡਲ ਅਤੇ ਸੁਰੱਖਿਆ ਅਭਿਆਸਾਂ 'ਤੇ ਸਖਤ ਧਿਆਨ ਖਿੱਚਿਆ।

OpenAI ਦੇ ਮਾਡਲ, ਖ਼ਾਸ ਕਰਕੇ Codex ਅਤੇ GPT‑4, ਕੰਮ ਅਤੇ ਰਚਨਾਤਮਕ ਕੰਮਕਾਜ 'ਚ ਹੁਣੇ ਹੀ ਪ੍ਰਭਾਵ ਪਾ ਰਹੇ ਹਨ:

ਸੰਭਾਵਿਤ ਫਾਇਦੇ:

ਜੋਖਮ ਅਤੇ ਚਿੰਤਾਵਾਂ:

ਤੁਸੀਂ OpenAI ਦੇ ਪ੍ਰਣਾਲੀ ਨਾਲ ਕਈ ਤਰੀਕਿਆਂ ਨਾਲ ਜੁੜ ਸਕਦੇ ਹੋ:

ਕਿਸੇ ਵੀ ਹਾਲਤ ਵਿੱਚ, ਇਹ ਜਾਣਨਾ ਲਾਜ਼ਮੀ ਹੈ ਕਿ ਮਾਡਲ ਕਿਵੇਂ ਟ੍ਰੇਨ ਕੀਤੇ ਜਾਂਦੇ ਹਨ ਅਤੇ ਉਹਨਾਂ ਨੂੰ ਕਿੱਦਾ ਗਵਰਨ ਕੀਤਾ ਜਾ ਰਿਹਾ ਹੈ, ਅਤੇ ਜਦੋਂ ਸੰਭਵ ਹੋਵੇ ਤਦ ਵੈਕਸੀਲਨ ਤਕਨੀਕਾਂ ਲਈ ਪਹੁੰਚ ਬਰਕਰਾਰ ਰੱਖੋ।

ਹਰੇਕ ਕਦਮ ਨੇ ਤਕਨੀਕੀ ਸੀਮਾਵਾਂ ਨੂੰ ਧੱਕਿਆ ਅਤੇ ਸੁਰੱਖਿਆ, ਐਕਸੈੱਸ ਅਤੇ ਵਪਾਰਿਕਰਨ ਬਾਰੇ ਨਵੇਂ ਫੈਸਲੇ ਲਿਆਉਂਦੇ ਹਨ।

ਖੁੱਲ੍ਹਾ ਨਤੀਜਾ ਨੀਤੀਆਂ, ਸੰਗਠਨਾਤਮਕ ਚੋਣਾਂ ਅਤੇ ਲੋਕਾਂ ਦੇ AI ਨੂੰ ਏਨਟੇਗਰੇਟ ਕਰਨ ਦੇ ਤਰੀਕਿਆਂ 'ਤੇ ਨਿਰਭਰ ਕਰੇਗਾ।