04 cze 2025·8 min

Dlaczego skalowanie poziome jest trudniejsze niż pionowe

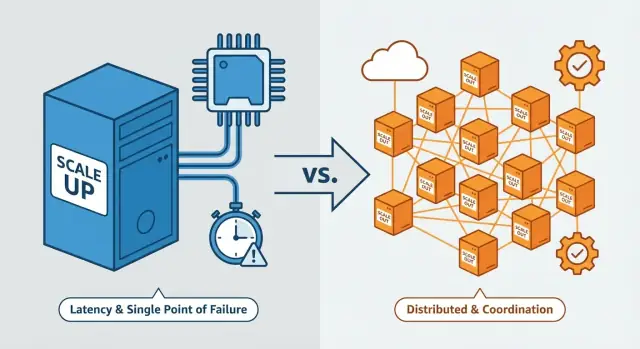

Skalowanie pionowe często to po prostu dodanie CPU/RAM. Skalowanie poziome wymaga koordynacji, partycjonowania danych, dbałości o spójność i więcej pracy operacyjnej — oto dlaczego jest trudniejsze.

Skalowanie prostym językiem

Skalowanie oznacza „obsłużyć więcej bez awarii”. To „więcej” może być:

- Więcej użytkowników korzystających z produktu w tym samym czasie

- Więcej zapytań API na sekundę

- Więcej danych przechowywanych i odpytywanych

- Więcej pracy w tle (maile, przetwarzanie wideo, raporty) wykonywanej za kulisami

Kiedy ludzie mówią o skalowaniu, zwykle chcą poprawić jedno lub więcej z tych aspektów:

- Pojemność: ile ruchu lub danych system może obsłużyć.

- Szybkość: jak szybko odpowiada pod obciążeniem.

- Niezawodność: jak dobrze działa, gdy coś się psuje.

Większość tego sprowadza się do jednej idei: skalowanie pionowe zachowuje „jednosystemowe” odczucie, podczas gdy skalowanie poziome zamienia system w skoordynowaną grupę niezależnych maszyn—i to właśnie ta koordynacja znacząco komplikuje sprawę.

Skalowanie pionowe vs poziome (krótkie definicje)

Skalowanie pionowe (scale up)

Skalowanie pionowe oznacza wzmocnienie pojedynczej maszyny. Zachowujesz tę samą architekturę, ale podnosisz parametry serwera (lub VM): więcej rdzeni CPU, więcej RAM, szybsze dyski, większa przepustowość sieci.

Pomyśl o tym jak o kupnie większej ciężarówki: masz jednego kierowcę i jedno pojazd, ale przewiezie więcej.

Skalowanie poziome (scale out)

Skalowanie poziome oznacza dodawanie kolejnych maszyn lub instancji i rozdzielanie pracy między nie—często za load balancerem. Zamiast jednego mocniejszego serwera uruchamiasz kilka serwerów współpracujących ze sobą.

To jak używanie większej liczby ciężarówek: łączna pojemność rośnie, ale pojawia się planowanie, trasowanie i koordynacja.

Co zwykle wymusza decyzję?

Częste wyzwalacze to:

- Skoki ruchu (kampanie marketingowe, sezonowość, wirusowy wzrost)

- Stały wzrost produktu w ciągu miesięcy lub lat

- Większe zbiory danych (więcej klientów, więcej zdarzeń, więcej historii do przechowania)

Ważny niuans: większość rzeczywistych systemów używa obu podejść

Zespoły często najpierw skalują pionowo, bo to szybkie (upgrade maszyny), a potem przechodzą do skalowania poziomego, gdy pojedyncza maszyna osiąga limit lub gdy potrzeba wyższej dostępności. Dojrzałe architektury zwykle łączą oba podejścia: większe węzły i więcej węzłów, w zależności od wąskiego gardła.

Dlaczego skalowanie pionowe wydaje się prostsze

Skalowanie pionowe jest atrakcyjne, bo trzyma system w jednym miejscu. Przy pojedynczym węźle często masz jedno źródło prawdy dla pamięci i lokalnego stanu. Jeden proces posiada cache w pamięci, kolejkę zadań, przechowywanie sesji (jeśli sesje są w pamięci) oraz pliki tymczasowe.

Mniej elementów do koordynacji

Na jednym serwerze większość operacji jest prosta, bo prawie nie ma koordynacji między węzłami:

- Debugowanie jest łatwiejsze, bo logi i metryki są w jednym miejscu.

- Awaria jest bardziej jednoznaczna: maszyna albo działa, albo nie.

- Wiele wąskich gardeł jest lokalnych i mierzalnych.

Strojenie wydajności zostaje „lokalne”

Przy skalowaniu pionowym używasz znanych dźwigni: dodajesz CPU/RAM, stosujesz szybszy storage, poprawiasz indeksy, optymalizujesz zapytania i konfiguracje. Nie musisz projektować na nowo dystrybucji danych ani mechanizmów, w jaki sposób wiele węzłów ma uzgadniać „co dalej”.

Kompromisy, które akceptujesz

Skalowanie pionowe nie jest „za darmo”—po prostu trzyma złożoność w ryzach.

Prędzej czy później trafiasz na limity: największa dostępna instancja, malejące przychody skali lub strome koszty przy bardzo wysokich parametrach. Możesz też zwiększyć ryzyko przestojów: jeśli jeden duży serwer padnie lub będzie serwisowany, duża część systemu może przestać działać, jeśli nie wprowadzono redundancji.

Koszty koordynacji: więcej węzłów, więcej zasad

Przy skalowaniu poziomym nie dostajesz tylko „więcej serwerów”. Dostajesz więcej niezależnych aktorów, którzy muszą się zgadzać, kto jest odpowiedzialny za daną część pracy, kiedy i z jakimi danymi.

Na jednej maszynie koordynacja jest często implikowana: jedna przestrzeń pamięci, jeden proces, jedno miejsce do sprawdzenia stanu. Przy wielu maszynach koordynacja staje się funkcją, którą musisz zaprojektować.

Jak koordynacja wygląda w praktyce

Typowe narzędzia i wzorce to:

- Wybór lidera: wyznaczanie jednego węzła do podejmowania decyzji (np. który worker przetworzy następne zadanie). Jeśli lider padnie, wszyscy muszą uzgodnić zastępstwo.

- Blokady/lease’y: zapewniają, że tylko jeden węzeł wykona zadanie w danym czasie (np. wysłanie faktury). Lease’y wygasają, zegary dryfują i „kto trzyma blokadę” może stać się sporne.

- Systemy konsensusu: niewielka grupa węzłów utrzymuje zgodny widok krytycznego stanu (konfiguracja, członkostwo, liderstwo). Potężne, ale wymagające operacyjnie.

Objawy, gdy koordynacja zawodzi

Błędy koordynacyjne rzadko wyglądają jak czyste awarie. Częściej zobaczysz:

- Warunki wyścigu: dwa węzły operują na tych samych danych w złej kolejności.

- Podwójna praca: to samo zadanie wykonuje się dwa razy, bo dwa workery sądzą, że jest nieprzypisane.

- Split‑brain: przerwa w sieci powoduje powstanie dwóch „liderów”, każdy podejmuje sprzeczne decyzje.

Te problemy często ujawniają się dopiero pod prawdziwym obciążeniem, podczas wdrożeń lub przy częściowych awariach (jeden węzeł jest wolny, przełącznik traci pakiety, jedna strefa ma fluktuacje). System wygląda dobrze — dopóki nie zostanie wystresowany.

Partycjonowanie danych i sharding są trudne do zrobienia poprawnie

Przy skalowaniu poziomym często nie da się trzymać wszystkich danych w jednym miejscu. Dzielisz je między maszyny (shardy), żeby wiele węzłów mogło równolegle przechowywać i serwować żądania. Ten podział to źródło złożoności: każdy odczyt i zapis zależy od tego, „który shard przechowuje ten rekord?”.

Popularne strategie: partycjonowanie zakresowe vs haszowe

Partycjonowanie zakresowe grupuje dane według uporządkowanego klucza (np. użytkownicy A–F na shardzie 1, G–M na shardzie 2). Jest intuicyjne i dobrze wspiera zapytania zakresowe („pokaż zamówienia z ostatniego tygodnia”). Wadą jest nierównomierne obciążenie: jeśli jeden zakres stanie się popularny, ten shard stanie się wąskim gardłem.

Partycjonowanie hashowe przepuszcza klucz przez funkcję hashującą i rozdziela wyniki po shardach. Rozkłada ruch równiej, ale utrudnia zapytania zakresowe, ponieważ powiązane rekordy są rozrzucone.

Rebalansowanie nie jest darmowe

Dodaj węzeł i chcesz go wykorzystać — część danych musi się przenieść. Usuń węzeł (planowo albo przez awarię) i inne shardy muszą przejąć jego dane. Rebalans może wygenerować duże transfery, rozgrzewanie cache’ów i tymczasowe spadki wydajności. W trakcie przenoszenia trzeba też zapobiegać przestarzałym odczytom i błędnym zapisom.

Gorące partycje i skew

Nawet przy hashowaniu ruch rzadko jest równomierny. Konto celebryty, popularny produkt czy wzorce czasowe mogą skupić odczyty/zapisy na jednym shardzie. Jeden gorący shard może ograniczać przepustowość całego systemu.

Praca operacyjna, której nie da się zignorować

Sharding wprowadza stałe obowiązki: utrzymanie reguł routingu, prowadzenie migracji, wykonywanie backfilli po zmianach schematu oraz planowanie podziałów/scalenia shardów bez łamania klientów.

Stan: sesje, cache i praca w tle

Eksploruj bezpieczne skalowanie poziome

Testuj wzorce bezstanowe i pomysły na wspólny stan bez budowania pełnego pipeline'u.

Przy skalowaniu poziomym nie dodajesz tylko serwerów — dodajesz kopie aplikacji. Trudna część to stan: wszystko, co aplikacja „pamięta” między żądaniami lub w trakcie pracy.

Sesje: gdzie przechowywane jest logowanie?

Jeśli użytkownik loguje się na Serwerze A, a jego kolejne żądanie trafi na Serwer B, czy B wie, kim jest?

- Sticky sessions kierują użytkownika do tego samego serwera. Proste, ale kruche: restarty i nierównomierne obciążenie stają się widoczne dla użytkownika.

- Wspólny magazyn sesji (Redis lub baza) pozwala każdemu serwerowi obsłużyć każde żądanie. Bardziej niezawodne — ale dodaje koszt i zależność. Jeśli magazyn sesji się spowolni, cała aplikacja wydaje się wolna.

Cache: szybkie, dopóki się nie rozbiegną

Cache przyspiesza działanie, ale wiele serwerów oznacza wiele cache’y. Pojawiają się wtedy problemy:

- Inwalidacja: gdy dane się zmieniają, jak sprawić, by wszystkie cache’e przestały serwować stare wartości?

- Spójność: węzły mogą przez krótkie okna nie zgadzać się co do „prawdy”.

- Różne trafienia: jeden serwer może mieć „rozgrzany” cache, inny być zimny — prowadzi to do niestabilnej wydajności.

Praca w tle: unikanie podwójnego przetwarzania

Przy wielu workerach zadania w tle mogą wykonać się dwukrotnie, jeśli nie zaprojektujesz zabezpieczeń. Zwykle potrzebujesz kolejki, lease’ów/blokad albo idempotentnej logiki zadań, aby „wysyłanie faktury” czy „pobranie opłaty” nie zdublowało się, zwłaszcza podczas retry i restartów.

Problemy spójności i współbieżności mnożą się

Przy jednym węźle (albo jednym primary DB) zwykle istnieje jasne „źródło prawdy”. Przy skalowaniu poziomym dane i żądania rozpraszają się po maszynach i utrzymanie synchronizacji staje się stałym wyzwaniem.

Silna vs eventual consistency (prosto)

- Silna spójność: po udanym zapisie każdy czytelnik natychmiast widzi najnowszą wartość.

- Eventual consistency: aktualizacje są propagowane i przez krótki czas niektórzy czytelnicy mogą widzieć stare wartości.

Eventual consistency jest często szybsza i tańsza przy skali, ale wprowadza zaskakujące przypadki brzegowe.

Co się psuje w realnych systemach

Typowe problemy to:

- Przestarzałe odczyty: użytkownik zmieni adres, odświeża stronę i dalej widzi stary.

- Konflikty zapisu: dwie aktualizacje niemal jednocześnie nadpisują się wzajemnie.

- Utracone aktualizacje: „ostatni zapis wygrywa” i cicha utrata zmian, które powinny były zostać scalone.

Wzorce, które ograniczają szkody

Nie da się wyeliminować awarii, ale można projektować pod nie:

- Klucze idempotencji: ponowienia „create payment” nie powodują podwójnego naliczenia.

- Retry z backoffem: powtarzaj po 200ms, potem 400ms, potem 800ms (z jitterem), żeby uniknąć szturmu.

- Deduplikacja: gdy wiadomość przyjdzie dwa razy, przetwórz ją tylko raz.

Dlaczego transakcje rozproszone są trudne

Transakcja obejmująca wiele usług (zamówienie + stan magazynu + płatność) wymaga, żeby wiele systemów się zgodziło. Jeśli jeden krok zawiedzie w połowie, potrzebujesz kompensujących działań i starannego rozliczenia. Klasyczne „wszystko albo nic” jest trudne, gdy sieci i węzły zawodzą niezależnie.

Gdzie silna spójność ma największe znaczenie

Stosuj silną spójność tam, gdzie poprawność jest krytyczna: płatności, salda kont, stany magazynowe, rezerwacje miejsc. Dla mniej krytycznych danych (analityka, rekomendacje) eventual consistency bywa akceptowalna.

Sieć: opóźnienia, timeouty i retry

Przy skalowaniu pionowym wiele „wywołań” to wywołania funkcji w tym samym procesie: szybkie i przewidywalne. Przy skalowaniu poziomym te same interakcje stają się wywołaniami sieciowymi—dodając opóźnienia, jitter i nowe tryby awarii, które kod musi obsłużyć.

Opóźnienie to nie tylko „trochę wolniej”

Wywołania sieciowe mają stałe narzuty (serializacja, kolejkowanie, przeskoki) i zmienne (kongestia, routing, noisy neighbors). Nawet jeśli średnie opóźnienie jest OK, ogon (najwolniejsze 1–5%) może dominować doświadczenie użytkownika, bo pojedyncze wolne zależności blokują całe żądanie.

Przepustowość i utrata pakietów także stają się ograniczeniami: przy dużym ruchu „małe” payloady sumują się, a retransmisje cicho zwiększają obciążenie.

Timeouty, retry i burze retry

Bez timeoutów wolne wywołania się kumulują, a wątki zostają zablokowane. Z timeoutami i retry można się podnieść—dopóki retry nie zwiększają obciążenia.

Częsty wzorzec awarii to burza retry: backend zwalnia, klienci timeoutują i retryują, retry zwiększają obciążenie, a backend staje się jeszcze wolniejszy.

Bezpieczniejsze retry wymagają zwykle:

- konserwatywnych timeoutów opartych na rzeczywistych danych o latencji

- ograniczonych retry (często 0–1) z wykładniczym backoffem i jitterem

- jasnych reguł, co jest bezpieczne do ponawiania (operacje idempotentne)

Load balancery i discovery usług

Przy wielu instancjach klienci muszą wiedzieć, gdzie wysyłać żądania—przez load balancer albo discovery usług z balansowaniem po stronie klienta. To dodaje ruchome elementy: health checki, draining połączeń, nierównomierne rozłożenie ruchu i ryzyko routingu do częściowo zepsutej instancji.

Backpressure i limitowanie

Aby zapobiec rozprzestrzenianiu się przeciążenia, potrzebujesz backpressure: ograniczonych kolejek, circuit breakerów i limitowania. Celem jest szybkie i przewidywalne odrzucanie zamiast pozwalać, by niewielkie spowolnienie zamieniło się w incydent w całym systemie.

Tryby awarii się zmieniają: częściowa awaria staje się normą

Zaplanuj ruchy skalowania

Naszkicuj plan skalowania pionowego kontra poziomego w Koder.ai zanim zaczniesz przepisywać architekturę.

Skalowanie pionowe zwykle zawodzi w prosty sposób: jedna większa maszyna może być pojedynczym punktem awarii. Jeśli zwolni lub padnie, wpływ jest oczywisty.

Skalowanie poziome zmienia kalkulacje. Przy wielu węzłach normalne staje się, że niektóre maszyny są niezdrowe, podczas gdy inne działają. System jest „dostępny”, ale użytkownicy widzą błędy, wolne strony lub niespójne zachowanie. To jest częściowa awaria, i staje się stanem, na który projektujesz system.

Jak częściowe awarie prowadzą do kaskady

W rozproszonym setupie usługi zależą od innych: baz danych, cache’y, kolejek i zewnętrznych API. Mały problem może rozlać się:

- Jeden węzeł nie może połączyć się z DB → zaczyna retryować agresywnie

- Retries zwiększają obciążenie DB → rośnie latencja dla wszystkich

- Wyższa latencja wywołuje kolejne timeouty → kolejne retry → jeszcze większe obciążenie

- Kolejki się zapełniają, cache’e słabną, a downstream API są zalewane

Redundancja pomaga, ale dodaje reguły

Aby przetrwać częściowe awarie, systemy dodają redundancję:

- Replikacja: wiele kopii danych lub usług

- Kworum: sukces tylko jeśli N z M replik się zgodzi

- Wielostrefowe wdrożenia: rozkład na strefy, żeby jedna strefa nie zabiła wszystkiego

To zwiększa dostępność, ale wprowadza przypadki brzegowe: split‑brain, przestarzałe repliki i decyzje, co robić, gdy nie osiągniesz kworum.

Narzędzia odporności, których będziesz potrzebować

Typowe wzorce to:

- Circuit breaker’y zatrzymujące wywołania do zawodzącej zależności

- Bulkheads izolujące awarie, żeby jeden hałaśliwy komponent nie zatopił wszystkiego

- Degradacja funkcjonalności by serwować prostsze doświadczenie zamiast twardych błędów

Obserwowalność i debugowanie w wielu maszynach

Na jednym serwerze „historia systemu” żyje w jednym miejscu: jeden zestaw logów, jeden wykres CPU, jeden proces do sprawdzenia. Przy skalowaniu poziomym historia jest rozproszona.

Więcej maszyn, więcej brakującego kontekstu

Każdy dodatkowy węzeł to kolejny strumień logów, metryk i śledzeń. Trudność nie polega na zbieraniu danych—tylko na ich korelowaniu. Błąd przy finalizacji zamówienia może zaczynać się na nodzie webowym, wywołać dwie usługi, trafić do cache’u i odczytać konkretny shard — ślady są w różnych miejscach i różnych punktach czasowych.

Problemy stają się także wybiórcze: jedna maszyna ma złą konfigurację, jeden shard jest gorący, jedna strefa ma wyższe opóźnienia. Debugowanie może wydawać się losowe, bo „przez większość czasu działa”.

Śledzenie i identyfikatory korelacji (prosto)

Rozproszone śledzenie to jak dodanie numeru przesyłki do żądania. Identyfikator korelacji to ten numer. Przekazuj go przez usługi i dołączaj do logów, żeby móc wybrać jeden ID i zobaczyć pełną drogę żądania end‑to‑end.

Alerty, które pomagają zamiast przytłaczać

Więcej komponentów zwykle oznacza więcej alertów. Bez strojenia zespoły dostają zmęczenie alertami. Celuj w akcjonowalne alerty, które mówią:

- Co jest zepsute

- Kogo to dotyczy

- Co sprawdzić najpierw

Monitoruj nasycenie, nie tylko błędy

Problemy z pojemnością często pojawiają się zanim nastąpią awarie. Monitoruj sygnały nasycenia takie jak CPU, pamięć, głębokość kolejek i użycie puli połączeń. Jeśli nasycenie pojawia się tylko na podzbiorze węzłów, podejrzewaj problemy z balansowaniem, shardingiem lub dryfem konfiguracji — nie tylko „więcej ruchu”.

Wdrożenia, aktualizacje i rollbacky stają się bardziej ryzykowne

Przy skalowaniu poziomym deploy to już nie „zamień jedną maszynę”. To koordynacja zmian na wielu maszynach przy zachowaniu dostępności usługi.

Rolling updates, canary i blue/green

Wdrożenia w poziomie często używają rolling updates (wymiana node’ów stopniowo), canary (wysyłanie małej części ruchu do nowej wersji) lub blue/green (przełączenie ruchu między dwoma środowiskami). Zmniejszają one blast radius, ale wymagają: przesuwania ruchu, health checków, drenażu połączeń i definicji „wystarczająco dobrego, by iść dalej”.

Różne wersje działają równocześnie

Podczas stopniowego wdrażania stare i nowe wersje działają obok siebie. Taki rozstrzał wersji oznacza, że system musi tolerować mieszane zachowania:

- Nowe węzły wywołujące stare (i odwrotnie)

- Stare klienty trafiające na nowe serwery

- Różne formaty cache’a lub payloadów zadań w locie

Zgodność staje się wymogiem

API muszą mieć kompatybilność wstecz i do przodu, nie tylko poprawność. Zmiany schematu bazy danych powinny być możliwie addytywne (dodaj kolumnę NULL zanim ją wymusisz). Format wiadomości powinien być wersjonowany, żeby konsumenci mogli czytać stare i nowe eventy.

Rollbacki są trudniejsze przy migracjach danych

Cofnięcie kodu jest proste; cofnięcie danych już nie. Jeśli migracja usuwa lub przepisuje pola, starszy kod może się załamać lub niewłaściwie obsłużyć rekordy. Migruj w trybie „rozszerz/zwężaj”: wdroż kod obsługujący oba schematy, przenieś dane, potem usuń stare ścieżki.

Konfiguracja i sekrety muszą być spójne

Przy wielu węzłach zarządzanie konfiguracją staje się częścią deployu. Jeden węzeł ze starą konfiguracją, złymi flagami funkcji lub przeterminowanymi poświadczeniami może generować trudne do powtórzenia awarie.

Koszty i złożoność zespołu często rosną wraz ze skalowaniem poziomym

Wysyłaj podczas nauki

Wystaw aplikację webową, serwerową lub mobilną i iteruj w miarę pojawiania się wąskich gardeł.

Skalowanie poziome może wyglądać taniej na papierze: wiele małych instancji z niską ceną godzinową. Ale całkowity koszt to nie tylko compute. Dodanie węzłów oznacza też więcej sieci, więcej monitoringu, więcej koordynacji i więcej czasu spędzonego na utrzymaniu spójności.

Kilka dużych maszyn kontra wiele małych instancji

Skalowanie pionowe koncentruje wydatki w mniejszej liczbie hostów — zwykle mniej hostów do patchowania, mniej agentów do uruchomienia, mniej logów do wysyłki, mniej metryk do zbierania.

Przy skali poziomej cena jednostkowa może być niższa, ale często płacisz też za:

- Load balancery, service discovery i dodatkowy transfer sieciowy

- Więcej replik by osiągnąć cele wydajności i dostępności

- Wyższy baseline pojemności, bo potrzebujesz zapasu na wielu warstwach, nie tylko w jednym miejscu

Wykorzystanie i nadprovisioning

Żeby bezpiecznie obsłużyć szczyty, systemy rozproszone często działają poniżej pełnego wykorzystania. Trzymasz zapas na wielu poziomach (web, worker, DB, cache), co może oznaczać płacenie za bezczynność na wielu instancjach.

Koszty operacyjne: ukryty mnożnik

Skalowanie poziome zwiększa obciążenie on‑call i wymaga dojrzałych narzędzi: strojenia alertów, playbooków, ćwiczeń incidentowych i szkoleń. Zespoły też poświęcają czas na wyznaczanie granic odpowiedzialności (kto jest właścicielem której usługi?) i koordynację incydentów.

Efekt: „tańsze za jednostkę” wciąż może być droższe w sumie, gdy doliczysz koszt ludzi, ryzyko operacyjne i pracę potrzebną, by wiele maszyn zachowywało się jak jeden system.

Jak wybrać: skalować pionowo czy poziomo

Wybór między skalowaniem pionowym (większa maszyna) a poziomym (więcej maszyn) to nie tylko kwestia ceny. To kwestia charakteru obciążenia i tego, ile złożoności operacyjnej zespół może udźwignąć.

Kryteria, które naprawdę mają znaczenie

Zacznij od charakteru obciążenia:

- Typ pracy: zadania obciążające CPU zwykle korzystają na skala w górę; ruch webowy z dużą liczbą żądań zazwyczaj lepiej skaluje się poziomo za load balancerem.

- Stanowość: jeśli żądania zależą od lokalnego stanu (sesje, cache, praca w toku), skalowanie poziome zmusza do przebudowy miejsca przechowywania stanu.

- Wymagania spójności: gdy poprawność jest kluczowa (płatności, stan magazynu), skalowanie poziome wprowadza trudniejsze kompromisy w zakresie współbieżności i spójności.

- Tempo wzrostu i skoki: przewidywalny wzrost można obsłużyć skalując pionowo stopniowo; nieprzewidywalne szczyty mogą wymusić zdolność poziomą.

Praktyczna ścieżka (która oszczędza czas)

Powszechna rozsądna kolejność:

- Optymalizuj oczywiste wąskie gardła (wolne zapytania, brak indeksów, nieefektywne endpointy).

- Skaluj pionowo najpierw (większa VM/DB), bo zmienia mniej założeń.

- Skaluj poziomo gdy pojedynczy węzeł naprawdę staje się ograniczeniem — albo gdy potrzebujesz dostępności, której jedna maszyna nie zapewni.

Wzorce hybrydowe są normalne

Wiele zespołów trzyma bazę danych pionowo (lub lekko sklastrowaną), a warstwę bezstanową (aplikacyjną) skaluje poziomo. To ogranicza ból shardowania, a jednocześnie pozwala szybko zwiększać pojemność webową.

Sygnały, że jesteś gotowy na skalowanie poziome

Jesteś bliżej, gdy masz solidny monitoring i alerty, przetestowany failover, testy obciążeniowe i powtarzalne wdrożenia z bezpiecznymi rollbackami.

Pytania przed podjęciem decyzji

- Czy możemy osiągnąć cele przez optymalizację lub skalowanie pionowe przez następne 6–12 miesięcy?

- Gdzie będą przechowywane sesje, cache i zadania w tle?

- Czy potrzebujemy silnej spójności i jakie awarie są akceptowalne?

- Jaki mamy plan partycjonowania danych (jeśli w ogóle) i rebalansowania?

- Czy mamy narzędzia do debugowania problemów na wielu węzłach?

Gdzie Koder.ai pomaga (praktyczna pomoc bez wymyślania wszystkiego od nowa)

Wiele bólu skalowania to nie tylko „architektura” — to pętla operacyjna: iterować bezpiecznie, wdrażać niezawodnie i szybko cofać, gdy rzeczy nie idą zgodnie z planem.

Jeśli budujesz aplikacje webowe, backendy lub mobilne i chcesz poruszać się szybko bez utraty kontroli, Koder.ai może pomóc w prototypowaniu i szybszym wydawaniu, jednocześnie wspierając decyzje dotyczące skalowania. To platforma vibe‑coding, gdzie budujesz aplikacje przez czat, z architekturą opartą na agentach pod spodem. W praktyce oznacza to, że możesz:

- Szybko postawić aplikację React, backend Go + PostgreSQL lub Flutter mobile i iterować w miarę odkrywania wąskich gardeł.

- Użyć trybu planowania, by przemyśleć zmiany „skala w górę kontra skalowanie poziome” zanim je wprowadzisz.

- Zmniejszyć ryzyko wdrożeń dzięki snapshotom i rollbackom, co ma większe znaczenie, gdy dodajesz węzły i pojawia się rozstrzał wersji.

- Wyeksportować kod źródłowy, gdy będziesz gotowy przenieść się do własnego pipeline’u, oraz wdrażać/hostować z własnymi domenami.

Ponieważ Koder.ai działa globalnie na AWS, może także wspierać wdrożenia w różnych regionach, by sprostać wymaganiom opóźnień i transferu danych — przydatne, gdy wielostrefowa lub wieloregionalna dostępność staje się częścią historii skalowania.

Często zadawane pytania

What’s the difference between vertical scaling and horizontal scaling?

Skalowanie pionowe oznacza powiększenie pojedynczej maszyny (więcej CPU/RAM/szybszy dysk). Skalowanie poziome to dodanie kolejnych maszyn i rozdzielenie pracy między nie.

Skalowanie pionowe często wydaje się prostsze, bo aplikacja nadal zachowuje się jak „jeden system”, natomiast skalowanie poziome wymaga, żeby wiele systemów się ze sobą koordynowało i zachowywało spójność.

Why does horizontal scaling introduce more complexity than vertical scaling?

W momencie, gdy masz wiele węzłów, pojawia się potrzeba jawnej koordynacji:

- ustalenia, kto zajmuje się którym zadaniem

- zapobiegania podwójnemu przetwarzaniu

- radzenia sobie z opóźnieniami sieci i częściowymi awariami

Pojedyncza maszyna naturalnie unika wielu z tych problemów rozproszonych, dlatego poziome skalowanie wydaje się trudniejsze.

What is “coordination overhead” in a scaled-out system?

To czas i logika potrzebne, żeby wiele maszyn zachowywało się jak jedna:

- wybór lidera i reguły failover

- blokady/lease’y i problemy z dryfem zegarów

- unikanie split‑brain

Nawet gdy każdy węzeł jest prosty, zachowanie całego systemu staje się trudniejsze do przewidzenia pod obciążeniem i podczas awarii.

Why are sharding and data partitioning so difficult to get right?

Sharding (partycjonowanie) dzieli dane pomiędzy węzły, żeby żadna pojedyncza maszyna nie musiała przechowywać i obsługiwać wszystkiego. To jest trudne, bo musisz:

- kierować każde odczyt/zapis do właściwego sharda

- przeprowadzać rebalans przy dodawaniu/usuwaniu węzłów

- radzić sobie z „gorącymi” shardami, które stają się wąskim gardłem

To też zwiększa pracę operacyjną (migracje, backfille, mapy shardów).

What does “state” mean, and why does it matter for scaling out?

Stan to wszystko, co aplikacja „pamięta” między żądaniami lub podczas przetwarzania (sesje, cache w pamięci, pliki tymczasowe, postęp zadań).

Przy skalowaniu poziomym żądania mogą trafić na różne serwery, więc zwykle potrzebujesz wspólnego miejsca na stan (np. Redis/baza) albo akceptujesz kompromisy jak sticky sessions.

How do you prevent background jobs from running twice when scaling out?

Gdy wielu workerów może pobrać to samo zadanie (albo zadanie jest powtarzane), istnieje ryzyko np. podwójnego naliczenia opłaty czy wysłania tej samej wiadomości.

Typowe sposoby zapobiegania temu:

- idempotentne handlersy zadań

- blokady/lease’y przy przydziale zadań

- deduplikacja oparta na unikalnych ID zadań

- ostrożne polityki retry z backoffem

What’s the practical difference between strong and eventual consistency?

Silna spójność oznacza, że po zatwierdzeniu zapisu wszyscy czytelnicy od razu widzą najnowszą wartość. Kwestia „eventual consistency” polega na tym, że aktualizacje rozchodzą się z opóźnieniem i przez krótki czas niektórzy czytelnicy mogą widzieć przestarzałe dane.

Używaj silnej spójności tam, gdzie poprawność jest krytyczna (płatności, salda, stan magazynu). Dla danych mniej krytycznych (analityka, rekomendacje) eventual consistency często wystarcza.

Why do timeouts and retries become a bigger deal with horizontal scaling?

W systemie rozproszonym wywołania stają się wywołaniami sieciowymi, co dodaje opóźnień, jittera i nowe tryby awarii.

Zasadnicze praktyki:

- ustawiaj time‑outy, żeby wątki się nie blokowały

- ograniczaj retry i stosuj wykładniczy backoff z jitterem

- retryuj tylko bezpieczne (idempotentne) operacje, żeby nie powodować duplikatów

What is “partial failure,” and why is it normal at scale?

Partial failure to sytuacja, w której niektóre komponenty są zepsute lub wolne, a inne działają poprawnie. System może być „up”, a mimo to generować błędy, opóźnienia lub niespójności.

Reakcje projektowe obejmują replikację, kworum, wdrożenia wielostrefowe, circuit breaker’y i degradację funkcjonalności, by awarie nie eskalowały.

How do you debug issues when your app runs on many servers?

Przy wielu maszynach ślady są rozproszone: logi, metryki i śledzenia znajdują się na różnych węzłach.

Praktyczne kroki:

- używaj identyfikatorów korelacji end‑to‑end

- wdrażaj rozproszone śledzenie (tracing), by zobaczyć ścieżkę żądania

- alertuj na sygnały nasycenia (CPU, głębokość kolejek, pulę połączeń), nie tylko na błędy