07 sie 2025·8 min

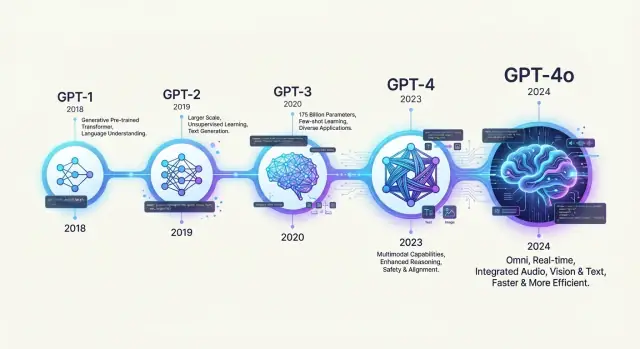

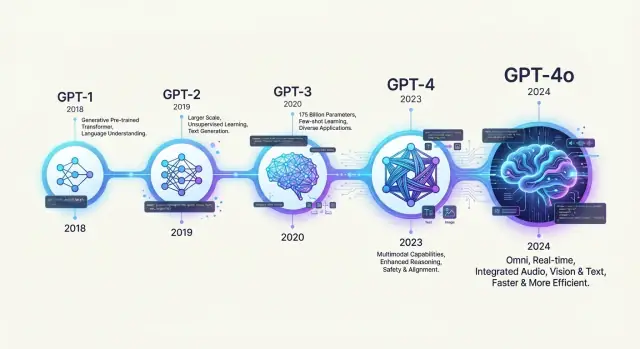

Od GPT-1 do GPT-4: historia modeli GPT firmy OpenAI

Poznaj historię modeli GPT firmy OpenAI — od GPT-1 do GPT-4o — i zobacz, jak każda generacja rozwijała rozumienie języka, użyteczność i kwestie bezpieczeństwa.

Poznaj historię modeli GPT firmy OpenAI — od GPT-1 do GPT-4o — i zobacz, jak każda generacja rozwijała rozumienie języka, użyteczność i kwestie bezpieczeństwa.

Modele GPT to rodzina dużych modeli językowych zaprojektowanych do przewidywania następnego słowa w sekwencji tekstu. Czytają ogromne ilości tekstu, uczą się wzorców użycia języka, a następnie wykorzystują te wzorce do generowania nowego tekstu, odpowiadania na pytania, pisania kodu, streszczania dokumentów i wielu innych zadań.

Samo rozwinięcie akronimu wyjaśnia centralny pomysł:

Zrozumienie, jak te modele ewoluowały, pomaga pojąć, co potrafią, czego nie potrafią i dlaczego każde kolejne wydanie wydaje się znacznym skokiem możliwości. Każda wersja odzwierciedla konkretne wybory techniczne i kompromisy dotyczące rozmiaru modelu, danych treningowych, celów i prac nad bezpieczeństwem.

Ten artykuł przedstawia chronologiczny, ogólny przegląd: od wczesnych modeli językowych i GPT-1, przez GPT-2 i GPT-3, do dostrajania do instrukcji i ChatGPT, aż po GPT-3.5, GPT-4 i rodzinę GPT-4o. Po drodze omówimy główne trendy techniczne, zmiany w sposobie użycia oraz to, co te przemiany sugerują o przyszłości dużych modeli językowych.

Zanim pojawił się GPT, modele językowe już odgrywały kluczową rolę w badaniach NLP. Wczesne systemy to były modele n‑gramowe, które przewidywały następne słowo na podstawie stałego okna poprzednich słów, używając prostych zliczeń. Napędzały korektę pisowni i podstawowe uzupełnianie, ale miały trudności z kontekstem na dużą odległość i rzadkością danych.

Kolejnym krokiem były neuronowe modele językowe. Sieci feed‑forward, a później rekurencyjne sieci neuronowe (RNN), zwłaszcza LSTM i GRU, uczyły rozproszonych reprezentacji słów i w teorii mogły obsłużyć dłuższe sekwencje. W tym samym czasie popularne stały się modele takie jak word2vec i GloVe, które pokazały, że uczenie bez nadzoru na surowym tekście może wychwycić bogatą strukturę semantyczną.

Jednak RNN były wolne w trenowaniu, trudne do równoległego uruchomienia i wciąż miały problemy z bardzo długimi kontekstami. Przełom nastąpił wraz z pracą z 2017 r. "Attention Is All You Need", która wprowadziła architekturę transformera. Transformatory zastąpiły rekurencję mechanizmem self‑attention, umożliwiając bezpośrednie powiązania między dowolnymi pozycjami w sekwencji i sprawiając, że trening stał się wysoce równoległy.

To otworzyło drzwi do skalowania modeli językowych daleko poza to, co było możliwe z RNN. Badacze zaczęli dostrzegać, że duży transformer trenowany do przewidywania następnego tokena na ogromnych korpusach tekstu może nauczyć się składni, semantyki, a nawet pewnych umiejętności rozumowania bez nadzoru specyficznego dla zadania.

Kluczową ideą OpenAI było sformalizowanie tego jako generative pre‑training: najpierw wytrenować duży decoder‑only transformer na szerokim, internetowym korpusie, aby modelować tekst, a następnie dostosować ten sam model do zadań docelowych przy minimalnym dodatkowym treningu. To podejście obiecywało pojedynczy model ogólnego przeznaczenia zamiast wielu wąskich modeli.

Ta zmiana koncepcyjna — od małych, zadaniowo‑specyficznych systemów do dużego, generatywnie wstępnie trenowanego transformera — przygotowała grunt pod pierwszy model GPT i całą serię następnych wydań.

GPT-1 był pierwszym krokiem OpenAI w kierunku serii GPT, którą znamy dziś. Opublikowany w 2018 r., miał 117 milionów parametrów i opierał się na architekturze Transformera z 2017 r. Choć był mały w porównaniu z późniejszymi modelami, skondensował podstawowy przepis, którym kierowały się wszystkie późniejsze wersje.

GPT-1 trenowano według prostego, ale skutecznego pomysłu:

Do pre‑treningu GPT-1 uczył się przewidywać następny token na tekstach pochodzących głównie z BooksCorpus i źródeł w stylu Wikipedii. Ten cel — przewidywanie następnego słowa — nie wymagał etykiet od ludzi, co pozwoliło modelowi przyswoić szeroką wiedzę o języku, stylu i faktach.

Po wstępnym treningu ten sam model był dostrajany z nadzorem na klasycznych benchmarkach NLP: analiza sentymentu, odpowiadanie na pytania, rozumienie implikatur tekstowych i inne. Dodawano małą główkę klasyfikacyjną i trenowano model end‑to‑end lub jego większość na każdym z tych zestawów.

Kluczowe było to, że ten sam wstępnie wytrenowany model można było lekko zaadaptować do wielu zadań, zamiast trenować oddzielny model dla każdego zadania od zera.

Mimo stosunkowo niewielkiego rozmiaru GPT-1 przyniósł istotne odkrycia:

GPT-1 pokazał też wstępne przejawy generalizacji zero‑shot i few‑shot, choć wciąż większość ocen opierała się na dostrajaniu do konkretnego zadania.

GPT-1 nie był skierowany do masowego wdrożenia ani szerokiego API deweloperskiego. Kilka czynników zatrzymało go w obszarze badań:

Mimo to GPT-1 ustanowił wzorzec: generatywne wstępne trenowanie na dużych korpusach tekstu, a następnie proste dostrajanie do zadań. Każdy późniejszy model GPT można traktować jako skalowanego, dopracowanego i coraz bardziej zdolnego potomka tego pierwszego transformera.

GPT-2, wydany w 2019 r., to pierwszy model z rodziny GPT, który naprawdę przyciągnął globalną uwagę. Zwiększył skalę architektury GPT-1 z 117 milionów parametrów do 1,5 miliarda, pokazując, jak daleko może zaprowadzić proste skalowanie transformera.

Architekturalnie GPT-2 był bardzo podobny do GPT-1: dekoder‑only transformer trenowany do przewidywania następnego tokena na dużym korpusie tekstów z internetu. Kluczową różnicą była skala:

Ten skok w rozmiarze dramatycznie poprawił płynność, spójność na dłuższych fragmentach i zdolność do podążania za promptami bez specjalistycznego treningu.

GPT-2 sprawił, że wielu badaczy przemyślało, co potrafi „tylko” przewidywanie następnego tokena.

Bez żadnego dostrajania GPT-2 potrafił w trybie zero‑shot wykonywać zadania takie jak:

Dodanie kilku przykładów w promptcie (few‑shot) często znacząco poprawiało rezultaty. To sugerowało, że duże modele językowe mogą w sposób wewnętrzny reprezentować szeroki zakres zadań, używając przykładów w kontekście jako implicitnego „programowania”.

Imponująca jakość generacji wywołała jedne z pierwszych dużych publicznych debat o modelach językowych. OpenAI początkowo wstrzymało pełne udostępnienie modelu 1,5B, argumentując obawami dotyczącymi:

Zamiast jednorazowego wypuszczenia pełnego modelu, przyjęto etapowe udostępnianie:

To inkrementalne podejście było jednym z pierwszych przykładów polityki wdrożeniowej AI opartej na ocenie ryzyka i monitoringu.

Nawet mniejsze checkpointy GPT-2 wywołały falę projektów open source. Deweloperzy dostrajali modele do twórczego pisania, autouzupełniania kodu i eksperymentalnych chatbotów. Badacze analizowali uprzedzenia, błędy faktograficzne i tryby awarii.

Te eksperymenty zmieniły sposób, w jaki wiele osób postrzegało modele językowe: z niszowych artefaktów badawczych w kierunku uniwersalnych silników tekstu. Wpływ GPT-2 ustawił oczekiwania — i podniósł obawy — które ukształtowały odbiór GPT-3, ChatGPT i późniejszych modeli klasy GPT-4.

GPT-3 pojawił się w 2020 r. z imponującą liczbą 175 miliardów parametrów, ponad 100 razy większą niż GPT-2. Ta liczba przyciągnęła uwagę: sugerowała ogromną zdolność zapamiętywania, ale ważniejsze było to, że otworzyła zachowania wcześniej nieobserwowane w tej skali.

Kluczowym odkryciem przy GPT-3 było in‑context learning. Zamiast dostrajania modelu do nowych zadań, wystarczyło wkleić kilka przykładów w prompt:

Model nie aktualizował wag; używał promptu jako tymczasowego zbioru treningowego. To doprowadziło do pojęć typu zero‑shot, one‑shot i few‑shot prompting oraz zapoczątkowało pierwszą falę prompt engineering: staranne formułowanie instrukcji, przykładów i formatowania, by uzyskać lepsze zachowanie bez zmiany modelu.

W przeciwieństwie do GPT-2, którego wagi były do pobrania, GPT-3 udostępniono głównie przez komercyjne API. OpenAI uruchomiło prywatne beta API w 2020 r., pozycjonując GPT-3 jako uniwersalny silnik tekstowy, do którego deweloperzy mogli wysyłać zapytania przez HTTP.

To przesunęło wielkie modele językowe z niszowych artefaktów badawczych do platformy dostępnej szeroko. Zamiast trenować własne modele, startupy i przedsiębiorstwa mogły prototypować pomysły z jednym kluczem API, płacąc za tokeny.

Wczesni użytkownicy szybko odkryli wzorce, które stały się standardowe:

GPT-3 pokazał, że pojedynczy, ogólny model — dostępny przez API — może zasilać szeroką gamę aplikacji i przygotował grunt pod ChatGPT oraz późniejsze systemy GPT-3.5 i GPT-4.

Bazowy GPT-3 trenowany był jedynie do przewidywania następnego tokena na tekście z internetu. Ten cel czynił go dobrym w kontynuowaniu wzorców, ale niekoniecznie w robieniu tego, o co proszą ludzie. Użytkownicy często musieli bardzo precyzyjnie formułować prompt, a model mógł:

Badacze nazwali tę różnicę między tym, czego chcą użytkownicy, a tym, co robi model, problemem alignmentu: zachowanie modelu nie było niezawodnie zgodne z ludzkimi intencjami, wartościami czy oczekiwaniami bezpieczeństwa.

OpenAI‑owski InstructGPT (2021–2022) był punktem zwrotnym. Zamiast trenować wyłącznie na surowym tekście, dodano dwa kluczowe etapy do GPT-3:

To dało modele, które:

W badaniach użytkowników, mniejsze modele InstructGPT były preferowane nad znacznie większymi bazowymi modelami GPT-3, co pokazało, że alignment i jakość interfejsu mogą znaczyć więcej niż sama skala.

ChatGPT (koniec 2022) rozszerzył podejście InstructGPT na dialog wielo‑tornowy. Był to model klasy GPT-3.5, dostrojony z użyciem SFT i RLHF na danych konwersacyjnych zamiast jednorazowych instrukcji.

Zamiast API lub playgroundu skierowanego do deweloperów, OpenAI uruchomiło prosty interfejs czatu:

To obniżyło próg wejścia dla użytkowników nietechnicznych. Bez znajomości prompt engineering, bez kodu — po prostu wpisujesz i otrzymujesz odpowiedź.

Efektem był przełom dla mas: technologia oparta na latach badań nad transformerami i alignmentem stała się dostępna dla każdego z przeglądarką. Dostrajanie do instrukcji i RLHF sprawiły, że system był wystarczająco kooperatywny i bezpieczny do szerokiego udostępnienia, a interfejs czatu przekształcił model badawczy w produkt codziennego użytku.

GPT-3.5 oznacza moment, gdy duże modele językowe przestały być głównie ciekawostką badawczą, a zaczęły pełnić rolę narzędzi użytkowych. Leżał między GPT-3 a GPT-4 pod względem zdolności, ale jego realna waga polegała na dostępności i praktyczności.

Technicznie GPT-3.5 udoskonalił architekturę GPT-3 dzięki lepszym danym treningowym, zaktualizowanej optymalizacji i szerokiemu dostrajaniu do instrukcji. Modele z tej serii, w tym text-davinci-003 i później gpt-3.5-turbo, były trenowane, by lepiej wykonywać polecenia w języku naturalnym, odpowiadać bezpieczniej i utrzymywać spójne wielo‑tornowe rozmowy.

To uczyniło GPT-3.5 naturalnym krokiem do GPT-4. Zapowiadał on wzorce definiujące kolejne generacje: lepsze rozumowanie w codziennych zadaniach, lepsze radzenie sobie z dłuższymi promptami i stabilniejsze zachowanie dialogowe, wszystko to bez pełnego skoku złożoności i kosztów związanych z GPT-4.

Pierwsze publiczne wydanie ChatGPT pod koniec 2022 r. napędzane było modelem klasy GPT-3.5 dopracowanym z użyciem RLHF. To znacząco poprawiło, jak model:

Dla wielu ludzi ChatGPT był pierwszym kontaktem z dużym modelem językowym i ustawił oczekiwania, jak powinien wyglądać „AI czat”.

Gdy OpenAI udostępniło gpt-3.5-turbo przez API, zaoferował on atrakcyjne połączenie ceny, szybkości i możliwości. Był tańszy i szybszy od wcześniejszych modeli GPT-3, a jednocześnie lepiej realizował instrukcje i prowadził dialog.

To połączenie sprawiło, że gpt-3.5-turbo stał się domyślnym wyborem dla wielu zastosowań:

GPT-3.5 odegrał więc kluczową rolę przejściową: wystarczająco potężny, by odblokować produkty na skalę, ekonomiczny i na tyle dopasowany do instrukcji, by być użytecznym w codziennych przepływach pracy.

GPT-4, wydany przez OpenAI w 2023 r., oznaczał przesunięcie od „dużego modelu tekstowego” ku asystentowi ogólnego przeznaczenia z lepszym rozumowaniem i wejściami multimodalnymi.

W porównaniu z GPT-3 i GPT-3.5, GPT-4 skupił się mniej na samej liczbie parametrów, a bardziej na:

Flagowe rodziny obejmowały gpt-4 i później gpt-4-turbo, które miały dostarczać podobną lub lepszą jakość przy niższych kosztach i niższej latencji.

Główną nowością GPT-4 była jego multimodalność: poza wejściem tekstowym potrafił też przyjmować obrazy. Użytkownicy mogli:

To sprawiło, że GPT-4 był mniej modelem „tylko dla tekstu”, a bardziej silnikiem rozumowania komunikującym się za pomocą języka.

GPT-4 był też trenowany i dostrajany z większym naciskiem na bezpieczeństwo i alignment:

Modele takie jak gpt-4 i gpt-4-turbo stały się wyborem domyślnym dla zastosowań produkcyjnych: automatyzacji wsparcia klienta, asystentów programistycznych, narzędzi edukacyjnych i wyszukiwania wiedzy. GPT-4 przygotował grunt pod warianty takie jak GPT-4o i GPT-4o mini, które jeszcze bardziej dążyły do efektywności i interakcji w czasie rzeczywistym, zachowując wiele postępów GPT-4 w rozumowaniu i bezpieczeństwie.

GPT-4o ("omni") oznacza przesunięcie od „maksymalnej zdolności bez względu na koszt” w stronę „szybkiego, niedrogiego i zawsze dostępnego”. Został zaprojektowany tak, by dostarczać jakość na poziomie GPT-4 przy znacznie niższych kosztach i z szybkością wystarczającą do doświadczeń interaktywnych.

GPT-4o unifikuje tekst, wizję i audio w jednym modelu. Zamiast łączyć oddzielne komponenty, natively obsługuje:

Ta integracja zmniejsza opóźnienia i złożoność. GPT-4o może odpowiadać w niemal rzeczywistym czasie, strumieniować odpowiedzi „w miarę myślenia” i płynnie przełączać się między modalnościami w trakcie jednej rozmowy.

Kluczowym celem projektowym GPT-4o była efektywność: lepsza wydajność na każdy wydany dolar i niższa latencja na żądanie. To pozwala deweloperom i dostawcom:

Efekt jest taki, że możliwości wcześniej zarezerwowane dla drogich API stają się dostępne dla studentów, hobbystów, małych startupów i zespołów eksperymentujących z AI po raz pierwszy.

GPT-4o mini idzie jeszcze dalej w dostępności, kosztem pewnej utraty szczytowej wydajności. Nadaje się do:

Dzięki niskim kosztom 4o mini można osadzić w wielu miejscach — w aplikacjach, portalach obsługi klienta, narzędziach wewnętrznych czy usługach o ograniczonym budżecie — bez dużego obciążenia kosztowego.

Razem GPT-4o i GPT-4o mini rozszerzają zaawansowane funkcje GPT na zastosowania w czasie rzeczywistym, konwersacyjne i multimodalne, jednocześnie zwiększając dostępność tych funkcji dla większej liczby twórców i użytkowników.

Kilka technicznych nurtów przebiega przez każde wydanie modeli GPT: skalowanie, sprzężenie zwrotne, bezpieczeństwo i specjalizacja. Razem wyjaśniają, dlaczego każde nowe wydanie wydaje się jakościowo inne, a nie tylko większe.

Kluczowe odkrycie stojące za postępem GPT to prawa skalowania: gdy zwiększasz parametry modelu, rozmiar danych i użyty compute w zrównoważony sposób, wydajność zwykle poprawia się gładko i przewidywalnie w wielu zadaniach.

Wczesne modele pokazały, że:

To doprowadziło do systematycznego podejścia:

Surowe modele GPT są potężne, ale obojętne na oczekiwania użytkowników. RLHF przekształca je w pomocnych asystentów:

Z czasem to podejście ewoluowało w kierunku instruction tuning + RLHF: najpierw dostraja się model na wielu parach instrukcja–odpowiedź, potem stosuje RLHF do dopracowania zachowania. Ta kombinacja stanowi podstawę interakcji w stylu ChatGPT.

Wraz ze wzrostem zdolności rosła też potrzeba systematycznych ewaluacji bezpieczeństwa i egzekwowania polityk.

Techniczne wzorce obejmują:

Mechanizmy te są wielokrotnie iterowane: nowe ewaluacje odkrywają tryby awarii, które wracają jako dane treningowe, modele nagrody i filtry.

Wcześniejsze wydania koncentrowały się na jednym „flagowym” modelu z kilkoma mniejszymi wariantami. Z czasem trend przesunął się w stronę rodzin modeli zoptymalizowanych pod różne ograniczenia i zastosowania:

Pod maską odzwierciedla to dojrzały stack: współdzielone architektury bazowe i pipeline’y treningowe, a następnie ukierunkowane dostrajanie i warstwy bezpieczeństwa tworzące portfel produktów zamiast jednego monolitu. Ta strategia multi‑modelowa jest dziś charakterystycznym trendem technicznym i produktowym w ewolucji GPT.

Modele GPT przekształciły AI oparty na języku z narzędzia badawczego w infrastrukturę, na której buduje wiele osób i organizacji.

Dla deweloperów modele GPT działają jak elastyczny „silnik językowy”. Zamiast pisać reguły ręcznie, wysyłają prompt w języku naturalnym i otrzymują tekst, kod lub strukturalne odpowiedzi.

To zmieniło sposób projektowania oprogramowania:

W rezultacie wiele produktów traktuje GPT jako komponent rdzeniowy, a nie dodatek.

Firmy wykorzystują modele GPT wewnętrznie i w produktach skierowanych do klientów.

W środku organizacji zespoły automatyzują triage wsparcia, tworzą szkice e‑maili i raportów, pomagają w programowaniu i QA oraz analizują dokumenty i logi. Na zewnątrz GPT napędza chatboty, copiloty w pakietach produktywności, asystentów kodowania, narzędzia marketingowe i copiloty domenowe dla finansów, prawa czy zdrowia.

API i hostowane produkty umożliwiają dodanie zaawansowanych funkcji językowych bez zarządzania infrastrukturą czy trenowania modeli od podstaw, co obniża barierę wejścia dla małych i średnich organizacji.

Badacze używają GPT do burzy mózgów, generowania kodu do eksperymentów, szkicowania artykułów i dyskusji w języku naturalnym. Nauczyciele i uczniowie korzystają z GPT do wyjaśnień, zadań ćwiczeniowych, korepetycji i wsparcia językowego.

Pisarze, projektanci i twórcy wykorzystują modele do tworzenia konspektów, generowania pomysłów, budowania światów i dopracowywania szkiców. Model rzadko zastępuje twórcę — raczej przyspiesza eksplorację.

Rozpowszechnienie modeli GPT niesie też poważne zagrożenia. Automatyzacja może przesuwać lub eliminować niektóre stanowiska, jednocześnie zwiększając zapotrzebowanie na inne umiejętności. Ponieważ GPT trenuje się na danych ludzkich, może odzwierciedlać i wzmacniać społeczne uprzedzenia, jeśli nie jest odpowiednio ograniczany. Może też generować przekonujące, lecz błędne informacje lub być nadużywany do tworzenia spamu, propagandy i wprowadzających w błąd treści na dużą skalę.

Te ryzyka prowokują prace nad technikami alignmentu, politykami użycia, monitoringiem oraz narzędziami do wykrywania i pochodzenia treści. Równoważenie nowych zastosowań z bezpieczeństwem, uczciwością i zaufaniem pozostaje otwartym wyzwaniem w miarę postępu modeli GPT.

Wraz z rosnącymi zdolnościami modeli GPT, kluczowe pytania przesuwają się z „czy możemy je zbudować?” do „jak powinniśmy je budować, wdrażać i regulować?”

Efektywność i dostępność. GPT-4o i GPT-4o mini zapowiadają przyszłość, w której modele wysokiej jakości działają tanio, na mniejszych serwerach, a w końcu na urządzeniach osobistych. Pytania:

Personalizacja bez przeuczenia. Użytkownicy chcą modeli pamiętających preferencje i styl, nieujawniających danych prywatnych ani nieprzesadnie upraszczających poglądów. Otwarte pytania:

Niezawodność i rozumowanie. Nawet topowe modele nadal halucynują, zawodzą dyskretnie lub zachowują się nieprzewidywalnie przy zmianie rozkładu danych. Badania kierują się ku:

Bezpieczeństwo i alignment w skali. Gdy modele zyskują zdolność działania przez narzędzia i automatyzację, utrzymanie ich zgodności z ludzkimi wartościami — i utrzymanie tej zgodności w miarę aktualizacji — pozostaje otwartym problemem. To obejmuje pluralizm kulturowy: czyje wartości i normy są kodowane i jak radzić sobie z konfliktami?

Regulacje i standardy. Rządy i branżowe organizacje opracowują reguły dotyczące przejrzystości, wykorzystania danych, znakowania i raportowania incydentów. Pytania:

Przyszłe systemy GPT prawdopodobnie będą bardziej wydajne, bardziej spersonalizowane i ściślej zintegrowane z narzędziami i organizacjami. Obok nowych możliwości spodziewajmy się też bardziej sformalizowanych praktyk bezpieczeństwa, niezależnej ewaluacji i jaśniejszych kontroli dla użytkowników. Historia od GPT-1 do GPT-4 pokazuje stały postęp, ale też że rozwój techniczny musi iść w parze z zarządzaniem, wkładem społecznym i ostrożną oceną wpływu w świecie rzeczywistym.

GPT (Generative Pre-trained Transformer) to duże sieci neuronowe trenowane do przewidywania następnego słowa w sekwencji. Dzięki temu, trenowane na ogromnych korpusach tekstu, uczą się gramatyki, stylu, faktów oraz wzorców rozumowania. Po treningu mogą:

Znajomość historii pomaga zrozumieć:

To także pomaga ustalić realistyczne oczekiwania: GPT to potężne narzędzie uczące się wzorców, a nie nieomylne źródło prawdy.

Główne kamienie milowe obejmują:

Dostrajanie do instrukcji i RLHF zmieniają zachowanie modeli w bardziej zgodne z oczekiwaniami ludzi:

W rezultacie modele są:

GPT-4 różni się od wcześniejszych modeli kilkoma cechami:

GPT-4o i GPT-4o mini są zoptymalizowane pod szybkość, koszt i użycie w czasie rzeczywistym:

Deweloperzy często używają modeli GPT do:

Dostęp przez API umożliwia integrację tych możliwości bez trenowania czy hostowania własnych dużych modeli.

Główne ograniczenia i ryzyka obecnych modeli GPT:

Kilka trendów może kształtować przyszłe systemy GPT:

Kilka praktycznych wskazówek do bezpiecznego i skutecznego użycia GPT:

Te zmiany przesuwają GPT-4 z roli generatora tekstu w stronę uniwersalnego asystenta.

Umożliwiają one ekonomiczne wykorzystanie zaawansowanych funkcji GPT na szeroką skalę.

W zastosowaniach krytycznych wyniki należy weryfikować, stosować mechanizmy kontroli (np. retrieval, walidatory) oraz nadzór ludzki.

Kierunek to bardziej zdolne, ale też kontrolowane i rozliczalne systemy.

Skuteczne użycie GPT polega na łączeniu jego mocnych stron z zabezpieczeniami i dobrą projektową praktyką.