29 sie 2025·8 min

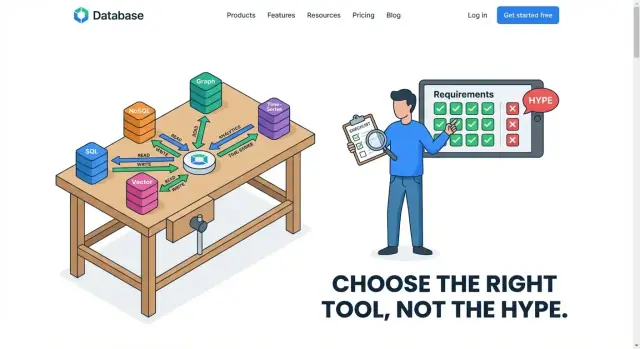

Wybieraj bazy danych według wzorców dostępu, nie trendów branżowych

Praktyczny przewodnik: wybieraj bazę danych według wzorców odczytu/zapisu, latencji, spójności i potrzeb wzrostu—aby trendy nie generowały niepotrzebnego długu technicznego.

Zacznij od obciążenia, nie od szumu

Wybieranie bazy danych, bo jest „popularna”, przypomina kupowanie pojazdu, bo wszyscy o nim mówią—bez sprawdzenia, czy potrzebujesz skutera, pickupa czy autobusu. Trendy odzwierciedlają to, co sprawdziło się w cudzego produktu, przy innym zespole, budżecie i tolerancji ryzyka. Twoja baza musi pasować do Twojego obciążenia: tego, co Twoja aplikacja rzeczywiście robi każdego dnia.

Co rozumiemy przez „obciążenie”

Obciążenie to rzeczywiste zachowanie systemu w produkcji:

- Jak dane są zapisywane: częste małe aktualizacje, duże wsadowe inserty, zdarzenia append-only, czy sporadyczne edycje.\n- Jak dane są czytane: pojedyncze odczyty rekordów, feed „ostatnich N”, wyszukiwanie pełnotekstowe czy duże skany.\n- Jak się zapytuje: proste odczyty po kluczu, filtrowanie po wielu polach, joiny, agregacje, raporty w oknach czasowych czy zapytania geospace.\n- Jak to się zmienia w czasie: szczyty ruchu, sezonowe piki, backfille i wzrost wolumenu danych.

Te zachowania to Twoje wzorce dostępu—powtarzalne sposoby, w jakie aplikacja dotyka danych. Jeśli potrafisz je jasno opisać, wybór bazy staje się znacznie mniej tajemniczy.

Ustal właściwe oczekiwania na początku

Jedno rozwiązanie rzadko pasuje wszystkim. Wiele udanych systemów stosuje podejście hybrydowe: jedna baza zoptymalizowana pod transakcje, inna pod analitykę, czasem dodatkowy silnik wyszukiwania lub cache. To nie jest „nadmiarowa złożoność dla złożoności”—to uznanie, że różne wzorce dostępu korzystają z różnych sposobów przechowywania i zapytań.

Zanim porównasz „SQL vs NoSQL” lub pobiegniesz za gorącym trendem, spisz swoje top 5–10 odczytów i zapisów. Zacznij od tego; reszta to szczegóły.

Co naprawdę znaczy „wzorzec dostępu”

Wzorzec dostępu to praktyczny opis tego, jak Twoja aplikacja dotyka danych na co dzień: co czyta, co zapisuje, jak często, jak szybko i w jakich kształtach. Chodzi mniej o to, czym są Twoje dane („zamówienia” czy „użytkownicy”), a bardziej o to, co z nimi robisz („pobierz zamówienie po ID 10 000 razy na minutę” lub „zeskanuj wszystkie zamówienia z ostatniego miesiąca, by wygenerować raport”).

Odczyty: trzy powszechne kształty

Większość ruchu odczytów mieści się w kilku rozpoznawalnych kubełkach:

- Punktowe odczyty: „Pokaż zamówienie #12345” lub „Załaduj profil użytkownika.” Zwykle są szybkie, jeśli baza może użyć indeksu lub klucza.\n- Złożone zapytania: „Znajdź klientów, którzy kupili X, w regionie Y, z więcej niż 2 zwrotami.” Zależą od joinów, filtrowania, sortowania i dobrego planu zapytania.\n- Skany / odczyty zakresowe: „Weź wszystkie logi z ostatnich 24 godzin” lub „Wyświetl ostatnie 50 transakcji.” Może to oznaczać czytanie dużej liczby wierszy/dokumentów, nawet jeśli pokazujesz tylko mały wycinek.

Kanał społecznościowy to dobre przykładowe mieszane kształty odczytów: punktowe odczyty profili, odczyty zakresowe „ostatnich postów” i agregacje do liczenia.

Zapisy: inserty, ingest i aktualizacje

Wzorce zapisów też mają znaczenie:

- Pojedyncze inserty: tworzenie zamówienia, dodanie komentarza, rejestracja użytkownika.\n- Wysokowolumenowy ingest: zbieranie zdarzeń kliknięć lub logów aplikacji ciągle napływających.\n- Aktualizacje: zmiana stanu zapasów, statusu zamówienia, edycja posta.

Logi są często „write-heavy i append-only” (dużo insertów, mało aktualizacji). Zamówienia zwykle są „write-then-update” (utworzenie, potem zmiany statusu).

Mieszane obciążenia (i dlaczego są trudne)

Wiele produktów chce wszystkiego naraz: szybkie punktowe odczyty dla aplikacji, złożone zapytania dla supportu i duże skany dla analityki. Jedna baza może obsłużyć pewne kombinacje dobrze, ale niektóre wzajemnie się wykluczają—for example, ciężkie skany analityczne mogą spowolnić małe, wrażliwe na opóźnienia odczyty, które obsługują checkout lub feed.

Gdy potrafisz jasno nazwać swoje wzorce dostępu, oceniasz bazy po rzeczywistym zachowaniu, a nie po popularności.

Typowe rodzaje obciążeń, które warto zidentyfikować wcześnie

Zanim porównasz marki baz, nazwij obciążenie, które faktycznie obsługujesz. Większość produktów to nie „jedno obciążenie”—to kilka różnych obciążeń obok siebie (czasem konkurujących). Dobre sklasyfikowanie na wczesnym etapie zapobiega forsowaniu bazy do roli, do której nie jest zoptymalizowana.

OLTP (Online Transaction Processing)

OLTP to codzienne tętno większości aplikacji: wiele małych odczytów i zapisów, dużo współbieżnych użytkowników i żądania, które muszą się szybko kończyć.

Pomyśl: „zaktualizuj koszyk”, „stwórz zamówienie”, „zmień adres”, „sprawdź zapas.” Operacje te są krótkie, celowane i wrażliwe na poprawność. Jeśli płatność zostanie zaksięgowana, nie może zniknąć; jeśli miejsce jest zarezerwowane, dwie osoby nie powinny dostać tego samego miejsca.

OLTP zwykle skłania do systemów, które dobrze radzą sobie z wysoką współbieżnością i dają jasne gwarancje wokół transakcji i integralności danych.

Analityka / OLAP (raporty i agregacje)

Analityka odwraca kształt pracy: mniej zapytań, ale każde obejmuje znacznie więcej danych.

Pomyśl: „przychód według regionu w ostatnim kwartale”, „konwersja według kanału”, „top produkty w kategorii”, „trend DAU”. Te zapytania często skanują wiele wierszy, grupują, agregują i sortują. Wymagania latencji mogą być luźniejsze (sekundy są często w porządku), ale koszt ciężkich skanów ma znaczenie—zwłaszcza jeśli pulpit ciągle działa.

Jeśli spróbujesz wykonywać zapytania OLAP na tym samym systemie, który obsługuje checkout, zwykle jedno z nich ucierpi.

Szeregi czasowe i logi

Dane czasowe i logi są zwykle append-heavy: nowe zdarzenia napływają nieustannie i zwykle zapytujesz po zakresach czasowych.

Pomyśl: metryki, clickstreamy, telemetria urządzeń, logi audytu. Typowe potrzeby to zasady retencji (kasowanie/wygaśnięcie starych danych), rollupy (przechowuj surowe zdarzenia przez 7 dni, agregaty przez 12 miesięcy) i szybkie zapisy podczas pików.

To obciążenie mniej dotyczy złożonych joinów, a bardziej wydajnego przyjmowania dużej liczby zdarzeń z przewidywalnym miejscem na dysku w czasie.

Wyszukiwanie

Wyszukiwanie to nie tylko „znajdź wiersze”. To dopasowywanie tekstu, ranking trafności, dopasowania częściowe i przyjazne filtrowanie.

Pomyśl: wyszukiwanie produktów po słowach kluczowych, znajdowanie ticketów po frazach, filtrowanie po fasetach (marka, zakres cen, kolor) i sortowanie po „najlepszym dopasowaniu”. Te funkcje często wymagają specjalnych indeksów i możliwości zapytań, które ogólne bazy mogą przybliżać—ale rzadko w pełni opanowują.

Jeśli wyszukiwanie jest kluczową cechą produktu, potraktuj je jako osobne obciążenie od początku, a nie „dodamy później”.

Potrzeby wydajności: latencja, przepustowość i skoki

Wydajność to nie jedna liczba. Dwie bazy mogą być „szybkie”, a jednak zupełnie inaczej odczuwać się dla użytkownika i operatora. Aby dobrze wybrać, oddziel to, co odczuwa użytkownik (latencja) od tego, co system musi utrzymać (przepustowość), a następnie przetestuj swoje założenia przy skokach.

Latencja vs przepustowość: co użytkownik odczuwa vs co system obsługuje

Latencja to ile trwa pojedyncze żądanie—„kliknij przycisk, otrzymaj wynik.” Użytkownicy odczuwają latencję bezpośrednio.

Przepustowość to ile żądań na sekundę możesz przetworzyć—ile ruchu system może utrzymać łącznie.

Baza może osiągać wysoką przepustowość przez efektywne grupowanie pracy, a jednocześnie mieć zauważalne opóźnienie na pojedyncze zapytanie. Inna może optymalizować szybkie odczyty punktowe, ale mieć problemy przy dużej liczbie zapisów jednocześnie.

Dlaczego najwolniejsze 1% ma znaczenie (P99)

Średnia latencja ukrywa ból. Jeśli 99 żądań kończy się w 50 ms, a 1 zajmuje 2 sekundy, średnia wygląda dobrze—ale ten 1% to moment „aplikacja jest wolna”.

To właśnie oznacza P99 latencji: czas dla najwolniejszych 1% żądań. Dla funkcji skierowanych do użytkownika (checkout, logowanie, wyniki wyszukiwania) P99 często decyduje, czy projekt bazy będzie odbierany jako niezawodny.

Szczyt vs średnie obciążenie: projektowanie pod kątem skoków

Większość systemów nie pada przy średnim ruchu; pada przy szczytach: mailing marketingowy, nagła wiadomość, dzień wypłaty, koniec miesiąca.

Skoki zmieniają rozmowę o bazie:

- Indeksy, które działają przy 200 zapisów/s, mogą stać się wąskim gardłem przy 2 000 zapisów/s.\n- Prace tła (kompaktacja, vacuum, replikacja) konkurują z zapytaniami użytkowników wtedy, gdy najmniej tego chcesz.

Jak cache zmienia kształt odczytów

Caching może sprawić, że odczyty wyglądają na mniejsze—dopóki nie ma missu lub wyczyszczenia cache.

Jeśli większość odczytów trafia w cache, baza może głównie obsługiwać zapisy i okazjonalne drogie odczyty. To faworyzuje inne wybory niż system, w którym każdy odczyt trafia do bazy. Planuj pod „zimny cache” i tail latency missów, nie tylko szczęśliwy przebieg.

Poprawność, dostępność i ograniczenia lokalizacji

Wybór bazy to nie tylko szybkość. To także, co może się zepsuć, ile możesz tolerować przestojów i gdzie znajdują się użytkownicy.

Poprawność: co nigdy nie może być błędne

Najpierw nazwij dane, które muszą być za każdym razem poprawne. Płatności, salda kont i stany magazynowe to klasyczne przykłady. Jeśli klient zostanie obciążony dwukrotnie, koszt to nie tylko wolna aplikacja—to zwroty, bilety do supportu i utrata zaufania.

Dla tych części systemu zwykle chcesz mocnych gwarancji: zapisów potwierdzonych zanim uznasz je za zakończone i czytelników, którzy nie zobaczą połowicznych aktualizacji. Kosztem jest to, że silniejsza poprawność często ogranicza elastyczność: niektóre strategie skalowania stają się trudniejsze, a zapisy wieloregionowe wolniejsze.

Dostępność: ile kosztuje przestój

Następnie zdecyduj, co się stanie, jeśli baza będzie niedostępna przez 5 minut.

Jeśli przestój oznacza „zamówienia przestają wpływać i przestaje płynąć przychód”, potrzebujesz wyższej dostępności: automatyczny failover, dobre backupy i plan na konserwację bez wyłączania aplikacji. Jeśli przestój oznacza „opóźnione dashboardy wewnętrzne”, możesz zaakceptować prostsze rozwiązania.

Wyższa dostępność zwykle zwiększa koszty i złożoność operacyjną (więcej replik, więcej monitoringu, ostrożniejsze upgrade’y). Klucz to dopasowanie inwestycji do wpływu biznesowego.

Lokalizacja: jeden region kontra wiele regionów

Jeśli Twoi użytkownicy są w jednym regionie, trzymanie danych lokalnie może być tańsze i szybsze. Jeśli masz użytkowników na różnych kontynentach albo wymagania regulacyjne co do miejsca przechowywania, może być potrzebna replikacja wieloregionowa.

Projekty wieloregionowe poprawiają doświadczenie użytkownika i odporność, ale wymuszają trudne wybory: czy dopuszczasz lekko przestarzałe odczyty, czy akceptujesz wolniejsze zapisy, by wszystko było idealnie spójne? Odpowiedź zależy od tolerancji Twojego obciążenia.

Model danych i kształt zapytań: ukryte czynniki decydujące

Sprawdź p99 przed skalowaniem

Prototypuj krytyczne endpointy i monitoruj tail latency przed podjęciem decyzji o bazie.

Większość „debat o bazach” to w rzeczywistości spory o kształt zapytania. Jeśli wiesz, jakie pytania Twoja aplikacja musi zadawać—joiny, agregacje, filtry, okna czasowe—zwykle szybko zawęzisz wybór baz.

Kształt zapytania napędza model danych

Model relacyjny błyszczy, gdy potrzebujesz elastycznego filtrowania i łączenia wielu bytów (klienci → zamówienia → pozycje), szczególnie gdy wymagania ewoluują. Jeśli produkt potrzebuje ad-hoc raportów („pokaż wszystkich klientów, którzy kupili X i zwrócili Y”), SQL i joiny zwykle pozostają prostsze w czasie.

Jeśli zapytania są przewidywalne i głównie po kluczu głównym („pobierz profil po user_id”), dokument lub model key-value może się sprawdzić—przechowując dane już w kształcie, w jakim się je czyta. Kosztem może być duplikacja danych, by unikać joinów, co przenosi złożoność do zapisów i aktualizacji.

Indeksy: prawdziwy kontrakt wydajnościowy

Indeksy to sposób, w jaki mówisz bazie „to są moje wzorce dostępu”. Zapytanie, które wygląda dobrze w makiecie, może się stać wolne, jeśli filtruje lub sortuje po niezaindeksowanym polu.

Przydatna zasada: każde częste filtrowanie, sortowanie lub klucz join powinien mieć plan indeksowania. Ale indeksy nie są darmowe: zajmują miejsce i obciążają zapisy.

Amplifikacja zapisów: kiedy „szybkie zapisy” stają się wolne

Twierdzenia o „szybkich zapisach” często pomijają amplifikację zapisów—dodatkową pracę tworzona przez indeksy wtórne, kompakcję, replikację czy aktualizowanie wielu kopii zdywersyfikowanych danych. Projekt optymalizujący odczyty przez dodanie indeksów lub duplikowanie dokumentów może cicho przerodzić się z wysokowydajnego zapisu w wąskie gardło.

Elastyczność schematu kontra utrzymywalność

Brak sztywnego schematu nie znaczy braku struktury. Elastyczne schematy przyspieszają wczesne iteracje, ale bez konwencji prowadzą do niespójnych pól, trudnych do debugowania zapytań i kosztownych migracji później. Gdy spodziewasz się wielu zespołów, wielu funkcji lub długiego okresu retencji, bardziej uporządkowany schemat i jasne ograniczenia często obniżają całkowity koszt—nawet jeśli na początku wydaje się wolniejszy.

Operacje i koszty: co trendy ignorują

Wybór bazy ze względu na popularność często zawodzi w mało widowiskowych częściach utrzymania: utrzymanie jej w działaniu, zabezpieczenie i opłaty co miesiąc. Dwie bazy mogą spełniać te same wymagania funkcjonalne, a różnić się diametralnie nakładem operacyjnym i całkowitym kosztem posiadania.

Wysiłek operacyjny jest cechą produktu

Zapytaj wcześnie, kto będzie prowadzić ten system o 2 w nocy. Backupy, odzyskiwanie do punktu w czasie, upgrade’y, patchowanie, ćwiczenia failoveru i monitoring to nie „zadania później”—kształtują ryzyko i zatrudnienie.

Usługi zarządzane redukują trud, ale nie eliminują go. Niektóre systemy wymagają regularnej kompaktacji, starannego tuningu lub głębokiej wiedzy, by uniknąć spowolnień. Inne utrudniają zmiany schematu lub wymagają specjalnych playbooków migracyjnych. Jeśli Twój zespół jest mały, baza łatwiejsza w utrzymaniu może pobić „idealne” dopasowanie na papierze.

Wiedzieć, co naprawdę napędza koszty

Koszty bazy zwykle pochodzą z:\n\n- Przechowywania (zwłaszcza jeśli masz wiele replik, indeksów lub długą retencję)\n- Compute (podstawa plus zapas na skoki)\n- I/O (losowe odczyty/zapisy, wolumen logów, kompakcje)\n- Egress sieciowy (replikacja między regionami, eksporty do analityki, backupy)

Wzorzec dostępu ciężki na zapisy i indeksy wtórne może pomnożyć I/O i przechowywanie, nawet gdy dataset jest niewielki.

Lock-in, przenoszalność i ryzyko

Proprietarne języki zapytań, unikalne cechy spójności czy serverlessowe „magiczne” funkcje mogą przyspieszyć dostawę—but mogą ograniczyć przyszłe ruchy. Zastanów się, czy możesz wyeksportować dane, uruchomić lokalnie do testów lub zmienić dostawcę bez przepisywania aplikacji.

Podstawy bezpieczeństwa i zgodności

Przynajmniej potwierdź szyfrowanie w tranzycie i w spoczynku, opcje zarządzania kluczami, audytowania, kontrolę dostępu i polityki retencji. Wymagania zgodności często decydują między „działa” a „akceptowalne”, niezależnie od tego, co modne.

Dopasowywanie wzorców do rodzin baz danych

Pokaż to jak produkcję

Postaw PoC na własnej domenie, by zaprezentować go jak prawdziwy produkt.

Gdy opiszesz wzorce dostępu (co czytasz, co zapisujesz, jak często i przy jakich skokach), zwykle jasne staje się, jaka rodzina baz jest właściwa. Celem nie jest wybranie najpopularniejszego narzędzia—jest nim wybranie najprostszych rozwiązań, które pozostaną poprawne przy Twoim obciążeniu.

Relacyjne (SQL): najprostszy poprawny wybór

Wybierz relacyjną bazę, gdy potrzebujesz silnej spójności, jasnych relacji i niezawodnych transakcji—zamówienia, płatności, zapasy, uprawnienia, harmonogramy. Jeśli często zapytujesz across entitites („klienci z nieopłaconymi fakturami w ciągu ostatnich 30 dni”) lub musisz wymuszać ograniczenia (unikalne emaile, klucze obce), SQL zwykle zmniejsza złożoność aplikacji.

Przydatna heurystyka: jeśli Twój zespół zaczyna implementować joiny, ograniczenia i transakcje w kodzie aplikacji, prawdopodobnie chcesz relacyjnej bazy.

Bazy dokumentowe: elastyczne kształty, mniej joinów

Baza dokumentowa najlepiej sprawdza się, gdy czytasz i zapisujesz głównie całe obiekty o zmiennej strukturze, jak profile użytkowników, strony treści, katalog produktów z opcjonalnymi polami czy ustawienia. Jeśli typowe zapytanie to „pobierz profil po user_id” i aktualizujesz jego części, dokumenty mogą trzymać używane razem dane w jednym miejscu.

Bądź ostrożny, gdy zapytania stają się bardzo relacyjne (wiele zapytań między dokumentami) lub potrzebujesz gwarancji transakcyjnych między wieloma bytami.

Key-value: ultraszybkie odczyty dla efemerycznych danych

Systemy key-value błyszczą przy cache, sesjach, limitach częstości, flagach funkcji i krótkotrwałym stanie, gdy wzorzec to „get/set po kluczu” i latencja jest krytyczna. Często są uzupełnieniem, nie głównym źródłem prawdy.

Jeśli przechowujesz trwałe dane biznesowe, zapytaj, co się stanie przy evicji, restarcie lub opóźnieniach replikacji.

Hurtownie kolumnowe: ciężkie agregacje i BI

Dla analityki—dashboardy, kohorty, rollupy przychodu, grupowania po długiej historii—systemy kolumnowe/w hurtownie wygrywają, bo są zoptymalizowane do wydajnych skanów i agregacji dużych zbiorów wierszy.

Praktyczny podział: trzymaj zapisy OLTP w bazie pierwotnej i zasil hurtownię do raportów. To unika spowalniania zapytań użytkowych przez obciążenie BI.

Przykłady z życia: jeden produkt, wiele baz

Wiele udanych produktów nie „wybiera bazy”. Mapuje każdy główny wzorzec dostępu do najprostszej warstwy przechowywania, która go dobrze obsłuży, nawet jeśli oznacza to użycie dwóch lub trzech baz obok siebie.

Przykład 1: E‑commerce — zamówienia, wyszukiwanie katalogu i analityka

Sklep online często ma trzy bardzo różne obciążenia:

- Zamówienia i płatności (OLTP): dużo małych odczytów/zapisów, ścisła poprawność, transakcyjne aktualizacje (stan magazynu, status zamówienia). Relacyjna baza to powszechny wybór.\n- Wyszukiwanie i filtrowanie katalogu: użytkownicy oczekują szybkiego wyszukiwania tekstowego, faset, tolerancji na literówki i rankingu trafności. Zwykle lepiej obsłużyć to silnikiem wyszukiwania niż zmuszać SQL do udawania takiego zachowania.\n- Analityka biznesowa: „Jak zmieniła się konwersja po kampanii?” wymaga dużych skanów i agregacji w czasie. Hurtownia kolumnowa lub baza analityczna obsłuży to bez spowalniania checkoutu.

Produkt sprawia wrażenie spójnego, ale przechowywanie jest wyspecjalizowane według wzorca dostępu.

Przykład 2: Aplikacja SaaS — wielodostępność, raportowanie i logi audytu

Aplikacja B2B może trzymać byty core (projekty, faktury, tickety) w transakcyjnej bazie, ale także potrzebować:

- Zapytania świadome tenantów: indeksy per-tenant i przewidywalne kształty zapytań, by utrzymać wydajność.\n- Raportowanie: długotrwałe, agregacyjne zapytania, które nie powinny konkurować z interaktywnymi żądaniami; często offloadowane do repliki, hurtowni lub osobnego magazynu raportowego.\n- Logi audytu: append-only, wysokowolumenowe zdarzenia z regułami retencji. Sklepy zoptymalizowane pod logi (albo nawet object storage + warstwa zapytająca) bywają tańsze i prostsze niż zapełnianie głównej bazy OLTP.

Przykład 3: IoT/logowanie — ingest, retencja, dashboardy

Platformy IoT przyjmują skoki telemetryczne, potem czytają je jako dashboardy czasowe.

Typowy podział to: szybki magazyn ingestu dla danych świeżych, tańsze długoterminowe przechowywanie i silnik analityczny do agregatów.

Kluczowa lekcja: różne komponenty mogą—i często powinny—używać różnych baz, gdy ich wzorce dostępu się rozjeżdżają.

Czerwone flagi, że wybrałeś złą bazę

Niedopasowanie bazy zwykle objawia się narastającą ilością „małych” poprawek. Jeśli zespół spędza więcej czasu na walce z bazą niż na budowaniu funkcji, zwróć uwagę—często to problem wzorca dostępu, nie tylko strojenia.

Objawy kompensowania złego dopasowania

Kilka powtarzających się sygnałów:

- Zbyt wiele obejść w kodzie aplikacji (cache’owanie wszystkiego, pisanie wielu wersji tych samych zapytań, denormalizacja „żeby było szybciej”).\n- Ciągłe reindeksowanie lub zmiany indeksów, bo nowe zapytania psują stare.\n- Wolne zapytania trudne do wytłumaczenia: wyglądają prosto, ale wydajność buzuje w zależności od rozmiaru danych lub pory dnia.\n- Awarie związane z rutynowymi wydarzeniami—deployy, joby wsadowe, backfille czy końcówki miesiąca.

Jeśli baza wymaga heroicznego wysiłku, by wspierać normalne operacje, wzorzec i rodzina bazy prawdopodobnie się nie zgadzają.

Trendowe wybory są drogie (później)

Wybór bazy, bo jest modna, może zamrozić Cię w długoterminowych kosztach:

- Zmusisz budować brakujące funkcje samodzielnie (joiny, ograniczenia, migracje, audyt), a ten kod staje się trudny do rozmontowania.\n- Migracje są odkładane, bo ryzyko jest duże—więc „tymczasowe” obejście staje się stałe.\n- Kształt danych dopasowuje się do narzędzia, a nie do produktu, utrudniając przyszłą analitykę, zgodność i integracje.

Rachunek przychodzi, gdy wzrasta skala lub zmieniają się wymagania—wtedy jedyne realistyczne wyjście to bolesne przeniesienie platformy.

Wczesne metryki ostrzegawcze

Nie potrzebujesz perfekcyjnej obserwowalności, ale kilku sygnałów:\n\n- Percentyle latencji (p95/p99), nie tylko średnie.\n- Kontencja blokad / deadlocki (lub równoważne konflikty współbieżności).\n- Nasycenie puli połączeń i timeouty.\n- Opóźnienia replikacji i niespójności read-after-write.\n- Tempo wzrostu przechowywania i stosunek indeksów do danych.

Co udokumentować, by nie powtórzyć błędu

Zapisz top wzorce dostępu (odczyty/zapisy, kluczowe zapytania, stawki szczytowe), założenia dotyczące wolumenu danych i „non-negotiables” (spójność, dostępność, ograniczenia lokalizacyjne). Dodaj przykłady najgorszych zapytań i dashboardy. Ten krótki zapis przyspiesza przyszłe decyzje i pokazuje, kiedy baza przestaje pasować do rzeczywistości.

Praktyczna lista kontrolna, którą możesz ponownie używać

Najpierw zaplanuj obciążenie

Użyj Planning Mode w Koder.ai, aby zmapować wzorce dostępu przed generowaniem kodu.

Wybór bazy jest łatwiejszy, gdy traktujesz go jak zbieranie wymagań, a nie konkurs popularności. Użyj tej listy, by zamienić nieostre „potrzebujemy czegoś skalowalnego” w konkretne wejścia porównawcze.

1) Wyjaśnij obciążenie kilkoma pytaniami o dużym wpływie

Odpowiedz najpierw prostym językiem, potem dodaj liczby tam, gdzie możesz:

- Główne zapytania: Jakie są top 3–5 rzeczy, które aplikacja musi robić (np. „pobierz użytkownika po emailu”, „lista ostatnich 50 zamówień”, „wyszukaj po słowie kluczowym”, „agreguj przychód dziennie”)?\n- Szybkość zapisów: Ile zapisów na sekundę teraz, a ile w szczycie? Zapisy małe i częste czy duże wsady?\n- Rozmiar danych i wzrost: Aktualny rozmiar datasetu, miesięczny wzrost, zasady retencji (przechowywać na zawsze, 90 dni, archiwizować?).\n- SLA: Cele p95/p99 latencji, dostępność, oczekiwania odnośnie odzyskiwania (RTO/RPO) i jak źle jest, jeśli dane będą nieco nieświeże.

2) Użyj prostego arkusza oceniania

Zrób jednostronicową tabelę z kryteriami w lewym kolumnie i kandydatami na górze. Oznacz każde kryterium jako must-have lub nice-to-have, potem oceniaj (np. 0–2).

Uwzględnij przynajmniej: dopasowanie zapytań, podejście skalowania, potrzeby spójności, wysiłek operacyjny, ekosystem/narzędzia i przewidywalność kosztów.

3) Przeprowadź mały proof of concept (PoC)

Testuj z reprezentatywnymi danymi i rzeczywistymi zapytaniami, nie z zabawkowymi przykładami. Odtwórz „top zapytania” i realistyczny wzorzec zapisów (w tym skoki).

Jeśli szybko iterujesz nad pomysłami produktowymi, środowisko vibe-coding takie jak Koder.ai może pomóc uruchomić działającą aplikację i zweryfikować wzorce dostępu wcześnie: wygenerować frontend React z backendem Go + PostgreSQL, odwzorować kilka endpointów i zmierzyć, jak zachowują się Twoje „top 5 zapytań” zanim zobowiążesz się do długoterminowej architektury. Możliwość eksportu źródła i kontroli nad schematem oraz migracjami pomaga unikać wpakowania się w ślepą uliczkę.

4) Zdefiniuj kryteria sukcesu przed testowaniem

Zapisz wcześniej, co znaczy „zaliczone”: cele latencji, akceptowalne współczynniki błędów, wymagane kroki operacyjne (backupy, zmiany schematu) i estymowany koszt miesięczny przy oczekiwanym użyciu. Jeśli kandydat nie spełnia must-have w PoC, odrzuć go wcześnie.

Jak zabezpieczyć się na przyszłość bez over‑inżynierii

Future‑proofing to nie wybór „najbardziej skalowalnej” bazy na dzień dobry. To świadome decyzje, które utrzymają Cię zwinnym, gdy wzorce dostępu się zmienią.

Zacznij od najprostszego systemu, który wystarczy dziś

Jeśli Twoje obciążenie to głównie transakcyjne odczyty/zapisy z prostymi zapytaniami, relacyjna baza często jest najszybszą drogą do solidnego produktu. Celem jest wypuszczenie z pewnością: przewidywalna wydajność, jasne gwarancje poprawności i narzędzia, które zespół już zna.

„Future‑proof” oznacza unikanie nieodwracalnych zobowiązań na początku—np. adopcji wyspecjalizowanego magazynu zanim udowodnisz, że potrzebujesz jego kompromisów.

Projektuj pod kątem zmiany: granice, modularny dostęp i migracje

Zbuduj eksplicytną warstwę dostępu do danych (lub granicę serwisową), by reszta aplikacji nie zależała od dziwactw konkretnej bazy. Centralizuj logikę zapytań, definiuj kontrakty (wejścia/wyjścia) i traktuj zmiany schematu jako normalną część rozwoju.

Kilka praktycznych nawyków pomocnych przy przyszłych migracjach:

- Preferuj zmiany addytywne (nowe kolumny/tabele) zamiast ryzykownych przepisów.\n- Backfilluj partiami i twórz kompatybilność starego i nowego kodu podczas deployów.\n- Loguj i mierz wzorce zapytań, by wcześniej zauważyć dryf.

Rozdzielaj obciążenia, gdy wzorce się rozjeżdżają

Wiele produktów ostatecznie potrzebuje dwóch ścieżek: OLTP dla codziennych transakcji i analityki dla raportów, eksperymentów lub ciężkich agregatów. Rozdzielaj, gdy zapytania analityczne zaczynają szkodzić latencji produkcyjnej albo gdy potrzebujesz innych zasad retencji/partycjonowania.

Aby utrzymać spójność, standaryzuj definicje zdarzeń/danych, automatyzuj pipeline’y i uzgadniaj sumy (np. dzienne przychody) między systemami, by „prawda” się nie rozproszyła.

Jeśli chcesz konkretnego następnego kroku, przygotuj lekki szablon planu migracji, którego zespół może używać ponownie: szablon planu migracji bazy danych.

Często zadawane pytania

Co w praktyce oznacza „wzorzec dostępu”?

Wzorzec dostępu to powtarzalny sposób, w jaki Twoja aplikacja sięga do danych w produkcji: co czyta/zapisuje, jak często, jak szybko i w jakich kształtach zapytań (punktowe odczyty, skany zakresów, joiny, agregacje, okna czasowe itd.). Jest bardziej praktyczny niż „mamy użytkowników i zamówienia”, bo mapuje się bezpośrednio na indeksy, wybór schematu i dopasowanie bazy.

Dlaczego nie powinienem wybierać bazy na podstawie trendów czy popularności?

Bo „popularne” odzwierciedla ograniczenia innych zespołów, nie Twoje. Ta sama baza może być świetna dla jednego wzorca (np. OLTP), a katastrofalna dla innego (np. ciężkie zapytania analityczne). Najpierw wypisz swoje top 5–10 odczytów i zapisów, a potem oceniaj bazy pod kątem tych zachowań, a nie marketingowego szumu.

Co powinienem najpierw udokumentować, aby zdefiniować obciążenie?

Zapisz:

- Najważniejsze zapytania (np. „pobierz użytkownika po emailu”, „lista ostatnich 50 zamówień”, „agreguj przychód według dnia”)

- Kształt zapisów (pojedyncze aktualizacje, zdarzenia append-only, załadunki wsadowe)

- Stawki szczytowe i średnie (odczyty/zapisy na sekundę)

- Wzrost danych i zasady retencji (jak długo przechowywać, archiwizacja)

- Cele dotyczące latencji/dostępności (p95/p99) i wymagania poprawności

To staje się Twoim dokumentem wymagań do porównania opcji.

Czym różnią się obciążenia OLTP i analityczne (OLAP)?

OLTP to codzienna praca większości aplikacji: wiele małych odczytów i zapisów, dużo współbieżnych użytkowników i operacje, które muszą zakończyć się szybko i poprawnie (koszyk, zamówienie, aktualizacja adresu).

OLAP/analiza to mniej zapytań, ale każde dotyka dużo danych (skany, grupowania, sortowania). Tutaj opóźnienia rzędu sekund mogą być akceptowalne, ale koszt skanów jest istotny. Łączenie obu typów na jednej bazie często powoduje, że zapytania analityczne spowalniają działanie funkcji użytkowych.

Dlaczego p99 ma większe znaczenie niż średnia latencja?

Patrz na p95/p99, nie na średnie. Jeśli najwolniejsze 1% żądań zajmuje sekundy, użytkownicy odczują aplikację jako zawodną, nawet gdy średnia wygląda dobrze.

Praktyczna wskazówka: śledź p95/p99 dla krytycznych endpointów (logowanie, checkout, wyszukiwanie) i koreluj skoki z metrykami bazy (blokady, opóźnienia replikacji, I/O).

Kiedy hybrydowe podejście do baz danych jest właściwe?

Zwykle gdy potrzeby konkurują:

- OLTP wymaga niskich opóźnień dla punktowych odczytów/zapisów i przewidywalnej współbieżności.

- Analityka potrzebuje szerokich skanów, agregacji i sortowań.

- Wyszukiwanie wymaga indeksowania tekstu, rankingów i dopasowań częściowych.

Stosowanie wyspecjalizowanych magazynów może być prostsze ogółem niż zmuszanie jednej bazy do robienia wszystkiego z obejściami.

Jak caching zmienia wybór i projekt bazy danych?

Cache może sprawić, że obciążenie odczytami wygląda mniejsze—dopóki nie nastąpi miss lub odświeżenie. To zmienia, co się liczy:

- Projektuj pod kątem zimnego cache (restarty, purge, deployy)

- Mierz i optymalizuj ścieżkę missów (to często Twój rzeczywisty najgorszy przypadek latencji)

- Zapewnij strategię unieważniania/aktualizacji cache zgodną z wymaganiami poprawności

Cache może tymczasowo ukryć problemy, ale też spowodować gwałtowne awarie, jeśli missy przytłoczą bazę.

Jak myśleć o wymaganiach poprawności i spójności?

Silna poprawność oznacza gwarancje dotyczące transakcji i widoczności aktualizacji (brak „półzapisanych” stanów). To kluczowe przy płatnościach, saldach kont, zapasach i rezerwacjach.

Kosztem mogą być:

- Trudniejsze/wolniejsze zapisy wieloregionowe

- Większe narzuty koordynacyjne

- Bardziej ostrożne projektowanie schematu i transakcji

Zdefiniuj, które dane „nigdy nie mogą się mylić”, a które mogą tolerować stalenie.

Jaką rolę odgrywają indeksy w dopasowaniu bazy do wzorców dostępu?

Indeksy to kontrakt wydajnościowy między Twoim obciążeniem a bazą. Planowanie indeksów powinno uwzględniać częste:

- Filtry (WHERE)

- Sortowania (ORDER BY)

- Klucze joinów

- Zapytania po zakresach czasowych

Indeksy zwiększają jednak zużycie przestrzeni i obciążają zapisy (write amplification). Cel: indeksować to, co faktycznie robisz często, nie wszystko.

Co sprawia, że proof of concept (PoC) wyboru bazy jest dobry?

PoC powinien być mini-repetycją produkcji:

- Użyj reprezentatywnej objętości danych (lub jej symulacji)

- Uruchom swoje rzeczywiste top zapytania i wzorce zapisów (w tym skoki i backfille)

- Zdefiniuj kryteria zaliczenia z góry (p95/p99, współczynnik błędów, kroki operacyjne, estymowany koszt miesięczny)

- Przetestuj też operacje: backup, restore, zmiana schematu, zachowanie przy failoverze

Jeśli kandydat nie spełnia must-have w PoC, wyeliminuj go wcześnie.