Przegląd: dlaczego historia OpenAI ma znaczenie

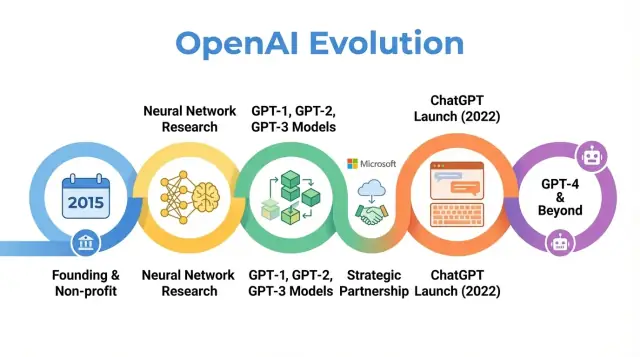

OpenAI to firma zajmująca się badaniami i wdrażaniem AI, której prace ukształtowały sposób myślenia o sztucznej inteligencji — od wczesnych artykułów naukowych po produkty takie jak ChatGPT. Zrozumienie, jak OpenAI ewoluowało — od małego non‑profitowego laboratorium w 2015 roku do kluczowego gracza w dziedzinie AI — pomaga wyjaśnić, dlaczego współczesne systemy AI wyglądają tak, jak wyglądają.

Historia OpenAI to nie tylko lista wydań modeli. To studium przypadku pokazujące, jak misja, bodźce, przełomy techniczne i opinia publiczna wzajemnie na siebie wpływają. Organizacja zaczęła z silnym naciskiem na otwarte badania i szerokie korzyści, potem zrestrukturyzowała się, by pozyskać kapitał, nawiązała głębokie partnerstwo z Microsoft i wprowadziła produkty używane przez setki milionów ludzi.

Dlaczego ta historia jest istotna

Śledzenie historii OpenAI uwidacznia kilka szerszych trendów w AI:

-

Misja i wartości: OpenAI powstało z oficjalnym celem zapewnienia, że sztuczna ogólna inteligencja przyniesie korzyści całej ludzkości. Sposób, w jaki ta misja była interpretowana i korygowana na przestrzeni czasu, ujawnia napięcia między ideałami a realiami rynkowymi.

-

Przełomy badawcze: Przejście od wczesnych projektów do systemów takich jak GPT-3, GPT-4, DALL·E i Codex odzwierciedla szerszy zwrot w stronę modeli bazowych na dużą skalę, które zasilają wiele współczesnych zastosowań AI.

-

Ład i struktura: Przejście od czystego non‑profitu do podmiotu z ograniczonym zyskiem oraz stworzenie skomplikowanych mechanizmów zarządzania pokazują, jak testowane są nowe formy organizacyjne, by radzić sobie z potężnymi technologiami.

-

Wpływ publiczny i kontrola: Dzięki ChatGPT i innym wydaniom OpenAI z laboratorium znanego głównie w kręgach badawczych stało się nazwą powszechną, przyciągając uwagę wokół kwestii bezpieczeństwa, zgodności i regulacji, które dziś kształtują dyskusje polityczne na całym świecie.

Ten artykuł opisuje drogę OpenAI od 2015 roku po najnowsze wydarzenia i pokazuje, jak każdy etap odzwierciedla szersze zmiany w badaniach nad AI, ekonomii i zarządzaniu — oraz co to może oznaczać dla przyszłości tej branży.

Założenie OpenAI: misja i wczesny zespół

Moment AI w 2015 roku

OpenAI zostało założone w grudniu 2015 roku, w czasie, gdy uczenie maszynowe — zwłaszcza deep learning — szybko się poprawiało, choć wciąż daleko mu było do ogólnej inteligencji. Benchmarki w rozpoznawaniu obrazów spadały, systemy mowy się poprawiały, a firmy takie jak Google, Facebook i Baidu inwestowały duże środki w AI.

Coraz więcej badaczy i liderów technologicznych obawiało się, że zaawansowana AI może zostać skoncentrowana w rękach niewielkiej liczby potężnych korporacji lub rządów. OpenAI powstało jako przeciwwaga: organizacja badawcza skoncentrowana na długoterminowym bezpieczeństwie i szerokim rozdziale korzyści płynących z AI, zamiast na krótkoterminowej przewadze komercyjnej.

Misja: AGI na korzyść wszystkich

Od pierwszego dnia OpenAI definiowało swoją misję w kategoriach sztucznej ogólnej inteligencji (AGI), a nie tylko przyrostowych postępów w uczeniu maszynowym. Główne założenie brzmiało: OpenAI będzie dążyć do tego, by AGI, jeśli zostanie stworzona, „przynosiła korzyści całej ludzkości”.

Ta misja miała kilka konkretnych implikacji:

- Priorytet dla badań nad bezpieczeństwem i długoterminowymi pytaniami o zgodność wartości

- Zobowiązanie do szerokiego dzielenia się badaniami, kodem i wnioskami tam, gdzie to możliwe

- Unikanie dynamiki zwycięzca-bierze-wszystko poprzez współpracę z innymi instytucjami

Wczesne publiczne wpisy na blogu i dokument założycielski podkreślały zarówno otwartość, jak i ostrożność: OpenAI publikowałoby dużą część swojej pracy, ale rozważałoby też wpływ społeczny udostępniania potężnych zdolności.

Założyciele, wczesne kierownictwo i struktura

OpenAI zaczęło jako non‑profitowe laboratorium badawcze. Początkowe zobowiązania finansowe ogłoszono na około 1 miliard dolarów w postaci obietnic wsparcia, choć nie była to natychmiastowa gotówka. Kluczowi wczesni darczyńcy to m.in. Elon Musk, Sam Altman, Reid Hoffman, Peter Thiel, Jessica Livingston i YC Research, a także wsparcie od firm takich jak Amazon Web Services i Infosys.

Wczesny zespół kierowniczy łączył doświadczenie startupowe, badawcze i operacyjne:

- Sam Altman – współzałożyciel i początkowy przewodniczący rady (później CEO)

- Elon Musk – współzałożyciel i wczesny darczyńca, członek rady w początkowym okresie

- Greg Brockman – były CTO Stripe, dołączył jako CTO i współzałożyciel

- Ilya Sutskever – wiodący badacz deep learningu, dołączył jako główny naukowiec

- Wojciech Zaremba i John Schulman – współzałożyciele i kluczowi liderzy badań

To połączenie przedsiębiorczości Doliny Krzemowej i najwyższej klasy badań AI ukształtowało wczesną kulturę OpenAI: ambitne dążenie do przesuwania granic możliwości AI, ale zorganizowane jako misjonerski non‑profit nastawiony na długoterminowy wpływ globalny, a nie szybkie komercyjne zyski.

Era non‑profit: wczesne badania i otwarta nauka

Kiedy OpenAI wystartowało jako non‑profitowe laboratorium w 2015 roku, jego publiczna obietnica była prosta, ale ambitna: rozwijać sztuczną inteligencję, dzieląc się jak najwięcej z szerszą społecznością.

Otwartość jako domyślna zasada

W pierwszych latach dominowała filozofia „open by default”. Publikowano artykuły naukowe szybko, zwykle udostępniano kod, a wewnętrzne narzędzia przekształcano w projekty publiczne. Idea była taka, że przyspieszenie szerokiego postępu naukowego — i poddanie go krytyce — będzie bezpieczniejsze i bardziej korzystne niż koncentracja zdolności w jednej firmie.

Jednocześnie bezpieczeństwo już wtedy było częścią rozmowy. Zespół dyskutował, kiedy otwartość może zwiększać ryzyko nadużyć i zaczął szkicować pomysły na etapowe udostępnianie i przeglądy polityk, choć te koncepcje były wówczas mniej sformalizowane niż późniejsze mechanizmy zarządzania.

Flagowe obszary badań

Wczesne zainteresowania OpenAI obejmowały kilka kluczowych obszarów:

- Uczenie przez wzmacnianie (RL): Prace nad agentami opanowującymi gry jak Dota 2 oraz złożone zadania sterowania przyczyniły się do postępów w algorytmach RL, metodach eksploracji i skali działania.

- Robotyka: Eksperymenty z robotycznymi dłońmi rozwiązującymi zadania manipulacyjne pokazały, jak RL i symulacja mogą przenosić się do świata fizycznego.

- Uczenie bez nadzoru i samonadzorowane: Badania nad tym, jak modele mogą uczyć się z dużych, nienadzorowanych zbiorów danych, zapowiadały późniejsze modele bazowe.

Te projekty były mniej o gotowych produktach, a bardziej o testowaniu, co jest możliwe dzięki deep learningowi, mocy obliczeniowej i sprytnym schematom treningu.

Narzędzia, które ukształtowały społeczność

Dwa z najbardziej wpływowych wyników tej ery to OpenAI Gym i Universe.

- OpenAI Gym dostarczył wspólny zestaw środowisk RL i benchmarków. Ustandaryzował sposób porównywania algorytmów i znacznie obniżył próg wejścia dla nowych laboratoriów i studentów.

- Universe miał na celu trenowanie i ocenianie agentów na szerokiej gamie istniejących środowisk programowych, od gier po aplikacje webowe. Chociaż Universe ostatecznie wycofano, skonsolidował zainteresowanie agentami ogólnego przeznaczenia.

Oba projekty odzwierciedlały zaangażowanie w infrastrukturę współdzieloną, a nie przewagę proprietarną.

Jak rówieśnicy i media postrzegali OpenAI

W okresie non‑profitowym OpenAI często przedstawiano jako organizację misjonerską, przeciwwagę dla laboratoriów AI wielkich firm. Rówieśnicy cenili jakość badań, dostępność kodu i środowisk oraz gotowość do prowadzenia dyskusji o bezpieczeństwie.

Media podkreślały niezwykłe połączenie znanych sponsorów, struktury non‑profit i obietnicy otwartości. Ta reputacja — jako wpływowego, otwartego laboratorium dbającego o długoterminowe konsekwencje — ukształtowała oczekiwania, które później wpływały na reakcje na każdą strategiczną zmianę organizacji.

Budowanie potężnych modeli: od GPT‑1 do GPT‑3

Punkt zwrotny w historii OpenAI to decyzja o skupieniu się na dużych modelach językowych opartych na transformatorach. Ten zwrot przekształcił OpenAI z organizacji badawczej w firmę znaną z modeli bazowych, na których inni budują swoje rozwiązania.

GPT‑1 była skromna w porównaniu do późniejszych modeli — 117 milionów parametrów, trenowana na BookCorpus — ale zaoferowała kluczowy dowód koncepcji.

Zamiast trenować oddzielne modele do każdego zadania NLP, GPT‑1 pokazała, że pojedynczy model transformatorowy trenowany z prostym celem (przewidywanie następnego słowa) można dostosować przy minimalnym dopasowaniu do zadań takich jak odpowiadanie na pytania, analiza sentymentu czy rozumienie logiczne.

Dla mapy drogowej OpenAI GPT‑1 potwierdziło trzy idee:

- Skala ma znaczenie: większe modele na większych danych działają lepiej w zaskakująco ogólny sposób.

- Pretraining + fine‑tuning potrafią przewyższyć systemy specyficzne dla zadania.

- Transformatory to potężna architektura dla języka.

GPT‑2: możliwości i obawy o nadużycia (2019)

GPT‑2 posunął tę samą receptę znacznie dalej: 1,5 miliarda parametrów i znacznie większy zbiór danych pochodzący z sieci. Jego generowane teksty były często zaskakująco spójne: wieloakapitowe artykuły, opowiadania i streszczenia wyglądające na pierwszy rzut oka jak tekst ludzki.

Te możliwości wzbudziły alarmy dotyczące potencjalnych nadużyć: automatyczna propaganda, spam, nękanie i fałszywe wiadomości na dużą skalę. Zamiast natychmiastowego udostępnienia pełnego modelu, OpenAI przyjęło strategię etapowego wydawania:

- Początkowe udostępnienie mniejszego modelu, wraz z artykułem technicznym i przykładami

- Kontynuacja wewnętrznych i zewnętrznych testów bezpieczeństwa

- Stopniowe publikowanie większych wersji w miarę oceny ryzyka

Był to jeden z pierwszych publicznie głośnych przykładów, gdy OpenAI jawnie wiązało decyzje o wdrożeniu z bezpieczeństwem i wpływem społecznym, co wpłynęło na sposób, w jaki organizacja myślała o ujawnianiu wyników, otwartości i odpowiedzialności.

GPT‑3: skala, uniwersalność i API (2020)

GPT‑3 ponownie zwiększył skalę — do 175 miliardów parametrów. Zamiast polegać głównie na fine‑tuningu dla każdego zadania, GPT‑3 pokazał „few‑shot” i nawet „zero‑shot” learning: model często potrafił wykonać nowe zadanie, otrzymując jedynie instrukcje i kilka przykładów w promptcie.

Ta wszechstronność zmieniła sposób myślenia OpenAI i branży: zamiast budować wiele wąskich modeli, jeden duży model mógł służyć jako ogólny silnik do:

- Tworzenia tekstu i treści marketingowych

- Fragmentów kodu i autouzupełniania

- Odpowiadania na pytania, czatu i wspomagania wyszukiwania

Kluczowe było to, że OpenAI zdecydowało się nie udostępniać GPT‑3 jako open‑source. Dostęp zapewniono poprzez komercyjne API. Ta decyzja była strategicznym zwrotem:

- Z publikowania modeli do ich obsługi jako usługi zarządzanej

- Z laboratorium badawczego do dostawcy platformy z płacącymi klientami

- Z jednorazowych demonstracji do ekosystemu deweloperów budujących na modelach OpenAI

GPT‑1, GPT‑2 i GPT‑3 tworzą wyraźną oś w historii OpenAI: skalowanie transformatorów, odkrywanie emergentnych zdolności, walka o bezpieczeństwo i nadużycia oraz budowanie podstaw komercyjnych, które później wspierały produkty typu ChatGPT i dalszy rozwój GPT‑4 i następnych.

Restrukturyzacja organizacji: OpenAI LP i model z ograniczonym zyskiem

Do 2018 roku liderzy OpenAI przekonali się, że pozostanie małym laboratorium finansowanym z darowizn nie wystarczy, by budować i bezpiecznie prowadzić bardzo duże systemy AI. Trenowanie modeli na froncie wymagało już dziesiątek milionów dolarów na obliczenia i talenty, a krzywe kosztów wskazywały na znacznie wyższe wydatki.

Dlaczego powstało OpenAI LP

W 2019 roku OpenAI uruchomiło OpenAI LP — nową spółkę ograniczoną z modelem „capped‑profit”. Celem było udostępnienie dużych zewnętrznych inwestycji przy jednoczesnym utrzymaniu misji non‑profitowej na szczycie hierarchii decyzyjnej.

Tradycyjne startupy finansowane przez VC odpowiadają przede wszystkim przed udziałowcami oczekującymi nieograniczonych zwrotów. Założyciele OpenAI obawiali się, że takie naciski zmusiłyby firmę do priorytetowego traktowania zysku kosztem bezpieczeństwa, otwartości czy ostrożnego wdrożenia. Struktura LP była kompromisem: mogła emitować instrumenty przypominające akcje i pozyskiwać kapitał na dużą skalę, ale na innych zasadach.

Jak działa model z ograniczonym zyskiem

W tym modelu inwestorzy i pracownicy mogą uzyskać zwroty ze swoich udziałów, ale tylko do ustalonej wielokrotności pierwotnej inwestycji (dla wczesnych inwestorów często cytowano nawet do 100x, z niższymi limitami w późniejszych rundach). Gdy limit zostanie osiągnięty, dodatkowa wartość ma trafiać do podmiotu non‑profit, by być użyta zgodnie z jego misją.

To kontrastuje z typowym startupem, gdzie wartość udziałów może teoretycznie rosnąć bez limitu, a maksymalizacja wartości dla udziałowców jest prawnie i kulturowo priorytetem.

Relacja między non‑profitem a LP

OpenAI Nonprofit pozostaje podmiotem kontrolującym. Jego rada nadzoruje OpenAI LP i zgodnie ze statutem ma priorytetować interesy ludzkości nad interesami poszczególnych inwestorów czy pracowników.

Formalnie:

- Non‑profit posiada kontrolujący udział w OpenAI LP.

- Rada non‑profitu powołuje kluczowe kierownictwo i w zasadzie może blokować decyzje sprzeczne z misją.

- Obowiązek zaufania (fiduciary duty) jest formułowany wokół statutu non‑profitu, a nie czystej optymalizacji finansowej.

Ten projekt zarządzania ma dać OpenAI elastyczność finansowania i zatrudnienia charakterystyczną dla organizacji komercyjnej, przy jednoczesnym zachowaniu nadrzędnej kontroli misyjnej.

Debaty i wpływ na finansowanie i rekrutację

Restrukturyzacja wywołała debaty wewnątrz i na zewnątrz organizacji. Zwolennicy twierdzili, że to jedyny praktyczny sposób, by zdobyć miliardy potrzebne do badań przy jednoczesnym ograniczeniu bodźców do maksymalizacji zysku. Krytycy wątpili, czy jakakolwiek struktura oferująca wysokie zwroty rzeczywiście oprze się presji komercyjnej i czy limity będą wystarczające lub egzekwowane.

W praktyce OpenAI LP otworzyło drzwi do dużych strategicznych inwestycji, z których najbardziej znacząca była współpraca z Microsoft, i pozwoliło firmie oferować konkurencyjne pakiety wynagrodzeń związane z potencjalnym wzrostem wartości. To z kolei umożliwiło skalowanie zespołów badawczych, rozszerzenie treningów modeli takich jak GPT‑3 i GPT‑4 oraz budowę infrastruktury potrzebnej do globalnego wdrożenia systemów takich jak ChatGPT — wszystko to z formalnym powiązaniem zarządzania z pierwotnymi non‑profitowymi celami.