04 juli 2025·8 min

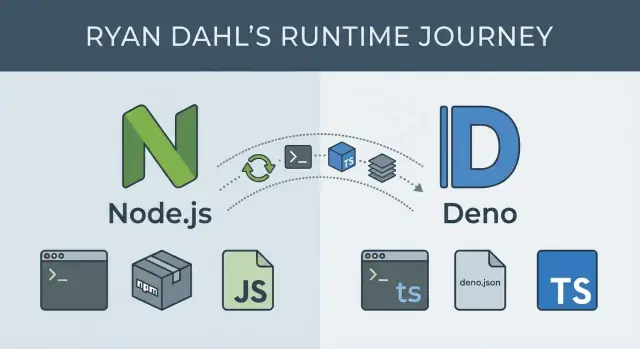

Ryan Dahls Node.js och Deno: runtime som formade JavaScript-backends

En praktisk guide till hur Ryan Dahls val i Node.js och Deno formade backend-JavaScript, verktyg, säkerhet och dagliga utvecklararbetsflöden — och hur du väljer idag.

Varför val av runtime formade backend-JavaScript

En JavaScript-runtime är mer än ett sätt att köra kod. Det är en samling beslut om prestandaegenskaper, inbyggda API:er, säkerhetsstandarder, paketering och distribution, samt de vardagliga verktyg utvecklare förlitar sig på. De besluten formar hur backend-JavaScript känns: hur du strukturerar tjänster, hur du felsöker problem i produktion och hur tryggt du kan leverera.

Runtimes påverkar arbetet, inte bara hastigheten

Prestanda är den uppenbara delen — hur effektivt en server hanterar I/O, samtidighet och CPU-intensiva uppgifter. Men runtimes bestämmer också vad du får “på köpet.” Har du ett standardiserat sätt att hämta URL:er, läsa filer, starta servrar, köra tester, lint:a kod eller paketera en app? Eller sätter du ihop de delarna själv?

Även när två runtimes kan köra liknande JavaScript kan utvecklarupplevelsen skilja sig dramatiskt. Paketering spelar roll: modulsystem, beroendelösning, lockfiles och hur bibliotek publiceras påverkar byggtillförlitlighet och säkerhetsrisk. Val av verktyg påverkar onboarding-tid och kostnaden för att underhålla många tjänster över år.

Beslut och avvägningar — inte hjältekult

Denna berättelse ramfästs ofta runt individer, men det är mer användbart att fokusera på begränsningar och avvägningar. Node.js och Deno representerar olika svar på samma praktiska frågor: hur köra JavaScript utanför webbläsaren, hur hantera beroenden och hur balansera flexibilitet med säkerhet och konsistens.

Du kommer att se varför vissa tidiga Node-val öppnade för ett stort ekosystem — och vad det ekosystemet krävde i utbyte. Du kommer också att se vad Deno försökte ändra, och vilka nya begränsningar som följer med de förändringarna.

Vad du lär dig och vem texten vänder sig till

Den här artikeln går igenom:

- Ursprunget till Node.js och varför dess eventdrivna modell spelade roll för backend

- Ekosystemeffekterna av npm och hur det formade arbetsflöden och risk

- Deno:s mål (inklusive säkerhet och TypeScript-först ergonomi)

- Hur dessa runtime-skillnader visas i dagligt leverans- och underhållsarbete

Den är skriven för utvecklare, tech leads och team som väljer runtime för nya tjänster — eller som underhåller befintlig Node.js-kod och utvärderar om Deno passar delar av stacken.

Ryan Dahl i kontext: två runtimes, två mål

Ryan Dahl är mest känd för att skapa Node.js (släppt 2009) och senare initiera Deno (annonserat 2018). Tillsammans läser de två projekten som ett offentligt register över hur backend-JavaScript utvecklades — och hur prioriteringar skiftar när verklig användning blottlägger avvägningar.

Node.js: göra JavaScript gångbart på servern

När Node.js dök upp dominerades serverutveckling av tråd-per-förfrågan-modeller som hade svårt med många samtidiga anslutningar. Dahls tidiga fokus var enkelt: gör det praktiskt att bygga I/O-tunga nätservers i JavaScript genom att para ihop Googles V8-motor med ett eventdrivet tillvägagångssätt och icke-blockerande I/O.

Nodes mål var pragmatiska: leverera något snabbt, håll runtime liten och låt communityn fylla luckor. Det hjälpte Node att spridas snabbt, men satte också mönster som blev svåra att ändra senare — särskilt kring beroendekultur och standardinställningar.

Deno: ompröva antaganden efter ett decennium av lärdomar

Nästan tio år senare presenterade Dahl “10 Things I Regret About Node.js”, där han pekade ut problem han ansåg var inbyggda i ursprungsdesignen. Deno är ett “andra utkast” format av de insikterna, med tydligare standarder och en mer åsiktsdriven utvecklarupplevelse.

Istället för att maximera flexibilitet först lutar Deno mot säkerare körning, modern språksupport (TypeScript) och inbyggda verktyg så att team behöver färre tredjepartsdelar bara för att komma igång.

Temat över båda runtimes är inte att den ena är “rätt” — det är att begränsningar, adoption och efterklokhet kan få samma person att optimera för väldigt olika resultat.

Node.js-grunder: event loop, icke-blockerande I/O, verklig påverkan

Node.js kör JavaScript på en server, men dess kärnidée handlar mer om hur den hanterar väntan.

Event loop, på vanligt språk

Det mesta backend-arbetet är väntan: en databasfråga, en filinläsning, ett nätverksanrop till en annan tjänst. I Node.js är event loop som en koordinator som håller koll på dessa uppgifter. När din kod startar en operation som tar tid (som en HTTP-begäran) lämnar Node den väntande delen till systemet och går genast vidare.

När resultatet är klart köar event loopen en callback (eller löser en Promise) så att din JavaScript kan fortsätta med svaret.

Icke-blockerande I/O och “enkelt tråd” samtidighet

Node.js JavaScript körs i en enkel huvudtråd, vilket betyder att en bit JS exekveras åt gången. Det låter begränsande tills du inser att designen är att undvika att göra “väntande” arbete i den tråden.

Icke-blockerande I/O innebär att din server kan ta emot nya förfrågningar medan tidigare fortfarande väntar på databasen eller nätverket. Samtidighet uppnås genom:

- Att låta OS hantera många I/O-operationer parallellt

- Att använda event loopen för att återuppta rätt förfrågan när dess I/O är klar

Detta är anledningen till att Node kan kännas “snabbt” under många samtidiga anslutningar, även om din JS inte körs parallellt i huvudtråden.

Praktiska konsekvenser: CPU-bundet arbete och avlastning

Node är utmärkt när mest tid spenderas på väntan. Den kämpar när appen spenderar mycket tid på beräkningar (bildbearbetning, storskalig kryptering, stora JSON-transformationer), eftersom CPU-tungt arbete blockerar den enkla tråden och fördröjer allt annat.

Vanliga alternativ:

- Worker threads för CPU-tunga uppgifter som måste ligga i-process

- Flytta beräkning till separata tjänster (jobbköer, dedikerade compute-workers)

- Använda native-moduler eller externa verktyg där det är lämpligt

Var Node.js brukar passa bra

Node glänser ofta för API:er och backend-for-frontend-servrar, proxies och gateways, realtidsappar (WebSockets) och utvecklarvänliga CLI:er där snabb uppstart och ett rikt ekosystem spelar roll.

Vad Node.js optimerade för — och vad det gav upp

Node.js byggdes för att göra JavaScript praktiskt som serverspråk, särskilt för appar som spenderar mycket tid på nätverksväntan: HTTP-förfrågningar, databaser, filinläsningar och API:er. Dess centrala satsning var att genomströmning och responsivitet betyder mer än “en tråd per förfrågan.”

Kärndesignen: V8 + libuv + ett litet standardbibliotek

Node parar Googles V8-motor (snabb JavaScript-exekvering) med libuv, ett C-bibliotek som hanterar event loop och icke-blockerande I/O över operativsystem. Den kombinationen lät Node förbli processsingel och eventdriven samtidigt som den presterade bra under många samtidiga anslutningar.

Node levererade också pragmatiska kärnmoduler — särskilt http, fs, net, crypto och stream — så att du kunde bygga riktiga servrar utan att vänta på tredjepartspaket.

Kompromiss: ett litet standardbibliotek höll Node lätt, men det pressade också utvecklare mot externa beroenden tidigare än i vissa andra ekosystem.

Från callbacks till async/await: kraft med ärr

Tidigt lutade Node tungt på callbacks för att uttrycka “gör detta när I/O är klart.” Det passade bra för icke-blockerande I/O, men ledde till inbäddad kod och förvirrande felhantering.

Med tiden gick ekosystemet över till Promises och sedan async/await, vilket gjorde att kod läste mer som synkron logik samtidigt som icke-blockerande beteende bevarades.

Kompromiss: plattformen behövde stödja flera generationsmönster, och tutorials, bibliotek och teamkodbaser blandade ofta stilar.

Backward compatibility: stabilitet som fördröjer större rengöringar

Nodes åtagande till bakåtkompatibilitet gjorde det säkert för företag: uppgraderingar bryter sällan allt över en natt och kärn-API:er tenderar att förbli stabila.

Kompromiss: den stabiliteten kan fördröja eller komplicera “stora rena brott”. Vissa inkonsekvenser och legacy-API:er finns kvar eftersom borttagning skulle skada existerande appar.

Native addons: stor räckvidd, mer komplexitet

Nodes möjlighet att anropa C/C++-bindings möjliggjorde prestandakritiska bibliotek och åtkomst till systemfunktioner via native addons.

Kompromiss: native addons kan introducera plattformsberoende byggen, svåra installationsfel och säkerhets-/uppdateringsbörda — särskilt när beroenden kompileras olika över miljöer.

Sammantaget optimerade Node för att snabbt leverera nätverkstjänster och hantera mycket I/O effektivt — samtidigt som man accepterade komplexitet i kompatibilitet, beroendekultur och långsiktig API-evolution.

npm och Node-ekosystemet: kraft, komplexitet och risk

npm är en stor anledning till att Node.js spreds så snabbt. Det förvandlade “jag behöver en webbserver + loggning + databashanterare” till ett par kommandon, med miljoner paket redo att kopplas in. För team betydde det snabbare prototyper, delade lösningar och en gemensam vokabulär för återanvändning.

Varför npm gjorde Node produktivt

npm sänkte kostnaden för att bygga backend genom att standardisera hur du installerar och publicerar kod. Behöver du JSON-validering, en date-hjälpare eller en HTTP-klient? Det finns sannolikt ett paket — med exempel, issues och community-kunskap. Detta snabbar upp leverans, särskilt när du sätter ihop många små funktioner under deadline.

Beroendeträd: där smärtan börjar

Kompromissen är att ett direkt beroende kan dra in dussintals (eller hundratals) indirekta beroenden. Med tiden stöter team ofta på:

- Storlek och duplicering: flera versioner av samma bibliotek installeras eftersom olika paket kräver olika intervall.

- Operativ dragkraft: installationer kan bli långsamma, CI-cachar växer och “funkar på min maskin” blir vanligare.

- Supply-chain-risk: ju större trädet är, desto mer förlitar du dig på underhållare du aldrig träffat — och desto mer attraktivt blir det för kontoövertaganden eller skadliga uppdateringar.

SemVer: förväntningar vs verklighet

Semantisk versionering (SemVer) låter tryggt: patchar är säkra, minor lägger till funktioner utan att bryta och major kan bryta. I praktiken stressar stora beroende grafer det löftet.

Underhållare publicerar ibland brytande förändringar som minor, paket överges eller en “säker” uppdatering triggar beteendeförändringar genom ett djupt transitivt beroende. När du uppdaterar en sak kan du i praktiken uppdatera många.

Praktiska styrmedel som fungerar

Några vanor minskar risken utan att sakta ner utveckling:

- Använd lockfiles (

package-lock.json,npm-shrinkwrap.json, elleryarn.lock) och committa dem. - Pin eller snäva kritiska beroenden, särskilt säkerhetskänsliga.

- Audita regelbundet:

npm auditär ett baslinjeverktyg; överväg schemalagd beroenderevision. - Föredra färre, välkända paket framför många små; ta bort beroenden du inte längre använder.

- Automatisera uppdateringar försiktigt (t.ex. grupperade PR:er med tester innan merge).

npm är både en accelerator och ett ansvar: det gör byggandet snabbt, och det gör beroendehygien till en verklig del av backend-arbetet.

Verktyg och arbetsflöden i Node: flexibilitet med extra setup

Hoppa över verktygskedjans spridning

Starta ett rent projekt och fokusera på runtime-tradeoffs, inte på scaffolding.

Node.js är känt för att vara oåsiktsfullt. Det är en styrka — team kan sätta ihop exakt det arbetsflöde de vill — men det betyder också att ett “typiskt” Node-projekt egentligen är en konvention byggd av communityvanor.

Hur Node-projekt organiserar skript

De flesta Node-repo centrerar kring en package.json med skript som fungerar som en kontrollpanel:

dev/startför att köra appenbuildför att kompilera eller paketera (när det behövs)testför att köra testlöparelintochformatför att upprätthålla kodstil- ibland

typechecknär TypeScript är involverat

Detta mönster fungerar väl eftersom varje verktyg kan kopplas in i skript, och CI/CD-system kan köra samma kommandon.

Verktygslagren du ofta staplar

Ett Node-arbetsflöde blir ofta en uppsättning separata verktyg, var och ett löser en bit:

- Transpilrar (TypeScript-kompilatorn, Babel) för att göra modern syntax körbar

- Bundlers (Webpack, Rollup, esbuild, Vite) för att paketera kod för distribution eller webbläsare

- Linters/formatters (ESLint, Prettier) för kodkonsistens

- Testrunner (Jest, Mocha, Vitest) plus assertions- och mocking-bibliotek

Inget av detta är “fel” — det är kraftfullt, och team kan välja bästalternativ. Kostnaden är att du integrerar en verktygskedja, inte bara skriver applikationskod.

Var friktion visar sig

Eftersom verktyg utvecklas självständigt kan Node-projekt stöta på praktiska problem:

- Konfigurationssprawl: flera configfiler (eller djupt inbäddade alternativ) som nya kollegor måste lära sig

- Versionsmismatch: en plugin förväntar sig en annan majorversion av linter, bundler eller TypeScript

- Miljödrift: lokala Node-versioner skiljer sig från CI eller produktion, vilket leder till “funkar på min maskin”-buggar

Med tiden har dessa problem påverkat nyare runtimes — särskilt Deno — att leverera fler standarder (formatterare, linter, testlöpare, TypeScript-stöd) så att team kan börja med färre rörliga delar och bara lägga till komplexitet när det är tydligt motiverat.

Varför Deno skapades: ompröva tidigare antaganden

Deno skapades som ett andra försök till en JavaScript/TypeScript-serverruntime — en som omprövar vissa tidiga Node-beslut efter år av verklig användning.

Ryan Dahl har offentligt reflekterat över vad han skulle ändra om han börjat om: friktionen orsakad av komplexa beroendeträd, avsaknaden av en förstklassig säkerhetsmodell och det “bolt-on”-karaktär av utvecklarbekvämligheter som blev nödvändiga över tid. Deno:s motivationer kan sammanfattas som: förenkla standardarbetsflödet, göra säkerhet till en tydlig del av runtimen och modernisera plattformen kring standarder och TypeScript.

“Secure by default” i praktiska termer

I Node.js kan ett skript vanligen nå nätverket, filsystemet och miljövariabler utan att fråga. Deno vänder på det. Som standard körs ett Deno-program med inga behörigheter.

I vardagen innebär det att du ger behörigheter avsiktligt vid körning:

- Tillåt att läsa en mapp:

--allow-read=./data - Tillåt nätverksanrop till en host:

--allow-net=api.example.com - Tillåt miljövariabler:

--allow-env

Detta förändrar vanor: du tänker på vad programmet faktiskt ska få göra, kan hålla behörigheter snäva i produktion och får en tydligare signal när kod försöker göra något oväntat. Det är inte en komplett säkerhetslösning i sig (du behöver fortfarande kodgranskning och supply-chain-hygien), men det gör "minsta privilegium" till standardvägen.

URL-baserade imports och en annan beroendementalitet

Deno stödjer att importera moduler via URL:er, vilket förändrar hur du tänker kring beroenden. Istället för att installera paket i ett lokalt node_modules-träd kan du referera kod direkt:

import { serve } from "https://deno.land/std/http/server.ts";

Detta uppmuntrar team att vara mer explicita om var koden kommer ifrån och vilken version som används (ofta genom att pinna URL:er). Deno cachar också remote-moduler, så du laddar inte ner dem varje körning — men du behöver fortfarande en strategi för versionering och uppdateringar, liknande hur du hanterar npm-uppgraderingar.

Ett alternativ, inte en universell ersättning

Deno är inte “Node.js men bättre för alla projekt.” Det är en runtime med andra standardinställningar. Node.js förblir ett starkt val när du förlitar dig på npm-ekosystemet, befintlig infrastruktur eller etablerade mönster.

Deno är lockande när du värderar inbyggda verktyg, en behörighetsmodell och ett mer standardiserat, URL-först import-sätt — särskilt för nya tjänster där dessa antaganden passar från dag ett.

Säkerhetsmodell: Deno-behörigheter vs Node-standard

Minska dina byggkostnader

Få krediter genom att dela innehåll om Koder.ai eller bjuda in kollegor.

En viktig skillnad mellan Deno och Node.js är vad ett program får göra “som standard.” Node utgår från att om du kan köra skriptet, så kan det nå allt den användaren har åtkomst till: nätverk, filer, miljövariabler med mera. Deno vänder den antagningen: skript startar med inga behörigheter och måste be om åtkomst uttryckligen.

Denos behörighetsmodell på enkelt språk

Deno behandlar känsliga möjligheter som spärrade funktioner. Du ger dem vid körning (och kan avgränsa dem):

- Network (

--allow-net): Om koden kan göra HTTP-förfrågningar eller öppna sockets. Du kan begränsa till specifika hosts (t.ex. baraapi.example.com). - Filsystem (

--allow-read,--allow-write): Om koden kan läsa eller skriva filer. Du kan begränsa till vissa mappar (t.ex../data). - Miljö (

--allow-env): Om koden kan läsa hemligheter och konfiguration från miljövariabler.

Detta gör "blast radius" för ett beroende eller en inklistrad kodbit mindre, eftersom den inte automatiskt kan nå platser den inte borde.

Säkrade standarder: skript och små tjänster

För engångsskript minskar Deno:s standarder oavsiktlig exponering. Ett CSV-parsningsskript kan köras med --allow-read=./input och inget annat — så även om ett beroende är komprometterat kan det inte ringa hem utan --allow-net.

För små tjänster kan du vara explicit om vad tjänsten behöver. En webhook-mottagare kan få --allow-net=:8080,api.payment.com och --allow-env=PAYMENT_TOKEN, men ingen filsystemåtkomst, vilket gör dataexfiltrering svårare om något går fel.

Kompromissen: bekvämlighet vs explicit åtkomst

Node:s angreppssätt är bekvämt: färre flaggor, färre “varför misslyckas detta?”-stunder. Deno:s angreppssätt lägger till friktion — särskilt i början — eftersom du måste besluta och deklarera vad programmet får göra.

Den friktionen kan vara en funktion: den tvingar team att dokumentera avsikt. Men den betyder också mer setup och ibland felsökning när en saknad behörighet blockerar en begäran eller filinläsning.

Göra behörigheter till del av CI och kodgranskning

Team kan behandla behörigheter som en del av en apps kontrakt:

- Committa exakta körkommandon (eller tasker) som inkluderar behörigheter, så att “funkar på min maskin” blir mindre sannolikt.

- Granska behörighetsändringar som API-ändringar: om en PR lägger till

--allow-enveller vidgar--allow-read, fråga varför. - CI-kontroller: kör tester med minimala behörigheter och faila om ett test kräver oväntad åtkomst.

Används konsekvent blir Deno-behörigheter en lättviktig säkerhetschecklista som lever intill hur du kör koden.

TypeScript och inbyggda verktyg: arbetsflödesskillnader i Deno

Deno behandlar TypeScript som förstaklass-medborgare. Du kan köra en .ts-fil direkt, och Deno hanterar kompilationssteget bakom kulisserna. För många team förändrar det ett projekts “form”: färre setupbeslut, färre rörliga delar och en tydligare väg från “ny repo” till “fungerande kod.”

TypeScript först: vad det förändrar

Med Deno är TypeScript inte ett valfritt tillägg som kräver en separat bygge-kedja från dag ett. Du börjar typiskt inte med att välja bundler, koppla tsc och konfigurera flera skript bara för att köra lokalt.

Det betyder inte att typer försvinner — typer är fortfarande viktiga. Det betyder att runtimen tar ansvar för vanliga TypeScript-friktioner (köra, cacha kompilerad output och alignera runtime-beteende med typkontroller) så projekt kan standardiseras snabbare.

Inbyggda verktyg: färre beslut, mer konsistens

Deno levereras med en uppsättning verktyg som täcker det mesta team når efter ett tag:

- Formatterare (

deno fmt) för konsekvent kodstil - Linter (

deno lint) för vanliga kvalitets- och korrekthetskontroller - Testrunner (

deno test) för att köra enhet och integrationstester

Eftersom dessa är inbyggda kan ett team anta delade konventioner utan att debattera “Prettier vs X” eller “Jest vs Y” i början. Konfiguration är ofta centraliserad i deno.json, vilket hjälper till att hålla projekt förutsägbara.

Jämfört med Node: flexibilitet med extra montering

Node-projekt kan helt stödja TypeScript och bra verktyg — men du sätter oftast ihop arbetsflödet själv: typescript, ts-node eller build-steg, ESLint, Prettier och en testramverk. Den flexibiliteten är värdefull, men kan också leda till inkonsekventa uppsättningar mellan repor.

Integrationspunkter: editorstöd och konventioner

Denos språktjänst och editorintegrationer försöker göra formattering, lintning och TypeScript-feedback enhetlig över maskiner. När alla kör samma inbyggda kommandon krymper ofta “funkar på min maskin”-problem — särskilt runt formatering och lint-regler.

Moduler och beroendehantering: olika vägar till att leverera kod

Hur du importerar kod påverkar allt som följer: mappstruktur, verktyg, publicering och hur snabbt ett team kan granska förändringar.

Node.js: CommonJS först, ES-moduler senare

Node växte fram med CommonJS (require, module.exports). Det var enkelt och fungerade med tidiga npm-paket, men det är inte samma modulsystem som webbläsarna standardiserade.

Node stödjer nu ES-moduler (ESM) (import/export), ändå lever många verkliga projekt i en blandad värld: vissa paket är CJS-only, vissa ESM-only och appar behöver ibland adaptrar. Det kan visa sig som byggflaggor, filändelser (.mjs/.cjs) eller package.json-inställningar ("type": "module").

Beroendemodellen är typiskt paket-namn imports lösta via node_modules, med versionering kontrollerad av en lockfile. Det är kraftfullt, men det betyder också att install- steget och beroendeträdet kan bli en del av din dagliga felsökning.

Deno: ESM-först med URL-stil imports

Deno började från antagandet att ESM är standard. Imports är explicita och ser ofta ut som URL:er eller absoluta sökvägar, vilket gör det tydligare var koden kommer ifrån och minskar “magisk upplösning.”

För team är den största förändringen att beroendebeslut syns mer i kodgranskningar: en importrad talar ofta om exakt källa och version.

Import maps: göra imports läsbara och stabila

Import maps låter dig definiera alias som @lib/ eller låsa en lång URL till ett kort namn. Team använder dem för att:

- undvika att upprepa långa versionerade URL:er överallt

- centralisera uppgraderingar (ändra mappen en gång, inte i varje fil)

- hålla interna modulgränser rena

De är särskilt hjälpsamma i kodbaser med många delade moduler eller när du vill konsistenta namn över appar och skript.

Paketering och distribution: bibliotek vs appar vs skript

I Node publiceras bibliotek ofta till npm; appar distribueras med sina node_modules (eller bundle:as); skript litar ofta på en lokal installation.

Deno gör skript och små verktyg lättare att köra (körs direkt med imports), medan bibliotek tenderar att betona ESM-kompatibilitet och tydliga entry points.

En enkel beslutsguide

Om du underhåller en legacy Node-kodbas, stanna kvar i Node och inför ESM gradvis där det minskar friktion.

För en ny kodbas, välj Deno om du vill ha ESM-först struktur och import-map-kontroll från dag ett; välj Node om du är beroende av specifika npm-paket och mogna Node-verktyg.

Att välja Node.js vs Deno: en praktisk checklista för team

Välj Node eller Deno med eftertanke

Använd Planning Mode för att kartlägga endpoints, data och uppgifter innan du skriver något.

Att välja runtime handlar mindre om “bättre” och mer om passform. Det snabbaste sättet att bestämma är att enas om vad teamet måste leverera under de nästa 3–12 månaderna: var det körs, vilka bibliotek ni förlitar er på och hur mycket operationell förändring ni kan hantera.

En snabb beslutschecklista

Ställ dessa frågor i ordning:

- Teamets erfarenhet: Har ni redan starka Node.js-färdigheter och etablerade mönster (frameworks, testning, CI-mallar)? Om ja, innebär en switch verklig kostnad.

- Deploy-mål: Distribuerar ni till serverless, containers, edge-runtimes eller egna servrar? Verifiera förstklassigt stöd och lokal-till-prod-paritet.

- Ekosystembehov: Behöver ni specifika paket (ORMs, auth-SDK:er, observability agents, företagsintegrationer)? Kontrollera mognad och underhållsstatus.

- Säkerhetspolicy: Behöver ni starka skydd för skript och tjänster som körs med åtkomst till filer, nätverk och miljövariabler?

- Verktygsförväntningar: Föredrar ni att “ta med egna verktyg”, eller vill ni ha en runtime som levererar fler inbyggda verktyg (formatterare, lint, test) för att minska setup-drift?

- Operationella begränsningar: Vilka övervaknings-, felsöknings- och incidenthanteringsarbetsflöden har ni redan? Att byta runtime kan ändra hur ni diagnosticerar problem.

Om ni utvärderar runtimes samtidigt som ni måste pressa fram tid-till-leverans kan det hjälpa att separera runtime-valet från implementeringsinsatsen. Plattformar som Koder.ai låter team prototypa och leverera web, backend och mobilappar genom ett chattdrivet arbetsflöde (med kodexport när du behöver det). Det gör det enklare att köra en liten “Node vs Deno”-pilot utan att binda veckor i scaffolding.

Vanliga scenarier där Node.js är säkrare

Node vinner ofta när ni har befintliga Node-tjänster, behöver mogna bibliotek och integrationer, eller måste följa ett etablerat produktionsplaybook. Det är också ett starkt val när rekrytering och onboardingstid spelar roll, eftersom många utvecklare redan har erfarenhet.

Vanliga scenarier där Deno passar bra

Deno passar ofta bäst för säkra automationsskript, interna verktyg och nya tjänster där du vill ha TypeScript-först utveckling och en mer enhetlig inbyggd verktygskedja med färre tredjepartsbeslut.

Minska risk med en liten pilot

Istället för en fullständig omskrivning, välj ett avgränsat användningsfall (en worker, en webhook-handler, ett schemalagt jobb). Definiera framgångskriterier i förväg — buildtid, felrate, cold-start-prestanda, säkerhetsgranskningsarbete — och tidbegränsa piloten. Om den lyckas har ni en reproducerbar mall för bredare adoption.

Adoption och migration: minimera risk samtidigt som ni moderniserar

Migration är sällan en big-bang. De flesta team adopterar Deno i skivor — där nyttan är tydlig och blast radius är liten.

Hur adoption ser ut i praktiken

Vanliga startpunkter är interna verktyg (release-skript, repo-automation), CLI-verktyg och edge-tjänster (lätta API:er nära användarna). Dessa områden har ofta färre beroenden, tydligare gränser och enklare prestandaprofil.

För produktionssystem är partiell adoption normalt: behåll kärn-API:t i Node.js samtidigt som du inför Deno för en ny tjänst, en webhook-handler eller ett schemalagt jobb. Med tiden lär du dig vad som passar utan att tvinga hela organisationen att byta samtidigt.

Kompatibilitetskontroller att göra tidigt

Innan ni bestämmer er, validera några realiteter:

- Bibliotek: Är ni beroende av Node-only paket, native addons eller djupa npm-verktyg?

- Runtime-API:er: Node-globals och moduler mappar inte alltid 1:1 till Deno (och vice versa).

- Distribueringsplattform: Vissa hosts antar Node-konventioner; bekräfta stöd för Deno, containers eller edge-runtimes.

- Observerbarhet: Loggning, tracing och felrapportering bör fungera likadant över tjänster.

En fasad strategi som minskar risk

Börja med en av dessa vägar:

- Bygg en Deno-CLI som läser/skriver filer och anropar interna API:er.

- Släpp en isolerad tjänst med ett snävt kontrakt (en endpoint, en kö-konsument).

- Lägg till delade konventioner: formattering, lintning, dependency-policys och säkerhetsgranskningar.

Avslutning

Val av runtime ändrar inte bara syntax — det formar säkerhetsvanor, verktygsförväntningar, rekryteringsprofiler och hur ditt team underhåller system år framöver. Behandla adoption som en arbetsflödesutveckling, inte som ett omskrivningsprojekt.

Vanliga frågor

Vad betyder “JavaScript runtime” utöver att bara köra kod?

Ett runtime är körmiljön plus dess inbyggda API:er, förväntningar kring verktyg, säkerhetsstandarder och distributionsmodell. Dessa val påverkar hur du strukturerar tjänster, hanterar beroenden, felsöker i produktion och standardiserar arbetsflöden över repor — inte bara rå prestanda.

Varför spelade Node.js event-driven-modell roll för backendutveckling?

Node populariserade en event-driven, icke-blockerande I/O-modell som hanterar många samtidiga anslutningar effektivt. Det gjorde JavaScript praktiskt för I/O-intensiva servrar (API:er, gateways, realtid) samtidigt som det tvingade team att tänka noga på CPU-intensivt arbete som kan blockera huvudtråden.

När har Node.js problem, och vilka vanliga sätt finns för att hantera det?

Node:s huvudsakliga JavaScript-tråd kör ett stycke JS i taget. Om du gör tung beräkning i den tråden väntar allt annat.

Praktiska åtgärder:

- Använd worker threads för CPU-tunga uppgifter som måste ligga i processen

- Flytta beräkning till bakgrundsarbetare via köer

- Flytta tung bearbetning till separata tjänster eller verktyg

Vilka är kompromisserna med att Node.js har ett relativt litet standardbibliotek?

Ett mindre standardbibliotek håller runtime lätt och stabil, men det ökar ofta beroendet av tredjepartspaket för vardagliga behov. Med tiden kan det innebära mer beroendehantering, större säkerhetsgranskningar och mer underhåll av verktygskedjan.

Hur ökar npm produktiviteten, och vilka risker följer med det?

npm snabbar upp utveckling genom att återanvändning blir trivial, men det skapar också stora transitiva beroendeträd.

Vanliga skyddsåtgärder som hjälper:

- Committa lockfiles och använd dem i CI

- Pin eller snäva versionsintervall för kritiska/ säkerhetskänsliga beroenden

- Kör

npm auditoch gör regelbundna beroenderevisioner - Ta bort oanvända beroenden och kräva tester för beroendeuppdateringar

Varför kan SemVer ändå leda till fel i Node.js-projekt?

I verkliga beroende- grafer kan uppdateringar dra in många transitiva förändringar, och inte alla paket följer SemVer perfekt.

För att minska överraskningar:

- Använd konservativa versionintervall för kärnberoenden

- Använd lockfiles för reproducerbara installationer

- Batcha uppdateringar och lita på automatiska tester för att fånga beteendeförändringar

Vad orsakar “tooling sprawl” i Node.js, och hur minskar team det?

Node-projekt sätter ofta ihop separata verktyg för formattering, linting, testning, TypeScript och bundling. Denna flexibilitet är kraftfull men kan skapa konfigurationssprawl, versionskonflikter och miljödrift.

Praktiska åtgärder: standardisera scripts i package.json, pinna verktygsversioner och lås en Node-version i både lokalt och CI.

Varför skapades Deno, och vad försöker det förändra?

Deno byggdes som ett “andra utkast” som omprövar beslut från Node-eran: det är TypeScript-först, levererar inbyggda verktyg (fmt/lint/test), använder ESM-först moduler och betonar ett behörighetsbaserat säkerhetsmodell.

Bäst att se det som ett alternativ med andra standardinställningar, inte som en universell ersättning för Node.

Hur skiljer sig Denos behörighetsmodell från Node.js standard?

Node tillåter vanligtvis full tillgång till nätverk, filsystem och miljövariabler för processen som körs. Deno nekar dessa möjligheter som standard och kräver explicita flaggor (t.ex. --allow-net, --allow-read).

I praktiken uppmuntrar detta till principen om minst privilegium och gör ändringar i behörigheter granskbara tillsammans med kodändringar.

Hur bör ett team välja mellan Node.js och Deno för en ny tjänst?

Börja med en liten, avgränsad pilot (en webhook-handler, ett schemalagt jobb eller en intern CLI) och definiera framgångskriterier (distribuerbarhet, prestanda, observerbarhet, underhållsarbete).

Tidig kontrolllista:

- Beroendekompatibilitet (Node-only paket, native addons)

- Distribueringsstöd på target-plattformen

- Loggning/spårning/felrapportering fungerar lika bra som i befintliga tjänster