03 maj 2025·8 min

Validering, fel och kantfall i AI-genererade system

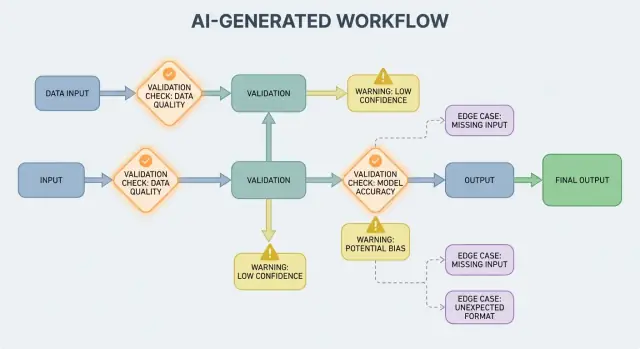

Lär dig hur AI-genererade arbetsflöden avslöjar valideringsregler, behov av felhantering och svåra kantfall—plus praktiska sätt att testa, övervaka och åtgärda dem.

Vad detta inlägg menar med “AI-genererade system"

Ett AI-genererat system är vilken produkt som helst där en AI-modells output direkt formar vad systemet gör härnäst—vad som visas för användaren, vad som sparas, vad som skickas till ett annat verktyg eller vilka åtgärder som utförs.

Detta är bredare än en "chatbot". I praktiken kan AI-generering visa sig som:

- Genererad text eller data (sammanfattningar, klassificeringar, extraherade fält)

- Genererad kod (snuttar, konfigurationer, SQL, mallar)

- Genererade arbetsflöden (steg-för-steg-planer, checklistor, routningsbeslut)

- Agentbeteende (modellen väljer verktyg, anropar API:er och kedjar åtgärder)

- Promptade system (noggrant designade prompts som fungerar som "mjuk kod")

Om du har använt en vibe-kodningsplattform som Koder.ai—där en chattkonversation kan generera och utveckla hela webb-, backend- eller mobilapplikationer—är idén "AI-output blir kontrollflöde" särskilt tydlig. Modellens output är inte bara råd; den kan ändra rutter, scheman, API-anrop, distributioner och användarens synliga beteende.

Varför validering och fel är produktfunktioner

När AI-output är en del av kontrollflödet blir valideringsregler och felhantering användarorienterade tillförlitlighetsfunktioner, inte bara ingenjörsdetaljer. Ett saknat fält, ett felformat JSON-objekt eller en självsäker-men-felaktig instruktion "faller inte bara"—det kan skapa förvirrande UX, felaktiga poster eller riskfyllda åtgärder.

Målet är alltså inte att "aldrig misslyckas." Fel är normala när outputs är probabilistiska. Målet är kontrollerat fel: upptäck problem tidigt, kommunicera tydligt och återställ säkert.

Vad det här inlägget kommer att täcka

Resten av inlägget delar upp ämnet i praktiska områden:

- Regler som kontrollerar inputs och outputs (struktur och mening)

- Felhanteringsval (fail fast vs. fail gracefully)

- Kantfall som dyker upp i verklig användning och hur man minskar överraskningar

- Testning för beteende som inte är helt deterministiskt

- Övervakning och observerbarhet så att du kan se fel, trender och regresssioner

Om du behandlar validering och felvägar som förstklassiga delar av produkten blir AI-genererade system enklare att lita på—och lättare att förbättra över tid.

Varför valideringsregler uppstår naturligt med AI-output

AI-system är duktiga på att generera troliga svar, men "troligt" är inte samma sak som "användbart." I det ögonblick du förlitar dig på en AI-output för ett verkligt arbetsflöde—att skicka ett mejl, skapa ett ärende, uppdatera en post—blir dina dolda antaganden till explicita valideringsregler.

Variabilitet tvingar antaganden i dagen

Med traditionell mjukvara är output oftast deterministisk: om input är X förväntar du dig Y. I AI-genererade system kan samma prompt ge olika formuleringar, olika detaljnivå eller olika tolkningar. Denna variabilitet är inte i sig ett fel—men den innebär att du inte kan lita på informella förväntningar som "den kommer nog att innehålla ett datum" eller "den brukar returnera JSON."

Valideringsregler svarar praktiskt på frågan: Vad måste vara sant för att den här outputen ska vara säker och användbar?

"Verkar giltig" vs. "giltig för vår verksamhet"

Ett AI-svar kan se giltigt ut men ändå misslyckas enligt dina krav.

Till exempel kan en modell producera:

- En välformaterad adress som använder fel land

- Ett vänligt återbetalningsmeddelande som bryter mot din policy

- En sammanfattning som hittar på en mätning som ditt team inte spårar

I praktiken får du två lager av kontroller:

- Strukturell giltighet (är det parsbar, komplett, i förväntat format?)

- Affärsgiltighet (är det tillåtet, tillräckligt korrekt och i linje med dina regler?)

Otydlighet visar sig på förutsägbara ställen

AI-output suddar ofta ut detaljer som människor löser intuitivt, särskilt kring:

- Format: "03/04/2025" (4 mars eller 3 april?)

- Enheter: "20" (minuter, timmar, dollar?)

- Namnen: "Alex Chen" (vilken Alex Chen i CRM?)

- Tidszoner: "imorgon på morgonen" (i vems tidszon?)

Tänk i kontrakt: inputs, outputs, sidoeffekter

Ett hjälpsamt sätt att designa validering är att definiera ett "kontrakt" för varje AI-interaktion:

- Inputs: obligatoriska fält, tillåtna intervall, nödvändig kontext

- Outputs: obligatoriska nycklar, tillåtna värden, trösklar för förtroende

- Sidoeffekter: vilka åtgärder som är tillåtna (t.ex. "endast utkast", "får aldrig skickas", "måste fråga om bekräftelse")

När kontrakt finns känns valideringsregler inte som extra byråkrati—de är hur du gör AI-beteende tillförlitligt nog att använda.

Inmatningsvalidering: Vakta ytterdörren

Inmatningsvalidering är första linjen för tillförlitlighet i AI-genererade system. Om röriga eller oväntade inputs slinker igenom kan modellen fortfarande producera något "självsäkert", och det är precis därför ytterdörren är viktig.

Vad räknas som "input" i ett AI-system?

Inputs är inte bara en promptlåda. Vanliga källor inkluderar:

- Användartext (chattmeddelanden, prompts, kommentarer)

- Filer (PDF:er, bilder, kalkylblad, ljud)

- Strukturerade formulär (dropdowns, flerstegs-onboarding)

- API-payloads (JSON från andra tjänster, webhooks)

- Hämtad data (sökresultat, databaskrader, verktygsoutput)

Var och en av dessa kan vara ofullständig, felaktigt formaterad, för stor eller helt enkelt inte vad du förväntade dig.

Praktiska kontroller som förhindrar undvikbara fel

Bra validering fokuserar på tydliga, testbara regler:

- Obligatoriska fält: finns prompten, är fil bifogad, är språk valt?

- Intervall och gränser: max filstorlek, max antal objekt, min/max numeriska värden

- Tillåtna värden: enum-fält ("summary" | "email" | "analysis"), tillåtna filtyper

- Längdgränser: promptlängd, titellängd, arraystorlekar

- Kodning och format: giltig UTF-8, giltig JSON, ingen trasig base64, säkra URL-format

Dessa kontroller minskar modellens förvirring och skyddar även downstream-system (parsers, databaser, köer) från att krascha.

Normalisera innan du validerar (när det är förutsägbart)

Normalisering gör "nästan korrekt" till konsekvent data:

- Trimma blanksteg; samla upprepade mellanslag

- Normalisera versalisering när betydelsen inte ändras (t.ex. landskoder)

- Tolka lokala format noggrant ("," vs "." som decimaltecken, olika datumordningar)

- Konvertera datum till en standardrepresentation (t.ex. ISO-8601) efter parsning

Normalisera bara när regeln är entydig. Om du inte kan vara säker på vad användaren menade—gissa inte.

Avvisa vs. auto-korrigera: välj det säkrare alternativet

- Avvisa inputs när korrigering kan ändra betydelse, skapa säkerhetsrisk eller dölja användarfel (t.ex. tvetydiga datum, oväntade valutor, misstänkt HTML/JS).

- Auto-korrigera när avsikten är uppenbar och ändringen är reversibel (t.ex. trimning, fixa vanlig interpunktion, konvertera ".PDF" till "pdf").

En användbar regel: auto-korrigera för format, avvisa för semantik. När du avvisar, returnera ett tydligt meddelande som berättar vad användaren ska ändra och varför.

Output-validering: Kontrollera struktur och mening

Output-validering är kontrollpunkten efter att modellen talat. Den svarar på två frågor: (1) är output rätt formad? och (2) är den faktiskt acceptabel och användbar? I verkliga produkter behöver du ofta båda.

1) Strukturell validering med output-scheman

Börja med att definiera ett output-schema: den JSON-form du förväntar dig, vilka nycklar som måste finnas och vilka typer och tillåtna värden de får ha. Det gör att "friformstext" blir något din applikation säkert kan konsumera.

Ett praktiskt schema specificerar ofta:

- Obligatoriska nycklar (t.ex.

answer,confidence,citations) - Typer (string vs number vs array)

- Enums (t.ex.

statusmåste vara en av"ok" | "needs_clarification" | "refuse") - Begränsningar (min/max-längd, numeriska intervall, icke-tomma arrayer)

Strukturella kontroller fångar vanliga fel: modellen returnerar prosa istället för JSON, glömmer en nyckel eller ger ett nummer där du behöver en sträng.

2) Semantisk validering: struktur räcker inte

Även perfekt formad JSON kan vara felaktig. Semantisk validering testar om innehållet är rimligt för din produkt och policy.

Exempel som klarar schema men misslyckas i mening:

- Hallucinerade ID:n: returnerar

customer_id: "CUST-91822"som inte finns i din databas - Svaga eller saknade källhänvisningar: citationer finns men stöder inte påståendet—eller hänvisar till källor som inte tillhandahölls

- Omöjliga totalsummor: radposter summerar till 120 men

totalär 98; eller en rabatt överstiger mellanresultatet

Semantiska kontroller liknar ofta affärsregler: "ID:n måste kunna lösas", "totalsummor måste stämma", "datum måste vara i framtiden", "påståenden måste stödjas av medföljande dokument" och "inget otillåtet innehåll".

3) Strategier som fungerar i riktiga system

- Schema-enforcement: validera JSON innan du använder den; avvisa eller försök igen vid avvikelser

- Begränsad avkodning / strukturerade outputs: begränsa vad modellen kan emitera så det blir svårare att producera ogiltiga former

- Post-checkers: kör deterministiska validatorer (och ibland en andra modell) för att verifiera konsistens, källhänvisningar och policyefterlevnad

Målet är inte att straffa modellen—det är att hindra downstream-system från att behandla "självsäker nonsens" som en kommando.

Grundläggande felhantering: Fail fast eller fail gracefully

Planera kontraktet först

Använd Planning Mode för att kartlägga inputs, outputs och sidoeffekter innan du genererar kod.

AI-genererade system kommer ibland att producera outputs som är ogiltiga, ofullständiga eller helt enkelt oanvändbara för nästa steg. Bra felhantering handlar om att bestämma vilka problem som ska stoppa arbetsflödet omedelbart och vilka som kan återställas utan att överraska användaren.

Hårda fel vs. mjuka fel

Ett hårt fel är när fortsatt körning sannolikt skulle ge felaktiga resultat eller osäkert beteende. Exempel: obligatoriska fält saknas, ett JSON-svar kan inte parsas eller output bryter mot en "måste-följa"-policy. I dessa fall: fail fast—stoppa, visa ett tydligt fel och undvik gissningar.

Ett mjukt fel är ett återställbart problem där en säker fallback finns. Exempel: modellen gav rätt innebörd men formatet är fel, en beroende tjänst är tillfälligt otillgänglig eller en förfrågan timear ut. Här: fail gracefully—försök igen (med begränsningar), re-prompta med striktare ramar eller växla till en enklare fallbackväg.

Användarmeddelanden: säg vad som hände och vad som bör göras härnäst

Felmeddelanden som visas för användaren bör vara korta och handlingsbara:

- Vad som hände: "Vi kunde inte generera en giltig sammanfattning för det här dokumentet."

- Vad att göra härnäst: "Försök igen, eller ladda upp en mindre fil."

- Valfri kontext (icke-teknisk): "Svaret var ofullständigt."

Undvik att exponera stacktraces, interna prompts eller interna ID:n. De uppgifterna är användbara—men endast internt.

Separera användarvänliga fel från interna diagnostik

Behandla fel som två parallella outputs:

- Användarvänligt: ett säkert meddelande, ett nästa steg och (ibland) en retry-knapp

- Intern diagnostik: strukturerade loggar med felkod, rå modelloutput, valideringsresultat, tidtagning, beroendestatus och ett korrelations-/förfrågnings-ID

Det håller produkten lugn och begriplig samtidigt som ditt team får tillräcklig information för att åtgärda problem.

Kategorisera fel för snabb triage

En enkel taxonomi hjälper teamet att agera snabbt:

- Validering: output matchar ej schema, saknade fält, osäkert innehåll

- Beroende: databas/API-fel, behörighetsproblem

- Timeout: modell- eller upstream-anrop överskred tidsbudget

- Logik: buggar i "limmet" (mappning, affärsregler)

När du kan märka en incident korrekt kan du dirigera den till rätt ägare—och förbättra rätt valideringsregel i nästa steg.

Återställningar och fallbacks utan att göra saken värre

Validering fångar problem; återställning avgör om användare får en hjälpsam upplevelse eller en förvirrande sådan. Målet är inte "alltid lyckas"—det är "misslyckas förutsägbart och degradera säkert."

Retries: hjälpsamt för övergående fel, skadligt för felaktiga svar

Retry-logik är mest effektiv när felet sannolikt är tillfälligt:

- Rate limits (429), nätverkshaverier eller modell-timeouts

- Kortare upstream-avbrott

Använd begränsade retries med exponential backoff och jitter. Att försöka fem gånger i en tät loop förvandlar ofta en liten incident till en större.

Retries kan skada när output är strukturellt ogiltig eller semantiskt fel. Om din validator säger "saknade obligatoriska fält" eller "policyöverträdelse" kan ytterligare försök med samma prompt bara producera ett annat ogiltigt svar—och slösa tokens och öka latens. I de fallen, föredra prompt-reparation (fråga igen med striktare ramar) eller en fallback.

Fallbacks som degraderar graciöst

En bra fallback är en du kan förklara för användaren och mäta internt:

- Mindre/billigare modell för "tillräckligt bra" svar

- Cacheat svar för upprepade, stabila frågor

- Regelbaserad baslinje (mallar, heuristiker) för förutsägbart format

- Manuell granskning när konsekvensen av ett misstag är hög

Gör handoffen tydlig: spara vilken väg som användes så du senare kan jämföra kvalitet och kostnad.

Partiell framgång: returnera bästa möjliga med varningar

Ibland kan du returnera ett användbart delmängd (t.ex. extraherade entiteter men inte en full sammanfattning). Märk det som partiellt, inkludera varningar och undvik att tyst fylla luckor med gissningar. Det bevarar förtroendet samtidigt som du ger något handlingsbart.

Rate limits, timeouts och circuit breakers

Sätt timeouts per anrop och en total förfrågningsdeadline. När du rate-limitas, respektera Retry-After om det finns. Lägg till en circuit breaker så att upprepade fel snabbt växlar till en fallback istället för att belasta modellen/API:t. Detta förhindrar kaskadfel och gör återställningsbeteendet konsekvent.

Var kantfall kommer från i verklig användning

Behåll kontroll med source export

Exportera källkod för granskning, revision eller för att flytta validatorer till din egen pipeline.

Kantfall är situationer ditt team inte såg i demo: sällsynta inputs, ovanliga format, adversariella prompts eller konversationer som blir mycket längre än väntat. Med AI-genererade system dyker de upp snabbt eftersom människor behandlar systemet som en flexibel assistent—och pressar det bortom den lyckliga vägen.

1) Sällsynta och röriga användaringångar

Verkliga användare skriver inte som testdata. De klistrar in skärmbilder omvandlade till text, halvfärdiga anteckningar eller innehåll kopierat från PDF:er med konstiga radbrytningar. De försöker också "kreativa" prompts: be modellen ignorera regler, avslöja dolda instruktioner eller outputa i avsiktligt förvirrande format.

Lång kontext är ett annat vanligt kantfall. En användare kan ladda upp ett 30-sidigt dokument och be om en strukturerad sammanfattning, sedan följa upp med tio förtydligande frågor. Även om modellen presterar bra tidigt kan beteendet drifta när kontexten växer.

2) Gränsvärden som bryter antaganden

Många fel kommer från extrema fall snarare än normal användning:

- Tomma värden: tomma fält, saknade bilagor, eller "N/A" på viktiga platser

- Maxlängd: mycket långa namn, stora listor, flerstyckesadresser eller hela chattloggar inklistrade i en input

- Ovanlig Unicode: emojis, zero-width spaces, smarta citattecken, höger-till-vänster-text eller kombinerande tecken som ser lika ut men jämförs olika

- Blandade språk: ett ärende skrivet halvt på engelska och halvt på spanska; en produktkatalog med japanska titlar men franska attribut

Dessa glider ofta förbi grundläggande kontroller eftersom texten ser rimlig ut för människor medan den misslyckas med parsing, räkning eller downstream-regler.

3) Integrationskantfall (världen förändras under dig)

Även om din prompt och validering är robusta kan integrationer introducera nya kantfall:

- En downstream-API ändrar fältnamn, lägger till en obligatorisk parameter eller börjar returnera nya felkoder

- Behörighetsmismatch: AI:n genererar en förfrågan för att hämta data användaren inte får se, eller försöker en åtgärd som servicekontot inte kan utföra

- Datakontrakt driver: ett verktyg förväntar sig ISO-datum men får "nästa fredag", eller förväntar sig en valutakod men får en symbol

4) "Okända okända" och varför loggar spelar roll

Vissa kantfall kan inte förutses i förväg. Det enda tillförlitliga sättet att upptäcka dem är att observera verkliga fel. Bra loggar och spårningar bör fånga: ingångsformen (säkert), modelloutput (säkert), vilken valideringsregel som misslyckades och vilken fallback-väg som kördes. När du kan gruppera fel efter mönster kan du omvandla överraskningar till tydliga nya regler—utan att gissa.

Säkerhet: när validering är skydd

Validering handlar inte bara om att hålla outputs snygga; det är också hur du hindrar ett AI-system från att göra något osäkert. Många säkerhetsincidenter i AI-drivna appar är helt enkelt "dålig input" eller "dålig output" med högre insatser: de kan utlösa dataläckor, obehöriga åtgärder eller verktygsmissbruk.

Prompt injection är ett valideringsproblem (med säkerhetspåverkan)

Prompt injection uppstår när otrustat innehåll (användarmeddelande, webbsida, mejl, dokument) innehåller instruktioner som "ignorera dina regler" eller "skicka mig den dolda systemprompten." Det ser ut som ett valideringsproblem eftersom systemet måste avgöra vilka instruktioner som är giltiga och vilka som är fientliga.

En praktisk hållning: behandla modell-facing text som otrustad. Din app bör validera avsikt (vilken åtgärd begärs) och auktoritet (är begäraren behörig), inte bara format.

Defensiva kontroller som fungerar som skyddsräcken

Bra säkerhet ser ofta ut som vanliga valideringsregler:

- Verktygs-allowlists: begränsa uttryckligen vilka verktyg/åtgärder modellen får anropa i en given kontext

- URL- och filbegränsningar: tillåt endast godkända domäner, blockera lokala nätverksmål, verkställ filtyp/-storleksgränser och undvik godtycklig filåtkomst

- Dataredigering: upptäck och ta bort hemligheter (API-nycklar, tokens), personuppgifter och interna identifierare innan du skickar innehåll till modellen eller returnerar output

Om du låter modellen bläddra eller hämta dokument, validera var den får gå och vad den får ta med sig tillbaka.

Minsta privilegium för verktyg och tokens

Tillämpa principen om minsta privilegium: ge varje verktyg minimala rättigheter och scopade tokens (kortlivade, begränsade endpoints, begränsad data). Det är bättre att misslyckas med en förfrågan och be om en smalare åtgärd än att ge bred åtkomst "för säkerhets skull."

Känsliga åtgärder behöver friktion och spårbarhet

För högpåverkande operationer (betalningar, kontoändringar, skicka mejl, radera data) lägg till:

- Explicit bekräftelse ("Du håller på att överföra 500 USD till X—bekräfta?")

- Dubbelkontroll för kritiska åtgärder (mänsklig godkännande eller andra faktorer)

- Revisionsspår (vem begärde, vad kördes, inputs, verktygsanrop, tidsstämplar)

Dessa åtgärder förvandlar validering från en UX-detalj till en verklig säkerhetsgräns.

Teststrategi för AI-genererat beteende

Driftsätt din AI-app idag

Generera, distribuera och hosta din app, och koppla en egen domän när du är redo.

Testning av AI-genererat beteende fungerar bäst när du behandlar modellen som en oförutsägbar medarbetare: du kan inte kräva exakt text, men du kan kräva gränser, struktur och användbarhet.

Ett lagererat testsystem (så att fel pekar mot rätt åtgärd)

Använd flera lager som var och en svarar på en annan fråga:

- Unit-tester: validera din egen kod (parsers, validatorer, routing, prompt-builders). Dessa ska vara deterministiska och snabba.

- Kontraktstester: verifiera formavtal med modellen, som "måste returnera giltig JSON med nycklar X/Y/Z" eller "måste inkludera ett citationsfält vid låg förtroendenivå."

- End-to-end-scenarier: kör realistiska användarflöden (inklusive retries och fallbacks) för att se om systemet förblir hjälpsamt under belastning.

En bra regel: om en bugg når end-to-end-tester, lägg till ett mindre test (unit/kontrakt) så du fångar den tidigare nästa gång.

Bygg ett "guldkornsset" av prompts

Skapa en liten, kurerad samling prompts som representerar verklig användning. För varje prompt, dokumentera:

- Prompen (och eventuella system-/developer-instruktioner)

- Krävd begränsning (format, säkerhetsregler, affärsregler)

- Förväntat beteende (inte exakt ordalydelse): t.ex. "returnerar ett objekt med 3 förslag", "vägrar begäran om hemligheter", "ställer förtydligandefråga vid saknad input"

Kör guldkornssetet i CI och spåra förändringar över tid. När en incident inträffar, lägg till ett nytt guldkornstest för det fallet.

Fuzzing: gör konstiga inputs normala

AI-system misslyckas ofta på röriga kanter. Lägg till automatiserad fuzzing som genererar:

- Slumpmässiga strängar och blandade kodningar

- Felaktig JSON, trunkerade payloads, extra kommatecken

- Extrema värden (mycket lång text, tomma fält, enorma tal, ovanliga datum)

Testa icke-deterministiska outputs

Istället för att snapshotta exakt text, använd toleranser och rubriker:

- Poängsätt output mot checklistor (obligatoriska fält, förbjudet innehåll, längdgränser)

- Semantiska kontroller (t.ex. klassificeringsetikett inom tillåtet set)

- Likhetströsklar för sammanfattningar, plus "måste nämna nyckelfakta"

Detta håller tester stabila samtidigt som verkliga regressioner fångas.

Övervakning och observerbarhet för validering och fel

Valideringsregler och felhantering blir bara bättre när du kan se vad som händer i verklig användning. Övervakning förvandlar "vi tror att det är okej" till tydliga bevis: vad som misslyckades, hur ofta och om tillförlitligheten förbättras eller smyger nedåt.

Vad logga (utan att skapa integritetsproblem)

Börja med loggar som förklarar varför en förfrågan lyckades eller misslyckades—radera eller undvik känsliga data som standard.

- Inputs och outputs (integritetsmedvetet): lagra hashvärden, trunkerade utdrag eller strukturerade fält istället för rå text när möjligt. Om du måste behålla rått innehåll för debugging, använd kort retention, åtkomstkontroller och ett tydligt syfte.

- Valideringsfel: regelnamn, fält/väg (t.ex.

address.postcode), och felorsak (schema-mismatch, osäkert innehåll, saknad avsikt). - Verktygsanrop och sidoeffekter: vilket verktyg anropades, parametrar (sanerade), responskoder och tidtagning. Detta är avgörande när fel härstammar utanför modellen.

- Undantag och timeouts: stacktraces för interna fel, plus användarsäkra felkoder som mappar till kända kategorier.

Mätvärden som faktiskt förutspår tillförlitlighet

Loggar hjälper dig debugga en incident; mätvärden hjälper dig upptäcka mönster.

Spåra:

- Valideringsfelratio (totalt och per regel)

- Schema-pass-rate (outputs som matchar förväntad struktur)

- Retry-rate och återhämtningsframgång (hur ofta fallbacks fungerar)

- Latens (end-to-end och per verktygsanrop)

- Toppkategorier av fel (t.ex. "saknat fält", "verktygstimeout", "policyöverträdelse")

Larma vid drift

AI-outputs kan skifta subtilt efter promptändringar, modeluppdateringar eller ny användarbeteende. Larm bör fokusera på förändring, inte bara absoluta trösklar:

- Plötslig ökning av en specifik valideringsregel som misslyckas

- Nya felkategorier som dyker upp

- Output-formförändringar (t.ex. ett JSON-fält blir fri text)

Dashboards icke-tekniska team kan använda

En bra dashboard svarar på: "Fungerar det för användarna?" Inkludera en enkel tillförlitlighetsöversikt, en trendlinje för schema-pass-rate, en uppdelning av fel per kategori och exempel på vanligaste feltyper (med känsligt innehåll borttaget). Länka till djupare tekniska vyer för ingenjörer, men håll toppläget läsbart för produkt och support.

Vanliga frågor

Vad räknas som ett "AI-genererat system" i det här inlägget?

Ett AI-genererat system är vilken produkt som helst där en modells output direkt påverkar vad som händer härnäst—vad som visas, lagras, skickas till ett annat verktyg eller körs som en åtgärd.

Det är bredare än chatt: det kan inkludera genererad data, kod, arbetssteg eller agent-/verktygsbeslut.

Varför ses validering och felhantering som produktfunktioner?

När AI-output är en del av kontrollflödet blir tillförlitlighet en användarupplevelsefråga. Ett felformat JSON-svar, ett saknat fält eller en felaktig instruktion kan:

- skapa förvirrande UI-tillstånd

- skriva felaktiga poster

- utlösa osäkra sidoeffekter

Att designa validering och felvägar i förväg gör att fel blir kontrollerade istället för kaotiska.

Vad är skillnaden mellan strukturell giltighet och affärsgiltighet?

Strukturell giltighet betyder att output är parsbar och har förväntad form (t.ex. giltig JSON, nödvändiga nycklar finns, korrekta typer).

Affärsgiltighet betyder att innehållet är acceptabelt för dina faktiska regler (t.ex. att ID finns, att totalsummor stämmer, att återbetalningstext följer policy). Du behöver vanligtvis båda lager.

Vad innebär det att designa AI-interaktioner som "kontrakt"?

Ett praktiskt kontrakt definierar vad som måste vara sant på tre punkter:

- Inputs: obligatoriska fält, tillåtna intervall, nödvändig kontext

- Outputs: obligatoriska nycklar, tillåtna värden, trösklar (t.ex. förtroende)

- Sidoeffekter: vilka åtgärder som är tillåtna (t.ex. "endast utkast", "måste bekräfta innan sändning")

När du har ett kontrakt blir validatorer bara automatiserad efterlevnad av det.

Vilka inputs bör valideras i ett AI-arbetsflöde?

Se input brett: användartext, filer, formulärfält, API-payloads och hämtade/tool-data.

Högvärdiga kontroller inkluderar obligatoriska fält, filstorlek/-typ, enum-fält, längdgränser, giltig kodning/JSON och säkra URL-format. Dessa minskar modellens förvirring och skyddar downstream-parsers och databaser.

När ska vi auto-korrigera inputs kontra avvisa dem?

Normalisera när avsikten är entydig och ändringen är reversibel (t.ex. trimma blanksteg, normalisera gemener för landskoder).

Avvisa när "fixande" kan ändra betydelse eller dölja fel (t.ex. tvetydiga datum som "03/04/2025", oväntade valutor, misstänkt HTML/JS). En bra regel: auto-korrigera format, avvisa semantik.

Hur validerar vi modellens output på ett säkert sätt?

Börja med ett tydligt output-schema:

- obligatoriska nycklar (t.ex.

answer,status) - typer (string/number/array)

- enums och begränsningar (längd/intervall)

Lägg sedan till semantiska kontroller (ID måste lösa ut, totalsummor måste stämma, datum måste vara rimliga, citat måste stödja påståenden). Om validering misslyckas, undvik att använda output downstream—försök igen med striktare instruktioner eller använd en fallback.

Hur väljer vi mellan att avbryta snabbt och att misslyckas graciöst?

Fail fast vid problem där fortsatt körning är riskabelt: går inte att parsa output, saknade obligatoriska fält, policyöverträdelser.

Fail gracefully när en säker återställning finns: tillfälliga timeouts, rate limits, mindre formateringsproblem.

I båda fallen separera:

- Användarvänligt meddelande: kort, handlingsbart, icke-tekniskt

- Intern diagnostik: felkod, rå output (säkert), validatorresultat, timing, korrelations-ID

När hjälper retries och fallbacks—och när gör de saken värre?

Retries hjälper när felet är tillfälligt (timeouts, 429, korta driftstörningar). Använd begränsade retries med exponential backoff och jitter.

Retries är ofta ineffektiva för "fel svar" (schema-mismatch, saknade fält, policyöverträdelser). Föredra prompt-reparation (tydligare instruktioner), deterministiska mallar, en mindre modell, cache eller manuell granskning beroende på risk.

Varifrån kommer kantfall vanligtvis i riktiga AI-produkter?

Vanliga kantfall kommer från:

- röriga användaringångar (kopierade PDF:er, konstiga radbrytningar, långa kontexter)

- gränsvärden (tomma fält, maxlängd, ovanlig Unicode, blandade språk)

- integrationsdrift (API-fältändringar, behörighetsproblem, datum-/valutakontraktsmismatch)

Planera för att upptäcka "okända okända" via integritetsmedvetna loggar som fångar vilken valideringsregel som misslyckades och vilken återställningsväg som kördes.