12 thg 11, 2025·8 phút

Từ phòng thí nghiệm phi lợi nhuận đến lãnh đạo AI: Lịch sử OpenAI

Khám phá lịch sử OpenAI, từ nguồn gốc phi lợi nhuận và những mốc nghiên cứu quan trọng đến việc ra mắt ChatGPT, GPT‑4 và sứ mệnh đang tiến hóa.

Khám phá lịch sử OpenAI, từ nguồn gốc phi lợi nhuận và những mốc nghiên cứu quan trọng đến việc ra mắt ChatGPT, GPT‑4 và sứ mệnh đang tiến hóa.

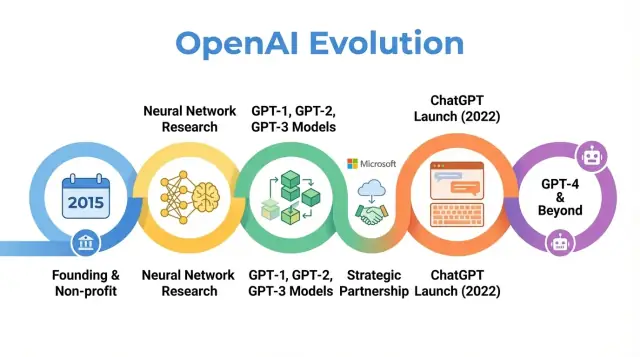

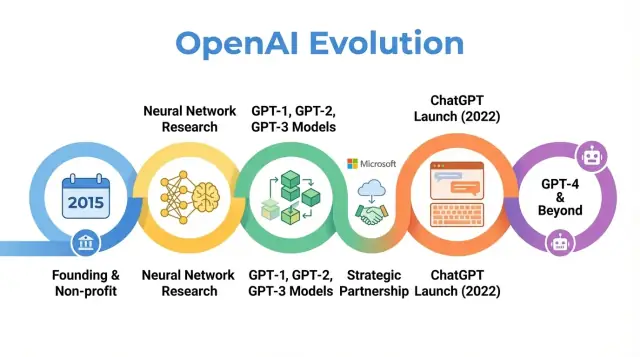

OpenAI là một công ty nghiên cứu và triển khai AI có tác động sâu tới cách mọi người nghĩ về trí tuệ nhân tạo, từ các bài báo nghiên cứu ban đầu đến sản phẩm như ChatGPT. Hiểu cách OpenAI phát triển — từ một phòng thí nghiệm phi lợi nhuận nhỏ năm 2015 tới một nhân tố trung tâm trong lĩnh vực AI — giúp giải thích vì sao AI hiện đại lại có hình thái như ngày nay.

Câu chuyện của OpenAI không chỉ là chuỗi các bản phát hành mô hình. Đó là một nghiên cứu tình huống về cách sứ mệnh, động cơ, đột phá kỹ thuật và áp lực công chúng tương tác với nhau. Tổ chức này khởi đầu với nhấn mạnh vào nghiên cứu mở và lợi ích chung, sau đó tái cấu trúc để thu hút vốn, hình thành quan hệ đối tác sâu với Microsoft và ra mắt các sản phẩm được hàng trăm triệu người sử dụng.

Theo dõi lịch sử của OpenAI làm rõ một số xu hướng rộng hơn trong AI:

Sứ mệnh và giá trị: OpenAI được thành lập với mục tiêu đảm bảo rằng AGI mang lại lợi ích cho toàn nhân loại. Cách sứ mệnh đó được hiểu và điều chỉnh theo thời gian tiết lộ sự căng thẳng giữa mục tiêu lý tưởng và thực tế thương mại.

Đột phá nghiên cứu: Tiến trình từ các dự án ban đầu tới hệ thống như GPT‑3, GPT‑4, DALL·E và Codex phản ánh sự chuyển dịch lớn sang các mô hình nền tảng quy mô lớn, là nền tảng cho nhiều ứng dụng AI hiện nay.

Quản trị và cấu trúc: Việc chuyển từ một tổ chức thuần phi lợi nhuận sang thực thể có lợi nhuận giới hạn, cùng việc tạo ra cơ chế quản trị phức tạp, làm nổi bật cách các hình thức tổ chức mới được thử nghiệm để quản lý công nghệ mạnh.

Tác động công chúng và giám sát: Với ChatGPT và các phiên bản khác, OpenAI chuyển từ một phòng thí nghiệm chủ yếu được biết trong cộng đồng AI sang một cái tên quen thuộc, thu hút chú ý vào các cuộc tranh luận về an toàn, căn chỉnh và quy định đang định hình chính sách toàn cầu.

Bài viết này theo dõi hành trình của OpenAI từ 2015 tới các phát triển gần đây, cho thấy mỗi giai đoạn phản ánh những thay đổi lớn trong nghiên cứu AI, kinh tế và quản trị — và điều đó có thể có ý nghĩa gì cho tương lai của lĩnh vực này.

OpenAI được thành lập vào tháng 12 năm 2015, khi học máy — đặc biệt là deep learning — đang tiến nhanh nhưng vẫn còn xa so với trí thông minh tổng quát. Các benchmark nhận dạng ảnh đang bị chinh phục, hệ thống nhận dạng giọng nói cải thiện, và các công ty như Google, Facebook, Baidu đổ nhiều tiền vào AI.

Một mối lo ngại ngày càng tăng trong giới nghiên cứu và lãnh đạo công nghệ là AI tiên tiến có thể rơi vào tay một vài tập đoàn hay chính phủ quyền lực. OpenAI được hình thành như một lực cân bằng: một tổ chức nghiên cứu tập trung vào an toàn dài hạn và phân phối lợi ích AI rộng rãi, thay vì lợi thế thương mại hẹp.

Ngay từ ngày đầu, OpenAI đặt sứ mệnh liên quan đến trí tuệ nhân tạo tổng quát (AGI), không chỉ là tiến bộ từng bước trong học máy. Tuyên bố cốt lõi là OpenAI sẽ làm việc để đảm bảo rằng AGI, nếu được tạo ra, “mang lại lợi ích cho toàn nhân loại.”

Sứ mệnh này có một số hệ quả cụ thể:

Các bài đăng blog công khai ban đầu và hiến chương sáng lập nhấn mạnh cả tính mở và thận trọng: OpenAI sẽ công bố nhiều công trình, nhưng cũng cân nhắc tác động xã hội khi phát hành những năng lực mạnh.

OpenAI bắt đầu như một phòng thí nghiệm phi lợi nhuận. Cam kết tài trợ ban đầu được thông báo khoảng 1 tỷ đô la cam kết hỗ trợ, dù đó là cam kết dài hạn chứ không phải tiền mặt ngay lập tức. Những người ủng hộ ban đầu gồm Elon Musk, Sam Altman, Reid Hoffman, Peter Thiel, Jessica Livingston và YC Research, cùng hỗ trợ từ các công ty như Amazon Web Services và Infosys.

Đội ngũ lãnh đạo ban đầu kết hợp kinh nghiệm khởi nghiệp, nghiên cứu và vận hành:

Sự pha trộn giữa tinh thần khởi nghiệp thung lũng Silicon và nghiên cứu AI đỉnh cao đã định hình văn hóa ban đầu của OpenAI: tham vọng lớn trong việc đẩy ranh giới năng lực AI, nhưng tổ chức theo mô hình phi lợi nhuận hướng tới tác động toàn cầu dài hạn thay vì thương mại ngắn hạn.

Khi OpenAI khởi đầu như phòng thí nghiệm phi lợi nhuận năm 2015, lời hứa công khai của họ đơn giản nhưng tham vọng: thúc đẩy trí tuệ nhân tạo đồng thời chia sẻ càng nhiều càng tốt với cộng đồng.

Những năm đầu được định nghĩa bởi triết lý “mở theo mặc định”. Các bài báo nghiên cứu được đăng sớm, mã thường được phát hành, và các công cụ nội bộ được đưa thành dự án công khai. Ý tưởng là tăng tốc tiến bộ khoa học rộng rãi — và tăng kiểm chứng — sẽ an toàn và có lợi hơn là gom năng lực vào tay một công ty duy nhất.

Cùng lúc đó, an toàn đã là một phần của cuộc trao đổi. Nhóm thảo luận khi nào sự công khai có thể tăng rủi ro lạm dụng và bắt đầu phác thảo ý tưởng về phát hành theo giai đoạn và đánh giá chính sách, dù những ý tưởng đó vẫn mang tính không chính thức hơn so với các quy trình quản trị sau này.

Trọng tâm khoa học ban đầu của OpenAI trải dài trên một số lĩnh vực cốt lõi:

Những dự án này ít nhằm tạo ra sản phẩm hoàn chỉnh hơn là thử nghiệm khả năng với deep learning, tài nguyên tính toán và các chế độ huấn luyện thông minh.

Hai sản phẩm có ảnh hưởng lớn của thời kỳ này là OpenAI Gym và Universe.

Cả hai dự án phản ánh cam kết về cơ sở hạ tầng chia sẻ thay vì lợi thế độc quyền.

Trong giai đoạn phi lợi nhuận này, OpenAI thường được mô tả là một lực lượng có sứ mệnh đối trọng với các phòng thí nghiệm AI của các hãng lớn. Đồng nghiệp đánh giá cao chất lượng nghiên cứu, việc công bố mã và môi trường, cũng như sẵn sàng tham gia thảo luận về an toàn.

Báo chí nhấn mạnh sự kết hợp bất thường giữa nhà tài trợ nổi bật, cấu trúc phi thương mại và lời hứa công bố mở. Danh tiếng đó — như một phòng thí nghiệm nghiên cứu có tầm ảnh hưởng, quan tâm đến hậu quả dài hạn — tạo kỳ vọng mà sau này ảnh hưởng tới phản ứng trước mọi thay đổi chiến lược của tổ chức.

Bước ngoặt trong lịch sử OpenAI là quyết định tập trung vào các mô hình ngôn ngữ lớn dựa trên transformer. Sự chuyển hướng này biến OpenAI từ phòng thí nghiệm nghiên cứu thuần túy sang công ty nổi tiếng về các mô hình nền tảng mà người khác xây dựng dựa trên đó.

GPT‑1 khi đó là nhỏ so với tiêu chuẩn sau này — 117 triệu tham số, huấn luyện trên BookCorpus — nhưng nó cung cấp bằng chứng quan trọng. Thay vì huấn luyện các mô hình riêng cho từng nhiệm vụ NLP, GPT‑1 cho thấy một mô hình transformer đơn, huấn luyện với mục tiêu đơn giản (dự đoán từ tiếp theo), có thể được điều chỉnh với chút fine‑tuning cho các nhiệm vụ như hỏi‑đáp, phân tích cảm xúc và suy luận ngữ nghĩa.

Với lộ trình nội bộ của OpenAI, GPT‑1 xác nhận ba ý tưởng:

GPT‑2 đẩy công thức cơ bản xa hơn: 1.5 tỷ tham số và tập dữ liệu lớn trích từ web. Kết quả tạo ra thường mạch lạc đáng ngạc nhiên: bài viết nhiều đoạn, truyện hư cấu và tóm tắt trông giống văn của con người.

Những năng lực đó gây cảnh báo về rủi ro lạm dụng: tuyên truyền tự động, spam, quấy rối và tin giả ở quy mô lớn. Thay vì phát hành đầy đủ mô hình ngay lập tức, OpenAI áp dụng chiến lược phát hành theo giai đoạn:

Đây là một trong những ví dụ nổi bật đầu tiên OpenAI gắn quyết định triển khai với an toàn và tác động xã hội, và điều này định hình cách tổ chức suy nghĩ về công bố, tính mở và trách nhiệm.

GPT‑3 tăng quy mô thêm lần nữa — lần này lên 175 tỷ tham số. Thay vì chủ yếu dựa vào fine‑tuning cho từng nhiệm vụ, GPT‑3 chứng minh khả năng “few‑shot” và thậm chí “zero‑shot”: mô hình có thể thực hiện nhiệm vụ mới chỉ từ hướng dẫn và vài ví dụ trong prompt.

Mức độ tổng quát đó thay đổi cách OpenAI và ngành nhìn nhận hệ thống AI. Thay vì xây nhiều mô hình hẹp, một mô hình lớn có thể hoạt động như động cơ đa dụng cho:

Crucially, OpenAI quyết định không mã nguồn mở GPT‑3. Truy cập được cung cấp qua API thương mại. Quyết định này là một chuyển hướng chiến lược:

GPT‑1, GPT‑2 và GPT‑3 vạch ra một quỹ đạo rõ ràng trong lịch sử OpenAI: tăng quy mô transformer, khám phá năng lực xuất hiện, đối mặt với an toàn và lạm dụng, và đặt nền tảng thương mại sau này cho các sản phẩm như ChatGPT và phát triển GPT‑4.

Đến 2018, lãnh đạo OpenAI tin rằng duy trì như một phòng thí nghiệm nhỏ dựa trên quyên góp sẽ không đủ để xây và điều hướng an toàn các hệ thống AI rất lớn. Huấn luyện các mô hình tiên phong đã đòi hỏi hàng chục triệu đô la cho compute và nhân tài, với đường chi phí có xu hướng tăng cao hơn. Để cạnh tranh thu hút nhà nghiên cứu hàng đầu, mở rộng thử nghiệm quy mô và đảm bảo truy cập dài hạn tới hạ tầng đám mây, OpenAI cần cấu trúc có thể thu hút vốn lớn mà không bỏ rơi sứ mệnh ban đầu.

Năm 2019, OpenAI ra mắt OpenAI LP, một limited partnership “capped‑profit”. Mục tiêu là mở khóa vốn đầu tư lớn trong khi giữ tổ chức phi lợi nhuận ở vị trí cấp cao trong cơ cấu ra quyết định.

Các startup truyền thống chịu trách nhiệm trước cổ đông tìm lợi nhuận không giới hạn. Người sáng lập OpenAI lo ngại điều đó sẽ tạo áp lực lớn ưu tiên lợi nhuận hơn an toàn, tính mở hay triển khai thận trọng. Cấu trúc LP là thỏa hiệp: có thể phát hành quyền lợi giống cổ phần và huy động vốn ở quy mô lớn, nhưng theo quy tắc khác.

Trong mô hình lợi nhuận giới hạn, nhà đầu tư và nhân viên có thể thu lợi nhưng chỉ tới một bội số cố định của khoản đầu tư ban đầu (với nhà đầu tư sớm, thường được nhắc tới là lên tới 100x, và các vòng sau có trần thấp hơn). Khi mức trần đó đạt, mọi giá trị tăng thêm dự định chảy về tổ chức phi lợi nhuận mẹ để sử dụng theo sứ mệnh.

Điều này trái ngược rõ rệt với startup thông thường, nơi giá trị vốn có thể tăng không giới hạn và tối đa hóa giá trị cổ đông là mặc định pháp lý và văn hóa.

OpenAI Nonprofit vẫn là thực thể kiểm soát. Hội đồng của tổ chức phi lợi nhuận giám sát OpenAI LP và được giao nhiệm vụ ưu tiên lợi ích nhân loại hơn lợi ích của nhóm nhà đầu tư hay nhân viên cụ thể.

Về mặt chính thức:

Thiết kế quản trị này nhằm cung cấp cho OpenAI khả năng huy động vốn và tuyển dụng như một tổ chức thương mại trong khi vẫn giữ kiểm soát theo sứ mệnh.

Việc tái cấu trúc gây ra tranh luận trong và ngoài tổ chức. Người ủng hộ cho rằng đó là cách thực tế duy nhất để đảm bảo hàng tỷ đô la cần thiết cho nghiên cứu AI tiên phong, đồng thời ràng buộc động cơ lợi nhuận. Nhà phê bình hoài nghi liệu bất kỳ cấu trúc nào cho phép lợi nhuận lớn có thể thực sự chống lại áp lực thương mại, và liệu các mức trần có đủ thấp hoặc được thực thi rõ ràng.

Trong thực tế, OpenAI LP mở cửa cho các khoản đầu tư chiến lược lớn, đáng chú ý nhất là từ Microsoft, và cho phép công ty cung cấp gói bồi thường cạnh tranh liên quan đến lợi ích tiềm năng. Điều đó giúp OpenAI mở rộng đội ngũ nghiên cứu, tăng quy mô chạy huấn luyện cho các mô hình như GPT‑3 và GPT‑4, và xây hạ tầng cần thiết để triển khai hệ thống như ChatGPT trên quy mô toàn cầu — đồng thời vẫn giữ liên kết quản trị về nguồn gốc phi lợi nhuận.

Năm 2019, OpenAI và Microsoft công bố quan hệ đối tác nhiều năm làm thay đổi vai trò của cả hai bên trong AI. Microsoft đầu tư khoảng 1 tỷ đô la, kết hợp tiền mặt và tín dụng Azure, để trở thành đối tác thương mại ưu tiên của OpenAI.

Thỏa thuận phù hợp với nhu cầu của OpenAI về nguồn compute khổng lồ để huấn luyện các mô hình ngày càng lớn, đồng thời mang lại cho Microsoft quyền truy cập vào AI tiên phong để phân biệt sản phẩm và nền tảng đám mây của mình. Qua các năm, mối quan hệ này càng sâu khi có thêm tài trợ và hợp tác kỹ thuật.

OpenAI chọn Microsoft Azure làm nền tảng đám mây chính vì một số lý do:

Điều này khiến Azure trở thành môi trường mặc định để huấn luyện và phục vụ các mô hình như GPT‑3, Codex và sau này GPT‑4.

Quan hệ đối tác dẫn tới một trong những hệ thống siêu máy tính AI lớn nhất thế giới, xây dựng trên Azure cho khối lượng công việc của OpenAI. Microsoft nhấn mạnh các cụm này như ví dụ hàng đầu về khả năng AI của Azure, trong khi OpenAI dựa vào chúng để đẩy kích thước mô hình, dữ liệu huấn luyện và tốc độ thử nghiệm.

Nỗ lực hạ tầng chung này làm mờ ranh giới giữa “khách hàng” và “đối tác”: OpenAI thực tế định hướng lộ trình AI của Azure, và Azure được điều chỉnh theo nhu cầu của OpenAI.

Microsoft nhận được quyền cấp phép độc quyền một số công nghệ OpenAI, đáng chú ý là GPT‑3. Điều đó cho phép Microsoft nhúng mô hình OpenAI vào các sản phẩm — Bing, Office, GitHub Copilot, Azure OpenAI Service — trong khi các công ty khác truy cập thông qua API của OpenAI.

Sự độc quyền này gây tranh luận: người ủng hộ cho rằng nó cung cấp nguồn tài trợ và kênh phân phối cần thiết để mở rộng AI mạnh một cách an toàn; nhà phê bình lo ngại nó tập trung ảnh hưởng lên các mô hình tiên tiến trong tay một công ty công nghệ lớn.

Cùng lúc, quan hệ đối tác mang lại tầm nhìn đại chúng cho OpenAI. Thương hiệu, tích hợp sản phẩm và kênh bán hàng doanh nghiệp của Microsoft giúp chuyển hệ thống OpenAI từ demo nghiên cứu thành công cụ hàng ngày, định hình nhận thức công chúng về OpenAI vừa là phòng thí nghiệm độc lập vừa là đối tác AI cốt lõi của Microsoft.

Khi mô hình hiểu và tạo ngôn ngữ cải thiện, nhóm OpenAI mở rộng sang các modal mới: hình ảnh và mã. Sự chuyển dịch này mở rộng tác động từ viết lách và đối thoại sang sáng tạo hình ảnh và phát triển phần mềm.

CLIP (Contrastive Language–Image Pretraining), công bố đầu 2021, là bước tiến lớn hướng tới mô hình hiểu thế giới giống con người hơn.

Thay vì chỉ huấn luyện trên ảnh có nhãn, CLIP học từ hàng trăm triệu cặp ảnh‑chú thích trích từ web công khai. Nó được huấn luyện để ghép ảnh với mô tả văn bản phù hợp nhất và phân biệt chúng với mô tả sai.

Điều này mang lại cho CLIP khả năng tổng quát đáng ngạc nhiên:

CLIP trở thành nền tảng cho các công trình tạo ảnh thế hệ sau tại OpenAI.

DALL·E (2021) áp dụng kiến trúc kiểu GPT cho ảnh, tạo ra hình ảnh trực tiếp từ prompt văn bản: “một chiếc ghế hình quả bơ” hay “biển hiệu cửa hàng có chữ ‘openai’”. Nó chứng tỏ mô hình ngôn ngữ có thể mở rộng để tạo ra hình ảnh mạch lạc, thường mang tính sáng tạo.

DALL·E 2 (2022) cải thiện độ phân giải, tính hiện thực và khả năng điều khiển. Nó giới thiệu các tính năng như:

Những hệ thống này thay đổi cách nhà thiết kế, marketer, nghệ sĩ và người dùng thử nghiệm ý tưởng, chuyển một phần công việc sáng tạo từ phác thảo thủ công sang khám phá lặp bằng prompt.

Codex (2021) lấy gia đình GPT‑3 và điều chỉnh cho mã nguồn, huấn luyện trên các kho mã công cộng lớn. Nó có thể chuyển ngôn ngữ tự nhiên thành đoạn mã hoạt động cho các ngôn ngữ như Python, JavaScript và nhiều ngôn ngữ khác.

GitHub Copilot, xây dựng trên Codex, đưa khả năng này vào công cụ phát triển hàng ngày. Lập trình viên bắt đầu nhận được hàm, test và boilerplate như gợi ý, dùng comment bằng ngôn ngữ tự nhiên để hướng dẫn.

Với phát triển phần mềm, Codex gợi ý một dịch chuyển dần dần:

CLIP, DALL·E và Codex cùng chỉ ra rằng phương pháp của OpenAI có thể mở rộng vượt ngôn ngữ sang thị giác và mã, làm rộng tác động nghiên cứu sang nghệ thuật, thiết kế và kỹ thuật.

OpenAI ra mắt ChatGPT dưới dạng “mở thử nghiệm nghiên cứu” miễn phí vào ngày 30 tháng 11 năm 2022, thông báo bằng một bài blog ngắn và tweet thay vì chiến dịch sản phẩm lớn. Mô hình dựa trên GPT‑3.5 và được tối ưu cho đối thoại, có các rào chắn để từ chối một số yêu cầu có hại hoặc không an toàn.

Lượng người dùng tăng vọt ngay lập tức. Hàng triệu người đăng ký chỉ trong vài ngày, và ChatGPT trở thành một trong những ứng dụng tiêu dùng tăng trưởng nhanh nhất từng thấy. Hình chụp màn hình các cuộc hội thoại tràn ngập mạng xã hội khi người dùng thử khả năng viết luận, gỡ lỗi mã, soạn email và giải thích chủ đề phức tạp bằng ngôn ngữ đơn giản.

Sức hút của ChatGPT đến từ tính đa dụng hơn là một trường hợp sử dụng hẹp.

Trong giáo dục, học sinh dùng nó để tóm tắt tài liệu, tạo câu hỏi luyện tập, dịch hoặc đơn giản hóa bài báo chuyên ngành, và nhận lời giải từng bước cho bài toán. Giáo viên thử dùng để thiết kế giáo án, soạn rubrics và tạo tài liệu phân hoá, trong khi trường học tranh luận về cách cho phép hoặc hạn chế sử dụng.

Tại nơi làm việc, chuyên gia dùng ChatGPT để soạn email, nội dung marketing, báo cáo, phác thảo bài thuyết trình, tạo đoạn mã, viết test và làm đối tác ý tưởng. Freelancer và doanh nghiệp nhỏ đặc biệt dựa vào nó như trợ lý chi phí thấp cho nội dung và phân tích.

Trong cuộc sống hàng ngày, mọi người dùng ChatGPT để lên kế hoạch du lịch, gợi ý nấu ăn theo nguyên liệu có trong tủ, giải thích sơ bộ về pháp lý và y tế (thường kèm khuyến nghị tìm chuyên gia), và hỗ trợ học ngôn ngữ hoặc kỹ năng mới.

Bản thử nghiệm ban đầu miễn phí để giảm rào cản và thu thập phản hồi về lỗi, lạm dụng và các thiếu sót. Khi lượng dùng tăng, OpenAI đối mặt cả chi phí hạ tầng lớn lẫn nhu cầu người dùng về truy cập ổn định hơn.

Tháng 2 năm 2023, OpenAI giới thiệu ChatGPT Plus — gói đăng ký cho phản hồi nhanh hơn, ưu tiên trong giờ cao điểm và quyền truy cập sớm các tính năng và mô hình mới như GPT‑4. Điều này tạo dòng doanh thu định kỳ trong khi vẫn giữ tầng miễn phí để tiếp cận rộng.

Theo thời gian, OpenAI bổ sung tùy chọn hướng doanh nghiệp: truy cập API cho các mô hình hội thoại, công cụ tích hợp vào quy trình làm việc, và sản phẩm như ChatGPT Enterprise với bảo mật, quyền quản trị và tuân thủ cao hơn cho tổ chức.

Sự nổi bật đột ngột của ChatGPT làm nóng các cuộc tranh luận lâu nay về AI.

Cơ quan quản lý lo ngại về quyền riêng tư, bảo vệ dữ liệu và tuân thủ luật pháp, đặc biệt tại các khu vực như Liên minh châu Âu. Một số cơ quan tạm thời hạn chế hoặc điều tra ChatGPT trong khi đánh giá xem việc thu thập và xử lý dữ liệu có đáp ứng tiêu chuẩn pháp lý hay không.

Ngành giáo dục đối mặt vấn đề đạo văn khi học sinh có thể tạo bài luận khó phát hiện. Điều này dẫn tới cấm hoặc chính sách nghiêm ngặt ở một số trường, trong khi trường khác điều chỉnh đề bài để nhấn mạnh quy trình, thi vấn đáp hoặc làm bài trong lớp.

Nhà đạo đức và nhà nghiên cứu cảnh báo về thông tin sai lệch, dựa quá mức vào AI cho quyết định quan trọng, thiên lệch trong phản hồi và tác động tới việc làm sáng tạo, tri thức. Cũng có câu hỏi về dữ liệu huấn luyện, bản quyền và quyền lợi của nghệ sĩ, nhà văn whose tác phẩm có thể đã ảnh hưởng đến hành vi mô hình.

Với OpenAI, ChatGPT là điểm ngoặt: biến tổ chức từ phòng thí nghiệm chủ yếu nghiên cứu thành công ty đứng giữa các cuộc thảo luận toàn cầu về cách triển khai, quản trị và tích hợp các mô hình ngôn ngữ mạnh vào đời sống hàng ngày.

OpenAI phát hành GPT‑4 vào tháng 3 năm 2023 như một bước tiến đáng kể so với GPT‑3.5 — mô hình ban đầu chạy ChatGPT. GPT‑4 cải thiện suy luận, tuân theo hướng dẫn phức tạp và giữ mạch truyện tốt hơn qua các cuộc hội thoại dài. Nó cũng tốt hơn nhiều trong xử lý prompt tinh tế, như giải thích điều khoản pháp lý, tóm tắt bài báo kỹ thuật, hay viết mã từ yêu cầu chưa rõ ràng.

So với GPT‑3.5, GPT‑4 giảm nhiều lỗi hiển nhiên: ít bịa nguồn khi yêu cầu trích dẫn, xử lý các trường hợp toán học và logic khó hơn đáng tin cậy hơn, và cho đầu ra nhất quán hơn qua nhiều truy vấn lặp lại.

GPT‑4 giới thiệu khả năng đa phương thức: ngoài văn bản, nó có thể nhận ảnh làm đầu vào ở một số cấu hình. Điều này cho các trường hợp sử dụng như mô tả biểu đồ, đọc ghi chú viết tay, phân tích ảnh chụp màn hình giao diện người dùng, hoặc trích xuất thông tin có cấu trúc từ ảnh.

Trên các benchmark chuẩn hóa, GPT‑4 thể hiện vượt trội so với các mô hình trước. Nó đạt điểm gần top‑percentile trên các kỳ thi mô phỏng chuyên nghiệp như bar exam, SAT và nhiều bài kiểm tra nâng cao khác. Nó cũng cải thiện trên các benchmark mã hóa và suy luận, phản ánh khả năng mạnh hơn ở cả hiểu ngôn ngữ và giải quyết vấn đề.

GPT‑4 nhanh chóng trở thành lõi của API OpenAI và dẫn tới thế hệ sản phẩm bên thứ ba mới: trợ lý AI trong bộ năng suất, trợ lý lập trình, công cụ hỗ trợ khách hàng, nền tảng giáo dục và ứng dụng theo ngành như luật, tài chính và y tế.

Dù có tiến bộ, GPT‑4 vẫn mắc hallucination, có thể bị điều khiển để cho ra phản hồi không an toàn hoặc thiên lệch, và không có hiểu biết thực sự hay kiến thức cập nhật. OpenAI tập trung mạnh vào nghiên cứu căn chỉnh cho GPT‑4 — dùng các kỹ thuật như reinforcement learning from human feedback, red‑teaming và quy tắc an toàn cấp hệ thống — nhưng nhấn mạnh rằng triển khai thận trọng, giám sát và nghiên cứu liên tục vẫn cần thiết để quản lý rủi ro và lạm dụng.

Từ những năm đầu, OpenAI đặt an toàn và căn chỉnh là trọng tâm sứ mệnh, không phải thứ phát sau khi ra sản phẩm. Tổ chức liên tục tuyên bố mục tiêu xây dựng hệ thống AI có năng lực cao nhưng căn chỉnh với giá trị con người và triển khai sao cho mang lại lợi ích cho mọi người, chứ không chỉ cổ đông hay đối tác sớm.

Năm 2018, OpenAI công bố Hiến chương OpenAI, trong đó chính thức hóa các ưu tiên:

Hiến chương hoạt động như la bàn quản trị, định hướng các quyết định về hướng nghiên cứu, tốc độ triển khai và quan hệ đối tác bên ngoài.

Khi mô hình ngày càng có năng lực, OpenAI xây dựng các chức năng an toàn và quản trị bên cạnh đội nghiên cứu cốt lõi:

Những nhóm này ảnh hưởng tới quyết định ra mắt, các tầng truy cập và chính sách sử dụng cho các mô hình như GPT‑4 và DALL·E.

Một phương pháp kỹ thuật nổi bật là reinforcement learning from human feedback (RLHF). Người đánh giá con người xem kết quả mô hình, xếp hạng chúng và huấn luyện một mô hình phần thưởng. Mô hình chính sau đó được tối ưu để tạo phản hồi gần hơn với hành vi ưa thích của con người, giảm nội dung độc hại, thiên lệch hoặc không an toàn.

Theo thời gian, OpenAI kết hợp RLHF với các kỹ thuật khác: quy tắc an toàn cấp hệ thống, bộ lọc nội dung, fine‑tuning cho lĩnh vực cụ thể và công cụ giám sát để hạn chế hoặc gắn cờ các sử dụng rủi ro cao.

OpenAI tham gia các khuôn khổ an toàn công khai, như cam kết tự nguyện với chính phủ, thực hành báo cáo mô hình và tiêu chuẩn an toàn cho mô hình tiên phong. Họ hợp tác với học giả, tổ chức xã hội dân sự và nhà nghiên cứu bảo mật trong các đánh giá, red‑teaming và kiểm toán.

Những hợp tác này, kết hợp với các tài liệu như Hiến chương và chính sách sử dụng đang phát triển, tạo nền tảng cho cách OpenAI quản trị các hệ thống AI ngày càng mạnh.

Sự trỗi dậy nhanh của OpenAI đi kèm với chỉ trích và căng thẳng nội bộ, phần lớn xoay quanh việc tổ chức còn trung thành thế nào với sứ mệnh ban đầu là đem lại lợi ích rộng rãi và an toàn.

Ban đầu OpenAI nhấn mạnh công bố mở — bài báo, mã và công cụ như OpenAI Gym. Theo thời gian, khi mô hình GPT‑2, GPT‑3 và GPT‑4 trở nên mạnh hơn, công ty chuyển sang phát hành hạn chế, truy cập qua API và ít chi tiết kỹ thuật hơn.

Người chỉ trích cho rằng bước đi này mâu thuẫn với lời hứa ẩn trong tên “OpenAI” và thông điệp phi lợi nhuận ban đầu. Người ủng hộ trong công ty lập luận rằng giữ lại trọng số mô hình và chi tiết huấn luyện là cần thiết để quản lý rủi ro lạm dụng và an ninh.

OpenAI phản hồi bằng cách công bố các đánh giá an toàn, thẻ hệ thống và tài liệu chính sách, đồng thời giữ trọng số lõi là tài sản sở hữu. Họ trình bày đây là sự cân bằng giữa tính mở, an toàn và áp lực cạnh tranh.

Khi OpenAI thắt chặt quan hệ với Microsoft — tích hợp mô hình vào Azure và sản phẩm như Copilot — người quan sát lo ngại về tập trung compute, dữ liệu và quyền quyết định.

Người chỉ trích lo rằng một vài công ty kiểm soát các mô hình tổng quát nhất và hạ tầng đằng sau chúng. Người khác cho rằng thương mại hóa mạnh (ChatGPT Plus, gói doanh nghiệp, cấp phép độc quyền) đi lệch khỏi sứ mệnh phi lợi nhuận ban đầu về lợi ích được chia sẻ.

Lãnh đạo OpenAI lập luận doanh thu là cần thiết để tài trợ cho nghiên cứu tốn kém, đồng thời duy trì cấu trúc lợi nhuận giới hạn và hiến chương ưu tiên lợi ích nhân loại. Họ cũng giới thiệu các chương trình như tầng truy cập miễn phí, quan hệ nghiên cứu và một số công cụ mã nguồn mở để chứng minh lợi ích công cộng.

Bất đồng nội bộ về tốc độ triển khai, mức độ công khai và ưu tiên an toàn liên tục xuất hiện.

Dario Amodei và một số người khác rời đi năm 2020 để thành lập Anthropic, viện dẫn quan điểm khác về an toàn và quản trị. Sau này, sự ra đi của các nhà nghiên cứu an toàn như Jan Leike năm 2024 làm nổi bật lo ngại rằng mục tiêu sản phẩm ngắn hạn đôi khi ưu tiên hơn công việc an toàn dài hạn.

Sự kiện nổi bật nhất xảy ra tháng 11 năm 2023, khi hội đồng quản trị tạm thời bãi nhiệm CEO Sam Altman vì lý do mất lòng tin. Sau phản ứng dữ dội của nhân viên và đàm phán có liên quan đến Microsoft và các bên khác, Altman trở lại, hội đồng được tái cấu trúc và OpenAI cam kết cải tổ quản trị, bao gồm thành lập Ủy ban An toàn và An ninh.

Những chương trình này cho thấy tổ chức vẫn đang vật lộn để hòa giải giữa triển khai nhanh, thành công thương mại và trách nhiệm về an toàn cùng lợi ích rộng rãi.

OpenAI đã chuyển từ một phòng thí nghiệm nghiên cứu nhỏ sang nhà cung cấp nền tảng trung tâm cho AI, ảnh hưởng tới cách công cụ mới được xây dựng, quy định và hiểu biết.

Thay vì chỉ công bố mô hình, OpenAI giờ vận hành một nền tảng đầy đủ được sử dụng bởi startup, doanh nghiệp và nhà phát triển độc lập. Thông qua API cho các mô hình như GPT‑4, DALL·E và các hệ thống tương lai, họ trở thành:

Vai trò nền tảng này có nghĩa OpenAI không chỉ thúc đẩy nghiên cứu — họ đang đặt mặc định cho cách hàng triệu người lần đầu gặp các AI mạnh.

Công việc của OpenAI thúc đẩy đối thủ và cộng đồng mã nguồn mở phản ứng với mô hình mới, phương pháp huấn luyện và cách tiếp cận an toàn. Cuộc cạnh tranh đó thúc đẩy tiến bộ đồng thời làm sắc bén các cuộc tranh luận về tính mở, tập trung và thương mại hóa AI.

Chính phủ và cơ quan quản lý ngày càng nhìn vào thực hành của OpenAI, báo cáo minh bạch và nghiên cứu căn chỉnh khi soạn quy định về triển khai AI, đánh giá an toàn và sử dụng có trách nhiệm. Các cuộc đối thoại công khai về ChatGPT, GPT‑4 và hệ thống tương lai ảnh hưởng mạnh tới cách xã hội tưởng tượng rủi ro và lợi ích của AI.

Khi mô hình càng mạnh, các vấn đề chưa có lời giải quanh vai trò của OpenAI càng trở nên quan trọng:

Những câu hỏi này sẽ quyết định liệu các hệ thống AI tương lai sẽ khuếch đại bất bình đẳng hiện có hay giúp giảm chúng.

Các nhà phát triển và doanh nghiệp có thể:

Cá nhân có thể:

Tầm ảnh hưởng tương lai của OpenAI sẽ phụ thuộc không chỉ vào quyết định nội bộ mà còn vào cách chính phủ, đối thủ, xã hội dân sự và người dùng bình thường chọn tham gia, phê phán và yêu cầu trách nhiệm từ các hệ thống họ xây dựng.

OpenAI được thành lập năm 2015 như một phòng thí nghiệm nghiên cứu phi lợi nhuận với sứ mệnh đảm bảo rằng trí tuệ nhân tạo tổng quát (AGI), nếu được tạo ra, sẽ mang lại lợi ích cho toàn nhân loại.

Một số yếu tố định hình việc thành lập:

Câu chuyện nguồn gốc này vẫn ảnh hưởng tới cấu trúc, quan hệ đối tác và các cam kết công khai của OpenAI ngày nay.

AGI (trí tuệ nhân tạo tổng quát) đề cập tới các hệ thống AI có khả năng thực hiện nhiều loại nhiệm vụ nhận thức ở mức tương đương hoặc vượt trội so với con người, thay vì chỉ là công cụ hẹp dành cho một nhiệm vụ.

Sứ mệnh của OpenAI là:

Sứ mệnh này được thể hiện trong Hiến chương OpenAI và ảnh hưởng tới các quyết định quan trọng về hướng nghiên cứu và triển khai.

OpenAI chuyển từ phi lợi nhuận sang mô hình “capped‑profit” (OpenAI LP) để huy động lượng vốn lớn cần thiết cho nghiên cứu AI tiên phong, đồng thời cố gắng giữ sứ mệnh ở vị trí ưu tiên nhất.

Các điểm chính:

Đó là một thử nghiệm về quản trị, và hiệu quả của nó vẫn được tranh luận.

Microsoft cung cấp cho OpenAI nguồn điện toán đám mây khổng lồ qua Azure và đã đầu tư hàng tỷ đô la vào công ty.

Quan hệ hợp tác bao gồm:

Đổi lại, OpenAI có được tài nguyên cần thiết để huấn luyện và triển khai mô hình cỡ lớn trên quy mô toàn cầu, còn Microsoft có khả năng AI khác biệt cho hệ sinh thái của mình.

Dãy GPT phản ánh tiến trình về quy mô, năng lực và chiến lược triển khai của OpenAI:

Mỗi bước đều đẩy giới hạn kỹ thuật đồng thời buộc tổ chức phải đưa ra quyết định mới về an toàn, truy cập và thương mại hóa.

OpenAI bắt đầu với triết lý “mở theo mặc định” — công bố bài báo, mã và công cụ như OpenAI Gym. Khi mô hình trở nên mạnh hơn, họ chuyển sang:

OpenAI lý giải điều này là cần thiết để giảm rủi ro lạm dụng và quản lý vấn đề an ninh. Nhà phê bình cho rằng điều này làm suy yếu lời hứa ban đầu mà cái tên “OpenAI” hàm ý và tập trung quyền lực vào một công ty duy nhất.

OpenAI sử dụng cả cấu trúc tổ chức và phương pháp kỹ thuật để quản lý an toàn và lạm dụng:

Những biện pháp này giảm thiểu rủi ro nhưng không loại bỏ được các vấn đề như hallucination, thiên lệch và nguy cơ lạm dụng — đó vẫn là thách thức của nghiên cứu và quản trị.

ChatGPT, ra mắt cuối 2022, khiến mô hình ngôn ngữ lớn trở nên dễ tiếp cận với công chúng qua một giao diện chat đơn giản.

Nó thay đổi việc áp dụng AI bằng cách:

Sự chú ý công khai này cũng làm gia tăng giám sát đối với quản trị, mô hình kinh doanh và thực tiễn an toàn của OpenAI.

Mô hình như Codex và GPT‑4 đã và đang thay đổi một phần công việc tri thức và sáng tạo:

Lợi ích tiềm năng:

Rủi ro và lo ngại:

Bạn có thể tham gia hệ sinh thái OpenAI bằng nhiều cách:

Trong mọi trường hợp, nên tìm hiểu cách mô hình được huấn luyện và quản trị, và thúc đẩy minh bạch, trách nhiệm giải trình và tiếp cận công bằng khi các hệ thống này ngày càng mạnh hơn.

Tác động ròng sẽ phụ thuộc lớn vào chính sách, lựa chọn của tổ chức và cách cá nhân, doanh nghiệp tích hợp AI vào công việc.