02 nov. 2025·8 min

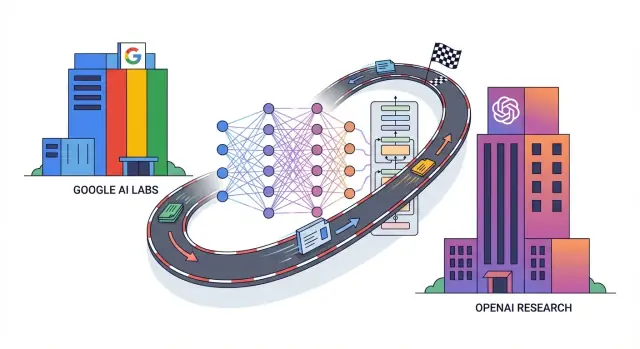

Comment Google a alimenté GPT mais a laissé OpenAI gagner la course à l'IA

Comprenez comment Google a inventé l'architecture Transformer à l'origine de GPT, mais a laissé OpenAI transformer cette avancée en produit grand public (ChatGPT), et quelles leçons en tirer pour convertir la recherche en avantage produit.

Vue d'ensemble : comment Google a alimenté GPT mais cédé la vedette

Google n'a pas tant « raté » l'IA que créé une grande partie de ce qui a rendu la vague actuelle possible — puis laissé quelqu'un d'autre transformer cela en produit emblématique.

Les chercheurs de Google ont inventé l'architecture Transformer, l'idée centrale derrière les modèles GPT. Cet article de 2017, "Attention Is All You Need", a montré comment entraîner des modèles très larges capables de comprendre et de générer du langage avec une remarquable fluidité. Sans ce travail, GPT tel que nous le connaissons n'existerait pas.

La réussite d'OpenAI n'était pas un nouvel algorithme magique. C'était un ensemble de choix stratégiques : pousser les Transformers à une échelle que peu jugeaient praticable, les entraîner sur d'énormes volumes, et empaqueter le résultat sous forme d'APIs simples, puis de ChatGPT — un produit grand public qui a rendu l'IA tangible pour des centaines de millions de personnes.

Cet article porte sur ces choix et compromis, pas sur des drames secrets ni des héros et vilains personnels. Il retrace comment la culture de recherche et le modèle économique de Google l'ont amené à privilégier des modèles de type BERT et des améliorations incrémentales de la recherche, tandis qu'OpenAI a parié sur des systèmes génératifs polyvalents bien plus risqués.

Nous verrons :

- Comment Google a bâti une domination précoce en IA et une organisation de recherche de classe mondiale

- Pourquoi l'article sur les Transformers a été une percée — et ce qu'il a vraiment changé

- Comment OpenAI a transformé cette fondation en GPT et ChatGPT

- Les stratégies divergentes : BERT et la recherche chez Google vs GPT à grande échelle et APIs chez OpenAI

- Le « moment ChatGPT », quand OpenAI a surpassé Google publiquement

- Différences culturelles et d'incitations qui ont guidé les décisions des deux entreprises

- La remise à plat de Google avec Bard et Gemini

- Leçons concrètes pour les bâtisseurs qui ne veulent pas répéter l'erreur de Google

Si vous vous intéressez à la stratégie IA — comment la recherche devient produit, et comment les produits deviennent un avantage durable — cette histoire est une étude de cas sur ce qui compte davantage qu'un meilleur article : avoir des paris clairs et le courage d'expédier.

La domination précoce de Google en IA et sa culture de recherche

Google est entré dans le machine learning moderne avec deux avantages structurels énormes : des données à une échelle inimaginable et une culture d'ingénierie déjà optimisée pour les grands systèmes distribués. Lorsqu'il a mis cette machinerie au service de l'IA, il est rapidement devenu le centre gravitationnel du domaine.

De Google Brain à DeepMind

Google Brain est né comme projet annexe vers 2011–2012, dirigé par Jeff Dean, Andrew Ng et Greg Corrado. L'équipe se concentrait sur le deep learning à grande échelle, utilisant les centres de données de Google pour entraîner des modèles hors de portée pour la plupart des universités.

DeepMind a rejoint Google en 2014 via une acquisition très médiatisée. Tandis que Google Brain vivait plus près des produits et de l'infrastructure, DeepMind s'orientait vers la recherche long terme : apprentissage par renforcement, jeux et systèmes d'apprentissage général.

Ensemble, ils ont fourni à Google une chambre moteur d'IA sans égal : un groupe intégré à la pile de production de Google, l'autre poursuivant des recherches ambitieuses.

Jalons qui ont marqué la domination en IA

Plusieurs jalons publics ont cimenté le statut de Google :

- Percées ImageNet : même si la victoire d'AlexNet (2012) venait de l'Université de Toronto, Google a rapidement recruté de nombreux chercheurs leaders et poussé l'état de l'art avec des modèles comme Inception. Les benchmarks en vision sont devenus une vitrine de l'échelle et des outils de Google.

- AlphaGo et successeurs : AlphaGo (DeepMind) battant Lee Sedol en 2016, suivi par AlphaGo Zero et AlphaZero, a démontré que le RL profond pouvait maîtriser des domaines complexes avec peu d'artifices humains.

- Rhétorique “AI-first” : autour de 2016–2017, Sundar Pichai a commencé à appeler Google une entreprise “AI‑first”. L'IA alimentait Search, Ads, YouTube, Photos, Maps et Android — touchant des milliards d'utilisateurs, même si la plupart ne voyaient jamais directement les modèles.

Ces victoires ont convaincu beaucoup de chercheurs que pour travailler sur les problèmes IA les plus ambitieux, il fallait aller chez Google ou DeepMind.

Densité de talents comme moteur d'innovation

Google a concentré une part extraordinaire du talent IA mondial. Des lauréats du Turing Award comme Geoffrey Hinton et des figures senior comme Jeff Dean, Ilya Sutskever (avant son départ vers OpenAI), Quoc Le, Oriol Vinyals, Demis Hassabis et David Silver travaillaient dans quelques organisations et campus.

Cette densité a créé des boucles de rétroaction puissantes :

- Les nouvelles idées se propageaient vite via des séminaires internes, listes de diffusion et code partagé.

- Les équipes pouvaient se former ad hoc pour attaquer des problèmes difficiles, sachant que l'expertise nécessaire était souvent à portée d'un message interne.

- Les chercheurs bénéficiaient d'une infrastructure de qualité production — pipelines de données, systèmes d'entraînement distribués et matériel spécialisé — sans tout construire eux‑mêmes.

Cette combinaison de talents d'élite et d'investissements massifs en infrastructure a fait de Google l'endroit où la recherche de pointe en IA émergeait souvent.

Une culture optimisée pour les articles et les plateformes

La culture IA de Google penchait fortement vers la publication et la construction de plateformes plutôt que vers des produits consommateurs soignés.

Côté recherche, la norme était :

- Publier aux conférences comme NeurIPS, ICML et ICLR.

- Open‑sourcer des outils (p. ex. TensorFlow) reflétant les systèmes internes.

- Publier des papiers influents sur la vision, le séquençage, le RL et l'entraînement à grande échelle.

Côté ingénierie, Google a investi dans l'infrastructure :

- TPU (Tensor Processing Units) sur mesure pour les charges de réseaux de neurones.

- Des piles d'entraînement et de serving sophistiquées inspirées de systèmes internes comme Borg.

- Des plateformes de données et d'expérimentation permettant de réaliser d'énormes études sur du trafic réel.

Ces choix concordaient fortement avec les activités core de Google. De meilleurs modèles et outils amélioraient directement la pertinence de Search, le ciblage d'annonces et les recommandations de contenu. L'IA était traitée comme une couche de capacité générale plutôt que comme une catégorie de produit autonome.

Le résultat fut une entreprise qui dominait la science et la plomberie de l'IA, l'intégrant profondément dans ses services existants, et diffusant ses progrès via une recherche influente — tout en restant prudente pour construire de nouvelles expériences grand public et génératives.

La naissance du Transformer : la percée de Google

En 2017, une petite équipe de Google Brain et Google Research a publié discrètement un papier qui a reconfiguré tout le domaine : “Attention Is All You Need” par Ashish Vaswani, Noam Shazeer, Niki Parmar, Jakob Uszkoreit, Llion Jones, Aidan Gomez, Łukasz Kaiser, et Illia Polosukhin.

L'idée centrale était simple mais radicale : on pouvait se passer de récurrence et de convolutions, et construire des modèles de séquence en utilisant uniquement l'attention. Cette architecture fut appelée le Transformer.

Ce que le Transformer a corrigé chez les RNN et LSTM

Avant les Transformers, les systèmes de langage s'appuyaient sur des RNN et LSTM, qui avaient deux problèmes majeurs :

- Goulot séquentiel : les RNN traitent les tokens un par un, rendant l'entraînement et l'inférence difficiles à paralléliser. Les GPU restent inactifs en attendant l'étape précédente.

- Dépendances à long terme : à mesure que les séquences augmentent, il devient plus difficile pour les RNN de conserver l'information lointaine, même avec des LSTM et des couches d'attention ajoutées.

Le Transformer a résolu les deux :

- Self-attention permet à chaque token de “regarder” directement tous les autres tokens de la séquence, en une seule couche.

- Le modèle traite tous les tokens en parallèle, transformant l'entraînement en un problème adapté aux GPU basé sur des multiplications de matrices.

- Multi-head attention permet au modèle d'apprendre différentes « vues » du contexte (syntaxe, coréférence, sujet, etc.) simultanément.

L'information de position est ajoutée via des encodages positionnels, de sorte que le modèle connaît l'ordre sans récurrence.

Pourquoi cela a débloqué des modèles évolutifs et multimodaux

Parce que toutes les opérations sont parallélisables et basées sur des multiplications matricielles denses, les Transformers s'échelonnent proprement avec plus de données et de puissance de calcul. Cette propriété d'échelle est exactement ce sur quoi reposent GPT, Gemini et d'autres modèles de pointe.

Le même mécanisme d'attention se généralise aussi au-delà du texte : on peut appliquer des Transformers à des patches d'image, des trames audio, des tokens vidéo, etc. Cela a rendu l'architecture une base naturelle pour des modèles multimodaux unifiés.

Publication ouverte et route vers GPT

Crucialement, Google a publié l'article ouvertement et (via des travaux de suivi et des bibliothèques comme Tensor2Tensor) a rendu l'architecture facile à reproduire. Chercheurs et startups du monde entier pouvaient lire les détails, copier le design et l'étendre.

OpenAI a fait exactement cela. GPT‑1 est, sur le plan architectural, une pile de décodeurs Transformer avec un objectif de modélisation du langage. L'ancêtre technique direct de GPT est le Transformer de Google : mêmes blocs d'attention, mêmes encodages positionnels, même pari sur l'échelle — appliqués dans un contexte produit et organisationnel différent.

Du Transformer à GPT : comment OpenAI s'est appuyé sur le travail de Google

Quand OpenAI a lancé GPT, ce n'était pas l'invention d'un paradigme totalement nouveau. C'était l'adoption du plan du Transformer de Google et sa poussée bien au-delà de ce que la plupart des groupes de recherche acceptaient ou pouvaient faire.

Transformer → GPT

Le GPT original (2018) était essentiellement un décodeur Transformer entraîné sur un objectif simple : prédire le token suivant sur de longues portions de texte. Cette idée remonte directement à l'architecture Transformer de 2017, mais là où Google s'intéressait à la traduction et aux benchmarks, OpenAI a traité la prédiction du prochain mot à grande échelle comme fondement d'un générateur de texte général.

GPT‑2 (2019) a porté la recette à 1,5 milliard de paramètres et un corpus web beaucoup plus vaste. GPT‑3 (2020) a sauté à 175 milliards de paramètres, entraîné sur des billions de tokens avec d'immenses grappes GPU. GPT‑4 a étendu le schéma : plus de données, meilleure curation, plus de calcul, enveloppés dans des couches de sécurité et du RLHF pour façonner le comportement en conversation utile.

Tout au long de cette progression, le cœur algorithmique est resté proche du Transformer de Google : blocs self-attention, encodages positionnels et couches empilées. Le saut a été d'ordre purement d'échelle et d'ingénierie implacable.

L'échelle comme stratégie, pas comme expérience de recherche

Tandis que les premiers modèles de langage de Google (comme BERT) ciblaient des tâches de compréhension — classification, ranking, question‑answering — OpenAI a optimisé pour la génération ouverte et le dialogue. Google publiait des modèles d'état‑de‑l'art puis passait au papier suivant. OpenAI a transformé une seule idée en pipeline produit.

La recherche ouverte de Google, DeepMind et des laboratoires académiques a alimenté GPT : variantes de Transformer, astuces d'optimisation, schémas d'apprentissage, lois d'échelle et meilleures tokenizations. OpenAI a absorbé ces résultats publics, puis investi massivement dans des runs d'entraînement propriétaires et dans l'infrastructure.

L'étincelle intellectuelle — les Transformers — venait de Google. La décision de parier l'entreprise sur la mise à l'échelle de cette idée, de livrer une API puis un chat consommateur, c'était celle d'OpenAI.

Pourquoi Google a privilégié BERT et la recherche plutôt que des produits à la GPT

Développez pour mobile plus vite

Créez une application Flutter depuis le chat et passez rapidement de la v1 à la v2.

Le succès commercial initial de Google avec le deep learning venait d'améliorer sa machine à cash — la recherche et la publicité. Ce contexte a façonné l'évaluation des nouvelles architectures comme le Transformer. Plutôt que de courir après des générateurs de texte libre, Google a doublé la mise sur des modèles qui rendaient le ranking, la pertinence et la qualité meilleurs. BERT était parfaitement adapté.

BERT, le Transformer « natif recherche »

BERT (Bidirectional Encoder Representations from Transformers) est un modèle uniquement encodeur entraîné par masked language modeling : des parties d'une phrase sont cachées, et le modèle doit en inférer les tokens manquants en utilisant le contexte complet des deux côtés.

Cet objectif d'entraînement s'alignait presque parfaitement avec les problèmes de Google :

- Compréhension des requêtes : les requêtes sont courtes, bruitées et ambiguës. Le contexte bidirectionnel de BERT permet d'interpréter des requêtes complexes avec plus de nuance.

- Compréhension des documents : classer des milliards de pages nécessite une similarité sémantique fine. Les embeddings BERT permettent un meilleur appariement requête‑passage.

- Qualité et détection de spam : un masked LM reconnaît naturellement le texte « hors contexte », utile pour filtrer le contenu de faible qualité.

Crucialement, les modèles encodeurs s'intégraient proprement à la pile de retrieval/ranking existante. Ils pouvaient être appelés comme signaux de pertinence parmi des centaines d'autres, améliorant la recherche sans réécrire tout le produit.

Pourquoi le masked language modeling servait le business de Google

Google a besoin de réponses fiables, traçables et monétisables :

- Fiables : les résultats de recherche doivent être ancrés à de vraies pages et sources. Le masked LM forme le modèle à comprendre le langage, pas à halluciner de longs textes.

- Traçables : chaque résultat renvoie à un éditeur, ce qui soutient l'écosystème web et permet la vérification.

- Monétisables : les annonces de recherche s'insèrent naturellement autour d'une liste classée de liens. Une meilleure pertinence améliore le CTR et la valeur par requête.

BERT améliorait ces trois aspects sans bouleverser l'UI ou le modèle d'annonces. Les générateurs autoregressifs de type GPT, en revanche, offraient une valeur incrémentale moins évidente pour le business existant.

Calcul interne des risques : sécurité, désinformation et marque

La génération libre soulevait des inquiétudes internes majeures :

- Désinformation et hallucinations : les modèles génératifs inventent des faits avec assurance. Pour une entreprise perçue comme une autorité, c'est un risque direct pour la marque.

- Contenu nuisible : la génération non filtrée peut produire du texte toxique ou dangereux.

- Exposition réglementaire : dans un contexte d'antitrust et de régulation des contenus, lancer un chatbot ouvert mondial semblait risqué.

La plupart des cas d'usage internes validés étaient assistés et contraints : auto‑complétion dans Gmail, réponses rapides, traduction, et améliorations de ranking. Les modèles encodeurs étaient plus faciles à encadrer, surveiller et justifier que des systèmes conversationnels ouverts.

Peur de cannibalisation : ne pas tuer la vache à lait Search

Même lorsque Google disposait de prototypes conversationnels, une question centrale restait : une excellente réponse directe réduirait‑elle les requêtes et les clics ads ?

Une expérience de chat donnant une réponse complète d'un coup change le comportement utilisateur :

- Moins de clics vers des sites externes → éditeurs mécontents, écosystème web affaibli

- Moins d'intention et d'espace pour les annonces → incertitude de revenus

L'instinct des dirigeants fut d'intégrer l'IA comme amélioration de la recherche, pas comme remplacement. Cela signifiait des extraits enrichis et une meilleure compréhension sémantique — exactement là où BERT brillait — plutôt qu'un produit conversationnel audacieux susceptible de perturber le modèle commercial.

Comment ces choix ont ralenti les produits générationnels grand public

Chaque décision prise isolément était rationnelle :

- Favoriser des modèles qui améliorent directement les métriques Search et Ads

- Prioriser la sécurité, la fiabilité et la prudence réglementaire

- Protéger l'expérience de recherche et la monétisation

Collectivement, cela a conduit Google à sous‑investir dans la productisation des générateurs autoregressifs grand public. Les équipes de recherche ont exploré de grands décodeurs et des systèmes de dialogue, mais les équipes produit avaient peu d'incitations à lancer un chatbot qui :

- n'améliorait pas clairement les KPIs de recherche,

- menaçait les revenus publicitaires et les relations avec les éditeurs,

- introduisait des risques de sécurité et d'image significatifs.

OpenAI, sans empire de recherche à protéger, a fait l'inverse : parier que même imparfait, un chat très capable accessible au public créerait une demande massive. La focalisation de Google sur BERT et l'alignement avec la recherche a retardé son entrée décisive dans les outils génératifs consommateurs, préparant le terrain pour ChatGPT.

La mise du pari d'OpenAI : échelle, APIs et chat grand public

Du laboratoire de recherche à la structure à profit plafonné

OpenAI a démarré en 2015 comme un laboratoire de recherche à but non lucratif, financé par quelques fondateurs tech voyant à la fois opportunité et risque de l'IA. Les premières années, il ressemblait à Google Brain ou DeepMind : publier, ouvrir du code, faire avancer la science.

En 2019, la direction a réalisé que les modèles de pointe demandaient des milliards de dollars de calcul et d'ingénierie. Un pur non‑profit peinait à lever de tels capitaux. La solution fut une innovation structurelle : OpenAI LP, une « société à profit plafonné » sous la houlette du non‑profit.

Les investisseurs pouvaient obtenir un rendement (jusqu'à un plafond), tandis que le conseil gardait une mission explicite d'AGI bénéfique. Cette structure a rendu possibles d'importants financements et accords cloud sans transformer l'organisation en startup classique.

L'échelle comme hypothèse centrale

Tandis que beaucoup de laboratoires optimisaient des architectures ingénieuses ou des systèmes spécialisés, OpenAI a fait un pari franc : des modèles de langage extrêmement larges pourraient se révéler étonnamment capables si l'on continue d'augmenter données, paramètres et calcul.

GPT‑1, GPT‑2 et GPT‑3 ont suivi une formule simple : architecture Transformer standard, mais plus grande, entraînée plus longtemps et sur un texte très divers. Plutôt que d'adapter les modèles à chaque tâche, ils ont misé sur « un grand modèle, de nombreux usages » via le prompting et le fine‑tuning.

Ce n'était pas qu'une posture de recherche : c'était une stratégie business : si une API unique pouvait alimenter des milliers de cas (rédaction, support, assistants de code), OpenAI pouvait devenir une plateforme.

API‑first : transformer les modèles en plateforme

L'API GPT‑3 lancée en 2020 a concrétisé cette stratégie. Plutôt que de pousser des logiciels lourds on‑premise ou des produits d'entreprise clos, OpenAI a exposé une API cloud simple :

- Envoyer du texte, recevoir la sortie du modèle.

- Payer par token.

- Construire ce que vous voulez par dessus.

Cette approche « API‑first » a permis aux startups et entreprises de gérer l'UX, la conformité et l'expertise métier, tandis qu'OpenAI se concentrait sur l'entraînement de modèles toujours plus grands et l'amélioration de l'alignement.

L'API a aussi créé tôt un moteur de revenus clair. Plutôt que d'attendre des produits parfaits, OpenAI laissait l'écosystème découvrir des usages et faire la R&D produit pour elle.

Volonté de lancer des produits imparfaits

OpenAI a choisi de lancer avant que les modèles ne soient polis. GPT‑2 est sorti avec des préoccupations de sécurité et une diffusion progressive ; GPT‑3 a été déployé en bêta contrôlée avec des défauts évidents (hallucinations, biais, incohérences).

L'expression la plus nette de cette philosophie fut ChatGPT fin 2022. Ce n'était pas le modèle le plus avancé d'OpenAI, ni particulièrement raffiné. Mais il offrait :

- Une interface de chat simple que tout le monde comprenait.

- Un accès gratuit au départ, invitant à l'expérimentation massive.

- Une boucle d'itération rapide basée sur les conversations réelles.

Plutôt que d'affiner le modèle longtemps en privé, OpenAI a traité le public comme un gigantesque moteur de retour d'expérience. Les garde‑fous, la modération et l'UX ont évolué semaine après semaine, guidés par le comportement observé.

Partenariat stratégique avec Microsoft et accès au calcul

Le pari d'OpenAI sur l'échelle nécessitait d'énormes budgets de calcul. Le partenariat avec Microsoft a été décisif.

À partir de 2019 et en se renforçant ensuite, Microsoft a fourni :

- Des investissements de plusieurs milliards dans OpenAI LP.

- Un hébergement cloud exclusif sur Azure pour les modèles d'OpenAI.

- Un go‑to‑market commun via Bing Chat, Copilot et d'autres intégrations.

Pour OpenAI, cela a résolu la contrainte majeure : effectuer des runs d'entraînement sur des supercalculateurs Azure dédiés sans tout construire et financer en propre.

Pour Microsoft, c'était un moyen de différencier Azure et d'infuser l'IA dans Office, GitHub, Windows et Bing plus rapidement qu'en développant tout en interne.

La boucle de rétroaction : utilisateurs → données → revenus → modèles

Tous ces choix — échelle, API‑first, chat grand public et l'accord Microsoft — ont alimenté une boucle auto‑entretenue :

- De meilleurs modèles attiraient développeurs et utilisateurs.

- Les APIs et ChatGPT facilitaient l'intégration et l'expérimentation.

- L'usage générait des revenus, finançant des runs d'entraînement plus grands et une meilleure infra.

- Les interactions réelles produisaient des données précieuses pour le fine‑tuning et le RLHF.

- Les modèles améliorés alimentaient de nouvelles fonctionnalités (plugins, multimodalité) attirant encore plus d'utilisateurs.

Plutôt que d'optimiser pour des articles parfaits ou des pilotes internes prudents, OpenAI a optimisé pour cette boucle d'amplification. L'échelle n'était pas seulement des modèles plus gros ; c'était des utilisateurs, des données et des flux de trésorerie qui permettaient de repousser la frontière.

Le choc ChatGPT : quand OpenAI a surpassé Google

Quand OpenAI a lancé ChatGPT le 30 novembre 2022, cela ressemblait à une preview de recherche discrète : une simple boîte de chat, pas de paywall, et un court billet de blog. En cinq jours, il a dépassé un million d'utilisateurs. En quelques semaines, captures d'écran et cas d'usage ont envahi Twitter, TikTok et LinkedIn. Des utilisateurs écrivaient des essais, déboguaient du code, rédigeaient des mails juridiques et faisaient du brainstorming d'entreprise avec un seul outil.

Le produit n'était pas présenté comme « une démo d'un modèle Transformer ». C'était juste : « Demandez n'importe quoi. Recevez une réponse. » Cette clarté a rendu la technologie immédiatement lisible aux non‑experts.

La stupeur interne chez Google

Chez Google, la réaction fut plus proche de l'alarme que de l'admiration. La direction a déclaré un « code red ». Larry Page et Sergey Brin ont été rappelés aux discussions produit et stratégie. Des équipes travaillant depuis des années sur des modèles conversationnels se sont soudainement retrouvées sous une intense pression.

Les ingénieurs savaient que Google disposait de systèmes raisonnablement comparables à la base de ChatGPT. Des modèles comme LaMDA, PaLM et Meena avaient déjà montré de la conversation fluide et du raisonnement sur des benchmarks internes. Mais ces systèmes étaient derrière des outils fermés, des revues de sécurité et des approbations complexes.

À l'extérieur, on avait l'impression que Google avait été pris de court.

ChatGPT vs LaMDA : même techno, produit différent

Techniquement, ChatGPT et LaMDA sont cousins : grands modèles Transformer ajustés pour le dialogue. L'écart ne venait pas principalement de l'architecture, mais des décisions produit.

OpenAI :

- A expédié une interface unique et claire

- A accepté la désordre du monde réel et l'itération

- A investi dans l'alignement et le RLHF, puis appris de millions de conversations

Google :

- A retenu LaMDA derrière des démos restreintes

- A optimisé pour l'évitement des risques et la protection de la réputation

- A eu du mal à transformer des prototypes en produit grand public

Le lancement précipité de Bard et ses déboires publics

Sous la pression, Google a annoncé Bard en février 2023. La démo cherchait à reproduire la magie conversationnelle de ChatGPT : posez une question, voyez une réponse intelligente.

Mais l'une des réponses phares — sur les découvertes du James Webb Space Telescope — était incorrecte. L'erreur est passée dans le matériel marketing de Google, repérée en quelques minutes, et a effacé des milliards du market cap d'Alphabet en une journée. Cela a renforcé le narratif brutal : Google était en retard, nerveux et maladroit, tandis qu'OpenAI paraissait confiant et prêt.

L'ironie était douloureuse pour les employés de Google. Les hallucinations et erreurs factuelles sont des problèmes connus des grands modèles de langage. La différence était qu'OpenAI avait déjà normalisé cela auprès des utilisateurs avec des indices UI, des avertissements et un cadrage en mode expérimental. Google, au contraire, avait présenté Bard avec un branding soigné à enjeux élevés — et trébuché sur un fait basique.

Vitesse, UX et narration : l'avantage d'exécution d'OpenAI

L'avantage de ChatGPT par rapport aux systèmes internes de Google n'a jamais été simplement un modèle plus gros ou un algorithme plus novateur. C'était la vitesse d'exécution et la clarté de l'expérience.

OpenAI :

- A transformé une ligne de recherche en un produit viral unique

- A adopté une mentalité de beta publique : « essayez, cassez, dites‑nous »

- A conçu une UX qui correspond directement à ce que les gens font déjà avec du texte : poser une question, obtenir une réponse, itérer

Google a progressé plus lentement, optimisé pour l'absence d'erreur et présenté Bard comme un lancement soigné plutôt qu'une phase d'apprentissage. Quand Bard a atteint les utilisateurs, ChatGPT était déjà devenu une habitude quotidienne pour étudiants, knowledge workers et développeurs.

Le choc pour Google n'était pas seulement qu'OpenAI avait une IA performante. C'était qu'une organisation beaucoup plus petite avait pris des idées qu'il avait aidé à inventer, les avait empaquetées dans un produit que le grand public adorait, et avait redéfini la perception publique de qui dirige l'IA — en quelques semaines.

Culture, incitations et risque : Google vs OpenAI

Itérez avec des instantanés

Expérimentez sans crainte, puis revenez en arrière si quelque chose casse pendant l'itération.

Google et OpenAI partaient de fondations techniques similaires mais de réalités organisationnelles très différentes. Cette différence a façonné presque toutes les décisions autour des systèmes de type GPT.

Incitations : machine à cash vs mode survie

Le cœur de Google, c'est la recherche et la publicité. Ce moteur génère des flux de trésorerie énormes et prévisibles ; la plupart des incitations senior sont liées à sa protection.

Lancer un modèle conversationnel puissant qui pourrait :

- réduire les impressions publicitaires,

- répondre aux questions sans recherche,

- halluciner d'une manière qui dégrade la confiance,

était naturellement vu comme une menace. Le défaut était la prudence. Tout nouveau produit devait prouver qu'il n'endommagerait pas Search ou la sécurité de la marque.

OpenAI, en revanche, n'avait pas de cash cow. Son incitatif était existentiel : livrer des modèles utiles, gagner la faveur des développeurs, conclure des gros contrats de calcul et convertir la recherche en revenus avant les autres. Le risque de ne pas lancer dépassait le risque de lancer trop tôt.

Culture : tolérance au risque et sensibilité PR

Google avait déjà affronté des enquêtes antitrust, des débats sur la vie privée et des régulations globales. Cette histoire a créé une culture où :

- les équipes PR, policy et legal possédaient un fort pouvoir de veto

- les revues de sécurité étaient longues et multilignes

- les dommages réputationnels étaient traités comme un risque majeur

OpenAI acceptait que des modèles puissants seraient désordonnés en public. L'entreprise privilégiait l'itération avec garde‑fous plutôt que des cycles internes d'amélioration prolongés. Elle restait prudente, mais la tolérance au risque produit était bien plus élevée.

Structure et vitesse : comités vs concentration du pouvoir

Chez Google, les grands lancements passent typiquement par des comités multiples, des validations inter‑org et des négociations d'OKR complexes. Cela ralentit tout produit qui traverse Search, Ads, Cloud et Android.

OpenAI a concentré le pouvoir dans un petit groupe de direction et une équipe produit ciblée. Les décisions sur ChatGPT, les prix et l'API pouvaient être prises rapidement puis ajustées selon l'usage réel.

Quand la recherche seule ne suffit plus

Pendant des années, l'avantage de Google reposait sur publier les meilleurs papiers et entraîner les modèles les plus puissants. Mais quand d'autres ont pu reproduire la recherche, l'avantage est devenu : recherche plus :

- design produit

- expérience développeur

- boucles de données

- vitesse de mise sur le marché

OpenAI a traité les modèles comme un substrat produit : publier une API, offrir une interface de chat, apprendre des utilisateurs, puis réinjecter ces apprentissages dans la génération suivante.

Google, en revanche, a passé des années à garder ses systèmes les plus performants comme outils internes ou démos restreintes. Au moment de les productiser à grande échelle, OpenAI avait déjà créé des habitudes, des attentes et un écosystème autour de GPT.

L'écart tenait moins à la maîtrise des transformers qu'à la capacité structurale et volontaire de transformer cette compréhension en produits exposés à des centaines de millions de personnes.

Innovation technique vs innovation produit : qui a fait quoi

Google : le moteur technique

Sur le plan technique, Google est resté une force motrice. Il a mené sur l'infrastructure : TPUs personnalisés, réseaux de centres de données avancés et outils internes rendant l'entraînement massif courant des années avant que la plupart des entreprises n'y parviennent.

Les chercheurs de Google ont poussé l'architecture (Transformers, variantes d'attention, mixture‑of‑experts, modèles augmentés par retrieval), les lois d'échelle et l'efficacité d'entraînement. Beaucoup des papiers clés définissant le ML à grande échelle venaient de Google ou DeepMind.

Mais une grande partie de cette innovation est restée dans des articles, des plateformes internes et des fonctionnalités ciblées dans Search, Ads et Workspace. Plutôt qu'un produit central, les utilisateurs voyaient des dizaines d'améliorations petites et parfois déconnectées.

OpenAI : l'engin produit et plateforme

OpenAI a pris une voie différente. Techniquement, elle s'est appuyée sur des idées publiées par d'autres, y compris Google. Son avantage a été de transformer ces idées en une ligne produit claire :

- Une expérience phare : ChatGPT, avec un cas d'usage évident et sans configuration.

- Une plateforme principale : l'API, avec des endpoints stables et une tarification prévisible.

- Une histoire simple pour les développeurs : de bons docs, des exemples et un modèle mental simple — « appelez le modèle comme une fonction ».

Cet empaquetage unique a permis d'adopter la capacité brute du modèle du jour au lendemain. Alors que Google publiait plusieurs marques et surfaces, OpenAI concentrait l'attention sur un petit nombre de noms et de parcours.

La distribution bat l'avance purement technique

Après le décollage de ChatGPT, OpenAI a gagné ce que Google possédait auparavant : la mindshare par défaut. Les développeurs expérimentaient d'abord sur OpenAI, rédigeant tutoriels et pitchs d'investisseurs autour de produits « build on GPT ».

L'écart de qualité de modèle — s'il existait — pesait moins que l'écart de distribution. L'avance technique de Google en infra et recherche ne s'est pas automatiquement traduite en leadership marché.

La leçon : gagner la science ne suffit pas. Sans produit, tarification, storytelling et intégration clairs, même le moteur de recherche le plus puissant peut se faire dépasser par une société produit focalisée.

Après l'appel d'urgence : Bard, Gemini et la remise à plat de Google

Lancez votre premier produit IA

Transformez une idée en application fonctionnelle via le chat, puis itérez comme une équipe produit.

Quand ChatGPT a montré à quel point Google paraissait en retard sur l'exécution produit, l'entreprise a déclenché un très public « code red ». Ce qui a suivi fut un réalignement accéléré, parfois chaotique, mais réel de la stratégie IA de Google.

De Bard à Gemini : admettre la remise à plat

La première réponse officielle fut Bard, une interface conversationnelle basée sur LaMDA puis mise à niveau sur PaLM 2. Bard donnait l'impression d'être précipité et prudent : accès limité, déploiement lent et contraintes produit évidentes.

La vraie remise à plat est venue avec Gemini :

- Gemini Ultra, Pro, Nano comme famille de modèles cohérente pour le cloud, le grand public et l'usage on‑device

- Bard renommé en Gemini (et Gemini Advanced) pour marquer une rupture nette avec l'ère expérimentale

- Engagement public pour faire de Gemini la marque IA centrale à travers les produits Google

Ce repositionnement a déplacé Google de « société de recherche Search expérimentant des chatbots » vers « plateforme AI‑first avec une famille de modèles phare », même si ce positionnement restait en retard sur la tête d'OpenAI.

Intégrer Gemini dans les produits core de Google

La force de Google, c'est la distribution ; la remise à plat a donc mis l'accent sur l'intégration de Gemini partout où les utilisateurs sont déjà :

- Search : Search Generative Experience et AI Overviews qui répondent directement aux requêtes, pas seulement des liens

- Workspace : assistants Gemini pour Gmail, Docs, Sheets, Slides et Meet qui rédigent, résument et analysent

- Android : Gemini comme assistant système, entrée multimodale et modèles Nano sur l'appareil pour les tâches sensibles à la vie privée

- Chrome : aide à l'écriture, organisation d'onglets et fonctions dev propulsées par Gemini dans le navigateur

La stratégie : si OpenAI gagne sur la nouveauté et la marque, Google peut encore gagner sur la présence par défaut et l'intégration serrée aux flux de travail quotidiens.

Sécurité, gouvernance et exposition mesurée

En élargissant l'accès, Google s'est appuyé fortement sur ses Principes IA et son posture sécurité :

- Red‑teaming et évaluations exhaustives avant de publier des modèles de plus haute capacité

- Déploiements région par région, certaines fonctionnalités étant restreintes selon l'âge et le type de compte

- Investissements en recherche d'alignement, filtres de contenu et comportements de refus

- Travail sur la provenance et le watermarking (p. ex. SynthID pour les médias)

Le compromis : des garde‑fous plus stricts et une expérimentation plus lente versus l'itération plus rapide et les faux pas publics d'OpenAI.

Google a‑t-il réellement rattrapé son retard ?

Sur la qualité pure des modèles, Gemini Advanced et les modèles haut de gamme semblent compétitifs avec GPT‑4 sur de nombreux benchmarks et retours de développeurs. Sur certains tâches multimodales et de codage, Gemini prend même l'avantage ; ailleurs, GPT‑4 et ses successeurs restent la référence.

Là où Google traîne encore : la mindshare et l'écosystème :

- OpenAI reste le choix par défaut pour beaucoup de startups et chercheurs

- La marque « ChatGPT » est synonyme d'IA pour le grand public

- L'API et l'écosystème d'OpenAI ont mûri plus tôt

L'atout contrebalançant est la distribution massive de Google (Search, Android, Chrome, Workspace) et son infra. S'il parvient à convertir cela en expériences AI natives plaisantes, il peut réduire voire inverser l'écart de perception.

Un futur multipolaire, pas une course à deux

La remise à plat intervient dans un champ qui n'est plus seulement Google vs OpenAI :

- OpenAI : notoriété grand public, itération rapide, fort écosystème développeur

- Google : infrastructure, données, distribution et intégration de Gemini

- Open source (Meta Llama, Mistral, etc.) : rapides, économiques et suffisants pour de nombreux usages

- Anthropic et autres : différenciation sur la sécurité, la fiabilité et des verticales spécifiques

Le futur semble multipolaire : pas de gagnant unique, pas une seule entreprise contrôlant la direction des modèles ou produits. Pour les bâtisseurs, cela signifie concevoir des stratégies en partant du principe de plusieurs fournisseurs forts, des modèles open source puissants et des sauts constants — plutôt que de parier tout sur une pile IA unique.

Leçons clés pour les bâtisseurs : comment ne pas répéter l'erreur de Google

Google a montré qu'on peut inventer la percée et quand même perdre la première vague de valeur. Pour les créateurs, l'enjeu n'est pas d'admirer ce paradoxe, mais de l'éviter.

1. Expédiez des produits, pas seulement des articles

Traitez chaque résultat de recherche majeur comme une hypothèse produit, pas comme une fin en soi.

- Désignez un product owner responsable pour chaque grande percée.

- Définissez, en quelques semaines, un problème utilisateur concret et une expérience v1, même étroite.

- Fixez une échéance où le comportement par défaut est : lancement auprès de vrais utilisateurs, même si ce n'est que 1 000 personnes.

Si un résultat mérite d'être publié, il mérite d'être prototypé pour des clients.

2. Alignez les incitations sur l'impact livré

Les gens font ce pour quoi on les récompense.

- Faites dépendre promotions et prestige de l'impact livré aux utilisateurs, pas seulement des citations ou démos internes.

- Célébrez les équipes transverses (recherche, ingénierie, produit, legal) qui mènent une idée risquée en production.

- Donnez des leaders single‑threaded l'autorité sur expérimentation et lancement pour éviter que les décisions ne meurent en comité.

3. Faites des paris produits explicites sur les nouveaux primitifs

Les Transformers étaient un nouveau primitif informatique. Google les a traités comme une amélioration d'infra ; OpenAI comme un moteur produit.

Quand vous tombez sur une idée aussi profonde :

- Nommez 1–2 produits phares qui pousseront cette idée au maximum.

- Isolerez une équipe et un budget pour 12–24 mois.

- Acceptez le chevauchement et la concurrence interne avec les produits legacy si le potentiel est énorme.

4. Équilibrer sécurité et apprentissage réel

Les préoccupations de marque et de sécurité sont valides, mais s'en servir pour justifier des délais infinis est risqué.

Créez un modèle de risque étagé :

- Les cas à fort enjeu (santé, finance, élections) ont des verrous stricts.

- Les expériences à faible enjeu, bien étiquetées, peuvent être lancées tôt avec surveillance et kill switches.

Au lieu d'attendre la certitude, concevez pour une exposition contrôlée : déploiement progressif, journalisation poussée, revert rapide, red‑teaming et communication publique transparente.

5. Possédez la plateforme que vous activez

Google a permis à d'autres de construire des systèmes GPT en open‑sourçant idées et outils, puis a largement regardé les autres bâtir l'expérience iconique.

Quand vous exposez une capacité puissante :

- Construisez un produit de référence montrant le plafond du possible.

- Proposez des APIs tôt, mais conservez une expérience first‑party que vous améliorez sans relâche.

- Traitez les développeurs externes comme des partenaires, pas comme les seuls à découvrir ce que veulent les utilisateurs.

6. Institutionalisez le passage “du papier au produit”

Vous ne pouvez pas compter sur un exec visionnaire ou une équipe héroïque.

Inscrivez la transition dans le fonctionnement de l'entreprise :

- Standardisez une pipeline : idée → démo interne → pilote externe limité → lancement général.

- Créez un groupe dédié à transformer les meilleurs résultats de recherche en produits ou APIs.

- Faites tourner les chercheurs senior dans des rôles produit pour que ceux qui comprennent la capacité possèdent aussi son application.

7. Engagez‑vous à être surpris par votre propre techno

La plus grande erreur de Google n'était pas de ne pas prévoir l'IA ; c'était de sous‑estimer ce que ses propres inventions pourraient devenir entre les mains des consommateurs.

Pour les fondateurs, PMs et dirigeants :

- Supposez que votre percée a plus de surface d'usage que ce que vous percevez en interne.

- Mettez‑la devant des utilisateurs assez tôt pour qu'ils montrent les usages surprenants et à haute valeur.

- Soyez prêts à pivoter la roadmap quand ces usages entrent en conflit avec vos plans initiaux.

Les prochaines percées — modèles, interfaces ou nouveaux primitifs informatiques — seront commercialisées par des équipes prêtes à passer rapidement de « nous avons découvert ça » à « nous sommes pleinement responsables de livrer ça ».

La leçon de Google n'est pas de publier moins ou de cacher la recherche. C'est d'associer la découverte de classe mondiale à une ambition produit tout aussi forte, des incitations claires et un biais pour apprendre en public. Les organisations qui feront cela posséderont la prochaine vague, elles n'écriront pas seulement l'article qui la déclenche.

FAQ

Google a-t-il vraiment inventé GPT, ou est-ce exagéré ?

Pas exactement, mais Google a inventé la technologie centrale qui a rendu GPT possible.

- Des chercheurs de Google ont créé l'architecture Transformer en 2017 ("Attention Is All You Need").

- Les modèles GPT (GPT‑1, 2, 3, 4) sont essentiellement de grands décodeurs Transformer entraînés à très grande échelle.

- OpenAI n'a pas remplacé l'idée de Google ; il l'a dimensionnée et transformée en produit.

Donc Google a construit une grande partie des fondations intellectuelles et d'infrastructure. OpenAI a emporté la première vague de valeur en transformant cette base en un produit grand public (ChatGPT et des APIs).

Si Google disposait de la technologie de base, pourquoi n'a-t-il pas lancé quelque chose comme ChatGPT en premier ?

Google s'est concentré sur la recherche, l'infrastructure et les améliorations progressives de la recherche, tandis qu'OpenAI a misé sur le lancement d'un produit généraliste audacieux.

Différences clés :

Quelle est la différence pratique entre BERT de Google et GPT d'OpenAI ?

BERT et GPT utilisent tous deux des Transformers mais sont optimisés pour des tâches différentes :

Pourquoi Google a-t-il été si prudent à propos de la publication d'un chatbot public puissant ?

Google considérait la génération libre comme risquée et difficile à monétiser dans son modèle principal.

Principales préoccupations :

Qu'est-ce qu'OpenAI a fait de différent pour transformer la recherche de Google en un produit gagnant ?

OpenAI a fait trois paris majeurs et les a exécutés de façon cohérente :

Google était-il réellement en retard sur OpenAI en capacité IA quand ChatGPT est sorti ?

Pas vraiment. Le choc concernait plutôt le produit et le récit, pas la capacité brute des modèles.

- Google disposait déjà de systèmes internes comparables (p. ex. LaMDA, PaLM) avant le lancement de ChatGPT.

- La surprise fut qu'une organisation plus petite :

- A pris une technologie sous-jacente similaire,

- L'a emballée dans un produit viral et simple (ChatGPT),

- A accepté les imperfections publiques et en a tiré des leçons.

Pourquoi ChatGPT semblait-il tellement supérieur à Bard et aux premières réponses concurrentes ?

L'atout de ChatGPT venait de l'exécution et du cadrage, pas d'algorithmes exclusifs.

Éléments clés :

- une seule zone de chat, sans configuration, modèle mental clair.

Quelles sont les principales leçons pour les fondateurs et les équipes produit ?

Pour la plupart des créateurs, l'histoire illustre comment transformer une technologie profonde en avantage durable :

Comment une petite entreprise ou une startup peut-elle éviter de répéter l'erreur de Google autour de l'IA ?

Vous pouvez faire la « erreur Google » à n'importe quelle échelle si vous :

- Traitez la recherche comme une fin plutôt que comme un point de départ produit.

- Laissez des processus averses au risque bloquer des lancements publics contrôlés.

- Optimisez l'organisation et les OKR pour protéger des revenus historiques.

Pour l'éviter :

Google a-t-il définitivement perdu la course à l'IA au profit d'OpenAI, ou rattrape-t-il son retard avec Gemini ?

Google reste une puissance technique et a effectué un grand virage avec Gemini :

- Il propose désormais une famille de modèles cohérente (Ultra, Pro, Nano) et a rebaptisé Bard en Gemini.

- Gemini est intégré dans Search, Workspace, Android et Chrome, offrant une distribution massive.

- Sur de nombreux benchmarks, les modèles haut de gamme de Gemini sont compétitifs avec GPT‑4.

Où Google est encore en retrait :