07 août 2025·8 min

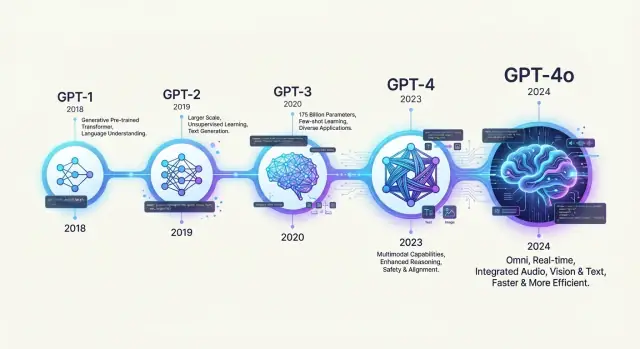

De GPT-1 à GPT-4 : l'histoire des modèles GPT d'OpenAI

Découvrez l'histoire des modèles GPT d'OpenAI, de GPT-1 à GPT-4o, et comment chaque génération a fait progresser la compréhension, l'utilisabilité et la sécurité des modèles de langage.

Pourquoi l'histoire des modèles GPT compte

Les modèles GPT forment une famille de grands modèles de langage conçus pour prédire le mot suivant dans une séquence de texte. Ils lisent d'énormes quantités de texte, apprennent les motifs d'utilisation du langage, puis utilisent ces motifs pour générer du texte, répondre à des questions, écrire du code, résumer des documents, et bien plus encore.

L'acronyme explique l'idée centrale :

- Generative (Génératif) – ils créent du texte nouveau, pas seulement classer du texte existant.

- Pre-trained (Pré-entraîné) – ils sont d'abord entraînés sur des données larges, puis adaptés à des tâches spécifiques.

- Transformer – ils utilisent l'architecture transformer, très efficace pour modéliser des dépendances à longue portée dans le langage.

Comprendre comment ces modèles ont évolué aide à saisir ce qu'ils peuvent ou ne peuvent pas faire, et pourquoi chaque génération semble représenter un saut en capacités. Chaque version reflète des choix techniques et des compromis concernant la taille du modèle, les données d'entraînement, les objectifs et le travail sur la sécurité.

- GPT-1 a introduit la recette de base : pré-entraînement général puis fine-tuning.

- GPT-2 a mis l'accent sur l'échelle et a déclenché les premiers débats publics sur les générateurs puissants de texte.

- GPT-3 a montré de fortes capacités d'apprentissage en contexte, livré principalement via une API.

- GPT-3.5 a transformé cette capacité de recherche en outil d'usage quotidien.

- GPT-4 a amélioré le raisonnement et ajouté des capacités multimodales (texte + images).

- GPT-4o et GPT-4o mini se sont concentrés sur l'efficacité, le coût et l'utilisation interactive en temps réel.

Cet article propose un aperçu chronologique et de haut niveau : des premiers modèles de langage et de GPT-1, en passant par GPT-2 et GPT-3, jusqu'à l'instruction tuning et ChatGPT, puis GPT-3.5, GPT-4 et la famille GPT-4o. Nous examinerons les grandes tendances techniques, l'évolution des usages et ce que ces changements laissent présager pour l'avenir des grands modèles de langage.

Fondations : des premiers modèles de langage à GPT

Avant GPT, les modèles de langage étaient déjà au cœur de la recherche en NLP. Les premiers systèmes étaient des modèles n‑grammes, qui prédisaient le mot suivant à partir d'une fenêtre fixe de mots précédents en utilisant des comptages simples. Ils servaient à la correction orthographique et à l'autocomplétion basique, mais peinaient avec le contexte à longue portée et la rareté des données.

La grande étape suivante fut les modèles de langage neuronaux. Les réseaux feed‑forward puis les réseaux récurrents (RNN), en particulier les LSTM et GRU, apprenaient des représentations distribuées des mots et pouvaient, en principe, gérer de plus longues séquences. Parallèlement, des modèles comme word2vec et GloVe ont popularisé les embeddings de mots, montrant que l'apprentissage non supervisé sur du texte brut pouvait capturer une riche structure sémantique.

Cependant, les RNN étaient lents à entraîner, difficiles à paralléliser et restaient limités sur les contextes très longs. La percée est arrivée avec l'article de 2017 “Attention Is All You Need”, qui a introduit l'architecture transformer. Les transformers ont remplacé la récurrence par l'auto‑attention, permettant au modèle de relier directement n'importe quelles positions d'une séquence et rendant l'entraînement hautement parallèle.

Cela a ouvert la porte à l'échelle des modèles de langage bien au‑delà de ce que les RNN pouvaient gérer. Les chercheurs ont commencé à observer qu'un large transformer entraîné à prédire le token suivant sur d'immenses corpus textuels pouvait apprendre syntaxe, sémantique et même des compétences de raisonnement sans supervision spécifique à la tâche.

L'idée clé d'OpenAI a été de formaliser cela comme un pré‑entraînement génératif : d'abord entraîner un grand transformer decoder‑only sur un corpus Internet‑scale pour modéliser le texte, puis adapter ce même modèle à des tâches en aval avec un entraînement minimal supplémentaire. Cette approche promettait un modèle généraliste plutôt que de nombreux modèles étroits.

Ce changement conceptuel — passer de petites solutions spécifiques à tâche à un grand transformeur pré‑entraîné génératif — a préparé le terrain pour GPT-1 et toute la série GPT qui a suivi.

GPT-1 : le premier transformeur pré‑entraîné génératif

GPT-1 a marqué le premier pas d'OpenAI vers la série GPT que nous connaissons aujourd'hui. Publié en 2018, il comptait 117 millions de paramètres et reposait sur l'architecture Transformer introduite par Vaswani et al. en 2017. Bien que modeste par rapport aux normes ultérieures, il a cristallisé la recette de base suivie par tous les GPT ultérieurs.

L'idée centrale d'entraînement

GPT-1 a été entraîné selon une idée simple mais puissante :

- Pré‑entraînement génératif sur un grand corpus textuel généraliste.

- Fine‑tuning spécifique aux tâches sur de petits jeux de données annotés.

Pour le pré‑entraînement, GPT-1 apprenait à prédire le token suivant sur du texte principalement tiré de BooksCorpus et de sources de type Wikipédia. Cet objectif—la prédiction du mot suivant—ne nécessitait pas d'étiquettes humaines, ce qui permettait au modèle d'absorber un large éventail de connaissances sur le langage, le style et les faits.

Après le pré‑entraînement, le même modèle était fine‑tuné en apprentissage supervisé sur des benchmarks NLP classiques : analyse de sentiment, question‑réponse, entailment textuel, etc. Une petite tête de classification était ajoutée, et la plupart du modèle était entraînée de bout en bout sur chaque jeu de données étiqueté.

Le point méthodologique clé était que le même modèle pré‑entraîné pouvait être légèrement adapté à de nombreuses tâches, au lieu d'entraîner un modèle séparé pour chaque tâche depuis zéro.

Enseignements issus d'un modèle à échelle modeste

Malgré sa taille relativement réduite, GPT-1 a apporté plusieurs enseignements influents :

- Le pré‑entraînement comme apprentissage NLP généraliste : l'étude a montré qu'un modèle génératif unique, entraîné sur du texte brut, pouvait égaler ou surpasser des architectures spécifiques à la tâche après fine‑tuning.

- Les transformers conviennent bien au langage : les modèles alors à la pointe utilisaient souvent des réseaux récurrents ou convolutionnels. GPT-1 a aidé à valider les décodeurs transformer purs comme architecture solide pour la modélisation du langage.

- Indices d'échelle : les résultats suggéraient que les performances continuaient de s'améliorer à mesure que la taille du modèle et des données augmentait, laissant entrevoir que des modèles beaucoup plus grands pourraient dévoiler de nouvelles capacités.

- Architecture unifiée, nombreuses tâches : GPT-1 utilisait essentiellement une seule architecture et un seul objectif pour de nombreux problèmes en aval, annonçant l'idée des « modèles fondation ».

GPT-1 montrait déjà des traces précoces de généralisation zéro‑shot et few‑shot, même si l'évaluation restait majoritairement basée sur le fine‑tuning pour chaque tâche.

Pourquoi GPT-1 est resté prototype de recherche

GPT-1 n'était pas destiné au déploiement grand public ni à une API développeur. Plusieurs facteurs l'ont maintenu dans le domaine de la recherche :

- Limites d'échelle : 117M de paramètres restaient insuffisants pour obtenir une qualité de génération et une factualité élevées.

- Focus d'évaluation étroit : le travail se concentrait sur des benchmarks NLP, pas sur des assistants interactifs ou des cas d'usage en production.

- Sécurité et fiabilité peu mises en avant : on discutait peu des usages abusifs, des hallucinations ou de l'alignement ; ces préoccupations grandirent avec les modèles suivants.

- Pas de produit public : OpenAI a publié l'article et le code, mais pas de service géré ou d'interface.

Pour autant, GPT-1 a établi le modèle type : pré‑entraînement génératif sur de larges corpus textuels, suivi d'un fine‑tuning simple. Chaque GPT ultérieur peut être vu comme un descendant mis à l'échelle, affiné et de plus en plus capable de ce premier transformeur génératif pré‑entraîné.

GPT-2 : montée en charge et premiers débats publics

GPT-2, publié en 2019, a été le premier modèle GPT à attirer une attention mondiale. Il a étendu l'architecture de GPT-1 de 117 millions à 1,5 milliard de paramètres, montrant jusqu'où le simple fait d'augmenter l'échelle d'un modèle transformer de langage pouvait aller.

Monter en échelle : 1,5 milliard de paramètres et ce qui a changé

Architecturalement, GPT-2 ressemblait beaucoup à GPT-1 : un décodeur transformer entraîné pour la prédiction du token suivant sur un large corpus web. La différence clé était l'échelle :

- Paramètres : 117M → 1,5B

- Données : corpus web bien plus vaste et divers

Ce saut de taille a considérablement amélioré la fluidité, la cohérence sur de longs passages et la capacité à suivre des prompts sans entraînement spécifique à la tâche.

Surprises zéro‑shot et few‑shot

GPT-2 a amené de nombreux chercheurs à repenser ce que la simple prédiction du token suivant pouvait accomplir.

Sans aucun fine‑tuning, GPT-2 pouvait accomplir des tâches zéro‑shot comme :

- Répondre à des questions factuelles à partir d'un prompt

- Traduire de courtes phrases entre langues

- Générer des résumés à partir d'un paragraphe d'entrée

Avec quelques exemples dans le prompt (few‑shot), les performances s'amélioraient souvent. Cela laissait entrevoir que de grands modèles de langage pouvaient représenter en interne une large gamme de tâches, utilisant des exemples en contexte comme une interface de programmation implicite.

Publication progressive et craintes d'abus

La qualité de génération impressionnante a déclenché l'un des premiers grands débats publics autour des grands modèles de langage. OpenAI a initialement retenu la version complète à 1,5B, citant des inquiétudes sur :

- Fake news et désinformation à grande échelle

- Spam et contenus à faible effort inondant les plateformes

- Usurpation d'identité et agents trompeurs ressemblant à des humains

OpenAI a adopté une publication échelonnée :

- Publication publique d'un petit modèle 117M

- Diffusion progressive des variantes 345M et 774M

- Publication complète du modèle 1,5B plus tard en 2019

Cette approche progressive fut l'un des premiers exemples d'une politique de déploiement IA explicite axée sur l'évaluation des risques et la surveillance.

Expérimentation communautaire et changement de perception

Même les plus petits checkpoints GPT-2 ont déclenché une vague de projets open source. Les développeurs ont fine‑tuné des modèles pour l'écriture créative, l'autocomplétion de code et des chatbots expérimentaux. Les chercheurs ont sondé les biais, les erreurs factuelles et les modes de défaillance.

Ces expérimentations ont modifié la perception des grands modèles de langage : d'artefacts de recherche de niche à moteurs de texte généralistes. L'impact de GPT-2 a fixé des attentes — et soulevé des inquiétudes — qui ont façonné la réception de GPT-3, ChatGPT et des modèles de la classe GPT-4 dans l'évolution continue de la famille GPT d'OpenAI.

GPT-3 : apprentissage en contexte et ère de l'API

GPT-3 est arrivé en 2020 avec le chiffre médiatique de 175 milliards de paramètres, plus de 100 fois la taille de GPT-2. Ce simple chiffre a attiré l'attention : il suggérait un pouvoir de mémorisation considérable mais, surtout, il a libéré des comportements peu observés à plus petite échelle.

Apprentissage en contexte et essor du prompt engineering

La découverte marquante avec GPT-3 fut l'in‑context learning. Au lieu de fine‑tuner le modèle sur de nouvelles tâches, on pouvait coller quelques exemples dans le prompt :

- Lui montrer quelques paires anglais–français, et il traduisait.

- Fournir quelques paires Q&A, et il répondait à de nouvelles questions.

- Démontrer un style d'écriture, et il l'imitait.

Le modèle n'actualisait pas ses poids ; il utilisait le prompt comme une sorte de jeu d'entraînement temporaire. Cela a mené à des notions de zero‑shot, one‑shot et few‑shot prompting, et a déclenché la première vague de prompt engineering : formuler soigneusement instructions, exemples et formatage pour obtenir de meilleurs comportements sans toucher au modèle sous‑jacent.

Du résultat de recherche à l'API commerciale

Contrairement à GPT-2, dont les poids téléchargeables existaient, GPT-3 a été rendu disponible principalement via une API commerciale. OpenAI a lancé une bêta privée de l'OpenAI API en 2020, positionnant GPT-3 comme un moteur de texte généraliste que les développeurs pouvaient appeler via HTTP.

Cela a déplacé les grands modèles de langage du domaine de la recherche vers une plateforme large. Plutôt que d'entraîner leurs propres modèles, startups et entreprises pouvaient prototyper des idées avec une clé API et payer au token.

Cas d'usage précoces

Les premiers adoptants ont rapidement exploré des usages devenus ensuite classiques :

- Aide au code : génération de snippets, expressions régulières, suggestions de refactoring.

- Assistance à l'écriture : rédaction d'e-mails, billets de blog, textes marketing et résumés.

- Prototypage produit : chatbots, recherche sémantique, outils no‑code/low‑code.

GPT-3 a montré qu'un modèle général accessible via API pouvait alimenter une large gamme d'applications, préparant le terrain pour ChatGPT et les systèmes GPT-3.5 et GPT-4.

Instruction tuning, alignement et l'essor de ChatGPT

Prototyper en une seule session

Testez rapidement une fonctionnalité alimentée par l'IA avant de vous engager dans un long développement.

Pourquoi l'instruction tuning était nécessaire

Le GPT-3 de base n'était entraîné que pour prédire le prochain token sur du texte internet‑scale. Cet objectif le rendait bon pour prolonger des motifs, mais pas nécessairement pour faire ce que les gens demandent. Les utilisateurs devaient souvent élaborer des prompts savamment, et le modèle pouvait :

- Ignorer des instructions ou changer de sujet

- Générer du contenu dangereux, biaisé ou factuellement faux sans avertissement

- Affirmer des informations fabriquées avec excès de confiance

Les chercheurs ont appelé cet écart entre ce que veulent les utilisateurs et ce que fait le modèle le problème d'alignement : le comportement du modèle n'était pas régulièrement aligné sur les intentions humaines, les valeurs ou les attentes de sécurité.

InstructGPT : apprendre à suivre des consignes

InstructGPT (2021–2022) a été un tournant. Plutôt que de s'entraîner uniquement sur du texte brut, OpenAI a ajouté deux étapes clés sur GPT-3 :

- Supervised fine‑tuning (SFT) : des annotateurs humains ont rédigé des réponses idéales à de nombreux prompts (par ex. « Explique l'informatique quantique en termes simples »). Le modèle a été fine‑tuné pour imiter ces réponses.

- Reinforcement learning from human feedback (RLHF) : des annotateurs ont classé plusieurs sorties du modèle pour un même prompt. Un « reward model » a appris ces préférences, puis le modèle de base a été optimisé (via policy gradients) pour produire des réponses mieux classées.

Cela a produit des modèles qui :

- Suivent les instructions de manière plus fiable

- Refusent davantage de requêtes dangereuses

- Sont par défaut plus utiles et polis

Dans des études utilisateurs, des modèles InstructGPT plus petits étaient préférés à des modèles GPT‑3 de plus grande taille non alignés, montrant que l'alignement et la qualité d'interface peuvent compter plus que l'échelle brute.

D'InstructGPT à ChatGPT

ChatGPT (fin 2022) a étendu l'approche InstructGPT au dialogue multi‑tours. C'était essentiellement un modèle de classe GPT-3.5, fine‑tuné avec SFT et RLHF sur des données conversationnelles plutôt que sur des instructions en une seule passe.

Au lieu d'une API ou d'un playground destiné aux développeurs, OpenAI a lancé une interface de chat simple :

- Les utilisateurs pouvaient parler au modèle comme dans une messagerie

- Le contexte entre tours rendait la conversation persistante et naturelle

- On pouvait corriger le modèle, affiner les questions et explorer des idées de façon itérative

Cela a abaissé la barrière pour les non‑techniciens. Pas besoin d'expertise en prompt engineering, pas de code, pas de configuration—il suffisait de taper et d'obtenir des réponses.

Le résultat a été une percée grand public : une technologie reposant sur des années de recherche sur les transformers et l'alignement est devenue accessible à quiconque a un navigateur. L'instruction tuning et le RLHF ont rendu le système suffisamment coopératif et sûr pour une large diffusion, tandis que l'interface de chat a transformé un modèle de recherche en produit global et outil du quotidien.

GPT-3.5 : du système de recherche à l'outil quotidien

GPT-3.5 a marqué le moment où les grands modèles de langage ont cessé d'être principalement des curiosités de recherche pour devenir des utilitaires du quotidien. Il se situe techniquement entre GPT-3 et GPT-4 en capacités, mais son importance réelle tient à son accessibilité et son aspect pratique.

Un pont entre GPT-3 et GPT-4

Techniquement, GPT-3.5 a affiné l'architecture GPT-3 avec de meilleures données d'entraînement, une optimisation mise à jour et un vaste tuning d'instructions. Des modèles de la série — incluant text-davinci-003 et plus tard gpt-3.5-turbo — ont été entraînés pour mieux suivre les instructions en langage naturel que GPT-3, répondre plus sûrement et maintenir des conversations multi‑tours cohérentes.

Cela en a fait une étape naturelle vers GPT-4. GPT-3.5 a préfiguré des tendances qui définiraient la génération suivante : un meilleur raisonnement pour les tâches courantes, une meilleure gestion de prompts longs et un comportement de dialogue plus stable, le tout sans le saut complet de complexité et de coût associé à GPT-4.

ChatGPT et l'essor de l'IA conversationnelle

La première version publique de ChatGPT fin 2022 était propulsée par un modèle de classe GPT-3.5, fine‑tuné avec RLHF. Cela a considérablement amélioré la façon dont le modèle :

- Restait sur le sujet sur plusieurs tours

- Demandait des clarifications plutôt que de deviner

- Suivait des instructions formulées en langage courant

Pour beaucoup, ChatGPT a été la première expérience pratique d'un grand modèle de langage, et il a fixé les attentes sur ce que devrait ressentir un « chat IA ».

gpt-3.5-turbo et pourquoi il est devenu le choix par défaut

Quand OpenAI a publié gpt-3.5-turbo via l'API, il offrait un équilibre convaincant entre prix, vitesse et capacités. Il était moins cher et plus rapide que les modèles GPT-3 antérieurs, tout en fournissant un meilleur suivi des instructions et une meilleure qualité de dialogue.

Cet équilibre a fait de gpt-3.5-turbo le choix par défaut pour de nombreuses applications :

- Les startups l'ont utilisé pour des bots de support client, génération de contenu et outils internes.

- Les développeurs l'ont adopté pour l'explication de code, la documentation inline et la synthèse de code simple.

- Les équipes produit l'ont intégré dans des applications de productivité, faisant de l'autocomplétion, du résumé et du brouillon des attentes standard.

GPT-3.5 a donc joué un rôle de transition décisif : suffisamment puissant pour débloquer des produits réels à grande échelle, économique pour être massivement déployé, et suffisamment aligné pour être utile dans les flux de travail quotidiens.

GPT-4 : modèles multimodaux et raisonnement renforcé

Créez via le chat, pas avec du code générique

Transformez vos acquis sur GPT en une application fonctionnelle, construite via le chat sur Koder.ai.

GPT-4, publié par OpenAI en 2023, a marqué le passage d'un « grand modèle de texte » à un assistant généraliste avec des compétences de raisonnement renforcées et une entrée multimodale.

De GPT-3 à GPT-4 : ce qui a réellement changé

Comparé à GPT-3 et GPT-3.5, GPT-4 a moins mis l'accent sur le simple compte de paramètres et plus sur :

- Raisonnement et fiabilité : meilleures performances aux examens et benchmarks (examens du barreau, problèmes de type olympiades, défis de programmation) et moins d'erreurs logiques évidentes.

- Steerability : les messages système permettent de spécifier style, rôle et contraintes de façon plus directe.

- Contexte plus long : certaines variantes gèrent des prompts bien plus longs, permettant l'analyse de documents et des workflows en plusieurs étapes.

La famille comprend notamment gpt-4 et, plus tard, gpt-4-turbo, qui vise à offrir une qualité égale ou supérieure à moindre coût et latence.

Multimodalité : comprendre plus que du texte

Une des caractéristiques phares de GPT-4 est sa capacité multimodale : en plus du texte, il peut accepter des images. Les utilisateurs peuvent :

- Poser des questions sur des diagrammes, des graphiques ou des notes manuscrites

- Obtenir des descriptions de captures d'écran d'interface

- Utiliser des images pour guider du code, du design ou l'extraction de données

Cela a rendu GPT-4 moins limité au texte et plus proche d'un moteur de raisonnement général qui communique via le langage.

Sécurité, alignement et contrôle

GPT-4 a aussi été entraîné et affiné avec un accent renforcé sur la sécurité et l'alignement :

- Extension du RLHF pour réduire les sorties dangereuses ou trompeuses

- Politiques de contenu et comportements de refus plus raffinés

- Meilleurs outils pour contrôler le ton, la verbosité et la persona via des prompts système et des réglages API

Des modèles tels que gpt-4 et gpt-4-turbo sont devenus des choix de référence pour des usages de production sérieux : automatisation du support client, assistants de codage, outils éducatifs et recherche de connaissances. GPT-4 a préparé le terrain pour des variantes ultérieures comme GPT-4o et GPT-4o mini, qui ont poussé plus loin l'efficacité et l'interaction en temps réel tout en héritant des progrès de raisonnement et de sécurité de GPT-4.

GPT-4o et GPT-4o mini : efficacité et usage en temps réel

GPT-4o ("omni") marque un virage de « performance maximale quel qu'en soit le coût » vers « rapide, abordable et toujours disponible ». Il est conçu pour offrir une qualité comparable à GPT-4 tout en étant beaucoup moins cher à exploiter et suffisamment rapide pour des expériences interactives en direct.

Ce pour quoi GPT-4o est optimisé

GPT-4o unifie texte, vision et audio dans un même modèle. Plutôt que d'assembler des composants séparés, il gère nativement :

- Le chat textuel et le codage

- La compréhension d'images (captures d'écran, photos, diagrammes)

- L'entrée et la sortie audio en temps réel

Cette intégration réduit la latence et la complexité. GPT-4o peut répondre en quasi‑temps réel, diffuser des réponses au fil de la génération et basculer sans friction entre modalités au sein d'une même conversation.

Vitesse, coût et accessibilité quotidienne

Un objectif clé de GPT-4o est l'efficacité : améliorer le rapport performance/prix et réduire la latence par requête. Cela permet à OpenAI et aux développeurs de :

- Proposer des paliers moins chers, voire gratuits, tout en conservant une haute qualité

- Alimenter des produits à fort volume (chat, support, éducation) sans coûts prohibitifs

- Offrir des fonctionnalités interactives comme la diffusion des réponses et les corrections en direct

Le résultat est que des capacités autrefois réservées à des API coûteuses deviennent accessibles aux étudiants, amateurs, petites startups et équipes explorant l'IA pour la première fois.

GPT-4o mini : petit, rapide et omniprésent

GPT-4o mini pousse l'accessibilité plus loin en échangeant une partie de la capacité maximale contre la vitesse et un coût ultra‑faible. Il convient particulièrement pour :

- Assistants toujours actifs et agents de fond

- Chatbots simples, routage et résumés légers

- Outils légers qui nécessitent des réponses rapides et peu coûteuses

Parce que 4o mini est économique, les développeurs peuvent l'intégrer dans bien plus d'endroits—applications, portails clients, outils internes—sans craindre des factures d'utilisation élevées.

Ensemble, GPT-4o et GPT-4o mini étendent les fonctionnalités avancées de GPT aux cas d'usage multimodaux, conversationnels et en temps réel, tout en élargissant l'accès pratique aux modèles de pointe.

Tendances techniques qui ont façonné l'évolution des GPT

Plusieurs courants techniques traversent chaque génération de modèles GPT : l'échelle, le feedback, la sécurité et la spécialisation. Ensemble, ils expliquent pourquoi chaque nouvelle sortie semble qualitativement différente, pas seulement plus grande.

Lois d'échelle et le schéma « plus de données, plus de compute, meilleurs modèles »

Une découverte clé derrière le progrès des GPT est celle des lois d'échelle : en augmentant les paramètres du modèle, la taille du jeu de données et le compute de manière équilibrée, les performances s'améliorent de façon lisse et prévisible sur de nombreuses tâches.

Les premiers modèles ont montré que :

- Des transformers plus grands entraînés sur du texte plus divers et de meilleure qualité généralisent mieux.

- Beaucoup d'aptitudes (traduction, codage, comportements de type raisonnement) émergent une fois que l'échelle dépasse certains seuils, sans entraînement spécifique.

Cela a conduit à une approche systématique :

- Planifier taille du modèle et taille du dataset ensemble, selon des courbes empiriques d'échelle.

- Utiliser des corpus toujours plus grands, dédupliqués et filtrés, mélangeant données web, livres, code et données propriétaires.

- Optimiser l'efficacité d'entraînement (meilleure parallélisation, kernels, utilisation hardware) pour rendre économiquement viable chaque montée en échelle.

Reinforcement learning from human feedback (RLHF)

Les modèles GPT bruts sont puissants mais indifférents aux attentes utilisateur. Le RLHF les transforme en assistants utiles :

- Collecter des réponses rédigées ou notées par des humains.

- Entraîner un reward model qui prédit quelles réponses les humains préfèrent.

- Utiliser du reinforcement learning (souvent Proximal Policy Optimization) pour que le modèle de base génère des réponses à haute récompense.

Au fil du temps, cela a évolué vers instruction tuning + RLHF : d'abord fine‑tuner sur de nombreuses paires instruction‑réponse, puis appliquer RLHF pour affiner le comportement. Cette combinaison sous‑tend les interactions de type ChatGPT.

Évaluations de sécurité et filtres de contenu

À mesure que les capacités augmentaient, la nécessité d'évaluations de sécurité systématiques et d'une application des politiques s'est accrue.

Les pratiques techniques incluent :

- Du red‑teaming dédié et des tests automatisés pour les scénarios d'abus (conseils dangereux, contenu interdit).

- Des variantes du modèle ajustées pour la sécurité, optimisées pour refuser ou rediriger les requêtes à risque.

- Des filtres de contenu qui opèrent en parallèle du modèle : classificateurs et heuristiques vérifiant prompts et sorties contre des politiques de sécurité avant délivrance.

Ces mécanismes s'itèrent régulièrement : de nouvelles évaluations découvrent des modes de défaillance qui alimentent les données d'entraînement, les reward models et les filtres.

D'un modèle unique géant à des familles de modèles adaptées

Les premières versions étaient centrées sur un seul « modèle phare » avec quelques variantes plus petites. Avec le temps, la tendance s'est orientée vers des familles de modèles optimisées pour différentes contraintes et usages :

- Modèles haut de gamme pour le raisonnement complexe et les tâches multimodales.

- Modèles plus légers et moins chers (variantes « mini ») pour l'interaction en temps réel, le déploiement à grande échelle ou l'edge.

- Modèles spécialisés pour le codage, la modération ou les workflows d'entreprise.

Sous le capot, cela reflète une pile mûre : architectures et pipelines d'entraînement partagés, puis fine‑tuning ciblé et couches de sécurité pour produire un portefeuille plutôt qu'un monolithe unique. Cette stratégie multi‑modèle est désormais une tendance technique et produit centrale de l'évolution GPT.

Comment les modèles GPT ont transformé l'usage et les applications de l'IA

Planifiez d'abord, construisez plus proprement

Utilisez le Mode Planification pour cartographier écrans, données et flux avant la génération du code.

Les modèles GPT ont fait passer l'IA basée sur le langage d'un outil de recherche de niche à une infrastructure sur laquelle de nombreuses personnes et organisations s'appuient.

Nouveaux blocs de construction pour les développeurs

Pour les développeurs, les modèles GPT se comportent comme un « moteur de langage » flexible. Plutôt que de coder des règles, on envoie des prompts en langage naturel et on reçoit en retour du texte, du code ou des sorties structurées.

Cela a changé la conception logicielle :

- Les prototypes se construisent en quelques heures via des appels API simples.

- Les applications délèguent des tâches complexes (résumés, traduction, génération de code) au modèle.

- De nouveaux patterns comme les agents, l'utilisation d'outils (function calling) et la génération augmentée par récupération ont émergé.

De nombreux produits s'appuient désormais sur GPT comme composant central plutôt que comme simple fonctionnalité ajoutée.

Intégration par les entreprises

Les entreprises utilisent les GPT à la fois en interne et face au client.

En interne, les équipes automatisent le tri du support, rédigent des e-mails et rapports, assistent la programmation et l'assurance qualité, et analysent documents et logs. En externe, GPT alimente chatbots, copilotes dans des suites de productivité, assistants de codage, outils de contenu et copilotes de domaine pour la finance, le droit, la santé, etc.

Les API et produits hébergés rendent possible l'ajout de fonctionnalités linguistiques avancées sans gérer l'infrastructure ni entraîner des modèles maison, abaissant la barrière d'entrée pour les petites et moyennes structures.

Impacts sur la recherche, l'éducation et le travail créatif

Les chercheurs utilisent GPT pour brainstormer des hypothèses, générer du code d'expérimentation, rédiger des articles et explorer des idées en langage naturel. Enseignants et étudiants s'appuient sur GPT pour des explications, des exercices, du tutorat et de l'aide linguistique.

Écrivains, designers et créateurs utilisent GPT pour l'élaboration, l'idéation, la construction de mondes et le polissage de brouillons. Le modèle devient moins un remplaçant qu'un collaborateur accélérant l'exploration.

Préoccupations et compromis

La diffusion des GPT soulève aussi des problèmes sérieux. L'automatisation peut déplacer certains emplois tout en créant de nouvelles demandes, poussant les travailleurs vers de nouvelles compétences.

Comme GPT est entraîné sur des données humaines, il peut refléter et amplifier des biais sociaux s'il n'est pas correctement cadré. Il peut aussi produire des informations plausibles mais incorrectes, ou être détourné pour produire du spam, de la propagande et d'autres contenus trompeurs à grande échelle.

Ces risques ont motivé des travaux sur les techniques d'alignement, des politiques d'utilisation, la surveillance et des outils de détection et de traçabilité. Équilibrer les nouvelles applications puissantes avec la sécurité, l'équité et la confiance reste un défi ouvert à mesure que les modèles GPT progressent.

Directions futures et questions ouvertes pour les modèles GPT

À mesure que les modèles GPT gagnent en capacités, les questions centrales évoluent de « peut‑on les construire ? » vers « comment devons‑nous les construire, déployer et gouverner ? »

Frontières techniques

Efficacité et accessibilité. GPT-4o et GPT-4o mini laissent entrevoir un avenir où des modèles de haute qualité tournent à moindre coût, sur des serveurs plus petits et peut‑être sur des appareils personnels. Questions clés :

- Jusqu'où peut‑on réduire les modèles tout en préservant la qualité de raisonnement ?

- L'entraînement et l'inférence peuvent‑ils devenir suffisamment économes en énergie pour une montée en charge durable ?

Personnalisation sans surapprentissage. Les utilisateurs veulent des modèles qui mémorisent préférences et styles sans fuiter de données ou devenir biaisés. Les questions ouvertes incluent :

- Comment séparer la connaissance fondamentale du modèle de l'adaptation spécifique à un utilisateur ?

- Comment personnaliser en toute sécurité sur de nombreux appareils et applications ?

Fiabilité et raisonnement. Même les meilleurs modèles hallucinent, échouent silencieusement ou se comportent de façon imprévisible en cas de distribution shift. La recherche porte sur :

- Des méthodes de raisonnement vérifiable et des contrôles assistés par outils

- Des manières de représenter l'incertitude et d'exprimer un "je ne sais pas" approprié

Défis sociétaux et de gouvernance

Sécurité et alignement à grande échelle. À mesure que les modèles gagnent en autonomie via des outils et l'automatisation, les maintenir alignés avec des valeurs humaines—et les garder alignés lors de mises à jour continues—reste un défi. Cela inclut le pluralisme culturel : quelles valeurs sont encodées et comment gérer les désaccords ?

Régulation et normes. Gouvernements et groupes industriels élaborent des règles sur la transparence, l'utilisation des données, le watermarking et le reporting d'incidents. Questions ouvertes :

- Quelles obligations devraient être imposées (audits, red‑teaming, évaluations de sécurité) ?

- Comment harmoniser des règles entre juridictions pour que l'innovation et la sécurité se conjuguent ?

Perspective équilibrée

Les systèmes GPT futurs seront probablement plus efficaces, plus personnalisés et plus intégrés aux outils et organisations. Parallèlement à ces capacités, on peut s'attendre à des pratiques de sécurité plus formelles, des évaluations indépendantes et des contrôles utilisateurs plus clairs. L'histoire de GPT-1 à GPT-4 montre des progrès réguliers, mais aussi que les avancées techniques doivent aller de pair avec la gouvernance, la contribution sociale et une mesure attentive des impacts réels.

FAQ

Qu'est-ce qu'un modèle GPT en termes simples ?

GPT (Generative Pre-trained Transformer) sont de grands réseaux de neurones entraînés à prédire le mot suivant dans une séquence. En faisant cela à grande échelle sur d'immenses corpus textuels, ils apprennent la grammaire, le style, des faits et des schémas de raisonnement. Une fois entraînés, ils peuvent :

- Générer du texte nouveau (histoires, e-mails, code)

- Répondre à des questions et expliquer des concepts

- Résumer et traduire des documents

- Servir d'assistants conversationnels ou de copilotes dans des applications

Pourquoi l'histoire des modèles GPT est-elle importante pour les utilisateurs d'aujourd'hui ?

Connaître l'histoire permet de clarifier :

- Pourquoi les capacités ont bougé entre les versions (par ex. GPT-2 → GPT-3 → GPT-4)

- Ce pour quoi chaque modèle est adapté ou non (raisonnement, longueur de contexte, multimodalité)

- Comment la sécurité et l'alignement ont évolué (de la génération brute à des assistants de type ChatGPT)

- Pourquoi les outils actuels prennent la forme qu'ils ont, des API aux interfaces de chat et aux modèles « mini »

Cela aide aussi à fixer des attentes réalistes : les GPT sont d'excellents apprenants de motifs, mais pas des oracles infaillibles.

Quels sont les grands jalons de GPT-1 à GPT-4o ?

Les jalons clés comprennent :

Comment l'instruction tuning et le RLHF modifient-ils le comportement des GPT ?

L'instruction tuning et le RLHF rendent les modèles plus alignés sur ce que veulent les utilisateurs.

- Instruction tuning (SFT) : affine le modèle sur de nombreux couples prompt–réponse rédigés par des humains, pour lui apprendre à suivre des instructions clairement.

- RLHF : entraîne un modèle de récompense à partir de classements humains des sorties, puis optimise le modèle GPT pour générer des réponses mieux notées.

Ensemble, ils :

Qu'est-ce qui a réellement changé entre GPT-3.5 et GPT-4 ?

GPT-4 se distingue des modèles antérieurs sur plusieurs points :

- Raisonnement : meilleure performance aux examens, tâches de codage et instructions complexes.

- Steerability : les messages système permettent aux développeurs de définir ton, rôle et contraintes.

- Longueur de contexte : certaines variantes acceptent des entrées beaucoup plus longues pour des tâches au niveau des documents.

- il peut accepter des images en entrée, permettant l'analyse de diagrammes ou la compréhension d'interfaces.

À quoi conviennent le mieux GPT-4o et GPT-4o mini ?

GPT-4o et GPT-4o mini sont optimisés pour la vitesse, le coût et l'usage en temps réel plutôt que pour la seule performance maximale.

- GPT-4o : modèle unifié pour texte, images et audio, faible latence, adapté aux chats en direct, assistants vocaux et outils interactifs.

- GPT-4o mini : plus petit et moins cher, idéal pour :

Comment les développeurs et les entreprises intègrent-ils les modèles GPT dans leurs produits ?

Les développeurs utilisent souvent les modèles GPT pour :

- Construire des chatbots et copilotes (support, ventes, outils internes)

- Rédiger et résumer e-mails, rapports, tickets et documentations

- Générer et expliquer du code, des tests et des transformations de données

- Implémenter traduction, analyse de sentiment et classification sans ML sur-mesure

- Prototyper des flux complexes via l'utilisation d'outils et la génération augmentée par récupération

L'accès via API permet d'intégrer ces capacités sans entraîner ni héberger ses propres modèles.

Quelles sont les principales limites et risques des modèles GPT actuels ?

Les modèles GPT actuels présentent des limitations importantes :

- Hallucinations : génération d'informations plausibles mais incorrectes ou fabriquées.

- Biais : les données d'entraînement peuvent encoder des biais sociaux et culturels qui se reflètent dans les sorties.

- Sensibilité au contexte : performance dégradée sur des entrées très longues, désordonnées ou hors distribution.

- ils modélisent des motifs textuels, pas une connaissance ancrée du monde.

Quelles directions futures pour les modèles GPT l'article met-il en avant ?

Plusieurs tendances devraient façonner les futurs systèmes GPT :

- Efficacité : modèles plus petits et moins coûteux avec une qualité proche de GPT-4, potentiellement exécutables sur des appareils personnels ou en périphérie.

- Personnalisation : moyens sûrs d'adapter les modèles aux préférences des utilisateurs sans fuite de données ni surapprentissage.

- meilleure gestion de l'incertitude, raisonnement vérifiable et comportement "je ne sais pas" plus explicite.

Comment les équipes devraient-elles penser l'utilisation sûre et efficace des modèles GPT ?

L'article propose des lignes directrices pratiques :

- Choisir le bon niveau : utiliser des modèles haut de gamme (classe GPT-4) pour le raisonnement complexe ; employer des modèles 4o mini pour les tâches simples à fort volume.

- Superposer la sécurité : combiner des modèles alignés avec des filtres de contenu, des politiques d'usage et une revue humaine quand les enjeux sont élevés.