Définir l'objectif de surveillance SLA

Avant de concevoir des écrans ou d'écrire la logique de détection, clarifiez précisément ce que votre application essaie d'empêcher. « Surveillance SLA » peut signifier n'importe quoi, d'un rapport quotidien à une prédiction de violation seconde par seconde — ce sont des produits très différents avec des besoins d'architecture très différents.

Décidez ce que signifie « temps réel » (et pourquoi)

Commencez par vous mettre d'accord sur la fenêtre de réaction que votre équipe peut exécuter de façon réaliste.

Si votre organisation support fonctionne sur des cycles de 5–10 minutes (files de triage, rotations d’astreinte), alors « temps réel » peut signifier des mises à jour du tableau de bord chaque minute avec des alertes sous 2 minutes. Si vous traitez des incidents à haute sévérité où chaque minute compte, il vous faudra peut‑être une boucle détection‑alerte de 10–30 secondes.

Écrivez cela comme un objectif mesurable, par exemple : « Détecter les risques potentiels de violation en 60 secondes et notifier l'astreinte en 2 minutes. » Cela devient une garde‑fou pour les compromis d'architecture et de coût.

Clarifiez les SLA que vous devez surveiller

Listez les promesses spécifiques que vous suivez et définissez chacune en langage clair :

- Première réponse (par ex. « répondre sous 1 heure »)

- Temps de résolution (par ex. « résoudre sous 24 heures », souvent avec règles de pause)

- Disponibilité/uptime (par ex. « 99,9 % sur le mois »)

Notez aussi comment cela se rapporte aux définitions SLO et SLA dans votre organisation. Si votre SLO interne diffère du SLA client, votre appli devra peut‑être suivre les deux : un pour l'amélioration opérationnelle, un pour le risque contractuel.

Identifiez les parties prenantes et les décideurs

Nommez les groupes qui utiliseront ou dépendront du système : support, engineering, customer success, responsables d'équipe, et répondants d'incident/astreinte.

Pour chaque groupe, capturez ce qu'ils doivent décider sur le moment : « Ce ticket est‑il à risque ? », « Qui en est responsable ? », « Faut‑il escalader ? » Cela façonnera votre tableau de bord, le routage des alertes et les permissions.

Définissez les actions que l'application doit déclencher

Votre objectif n'est pas seulement la visibilité — c'est l'action en temps utile. Décidez ce qui doit se produire quand le risque augmente ou qu'une violation se produit :

- Envoyer des alertes en temps réel vers Slack/email/pager

- Escalader selon la sévérité, le niveau client ou les horaires d'ouverture

- Créer automatiquement une tâche (Jira/Linear) et assigner un propriétaire

Une bonne formulation d'issue : « Réduire les violations SLA en permettant la détection et la réponse aux incidents dans notre fenêtre de réaction convenue. »

Cartographiez vos règles SLA et les cas limites

Avant d'écrire la logique de détection, décrivez exactement ce que signifient « bon » et « mauvais » pour votre service. La plupart des problèmes de surveillance SLA ne sont pas techniques — ce sont des problèmes de définition.

SLA vs SLO vs KPI (en langage simple)

Un SLA (Service Level Agreement) est une promesse faite aux clients, généralement avec des conséquences (crédits, pénalités). Un SLO (Service Level Objective) est un objectif interne que vous visez pour rester au‑dessus du SLA. Un KPI (Key Performance Indicator) est toute métrique que vous suivez (utile, mais pas toujours liée à une promesse).

Exemple : SLA = « répondre sous 1 heure ». SLO = « répondre sous 30 minutes ». KPI = « temps moyen de première réponse ».

Définissez clairement les types de violation

Listez chaque type de violation à détecter et l'événement qui démarre le minuteur.

Catégories courantes de violation :

- Réponse manquée : par ex. ticket créé à 10:00 ; la première réponse doit survenir avant 11:00.

- Résolution manquée : par ex. ticket ouvert ; doit être marqué résolu sous 24 heures (hors pauses approuvées).

- Seuil d'indisponibilité : par ex. disponibilité du service < 99,9 % mensuel, ou une panne unique > 15 minutes.

Soyez explicite sur ce qui compte comme « réponse » (réponse publique vs note interne) et « résolution » (résolu vs fermé), et si la réouverture remet le minuteur à zéro.

Heures ouvrées, 24/7 et règles de fuseau horaire

Beaucoup de SLA ne comptent le temps que durant les heures ouvrées. Définissez le calendrier : jours ouvrés, jours fériés, heures de début/fin, et le fuseau horaire utilisé pour le calcul (du client, du contrat ou de l'équipe). Décidez aussi de ce qui se passe quand le travail traverse ces frontières (par ex. ticket arrivé à 16h55 avec un SLA de 30 minutes).

Conditions de pause et exclusions

Documentez quand l'horloge SLA s'arrête, par exemple :

- En attente du client (info demandée non fournie)

- Fenêtres de maintenance planifiée

- Dépendance tierce (si le contrat le permet)

Écrivez ces règles de façon à ce que l'application puisse les appliquer de manière cohérente et conservez des exemples de cas délicats pour les tests.

Choisir les sources de données et les événements à suivre

Votre moniteur SLA n'est fiable que si les données qui l'alimentent le sont. Commencez par identifier les « systèmes de référence » pour chaque horloge SLA. Pour beaucoup d'équipes, l'outil de ticketing est la source de vérité pour les horodatages du cycle de vie, tandis que le monitoring explique pourquoi quelque chose est arrivé.

Choisissez les systèmes qui détiennent la vérité

Les déploiements SLA en quasi‑temps réel tirent souvent de quelques systèmes centraux :

- Ticketing/helpdesk (Zendesk, ServiceNow, Jira Service Management) : priorité, statut, assigné, client, horodatages

- Outils de monitoring/incident (Datadog, PagerDuty) : incident ouvert/acknowledged/résolu, actions d'astreinte

- CRM/données client (Salesforce, HubSpot) : niveau client, contrat SLA, plan de support

- Logs et pistes d'audit (logs applicatifs, logs de workflow) : contexte détaillé pour enquêtes et litiges

Si deux systèmes divergent, décidez à l'avance lequel prévaut pour chaque champ (par ex. « statut du ticket depuis ServiceNow, niveau client depuis le CRM »).

Listez les événements nécessaires (et ceux qu'on oublie)

Au minimum, suivez les événements qui démarrent, stoppent ou modifient le minuteur SLA :

- Ticket créé (le SLA démarre)

- Changement de statut (incluant « attente client », « en attente », « en pause »)

- Assigné / réassigné (impacte souvent les règles d'escalade)

- Changement de priorité / sévérité (peut changer l'objectif en cours de route)

- Première réponse envoyée et résolu/fermé (le SLA s'arrête)

Considérez également des événements opérationnels : changements du calendrier des heures ouvrées, mises à jour du fuseau client, et changements de jours fériés.

Privilégiez les webhooks pour des mises à jour quasi‑temps réel. Utilisez le polling quand les webhooks ne sont pas disponibles ou fiables. Gardez des exportations API / backfills pour la réconciliation (par ex. jobs nocturnes pour combler les lacunes). Beaucoup d’équipes aboutissent à un hybride : webhook pour la rapidité, polling périodique pour la sécurité.

Prévoyez les problèmes de qualité des données

Les systèmes réels sont désordonnés. Attendez‑vous à :

- Horodatages manquants (stockez « inconnu » et signalez pour révision)

- Événements dupliqués (utilisez des clés d'idempotence et des règles de dédoublonnage)

- Livraison hors d'ordre et dérive d'horloge (triez par horodatage source + temps d'ingestion, et détectez les durées négatives)

Considérez ces points comme des exigences produit — votre détection de violations en dépend.

Concevoir une architecture simple et haute‑niveau

Une bonne application de surveillance SLA est plus facile à construire quand l'architecture est claire et volontairement simple. À haut niveau, vous construisez un pipeline qui transforme des signaux opérationnels bruts en « état SLA », puis utilise cet état pour alerter et alimenter un tableau de bord.

Les composants principaux

Pensez en cinq blocs :

- Ingest : collecter événements et métriques

- Process : normaliser, corréler aux clients/services, calculer minuteries et seuils

- Store : conserver l'état SLA courant (accès rapide) et les enregistrements historiques/audit

- Alert : déclencher notifications et escalades quand une violation est prédite ou constatée

- Display : application web pour « ce qui est à risque maintenant », avec drill‑downs

Cette séparation maintient les responsabilités claires : l'ingestion ne devrait pas contenir la logique SLA, et les dashboards ne devraient pas exécuter de calculs lourds.

Streaming vs recalcul fréquent

Décidez tôt du niveau de « temps réel » requis.

- Streaming d'événements (recommandé pour réaction rapide) : à l'arrivée d'un événement, mettez à jour l'état SLA immédiatement. Supporte prédiction basse latence et alertes rapides.

- Recalcul fréquent (plus simple au départ) : exécutez un job planifié toutes les N minutes qui recompute le risque SLA à partir des données récentes. Fonctionne pour des fenêtres au niveau de l'heure, mais peut manquer des pics courts ou créer du bruit autour du cycle de rafraîchissement.

Approche pragmatique : commencez par un recalcul fréquent pour une ou deux règles SLA, puis migrez les règles à fort impact vers du streaming.

Démarrez avec un modèle de déploiement simple

Évitez la complexité multi‑région et multi‑environnement au début. Une seule région, un environnement de production et un staging minimal suffisent généralement jusqu'à validation de la qualité des données et de l'utilité des alertes. Faites du « scale later » une contrainte de conception, pas une exigence de construction.

Si vous voulez accélérer la première version fonctionnelle du tableau de bord et des workflows, une plateforme de type vibe‑coding comme Koder.ai peut vous aider à générer rapidement une UI React et un backend Go + PostgreSQL à partir d'un spec conversationnel, puis itérer sur les écrans et filtres en validant ce dont les répondants ont réellement besoin.

Exigences non fonctionnelles à définir maintenant

Écrivez ces cibles avant d'implémenter :

- Objectif de disponibilité pour le système de monitoring lui‑même (par ex. 99,9 %).

- Latence de bout en bout événement → tableau de bord/alerte (par ex. <60 secondes).

- Rétention pour l'historique et les audits (par ex. 13 mois).

- Auditabilité : chaque changement d'état SLA doit être explicable (« quel événement a causé cela ? »).

Construire l'ingestion d'événements et la normalisation

L'ingestion est l'endroit où votre système devient fiable — ou bruyant et confus. L'objectif : accepter des événements de nombreux outils, les convertir en un format « unique », et stocker assez de contexte pour expliquer chaque décision SLA plus tard.

Définissez un schéma d'événement clair

Standardisez ce à quoi ressemble un « événement pertinent pour le SLA », même si les systèmes en amont varient. Un schéma de base pratique inclut :

ticket_id (ou identifiant de l'élément de travail)timestamp (quand le changement est survenu, pas quand vous l'avez reçu)status (opened, assigned, waiting_on_customer, resolved, etc.)priority (P1–P4 ou équivalent)customer (identifiant du compte/tenant)sla_plan (quelles règles SLA s'appliquent)

Versionnez le schéma (par ex. schema_version) pour pouvoir faire évoluer les champs sans casser les producteurs plus anciens.

Normalisez avant de calculer

Différents systèmes appellent la même chose par des noms différents : “Solved” vs “Resolved”, “Urgent” vs “P1”, différences de fuseau, priorités manquantes. Construisez une petite couche de normalisation qui :

- mappe les statuts sur un ensemble cohérent

- convertit les horodatages en UTC

- remplit des valeurs par défaut (ou signale) quand les champs requis sont manquants

- attache des champs dérivés (comme

is_customer_wait ou is_pause) qui simplifient ensuite la logique de violation

Idempotence : ne pas compter deux fois les événements

Les intégrations retentent. Votre ingestion doit être idempotente pour que les événements répétés n'engendrent pas de doublons. Approches courantes :

- exiger un

event_id producteur et rejeter les duplicatas

- générer une clé déterministe (par ex.

ticket_id + timestamp + status) et upserter

Conservez une piste d'audit explicable

Quand on demande « Pourquoi avons‑nous alerté ? », vous devez avoir une traçabilité. Conservez chaque événement brut accepté et chaque événement normalisé, plus qui/quoi l'a modifié. Cet historique d'audit est essentiel pour les conversations clients et les revues internes.

Gestion des messages morts pour les échecs

Certains événements échoueront au parsing ou à la validation. Ne les ignorez pas silencieusement. Orientez‑les vers une file/table « dead‑letter » avec la raison de l'erreur, la charge originale et le compteur de retentatives, pour que vous puissiez corriger les mappings et rejouer en toute sécurité.

Choisir le stockage pour l'état, l'historique et les audits

Itérez sans perturber les opérations

Testez les nouvelles règles SLA en toute sécurité, puis revenez rapidement en arrière si les alertes deviennent trop nombreuses.

Votre appli SLA a besoin de deux « mémoires » : ce qui est vrai maintenant (pour déclencher des alertes) et ce qui s'est passé dans le temps (pour expliquer et prouver pourquoi cela a alerté).

Stockez l'état courant pour des décisions rapides

L'état courant est le dernier statut connu de chaque élément de travail (ticket/incident) plus ses minuteries SLA actives (heure de début, temps en pause, heure d'échéance, minutes restantes, propriétaire actuel).

Choisissez un stockage optimisé pour des lectures/écritures rapides par ID et des filtres simples. Options courantes : base relationnelle (Postgres/MySQL) ou clé‑valeur (Redis/DynamoDB). Pour beaucoup d'équipes, Postgres suffit et simplifie le reporting.

Gardez le modèle d'état petit et facile à requêter. Vous le lirez constamment pour des vues comme « risque de violation prochainement ».

Conservez l'historique en log append‑only

L'historique doit capturer chaque changement comme un enregistrement immuable : créé, assigné, priorité changée, statut mis à jour, client répondu, on‑hold démarré/terminé, etc.

Une table d'événements append‑only (ou un event store) rend possibles les audits et les relectures. Si vous découvrez plus tard un bug dans la logique de violation, vous pourrez retraiter les événements pour reconstruire l'état et comparer les résultats.

Pattern pratique : table d'état + table d'événements dans la même base au départ ; évoluez vers un stockage analytique séparé si le volume augmente.

Décisions de rétention et d'archivage

Définissez la rétention selon l'usage :

- Vues opérationnelles : conservez l'état récent et une fenêtre d'historique courte (p.ex. 30–90 jours).

- Audit/conformité : conservez les événements plus longtemps (p.ex. 1–7 ans), puis archivez sur un stockage moins cher.

Utilisez des partitions (par mois/trimestre) pour rendre les archivages et suppressions prévisibles.

Index et requêtes pour vos écrans clés

Planifiez pour les questions que votre tableau de bord posera le plus :

- « Breaching soon » : indexez

due_at et status (et possiblement queue/team).

- « Breached today » : indexez

breached_at (ou un flag de violation) et la date.

- Vues par client ou par service : index composites comme

(customer_id, due_at).

C'est là que la performance se gagne : structurez le stockage autour de vos 3–5 vues principales, pas de tous les rapports possibles.

Implémenter la logique de détection des violations en temps réel

La détection en temps réel consiste surtout à transformer des workflows humains désordonnés (assigné, attente client, réouvert, transféré) en minuteries SLA claires et fiables.

Construire les minuteries SLA : démarrer, arrêter, mettre en pause, reprendre

Commencez par définir quels événements contrôlent l'horloge SLA pour chaque type de ticket ou requête. Schémas communs :

- Start : quand un ticket est créé, ou quand il entre pour la première fois dans un statut « support actif ».

- Pause : quand il passe en « Waiting for customer » ou « On hold ».

- Resume : quand le client répond ou que le ticket revient dans une file active.

- Stop : quand il est résolu/fermé (ou quand la SLA de première réponse est satisfaite).

À partir de ces événements, calculez un due time. Pour des SLA stricts, cela peut être created_at + 2 heures. Pour des SLA basés sur les heures ouvrées, c'est « 2 heures ouvrées », ce qui exige un calendrier.

Module calendrier métier réutilisable

Créez un petit module calendrier qui répond toujours à ces deux questions :

- « Combien de temps ouvré s’est écoulé entre A et B ? »

- « Quel est l'horodatage N minutes ouvrées après A ? »

Conservez jours fériés, heures de travail et fuseaux en un seul endroit pour que toutes les règles SLA utilisent la même logique.

Temps restant et risque de violation

Une fois que vous avez un due time, calculer le temps restant est simple : due_time - now (en minutes ouvrées si applicable). Puis définissez des seuils de risque de violation comme « dû dans 15 minutes » ou « moins de 10 % du SLA restant ». Cela alimente les badges d'urgence et le routage des alertes.

Recalcul continu vs ticks planifiés

Vous pouvez :

- Recalculer en continu (à chaque événement pertinent + à chaque lecture) : conceptuellement simple, mais coûteux à grande échelle.

- Utiliser des ticks planifiés (p.ex. chaque minute) : mettez à jour le temps restant et déclenchez les transitions de risque en batch.

Un hybride pratique : mises à jour pilotées par événements pour la précision, plus un tick à la minute pour attraper les franchissements basés sur le temps quand aucun événement n'arrive.

Mettre en place l'alerte, les escalades et les notifications

Compensez vos coûts de développement

Obtenez des crédits en partageant ce que vous avez construit ou en recommandant des collègues à Koder.ai.

Les alertes sont le moment où la surveillance SLA devient opérationnelle. L'objectif n'est pas « plus de notifications » — c'est amener la bonne personne à effectuer la bonne action avant l'échéance.

Définir les types d'alerte (et leur sens)

Utilisez un petit ensemble de types d'alerte avec une intention claire :

- Avertissement de risque : le SLA est encore sûr, mais tendance vers un manquement (ex. « probable violation dans 30 minutes »).

- Violation confirmée : le SLA est officiellement violé, avec horodatage et périmètre impacté.

- Étape d'escalade : suivi chronométré quand le problème n'a pas été reconnu ou résolu.

Mappez chaque type à une urgence et un canal de diffusion différents (chat pour les avertissements, paging pour les violations confirmées, etc.).

Router les alertes par équipe, service, priorité et niveau client

Le routage doit être piloté par les données, pas codé en dur. Utilisez une table de règles simple : service → équipe propriétaire, puis appliquez des modificateurs :

- Priorité / sévérité (P0–P3)

- Niveau client (entreprise vs standard)

- Heures ouvrées vs astreinte hors heures

Ainsi vous évitez les diffusions massives et rendez la propriété visible.

Ajoutez du dédoublonnage pour éviter le spam d'alertes

Le statut SLA peut fluctuer rapidement pendant la réponse à un incident. Dédupliquez par clé stable comme (ticket_id, sla_rule_id, alert_type) et appliquez :

- une courte fenêtre de cooldown (p.ex. 5–15 minutes)

- envoi basé sur les transitions (notifier seulement sur les changements)

Envisagez aussi de regrouper plusieurs avertissements en un résumé périodique.

Incluez un contexte clair dans chaque alerte

Chaque notification doit répondre à « quoi, quand, qui, et quoi faire maintenant » :

- Propriétaire/équipe et cible d'astreinte

- Heure d'échéance et temps restant

- Prochaine action (acknowledge, assigner, répondre)

- Lien direct vers l'élément source (ex. /tickets/123) et la vue SLA (ex. /sla/tickets/123)

Si quelqu’un ne peut pas agir dans les 30 secondes de lecture, l'alerte a besoin d'un meilleur contexte.

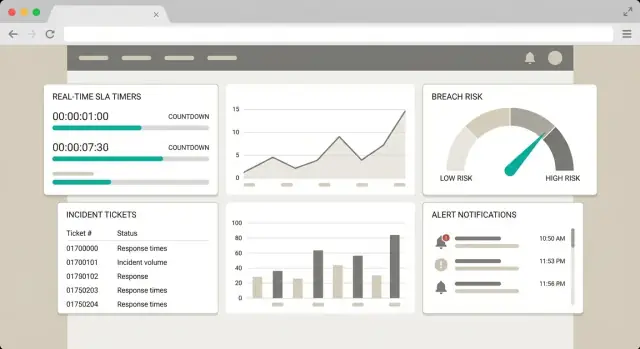

Concevoir le tableau de bord et les workflows utilisateurs

Un bon tableau de bord SLA sert moins aux graphiques qu'à aider quelqu’un à décider quoi faire en moins d'une minute. Concevez l'UI autour de trois questions : Qu'est‑ce qui est à risque ? Pourquoi ? Quelle action dois‑je faire ?

Vues principales qui correspondent au travail des équipes

Commencez par quatre vues simples, chacune avec un but clair :

- Vue d'ensemble : instantané de la charge et du risque (ouverts totaux, dus bientôt, violés, principaux clients impactés).

- À risque bientôt : la boîte de réception opérationnelle — éléments avec la plus haute urgence.

- Violés : ce qui nécessite réponse d'incident, escalade ou mises à jour client.

- Tendances de conformité : reporting hebdo/mensuel pour que les managers détectent les problèmes récurrents (par équipe, client, plan SLA).

Concentrez la vue par défaut sur à risque bientôt, car c'est là que se fait la prévention.

Filtres simples (mais utiles)

Offrez un petit jeu de filtres qui correspondent aux décisions réelles de propriété et de triage :

- Équipe/file (qui en est propriétaire)

- Priorité (impact)

- Client (focus compte)

- Plan SLA (termes contractuels)

- Plage temporelle (24h, 7j, 30j pour les tendances)

Rendez les filtres persistants par utilisateur pour éviter de les reconfigurer à chaque visite.

Expliquez pourquoi un ticket est à risque

Chaque ligne dans « à risque bientôt » doit inclure une courte explication en langage clair, par ex. :

- Horloge SLA : 2h10 restantes (objectif 4h)

- Temps en pause : 1h30 exclu (attente client)

- Règle appliquée : « P1 Heures ouvrées (Lun–Ven) »

- Prochaine échéance : 15:40 heure locale

Ajoutez un tiroir « Détails » montrant la timeline des changements d'état SLA (démarré, mis en pause, repris, violé), pour que l'utilisateur puisse vérifier le calcul sans faire de calcul mental.

Workflows et boutons d'action

Concevez le workflow par défaut : review → open → act → confirm.

Chaque élément doit proposer des actions qui mènent à la source de vérité :

- Ouvrir le ticket : /tickets/{id}

- Voir le client : /customers/{id}

- Politique d'escalade : /oncall/{team}

Si vous proposez des actions rapides (assigner, changer la priorité, ajouter une note), montrez‑les seulement là où vous pouvez les appliquer de façon cohérente et auditez la modification.

Ajouter sécurité, permissions et gouvernance des données

Une appli de surveillance SLA devient rapidement un système de référence pour la performance, les incidents et l'impact client. Traitez‑la comme un logiciel de production : limitez qui peut faire quoi, protégez les données clients, et documentez comment les données sont stockées et supprimées.

Définissez rôles et permissions

Commencez avec un modèle de permission petit et clair et étendez‑le seulement si nécessaire. Configuration commune :

- Viewer : accès lecture seule aux dashboards et rapports.

- Operator : peut acquitter alertes, ajouter des notes, créer des incidents et déclencher des escalades.

- Admin : gère définitions SLA, intégrations, règles de routage, utilisateurs et politiques de données.

Alignez les permissions sur les workflows. Par ex. un operator peut mettre à jour le statut d'un incident, mais seul un admin peut changer les minuteries SLA ou les règles d'escalade.

Protégez les champs sensibles et auditez l'accès

La surveillance SLA contient souvent identifiants client, niveaux de contrat et contenu de tickets. Minimisez l'exposition :

- Masquez ou redigez les détails clients par défaut (affichez les valeurs complètes seulement aux rôles autorisés).

- Séparez « nom d'affichage » et « ID unique » pour que les tableaux de bord restent utiles sans révéler de données privées.

- Journalisez l'accès aux vues et exports sensibles (qui a accédé quoi, quand et d'où).

Sécurisez les intégrations de bout en bout

Les intégrations sont un point faible fréquent :

- Utilisez des scopes least‑privilege : seules les permissions nécessaires pour lire les événements ou envoyer des notifications.

- Stockez les tokens dans un gestionnaire de secrets (pas dans le code ni dans les réglages du dashboard).

- Faites pivoter les tokens régulièrement et immédiatement après les changements de personnel ou suspicion d'exposition.

- Privilégiez les webhooks avec vérification de signature ou des identifiants à courte durée de vie quand possible.

Définissez les politiques de traitement des données tôt

Fixez ces règles avant d'accumuler des mois d'historique :

- Rétention : durée de conservation des événements bruts, états SLA calculés et logs d'audit.

- Suppression : comment supprimer les données client sur demande (et ce qui ne peut pas être supprimé pour conformité).

- Exports : qui peut exporter quels rapports, dans quels formats et avec quelles redactions.

Consignez ces règles et reflétez‑les dans l'UI pour que l'équipe sache ce que le système conserve — et pour combien de temps.

Tester, valider et monitorer le système

Générez l'application full-stack

Générez une interface React et un backend Go/PostgreSQL en quelques minutes, puis peaufinez les workflows.

Tester une appli SLA, ce n'est pas tant « est‑ce que l'UI se charge » que « les minuteries, pauses et seuils sont‑ils calculés exactement comme le contrat l'exige — à chaque fois ». Une petite erreur (fuseau, heures ouvrées, événements manquants) peut générer du bruit ou, pire, des violations manquées.

Validez les règles avec des scénarios réalistes

Transformez vos règles SLA en scénarios concrets que vous pouvez simuler de bout en bout. Incluez les flux normaux et les cas limites inconfortables :

- Tickets créés juste avant la fin des heures ouvrées

- Changements de priorité en cours d'incident (le minuteur se réinitialise‑t‑il ?)

- Réponse client qui met en pause le minuteur (et reprend correctement)

- Événements dupliqués, hors ordre et horodatages manquants

Prouvez que votre logique de détection tient face à la désorganisation opérationnelle, pas seulement aux données propres de la démo.

Utilisez des fixtures d'événements rejouables

Créez des fixtures réutilisables : une petite bibliothèque de « timelines d'incident » que vous pouvez rejouer dans l'ingestion et le calcul chaque fois que vous modifiez la logique. Cela aide à vérifier les calculs dans le temps et empêche les régressions.

Versionnez les fixtures (dans Git) et incluez les sorties attendues : temps restant calculé, moment de violation, fenêtres de pause et déclenchements d'alerte.

Monitorer le moniteur

Traitez l'outil de surveillance comme un système de production et ajoutez ses propres signaux santé :

- Lag d'ingestion (retard par rapport au temps réel)

- Nombre d'événements en échec / dead‑letter

- Erreurs de calcul de minuteurs (par type de SLA)

- Taux de succès de livraison d'alerte et temps de livraison

Si votre dashboard affiche « vert » pendant que les événements sont bloqués, vous perdrez vite la confiance.

Runbooks pour pipelines bloqués et recalcul

Rédigez un runbook court et clair pour les modes de panne courants : consommateurs bloqués, changements de schéma, coupures en amont, backfills. Incluez les étapes pour rejouer les événements et recalculer les minuteries en toute sécurité (quelle période, quels tenants, et comment éviter les double‑alertes). Liez‑le depuis vos docs internes ou une page simple comme /runbooks/sla-monitoring.

Déployer progressivement et planifier les itérations

Lancer une appli de surveillance SLA est plus simple quand vous la traitez comme un produit, pas un projet ponctuel. Commencez par un MVP qui prouve la boucle complète : ingest → évaluer → alerter → confirmer que cela a aidé quelqu’un à agir.

Commencez par une version minimale viable

Choisissez une source de données, un type de SLA et des alertes basiques. Par ex. surveillez la « première réponse » en utilisant un flux d’un seul outil de ticketing, et envoyez une alerte quand le minuteur est sur le point d'expirer (pas seulement après la violation). Cela maintient le périmètre réduit tout en validant les parties délicates : horodatages, fenêtres temporelles et propriété.

Une fois le MVP stable, étendez par petites étapes : ajoutez un deuxième type de SLA (résolution), puis une deuxième source, puis des workflows enrichis.

Planifiez environnements et déploiements sûrs

Mettez en place dev, staging et production tôt. Le staging devrait refléter la configuration production (intégrations, plannings, chemins d'escalade) sans notifier les véritables répondants.

Utilisez feature flags pour déployer :

- Nouvelles règles de violation à une équipe pilote d'abord

- Intégrations en mode « observe‑only » (log des détections, pas d'alertes)

- Changements UI derrière un toggle pour pouvoir revenir en arrière rapidement

Si vous développez vite avec une plateforme comme Koder.ai, les snapshots et rollback sont utiles : vous pouvez livrer l'UI et les règles à un pilote puis revenir en arrière si les alertes deviennent bruyantes.

Documentez l'onboarding pour favoriser l'adoption

Rédigez des docs courtes et pratiques : « Connecter une source de données », « Créer un SLA », « Tester une alerte », « Que faire lorsqu'on est notifié ». Placez‑les près du produit, par ex. une page interne /docs/sla-monitoring.

Construisez le backlog d'itération

Après l'adoption initiale, priorisez les améliorations qui augmentent la confiance et réduisent le bruit :

- Détection d'anomalies simple pour volumes inhabituels ou pics soudains de risque SLA

- Pages de statut client‑visibles pour les services clés (optionnel)

- Rapports opérationnels programmés (résumé hebdo SLA, principales causes de violation, tendances)

Itérez à partir des incidents réels : chaque alerte devrait vous apprendre quoi automatiser, clarifier ou supprimer.