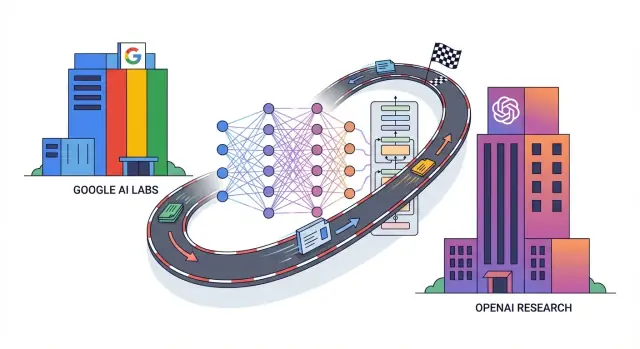

अवलोकन: कैसे Google ने GPT को संभव बनाया लेकिन OpenAI को AI दौड़ जीतने दिया

Google ने AI "छोड़ा" नहीं—उसने उस लहर का एक बड़ा हिस्सा ही अविष्कार किया जो आज की जनरेटिव AI को संभव बनाती है—और फिर किसी और को इसे परिभाषित उत्पाद में बदलने दिया।

Google के शोधकर्ताओं ने Transformer आर्किटेक्चर बनाया, जो GPT मॉडल के पीछे का मूल विचार है। 2017 का वह पेपर, “Attention Is All You Need,” दिखाता है कि कैसे बहुत बड़े मॉडल ट्रेन किए जा सकते हैं जो भाषा को आश्चर्यजनक प्रवाह से समझते और उत्पन्न करते हैं। उस काम के बिना आज का GPT जैसा कुछ मौजूद नहीं होता।

OpenAI की उपलब्धि कोई जादुई नया एल्गोरिथ्म नहीं थी। यह कुछ रणनीतिक चुनाव थे: Transformers को बड़े पैमाने पर स्केल करना, असाधारण प्रशिक्षण रन करना, और परिणाम को आसान‑से‑उपयोग APIs और अंततः ChatGPT के रूप में पैकेज करना—एक उपभोक्ता उत्पाद जिसने AI को करोड़ों लोगों के लिए अनुभवयोग्य बना दिया।

यह लेख उन विकल्पों और ट्रेडऑफ की चर्चा है, न कि किसी गुप्त ड्रामा या व्यक्तिगत नायकों‑खलनायकों की। यह बताता है कि Google की शोध संस्कृति और व्यापार मॉडल ने उसे BERT‑किस्म के मॉडलों और सर्च में क्रमिक सुधारों के पक्ष में क्यों झुका दिया, जबकि OpenAI ने सामान्य‑उद्देश्य जनरेटिव सिस्टम पर बहुत अधिक जोखिम भरा दांव खेला।

हम निम्न पर चर्चा करेंगे:

- Google ने शुरुआती AI दबदबा कैसे बनाया और विश्व‑स्तरीय शोध संगठन कैसे कायम किया

- Transformer पेपर क्यों इतना क्रांतिकारी था—और इससे वास्तव में क्या बदला

- OpenAI ने उस नींव को GPT और ChatGPT में कैसे बदला

- अलग होती रणनीतियाँ: Google पर BERT और सर्च बनाम OpenAI पर स्केल्ड GPT और APIs

- “ChatGPT पल,” जब OpenAI ने सार्वजनिक रूप से Google से बेहतर निष्पादन किया

- दोनों कंपनियों के निर्णयों को आकार देने वाले सांस्कृतिक और प्रेरक अंतर

- Bard और Gemini के साथ Google की रिसेट

- उन निर्माताओं के लिए ठोस सबक जो Google की गलती दोहराना नहीं चाहते

यदि आप AI रणनीति—कैसे शोध उत्पाद में बदलता है, और उत्पाद स्थायी लाभ में कैसे तब्दील होता है—में रुचि रखते हैं, तो यह कहानी यह बताती है कि सबसे बेहतर पेपर होने से ज्यादा क्या मायने रखता है: स्पष्ट दांव लगाना और उसे शिप करने का साहस।

Google का शुरुआती AI दबदबा और शोध संस्कृति

Google ने आधुनिक मशीन लर्निंग में दो बड़े संरचनात्मक लाभ के साथ प्रवेश किया: असाधारण पैमाने पर डेटा और बड़े वितरित सिस्टम के लिए पहले से अनुकूलित इंजीनियरिंग संस्कृति। जब इस मशीनरी को AI की ओर मोड़ा गया, तो वह जल्दी ही इस क्षेत्र का गुरुत्वाकर्षण केंद्र बन गया।

Google Brain से DeepMind तक

Google Brain 2011–2012 के आसपास एक साइड‑प्रोजेक्ट के रूप में शुरू हुआ, जिसका नेतृत्व Jeff Dean, Andrew Ng, और Greg Corrado ने किया। टीम बड़े‑पैमाने पर डीप लर्निंग पर केंद्रित थी, Google के डेटा‑सेंटर्स का उपयोग कर ऐसे मॉडल ट्रेन करने के लिए जो अधिकतर विश्वविद्यालयों की पहुँच से बाहर थे।

DeepMind 2014 में एक प्रमुख अधिग्रहण के ज़रिये जुड़ा। जहाँ Google Brain उत्पादों और इंफ्रास्ट्रक्चर के करीब रहता था, वहीं DeepMind लॉन्ग‑हॉरिज़न रिसर्च—रिइन्फोर्समेंट लर्निंग, गेम्स, और सामान्य‑उद्देश्य लर्निंग सिस्टम—में झुकाव रखता था।

एक साथ, उन्होंने Google को एक बेजोड़ AI इंजन‑रूम दिया: एक समूह जो उत्पादक स्टैक में एम्बेडेड था, और दूसरा जो मूनशॉट रिसर्च पर काम कर रहा था।

AI दबदबे के संकेतक

कई सार्वजनिक मील के पत्थरों ने Google की स्थिति को ठोस किया:

- ImageNet सफलताएँ: जबकि मूल 2012 ImageNet जीत (AlexNet) University of Toronto से आई थी, Google ने जल्दी कई प्रमुख शोधकर्ताओं को नियुक्त किया और Inception जैसे मॉडलों से स्टेट‑ऑफ‑द‑आर्ट को आगे बढ़ाया। विज़न बेंचमार्क Google के पैमाने और टूलिंग का प्रदर्शन बने।

- AlphaGo और उसके उत्तराधिकारी: DeepMind का AlphaGo ने 2016 में Lee Sedol को हराकर दिखाया कि डीप रिइन्फोर्समेंट लर्निंग न्यूनतम मानवीय हस्तक्षेप के साथ जटिल डोमेन में माहिर हो सकता है।

- “AI‑first” बयानबाज़ी: 2016–2017 के आसपास, Sundar Pichai ने Google को "AI‑first कंपनी" कहा। AI ने Search, Ads, YouTube सिफारिशें, Photos, Maps, और Android संचालित किए—बिलियनों उपयोगकर्ताओं तक पहुंचते हुए, भले ही ज्यादातर लोगों ने सीधे मॉडल नहीं देखे हों।

इन जीतों ने कई शोधकर्ताओं को यह विश्वास दिलाया कि यदि आप सबसे महत्वाकांक्षी AI समस्याओं पर काम करना चाहते हैं, तो Google या DeepMind जाना चाहिए।

प्रतिभा‑सघनता एक नवाचार इंजन के रूप में

Google ने विश्व की असाधारण AI प्रतिभा का एक बड़ा हिस्सा केंद्रित कर लिया। Geoffrey Hinton जैसे Turing Award विजेता और Jeff Dean, Ilya Sutskever (OpenAI जाने से पहले), Quoc Le, Oriol Vinyals, Demis Hassabis, और David Silver जैसे वरिष्ठ व्यक्ति कुछ ही संगठनों और भवनों के भीतर कार्य कर रहे थे।

इस सघनता ने शक्तिशाली फीडबैक लूप पैदा किए:

- नए विचार आंतरिक टॉक्स, मेलिंग‑लिस्ट्स और साझा कोड के जरिए जल्दी फैलते थे।

- टीमें कठिन समस्याओं पर एड‑हॉक बन सकती थीं, यह जानते हुए कि आवश्यक विशेषज्ञता आम तौर पर एक अंदरूनी पिंग दूर है।

- शोधकर्ताओं को प्रोडक्शन‑ग्रेड इंफ्रास्ट्रक्चर—डाटा पाइपलाइन, वितरित ट्रेनिंग सिस्टम, और विशेष हार्डवेयर—सुलभ था, बिना सब कुछ खुद बनाए।

यह संयोजन Google को उस जगह बना देता था जहाँ फ्रंटियर AI शोध अक्सर उत्पन्न होता था।

पेपर और प्लेटफ़ॉर्म के लिए अनुकूलित संस्कृति

Google की AI संस्कृति काफी हद तक प्रकाशन और प्लेटफ़ॉर्म बिल्डिंग की ओर झुकी हुई थी, बजाय कि पॉलिश किए हुए उपभोक्ता‑एआई उत्पादों के।

शोध की तरफ़, मानक था:

- NeurIPS, ICML, और ICLR जैसे सम्मेलन में प्रकाशन।

- ओपन‑सोर्स टूल्स (जैसे TensorFlow) जो Google की आंतरिक प्रणालियों को प्रतिबिंबित करते थे।

- विज़न, अनुक्रम मॉडलिंग, रिइन्फोर्समेंट लर्निंग और बड़े‑पैमाने की ट्रेनिंग पर प्रभावशाली पेपर्स जारी करना।

इंजीनियरिंग की तरफ़, Google ने इंफ्रास्ट्रक्चर में संसाधन डाले:

- Tensor Processing Units (TPUs) जो न्यूरल नेटवर्क वर्कलोड के लिए अनुकूलित थे।

- प्रशिक्षण और सर्विंग के परिष्कृत स्टैक्स जो Borg जैसी आंतरिक प्रणालियों से प्रेरित थे।

- डेटा और प्रयोगात्मक प्लेटफॉर्म जो असली ट्रैफ़िक पर बड़े अध्ययन चलाना आसान बनाते थे।

ये चुनाव Google के मुख्य व्यवसायों के साथ अच्छी तरह संरेखित थे। बेहतर मॉडल और टूलिंग सीधे Search प्रासंगिकता, विज्ञापन टार्गेटिंग, और कंटेंट सिफारिशों में सुधार करते थे। AI को एक सामान्य क्षमता‑लेयर के रूप में माना गया, बजाय किसी अलग‑ख़ास उत्पाद श्रेणी के।

परिणाम यह हुआ कि कंपनी ने AI के विज्ञान और पाइपलाइन पर वर्चस्व बनाया, उसे मौजूदा सेवाओं में गहराई से एकीकृत किया, और अपने प्रगति को प्रभावशाली शोध के माध्यम से प्रसारित किया—पर साथ ही उपभोक्ता‑मुखी नए AI अनुभव बनाने में सावधानी बरती।

2017 में, एक छोटी Google Brain और Google Research टीम ने चुपचाप एक पेपर प्रकाशित किया जिसने पूरे क्षेत्र को नया आकार दिया: “Attention Is All You Need”—लेखकों में Ashish Vaswani, Noam Shazeer, Niki Parmar, Jakob Uszkoreit, Llion Jones, Aidan Gomez, Łukasz Kaiser, और Illia Polosukhin थे।

मूल विचार सरल पर क्रांतिकारी था: आप recurrence और convolution को छोड़कर केवल attention का उपयोग करके अनुक्रम‑मॉडल बना सकते हैं। उस आर्किटेक्चर को Transformer नाम दिया गया।

Transformer से पहले, स्टेट‑ऑफ‑द‑आर्ट भाषा प्रणालियाँ RNNs और LSTMs पर आधारित थीं। उनके दो बड़े समस्याएँ थीं:

- Sequential bottleneck: RNNs टोकन को एक‑एक कर प्रोसेस करते हैं, इसलिए ट्रेनिंग और इन्फरेंस में पैरेललाइज़ेशन कठिन होता है। GPUs पिछले स्टेप के खत्म होने का इंतजार करती हैं।

- Long-range dependencies: जैसे‑जैसे अनुक्रम लंबा होता है, RNNs के लिए कई कदम पीछे की जानकारी याद रखना कठिन हो जाता है, भले ही LSTMs और अटेंशन‑लेयर्स जोड़े गए हों।

Transformer ने दोनों समस्याओं का समाधान किया:

- Self-attention हर टोकन को सीधे सीक्वेंस के बाकी सभी टोकनों को "देखने" की अनुमति देता है, एक ही लेयर में।

- मॉडल सभी टोकनों को पैरेलल में प्रोसेस करता है, जिससे ट्रेनिंग GPU‑फ्रेंडली मैट्रिक्स‑मल्टिप्लिकेशन समस्या बन जाती है।

- Multi-head attention मॉडल को विभिन्न संदर्भ‑दृष्टिकोण (वाक्य रचना, कोरफ़रेन्स, विषय आदि) एक साथ सीखने देती है।

क्रम जानने के लिए मॉडल को positional encodings दी जाती हैं, ताकि बिना recurrence के क्रम की जानकारी बनी रहे।

इसने स्केलेबल और मल्टीमॉडल मॉडलों को क्यों खोला

क्योंकि सभी ऑपरेशन्स पैरेललाइज़ेबल और घने मैट्रिक्स‑गुणा पर आधारित हैं, Transformers डेटा और कंप्यूट के साथ साफ़‑सुथरे ढंग से स्केल करते हैं। यही स्केलिंग गुण GPT, Gemini और अन्य उन्नत मॉडलों की निर्भरता की नींव है।

इसी attention मशीनरी को टेक्स्ट के अलावा इमेज पैच, ऑडियो फ्रेम, वीडियो टोकन आदि पर भी लागू किया जा सकता है। इससे आर्किटेक्चर मल्टीमॉडल मॉडलों के लिए स्वाभाविक आधार बन गया—एक ही बैकबोन से पढ़ना, देखना और सुनना संभव हुआ।

खुला प्रकाशन और GPT तक का रास्ता

नियति के रूप में Google ने पेपर को खुला प्रकाशित किया और (फॉलो‑ऑन वर्क व Tensor2Tensor जैसी लाइब्रेरीज़ के माध्यम से) आर्किटेक्चर को आसानी से पुन:उत्पादित करने योग्य बनाया। शोधकर्ता और स्टार्टअप दुनिया भर में विवरण पढ़कर डिज़ाइन कॉपी कर सकते थे और उसे स्केल कर सकते थे।

OpenAI ने ठीक यही किया। GPT‑1 तकनीकी रूप से एक Transformer decoder stack था जिसे भाषा‑मॉडलिंग उद्देश्य से प्रशिक्षित किया गया था। GPT का प्रत्यक्ष तकनीकी पूर्वज Google का Transformer है: वही self-attention ब्लॉक्स, वही positional encodings, और वही स्केल पर भरोसा—पर अलग उत्पाद और संगठनात्मक संदर्भ में लागू किया गया।

जब OpenAI ने GPT लॉन्च किया, वह बिलकुल नई पराडाइम नहीं बना रहा था। वह Google के Transformer ब्लूप्रिंट ले रहा था और उसे उस पार तक धकेल रहा था जहाँ अधिकांश शोध समूह जाने से हिचकते थे।

मूल GPT (2018) तकनीकी रूप से एक Transformer decoder था जिसे साधारण उद्देश्य—एक लंबी टेक्स्ट की अगली टोकन की भविष्यवाणी—पर प्रशिक्षित किया गया था। यह विचार सीधे Google के 2017 Transformer आर्किटेक्चर से आया, पर जहाँ Google ने अनुवाद बेंचमार्क पर ज़्यादा ध्यान दिया, OpenAI ने "अगले‑शब्द की भविष्यवाणी को बड़े पैमाने पर" एक सामान्य‑उद्देश्य टेक्स्ट जनरेटर के रूप में माना।

GPT-2 (2019) ने रेसिपी को 1.5B पैरामीटर और बहुत बड़े वेब कॉर्पस तक स्केल किया। GPT-3 (2020) ने 175B पैरामीटर तक छलांग लगाई, ट्रिलियनों टोकनों पर विशाल GPU क्लस्टरों का उपयोग करके प्रशिक्षित किया गया। GPT-4 ने इस पैटर्न को और बढ़ाया: अधिक पैरामीटर, अधिक डेटा, बेहतर क्युरेशन, और अधिक कंप्यूट, साथ में सुरक्षा‑परतें और RLHF जिससे व्यवहार को संवादात्मक और उपयोगी बनाया गया।

इस प्रगति के दौरान, एल्गोरिद्मिक मूल काफी हद तक Google के Transformer के करीब रहा: self-attention ब्लॉक्स, positional encodings, और स्टैक्ड लेयर्स। छलांग कड़ी मेहनत, पैमाने और निर्बाध इंजीनियरिंग में थी।

रणनीति के रूप में स्केलिंग, सिर्फ़ रिसर्च प्रयोग नहीं

जहाँ Google के शुरुआती भाषा मॉडल (जैसे BERT) समझने वाले टास्क—क्लासिफिकेशन, सर्च रैंकिंग, प्रश्न‑उत्तर—के लिए लक्षित थे, OpenAI ने खुले‑अंत जनरेशन और संवाद के लिए ऑप्टिमाइज़ किया। Google ने स्टेट‑ऑफ‑द‑आर्ट मॉडल प्रकाशित किए और अगले पेपर पर आगे बढ़ गया। OpenAI ने एक विचार को उत्पाद पाइपलाइन में बदला।

Google, DeepMind और अकादमिक लैब्स से खुला शोध GPT को सीधे फीड हुआ: Transformer वेरिएंट, ऑप्टिमाइज़ेशन ट्रिक्स, लर्निंग‑रेट शेड्यूल, स्केलिंग लॉज़, और बेहतर टोकनाइज़ेशन। OpenAI ने इन सार्वजनिक परिणामों को आत्मसात किया, फिर गोपनीय प्रशिक्षण रन और इंफ्रास्ट्रक्चर में भारी निवेश किया।

बौद्धिक चिंगारी—Transformers—Google से आई। उस विचार पर दांव लगाना, उसे स्केल करना, API के रूप में पैकेज करना और फिर मास‑मार्केट चैट प्रोडक्ट के रूप में परोसना OpenAI का निर्णय था।

क्यों Google ने BERT और सर्च को GPT‑शैली के उत्पादों से ऊपर प्राथमिकता दी

टीम सदस्य शामिल करें

Koder.ai के लिए दूसरों को रेफ़र करें और साथ मिलकर बनाने पर अधिक क्रेडिट पाएं।

Google की प्रारंभिक वाणिज्यिक सफलता डीप लर्निंग को उसके मुख्य पैसे कमाने वाले इंजन—सर्च और विज्ञापन—को बेहतर बनाकर आई। उस संदर्भ ने यह निर्धारित किया कि वह Transformer जैसे नए आर्किटेक्चर का मूल्यांकन कैसे करेगा। मुफ्त‑रूप जनरेटर बनाने की बजाय, Google ने उन मॉडलों पर जोर दिया जो रैंकिंग, प्रासंगिकता और गुणवत्ता को बेहतर बनाते थे। BERT इसका सही मेल था।

BERT (Bidirectional Encoder Representations from Transformers) एक encoder‑only मॉडल है जिसे masked language modeling से प्रशिक्षित किया गया: वाक्य के कुछ हिस्से छिपाकर, मॉडल को दोनों ओर के पूरे संदर्भ से गायब टोकन का अनुमान लगाना होता है।

यह प्रशिक्षण उद्देश्य लगभग बिल्कुल Google की समस्याओं से मेल खाता था:

- क्वेरी समझ: सर्च क्वेरीज छोटी, गंदी, और ambiguous होती हैं। BERT की bidirectional context ने Google को जटिल क्वेरीज का अधिक सूक्ष्म अर्थ निकालने में मदद की।

- दस्तावेज़ समझ: अरबों पन्नों को रैंक करना बारीक‑ग्रैन्युलर सिमिलैरिटी मांगता है। BERT embeddings ने Google को क्वेरी‑टू‑पासेज़ मेल बेहतर करने में सक्षम बनाया।

- गुणवत्ता और स्पैम पहचान: masked LM स्वाभाविक रूप से उस तरह के टेक्स्ट का पता लगाने में अच्छा है जो "ठीक नहीं बैठता", जो जंक कंटेंट फ़िल्टर करने में उपयोगी है।

महत्वपूर्ण बात यह है कि encoder‑शैली के मॉडल Google के मौजूद retrieval और रैंकिंग स्टैक में आसानी से फिट हो गए। इन्हें अन्य सिग्नल्स के साथ कॉल किया जा सकता था, सर्च को फिर से लिखे बिना सुधार मिल गया।

मास्क्ड लैंग्वेज मॉडलिंग Google के व्यवसाय से कैसे जुड़ी

Google को ऐसे उत्तर चाहिए जो विश्वसनीय, सुराग‑योग्य (traceable), और मोनेटाइज़ेबल हों:

- विश्वसनीय: सर्च के परिणामों का आधार असली पन्नों और स्रोतों पर होना चाहिए। Masked language modeling मॉडल को भाषा समझने के लिए प्रशिक्षित करता है, न कि लंबे उत्तरों में हॉलुसिनेट करने के लिए।

- सुराग‑योग्य: हर परिणाम किसी प्रकाशक से लिंक करता है, जिससे उपयोगकर्ता जांच कर सके।

- मोनिटाइज़ेबल: सर्च विज्ञापन एक रैंकेड लिस्ट के आसपास साफ बैठते हैं। बेहतर प्रासंगिकता का मतलब उच्च क्लिक‑थ्रू और क्वेरी‑प्रति अधिक मूल्य।

BERT ने ये तीनों बिना सर्च UI या विज्ञापन मॉडल में बड़े बदलाव के सुधार दिए। GPT‑शैली के autoregressive जनरेटर ने, इसके विपरीत, मौजूदा व्यवसाय के लिए स्पष्ट तात्कालिक वैल्यू कम दी।

आंतरिक जोखिम गणना: सुरक्षा, गलत सूचना, और ब्रांड

फ्री‑फॉर्म जनरेशन ने तेज़ी से अंदरुनी चिंताएँ उठाईं:

- गलत जानकारी और हॉलुसिनेशन: जनरेटिव मॉडल तथ्य बनाए बिना आत्मविश्वास से प्रस्तुत कर देते हैं। एक कंपनी के रूप में जिसे अक्सर एक प्राधिकरण माना जाता है, यह सीधे ब्रांड जोखिम है।

- हानिकारक कंटेंट: अनफ़िल्टर्ड जनरेशन विषैला, पक्षपाती, या खतरनाक टेक्स्ट उत्पन्न कर सकता है। इसे Google‑स्केल पर तैनात करना सार्वजनिक बैकलैश और विनियमन जोखिम लाता है।

- नियामकीय जोखिम: जैसे‑जैसे एंटीट्रस्ट और कंटेंट विनियमन तेज़ हुआ, एक वैश्विक, खुले‑अंत वाला AI चैटबोट लॉन्च करना प्रलोभन में पड़ता था।

ज्यादातर आंतरिक उपयोग‑मामले जो नीति समीक्षा पार कर पाते थे, वे सहायक और सीमित थे: Gmail में auto‑completion, स्मार्ट रिप्लाइज, अनुवाद, और रैंकिंग बूस्ट। Encoder‑शैली के मॉडल को सीमित करना, मॉनिटर करना और औचित्य देना GPT‑शैली के सामान्य संवादात्मक सिस्टम से आसान था।

कैनिबलाइज़ेशन का डर: सर्च कैश काउ को न मारो

भले ही Google के पास काम करने वाले चैट और जनरेटिव प्रोटोटाइप थे, एक मूल प्रश्न बना रहा: क्या अच्छे सीधे उत्तर सर्च क्वेरीज और विज्ञापन क्लिक कम कर देंगे?

एक चैट अनुभव जो एक ही बार में पूरा उत्तर दे दे, उपयोगकर्ता व्यवहार बदल देता है:

- बाहरी साइटों पर कम क्लिक → प्रकाशक नाराज़, वेब इकोसिस्टम कमजोर

- पारंपरिक सर्च विज्ञापनों के लिए कम जगह → राजस्व अनिश्चितता

लीडरशिप की प्रवृत्ति थी AI को सर्च का एन्हांसमेंट बनाना, न कि प्रतिस्थापन। इसका मतलब था रैंकिंग ट्वीक, रिच स्निपेट्स, और धीरे‑धीरे अधिक सिमेंटिक समझ—बिल्कुल वही जहाँ BERT उत्कृष्ट था—बजाय किसी साहसी, स्टैंडअलोन कॉन्वर्सेशनल उत्पाद के जो कोर बिजनेस मॉडल को खतरे में डाल सकता।

इन चुनावों ने सार्वजनिक‑मुखी जनरेटिव उत्पादों को धीमा क्यों किया

व्यक्तिगत रूप से, हर निर्णय तर्कसंगत था:

- उन मॉडलों को प्राथमिकता दें जो सीधे सर्च और विज्ञापन मीट्रिक्स में सुधार करें

- सुरक्षा, विश्वसनीयता, और नियामक सतर्कता को प्राथमिकता दें

- सर्च अनुभव और मोनेटाइज़ेशन मॉडल की रक्षा करें

कुल मिलाकर, इनका अर्थ हुआ कि Google ने सार्वजनिक रूप से GPT‑शैली के ऑटोरेग्रेसिव जनरेशन को उत्पादित करने में कम निवेश किया। शोध टीमें बड़े decoder मॉडलों और डायलॉग सिस्टम्स का अन्वेषण करती रहीं, पर प्रोडक्ट टीमें उस चैटबॉट को शिप करने के लिए कम प्रेरित थीं जो:

- स्पष्ट रूप से मुख्य सर्च KPIs में सुधार न करे

- विज्ञापन राजस्व और प्रकाशक संबंधों को खतरे में डाले

- भारी सुरक्षा और पीआर जोखिम लाए

OpenAI, जिसके पास सर्च साम्राज्य नहीं था, ने विपरीत दांव लगाया: कि एक अत्यंत सक्षम, खुले‑पहुंच वाला चैट इंटरफ़ेस—भले ही उसमें कमियाँ हों—बड़ी मात्रा में नई मांग उत्पन्न करेगा। Google का BERT और सर्च‑समायोजन पर फोकस ने उसके उपभोक्ता‑मुखी जनरेटिव टूल्स में कदम रखने में देरी कर दी और ChatGPT को श्रेणी पहले परिभाषित करने का अवसर दिया।

OpenAI का स्केल, API, और उपभोक्ता चैट अनुभव पर दांव

रिसर्च लैब से कैप्ड‑प्रॉफिट कंपनी तक

OpenAI 2015 में एक नॉन‑प्रॉफिट रिसर्च लैब के रूप में शुरू हुआ, जिसे कुछ टेक संस्थापकों ने फंड किया जिनका मानना था कि AI एक अवसर और जोखिम दोनों है। शुरुआती वर्षों में यह Google Brain या DeepMind जैसा ही दिखा: पेपर्स प्रकाशित करना, कोड रिलीज़ करना, विज्ञान को आगे बढ़ाना।

2019 तक नेतृत्व ने महसूस किया कि फ्रंटियर मॉडल अरबों डॉलर के कंप्यूट और इंजीनियरिंग की मांग करेंगे। एक शुद्ध नॉन‑प्रॉफिट के लिए इतना पूंजी जुटाना मुश्किल होगा। इसका हल संरचनात्मक नवाचार था: OpenAI LP, एक "capped‑profit" कंपनी जो नॉन‑प्रॉफिट के अंतर्गत बैठती है।

निवेशक अब वापसी (एक कैप तक) कमा सकते थे, जबकि बोर्ड व्यापक लाभकारी AGI पर मिशन फोकस बनाए रखता था। इस संरचना ने बड़ी फाइनेंसिंग और क्लाउड कंप्यूट डील्स साइन करने को संभव बनाया बिना पारंपरिक स्टार्टअप में बदलने के।

रणनीति के रूप में स्केलिंग

जहाँ कई लैब्स चालाक आर्किटेक्चर या विशिष्ट प्रणालियों के लिए अनुकूलित थे, OpenAI ने एक स्पष्ट दांव लगाया: बेहद बड़े, सामान्य‑उद्देश्य भाषा मॉडल आश्चर्यजनक रूप से सक्षम हो सकते हैं यदि आप डेटा, पैरामीटर और कंप्यूट को लगातार बढ़ाएँ।

GPT‑1, GPT‑2, और GPT‑3 ने एक सरल सूत्र अपनाया: ज्यादातर मानक Transformer आर्किटेक्चर, पर बड़ा, लंबे समय तक प्रशिक्षित, और विविध टेक्स्ट पर। विभिन्न कार्यों के लिए मॉडल को विशेष रूप से तैयार करने के बजाय, उन्होंने prompting और फाइन‑ट्यूनिंग के जरिए "एक बड़ा मॉडल, कई उपयोग" वाले तरीके पर भरोसा किया।

यह सिर्फ़ रिसर्च का रुख नहीं था—यह एक व्यापार रणनीति भी थी: यदि एक API हजारों उपयोग‑केसेज़ को चला सके—कॉपीराइटिंग टूल्स से लेकर कोडिंग असिस्टेंट तक—तो OpenAI एक प्लेटफ़ॉर्म बन सकता था, सिर्फ़ शोध प्रयोगशाला नहीं।

API‑फर्स्ट: मॉडल्स को प्लेटफ़ॉर्म बनाना

GPT‑3 API, 2020 में लॉन्च हुआ, इस रणनीति को ठोस रूप दिया। भारी ऑन‑प्रेमिस सॉफ्टवेयर या कड़े एंटरप्राइज़ उत्पादों पर ज़ोर देने के बजाय, OpenAI ने एक सरल क्लाउड API खुला:

- टेक्स्ट भेजो, मॉडल आउटपुट पाओ.

- प्रति‑टोकन भुगतान.

- ऊपर कुछ भी बनाओ जो तुम चाहो.

यह "API‑first" दृष्टिकोण स्टार्टअप्स और उद्यमों को UX, अनुपालन, और डोमेन विशेषज्ञता संभालने देता था, जबकि OpenAI बड़े मॉडल ट्रेन करने और alignment सुधारने पर ध्यान केंद्रित करता रहा।

API ने जल्दी से स्पष्ट राजस्व इंजन भी बना दिया। OpenAI ने परफेक्ट‑प्रोडक्ट का इंतजार नहीं किया; उसने पारिस्थितिकी तंत्र को उपयोग‑केसेज़ खोजने और उसके ऊपर व्यवसाय बनाने दिया।

अधूरे उत्पाद शिप करने की इच्छा

OpenAI लगातार मॉडलों के पूरी तरह परिष्कृत होने से पहले उन्हें शिप करना चुनता रहा। GPT‑2 का लॉन्च सुरक्षा चिंताओं और चरणबद्ध रिलीज़ के साथ हुआ; GPT‑3 को नियंत्रित बीटा के जरिए निकाला गया—जिसमें स्पष्ट कमियाँ थीं—हॉलुसिनेशन, पक्षपात, और असंगति।

इस दर्शन की सबसे स्पष्ट अभिव्यक्ति ChatGPT थी, देर 2022 में। यह OpenAI के पास सबसे उन्नत मॉडल नहीं था, न ही बहुत परिष्कृत। परंतु उसने दिया:

- एक सरल चैट इंटरफ़ेस जिसे कोई भी समझ सके।

- शुरुआत में मुफ्त पहुँच, जिसने बड़े पैमाने पर प्रयोग को आमंत्रित किया।

- वास्तविक उपयोगकर्ता वार्तालापों के आधार पर तेज़ Итरेट लूप।

OpenAI ने जनता को एक विशाल फीडबैक इंजन माना। गार्डरेल्स, मॉडरेशन, और UX सप्ताह दर सप्ताह विकसित हुए, सीधे प्रेक्षित व्यवहार से सीखे गए निष्कर्षों पर आधारित।

Microsoft के साथ रणनीतिक साझेदारी और कंप्यूट तक पहुंच

OpenAI की स्केल‑सुदृढ़ इच्छा को विशाल कंप्यूट बजट की ज़रूरत थी। Microsoft के साथ साझेदारी निर्णायक रही।

2019 से शुरु होकर अगले वर्षों में गहरे होते हुए, Microsoft ने प्रदान किया:

- OpenAI LP में अरबों डॉलर का निवेश।

- OpenAI के मॉडलों के लिए Azure पर विशेष क्लाउड होस्टिंग।

- Bing Chat और Copilot जैसे उत्पादों के जरिए संयुक्त गो‑टू‑मार्केट।

OpenAI के लिए, इससे मुख्य बाधा हल हो गई: समर्पित AI सुपरकंप्यूटर्स पर प्रशिक्षण रन स्केल करने की सुविधा बिना अपनी क्लाउड बनाने या वित्तपोषण के।

Microsoft के लिए, यह Azure को अलग दिखाने और Office, GitHub, Windows, और Bing में तेजी से AI इन्फ्यूज़ करने का तरीका था।

फीडबैक लूप: उपयोगकर्ता → डेटा → राजस्व → बड़े मॉडल

इन सभी चुनावों—स्केल, API‑पहला, उपभोक्ता चैट, और Microsoft डील—ने एक मजबूतीपूर्ण लूप बनाया:

- बेहतर मॉडल डेवलपर्स और उपयोगकर्ताओं को आकर्षित करते हैं.

- APIs और ChatGPT इंटीग्रेशन और प्रयोग को आसान बनाते हैं.

- उपयोग राजस्व पैदा करता है, जो बड़े प्रशिक्षण रन और बेहतर इंफ्रास्ट्रक्चर को फंड करता है.

- वास्तविक‑दुनिया इंटरैक्शन फाइन‑ट्यूनिंग और मानव फीडबैक से reinforcement सीखने के लिए उच्च‑मूल्य डेटा पैदा करते हैं.

- सुधरे मॉडल नए फीचर और टूलिंग को शक्ति देते हैं जो और उपयोगकर्ताओं को आकर्षित करते हैं.

OpenAI ने परफेक्ट रिसर्च पेपर्स या सतर्क आंतरिक पायलट्स को प्राथमिकता नहीं दी; उसने इस संघनन लूप को ऑप्टिमाइज़ किया। स्केल सिर्फ बड़े मॉडलों के बारे में नहीं था; यह उपयोगकर्ताओं, डेटा और नकदी‑प्रवाह को तेज़ी से बढ़ाने के बारे में था ताकि सीमा को आगे ले जाया जा सके।

ChatGPT का झटका: जब OpenAI ने Google से बेहतर निष्पादन किया

OpenAI ने ChatGPT 30 नवम्बर 2022 को लॉन्च किया—यह एक साधारण चैट बॉक्स, बिना पे‑वाल के और छोटा ब्लॉग पोस्ट के साथ एक कम‑कुंजी रिसर्च प्रीव्यू जैसा लगा। पाँच दिनों में यह एक मिलियन उपयोगकर्ताओं को पार कर गया। कुछ ही हफ्तों में, स्क्रीनशॉट और उपयोग‑केसेज़ Twitter, TikTok, और LinkedIn पर भर गए। लोग निबंध लिख रहे थे, कोड डिबग कर रहे थे, कानूनी ई‑मेल ड्राफ्ट कर रहे थे, और एक ही टूल के साथ बिज़नेस आइडिया ब्रेनस्टॉर्म कर रहे थे।

उत्पाद को "Transformer‑आधारित बड़े भाषा मॉडल का डेमो" के रूप में पेश नहीं किया गया था। यह बस था: कहीं भी कुछ पूछो। उत्तर पाओ। इस स्पष्टता ने तकनीक को गैर‑विशेषज्ञों के लिए तुरंत पढ़ने योग्य बना दिया।

Google के अंदर का झटका

Google के अंदर प्रतिक्रिया प्रशंसा से ज़्यादा अलार्म जैसी थी। नेतृत्व ने "कोड रेड" घोषित किया। Larry Page और Sergey Brin को उत्पाद और रणनीति चर्चाओं में वापस बुलाया गया। वो टीमें जो वर्षों से संवादात्मक मॉडलों पर काम कर रही थीं, अचानक तेज़ निगरानी में आ गईं।

इंजीनियर जानते थे कि Google के पास ChatGPT की नींव‑क्षमताओं के बराबर सिस्टम थे। LaMDA, PaLM, और पहले के Meena ने आंतरिक बेंचमार्क पर पहले ही प्रवाह और तर्क दिखा दिया था। पर वे बाड़ के पीछे या सीमित डेमो में रहे।

बाहरी रूप से ऐसा लगा कि Google चौंक गया।

ChatGPT बनाम LaMDA: समान तकनीक, अलग उत्पाद

तकनीकी स्तर पर, ChatGPT और Google की LaMDA करीबी संबंधी थे: बड़े Transformer‑आधारित भाषा मॉडल जो संवाद के लिए फाइन‑ट्यून किए गए थे। अंतर मॉडल आर्किटेक्चर में कम और उत्पादिक निर्णयों में अधिक था।

OpenAI:

- एक सरल, साफ़ इंटरफ़ेस शिप किया

- सार्वजनिक अशुद्धियों और iterate को स्वीकार किया

- लाखों वार्तालापों से सीखने के लिए RLHF में भारी निवेश किया

Google:

- LaMDA को सीमित डेमो के पीछे रखा

- जोखिम टालने और ब्रांड सुरक्षा की दिशा में ऑप्टिमाइज़ किया

- शोध प्रोटोटाइप को उपभोक्ता‑फेसिंग उत्पाद में बदलने में संघर्ष किया

Bard का जल्दबाज़ी में डेब्यू और सार्वजनिक चूके

प्रतिक्रिया दिखाने के दबाव में, Google ने फरवरी 2023 में Bard की घोषणा की। प्रीव्यू डेमो ChatGPT की संवादात्मक जादुई चाहत को दर्शाने की कोशिश करता था: Bard से कुछ पूछो, एक स्मार्ट उत्तर पाओ।

पर एक प्रमुख उत्तर—James Webb Space Telescope से खोजों के बारे में—गलत था। यह त्रुटि Google के मार्केटिंग मटीरियल में घुस गई, मिनटों में पकड़ी गई, और एक दिन में Alphabet के मार्केट‑कैप में अरबों की कटौती कर दी। यह कठोर कथा को मजबूत कर गया: Google देरी पर था, नर्वस था, और ढीला था, जबकि OpenAI आत्मविश्वासी दिखा।

यह Google के कर्मचारियों के लिए कष्टदायक था। हॉलुसिनेशन और तथ्यगत गलतियाँ बड़े भाषा मॉडलों की जानी‑पहचानी समस्याएँ थीं। फर्क यह था कि OpenAI ने पहले ही इन कमियों को उपयोगकर्ताओं के मन में सामान्य कर दिया था—स्पष्ट UI संकेतों, डिस्क्लेमरों, और प्रयोगात्मक फ्रेमिंग के साथ। Google ने Bard के डेब्यू को चमकदार, उच्च‑दांव वाले ब्रांडिंग के साथ लपेटा—और फिर एक बुनियादी तथ्य पर ठोकर खाई।

गति, UX, और कथा: OpenAI का निष्पादन लाभ

ChatGPT का लाभ कभी सिर्फ बड़ा मॉडल या नया एल्गोरिथ्म नहीं था। यह निष्पादन की गति और अनुभव की स्पष्टता थी।

OpenAI:

- एक शोध लाइन को एक सिंगल, वायरल उत्पाद में बदला

- सार्वजनिक बीटा मनोवृत्ति अपनाई: “इसे आज़माइए, तोड़कर बताइए”

- ऐसा UX डिजाइन किया जो लोगों के पहले से मौजूद टेक्स्ट व्यवहार—पूछना, उत्तर पाना, iterate करना—से सीधे मेल खाता था

Google धीमें चला, शून्य‑त्रुटि के लिए ऑप्टिमाइज़ किया, और Bard को एक चमकदार लॉन्च के रूप में फ़्रेम किया बजाय लर्निंग‑फेज के। जब Bard उपयोगकर्ताओं तक पहुँचा, ChatGPT पहले ही छात्रों, ज्ञान‑कर्मियों, और डेवलपर्स के लिए रोज़मर्रा की आदत बन चुका था।

Google के अंदर की झटका केवल यह नहीं था कि OpenAI के पास अच्छा AI था। यह था कि एक काफी छोटी संस्था ने Google की मदद से आविष्कृत विचारों को उठाकर एक ऐसा उत्पाद पैकेज किया जिसे सामान्य लोग पसंद करने लगे—और सिर्फ़ कुछ हफ्तों में AI में नेतृत्व की धारणा बदल दी।

संस्कृति, प्रेरक, और जोखिम: Google बनाम OpenAI

मोबाइल जल्दी बनाएं

चैट से एक Flutter मोबाइल ऐप बनाएं और v1 से v2 तक लगातार आगे बढ़ें।

Google और OpenAI समान तकनीकी नींव से शुरू हुए पर बहुत अलग संगठनात्मक वास्तविकताओं के साथ। उन अंतर ने लगभग हर निर्णय को आकार दिया जो GPT‑शैली के सिस्टम्स के आसपास लिया गया।

प्रेरक: नकदी‑मशीन बनाम अस्तित्व का दबाव

Google का मुख्य व्यवसाय सर्च और विज्ञापन है। वह इंजन विशाल, पूर्वानुमानित नकदी पैदा करता है, और अधिकांश वरिष्ठ प्रोत्साहन इसे सुरक्षित रखने से जुड़े होते हैं।

एक शक्तिशाली संवादात्मक मॉडल लॉन्च करने से जो कि:

- विज्ञापन इंप्रेशन्स घटा सकता है,

- प्रश्नों का उत्तर दे कर सर्च को कम कर सकता है,

- और हॉलुसिनेट कर कर भरोसा तोड़ सकता है,

यह स्वाभाविक रूप से खतरा माना गया। डिफ़ॉल्ट रवैया सतर्कता था। किसी भी नए AI उत्पाद को यह साबित करना था कि वह सर्च या ब्रांड सुरक्षा को नुकसान नहीं पहुंचाएगा।

OpenAI, इसके विपरीत, के पास कोई कैश काउ नहीं था। उसका प्रोत्साहन अस्तित्वात्मक था: मूल्यवान मॉडल शिप करो, डेवलपर माइंडशेयर जीतो, बड़े कंप्यूट डील्स साइन करो, और दूसरों से पहले शोध को राजस्व में बदलो। लॉन्च न करने का जोखिम बहुत अधिक था बनाम जल्दी लॉन्च करने का जोखिम।

संस्कृति: जोखिम सहने की क्षमता और PR संवेदनशीलता

Google ने antitrust, प्राइवेसी विवाद, और वैश्विक नियमन का अनुभव किया था। उस इतिहास ने एक संस्कृति बनाई जहाँ:

- PR, नीति, और कानूनी टीमें शक्तिशाली वीटो शक्ति रखती थीं

- सुरक्षा समीक्षाएँ लंबी और बहु‑स्तरीय थीं

- प्रतिष्ठा हानि को उच्च प्राथमिकता दी जाती थी

OpenAI ने स्वीकार किया कि शक्तिशाली मॉडल सार्वजनिक रूप में गन्दा हो सकते हैं। कंपनी ने व्यापकता के साथ गार्डरेल्स के बीच इटरैशन को प्राथमिकता दी न कि लंबे आंतरिक परफेक्शन चक्रों को। वह अभी भी सतर्क थी, पर उत्पाद जोखिम सहने की सहनशीलता कहीं ज़्यादा थी।

संरचना और गति: समितियाँ बनाम केंद्रीकृत निर्णय

Google में बड़े लॉन्च आमतौर पर कई समितियों, क्रॉस‑ऑर्ग साइन‑ऑफ, और जटिल OKR वार्ता से होकर गुजरते हैं। यह किसी भी ऐसे उत्पाद को धीमा कर देता है जो Search, Ads, Cloud, और Android को पार करे।

OpenAI ने शक्ति को एक छोटी नेतृत्व टीम और एक केंद्रित उत्पाद टीम में केंद्रित किया। ChatGPT, मूल्य निर्धारण, और API दिशा के फैसले तेज़ी से लिए जा सकते थे और वास्तविक उपयोग के आधार पर समायोजित किए जा सकते थे।

जब केवल शोध पर्याप्त नहीं रहा

सालों तक Google का बढ़त अच्छे पेपर्स प्रकाशित करने और मजबूत मॉडल ट्रेन करने पर टिका रहा। पर जब अन्य लोग शोध को कॉपी कर सकते थे, तो लाभांश शोध और उत्पाद में शिफ्ट हो गया:

- उत्पाद डिजाइन

- डेवलपर अनुभव

- डेटा फीडबैक लूप

- गो‑टू‑मार्केट की गति

OpenAI ने मॉडलों को एक उत्पाद सब्सट्रेट माना: API शिप करो, चैट इंटरफेस शिप करो, उपयोगकर्ताओं से सीखो, फिर अगले मॉडल में फीड करो।

Google ने अपनी सबसे सक्षम प्रणालियों को आंतरिक उपकरणों या संकुचित डेमो के रूप में रखा। जब उसने उन्हें स्केल पर प्रोडक्टाइज़ करने की कोशिश की, OpenAI पहले ही GPT के आसपास आदतें, अपेक्षाएँ, और एक पारिस्थितिकी तंत्र बना चुका था।

अंतर यह था कि कौन ट्रांसफॉर्मर्स को बेहतर समझता था उससे कम, और कौन तैयार और संरचनात्मक रूप से सक्षम था इसे बड़े पैमाने पर शिप करने के लिए उस से अधिक मायने रखता था।

तकनीकी नवाचार बनाम उत्पाद नवाचार: किसने क्या किया

Google: तकनीकी इंजन

तकनीकी पक्ष पर Google लगातार एक पावरहाउस रहा। उसने इंफ्रास्ट्रक्चर में नेतृत्व किया: कस्टम TPUs, उन्नत डेटा‑सेंटर नेटवर्किंग, और आंतरिक टूलिंग जिसने बड़े मॉडलों को ट्रेन करना वर्षों पहले ही कई कंपनियों के लिए नियमित कर दिया था।

Google शोधकर्ताओं ने मॉडल आर्किटेक्चर्स (Transformers, attention वेरिएंट्स, mixture‑of‑experts, retrieval‑augmented मॉडल्स), स्केलिंग लॉज़, और ट्रेनिंग दक्षता पर अग्रणी कार्य किया। आधुनिक बड़े‑पैमाने की ML को परिभाषित करने वाले कई प्रमुख पेपर्स Google या DeepMind से आए।

पर इन नवाचारों का एक बड़ा हिस्सा डॉक्यूमेंट्स, आंतरिक प्लेटफ़ॉर्म, और सर्च/एड्स/वर्कस्पेस में संकुचित सुविधाओं तक सीमित रहा। उपयोगकर्ताओं ने एक स्पष्ट "AI उत्पाद" के बजाय दर्जनों छोटे, असंबद्ध सुधार देखे।

OpenAI: उत्पाद और प्लेटफ़ॉर्म इंजन

OpenAI ने अलग रास्ता अपनाया। तकनीकी रूप से उसने दूसरों के प्रकाशित विचारों (जिसमें Google भी शामिल है) पर निर्माण किया। उसका लाभ यह था कि उन विचारों को एक सिंगल, स्पष्ट उत्पाद लाइन में बदल दिया गया:

- एक प्रमुख अनुभव: ChatGPT, जिस का उपयोग करना सहज और बिना सेटअप के था.

- एक मुख्य प्लेटफ़ॉर्म: API, स्थिर endpoints और अनुमानित मूल्य निर्धारण के साथ.

- डेवलपर्स के लिए एक आसान कहानी: अच्छी डॉक्स, उदाहरण, और सरल मानसिक मॉडल—"मॉडल को एक फ़ंक्शन की तरह कॉल करो।"

इस एकीकृत पैकेजिंग ने कच्ची मॉडल क्षमता को कुछ ऐसा बना दिया जिसे लोग तुरंत अपना सकते थे। जबकि Google ने शक्तिशाली मॉडलों को अनेक ब्रांड और सतहों के तहत जारी किया, OpenAI ने ध्यान कुछ छोटे नामों और फ्लोज़ पर केंद्रित रखा।

डिस्ट्रीब्यूशन शुद्ध तकनीकी नेतृत्व से अधिक मायने रखता है

एक बार ChatGPT ने उछाल लिया, OpenAI ने वह माइंडशेयर हासिल कर ली जो पहले अक्सर Google के पास था। डेवलपर्स ने डिफ़ॉल्ट रूप से OpenAI पर प्रयोग किया, ट्यूटोरियल उससे जुड़े, और स्टार्टअप्स "GPT पर बने" उत्पादों के साथ निवेशकों के पास गए।

यदि कोई मॉडल गुणवत्ता अंतर था—तो भी वह वितरण अंतर के सामने कम मायने रखता था। Google की तकनीकी बढ़त बाजार में नेतृत्व में स्वतः अनुवाद नहीं हुई। सबक: विज्ञान जीतना ही काफी नहीं है। बिना स्पष्ट उत्पाद, मूल्य निर्धारण, कहानी, और एकीकरण मार्ग के, सबसे मजबूत शोध इंजन भी एक केंद्रित उत्पाद कंपनी से पिछड़ सकता है।

जागरण के बाद: Bard, Gemini, और Google का AI रिसेट

ऑप्स की झंझट के बिना लॉन्च करें

अपना ऐप डिप्लॉय और होस्ट करें ताकि आप इसे आज ही असली उपयोगकर्ताओं के साथ साझा कर सकें।

ChatGPT ने Google के उत्पाद निष्पादन में जो कमी उजागर की, उसने कंपनी को एक सार्वजनिक "कोड रेड" करने पर मजबूर किया। इसके बाद जो आया वह तेज़, कभी‑कभी गड़बड़, पर ईमानदार रिसेट था।

Bard से Gemini तक: रिसेट की स्वीकारोक्ति

Google का पहला उत्तर Bard था, LaMDA पर आधारित चैट इंटरफ़ेस जिसे बाद में PaLM 2 पर उन्नत किया गया। Bard में जल्दबाज़ी और सावधानी दोनों की झलक थी: सीमित पहुँच, धीमा रोलआउट, और स्पष्ट उत्पाद प्रतिबंध।

असल रिसेट आया Gemini के साथ:

- Gemini Ultra, Pro, Nano—क्लाउड, उपभोक्ता, और ऑन‑डिवाइस उपयोग के लिए एक सुसंगत मॉडल परिवार

- Bard को Gemini (और Gemini Advanced) के रूप में री‑ब्रांड किया गया ताकि प्रयोगवादी दौर से साफ़ टूटकर नया अध्याय दिखे

- Gemini को Google के उत्पादों में केंद्रित AI ब्रांड बनाने की सार्वजनिक प्रतिबद्धता

यह बदलाव Google को "सर्च कंपनी जो चैटबोट्स का प्रयोग कर रही है" से "AI‑first प्लेटफ़ॉर्म जिसके पास एक प्रमुख मॉडल परिवार है" के रूप में पुनर्स्थापित करने की दिशा में था—भले ही वह OpenAI के शुरुआती नेतृत्व से पीछे था।

Gemini को Google के मुख्य उत्पादों में बुन्ना

Google की ताकत वितरण में है, इसलिए रिसेट का फोकस Gemini को वहाँ घुसाने पर रहा जहाँ उपयोगकर्ता पहले से हैं:

- Search: Search Generative Experience और AI Overviews जो सीधे प्रश्नों का उत्तर देते हैं, सिर्फ़ पन्नों को लिंक नहीं करते

- Workspace: Gmail, Docs, Sheets, Slides, और Meet के लिए Gemini सहायक जो ड्राफ्ट, सारांश, और सामग्री विश्लेषण करते हैं

- Android: सिस्टम‑स्तर असिस्टेंट, मल्टीमॉडल इनपुट, और गोपनीयता‑संवेदी कार्यों के लिए ऑन‑डिवाइस Nano मॉडल

- Chrome: ब्राउज़र के अंदर Gemini‑समर्थित राइटिंग हेल्प, टैब संगठन, और डेवलपर सुविधाएँ

रणनीति यह है कि यदि OpenAI “नवीनता” और ब्रांड में आगे है, तो Google डिफ़ॉल्ट उपस्थिति और दैनिक‑वर्कफ़्लो एकीकरण के द्वारा जीत सकता है।

सुरक्षा, गवर्नेंस, और नियंत्रित एक्सपोज़र

Google ने पहुंच बढ़ाते समय अपने AI सिद्धांतों और सुरक्षा रुख पर भारी निर्भरता दिखाई:

- उच्च‑क्षमता मॉडल जारी करने से पहले व्यापक रेड‑टीमिंग और मूल्यांकन

- क्षेत्र‑दर‑क्षेत्र रोलआउट, कुछ फीचर्स आयु और अकाउंट प्रकार के आधार पर गेटेड

- अलाइनमेंट रिसर्च, कंटेंट फ़िल्टर, और इनकार व्यवहारों में निवेश

- watermarking और स्रोत‑प्रमाणिकता का काम (जैसे SynthID छवि और मीडिया के लिए)

ट्रेडऑफ रहा: OpenAI की तेज़ प्रयोगात्मकता और कभी‑कभी सार्वजनिक चूकों के सापेक्ष ज़्यादा गार्डरेल्स और धीमी तलाश।

क्या Google वास्तव में पकड़ चुका है?

शुद्ध मॉडल गुणवत्ता पर, Gemini Advanced और शीर्ष‑स्तरीय Gemini मॉडल कई बेंचमार्क और डेवलपर रिपोर्ट्स पर GPT‑4 के समकक्ष दिखते हैं। कुछ मल्टीमॉडल और कोडिंग टास्क में Gemini आगे भी है; कुछ में GPT‑4 और उसके उत्तराधिकारी अभी भी मानक सेट करते हैं।

जहाँ Google अभी भी पिछड़ा है वह है माइंडशेयर और पारिस्थितिकी तंत्र:

- OpenAI कई स्टार्टअप्स और शोधकर्ताओं के लिए डिफ़ॉल्ट चुनाव बना हुआ है

- “ChatGPT” ब्रांड मुख्यधारा उपयोगकर्ताओं के लिए AI का पर्याय बन चुका है

- OpenAI का API और प्लग‑इन/टूलिंग पारिस्थितिकी‑तंत्र पहले और तेज़ी से परिपक्व हुआ

Google का संतुलन उसकी विशाल वितरण (Search, Android, Chrome, Workspace) और गहरी इन्फ्रा है। यदि वह इन्हें त्वरित, AI‑नेटिव अनुभवों में बदल दे, तो वह धारणा अंतर को कम या उलट भी सकता है।

एक बहुध्रुवीय भविष्य, दो‑घोड़ों की दौड़ नहीं

रिसेट ऐसी फ़ील्ड में हो रहा है जो अब केवल Google बनाम OpenAI नहीं है:

- OpenAI: उपभोक्ता माइंडशेयर, तेज़ इटरेशन, मजबूत डेवलपर पारिस्थितिकी तंत्र

- Google: इंफ्रा, डेटा, वितरण, और Gemini के माध्यम से उत्पादों में गहन एकीकरण

- ओपन‑सोर्स (Meta की Llama, Mistral, और अन्य): तेज़‑चलन, सस्ता, और कई उपयोग‑मामलों के लिए पर्याप्त

- Anthropic और अन्य: सुरक्षा, विश्वसनीयता, और विशिष्ट वर्टिकल में अंतर

Google का देर से परन्तु गंभीर रिसेट इसका अर्थ यह नहीं कि वह जनरेटिव AI क्षण "छोड़" गया है। पर भविष्य बहुध्रुवीय दिखता है: कोई एक विजेता नहीं, और कोई एक कंपनी मॉडल या उत्पाद नवाचार की दिशा नियंत्रित नहीं करेगी।

निर्माताओं के लिए इसका मतलब है ऐसी रणनीतियाँ डिजाइन करना जो कई मजबूत प्रदाताओं, शक्तिशाली ओपन मॉडलों, और निरंतर leapfrogging को मानकर चलें—न कि एक ही AI स्टैक या ब्रांड पर सब कुछ दांव लगाने का तरीका।

निर्माताओं के लिए प्रमुख सबक: Google की गलती न दोहराएं

Google ने साबित कर दिया कि आप अविष्कार कर सकते हैं और फिर भी पहली महत्वपूर्ण वैल्यू की लहर हार सकते हैं। निर्माताओं के लिए मकसद इस विरोधाभास की प्रशंसा नहीं है, बल्कि इसे दोहराने से बचना है।

1. पेपर्स नहीं, उत्पाद शिप करें

प्रत्येक बड़े शोध नतीजे को एक उत्पाद परिकल्पना मानें, न कि अंतिम बिंदु।

- हर बड़े शोध परिणाम पर एक सीधे जिम्मेदार उत्पाद मालिक रखें।

- कुछ हफ्तों के भीतर एक स्पष्ट उपयोगकर्ता समस्या और एक v1 अनुभव परिभाषित करें, चाहे वह कितना भी संकरा क्यों न हो।

- एक समय‑सीमा रखें जहाँ डिफ़ॉल्ट परिणाम यह हो: यह वास्तविक उपयोगकर्ताओं के लिए लॉन्च होता है, भले ही सिर्फ 1,000 उपयोगकर्ताओं तक हो।

यदि कोई परिणाम प्रकाशित करने लायक है, तो वह ग्राहकों के लिए प्रोटोटाइप बनाकर परखने लायक भी है।

2. प्रोत्साहन शिप किए गए प्रभाव के अनुरूप बनाएं

लोग वही करते हैं जिनके लिए उन्हें पुरस्कृत किया जाता है।

- प्रोन्नति और प्रतिष्ठा को केवल संदर्भों, पेटेंट, या आंतरिक डेमो पर न बल्कि लॉन्च किए गए उपयोगकर्ता‑प्रभाव पर निर्भर बनाएं।

- क्रॉस‑फंक्शनल टीमों (शोध, इंजीनियरिंग, उत्पाद, कानूनी) को मनाएं जो जोखिम भरे विचार को प्रोडक्शन में ले जाती हैं।

- एकल‑धागा नेताओं को अधिकार दें ताकि निर्णय समितियों में दम न तोड़ें।

3. नए प्रिमिटिव पर स्पष्ट उत्पाद दांव लगाएँ

Transformers जैसे गहरे विचार को जब आप खोजते हैं:

- 1–2 प्रमुख उत्पादों का नाम रखें जो उस विचार को सीमा तक पुश करें।

- कम‑से‑कम 12–24 महीनों के लिए टीम और बजट निर्धारित करें।

- लेगेसी उत्पादों के साथ ओवरलैप और आंतरिक प्रतिस्पर्धा स्वीकार करें यदि संभावित लाभ बड़ा हो।

4. सुरक्षा और वास्तविक‑विश्व सीखने के बीच संतुलन बनाएँ

ब्रांड और सुरक्षा चिंताएँ वैध हैं, पर उन्हें अनंत देरी का औचित्य न बनने दें।

एक टायर्ड रिस्क मॉडल बनाएं:

- उच्च‑जोखिम उपयोग‑मामले (स्वास्थ्य, वित्त, चुनाव) के लिए सख्त गेट्स रखें।

- कम‑जोखिम, स्पष्ट रूप से लेबल किए गए प्रयोग जल्दी शिप किए जा सकते हैं, पर सावधानीपूर्वक मॉनिटर और रिवर्ट‑पाथ रखें।

निश्चितता का इंतजार करने के बजाय नियंत्रित एक्सपोज़र के लिए डिज़ाइन करें: प्रोग्रेसिव रोलआउट, मजबूत लॉगिंग, तेज़ रिवर्ट, रेड‑टीमिंग, और सार्वजनिक संचार कि आप अभी भी सीख रहे हैं।

5. आप जो सक्षम करते हैं उसके प्रदर्शन उत्पाद का मालिक बनें

Google ने दूसरों को GPT‑शैली सिस्टम बनाने लायक विचार और टूल उपलब्ध कराए, फिर किनारから देखा कि दूसरे आइकॉनिक अनुभव बना रहे हैं।

किसी शक्तिशाली क्षमता को सार्वजनिक करते समय:

- एक रेफरेंस प्रोडक्ट बनाएं जो यह दिखाए कि उच्चतम संभावना क्या हो सकती है।

- API जल्दी दें, पर एक प्राथमिक‑पक्ष अनुभव रखें जिसे आप लगातार सुधारें।

- बाहरी डेवलपर्स को पार्टनर समझें, पर यह मानें कि केवल वे ही उपयोगकर्ता‑किसी जानकारी को खोजेंगे ऐसा नहीं होगा।

6. "पेपर से उत्पाद" पथ को संस्थागत बनाएं

आप किसी एक दूरदर्शी कार्यकारी या नायाब टीम पर निर्भर नहीं रह सकते।

- एक मानकीकृत पाइपलाइन बनाएं: विचार → आंतरिक डेमो → सीमित बाहरी पायलट → सामान्य लॉन्च।

- एक समर्पित समूह बनाएं जिसका केवल काम शीर्ष शोध आउटपुट्स को उत्पादों या APIs में बदलना हो।

- वरिष्ठ शोधकर्ताओं को उत्पाद नेतृत्व भूमिकाओं में रोटेट करें ताकि जो क्षमता समझता है वही उसका अनुप्रयोग भी संचालित करे।

7. अपनी ही तकनीक द्वारा चौंकने के लिए प्रतिबद्ध रहें

Google की सबसे बड़ी चूक केवल AI की भविष्यवाणी न करना नहीं था; यह यह कम आकलन था कि उसकी खुद की खोजें उपभोक्ताओं के हाथों में क्या बन सकती हैं।

व्यावहारिक मनोवृत्ति:

- मानें कि आपका ब्रेकथ्रू अंदर से दिखने से ज़्यादा सतह‑क्षेत्र रखता है।

- इसे उपयोगकर्ताओं के सामने जल्दी रखें ताकि वे आपको आश्चर्यजनक, गंदे, उच्च‑मूल्य उपयोग दिखा सकें।

- जब वे ऐसी उपयोगिताएँ आपके मूल रोडमैप से टकराएँ, तो अपने रोडमैप को बदलने के लिए तैयार रहें।

भविष्य के ब्रेकथ्रू—चाहे मॉडल हों, इंटरफेस हों, या पूरी तरह नए कंप्यूटिंग प्रिमिटिव—उन टीमों द्वारा व्यावसायिक होंगे जो "हमने यह खोजा" से "हम इसके शिपिंग के लिए ज़िम्मेदार हैं" में तुरंत संक्रमण करवा सकें।

Google से सबक यह नहीं है कि शोध कम करें या छिपाएँ। बल्कि यह है कि विश्व‑स्तरीय खोज को समान रूप से महत्वाकांक्षी उत्पाद स्वामित्व, स्पष्ट प्रोत्साहनों, और सार्वजनिक सीखने के झुकाव के साथ जोड़ा जाए। जो संगठन यह करेंगे वे अगली लहर के मालिक बनेंगे, सिर्फ़ पेपर लिखने वाले नहीं।