30 अक्टू॰ 2025·8 मिनट

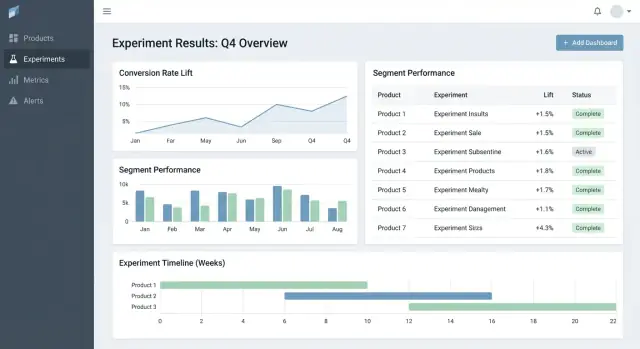

उत्पाद के अनुसार प्रयोग परिणाम ट्रैक करने वाला वेब ऐप कैसे बनाएं

डेटा मॉडल, मेट्रिक्स, अनुमतियाँ, इंटीग्रेशन, डैशबोर्ड और विश्वसनीय रिपोर्टिंग सहित उत्पादों में प्रयोगों को ट्रैक करने वाला वेब ऐप कैसे बनाएं।

यह वेब ऐप क्या सुलझाना चाहिए

अधिकांश टीम्स विचारों की कमी के कारण प्रयोग में फेल नहीं होतीं—वे इसलिए फेल होती हैं क्योंकि परिणाम बिखरे हुए होते हैं। एक उत्पाद में चार्ट एनालिटिक्स टूल में होते हैं, दूसरे में स्प्रेडशीट, तीसरे में स्लाइड डेक में स्क्रीनशॉट। कुछ महीनों बाद कोई साधारण प्रश्नों का उत्तर नहीं दे पाता जैसे “क्या हमने यह पहले टेस्ट किया था?” या “किस वर्शन ने जीता, किस मेट्रिक परिभाषा के साथ?”

मूल समस्या: बिखरे हुए परिणाम और असंगत सच्चाई

एक प्रयोग ट्रैकिंग वेब ऐप को क्या टेस्ट हुआ, क्यों, कैसे मापा गया और क्या हुआ—इन सबको केंद्रीकृत करना चाहिए—विभिन्न उत्पादों और टीमों में। इसके बिना टीमें रिपोर्ट फिर से बनाती हैं, नंबरों पर बहस होती है, और पुराने टेस्ट दोहराए जाते हैं क्योंकि सीखने searchable नहीं होते।

किसके लिए है (और हर समूह को क्या चाहिए)

यह सिर्फ एक एनालिस्ट टूल नहीं है।

- प्रोडक्ट मैनेजर को outcomes, confidence, और decision status तेजी से देखने की ज़रूरत होती है।

- एनालिस्ट को assumptions, मेट्रिक परिभाषाएँ, और caveats दस्तावेज़ करने के लिए भरोसेमंद स्थान चाहिए।

- इंजीनियर्स को स्पष्टता चाहिए कि कौन से फीचर फ्लैग, वेरिएंट, और rollout शर्तें स्कोप में थीं।

- लीडरशिप को अलग-अलग कस्टम डैक्स के बिना उत्पादों में प्रभाव का सुसंगत दृश्य चाहिए।

अनुकूलित परिणाम जो आप ऑप्टिमाइज़ करें

एक अच्छा ट्रैकर व्यवसायिक मूल्य इस तरह उत्पन्न करता है:

- तेज़ निर्णय (लिंक्स और अनुमोदनों का पीछा करने पर कम समय)\n- कम रिपोर्टिंग त्रुटियाँ ("अंतिम नंबर" के लिए एक स्रोत)\n- साझा सीख (विजय, हार और न्यूट्रल टेस्ट का सर्चेबल इतिहास)

स्पष्ट स्कोप सीमाएँ

स्पष्ट बताएं: यह ऐप प्राथमिक रूप से परिणाम ट्रैकिंग और रिपोर्टिंग के लिए है—पूरा end-to-end प्रयोग चलाने के लिए नहीं। यह मौजूदा टूल्स (feature flagging, analytics, data warehouse) के आउट-लिंक्स कर सकता है जबकि प्रयोग और उसके अंतिम, सहमत व्याख्या के संरचित रिकॉर्ड का मालिक होगा।

आवश्यकताएँ: न्यूनतम व्यवहार्य प्रयोग ट्रैकर

एक MVP ट्रैकर को बिना दस्तावेज़ या स्प्रेडशीट के खोज किए दो प्रश्नों का उत्तर देना चाहिए: हम क्या टेस्ट कर रहे हैं और हमने क्या सीखा। ऐसे कुछ एंटिटीज़ और फ़ील्ड्स के साथ शुरुआत करें जो सभी उत्पादों में काम करें, और केवल तब ही विस्तार करें जब टीम्स को वास्तविक पीड़ा महसूस हो।

समर्थन करने के लिए मूल एंटिटीज़

डेटा मॉडल इतना सरल रखें कि हर टीम इसे समान तरीके से इस्तेमाल करे:

- Product: वह सर्फेस एरिया (app/site/API) जहाँ बदलाव शिप हुआ।

- Experiment: एक हाइपोथेसिस और एक निर्णय।

- Variant: कंट्रोल और एक या अधिक ट्रीटमेंट।

- Metric: नामित माप जो मालिक और परिभाषा के साथ हो।

- Segment: वैकल्पिक ऑडियंस स्लाइस (नए उपयोगकर्ता, भुगतान करने वाले उपयोगकर्ता, क्षेत्र) रिपोर्टिंग के लिए।

प्रयोग प्रकार (छोटे से शुरू करें, लचीले रहें)

शुरुआत से सबसे सामान्य पैटर्न्स का समर्थन करें:

- A/B परीक्षण (कंट्रोल बनाम ट्रीटमेंट)

- मल्टीवेरिएट परीक्षण (कई वेरिएंट)

- फीचर फ्लैग रोलआउट (प्रतिशत-आधारित एक्सपोज़र)

भले ही रोलआउट प्रारंभ में औपचारिक सांख्यिकी का उपयोग न करें, उन्हें एक्सपेरिमेंट्स के साथ ट्रैक करना टीम्स को बिना रिकॉर्ड के उसी “टेस्ट” को दोहराने से बचने में मदद करता है।

हर प्रयोग के लिए न्यूनतम फ़ील्ड्स

निर्माण के समय केवल वही मांगे जो बाद में टेस्ट चलाने और व्याख्या करने के लिए जरूरी हों:

- Hypothesis (क्या बदला, किसके लिए, और क्यों)

- Owner (एक जिम्मेदार व्यक्ति)

- Start/end dates (योजना और वास्तविक)

- Targeting (योग्यता नियम) और allocation (ट्रैफिक स्प्लिट)

- Links rollout/flag, ticket, या spec के लिए (रिलेटिव URLs जैसे /projects/123)

सफलता के मानदंड और निर्णय स्थिति

संरचना लागू कर के परिणामों की तुलना योग्य बनाएं:

- Primary metric (मुख्य सफलता माप)

- Guardrails (ऐसी मेट्रिक्स जो बिगड़नी नहीं चाहिए)

- Decision status: proposed → running → analyzed → shipped/rolled back → archived

यदि आप केवल यह बनाते हैं, तो टीमें बिना उन्नत एनालिटिक्स या ऑटोमेशन के भी प्रयोग ढूँढ सकती हैं, सेटअप समझ सकती हैं, और परिणाम रिकॉर्ड कर सकती हैं।

कई उत्पादों में काम करने वाला डेटा मॉडल

क्रॉस‑प्रोडक्ट प्रयोग ट्रैकर अपनी डेटा मॉडल पर टिका होता है। यदि IDs टकराती हैं, मेट्रिक्स ड्रिफ्ट होते हैं, या सेगमेंट असंगत होते हैं, तो आपका डैशबोर्ड “सही” दिख सकता है जबकि गलत कहानी बता रहा हो।

स्थिर पहचानकर्ता चुनें (और उन पर टिके रहें)

एक स्पष्ट आइडेंटिफायर रणनीति से शुरुआत करें:

- product_id: नाम बदलने पर भी स्थिर रहे (डिस्प्ले नाम को की के रूप में न उपयोग करें)

- experiment_key: मानव-मैत्रीपूर्ण स्लग (उदा.

checkout_free_shipping_banner) और एक अपरिवर्तनीय experiment_id - variant_key: स्थिर लेबल जैसे

control,treatment_a

यह आपको उत्पादों के पार परिणामों की तुलना करने देता है बिना यह अनुमान लगाए कि “Web Checkout” और “Checkout Web” एक ही हैं या नहीं।

मुख्य कलेक्शंस/टेबल्स

कोर एंटिटीज़ को छोटा और स्पष्ट रखें:

- experiments: product_id, hypothesis, primary_metric_def_id, start/end, status

- variants: experiment_id, variant_key, traffic_split

- assignments: experiment_id, user_id (या anonymous_id), variant_key, assigned_at

- metric_defs: metric name, numerator/denominator logic, unit (user/session/order), owner

- results: experiment_id, metric_def_id, time_window_id, segment_id, computed_at, effect, uncertainty

भले ही गणना कहीं और होती हो, outputs (results) स्टोर करने से तेज़ डैशबोर्ड और भरोसेमंद इतिहास मिलता है।

टाइम विंडो और वर्शनिंग

मेट्रिक्स और प्रयोग स्थिर नहीं होते। मॉडल करें:

- time windows (उदा. “पहले 7 दिन असाइनमेंट के बाद”, “कैलेंडर सप्ताह”)\n- वर्शन किए गए मेट्रिक परिभाषाएँ: जब मेट्रिक की गणना बदलती है, तो पुराना वर्शन संपादित करने की बजाय नया वर्शन बनाएँ

यह पिछले महीने के प्रयोगों को किसी ने KPI लॉजिक अपडेट करने पर बदलने से रोकता है।

सेगमेंट और ऑडिट ट्रेल

उत्पादों में सुसंगत सेगमेंट के लिए योजना बनाएं: देश, डिवाइस, प्लान टियर, नया बनाम लौटता हुआ।

अंत में, एक ऑडिट ट्रेल जोड़ें जो किसने क्या और कब बदला इसे कैप्चर करे (status बदलाव, ट्रैफिक स्प्लिट, मेट्रिक परिभाषा अपडेट)। यह भरोसेमंदता, रिव्यू और गवर्नेंस के लिए अनिवार्य है।

मेट्रिक परिभाषाएँ और सुसंगत गणनाएँ

यदि आपका ट्रैकर मेट्रिक गणित गलत करता है (या उत्पादों में असंगत है), तो “परिणाम” सिर्फ एक राय भर होगा। इसे रोकने का सबसे तेज़ तरीका मेट्रिक्स को साझा उत्पाद संपत्ति मानना है—न कि एड‑हॉक क्वेरी स्निपेट्स।

एक कैनोनिकल मेट्रिक कैटलॉग बनाएं

एक मेट्रिक कैटलॉग बनाएं जो परिभाषाएँ, गणना लॉजिक और उत्तरदायित्व का सिंगल सोर्स ऑफ़ ट्रुथ हो। हर मेट्रिक एंट्री में शामिल होने चाहिए:

- सरल-भाषा परिभाषा (यह किस निर्णय का समर्थन करता है)

- एक मालिक (परिवर्तन के लिए जिम्मेदार व्यक्ति/टीम)

- सटीक फ़ॉर्मूला और आवश्यक इवेंट/फील्ड

- शामिल/अवर्जित नियम (उदा. आंतरिक उपयोगकर्ता, बॉट्स, रिफंड्स)

- वैध एग्रीगेशन लेवल और समर्थित उत्पाद

कैटलॉग को जगह पर रखें जहाँ लोग काम करते हैं (उदा. प्रयोग निर्माण फ़्लो से लिंक), और इसे वर्शन करें ताकि आप ऐतिहासिक परिणाम समझा सकें।

एग्रीगेशन लेवल स्टैंडर्डाइज़ करें

पहले से तय कर लें कि हर मेट्रिक किस "unit of analysis" का उपयोग करेगी: per user, per session, per account, या per order। एक कनवर्ज़न रेट "per user" और "per session" में असहमति हो सकती है भले ही दोनों सही हों।

कन्फ्यूजन कम करने के लिए, मेट्रिक परिभाषा के साथ एग्रीगेशन विकल्प स्टोर करें, और प्रयोग सेटअप में इसे आवश्यक बनाएं। हर टीम को एड‑हॉक यूनिट चुनने को न दें।

देरी वाले कन्वर्ज़न्स और एट्रिब्यूशन संभालना

कई उत्पादों में कन्वर्ज़न विंडो होती है (उदा. आज साइनअप, 14 दिनों में खरीद)। एट्रिब्यूशन नियम लगातार परिभाषित करें:

- घड़ी कब शुरू होती है (exposure time, first visit, assignment time)?

- यदि उपयोगकर्ता को कई बार एक्सपोज़ किया गया तो क्या काउंट होगा?

- क्रॉस‑डिवाइस या क्रॉस‑प्रॉडक्ट यात्रा को कैसे हैंडल करेंगे?

इन नियमों को डैशबोर्ड में स्पष्ट दिखाएँ ताकि रीडर्स जानें वे क्या देख रहे हैं।

रॉ काउंट्स और कम्प्यूटेड स्टैट्स दोनों स्टोर करें

तेज़ डैशबोर्ड और ऑडिटेबिलिटी के लिए दोनों स्टोर करें:

- रॉ काउंट्स (exposures, converters, revenue sums, variance inputs)

- कम्प्यूटेड स्टैट्स (lift, confidence intervals, p-values)

यह तेज़ रेंडरिंग सक्षम करता है और साथ ही परिभाषा बदलने पर पुनःगणना की अनुमति देता है।

नामकरण सम्मेलन मेट्रिक स्प्रॉल रोकते हैं

ऐसा नामकरण मानक अपनाएँ जो अर्थ एन्कोड करे (उदा. activation_rate_user_7d, revenue_per_account_30d)। यूनिक IDs आवश्यक बनाएं, एलियास लागू करें, और मेट्रिक निर्माण के दौरान नज़दीकी‑डुप्लिकेट्स को फ़्लैग करें ताकि कैटलॉग साफ़ रहे।

डेटा इकट्ठा करना: इवेंट्स, पाइपलाइन्स, और क्वालिटी चेक्स

आपका एक्सपेरिमेंट ट्रैकर उतना ही विश्वसनीय है जितना वह डेटा जो वह لیتا है। लक्ष्य हर उत्पाद के लिए विश्वसनीय रूप से दो प्रश्नों का उत्तर देना है: किसे किस वेरिएंट का एक्सपोज़र मिला, और उसने बाद में क्या किया? बाकी सब—मेट्रिक्स, स्टैटिस्टिक्स, डैशबोर्ड—उस नींव पर निर्भर करते हैं।

एक इनजेशन अप्रोच चुनें

अधिकांश टीमें इन पैटर्न्स में से एक चुनती हैं:

- Event stream (near real-time): तेज़ रीड और तेज़ डिबगिंग के लिए अच्छा। इसे स्थिर रखने के लिए अधिक इंजीनियरिंग परिपक्वता चाहिए।

- Daily batch: ऑपरेट करने में सरल और सस्ता। जब निर्णय घंटे‑घंटे में नहीं होने हों तो सबसे अच्छा।

- Hybrid: एक्सपोज़र्स और महत्वपूर्ण इवेंट्स को स्ट्रीम करें (ताकि असाइनमेंट जल्दी वैरिफाई हो सके), बाकी बैच करें पूर्णता और लागत‑नियंत्रण के लिए।

जो भी चुनें, हर उत्पाद में न्यूनतम इवेंट सेट मानकीकृत करें: exposure/assignment, प्रमुख conversion events, और उन्हें जोड़ने के लिए पर्याप्त संदर्भ (user ID/device ID, timestamp, experiment ID, variant)।

मेट्रिक्स के लिए प्रोडक्ट इवेंट्स को मैप करें (और पूर्णता सत्यापित करें)

रॉ इवेंट्स से उन मेट्रिक्स तक स्पष्ट मैपिंग परिभाषित करें जो ट्रैकर रिपोर्ट करेगा (उदा. purchase_completed → Revenue, signup_completed → Activation)। यह मैपिंग प्रत्येक उत्पाद के लिए बनाए रखें, लेकिन नामकरण को उत्पादों के पार सुसंगत रखें ताकि आपका A/B टेस्ट परिणाम डैशबोर्ड "like with like" तुलना कर सके।

पूर्णता की जल्दी सत्यापित करें:

- सुनिश्चित करें हर एक्सपोज़र में experiment ID और variant हों।

- कन्वर्ज़न इवेंट्स में वही पहचान फील्ड्स शामिल हों जो एक्सपोज़र जॉइन्स के लिए उपयोग होते हैं।

- क्लाइंट, सर्वर और वेयरहाउस के बीच इवेंट ड्रॉप‑ऑफ के लिए देखें (मोबाइल SDKs सामान्य अपराधी होते हैं)।

आप जो ऑटोमेट करना चाहिए वो डेटा क्वालिटी चेक्स

हर लोड पर चलने वाले चेक बनाएं और जब वे फेल हों तेज़ी से अलर्ट करें:

- Missing exposure events: कन्वर्ज़न्स जिनके पास पूर्व एक्सपोज़र नहीं (आमतौर पर इंस्ट्रूमेंटेशन गैप या पहचान असंगति)

- Skewed allocations: वेरिएंट्स को 70/30 मिलना जबकि आप 50/50 अपेक्षा कर रहे थे (लक्ष्यीकरण बग का संकेत)

- Timestamp sanity: एक्सपोज़र कन्वर्ज़न के बाद, या घड़ी में बड़ी देरी जो क्लॉक इश्यू सुझाती है

इन्हें प्रयोग से जुड़ी चेतावनियों के रूप में ऐप में दिखाएँ, न कि लॉग्स में छिपा हुआ।

बैकफिल्स और रीप्रोसेसिंग

पाइपलाइन्स बदलते हैं। जब आप इंस्ट्रूमेंटेशन बग या डेडुप लॉजिक ठीक करते हैं, तब आपको ऐतिहासिक डेटा रीप्रोसेस करने की ज़रूरत पड़ेगी ताकि मेट्रिक्स और KPIs सुसंगत रहें।

योजना बनाएं:

- वर्शन किए गए ट्रांसफॉर्मेशन (ताकि आप जान सकें किस लॉजिक ने कौन सा परिणाम उत्पन्न किया)

- सुरक्षित बैकफिल्स (तिथी/उत्पाद/प्रयोग द्वारा स्कोप सीमित करें)

- पुनःगणना का एक ऑडिट ट्रेल

इंटीग्रेशन्स का दस्तावेज़ीकरण

इंटीग्रेशन्स को एक उत्पाद फीचर की तरह मानें: समर्थित SDKs, इवेंट स्कीमा, और ट्रबलशूटिंग स्टेप्स दस्तावेज़ करें। यदि आपके पास डॉक्स एरिया है तो इसे रिलेटिव पाथ के रूप में लिंक करें जैसे /docs/integrations।

भरोसेमंद स्टैटिस्टिक्स और परिणाम गणना

इसे अपने डोमेन पर रखें

कस्टम डोमेन प्रयोग करें ताकि ट्रैकर एक असली आंतरिक उत्पाद जैसा लगे.

यदि लोग नंबरों पर भरोसा नहीं करते तो वे ट्रैकर का उपयोग नहीं करेंगे। लक्ष्य जटिल गणित से प्रभावित करना नहीं है—बल्कि निर्णयों को दोहराने योग्य और उत्पादों में औपचारिक बनाने का है।

एक सांख्यिकीय “डायलैक्ट” चुनें और उस पर टिके रहें

पहले तय करें कि आपकी ऐप frequentist परिणाम (p-values, confidence intervals) रिपोर्ट करेगी या Bayesian परिणाम (सुधार की संभावना, credible intervals)। दोनों काम कर सकते हैं, लेकिन उत्पादों के पार मिश्रण कन्फ्यूज़न पैदा करता है ("एक टेस्ट 97% जीतने की संभावना दिखाता है, जबकि दूसरा p=0.08 दिखाता है—क्यों?").

एक व्यावहारिक नियम: वह अप्रोच चुनें जिसे आपका संगठन पहले से समझता है, फिर शब्दावली, डिफ़ॉल्ट और थ्रेशहोल्ड्स स्टैंडर्डाइज़ करें।

UI में ठीक‑ठीक क्या दिखेगा यह स्पष्ट करें

कम से कम, आपके परिणाम दृश्य में ये आइटम अस्पष्ट न रहें:

- Lift (कंट्रोल के मुकाबले absolute और/या relative)

- Interval (confidence interval या credible interval) जो रेंज के रूप में दिखे, सिर्फ पॉइंट अनुमान नहीं

- Strength of evidence (frequentist के लिए p-value, या Bayesian के लिए कंट्रोल से बेहतर होने की संभावना)

साथ में दिखाएँ analysis window, गिने गए यूनिट्स (users, sessions, orders), और मेट्रिक परिभाषा वर्शन जिसका उपयोग हुआ। ये “डिटेल्स” सुसंगत रिपोर्टिंग और बहस के बीच फर्क करते हैं।

मल्टीपल कम्पेरिसंस और “पीकिंग” नीतियाँ

यदि टीमें कई वेरिएंट, कई मेट्रिक्स, या रोज़ाना परिणाम चेक करती हैं, तो झूठे पॉज़िटिव्स संभाव्य हो जाते हैं। आपकी ऐप को एक नीति एनकोड करनी चाहिए बजाय इसे हर टीम पर छोड़ने के:

- Multiple comparisons: तय करें कि आप एडजस्ट करेंगे (उदा. false discovery rate कंट्रोल) या परिणामों को स्पष्ट रूप से "unadjusted exploratory" लेबल करेंगे।

- Repeated peeking: या तो (1) इसे डिज़एबल करें निश्चित समाप्ति तिथि और "finalized" स्थिति के साथ, या (2) सेक्वेंशियल मेथड्स सपोर्ट करें और "safe-to-stop" मार्गदर्शन दिखाएँ।

सामान्य फेल्योर मोड पकड़ने वाले गार्डरैइल्स

ऐसे ऑटोमेटेड फ्लैग जोड़ें जो परिणाम के पास दिखें, लॉग्स में छिपे न हों:

- Sample Ratio Mismatch (SRM): जब ट्रैफिक स्प्लिट अपेक्षित आवंटन से हटे तो चेतावनी दें।

- Anomaly detection: ट्रैफिक, कन्वर्ज़न, या रेवेन्यू में अचानक ड्रॉप/स्पाइक फ़्लैग करें जो ट्रैकिंग ब्रेक, आउटेज, या बॉट ट्रैफ़िक संकेत कर सकते हैं।

साधारण‑भाषा में व्याख्याएं

नंबर्स के पास एक छोटा व्याख्यान जोड़ें जो गैर‑तकनीकी पाठक पर भरोसा कर सके, जैसे: “सर्वोत्तम अनुमान +2.1% लिफ्ट है, पर असली प्रभाव संभवतः -0.4% से +4.6% के बीच हो सकता है। हमारे पास अभी निर्णायक साक्ष्य नहीं हैं कि विजेता हो।”

UX और डैशबोर्ड—तेज़ निर्णय के लिए

अच्छा एक्सपेरिमेंट टूलिंग लोगों को दो प्रश्नों के उत्तर जल्दी देने में मदद करता है: अगले क्या देखना चाहिए? और इसके बारे में हमें क्या करना चाहिए? UI को संदर्भ के लिए खोजना कम से कम करना चाहिए और “निर्णय स्थिति” स्पष्ट बनानी चाहिए।

वर्कफ़्लो को एंकर करने के लिए प्रमुख पृष्ठ

शुरुआत तीन पृष्ठों से करें जो अधिकतर उपयोग को कवर करते हैं:

- Experiments list: पूरे संगठन (या प्रति‑उत्पाद) के लिए एक सॉर्टेबल कतार।

- Experiment detail: सेटअप, परिणाम, और निर्णय का एकल स्रोत-ऑफ‑ट्रुथ।

- Product overview: एक उत्पाद के लिए सक्रिय टेस्ट, हालिया निर्णय, और मेट्रिक हेल्थ का रोल‑अप।

लिस्ट और उत्पाद पृष्ठों पर फिल्टर्स तेज़ और स्टिकी रखें: product, owner, date range, status, primary metric, और segment। लोग कुछ ही सेकंड में "Checkout experiments, owned by Maya, running this month, primary metric = conversion, segment = new users" जैसी खोज कर सकें।

भरोसेमंद निर्णय स्थितियाँ

स्टेटस को नियंत्रित शब्दावली की तरह ट्रीट करें, फ्री‑टेक्स्ट नहीं:

Draft → Running → Stopped → Shipped / Rolled back

स्टेटस को हर जगह दिखाएँ (लिस्ट रोज़, डिटेल हेडर, और शेयर लिंक) और रिकॉर्ड करें किसने क्यों बदला। यह "चुप्पी में लॉन्च" और अस्पष्ट परिणामों को रोकता है।

एक परिणाम तालिका जो निर्णय स्पष्ट करे

एक्सपेरिमेंट डिटेल व्यू में, मेट्रिक प्रति तालिका के साथ लीड करें:

- Baseline

- Variant

- Lift

- अनिश्चितता (confidence interval या credible interval)

- Notes (उदा. इंस्ट्रूमेंटेशन कैवेट्स, सेगमेंट अजीबताएँ)

उन्नत चार्ट्स को "More details" सेक्शन में रखें ताकि निर्णय‑निर्धारक ओवरव्हेल्म न हों।

शेयरिंग और एक्सपोर्ट बिना कंट्रोल खोए

एनालिस्ट्स के लिए CSV export और स्टेकहोल्डर्स के लिए shareable links जोड़ें, पर एक्सेस लागू करें: लिंक रोल्स और प्रोडक्ट परमिशन का सम्मान करें। एक साधारण “Copy link” बटन और “Export CSV” एक्शन अधिकांश सहयोग ज़रूरतों को कवर करता है।

अनुमतियाँ, गोपनीयता, और गवर्नेंस

चैट में ट्रैकर का प्रोटोटाइप बनाएं

अपने एक्सपेरिमेंट ट्रैकर का वर्णन करें—Koder.ai React ऐप और Go बैकएंड बना देगा.

यदि आपका ट्रैकर कई उत्पादों में फैला है, तो एक्सेस कंट्रोल और ऑडिटेबिलिटी वैकल्पिक नहीं हैं। यही टूल को अपनाने में सुरक्षित और रिव्यू के दौरान भरोसेमंद बनाता है।

भूमिका-आधारित पहुँच नियंत्रण (RBAC)

सरल रोल्स से शुरुआत करें और उन्हें पूरे ऐप में सुसंगत रखें:

- Viewer: प्रयोग, परिणाम, और डैशबोर्ड का केवल-पढ़ने का पहुंच।

- Editor: प्रयोग बनाएँ/संपादित करें, सपोर्टिंग डॉक अपलोड करें, स्टेटस सेट करें (draft → running → concluded)।

- Admin: यूज़र्स, परमिशन्स, मेट्रिक परिभाषाएँ, रिटेंशन नियम, और इंटीग्रेशन्स प्रबंधित करें।

RBAC निर्णयों को केंद्रीकृत रखें (एक पॉलिसी लेयर), ताकि UI और API दोनों एक ही नियम लागू करें।

प्रोडक्ट-स्तर और रो-स्तर अनुमतियाँ

कई ऑर्ग्स को प्रोडक्ट‑स्कोप्ड एक्सेस चाहिए: टीम A केवल उत्पाद A के प्रयोग देख पाए पर उत्पाद B नहीं। इसे स्पष्ट रूप से मॉडल करें (उदा. user ↔ product memberships), और हर क्वेरी को product द्वारा फ़िल्टर करें।

संवेदनशील मामलों के लिए (उदा. पार्टनर डेटा, विनियमित सेगमेंट) ऊपर रो-स्तर प्रतिबंध जोड़ें। व्यावहारिक दृष्टिकोण: प्रयोगों (या परिणाम स्लाइस) को संवेदनशीलता स्तर से टैग करें और देखने के लिए अतिरिक्त अनुमति आवश्यक करें।

ऑडिट ट्रेल: एक्सेस + बदलाव इतिहास

दो चीज़ें अलग-अलग लॉग करें:

- Change logs: किसने प्रयोग, मेट्रिक परिभाषा, या निर्णय संपादित किया—क्या बदला और कब।

- Access logs: किसने परिणाम देखे या एक्सपोर्ट किए (खासकर संवेदनशील प्रयोगों के लिए)।

चेंज हिस्ट्री को UI में पारदर्शिता के लिए एक्सपोज़ करें, और जाँच के लिए गहरी लॉग्स रखें।

रेटेंशन और डिलीशन नियम

इनके लिए रिटेंशन नियम परिभाषित करें:

- Experiment metadata (हाइपोथेसिस, मालिक, तिथियाँ, निर्णय नोट्स)

- Computed results (इफेक्ट साइज, confidence intervals, significance flags)

रिटेंशन उत्पाद और संवेदनशीलता के अनुसार कॉन्फ़िगर करने योग्य रखें। जब डेटा हटाना आवश्यक हो, तो एक न्यूनतम टॉम्बस्टोन रिकॉर्ड रखें (ID, deletion time, कारण) ताकि रिपोर्टिंग इंटीग्रिटी बनी रहे बिना संवेदनशील सामग्री रखे।

वर्कफ़्लो फ़ीचर्स: आइडिया से सीखने की लाइब्रेरी तक

एक ट्रैकर तब वास्तव में उपयोगी बनता है जब वह पूरे प्रयोग लाइफ़साइकल को कवर करता है, सिर्फ अंतिम p-value नहीं। वर्कफ़्लो फ़ीचर्स बिखरे हुए डॉक, टिकट और चार्ट्स को एक दोहराने योग्य प्रक्रिया में बदल देते हैं जो गुणवत्ता बढ़ाती है और सीखने को आसान बनाती है।

लाइफ़साइकल वर्कफ़्लो: विचार → समीक्षा → चलाना → पोस्ट‑मॉर्टम

प्रयोगों को स्टेट्स की श्रेणी के रूप में मॉडल करें (Draft, In Review, Approved, Running, Ended, Readout Published, Archived)। हर स्टेट का स्पष्ट "exit criteria" होना चाहिए ताकि आवश्यक चीज़ें जैसे hypothesis, primary metric, और guardrails बिना हों प्रायोगिक रूप से लाइव न जाएँ।

अनुमोदन भारी होने की ज़रूरत नहीं है। एक सरल रिव्युअर स्टेप (उदा. प्रोडक्ट + डेटा) और किसने क्या अनुमोदित किया उसका ऑडिट ट्रेल अप्रिय गलतियों को रोक सकता है। पूरा होने के बाद, एक छोटा पोस्ट‑mortem आवश्यक करें ताकि परिणाम और संदर्भ कैप्चर हो सकें फिर प्रयोग "Published" चिह्नित किया जाए।

टेम्प्लेट्स जो सोच को स्टैंडर्डाइज़ करें

टेम्प्लेट्स जोड़ें:

- Experiment brief (goal, hypothesis, target audience, success metrics, guardrails, rollout plan)

- Analysis notes (data sources, exclusions, sanity checks, interpretation, risks)

टेम्प्लेट्स "खाली पन्ना" बाधा घटाते हैं और समीक्षा तेज करते हैं क्योंकि हर कोई जानता है कहाँ देखना है। इन्हें प्रति उत्पाद संपादनीय रखें पर एक सामान्य कोर संरक्षित रखें।

सीखें: सब कुछ लिंक करें, searchable रखें

प्रयोग अकेले कम ही रहते हैं—लोगों को आस-पास का संदर्भ चाहिए। उपयोगकर्ताओं को टिकट/स्पेक्स और संबंधित राइट‑अप्स जोड़ने दें (उदा. /blog/how-we-define-guardrails, /blog/experiment-analysis-checklist)। संरचित “Learning” फ़ील्ड्स स्टोर करें जैसे:

- क्या बदला (निर्णय)

- हमने क्या सीखा (INSIGHT)

- अगला कदम (फॉलो‑अप)

गार्डरैइल्स और बदलते परिणामों के लिए अलर्ट

गरार्डरैइल्स के regress होने पर (उदा. error rate, cancellations) या लेट डेटा या मेट्रिक पुनःगणना के बाद जब परिणाम सामरिक रूप से बदलें तो नोटिफ़िकेशन्स सपोर्ट करें। अलर्ट को actionable बनाएं: मेट्रिक, थ्रेशहोल्ड, टाइमफ़्रेम, और एक ओनर दिखाएँ जिसे acknowledge या escalate करना है।

अतीत के काम को दोबारा उपयोग करने के लिए लाइब्रेरी व्यू

एक लाइब्रेरी प्रदान करें जो उत्पाद, फीचर एरिया, ऑडियंस, मेट्रिक, परिणाम और टैग्स (उदा. “pricing,” “onboarding,” “mobile”) से फिल्टर करे। "Similar experiments" सुझाव जोड़ें साझा टैग/मेट्रिक्स के आधार पर ताकि टीमें वही टेस्ट दोबारा न चलाएँ और बजाय इसके पिछले सीखों पर निर्माण करें।

आर्किटेक्चर और टेक स्टैक विकल्प

एक परफेक्ट स्टैक की ज़रूरत नहीं होती—पर स्पष्ट सीमाएँ चाहिए: डेटा कहाँ रहता है, गणनाएँ कहाँ होती हैं, और टीमें परिणामों तक कैसे पहुँचती हैं।

एक व्यावहारिक बेसलाइन स्टैक

कई टीम्स के लिए एक सरल और स्केलेबल सेटअप ऐसा दिखता है:

- Frontend: React (या Vue) डैशबोर्ड और वर्कफ़्लो के लिए

- Backend API: Node.js/Express, Python/FastAPI, या Java/Spring—वह चुनें जिसे आपकी टीम मेंटेन कर सके

- Database: Postgres ऐप डेटा (experiments, metric definitions, permissions) के लिए

- Analytics warehouse: BigQuery/Snowflake/Redshift इवेंट डेटा और भारी एग्रीगेशन्स के लिए

यह विभाजन transactional वर्कफ़्लोज़ को तेज़ रखता है जबकि वेयरहाउस बड़े‑पैमाने पर गणना संभालता है।

यदि आप UI प्रोटोटाइप जल्दी उठाना चाहते हैं (experiments list → detail → readout) बिना पूरे इंजीनियरिंग चक्र के, तो एक vibe-coding प्लेटफ़ॉर्म जैसे Koder.ai आपको चैट स्पेक से React + बैकएंड फ़ाउंडेशन जनरेट करने में मदद कर सकता है। यह विशेष रूप से एंटिटीज़, फार्म्स, RBAC स्कैफ़ोल्डिंग, और ऑडिट‑फ्रेंडली CRUD लगाने में उपयोगी है, फिर आप अपने एनालिटिक्स टीम के साथ डेटा कॉन्ट्रैक्ट्स पर इटरेट कर सकते हैं।

मेट्रिक गणनाएँ कहाँ रहें?

आमतौर पर आपके पास तीन विकल्प होते हैं:

- Warehouse-first: SQL मॉडल मेट्रिक्स और प्रयोग परिणाम तालिकाएँ कम्प्यूट करते हैं। ऐप ज्यादातर पढ़ता है।

- Backend jobs: एक वर्कर शेड्यूल पर या जब प्रयोग बदलता है परिणाम कम्प्यूट करता है।

- Hybrid: वेयरहाउस में कैनोनिकल एग्रीगेशन्स, और बैकएंड पोस्ट‑प्रोसेसिंग (फॉर्मैटिंग, गार्डरैइल्स, कैशिंग)।

यदि आपका डेटा टीम पहले से भरोसेमंद SQL रखती है तो warehouse-first अक्सर सरल होता है। बैकएंड‑भारी तब काम कर सकता है जब आपको लो‑लेटेंसी अपडेट्स या कस्टम लॉजिक चाहिए, पर इससे ऐप जटिलता बढ़ती है।

प्रदर्शन: कैश और प्रीकम्प्यूट

एक्सपेरिमेंट डैशबोर्ड अक्सर वही क्वेरी बार‑बार दोहराते हैं (टॉप‑लाइन KPI, टाइम सीरीज़, सेगमेंट कट)। योजना बनाएं:

- Precompute rollups (दैनिक मेट्रिक एग्रीगेट्स प्रति प्रयोग/वेरिएंट/सेगमेंट)

- API लेयर पर महंगे रीड्स कैश करें (उदा. Redis) स्पष्ट इनवैलिडेशन रूल्स के साथ

- सामान्य डैशबोर्ड के लिए materialized views या शेड्यूल्ड टेबल्स वेयरहाउस में उपयोग करें

मल्टी‑टेनेंट बनाम सिंगल‑टेनेंट

यदि आप कई उत्पादों या बिज़नेस यूनिट्स सपोर्ट करते हैं, तो जल्दी निर्णय लें:

- Single-tenant (shared schema): ऑपरेट करना आसान, पर कड़ाई से परमिशन फ़िल्टरिंग की ज़रूरत

- Multi-tenant: मजबूत आइसोलेशन पर अलग-अलग स्कीमाज/प्रोजेक्ट्स, पर अधिक ओवरहेड

एक सामान्य समझौता साझा इंफ्रास्ट्रक्चर के साथ मजबूत tenant_id मॉडल और प्रवृत्त रो‑स्तर एक्सेस लागू करना है।

कोर APIs परिभाषित करें

API सतह को छोटा और स्पष्ट रखें। अधिकांश सिस्टम्स को endpoints चाहिए: experiments, metrics, results, segments, और permissions (साथ में ऑडिट‑फ्रेंडली रीड्स)। इससे नए उत्पाद जोड़ना आसान होता है बिना प्लंबिंग दोबारा लिखे।

टेस्टिंग, मॉनिटरिंग, और विश्वसनीय ऑपरेशन्स

कोड का पूरा स्वामित्व रखें

सोर्स कोड कभी भी एक्सपोर्ट करें और अपनी रिपॉज़िटरी में आगे विकास जारी रखें.

एक्सपेरिमेंट ट्रैकर तब ही उपयोगी है जब लोग उस पर भरोसा करें। यह भरोसा अनुशासित टेस्टिंग, स्पष्ट मॉनिटरिंग, और अनुमानित ऑपरेशन्स से आता है—खासकर जब कई उत्पाद और पाइपलाइन्स उसी डैशबोर्ड में डेटा फीड करें।

ऑब्ज़र्वेबिलिटी जो उपयोग‑पैटर्न को मैच करे

प्रत्येक महत्वपूर्ण चरण के लिए स्ट्रक्चर्ड लॉगिंग से शुरुआत करें: इवेंट इनजेशन, असाइनमेंट, मेट्रिक रोलअप्स, और परिणाम कम्प्यूटेशन। पहचानकर्ता शामिल करें जैसे product, experiment_id, metric_id, और pipeline run_id ताकि सपोर्ट एकल परिणाम को उसके इनपुट्स तक ट्रेस कर सके।

सिस्टम मेट्रिक्स (API latency, job runtimes, queue depth) और डेटा मेट्रिक्स (इवेंट्स प्रोसेस्ड, % लेट इवेंट्स, % ड्रॉप्ड बाय वैलिडेशन) जोड़ें। सर्विसेज़ के पार ट्रेसिंग भी जोड़ें ताकि आप जवाब दे सकें, "यह प्रयोग कल के डेटा क्यों मिस कर रहा है?"।

डेटा फ्रेशनेस चेक सबसे तेज़ तरीका है साइलेंट फेल्यर्स रोकने का। यदि SLA "रोज़ाना 9am तक" है, तो उत्पाद और स्रोत के हिसाब से फ्रेशनेस मॉनिटर करें और अलर्ट करें जब:

- नवीनतम पार्टिशन गायब हो

- इवेंट वॉल्यूम बेसलाइन से तेज़ गिरावट/उछाल दिखाए

- रोलअप जॉब चलते हैं पर शून्य पंक्तियाँ उत्पन्न करते हैं

ऑटोमेटेड टेस्ट्स: डेटा और गणित की रक्षा

तीन स्तरों पर टेस्ट बनाएँ:

- Schema और constraints: आवश्यक फ़ील्ड्स, यूनिकनेस (उदा. एक प्रयोग प्रति उपयोगकर्ता प्रति असाइनमेंट), फ़ॉरेन कीज़, वैध तिथियाँ

- Permissions: RBAC टेस्ट (viewer/editor/admin), और product scoping ताकि टीमें केवल वही देखें जो उन्हें दिखाना चाहिए

- Result math: लिफ्ट, confidence intervals, significance flags, और एज‑केसेस (छोटे सैम्पल, शून्य नामक डिनोमिनेटर, कई वेरिएंट्स) के लिए यूनिट टेस्ट

एक छोटा "golden dataset" रखें ताकि आप रिलीज़ से पहले रिग्रेशन पकड़ सकें।

डिप्लॉयमेंट्स, माइग्रेशन्स, और ऐतिहासिक सुरक्षा

माइग्रेशन्स को ऑपरेशन्स का हिस्सा मानें: अपने मेट्रिक परिभाषाओं और परिणाम कम्प्यूटेशन लॉजिक को वर्शन करें, और ऐतिहासिक प्रयोगों को बिना अनुरोध के पुनःलिखित न करें। जब बदलाव आवश्यक हों, तो नियंत्रित बैकफिल पथ दें और ऑडिट ट्रेल में क्या बदला इसका दस्तावेज़ रखें।

घटनाओं और पुनःप्रोसेसिंग के लिए एडमिन टूल्स

एक एडमिन व्यू प्रदान करें ताकि किसी विशेष प्रयोग/तिथि‑रेंज के लिए पाइपलाइन फिर से चलाई जा सके, वैलिडेशन त्रुटियाँ निरीक्षण की जा सकें, और घटनाओं को स्थिति अपडेट के साथ टैग किया जा सके। प्रभावित प्रयोगों से सीधे incident नोट्स लिंक करें ताकि उपयोगकर्ता देरी समझें और अधूरी डेटा पर निर्णय न लें।

रोलआउट योजना और सामान्य पिटफॉल्स जो टालने चाहिए

एक्सपेरिमेंट ट्रैकिंग वेब ऐप को उत्पादों में रोलआउट करना "लॉन्च डे" की बात नहीं है—यह अस्पष्टता को निरंतर कम करने के बारे में है: क्या ट्रैक होता है, किसका मालिक कौन है, और क्या नंबर वास्तविकता से मेल खाते हैं।

व्यावहारिक रोलआउट अनुक्रम

एक उत्पाद और एक छोटा, उच्च‑कॉनफिडेंस मेट्रिक सेट (उदा. conversion, activation, revenue) से शुरू करें। लक्ष्य आपका end-to-end वर्कफ़्लो मान्य करना है—एक प्रयोग बनाना, एक्सपोज़र और परिणाम कैप्चर करना, परिणामों की गणना, और निर्णय रिकॉर्ड करना—इससे पहले कि आप जटिलता बढ़ाएँ।

पहले उत्पाद के स्थिर होने पर, उत्पाद दर उत्पाद विस्तार करें एक पूर्वानुमेय ऑनबोर्डिंग cadence के साथ। हर नया उत्पाद एक दोहराने योग्य सेटअप जैसा महसूस होना चाहिए, कोई कस्टम परियोजना नहीं।

यदि आपकी संस्था लंबे "प्लेटफ़ॉर्म बिल्ड" चक्रों में फँसती है, तो एक दो‑ट्रैक दृष्टिकोण पर विचार करें: दृढ़ डेटा कॉन्ट्रैक्ट्स (इवेंट्स, IDs, मेट्रिक परिभाषाएँ) को एक साथ बनाएं और एक पतली एप्लिकेशन लेयर को समानांतर में बनाएं। टीमें कभी‑कभी Koder.ai का उपयोग उस पतली परत को जल्दी खड़ा करने के लिए करती हैं—फार्म्स, डैशबोर्ड, परमिशन्स, और एक्सपोर्ट—फिर अपनाने बढ़ने पर इसे हार्डन करती हैं (स्रोत कोड एक्सपोर्ट और स्नैपशॉट्स के माध्यम से इटरेटिव रोलबैक सहित)।

प्रत्येक नए उत्पाद के लिए रोलआउट चेकलिस्ट

उत्पादों और इवेंट स्कीमाज़ को सुसंगत रूप से ऑनबोर्ड करने के लिए एक हल्की चेकलिस्ट उपयोग करें:

- इवेंट टैक्सोनॉमी और नामकरण कन्वेंशन्स की पुष्टि करें (और कौन इन्हें बदल सकता है)

- सुनिश्चित करें exposure events मौजूद हैं और उपयोगकर्ता विशेष रूप से एट्रिब्युटेबल हैं

- मेट्रिक्स को उत्पाद के इवेंट स्कीमा से मैप करें (रिफंड्स, कैंसलेशन्स जैसे एज‑केसेस सहित)

- मौजूदा एनालिटिक्स से तुलना करने के लिए बैकफिल या पैरेलल‑रन अवधि चलाएँ

- प्रयोग सेटअप, डेटा वैलिडेशन, और अंतिम निर्णय नोट्स के लिए मालिक सौंपें

जहाँ अपनाने में मदद मिले वहाँ प्रयोग परिणामों से "next steps" संबंधित उत्पाद क्षेत्रों की ओर लिंक करें (उदा. प्राइसिंग‑संबंधी प्रयोग /pricing को लिंक कर सकते हैं)। लिंक सूचनात्मक और न्यूट्रल रखें—कोई निहित परिणाम नहीं।

अपनाने को मापें ताकि आप शुरुआती घर्षण ठीक कर सकें

मापें कि टूल निर्णयों के लिए डिफ़ॉल्ट जगह बन रहा है या नहीं:

- रोल के अनुसार साप्ताहिक सक्रिय उपयोगकर्ता (PM, एनालिस्ट, इंजीनियर)

- बनाए और पूरे किए गए प्रयोग

- जिन में निर्णय नोट्स भरे गए हैं (%) (सिर्फ परिणाम देखे जाने के बजाय)

- प्रयोग अंत → निर्णय रिकॉर्ड होने में लगने वाला समय

सामान्य पिटफॉल्स जो ध्यान रखें

अमल में, अधिकांश रोलआउट कुछ दोहराने वाले कारणों पर अटकते हैं:

- विभिन्न उत्पादों में असंगत मेट्रिक परिभाषाएँ (एक ही नाम, अलग गणित)

- गायब या दोषपूर्ण एक्सपोज़र ट्रैकिंग, जिससे पक्षपाती परिणाम

- अस्पष्ट मालिकाना जो validation और sign-off के अभाव में "zombie experiments" बनाते हैं

- चुपके से स्कीमा बदलना जो ट्रेंड्स तोड़ दे बिना किसी को पता चले

- कोर वर्कफ़्लो पर भरोसा बनने से पहले बहुत सारे मेट्रिक्स में स्केल करना

इन सावधानियों के साथ आप धीरे‑धीरे अस्पष्टता कम कर के संगठन के लिए एक भरोसेमंद प्रयोग रिकॉर्ड बना सकते हैं।

अक्सर पूछे जाने वाले प्रश्न

एक प्रयोग ट्रैकिंग वेब ऐप असल में किस समस्या का समाधान कर रहा है?

प्रत्येक प्रयोग का अंतिम, सहमत रिकॉर्ड केंद्रीकृत करके शुरुआत करें:

- क्या टेस्ट किया गया (हाइपोथेसिस, वेरिएंट)

- कहाँ चलाया गया (उत्पाद)

- कैसे मापा गया (मेट्रिक परिभाषा + वर्शन)

- क्या हुआ (परिणाम, अनिश्चितता, निर्णय)

आप फीचर-फ्लैग टूल और एनालिटिक्स सिस्टमों के लिंक जोड़ सकते हैं, लेकिन ट्रैकर को संरचित इतिहास का मालिक होना चाहिए ताकि परिणाम समय के साथ खोजने योग्य और तुलनात्मक बने रहें।

क्या एक प्रयोग ट्रैकर को एक्सपेरिमेंट्स end-to-end चलाने की ज़रूरत है?

नहीं—स्कोप को स्पष्ट रखें: यह ऐप परिणामों को ट्रैक और रिपोर्ट करने पर केंद्रित होना चाहिए।

एक व्यावहारिक MVP में शामिल है:

- प्रयोग मेटाडेटा संग्रहीत करना (मालिक, तिथियाँ, टार्गेटिंग, ट्रैफिक स्प्लिट)

- मेट्रिक परिभाषाएँ (वर्शन वाली) संग्रहीत करना

- कम्प्यूटेड परिणाम संग्रहीत करना (लिफ्ट + अनिश्चितता) और निर्णय नोट्स

- बाहरी सिस्टम्स (फ्लैग, टिकट, डैशबोर्ड) के लिए लिंक

इससे आप पूरा एक्सपेरिमेंटेशन प्लेटफ़ॉर्म फिर से बनाने से बचते हुए “छितरे हुए परिणाम” की समस्या सुलझा लेते हैं।

MVP डेटा मॉडल में किन मुख्य एंटिटीज़ को शामिल करना चाहिए?

एक न्यूनतम मॉडल जो टीमों के बीच काम करता है:

हम ऐसे आइडेंटिफायर्स कैसे डिजाइन करें कि परिणाम उत्पादों के बीच सुसंगत रहें?

डिस्प्ले नामों को एडिटेबल लेबल मानते हुए स्थिर IDs का उपयोग करें:

product_id: बदलना नहीं चाहिए, भले ही उत्पाद का नाम बदलेexperiment_id: आंतरिक अपरिवर्तनीय IDexperiment_key: पठनीय स्लग (प्रति-उत्पाद यूनिक बनाया जा सकता है)

एक प्रयोग बनाते समय किन फील्ड्स को अनिवार्य करना चाहिए?

सेटअप के समय “सक्सेस क्राइटेरिया” को स्पष्ट रखें:

- सेटअप पर एक प्राथमिक मेट्रिक अनिवार्य करें (निर्णय चालक)

- गार्डरैइल्स परिभाषित करें (जो बिगड़ना नहीं चाहिए)

- नियंत्रित निर्णय स्थिति स्टोर करें (उदा. Draft → Running → Analyzed → Shipped/Rolled back → Archived)

इस संरचना से बाद में बहस कम होती है क्योंकि पाठक देख सकते हैं कि टेस्ट से पहले "जीत" का क्या मतलब था।

हम टीमों के बीच मेट्रिक परिभाषाओं की असंगति कैसे रोकें?

एक कैनोनिकल मेट्रिक कैटलॉग बनाकर:

- साधारण-भाषा परिभाषा + निर्णय उद्देश्य

- सटीक फॉर्मूला और आवश्यक इवेंट/फील्ड

- शामिल/अवर्जित नियम (बॉट्स, आंतरिक उपयोगकर्ता, रिफंड्स)

- विश्लेषण यूनिट (यूजर/सेशन/ऑर्डर/अकाउंट)

- मालिक और वर्शनिंग

जब लॉजिक बदलती है, तो इतिहास में बदलाव करने की बजाय नया मेट्रिक वर्शन पब्लिश करें—और हर प्रयोग में किस वर्शन का उपयोग हुआ, वह स्टोर करें।

हमारे पास न्यूनतम इंस्ट्रूमेंटेशन और डेटा क्वालिटी चेक्स क्या होने चाहिए?

न्यूनतम इंस्ट्रूमेंटेशन और डेटा क्वालिटी चेक जो चाहिए:

- एक assignment/exposure इवेंट जिसमें experiment ID और variant हो

- प्रमुख कन्वर्ज़न इवेंट्स जिनमें exposure से जोड़ने के लिए संगत पहचान फील्ड हों

- एट्रिब्यूशन विंडो के लिए भरोसेमंद टाइमस्टैम्प

फिर इन चेक्स को ऑटोमेट करें जैसे:

ट्रैकर में हमें frequentist रखना चाहिए या Bayesian?

एक “डायलैक्ट” चुनें और उसी पर टिके रहें:

- Frequentist: p-values + confidence intervals

- Bayesian: सुधार की संभावना + credible intervals

जो भी चुनें, UI में हमेशा दिखाएँ:

- कंट्रोल के मुकाबले लिफ्ट

- एक अंतराल रेंज (सिर्फ पॉइंट अनुमान नहीं)

- विश्लेषण विंडो, गिने गए यूनिट्स, और मेट्रिक वर्शन

क्रॉस-प्रोडक्ट ट्रैकर के लिए कौन‑सी अनुमति और गवर्नेंस सुविधाएँ आवश्यक हैं?

पहले से ही मानक के रूप में एक्सेस कंट्रोल को लें, न कि बाद में जोड़ें:

- RBAC: Viewer / Editor / Admin

- Product-scoped access: उपयोगकर्ता केवल उन्हीं उत्पादों को देखें जिनके वे सदस्य हों

- संवेदनशील प्रयोगों के लिए वैकल्पिक row-level restrictions

और दो ऑडिट ट्रेल रखें:

हम ट्रैकर कैसे रोल आउट करें और किन सामान्य गलतियों से बचें?

रोलआउट को दोहराने योग्य क्रम में करें:

- एक उत्पाद और एक छोटे मेट्रिक सेट (उदा. conversion, activation, revenue) से शुरू करें

- end-to-end वैधता जाँचें: assignment → joins → metrics → results → decision notes

- हर नए उत्पाद को उसी ऑनबोर्डिंग चेकलिस्ट के साथ जोड़ें

सामान्य पिटफॉल्स से बचें: