29 apr 2025·7 min

Come creare una web app per esperimenti sui prezzi

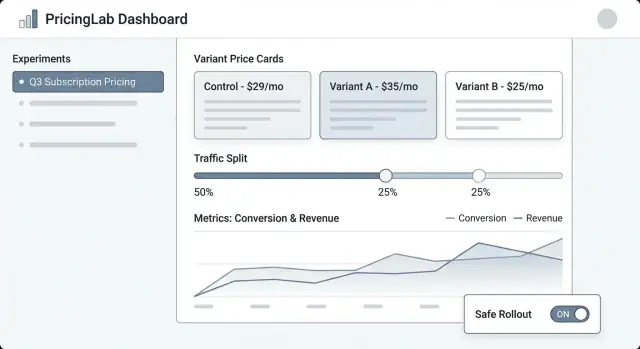

Progetta e lancia una web app interna per gestire esperimenti di prezzo: varianti, split traffico, assegnazione, metriche, dashboard e guardrail per rollout sicuri.

Cosa deve fare un Pricing Experiment Manager

Gli esperimenti di prezzo sono test strutturati in cui mostri prezzi diversi (o packaging diversi) a gruppi differenti di clienti e misuri cosa cambia—conversione, upgrade, churn, revenue per visitatore e altro. È la versione sul prezzo di un test A/B, ma con un rischio aggiuntivo: un errore può confondere i clienti, generare ticket di supporto o perfino violare policy interne.

Un pricing experiment manager è il sistema che mantiene questi test controllati, osservabili e reversibili.

I problemi che questa app dovrebbe risolvere

Controllo: i team hanno bisogno di un unico posto per definire cosa viene testato, dove e per chi. “Abbiamo cambiato il prezzo” non è un piano—un esperimento necessita di un'ipotesi chiara, date, regole di targeting e un kill switch.

Tracciamento: senza identificatori coerenti (experiment key, variant key, timestamp di assegnazione), l'analisi diventa un'ipotesi. Il manager deve garantire che ogni esposizione e acquisto sia attribuibile al test giusto.

Coerenza: i clienti non dovrebbero vedere un prezzo sulla pagina dei prezzi e un altro al checkout. Il manager deve coordinare come le varianti vengono applicate sulle diverse superfici in modo che l'esperienza sia coerente.

Sicurezza: gli errori di prezzo sono costosi. Servono guardrail come limiti di traffico, regole di eligibilità (es. solo nuovi clienti), passaggi di approvazione e auditabilità.

Chi lo usa

- Product per pianificare esperimenti, definire metriche di successo e decidere cosa rilasciare.

- Growth/Marketing per iterare offerte e messaggi legati al prezzo.

- Finance per far rispettare regole di revenue, politiche di sconto e requisiti di reportistica.

- Support per capire cosa ha visto un cliente e risolvere le dispute rapidamente.

- Engineering per integrare i cambi di prezzo in modo sicuro e prevedibile.

Cosa stiamo costruendo (e cosa non stiamo costruendo)

Questo post si concentra su un'app interna che gestisce esperimenti: crearli, assegnare varianti, raccogliere eventi e riportare i risultati.

Non è un motore di pricing completo (calcolo tasse, fatturazione, cataloghi multi-valuta, proration, ecc.). Invece, è il pannello di controllo e lo strato di tracciamento che rende i test di prezzo abbastanza sicuri da eseguire regolarmente.

Ambito, requisiti e non-goals

Un pricing experiment manager è utile solo se è chiaro cosa farà—e cosa non farà. Un ambito ristretto mantiene il prodotto facile da gestire e più sicuro da rilasciare, specialmente quando c'è revenue reale in gioco.

Requisiti minimi (capabilità must-have)

Al minimo, la tua web app dovrebbe permettere a un operatore non tecnico di eseguire un esperimento end-to-end:

- Creare esperimenti con nome, ipotesi, prodotto/i target, segmento/i target e durata pianificata.

- Definire varianti (es. “Control: $29”, “Treatment: $35”), inclusa valuta, periodo di fatturazione e regole di eligibilità.

- Avviare / mettere in pausa / terminare un esperimento, con stato chiaro e timestamp efficaci.

- Visualizzare risultati a un livello base: conversione, revenue per visitatore, valore medio ordine, più indicatori di confidenza/incertezza.

Se non costruisci altro, costruisci bene queste cose—with valori predefiniti chiari e guardrail.

Tipi di esperimento supportati (mantienili intenzionali)

Decidi presto quali formati di esperimento supporterai così UI, modello dati e logica di assegnazione restino coerenti:

- A/B test (un controllo vs una treatment) come percorso primario.

- Test multivariati / multi-armed (più punti prezzo) per team che necessitano più di due opzioni.

- Gruppi holdout (es. 5% vede il pricing baseline) per misurare effetti a lungo termine o di sistema.

- Gradual rollout (incremento del traffico nel tempo) per ridurre il rischio durante l'apprendimento.

Non-goals (ciò che non stai costruendo)

Sii esplicito per prevenire lo “scope creep” che trasforma lo strumento in un sistema fragile e critico per il business:

- Non è un sostituto del sistema di fatturazione (invoicing, tasse, proration, rimborsi).

- Non è una piattaforma BI completa (esplorazione dati libera, SQL custom, modeling su data warehouse).

- Non è ottimizzazione ML complessa (motori di pricing dinamici, reinforcement learning, auto-tuning).

Criteri di successo

Definisci il successo in termini operativi, non solo statistici:

- Insight pronti per la decisione: un product manager può decidere con fiducia “ship / revert / iterate”.

- Basso rischio operativo: default sicuri, rollback semplice e esposizione controllata.

- Auditabilità: chi ha cambiato cosa, quando e perché—adatto per revisione finance e compliance.

Modello dati: Experiments, Variants e Assignments

Un'app per esperimenti di prezzo vive o muore con il suo modello dati. Se non puoi rispondere in modo affidabile a “che prezzo ha visto questo cliente, e quando?”, le metriche saranno rumorose e il team perderà fiducia.

Entità chiave da modellare

Inizia con un set piccolo di oggetti core che mappano a come il pricing funziona realmente nel tuo prodotto:

- Product: ciò che viene venduto (es. “Analytics Suite”).

- Plan: un tier di packaging (es. Starter, Pro, Enterprise).

- Price: l'importo effettivo e le regole di fatturazione (valuta, intervallo, regole paese/VAT, date di efficacia).

- Customer: l'unità di analisi (account, user, workspace—scegline una e mantienila).

- Segment: una definizione riutilizzabile (es. “solo US”, “self-serve”, “nuovi clienti”).

- Experiment: il contenitore con scope, ipotesi, inizio/fine e targeting.

- Variant: ogni trattamento (Variant A = prezzo corrente, Variant B = nuovo prezzo).

- Assignment: il record che indica che un cliente è stato messo in una specifica variante.

- Event: azioni tracciate (page_view, checkout_started, subscription_created, upgrade).

- Metric: una definizione calcolata (conversion rate, ARPA, revenue per visitor, churn).

Identificatori e campi temporali che vorrai dopo

Usa identificatori stabili tra i sistemi (product_id, plan_id, customer_id). Evita chiavi “belle” come nomi—possono cambiare.

I campi temporali sono altrettanto importanti:

- created_at per tutto.

- starts_at / ends_at sugli esperimenti per le finestre di reporting.

- decision_date (o decided_at) per segnare quando il risultato è stato accettato.

Considera anche effective_from / effective_to sui record Price così puoi ricostruire il pricing in un qualsiasi momento nel passato.

Relazioni che rendono possibile l'attribuzione

Definisci relazioni in modo esplicito:

- Experiment → Variants (one-to-many).

- Customer → Assignments (one-to-many, ma spesso limitato a un assignment attivo per esperimento).

- Event → Customer + Experiment + Variant.

Praticamente, questo significa che un Event dovrebbe portare (o essere joinable a) customer_id, experiment_id e variant_id. Se memorizzi solo customer_id e “cerchi l'assignment più tardi”, rischi join errati quando le assegnazioni cambiano.

Immutabilità: conserva la storia, non sovrascriverla

Gli esperimenti di prezzo richiedono una storia a prova di audit. Rendi record chiave append-only:

- Prices dovrebbero essere versionati, non aggiornati in place.

- Assignments non dovrebbero mai essere modificati per “correggere” dati; se devi cambiare l'esposizione, crea un nuovo record e chiudi quello vecchio.

- Decisions (vincitore, rationale, decision_date) dovrebbero essere preservate anche se in seguito rilanci un test simile.

Questo approccio mantiene il reporting consistente e rende le funzionalità di governance, come gli audit log, più semplici da implementare in seguito.

Workflow dell'esperimento e lifecycle

Un pricing experiment manager necessita di un lifecycle chiaro così tutti capiscono cosa è modificabile, cosa è bloccato e cosa succede ai clienti quando lo stato dell'esperimento cambia.

Lifecycle raccomandato

Draft → Scheduled → Running → Stopped → Analyzed → Archived

- Draft: creare l'esperimento, le varianti, il pubblico target e le metriche di successo. Nulla è servito ai clienti.

- Scheduled: è impostato un orario di inizio (e opzionalmente di fine). Il sistema valida la readiness e può notificare gli stakeholder.

- Running: assegnazione e fornitura prezzi sono live. La maggior parte dei campi dovrebbe bloccarsi per evitare modifiche accidentali a metà test.

- Stopped: l'esperimento non assegna più nuovi utenti; si sceglie come trattare gli utenti esistenti.

- Analyzed: i risultati sono finalizzati, documentati e condivisi.

- Archived: storage in sola lettura per compliance e riferimento futuro.

Campi richiesti e validazioni per stato

Per ridurre lanci rischiosi, applica campi obbligatori man mano che l'esperimento avanza:

- Prima di Scheduled: owner, scope (prodotti/regioni/piani), varianti e punti prezzo, esposizione/split traffico, orari di start/end.

- Prima di Running: ipotesi, metrica/e primaria/e, guardrail (es. churn, rimborsi, ticket supporto), sample minimo o regola run-time, piano di rollback e conferma schema di tracking/eventi.

- Prima di Analyzed: tempo snapshot finale dei dati, note di analisi e decisione (ship/iterate/reject).

Gate di approvazione e override

Per il pricing, aggiungi gate opzionali per Finance e Legal/Compliance. Solo gli approvatori possono spostare Scheduled → Running. Se supporti override (es. rollback urgente), registra chi ha fatto override, perché e quando, nell'audit log.

Cosa significa operativamente “Stop”

Quando un esperimento è Stopped, definisci due comportamenti espliciti:

- Freeze assignments: smettere di assegnare nuovi utenti; mantenere gli utenti esistenti ancorati alla loro ultima variante assegnata.

- Serving policy: o continuare a servire l'ultimo prezzo visto (stabilità per i clienti a metà percorso) o revertire al baseline (rollback rapido).

Rendi questa scelta obbligatoria al momento dello stop così il team non può fermare un esperimento senza decidere l'impatto sui clienti.

Assegnazione varianti e traffic splitting

Estendi il budget

Pubblica quello che costruisci con Koder.ai o segnala colleghi e guadagna crediti d'uso.

Far bene l'assegnazione è la differenza tra un test di prezzo affidabile e rumore confuso. La tua app dovrebbe rendere semplice definire chi vede un prezzo e assicurarsi che lo veda in modo consistente.

Assegnazione consistente (la regola “sticky”)

Un cliente dovrebbe vedere la stessa variante tra sessioni, dispositivi (quando possibile) e refresh. Ciò significa che l'assegnazione deve essere deterministica: dato lo stesso assignment key e lo stesso esperimento, il risultato è sempre lo stesso.

Approcci comuni:

- Assegnazione basata su hash: calcolare l'hash di

(experiment_id + assignment_key)e mappare il risultato su una variante. - Assegnazione memorizzata: scrivere la variante assegnata in una tabella del database per recupero successivo (utile quando servono audit o override complessi).

Molte squadre usano l'assegnazione basata su hash di default e memorizzano le assegnazioni solo quando necessario (per supporto o governance).

Scelta della chiave di assegnazione

La tua app dovrebbe supportare più chiavi, perché il pricing può essere a livello utente o account:

- user_id: migliore quando il pricing è individuale e gli utenti fanno login in modo affidabile.

- account_id / org_id: migliore per pricing B2B così tutti nella stessa azienda vedono lo stesso prezzo.

- cookie anonimo/device ID: utile prima del login, con una strada di upgrade per unire l'assegnazione a

user_iddopo la registrazione/login.

Quella strada di upgrade è importante: se qualcuno naviga da anonimo e poi crea un account, dovresti decidere se mantenere la loro variante originale (continuità) o riassegnarli (regole di identità più pulite). Rendi questa impostazione chiara ed esplicita.

Traffic splitting e ramp-up

Supporta allocazioni flessibili:

- 50/50 per semplici A/B test

- Split pesati (es. 90/10) per controllo del rischio

- Schedule di ramp-up (es. 1% → 5% → 25% → 50%) con date/ore

Quando fai ramp, mantieni le assegnazioni sticky: l'aumento di traffico dovrebbe aggiungere nuovi utenti all'esperimento, non rimescolare quelli esistenti.

Casi limite da gestire

I test concorrenti possono entrare in conflitto. Costruisci guardrail per:

- Gruppi mutuamente esclusivi (solo un esperimento di prezzo attivo per utente/account)

- Regole di priorità (se due esperimenti targettano lo stesso cliente, quale vince?)

- Esclusioni (staff interno, account di test/supporto, regioni, piani, contratti esistenti)

Una chiara schermata di “Assignment preview” (dato un esempio di user/account) aiuta i team non tecnici a verificare le regole prima del lancio.

Integrare i prezzi nel prodotto in sicurezza

Testa le assegnazioni in sicurezza

Aggiungi una vista QA per verificare l'assegnazione di un utente o di un'organizzazione prima del lancio.

Gli esperimenti di prezzo falliscono più spesso nel livello di integrazione—not perché la logica dell'esperimento è sbagliata, ma perché il prodotto mostra un prezzo e addebita un altro. La tua web app dovrebbe rendere molto esplicito “qual è il prezzo” e “come il prodotto lo usa”.

Separa definizione del prezzo dalla consegna del prezzo

Tratta la definizione del prezzo come fonte di verità (le regole prezzo della variante, date effettive, valuta, tassazione, ecc.). Tratta la consegna del prezzo come un semplice meccanismo per recuperare il prezzo scelto tramite un endpoint API o un SDK.

Questa separazione mantiene pulito lo strumento di gestione esperimenti: i team non tecnici modificano definizioni, mentre gli ingegneri integrano un contratto di delivery stabile come GET /pricing?sku=....

Decidi dove viene calcolato il prezzo

Ci sono due pattern comuni:

- Server-side al checkout (raccomandato per l'addebito): calcola l'importo finale pagabile sul server per evitare incongruenze e manomissioni.

- Client-side per la visualizzazione: va bene per mostrare prezzi stimati, ma deve essere verificato dal server al momento dell'acquisto.

Un approccio pratico è “display client, verify e compute server”, usando la stessa assegnazione dell'esperimento.

Sii rigoroso su valute, tasse e arrotondamenti

Le varianti devono seguire le stesse regole su:

- selezione valuta (locale utente vs paese di fatturazione)

- inclusione tasse (IVA inclusa vs aggiunta)

- arrotondamento (per voce vs per fattura)

Memorizza queste regole insieme al prezzo così ogni variante sia confrontabile e finance-friendly.

Prevedi fallback sicuri

Se il servizio degli esperimenti è lento o non disponibile, il prodotto dovrebbe restituire un prezzo di default sicuro (di solito il baseline). Definisci timeout, caching e una chiara policy “fail closed” così il checkout non si rompe—e registra i fallback per quantificarne l'impatto.

Metriche, eventi e basi per l'attribuzione

Gli esperimenti di prezzo vivono o muoiono dalla misurazione. La tua app dovrebbe rendere difficile il “ship and hope” richiedendo metriche chiare, eventi puliti e un approccio di attribuzione coerente prima che un esperimento possa partire.

Scegli le metriche primarie (le metriche di decisione)

Inizia con una o due metriche che userai per decidere il vincitore. Scelte comuni per il pricing:

- Conversion rate (es. visitatore → checkout, trial → paid)

- Revenue per visitor (RPV) (cattura insieme prezzo e conversione)

- ARPA/ARPU (utile per tier di abbonamento)

- Churn / retention (solo se misurabile in una finestra ragionevole)

Una regola utile: se i team discutono ancora del risultato dopo il test, probabilmente non hai definito la metrica di decisione in modo sufficientemente chiaro.

Aggiungi guardrail (le metriche “non rompere il business”)

I guardrail catturano danni che un prezzo più alto potrebbe causare anche se il revenue a breve termine sembra positivo:

- Refund rate e chargeback

- Ticket di supporto (billing, confusione, reclami)

- Payment failures (decline carte, problemi 3DS)

- Drop trial-to-paid (i cambi di prezzo possono influenzare l'intento)

La tua app può applicare soglie per i guardrail (es. “refund rate non deve aumentare oltre 0.3%”) e evidenziare le violazioni nella pagina dell'esperimento.

Definisci uno schema eventi di cui ti puoi fidare

Al minimo, il tuo tracciamento deve includere identificatori stabili per esperimento e variante su ogni evento rilevante.

{

"event": "purchase_completed",

"timestamp": "2025-01-15T12:34:56Z",

"user_id": "u_123",

"experiment_id": "exp_earlybird_2025_01",

"variant_id": "v_price_29",

"currency": "USD",

"amount": 29.00

}

Rendi queste proprietà obbligatorie al momento dell'ingestione, non “best effort”. Se un evento arriva senza experiment_id/variant_id, instradalo in un bucket “unattributed” e segnala problemi di qualità dati.

Scegli finestre di attribuzione (e gestisci outcome ritardati)

Gli esiti del pricing sono spesso ritardati (renewal, upgrade, churn). Definisci:

- Finestra di attribuzione: es. “conta gli acquisti entro 7 giorni dalla prima esposizione”

- Regola di exposure: prima esposizione vs ultima esposizione (prima è solitamente più sicuro per il pricing)

- Metriche ritardate: mostra subito un “early read”, ma mantieni uno stato “finale” che si aggiorna quando la finestra chiude

Questo mantiene i team allineati su quando un risultato è affidabile—e previene decisioni premature.

UX e schermate per team non tecnici

Ottieni report decisionali

Crea una vista operativa dei risultati con metriche chiave e breakdown per segmenti.

Uno strumento per esperimenti di prezzo funziona solo se product manager, marketing e finance possono usarlo senza chiedere un ingegnere per ogni clic. La UI dovrebbe rispondere a tre domande rapidamente: Cosa è in esecuzione? Cosa cambierà per i clienti? Cosa è successo e perché?

Schermate core da includere

Lista esperimenti dovrebbe sembrare una dashboard operativa. Mostra: nome, stato (Draft/Scheduled/Running/Paused/Ended), start/end, traffic split, metrica primaria e owner. Aggiungi un visibile “ultimo aggiornamento da” con timestamp così le persone si fidano dei dati.

Dettaglio esperimento è la home base. Metti un sommario compatto in alto (stato, date, audience, split, metrica primaria). Sotto, usa tab come Varianti, Targeting, Metriche, Change log e Risultati.

Editor variante deve essere semplice e opinabile. Ogni riga variante dovrebbe includere prezzo (o regola di prezzo), valuta, periodo di fatturazione e una descrizione in linguaggio naturale (“Piano annuale: $120 → $108”). Rendi difficile modificare accidentalmente una variante live richiedendo conferma.

Vista risultati dovrebbe partire dalla decisione, non solo dai grafici: “La Variante B ha aumentato la conversione checkout del 2.1% (95% CI …).” Poi fornisci drill-down e filtri di supporto.

Design per chiarezza (e fiducia)

Usa badge di stato coerenti e mostra una timeline delle date chiave. Visualizza lo split traffico sia in percentuale che con una piccola barra. Includi un pannello “Chi ha cambiato cosa” (o tab) che elenchi modifiche a varianti, targeting e metriche.

Guardrail e validazione

Prima di permettere Start, richiedi: almeno una metrica primaria selezionata, almeno due varianti con prezzi validi, un piano di ramp (opzionale ma raccomandato) e un piano di rollback o prezzo di fallback. Se manca qualcosa, mostra errori azionabili (“Aggiungi una metrica primaria per abilitare i risultati”).

Azioni rapide che risparmiano tempo

Fornisci azioni sicure e prominenti: Pause, Stop, Ramp up (es. 10% → 25% → 50%), e Duplicate (copia impostazioni in un nuovo Draft). Per azioni rischiose, usa conferme che riassumono l'impatto (“La pausa congela le assegnazioni e ferma l'esposizione”).

Prototipare lo strumento interno più velocemente

Se vuoi validare i workflow (Draft → Scheduled → Running) prima di investire in una build completa, una piattaforma vibe-coding come Koder.ai può aiutarti a mettere in piedi un'app interna da una specifica chat-based—poi iterare velocemente con schermate basate su ruoli, audit log e dashboard semplici. È particolarmente utile per i prototipi iniziali dove vuoi un UI React funzionante e un backend Go/PostgreSQL che poi puoi esportare e rafforzare.

Domande frequenti

Cos'è un pricing experiment manager e quale problema risolve?

È un pannello di controllo interno e uno strato di tracciamento per i test di prezzo. Aiuta i team a definire esperimenti (ipotesi, pubblico, varianti), mostrare un prezzo coerente su tutte le superfici, raccogliere eventi attribuibili e avviare/pausare/interrompere in sicurezza con auditabilità.

Non è voluto essere un motore di fatturazione completo o gestione fiscale; orchestra gli esperimenti attorno allo stack di pricing/billing esistente.

Quali sono le funzionalità minime che un MVP dovrebbe includere?

Un MVP pratico include:

- Creazione di esperimenti e varianti (valuta, periodo di fatturazione, regole di eligibilità)

- Assegnazione deterministica e sticky (utente/organizzazione/cookie)

- Avvio/pausa/interruzione con timestamp effettivi e un kill switch

- Risultati di base (conversione, revenue per visitatore, AOV) con indicatori di incertezza/confidenza

- Guardrail (limiti di traffico, esclusioni, validazione) e registro di audit

Se queste funzioni sono affidabili, si può iterare su targeting e reporting più ricchi in seguito.

Quali entità del data model sono più importanti per un'attribuzione accurata?

Modella gli oggetti principali che ti permettono di rispondere: “Quale prezzo ha visto questo cliente, e quando?” Tipicamente:

- Experiment, Variant, Assignment

- Customer (o account/org), Segment

- Price (versionato con date di efficacia)

- Event (deve riportare experiment_id + variant_id, non solo customer_id)

Evita modifiche mutabili alla storia chiave: versione i prezzi e aggiungi nuovi record di assignment invece di sovrascrivere.

Come dovrebbe funzionare il ciclo di vita dell'esperimento per ridurre i rischi?

Definisci un lifecycle come Draft → Scheduled → Running → Stopped → Analyzed → Archived.

Blocca i campi a rischio quando l'esperimento è Running (varianti, targeting, split) e richiedi validazioni prima di cambiare stato (metriche selezionate, tracking confermato, piano di rollback). Questo evita modifiche a metà test che renderebbero i risultati inaffidabili e creerebbero incongruenze per i clienti.

Come si assegnano i clienti alle varianti in modo affidabile (assegnazione sticky)?

Usa l'assegnazione sticky così lo stesso cliente ottiene la stessa variante su sessioni/dispositivi quando possibile.

Pattern comuni:

- Hash-based: calcola l'hash di

(experiment_id + assignment_key)e mappa il risultato su un bucket variante - Stored assignment: scrivi la variante assegnata in una tabella per recupero e per audit/override

Molte squadre usano hash-first e memorizzano le assegnazioni solo quando serve per governance o supporto.

Quale dovrebbe essere la chiave di assegnazione: user_id, account_id o cookie anonimo?

Scegli una chiave che rispecchi come i clienti vivono il pricing:

- org_id/account_id per B2B (tutta l'azienda vede lo stesso prezzo)

- user_id per prezzi individuali quando il login è affidabile

- cookie anonimo/device ID per navigazione pre-login

Se inizi anonimo, definisci una regola esplicita di “identity upgrade” al signup/login (mantenere la variante originale per continuità vs riassegnare per pulizia).

Quando si interrompe un esperimento, cosa succede agli utenti esistenti?

Tratta “Stop” come due decisioni separate:

- Freeze assignments: interrompi l'arruolamento di nuovi clienti; mantieni gli utenti esistenti fissati alla loro ultima variante

- Serving policy: o continui a servire l'ultimo prezzo visto (stabilità) o torni al baseline (rollback rapido)

Rendi la policy di serving una scelta obbligatoria al momento dello stop, così il team riconosce l'impatto sui clienti.

Come si evita che i clienti vedano un prezzo e ne vengano addebitati un altro?

Assicura che la stessa variante guidi sia la visualizzazione sia l'addebito:

- Usa il manager come fonte di verità per la definizione del prezzo

- Fornisci un contratto di fornitura stabile (API/SDK) usato sia dalla pagina prezzi sia dal checkout

- Calcola l'importo finale pagabile server-side al checkout (il client può mostrare solo stime)

Definisci anche fallback sicuri se il servizio è lento/non disponibile (di solito il prezzo baseline) e registra ogni fallback per visibilità.

Quali metriche ed eventi dovrei tracciare per gli esperimenti di prezzo?

Richiedi uno schema di eventi piccolo e coerente dove ogni evento rilevante includa experiment_id e variant_id.

In genere definisci:

- Metriche decisionali primarie (es. conversion rate, revenue per visitor)

- Guardrail (resi, ticket di supporto, fallimenti di pagamento)

- Finestra di attribuzione e regola di exposure (spesso “prima exposure” + 7–14 giorni)

Se un evento arriva senza i campi experiment/variant, instradalo in un bucket “unattributed” e segnala problemi di qualità dati.

Come si integrano permessi, approvazioni e audit log negli esperimenti di prezzo?

Usa un modello di ruoli semplice e una cronologia completa delle modifiche:

- Ruoli: Viewer, Editor, Approver, Admin (opzionalmente scorporati per prodotto/regione)

- Audit log con chi/cosa/quando e diff before/after per varianti, targeting, split, start/stop, approvazioni

- Note per ipotesi, rationale e outcome delle decisioni

Questo riduce lanci accidentali e facilita revisioni finanziarie/compliance e retrospettive future.