09 de ago. de 2025·4 min

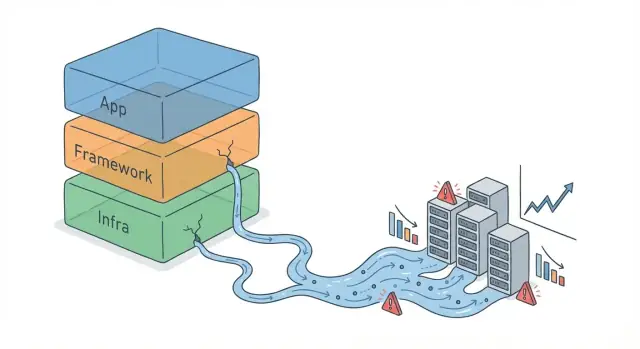

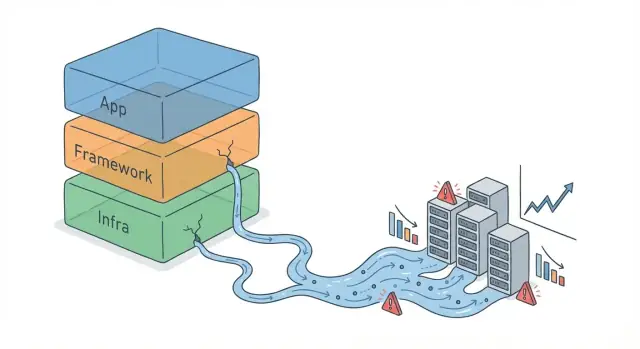

Como as Abstrações de Framework Vazam Quando os Sistemas Escalam

Entenda por que frameworks de alto nível falham em escala, padrões comuns de vazamento, sintomas a observar e correções práticas de design e operação.

Entenda por que frameworks de alto nível falham em escala, padrões comuns de vazamento, sintomas a observar e correções práticas de design e operação.

Uma abstração é uma camada que simplifica: a API do framework, um ORM, um cliente de fila, até um helper de cache “uma-linha”. Ela te deixa pensar em conceitos de nível mais alto (“salvar este objeto”, “enviar este evento”) sem mexer constantemente com a mecânica de baixo nível.

Um vazamento de abstração acontece quando esses detalhes ocultos começam a afetar os resultados reais — então você é forçado a entender e gerenciar aquilo que a abstração tentou esconder. O código ainda “funciona”, mas o modelo simplificado não prevê mais o comportamento real.

O crescimento inicial perdoa. Com pouco tráfego e datasets pequenos, ineficiências se escondem atrás de CPU sobrando, caches vazios e queries rápidas. Picos de latência são raros, retries não se acumulam, e uma linha de log um pouco ineficiente não faz diferença.

À medida que o volume aumenta, os mesmos atalhos podem se amplificar:

Abstrações que vazam costumam se manifestar em três áreas:

A seguir, vamos focar em sinais práticos de que uma abstração está vazando, como diagnosticar a causa subjacente (não apenas os sintomas) e opções de mitigação — desde ajustes de configuração até “descer de nível” deliberadamente quando a abstração não corresponde mais à sua escala.

Muito software segue o mesmo arco: um protótipo prova a ideia, um produto é lançado e o uso cresce mais rápido que a arquitetura original. No começo, frameworks parecem mágicos porque seus defaults permitem mover-se rápido — roteamento, acesso a BD, logging, retries e jobs em background “de graça”.

Em escala, você ainda quer esses benefícios — mas os defaults e APIs de conveniência começam a comportar-se como suposições.

Os padrões do framework geralmente supõem:

Essas suposições valem cedo, então a abstração parece limpa. Mas escala muda o que “normal” significa. Uma query que vai bem com 10.000 linhas fica lenta em 100 milhões. Um handler síncrono simples começa a dar timeout quando há picos de tráfego. Uma política de retry que suavizava falhas ocasionais pode amplificar outages quando milhares de clientes re-tentam ao mesmo tempo.

Escala não é só “mais usuários”. É mais volume de dados, tráfego em rajadas e mais trabalho concorrente acontecendo ao mesmo tempo. Isso pressiona as partes que as abstrações escondem: pools de conexão, escalonamento de threads, profundidade de filas, pressão de memória, limites de I/O e limites de taxa de dependências.

Frameworks frequentemente escolhem configurações genéricas seguras (tamanhos de pool, timeouts, comportamento de batching). Sob carga, esses ajustes podem se traduzir em contenção, latência de cauda e falhas em cascata — problemas que não eram visíveis quando tudo cabia confortavelmente nas margens.

Ambientes de staging raramente espelham produção: datasets menores, menos serviços, comportamento de cache diferente e atividade de usuário menos “bagunçada”. Em produção você também tem variabilidade real de rede, noisy neighbors, deploys rolantes e falhas parciais. Por isso abstrações que pareciam estanques em testes podem começar a vazar quando condições do mundo real aplicam pressão.

Quando uma abstração vaza, os sintomas raramente aparecem como uma mensagem de erro clara. Em vez disso, você vê padrões: comportamento que era aceitável em baixo tráfego se torna imprevisível ou caro com maior volume.

Uma abstração vazando frequentemente se anuncia por latência visível ao usuário:

Esses são sinais clássicos de que a abstração está ocultando um gargalo que você não alivia sem descer um nível (ex.: inspecionar queries reais, uso de conexão ou comportamento de I/O).

Alguns vazamentos aparecem primeiro em faturas em vez de dashboards:

Se subir infraestrutura não restaura desempenho proporcionalmente, muitas vezes não é capacidade bruta — é overhead que você não percebeu que estava pagando.

Vazamentos viram problemas de confiabilidade quando interagem com retries e cadeias de dependência:

Use isto para checar antes de comprar mais capacidade:

Se os sintomas se concentram em uma dependência (BD, cache, rede) e não respondem previsivelmente a “mais servidores”, é um forte indicador de que você precisa olhar abaixo da abstração.

ORMs são ótimos para remover boilerplate, mas também facilitam esquecer que todo objeto vira uma query SQL. Em pequena escala, essa troca é invisível. Em volumes maiores, o banco costuma ser o primeiro lugar onde uma abstração “limpa” começa a cobrar juros.

N+1 acontece quando você carrega uma lista de registros pai (1 query) e então, dentro de um loop, carrega registros relacionados para cada pai (N queries adicionais). Em testes locais parece ok — talvez N seja 20. Em produção, N vira 2.000, e seu app transforma silenciosamente uma requisição em milhares de round trips.

O complicado é que nada “quebra” imediatamente; a latência aumenta gradualmente, pools de conexão enchem e retries multiplicam a carga.

Abstrações frequentemente encorajam buscar objetos completos por padrão, mesmo quando você precisa de dois campos. Isso aumenta I/O, memória e transferência de rede.

Ao mesmo tempo, ORMs podem gerar queries que pulam índices que você supôs estarem sendo usados (ou que nunca existiram). Um índice faltante pode transformar uma lookup seletiva em um full table scan.

Joins são outro custo oculto: o que parece “incluir a relação” pode virar uma query com múltiplos joins e grandes resultados intermediários.

Sob carga, conexões de banco são recurso escasso. Se cada requisição se espalha em múltiplas queries, o pool atinge o limite rapidamente e seu app começa a enfileirar.

Transações longas (às vezes acidentais) também causam contenção — locks duram mais e a concorrência colapsa.

Concorrência é onde abstrações podem parecer “seguras” no desenvolvimento e então falhar estridentemente sob carga. O modelo padrão do framework frequentemente oculta a restrição real: você não está só servindo requests — está gerenciando contenção por CPU, threads, sockets e capacidade downstream.

Thread-per-request (comum em stacks web clássicas) é simples: cada request ganha uma thread de trabalho. Isso quebra quando I/O lento (BD, chamadas a APIs) faz threads se acumular. Quando o pool de threads se esgota, novas requisições enfileiram, latência dispara e eventualmente você atinge timeouts — enquanto o servidor está “ocupado” apenas esperando.

Modelos async/event-loop lidam com muitas requisições simultâneas com menos threads, então são ótimos em alta concorrência. Eles quebram de forma diferente: uma chamada bloqueante (uma biblioteca síncrona, parsing pesado de JSON, logging custoso) pode travar o loop de eventos, transformando “uma requisição lenta” em “tudo lento”. Async também facilita criar demais concorrência, sobrecarregando uma dependência mais rápido do que limites de threads fariam.

Backpressure é o sistema dizendo aos chamadores “diminua; não consigo aceitar mais”. Sem ele, uma dependência lenta não apenas atrasa respostas — ela aumenta o trabalho em voo, uso de memória e o comprimento de filas. Esse trabalho extra torna a dependência ainda mais lenta, criando loop de feedback.

Timeouts devem ser explícitos e em camadas: cliente, serviço e dependência. Se os timeouts são muito longos, filas crescem e a recuperação demora. Se retries são automáticos e agressivos, você pode provocar uma tempestade de retry: uma dependência fica lenta, chamadas dão timeout, chamadores re-tentam, a carga se multiplica e a dependência colapsa.

Uma abstração vazando é uma camada que tenta esconder complexidade (ORMs, helpers de retry, wrappers de cache, middlewares), mas sob carga os detalhes ocultos começam a alterar os resultados.

Na prática, é quando seu “modelo mental simples” deixa de prever o comportamento real, e você precisa entender coisas como planos de consulta, pools de conexão, profundidade de filas, GC, timeouts e retries.

Sistemas iniciais têm capacidade sobrando: tabelas pequenas, baixa concorrência, caches quentes e poucas interações de falha.

À medida que o volume cresce, pequenas sobrecargas tornam-se gargalos constantes, e casos raros (timeouts, falhas parciais) tornam-se comuns. É aí que os custos e limites ocultos da abstração aparecem em produção.

Procure padrões que não melhoram previsivelmente ao adicionar recursos:

O subdimensionamento costuma melhorar aproximadamente de forma linear quando você adiciona capacidade.

Um vazamento costuma mostrar:

Use a lista de verificação do post: se dobrar recursos não resolver proporcionalmente, suspeite de vazamento.

ORMs escondem que cada operação em um objeto vira SQL. Vazamentos comuns:

Comece mitigando com eager loading quando necessário, selecionando apenas colunas necessárias, paginação, batching e validando SQL gerado com EXPLAIN.

Pools de conexão limitam concorrência para proteger o BD, mas a proliferação oculta de queries pode esgotar o pool.

Quando o pool enche, requests enfileiram no app, aumentando latência e prendendo recursos por mais tempo. Transações longas pioram ao manter locks e reduzir a concorrência efetiva.

Correções práticas:

Thread-per-request quebra por esgotamento de threads quando I/O é lento; tudo enfileira e timeouts disparam.

Async/event-loop falha quando:

Em ambos os casos, a abstração “o framework cuida da concorrência” vaza em limites explícitos, timeouts e backpressure.

Backpressure é o mecanismo que diz “diminua a velocidade” quando um componente não pode aceitar mais trabalho com segurança.

Sem ele, dependências lentas aumentam o número de requisições em voo, uso de memória e comprimento de filas—o que torna a dependência ainda mais lenta (loop de feedback).

Ferramentas comuns:

Retries automáticos podem transformar uma lentidão em colapso:

Mitigue com:

Instrumentação faz trabalho real em alto tráfego:

user_id, email, order_id) explodem séries temporais e custosControles práticos: