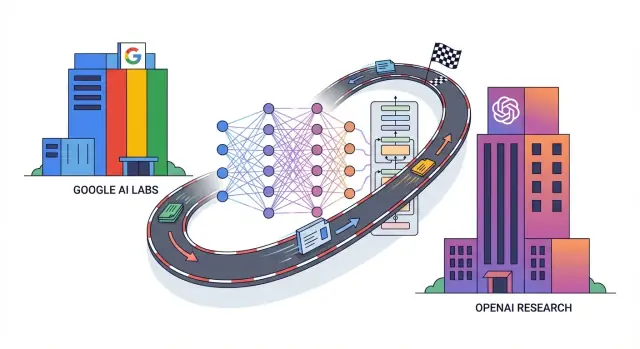

Visão geral: como o Google impulsionou o GPT mas perdeu o holofote

O Google não “perdeu” a IA tanto quanto inventou grande parte do que tornou a onda atual possível — e depois deixou outra organização transformar isso no produto definidor.

Pesquisadores do Google criaram a arquitetura Transformer, a ideia central por trás dos modelos GPT. Aquele paper de 2017, “Attention Is All You Need”, mostrou como treinar modelos muito grandes que entendem e geram linguagem com notável fluência. Sem esse trabalho, o GPT como o conhecemos não existiria.

A conquista da OpenAI não foi um algoritmo mágico novo. Foi um conjunto de escolhas estratégicas: escalar Transformers muito além do que a maioria julgava prático, acompanhá‑los com treinos enormes e empacotar o resultado como APIs fáceis de usar e, eventualmente, o ChatGPT — um produto de consumo que tornou a IA tangível para centenas de milhões de pessoas.

Este artigo trata dessas escolhas e trade‑offs, não de dramas secretos ou heróis e vilões pessoais. Traça como a cultura de pesquisa e o modelo de negócios do Google o levaram a favorecer modelos tipo BERT e melhorias incrementais na busca, enquanto a OpenAI perseguiu uma aposta muito mais arriscada em sistemas gerativos de propósito geral.

Cobriremos:

- Como o Google construiu domínio inicial em IA e uma organização de pesquisa de classe mundial

- Por que o paper do Transformer foi um marco — e o que ele realmente mudou

- Como a OpenAI transformou essa fundação em GPT e ChatGPT

- As estratégias divergentes: BERT e busca no Google vs GPT escalado e APIs na OpenAI

- O “momento ChatGPT”, quando a OpenAI superou o Google publicamente

- Diferenças culturais e de incentivos que moldaram ambas as empresas

- O reset do Google com Bard e Gemini

- Lições concretas para construtores que não querem repetir o erro do Google

Se você se interessa por estratégia de IA — como pesquisa vira produto, e produto vira vantagem duradoura — esta história é um estudo de caso sobre o que importa mais do que ter o melhor paper: fazer apostas claras e ter coragem para lançar.

Domínio inicial do Google em IA e cultura de pesquisa

O Google entrou no aprendizado de máquina moderno com duas enormes vantagens estruturais: dados em escala inimaginável e uma cultura de engenharia já otimizada para grandes sistemas distribuídos. Quando converteu essa máquina para IA, rapidamente se tornou o centro gravitacional do campo.

Do Google Brain ao DeepMind

O Google Brain começou como um projeto paralelo por volta de 2011–2012, liderado por Jeff Dean, Andrew Ng e Greg Corrado. A equipe focou em deep learning em larga escala, usando os data centers do Google para treinar modelos fora do alcance da maioria das universidades.

O DeepMind foi adquirido em 2014. Enquanto o Google Brain vivia mais próximo de produtos e infraestrutura, o DeepMind inclinou‑se para pesquisa de longo horizonte: reinforcement learning, jogos e sistemas de aprendizagem de propósito geral.

Juntos, deram ao Google uma sala de máquinas de IA sem paralelo: um grupo embutido na pilha de produção do Google e outro perseguindo pesquisas audaciosas.

Marcos que sinalizaram domínio em IA

Vários marcos públicos cimentaram o status do Google:

- Avanços em ImageNet: Embora a vitória original de 2012 (AlexNet) tenha vindo da Universidade de Toronto, o Google rapidamente contratou muitos pesquisadores líderes e impulsionou o estado da arte com modelos como o Inception. Benchmarks de visão tornaram‑se vitrines para a escala e as ferramentas do Google.

- AlphaGo e sucessores: O AlphaGo do DeepMind derrotando Lee Sedol em 2016, seguido por AlphaGo Zero e AlphaZero, demonstrou que reinforcement learning poderia dominar domínios complexos com intervenção humana mínima.

- Retórica “AI‑first”: Por volta de 2016–2017, Sundar Pichai começou a chamar o Google de “empresa AI‑first”. A IA passou a alimentar Search, Ads, recomendações do YouTube, Photos, Maps e Android — tocando bilhões de usuários, mesmo que a maioria nunca visse os modelos diretamente.

Essas vitórias convenceram muitos pesquisadores de que, se quisessem trabalhar nos problemas de IA mais ambiciosos, iam para o Google ou DeepMind.

Densidade de talento como motor de inovação

O Google concentrou uma parcela extraordinária do talento mundial em IA. Vencedores do Turing Prize como Geoffrey Hinton e figuras seniores como Jeff Dean, Ilya Sutskever (antes de sair para a OpenAI), Quoc Le, Oriol Vinyals, Demis Hassabis e David Silver trabalharam em poucos orgs e prédios.

Essa densidade criou ciclos de feedback poderosos:

- Novas ideias se espalhavam rapidamente por seminários internos, mailing lists e código compartilhado.

- Equipes podiam formar‑se ad hoc para atacar problemas difíceis, sabendo que a expertise necessária estava a um ping interno de distância.

- Pesquisadores se beneficiavam de infraestrutura de grau de produção — pipelines de dados, sistemas de treino distribuído e hardware especializado — sem precisar construir tudo do zero.

Essa combinação de talento de elite e investimento pesado em infraestrutura fez do Google o local onde muitas pesquisas de ponta em IA se originaram.

A cultura de IA do Google inclinava‑se fortemente para publicação e construção de plataformas em vez de produtos de consumo polidos.

No lado de pesquisa, a norma era:

- Publicar em conferências como NeurIPS, ICML e ICLR.

- Open‑source de ferramentas (por exemplo, TensorFlow) que refletiam sistemas internos.

- Lançar papers influentes sobre visão, modelagem de sequência, reinforcement learning e treinamento em larga escala.

No lado da engenharia, o Google investiu pesadamente em infraestrutura:

- TPUs (Tensor Processing Units) customizadas para cargas de trabalho de redes neurais.

- Stacks sofisticados de treino e serving inspirados por sistemas internos como o Borg.

- Plataformas de dados e experimentação que facilitavam estudos enormes em tráfego real.

Essas escolhas estavam bem alinhadas com os negócios centrais do Google. Modelos melhores e ferramentas melhoravam diretamente a relevância na Busca, a segmentação de anúncios e as recomendações. A IA foi tratada como uma camada de capacidade geral em vez de uma categoria de produto autônoma.

O resultado foi uma empresa que dominou a ciência e a infraestrutura da IA, integrou‑a profundamente em serviços existentes e transmitiu seu progresso por meio de pesquisa influente — ao mesmo tempo em que mantinha cautela na construção de experiências de IA voltadas ao consumidor.

Em 2017, uma pequena equipe do Google Brain e da Google Research publicou silenciosamente um paper que revirou todo o campo: “Attention Is All You Need” por Ashish Vaswani, Noam Shazeer, Niki Parmar, Jakob Uszkoreit, Llion Jones, Aidan Gomez, Łukasz Kaiser e Illia Polosukhin.

A ideia central era simples mas radical: dava para abandonar recorrência e convoluções e construir modelos de sequência usando apenas atenção. Essa arquitetura foi chamada de Transformer.

Antes dos Transformers, os sistemas de linguagem de ponta eram baseados em RNNs e LSTMs. Tinham dois problemas principais:

- Gargalo sequencial: RNNs processam tokens um a um, então treino e inferência são difíceis de paralelizar. GPUs ficam ociosas esperando o passo anterior terminar.

- Dependências de longo alcance: À medida que sequências crescem, fica mais difícil para RNNs lembrar informações de muitos passos atrás, mesmo com LSTMs e camadas de atenção adicionadas.

O Transformer resolveu ambos:

- Self‑attention permite que cada token “veja” diretamente todos os outros tokens na sequência, em uma única camada.

- O modelo processa todos os tokens em paralelo, transformando o treino em um problema favorável a GPUs, baseado em multiplicações de matrizes.

- Multi‑head attention permite que o modelo aprenda diferentes “visões” do contexto (sintaxe, correferência, tópico etc.) simultaneamente.

Informação de posição é adicionada via codificações posicionais, de modo que o modelo sabe a ordem sem precisar de recorrência.

Por que isso desbloqueou modelos escaláveis e multimodais

Como todas as operações são paralelizáveis e baseadas em multiplicações densas de matrizes, os Transformers escalam bem com mais dados e compute. Essa propriedade de escala é exatamente no que GPT, Gemini e outros modelos de ponta se apoiam.

A mesma mecânica de atenção também se generaliza além do texto: dá para aplicar Transformers a patches de imagem, frames de áudio, tokens de vídeo e mais. Isso fez da arquitetura uma base natural para modelos multimodais que leem, veem e ouvem com um backbone unificado.

Publicação aberta e o caminho para o GPT

Crucialmente, o Google publicou o paper abertamente e (por meio de trabalhos subsequentes e bibliotecas como Tensor2Tensor) tornou a arquitetura fácil de reproduzir. Pesquisadores e startups do mundo todo puderam ler os detalhes, copiar o design e escalá‑lo.

A OpenAI fez exatamente isso. O GPT‑1 é, arquitetonicamente, um stack decoder Transformer com o objetivo de modelagem de linguagem. O ancestral técnico direto do GPT é o Transformer do Google: mesmos blocos de self‑attention, mesmas codificações posicionais, mesma aposta na escala — apenas aplicado em contexto de produto e organização diferentes.

Quando a OpenAI lançou o GPT, não estava inventando um novo paradigma do zero. Estava pegando o blueprint do Transformer do Google e levando‑o além do que a maioria dos grupos de pesquisa estava disposta — ou capaz — de ir.

O GPT original (2018) era essencialmente um decoder Transformer treinado com um objetivo simples: prever o próximo token em longos trechos de texto. Essa ideia vem diretamente da arquitetura Transformer de 2017, mas onde o Google focou em benchmarks de tradução, a OpenAI tratou a “previsão da próxima palavra em escala” como base para um gerador de texto de propósito geral.

O GPT‑2 (2019) escalou a mesma receita para 1,5B de parâmetros e um corpus web muito maior. O GPT‑3 (2020) saltou para 175B de parâmetros, treinado em trilhões de tokens usando clusters massivos de GPU. O GPT‑4 estendeu o padrão novamente: mais parâmetros, mais dados, melhor curadoria e mais compute, embrulhados em camadas de segurança e RLHF para moldar o comportamento em algo conversacional e útil.

Ao longo dessa progressão, o núcleo algorítmico permaneceu próximo ao Transformer do Google: blocos de self‑attention, codificações posicionais e camadas empilhadas. O salto foi na pura escala e na engenharia implacável.

Escalar como estratégia, não apenas experimento de pesquisa

Onde os modelos iniciais de linguagem do Google (como o BERT) miravam tarefas de compreensão — classificação, ranking de busca, question answering — a OpenAI otimizou para geração aberta e diálogo. O Google publicava modelos de ponta e seguia adiante com o próximo paper. A OpenAI transformou uma única ideia numa pipeline de produto.

Pesquisas abertas do Google, DeepMind e laboratórios acadêmicos alimentaram diretamente o GPT: variantes de Transformer, truques de otimização, schedules de learning rate, leis de escala e tokenização melhor. A OpenAI absorveu esses resultados públicos e investiu pesado em treinos proprietários e infraestrutura.

O brilho intelectual — Transformers — veio do Google. A decisão de apostar a organização em escalar essa ideia, entregar uma API e depois um chat consumidor foi da OpenAI.

Por que o Google priorizou BERT e busca em vez de produtos estilo GPT

Construa e ganhe créditos

Compartilhe no Koder.ai e ganhe créditos para continuar entregando mais rápido.

O sucesso comercial inicial do Google com deep learning veio de tornar sua máquina de dinheiro — busca e anúncios — mais inteligente. Esse contexto moldou como avaliou novas arquiteturas como o Transformer. Em vez de correr para construir geradores de texto de uso livre, o Google reforçou modelos que tornavam ranking, relevância e qualidade melhores. BERT foi o ajuste perfeito.

BERT (Bidirectional Encoder Representations from Transformers) é um modelo apenas‑encoder treinado com masked language modeling: partes de uma frase são escondidas, e o modelo deve inferir os tokens faltantes usando todo o contexto dos dois lados.

Esse objetivo de treino alinhava‑se quase perfeitamente com os problemas do Google:

- Entendimento de consulta: Consultas de busca são curtas, confusas e ambíguas. O contexto bidirecional do BERT permitiu interpretar consultas com muito mais nuance.

- Entendimento de documentos: Rankear bilhões de páginas requer similaridade semântica fina. Embeddings BERT ajudaram a ligar consultas a passagens específicas, não apenas a documentos inteiros.

- Qualidade e detecção de spam: Um masked LM é naturalmente bom em detectar texto que “não pertence”, útil para filtrar conteúdo lixo.

Criticamente, modelos encoder se encaixavam bem na pilha de recuperação e ranking existente do Google. Podiam ser chamados como sinais de relevância ao lado de centenas de outras features, melhorando a busca sem reescrever todo o produto.

Por que masked language modeling fazia sentido para o negócio do Google

O Google precisava de respostas que fossem confiáveis, verificáveis e monetizáveis:

- Confiáveis: Resultados de busca devem estar ancorados em páginas reais e fontes. Masked LM treina o modelo para entender linguagem, não para inventar longas respostas.

- Verificáveis: Cada resultado liga a um publisher. Isso sustenta o ecossistema da web e dá aos usuários uma forma de checar informações.

- Monetizáveis: Anúncios de busca se encaixam naturalmente em torno de uma lista ranqueada de links. Melhor relevância significa melhores taxas de clique e maior valor por consulta.

BERT melhorou tudo isso sem perturbar a UI comprovada da busca ou o modelo de anúncios. Modelos autoregressivos estilo GPT, por outro lado, ofereciam um valor incremental menos óbvio para o negócio existente.

A geração livre levantou preocupações internas agudas:

- Desinformação e alucinações: Modelos gerativos inventam fatos com confiança. Para uma empresa frequentemente tratada como autoridade, isso é risco direto à marca.

- Conteúdo nocivo: Geração sem filtros pode produzir texto tóxico, enviesado ou perigoso. Implantar isso em escala convida críticas públicas e pressão regulatória.

- Exposição regulatória: Com antitruste e regulação de conteúdo aquecendo, lançar um chatbot global e de alto alcance parecia uma tentação arriscada.

A maioria dos casos de uso aprovados internamente eram assistivos e limitados: autocompletar no Gmail, respostas inteligentes, tradução e boosts de ranking. Modelos encoder eram mais fáceis de limitar, monitorar e justificar do que um sistema conversacional aberto.

Medo da canibalização: não matar a galinha dos ovos de ouro

Mesmo quando o Google tinha protótipos conversacionais funcionando, uma questão central permanecia: Uma ótima resposta direta reduziria consultas e cliques em anúncios?

Uma experiência de chat que dá uma resposta completa de uma vez muda o comportamento do usuário:

- Menos cliques para sites externos → editores insatisfeitos, ecossistema web enfraquecido

- Menos espaço e intenção para anúncios tradicionais → incerteza na receita

O instinto da liderança era integrar a IA como um melhorador da busca, não como substituta. Isso significou tweaks de ranking, rich snippets e entendimento semântico gradual — exatamente onde BERT brilhava — em vez de um produto conversacional ousado que poderia ameaçar o modelo de monetização.

Como essas escolhas desaceleraram produtos gerativos voltados ao público

Individualmente, cada decisão era racional:

- Favorecer modelos que melhorassem métricas de busca e anúncios

- Priorizar segurança, confiabilidade e cautela regulatória

- Proteger a experiência de busca e a monetização

Coletivamente, significaram que o Google subinvestiu na productização de geração autoregressiva pública. Times de pesquisa exploraram grandes modelos decoder e sistemas de diálogo, mas times de produto tinham incentivos fracos para lançar um chatbot que:

- Não melhorava claramente KPIs de busca

- Ameaçava receita de anúncios e relações com publishers

- Introduzia riscos substanciais de segurança e PR

A OpenAI, sem um império de busca a proteger, fez a aposta oposta: que uma interface de chat altamente capaz e abertamente acessível — mesmo com imperfeições — criaria nova demanda em escala massiva. O foco do Google em BERT e alinhamento com a busca atrasou seu movimento em direção a ferramentas gerativas ao público, preparando o terreno para que o ChatGPT definisse a categoria primeiro.

A aposta da OpenAI em escala, APIs e chat para consumidores

De laboratório de pesquisa a empresa de lucro limitado

A OpenAI começou em 2015 como um laboratório sem fins lucrativos de pesquisa, financiado por alguns fundadores de tecnologia que viam a IA como oportunidade e risco. Nos primeiros anos, parecia semelhante ao Google Brain ou DeepMind: publicar artigos, liberar código e empurrar a ciência adiante.

Em 2019, a liderança percebeu que modelos de fronteira exigiriam bilhões de dólares em compute e engenharia. Um non‑profit puro teria dificuldade para levantar esse capital. A solução foi uma inovação estrutural: OpenAI LP, uma empresa de “lucro limitado” sob o non‑profit.

Investidores podiam agora obter retorno (até um limite), enquanto o conselho mantinha um foco na missão de AGI amplamente benéfica. Essa estrutura permitiu fechar grandes financiamentos e acordos de compute sem virar uma startup convencional.

Escala como hipótese central

Enquanto muitos laboratórios otimizavam por arquiteturas engenhosas ou sistemas especializados, a OpenAI fez uma aposta direta: modelos de linguagem gerais e extremamente grandes poderiam ser surpreendentemente capazes se você simplesmente continuasse a escalar dados, parâmetros e compute.

GPT‑1, GPT‑2 e GPT‑3 seguiram uma fórmula simples: arquitetura Transformer em grande parte padrão, só maior, treinado por mais tempo e com texto mais diverso. Em vez de moldar modelos para cada tarefa, apostaram no “um grande modelo, muitos usos” via prompting e fine‑tuning.

Isso não era só uma postura de pesquisa. Era uma estratégia de negócio: se uma API pudesse atender milhares de casos — de ferramentas de copywriting a assistentes de programação — a OpenAI poderia virar plataforma, não apenas laboratório.

A API do GPT‑3, lançada em 2020, concretizou essa estratégia. Em vez de focar em software on‑premise pesado ou produtos empresariais restritos, a OpenAI expôs uma API simples em nuvem:

- Envie texto, receba saída do modelo.

- Pague por token.

- Construa o que quiser por cima.

Essa abordagem “API‑first” permitiu que startups e empresas cuidassem da experiência do usuário, conformidade e expertise de domínio, enquanto a OpenAI focava em treinar modelos cada vez maiores e melhorar alinhamento.

A API também criou um motor de receita claro cedo. Em vez de esperar por produtos perfeitos, a OpenAI deixou o ecossistema descobrir casos de uso e efetivamente fazer P&D de produto por conta própria.

Disposição para lançar produtos imperfeitos

A OpenAI consistentemente escolheu lançar antes dos modelos estarem polidos. O GPT‑2 foi lançado com preocupações de segurança e liberação em etapas; o GPT‑3 entrou no mundo via beta controlado com falhas óbvias — alucinações, vieses, inconsistência.

A expressão mais clara dessa filosofia foi o ChatGPT no fim de 2022. Não era o modelo tecnicamente mais avançado que a OpenAI tinha, nem particularmente refinado. Mas oferecia:

- Uma interface de chat simples que quase qualquer pessoa entendia.

- Acesso gratuito inicial, convidando experimentação massiva.

- Um ciclo de iteração rápido baseado em conversas reais de usuários.

Em vez de afinar o modelo indefinidamente em privado, a OpenAI tratou o público como uma enorme máquina de feedback. Guardrails, moderação e UX evoluíram semana a semana, impulsionados pelo comportamento observado.

A aposta da OpenAI em escala exigia orçamentos enormes de compute. A parceria com a Microsoft foi decisiva.

Desde 2019 e aprofundando nos anos seguintes, a Microsoft forneceu:

- Investimentos multibilionários na OpenAI LP.

- Hospedagem em nuvem exclusiva no Azure para os modelos da OpenAI.

- Go‑to‑market conjunto via produtos como Bing Chat e Copilot.

Para a OpenAI, isso resolveu uma limitação central: escalar treinos em supercomputadores dedicados sem construir ou financiar sua própria nuvem.

Para a Microsoft, foi uma forma de diferenciar o Azure e infundir IA no Office, GitHub, Windows e Bing mais rapidamente do que construir tudo internamente.

O loop de feedback: usuários → dados → receita → modelos maiores

Todas essas escolhas — escala, API‑first, chat consumidor e o acordo com Microsoft — alimentaram um loop reforçador:

- Modelos melhores atraíam desenvolvedores e usuários.

- APIs e ChatGPT facilitavam integração e experimentação.

- Uso gerava receita, que financiava treinos maiores e melhor infraestrutura.

- Interações do mundo real produziam dados de alto valor para fine‑tuning e reinforcement learning from human feedback (P&D de alinhamento).

- Modelos aprimorados impulsionavam novas features (plugins, ferramentas, multimodalidade) que atraíam ainda mais usuários.

Em vez de otimizar por papers perfeitos ou pilotos internos cautelosos, a OpenAI otimizou por esse ciclo composto. Escalar não era só sobre modelos maiores; era sobre escalar usuários, dados e fluxo de caixa rápido o suficiente para continuar empurrando a fronteira.

O choque do ChatGPT: quando a OpenAI superou o Google

Quando a OpenAI lançou o ChatGPT em 30 de novembro de 2022, parecia uma prévia de pesquisa discreta: uma caixa de chat simples, sem paywall e um post curto no blog. Em cinco dias, passou de 1 milhão de usuários. Semanas depois, screenshots e casos de uso lotavam Twitter, TikTok e LinkedIn. Pessoas escreviam ensaios, depuravam código, redigiam e‑mails legais e faziam brainstorming com uma única ferramenta.

O produto não foi apresentado como “um demo de um modelo Transformer”. Era simplesmente: Pergunte qualquer coisa. Receba uma resposta. Essa clareza tornou a tecnologia instantaneamente legível para não especialistas.

Choque interno no Google

Dentro do Google, a reação foi mais de alarme que de admiração. A liderança declarou um “code red”. Larry Page e Sergey Brin foram puxados de volta para discussões de produto e estratégia. Times que trabalhavam em modelos conversacionais há anos de repente se viram sob intensa vigilância.

Engenheiros sabiam que o Google tinha sistemas aproximadamente comparáveis ao que alimentava o ChatGPT. Modelos como LaMDA, PaLM e o Meena já demonstravam conversação fluente e raciocínio em benchmarks internos. Mas viviam atrás de ferramentas restritas, revisões de segurança e aprovações complexas.

Externamente, parecia que o Google tinha sido pego de surpresa.

ChatGPT vs LaMDA: tecnologia similar, produto diferente

Em nível técnico, ChatGPT e a LaMDA do Google eram parentes: grandes modelos Transformer ajustados para diálogo. A lacuna não era principalmente arquitetural; era de decisão de produto.

OpenAI:

- Lançou uma interface única e limpa

- Aceitou a desordem pública e a iteração

- Investiu pesado em alinhamento e RLHF, aprendendo com milhões de conversas

Google:

- Manteve LaMDA atrás de demos restritos

- Otimizou para evitar riscos e proteger a reputação

- Teve dificuldade em transformar protótipos de pesquisa em produto voltado ao consumidor

Estreia apressada do Bard e erros públicos

Sob pressão para reagir, o Google anunciou o Bard em fevereiro de 2023. A demo tentou reproduzir a magia conversacional do ChatGPT.

Mas uma das respostas de destaque — sobre descobertas do James Webb Space Telescope — estava errada. O erro apareceu no material de marketing do Google, foi percebido em minutos e apagou bilhões do market cap da Alphabet em um dia. Reforçou a narrativa brutal: o Google estava atrasado, nervoso e descuidado, enquanto a OpenAI parecia confiante e preparada.

A ironia foi dolorosa para os Googlers. Alucinações e erros factuais já eram problemas conhecidos em grandes modelos de linguagem. A diferença foi que a OpenAI já havia normalizado isso na mente dos usuários com indícios claros, avisos e um enquadramento experimental. O Google, em contraste, envolveu o lançamento do Bard em branding polido de alto risco — e então tropeçou em um fato básico.

Velocidade, UX e narrativa: a vantagem de execução da OpenAI

A vantagem do ChatGPT sobre os sistemas internos do Google nunca foi só um modelo maior ou um algoritmo mais novo. Foi a velocidade de execução e a clareza da experiência.

OpenAI:

- Transformou uma linha de pesquisa em um produto viral único

- Abraçou a mentalidade de beta público: “experimente, quebre, nos conte”

- Projetou uma UX que mapeava diretamente para o que as pessoas já fazem com texto: perguntar, responder, iterar

O Google moveu‑se mais devagar, otimizou para zero erros e enquadrou o Bard como um lançamento brilhante em vez de uma fase de aprendizado. Quando o Bard chegou aos usuários, o ChatGPT já havia se tornado hábito diário para estudantes, trabalhadores do conhecimento e desenvolvedores.

O choque no Google não foi apenas que a OpenAI tinha boa IA. Foi que uma organização muito menor pegou ideias que o Google ajudou a inventar, empacotou‑as num produto que pessoas comuns adoraram e redefiniu a percepção pública de quem lidera a IA — tudo isso em semanas.

Cultura, incentivos e risco: Google versus OpenAI

Backend sem trabalho burocrático

Gere um backend em Go com PostgreSQL e foque nas decisões do produto, não no boilerplate.

Google e OpenAI partiram de fundamentos técnicos semelhantes, mas realidades organizacionais muito diferentes. Isso moldou quase todas as decisões em torno de sistemas estilo GPT.

Incentivos: máquina de dinheiro vs modo de sobrevivência

O negócio central do Google é busca e anúncios. Esse motor gera caixa enorme e previsível, e muitos incentivos seniores estão atrelados a protegê‑lo.

Lançar um modelo conversacional poderoso que pudesse:

- reduzir impressões de anúncios,

- responder perguntas sem busca,

- e alucinar de formas que prejudicam confiança,

era visto naturalmente como uma ameaça. O padrão foi cautela. Qualquer novo produto de IA precisava provar que não prejudicaria busca ou segurança da marca.

A OpenAI, em contraste, não tinha vaca leiteira. Seu incentivo era existencial: lançar modelos valiosos, conquistar desenvolvedores, fechar grandes acordos de compute e transformar pesquisa em receita antes que outros o fizessem. O risco de não lançar superava o risco de lançar cedo demais.

Cultura: tolerância a risco e sensibilidade de PR

O Google viveu com escrutínio antitruste, disputas de privacidade e regulação global. Isso criou uma cultura onde:

- PR, política e times legais têm forte poder de veto

- revisões de segurança são longas e multilaterais

- dano à reputação é tratado como risco de primeira ordem

A OpenAI aceitou que modelos poderosos seriam bagunçados em público. A empresa enfatizou iteração com guardrails sobre ciclos internos longos de perfeição. Ainda assim cautelosa, mas com muito mais tolerância a risco de produto.

Estrutura e velocidade: comitês vs concentração de poder

No Google, grandes lançamentos tipicamente passam por múltiplos comitês, sign‑offs cross‑org e negociações complexas de OKR. Isso retarda qualquer produto que corte transversais entre Search, Ads, Cloud e Android.

A OpenAI concentrou poder num pequeno grupo de liderança e numa equipe de produto focada. Decisões sobre ChatGPT, precificação e direção da API podiam ser tomadas rápido e ajustadas com base no uso real.

Quando apenas pesquisa deixou de ser suficiente

Por anos, a vantagem do Google repousou em publicar melhores papers e treinar modelos mais fortes. Mas quando outros puderam replicar a pesquisa, a vantagem mudou para pesquisa mais:

- design de produto

- experiência do desenvolvedor

- loops de feedback de dados

- velocidade de go‑to‑market

A OpenAI tratou modelos como substrato de produto: lance uma API, lance uma interface de chat, aprenda com usuários e alimente a próxima geração de modelos. O Google, em contrapartida, passou anos mantendo seus sistemas mais capazes como ferramentas internas ou demos restritos. Quando tentou productizá‑los em escala, a OpenAI já havia criado hábitos, expectativas e um ecossistema em torno do GPT.

A lacuna teve menos a ver com quem entendia transformers melhor e mais com quem estava disposto — e estruturalmente capaz — de transformar esse entendimento em produtos diante de centenas de milhões de pessoas.

Inovação técnica vs inovação de produto: quem fez o quê

Google: a máquina técnica

No aspecto técnico, o Google nunca deixou de ser potência. Liderou em infraestrutura: TPUs customizadas, networking avançado em datacenters e ferramentas internas que tornaram rotineiro treinar modelos massivos anos antes de a maioria tentar.

Pesquisadores do Google empurraram fronteiras em arquiteturas (Transformers, variantes de atenção, mixture‑of‑experts, modelos augmentados por recuperação), leis de escala e eficiência de treino. Muitos papers-chave que definem o ML em larga escala vieram do Google ou DeepMind.

Mas muita dessa inovação ficou em artigos, plataformas internas e features pontuais em Search, Ads e Workspace. Em vez de um produto AI claro, os usuários viram dezenas de melhorias pequenas e desconexas.

A OpenAI escolheu um caminho diferente. Tecnicamente, ela se apoiou em ideias publicadas por outros, incluindo o Google. Sua vantagem foi transformar essas ideias numa linha de produtos clara:

- Uma experiência carro‑chefe: ChatGPT, com caso de uso óbvio e sem setup.

- Uma plataforma principal: a API, com endpoints estáveis e precificação previsível.

- Uma história para desenvolvedores: docs bons, exemplos e um modelo mental simples — “chame o modelo como uma função”.

Esse empacotamento unificado transformou capacidade bruta em algo que as pessoas podiam adotar da noite para o dia. Enquanto o Google distribuía modelos poderosos sob várias marcas e superfícies, a OpenAI concentrou atenção em poucos nomes e fluxos.

Distribuição vence vantagem técnica pura

Depois que o ChatGPT decolou, a OpenAI ganhou algo que antes era do Google: mindshare default. Desenvolvedores experimentavam primeiro na OpenAI, escreviam tutoriais contra sua API e propunham investidores em produtos “construídos sobre GPT”.

A diferença de qualidade subjacente — se existia — importou menos que a lacuna de distribuição. A vantagem técnica do Google em infraestrutura e pesquisa não se traduziu automaticamente em liderança de mercado.

A lição: ganhar a ciência não é suficiente. Sem produto claro, preço, história e caminho de integração, mesmo o motor de pesquisa mais forte pode ser ultrapassado por uma empresa focada em produto.

Após o chamado de atenção: Bard, Gemini e o reset de IA do Google

Teste a ideia rapidamente

Prototipe a experiência do usuário rapidamente para testar a ideia antes de complicar.

Quando o ChatGPT expôs o atraso do Google em execução de produto, a empresa acionou um “code red” público. O que se seguiu foi um reset acelerado, às vezes confuso, mas genuíno da estratégia de IA do Google.

Do Bard ao Gemini: admitir o reset

A primeira resposta do Google foi o Bard, uma interface de chat construída sobre a LaMDA e depois atualizada para PaLM 2. O Bard parecia apressado e cauteloso ao mesmo tempo: acesso limitado, rollout lento e restrições claras de produto.

O reset real chegou com o Gemini:

- Gemini Ultra, Pro, Nano como família coerente de modelos para nuvem, consumidor e uso on‑device

- Bard rebatizado como Gemini (e Gemini Advanced) para sinalizar uma ruptura limpa com a era experimental

- Compromisso público de tornar o Gemini a marca central de IA em produtos Google

Essa mudança reposicionou o Google de “empresa de busca experimentando chatbots” para “plataforma AI‑first com família de modelos carro‑chefe”, mesmo que isso viesse depois da vantagem de marca da OpenAI.

Tecendo o Gemini nos produtos centrais do Google

A força do Google é a distribuição, então o reset focou em integrar o Gemini onde os usuários já estão:

- Search: Search Generative Experience e AI Overviews que respondem queries diretamente, não só linkam páginas

- Workspace: assistentes Gemini para Gmail, Docs, Sheets, Slides e Meet que redigem, resumem e analisam conteúdo

- Android: Gemini como assistente de sistema, input multimodal e modelos Nano on‑device para tarefas sensíveis à privacidade

- Chrome: ajuda à redação, organização de abas e recursos para desenvolvedores dentro do navegador

A estratégia: se a OpenAI vence em “novidade” e marca, o Google pode vencer em presença padrão e integração profunda com fluxos de trabalho diários.

Segurança, governança e exposição medida

Ao ampliar o acesso, o Google apoiou‑se fortemente em seus Princípios de IA e postura de segurança:

- Extenso red‑teaming e avaliação antes de liberar modelos de maior capacidade

- Rollouts por região, com recursos limitados por idade e tipo de conta

- Investimentos em pesquisa de alinhamento, filtros de conteúdo e comportamentos de recusa

- Trabalhos de watermarking e proveniência (por exemplo, SynthID para imagens e mídia)

O trade‑off: guardrails mais fortes e experimentação mais lenta versus iteração rápida e eventuais tropeços públicos da OpenAI.

O Google alcançou de fato a OpenAI?

Em qualidade pura de modelo, Gemini Advanced e os modelos de topo do Gemini parecem competitivos com o GPT‑4 em muitos benchmarks e relatos de desenvolvedores. Em algumas tarefas multimodais e de programação, o Gemini até lidera; em outras, o GPT‑4 (e sucessores) ainda dão o tom.

Onde o Google ainda fica atrás é em mindshare e ecossistema:

- A OpenAI permanece escolha padrão para muitos startups e pesquisadores

- A marca “ChatGPT” é sinônima de IA para usuários leigos

- A API e o ecossistema de plugins/ferramentas da OpenAI amadureceram antes

O contrapeso do Google é a distribuição massiva (Search, Android, Chrome, Workspace) e infra profunda. Se conseguir converter isso em experiências AI‑nativas agradáveis mais rápido, pode reduzir ou até reverter a lacuna de percepção.

Futuro multipolar, não corrida de dois cavalos

O reset acontece num campo que já não é só Google vs OpenAI:

- OpenAI: mindshare consumidor, iteração rápida, ecossistema de desenvolvedores forte

- Google: infraestrutura, dados, distribuição e Gemini integrado a produtos

- Open source (Meta Llama, Mistral e outros): rápido, barato e suficientemente bom para muitos casos

- Anthropic e outros: diferenciação em torno de segurança, confiabilidade e verticais específicas

O Google, tarde porém sério no reset, não está mais “perdendo” o momento gerativo. Mas o futuro é multipolar: nenhum único vencedor e nenhuma empresa controlando a direção da inovação de modelos ou produtos.

Para construtores, isso significa desenhar estratégias supondo vários provedores fortes, modelos abertos poderosos e salto constante de capacidades — em vez de apostar tudo numa única pilha ou marca de IA.

Lições-chave para construtores: como não repetir o erro do Google

O Google provou que você pode inventar o avanço e ainda assim perder a primeira onda de valor. Para construtores, a ideia não é admirar o paradoxo, mas evitá‑lo.

1. Lance produtos, não apenas artigos

Trate cada resultado de pesquisa importante como uma hipótese de produto, não como um fim.

- Coloque um dono de produto diretamente responsável por cada grande avanço.

- Em semanas, defina um problema de usuário concreto e uma experiência v1, por mais estreita que seja.

- Estabeleça um prazo cujo resultado padrão seja: lançar para usuários reais, mesmo que só 1.000.

Se um resultado é importante o suficiente para publicar, é importante o suficiente para prototipar para clientes.

As pessoas fazem o que é recompensado.

- Faça promoções e prestígio dependerem do impacto lançado, não só de citações, patentes ou demos internas.

- Celebre times cross‑funcionais (pesquisa, engenharia, produto, jurídico) que movem uma ideia arriscada para produção.

- Dê líderes com foco único autoridade sobre experimentação e lançamento, para que decisões não morram em comitês.

3. Faça apostas explícitas em novos primitivos

Transformers foram um novo primitivo de computação. O Google tratou‑os mais como atualização de infraestrutura; a OpenAI como motor de produtos.

Quando você encontra uma ideia igualmente profunda:

- Nomeie 1–2 produtos carro‑chefe que irão explorar esse primitivo ao limite.

- Reserve equipe e orçamento por 12–24 meses.

- Aceite sobreposição e até competição interna com produtos legados quando o upside for enorme.

Preocupações de marca e segurança são válidas, mas usá‑las para justificar atrasos infinitos não é.

Crie um modelo de risco em camadas:

- Casos de alto risco (saúde, finanças, eleições) recebem portões rígidos.

- Experimentos de baixo risco, claramente rotulados, podem ser lançados cedo com monitoramento cuidadoso e kill switches.

Em vez de esperar por certeza, projete para exposição controlada: rollout progressivo, logging forte, caminhos rápidos de reversão, red‑teaming e comunicação pública de que ainda se está aprendendo.

O Google disponibilizou ideias e ferramentas poderosas e depois observou outros construírem os produtos icônicos.

Quando você expõe uma capacidade poderosa:

- Construa um produto de referência que mostre o teto do que é possível.

- Ofereça APIs cedo, mas mantenha uma experiência de primeira‑parte que você itere sem trégua.

- Trate desenvolvedores externos como parceiros que estendem sua plataforma, não como os únicos que descobrirão o que usuários querem.

6. Institucionalize o caminho “do paper ao produto”

Você não pode depender de um executivo visionário ou um time heróico.

Incorpore a transição no funcionamento da empresa:

- Padronize um pipeline: ideia → demo interna → piloto externo limitado → lançamento geral.

- Crie um grupo dedicado cuja única função é transformar outputs de pesquisa em produtos ou APIs.

- Roteie pesquisadores seniores para papéis de liderança de produto para que quem entende a capacidade também possua sua aplicação.

O maior erro do Google não foi não prever a IA; foi subestimar o que suas próprias invenções poderiam se tornar nas mãos dos consumidores.

Para fundadores, PMs e executivos, a mentalidade prática é:

- Presuma que seu avanço tem mais superfície do que você vê de dentro do prédio.

- Coloque‑o diante de usuários cedo o suficiente para que mostrem usos surpreendentes e valiosos.

- Esteja disposto a pivotar o roadmap quando esses usos conflitarem com sua estratégia original.

Descobertas futuras — em modelos, interfaces ou primitivos de computação inteiramente novos — serão comercializadas por times dispostos a mover‑se de “descobrimos isso” para “somos totalmente responsáveis por lançar isto” muito rapidamente.

A lição do Google não é publicar menos ou esconder pesquisa. É parear descoberta de classe mundial com propriedade de produto igualmente ambiciosa, incentivos claros e viés para aprender em público. As organizações que fizerem isso dominarão a próxima onda, não apenas escreverão o paper que a inicia.