A maioria de nós escreve código esperando que ele seja legível, reutilizável e relativamente portátil. Nomeamos variáveis, chamamos bibliotecas e presumimos que nosso programa vai rodar em máquinas que nunca vimos. Essa expectativa não surgiu por acaso. É resultado de uma grande mudança em como humanos e computadores dividem o trabalho — e os compiladores são a ponte.

A pergunta central: o que mudou e por que isso importou?

Os primeiros programadores não "digitavam código" do jeito que pensamos hoje. Eles gerenciavam computadores em um nível tão detalhado e frágil que cada instrução parecia um trabalho artesanal. A questão chave é esta:

Como a programação passou de um ofício específico de hardware para uma prática centrada no humano que equipes conseguem manter ao longo do tempo?

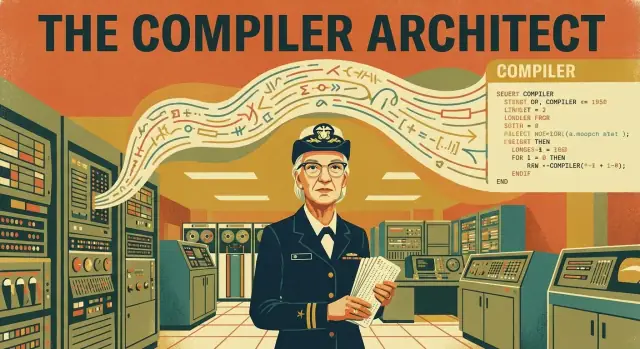

O papel de Hopper: fazer a máquina se adaptar ao humano

Grace Hopper é central nessa mudança porque ela defendeu uma ideia radical para sua época: o computador deveria fazer mais da tradução. Em vez de forçar pessoas a escrever longas e propensas a erro sequências adaptadas a uma máquina só, Hopper ajudou a pioneirar trabalhos iniciais de compilador — sistemas que podiam transformar instruções mais amigáveis em passos de baixo nível que a máquina realmente executa.

O trabalho dela ajudou a provar que "tradução" não era luxo. Era um avanço de produtividade. Quando você consegue expressar intenção com mais clareza, você pode:

- escrever programas mais rápido,

- detectar erros mais facilmente,

- compartilhar código com outras pessoas,

- e atualizar software sem reescrever tudo do zero.

O que você vai aprender neste artigo

Vamos percorrer como era a programação antes dos compiladores, o que um compilador realmente faz (sem jargões), e como o trabalho A-0 de Hopper e a ascensão do COBOL empurraram o software para linguagens legíveis e padronizadas. Ao longo do caminho, você verá consequências práticas que ainda moldam o desenvolvimento moderno: portabilidade, trabalho em equipe, manutenção de longo prazo e a suposição cotidiana de que o código deve ser compreendido por humanos — não apenas pela máquina.

Se você já se beneficiou de mensagens de erro claras, código portátil ou de uma linguagem pensada para ser lida como instruções, você vive no mundo que Hopper ajudou a construir.

Programação antes dos compiladores: do jeito difícil

Grace Hopper não começou tentando tornar a programação “mais fácil”. Ela começou onde a computação inicial exigia que se começasse: pelos limites da máquina. Formada em matemática, ela entrou na Marinha dos EUA durante a Segunda Guerra e foi designada para trabalhar no Harvard Mark I, um dos primeiros computadores eletromecânicos de grande escala.

O Mark I não era um laptop que você podia reiniciar depois de um erro — era um recurso do tamanho de uma sala, compartilhado por uma equipe, agendado com cuidado e tratado como equipamento de laboratório caro.

Como era programar sem compiladores

Antes dos compiladores, programar era mais parecido com ligar um painel de controle do que escrever algo que reconheceríamos como código. Instruções tinham de corresponder exatamente às necessidades do hardware, muitas vezes como códigos numéricos ou operações de muito baixo nível. Se você queria que a máquina somasse, comparasse ou movesse valores, você expressava isso no vocabulário da máquina — passo a passo.

Esse trabalho era:

- Manual: você mesmo traduzia sua lógica em pequenas operações.

- Propenso a erros: um único dígito ou endereço errado podia quebrar tudo.

- Lento para mudar: mesmo pequenas atualizações exigiam revisar longas cadeias de instruções.

A restrição real: tempo era caro

Os primeiros computadores eram escassos, e o “tempo de computador” era um item de orçamento. Não dava para rodar casualmente um programa dez vezes para ver o que acontecia. As equipes se preparavam cuidadosamente, verificavam tudo duas vezes e depois esperavam sua vez para executar tarefas. Cada minuto desperdiçado com erros evitáveis era tempo que não era usado para resolver o problema real.

Essa pressão moldou o pensamento de Hopper: se os humanos gastavam mais esforço falando a língua da máquina do que resolvendo a tarefa, o gargalo não era só o hardware — era o método.

Código de máquina, Assembly e o problema do tempo humano

Antes dos compiladores, os programadores falavam com computadores na "linguagem nativa" das máquinas.

Código de máquina, em linguagem simples

Código de máquina é uma sequência de 0s e 1s que o processador pode executar diretamente. Cada padrão significa algo como “somar estes dois números”, “mover este valor” ou “pular para outro passo”. É preciso — e brutalmente difícil para humanos lerem, escreverem e depurarem.

Assembly: um pequeno passo rumo à legibilidade

Linguagem assembly é código de máquina com apelidos. Em vez de escrever bits brutos, você escreve palavras curtas como LOAD, ADD ou JUMP, além de endereços de memória. Um montador (assembler) então traduz essas palavras para os 0s e 1s exatos daquela máquina específica.

Assembly era mais fácil que código de máquina puro, mas ainda forçava as pessoas a pensar como o hardware: registradores, posições de memória e a ordem exata das operações.

Por que programas iniciais eram presos ao hardware

Os primeiros computadores não eram intercambiáveis. Máquinas diferentes tinham conjuntos de instruções, layouts de memória e até maneiras diferentes de representar números. Um programa escrito para as instruções de um processador frequentemente não rodava em outro.

O software era menos como uma “receita” e mais como uma chave personalizada para uma fechadura única.

Quando pequenas mudanças causavam grandes reescritas

Porque programas eram construídos a partir de passos de baixo nível, um pedido “simples” — como adicionar uma nova coluna de relatório, mudar um formato de arquivo ou ajustar o arredondamento de um cálculo — podia repercutir por todo o programa.

Se uma nova funcionalidade exigia instruções extras, talvez fosse preciso reorganizar endereços de memória, atualizar alvos de salto e verificar cada lugar que presumisse o layout antigo. O tempo da máquina era precioso, mas o tempo humano era o verdadeiro gargalo — e estava sendo queimado em detalhes que pouco tinham a ver com o problema de negócio.

A grande ideia: o que um compilador faz

Os primeiros computadores eram poderosos mas dolorosamente literais. Eles só podiam seguir instruções expressas no pequeno conjunto de operações que seu hardware entendia. Isso significava que programar muitas vezes parecia escrever diretamente para a máquina, passo a passo.

Um compilador inverteu esse padrão de trabalho: em vez de pessoas “falarem máquina”, você podia escrever instruções de forma mais amigável ao humano — e deixar um software cuidar da tradução. Em termos práticos, é um programa que ajuda a produzir programas.

O que “compilar” realmente significa

Compilar é o processo de transformar código que humanos podem ler e escrever em instruções de máquina que o computador pode executar. Você pode pensar nisso como traduzir uma receita para os botões exatos que um robô de cozinha precisa apertar.

Em alto nível, um compilador normalmente:

- lê seu código-fonte (o texto que você escreveu),

- verifica erros e inconsistências,

- traduz para uma forma de nível mais baixo que a máquina possa rodar (muitas vezes criando um executável ou outro arquivo de saída).

A mágica não é que o computador de repente “entende inglês”. A mágica é que o compilador faz a conversão tediosa e propensa a erros com velocidade e consistência.

Compilador vs. interpretador (a confusão comum)

As pessoas frequentemente confundem compiladores e interpretadores porque ambos ajudam a executar código amigável ao humano.

Uma maneira simples de separá-los:

- Um compilador traduz o programa inteiro (ou grandes partes) antecipadamente, produzindo algo que o computador pode executar.

- Um interpretador executa seu programa traduzindo e rodando passo a passo enquanto avança.

Ambas as abordagens podem parecer parecidas externamente (“eu escrevo código e ele roda”), mas o fluxo de trabalho e as trocas de desempenho são diferentes. O ponto-chave para a história de Hopper é que a compilação tornou “escrever código” menos sobre detalhes de hardware e mais sobre expressar intenção.

A-0 de Hopper e os primeiros passos rumo aos compiladores

O sistema A-0 de Grace Hopper (geralmente datado de 1952) é uma das primeiras ferramentas parecidas com compilador — embora não se parecesse com compiladores modernos que traduzem uma linguagem totalmente legível para código de máquina.

O que o A-0 fazia (em termos simples)

Em vez de escrever cada instrução à mão, um programador podia escrever um programa que referenciava rotinas pré-construídas por um identificador. O A-0 então:

- procurava as rotinas solicitadas em um catálogo (uma lista de bibliotecas),

- puxava os blocos corretos de código de máquina para essas rotinas,

- costurava-os em um programa executável completo (o que hoje chamaríamos de ligação).

Assim, o programador ainda não pedia para a máquina “entender uma linguagem parecida com Inglês”. Pedia-se para automatizar um trabalho repetitivo e propenso a erro: selecionar e combinar blocos de construção conhecidos.

Subrotinas e bibliotecas: menos repetição, menos erros

O A-0 apoiou-se numa ideia poderosa: subrotinas. Se você já tinha uma rotina testada para algo como entrada/saída, operações matemáticas ou movimentação de dados, não precisava reescrevê-la sempre.

Isso mudou o trabalho cotidiano de duas grandes maneiras:

- Velocidade: equipes podiam construir novos programas reutilizando pedaços existentes.

- Confiabilidade: reutilizar rotinas comprovadas reduzia a chance de introduzir bugs novos por duplicação.

A mudança de mentalidade: programar como reutilização + automação

O impacto mais profundo do A-0 não foi apenas técnico — foi cultural. Ele sugeriu que programar podia ser sobre descrever o que você queria montar a partir de componentes confiáveis e deixar as ferramentas fazerem o trabalho mecânico.

Essa atitude — reutilizar bibliotecas, padronizar rotinas e automatizar tradução — tornou-se a base para compiladores, linguagens padrão e práticas modernas de desenvolvimento de software.

Código amigável ao humano: a defesa da legibilidade

Publique no seu domínio

Coloque seu projeto em um domínio personalizado quando estiver pronto para compartilhar.

Os primeiros programadores não lutavam só com máquinas — também brigavam com as suposições uns dos outros sobre o que era "programação de verdade". Para muitos engenheiros, trabalho sério significava instruções que lembrassem o hardware: apertadas, numéricas e explícitas. Qualquer coisa que parecesse linguagem natural soava imprecisa.

Grace Hopper argumentava que computadores deveriam servir às pessoas, não o contrário. Sua defesa por notação mais legível — sentenças mais próximas de termos de negócio do que de operações de máquina — foi controversa porque desafiava uma crença central: que eficiência exigia que humanos pensassem em passos moldados pela máquina.

Céticos temiam que comandos parecidos com inglês seriam ambíguos, esconderiam detalhes importantes e incentivariam pensamento descuidado. A resposta de Hopper foi prática: a maior parte do tempo de programação não é gasta digitando instruções — é gasta entendendo-as depois.

Legibilidade é uma estratégia de manutenção

Código legível não é sobre tornar programas "fáceis"; é sobre torná-los sobrevivíveis. Quando o código comunica intenção, equipes podem revisar mudanças mais rápido, integrar novas pessoas com menos erros e diagnosticar problemas sem reverter cada decisão.

Isso importa ainda mais ao longo dos anos. Software sobrevive a cargos, departamentos e, às vezes, ao propósito original para o qual foi criado. Estrutura e nomes amigáveis ao humano reduzem o custo de mudança, que frequentemente é o maior custo no software.

Compensações: desempenho, ferramentas e ceticismo inicial

A abordagem de Hopper tinha limites. Compiladores e ferramentas iniciais eram imaturos, e código de nível mais alto podia produzir programas mais lentos ou maiores que assembly otimizado manualmente. Depurar também podia parecer indireto: erros apareciam na saída compilada em vez do texto fonte.

Ainda assim, o benefício de longo prazo era claro: código-fonte legível tornou possível construir sistemas maiores com mais pessoas — e manter esses sistemas funcionando muito depois da versão inicial ser entregue.

COBOL e o movimento rumo a linguagens padronizadas

O COBOL (Common Business-Oriented Language) foi criado com um objetivo simples: tornar programas legíveis para as pessoas que gerenciam negócios, não apenas para quem monta máquinas. Grace Hopper defendia fortemente essa ideia — se o código ia viver por anos, mudar de equipe e sobreviver à rotatividade, ele precisava ser compreensível.

O que o COBOL tentou alcançar

O COBOL foi desenhado para processamento de dados de negócios: folha de pagamento, inventário, faturamento e outros trabalhos onde a “forma” dos dados importa tanto quanto a matemática. Por isso o COBOL enfatizou registros, campos e descrições claras do que um programa estava fazendo.

Uma grande parte da ambição era clareza. O COBOL inclinou-se para uma estrutura parecida com Inglês para que alguém lendo o programa pudesse seguir a intenção. Não se tratava de tornar a programação "fácil" — tratava-se de torná-la legível e mantível quando o custo de erros em sistemas de negócio podia ser enorme.

Comitês, padrões e por que isso importou

O grande avanço do COBOL não foi apenas sua sintaxe. Foi a movimentação rumo à padronização.

Em vez de ficar preso à linguagem privada de um fabricante ou empresa, o COBOL foi moldado por comitês e especificações formais. Esse processo podia ser lento e político, mas criou um alvo compartilhado que múltiplos fornecedores podiam implementar.

Na prática, isso significou que organizações podiam investir em COBOL com mais confiança: materiais de treinamento duravam mais, contratação era mais fácil e o código tinha maior chance de sobreviver a uma mudança de hardware.

A padronização também mudou expectativas. Linguagens deixaram de ser apenas ferramentas que “vinham com a máquina”. Tornaram-se acordos públicos — regras sobre como humanos escrevem instruções e como compiladores as traduzem.

Uma visão equilibrada: forças e críticas

As vantagens do COBOL são fáceis de explicar: é explícito, suas estruturas de dados são centrais e ele suporta sistemas de negócio de longa duração. Essa longevidade não é acidente; é resultado de escolhas de design que favoreceram clareza e estabilidade.

As críticas também são reais. COBOL pode ser verboso, e sua legibilidade pode parecer rígida comparada a linguagens modernas. Mas a verbosidade muitas vezes tinha um propósito: o código mostra seu trabalho, o que ajuda auditoria, manutenção e transições entre equipes.

O COBOL marca um ponto de inflexão onde linguagens de programação passaram a agir menos como atalhos pessoais e mais como infraestrutura guiada por padrões — compartilhada, ensinável e construída para durar.

De uma máquina para muitas: portabilidade e padronização

Construa mais rápido que a tradução manual

Teste um fluxo de trabalho tipo compilador para criar apps a partir do chat com o plano gratuito.

Programas iniciais eram frequentemente casados com uma máquina específica. Se você mudasse de computador, não bastava mover arquivos — frequentemente era preciso reescrever o programa, porque instruções e convenções eram diferentes. Isso tornava o software frágil, caro e retardava a adoção de novo hardware.

Portabilidade: o verdadeiro “escreva uma vez, rode (quase) em qualquer lugar”

Compiladores introduziram uma separação poderosa: você escreve seu programa em uma linguagem de nível mais alto, e o compilador o traduz para as instruções nativas de um computador específico.

Isso é o que se entende por portabilidade: o mesmo código-fonte pode ser compilado para máquinas diferentes — desde que haja um compilador apropriado (e você evite suposições específicas de máquina). Em vez de reescrever um sistema de folha de pagamento para cada novo computador, as organizações podiam manter a lógica e apenas recompilar.

Hardware melhor sem refazer o software

Essa mudança alterou a economia da melhoria de hardware. Fabricantes podiam lançar máquinas mais rápidas ou capazes, e clientes não precisavam descartar anos de investimento em software.

Compiladores tornaram-se uma espécie de “camada adaptadora” entre necessidades de negócio estáveis e tecnologia em rápida mudança. Era possível atualizar processadores, modelos de memória e periféricos mantendo a intenção da aplicação intacta. Algumas mudanças ainda exigiam atualizações — especialmente entrada/saída — mas a ideia central deixou de estar presa a um conjunto específico de opcodes.

Padronização: linguagens compartilhadas, ecossistemas compartilhados

A portabilidade melhora dramaticamente quando a linguagem é padronizada. Regras padrão significam que código escrito para um compilador é muito mais provável de compilar em outro, reduzindo dependência de fornecedor e tornando o software mais fácil de compartilhar.

Esse legado está por toda parte hoje:

- aplicativos multiplataforma construídos a partir de uma base de código comum (desktop, mobile, web),

- linguagens e runtimes padronizados que se comportam de forma previsível em sistemas diferentes,

- grandes ecossistemas — bibliotecas, ferramentas e pipelines de contratação — que existem porque as pessoas confiam que “o mesmo código” vai significar algo parelho em lugares diferentes.

O empurrão de Grace Hopper por programação amigável e amplamente utilizável não foi só comodidade. Ajudou a transformar software de instruções específicas de máquina em um ativo portátil que podia sobreviver a gerações de hardware.

Como os compiladores mudaram o trabalho e a manutenção de software

Compiladores não apenas aceleraram a programação — eles remodelaram como equipes de software eram organizadas. Quando o código pôde ser escrito em termos de nível mais alto (mais próximo de regras de negócio do que de instruções de máquina), diferentes pessoas puderam contribuir com mais eficácia.

Novos papéis, entregas mais claras

Projetos iniciais muitas vezes separavam trabalho em papéis como analistas (que definiam o que o sistema deveria fazer), programadores (que traduziram isso em código) e operadores (que rodavam tarefas e gerenciavam tempo de máquina). Com compiladores, analistas podiam descrever fluxos de trabalho de maneira mais estruturada e consistente, enquanto programadores gastavam menos esforço “montando” instruções e mais tempo desenhando lógica que combinava com esses fluxos.

O resultado foi uma entrega mais limpa: requisitos → código-fonte legível → programa compilado. Isso tornou projetos grandes menos dependentes de poucos especialistas que conheciam as peculiaridades de uma máquina.

Manutenção tornou-se a conta real

À medida que o software começou a viver por anos — não semanas — a manutenção virou um custo importante. Correções, atualizações e pequenas mudanças de política se acumularam. Código-fonte legível tornou isso suportável: alguém novo podia entender a intenção sem decodificar milhares de passos de baixo nível.

Compiladores apoiaram isso ao encorajar estrutura: variáveis nomeadas, rotinas reutilizáveis e fluxo de controle mais claro. Quando o código se explica, a manutenção deixa de ser arqueologia.

Melhores hábitos de teste e depuração

Abstrações mais claras também melhoraram testes e depuração. Em vez de perseguir uma instrução de máquina errada, equipes podiam raciocinar sobre funcionalidades (“esse cálculo está errado para reembolsos”) e isolar problemas para um módulo ou função.

Mesmo quando compiladores antigos geravam erros crípticos, eles ainda impuseram uma disciplina valiosa: mantenha o código-fonte organizado, verifique comportamento passo a passo e faça mudanças onde o significado é expresso — não onde o hardware armazena os bits.

Mitos comuns sobre compiladores e programação “fácil"

Compiladores traduzem instruções amigáveis ao humano em instruções de máquina. Essa mudança tornou o software mais rápido de escrever e mais fácil de compartilhar — mas também criou alguns mitos que ainda aparecem quando se fala de codificação.

Mito 1: “O compilador torna o programa correto”

Um compilador verifica em grande parte se seu código segue as regras da linguagem e pode ser traduzido em algo executável. Se a lógica estiver errada, o compilador muitas vezes gera um programa válido que faz a coisa errada.

Por exemplo, um cálculo de folha de pagamento pode compilar limpo e ainda pagar o valor errado por causa de uma fórmula equivocada, um caso-limite não tratado ou uma suposição de fuso horário que você não notou.

Mito 2: “Linguagens de alto nível evitam bugs”

Linguagens de alto nível reduzem certas classes de erro — como confundir instruções de CPU ou gerenciar manualmente detalhes minuciosos de memória — mas não eliminam bugs. Você ainda pode:

- tratar entradas inadequadamente e criar brechas de segurança,

- escrever código que funciona para casos “normais” mas falha em casos incomuns,

- construir sistemas difíceis de mudar porque são obscuros ou inconsistentes.

Código legível é uma grande vantagem, mas legibilidade não é o mesmo que correção.

Mito 3: “Se é legível, deve ser seguro e eficiente”

Código pode ter nomes belos e estar bem formatado e ainda assim ser inseguro (por exemplo, confiar na entrada do usuário), lento (por exemplo, chamadas repetidas ao banco em um laço) ou frágil (por exemplo, dependências ocultas).

A melhor moldura é: código legível facilita encontrar problemas e corrigi-los. Não garante que não existam problemas.

Hábitos práticos que vencem os mitos

Compiladores são ferramentas, não babás. A confiabilidade vem de como as pessoas trabalham:

- Nomes: escolha nomes que expliquem a intenção, não só a mecânica.

- Documentação: registre suposições (entradas, saídas, limites).

- Revisões: peça uma segunda opinião antes de enviar mudanças.

- Testes: verifique comportamento automaticamente para que alterações não quebrem promessas antigas.

Grace Hopper defendeu código que humanos pudessem entender. O melhor desdobramento disso é combinar essa legibilidade com práticas disciplinadas que evitem que “fácil” vire “descuidado”.

O legado dos compiladores em linguagens e ferramentas modernas

Prototipe um app móvel

Transforme uma ideia de produto em um app Flutter que você possa iterar e exportar.

A aposta central de Hopper foi simples: se podemos descrever o trabalho em termos que as pessoas entendem, os computadores devem lidar com a tradução. Essa ideia está embutida em quase toda experiência moderna de programação — de escrever Python ou JavaScript a publicar apps com toolchains industriais.

Hoje, um “compilador” raramente é um único programa. É um pipeline: analisar seu código, checá-lo, transformá-lo, otimizar e produzir algo executável (código de máquina, bytecode ou um bundle otimizado). Quer você escreva Go, Rust, Swift ou C#, você se beneficia da mesma promessa que Hopper defendia: reduzir trabalho repetitivo, manter a intenção clara e deixar máquinas cuidar da conversão repetitiva.

Isso também explica por que o desenvolvimento moderno continua a subir para interfaces de nível ainda mais alto que ainda produzem sistemas reais e implantáveis. Em plataformas como Koder.ai, por exemplo, você descreve o que quer em uma interface de chat e um fluxo de trabalho baseado em agentes ajuda a gerar e refinar uma aplicação (web, backend ou mobile) enquanto ainda produz código-fonte exportável. De maneira muito Hopperiana, o objetivo é o mesmo: mover esforço de tradução tediosa para intenção clara, saída revisável e iteração mais rápida.

Recursos de qualidade de vida que agora damos como certos

Compiladores modernos não só traduzem — eles ensinam e protegem.

Quando você vê uma mensagem de erro que aponta a linha exata e sugere uma correção, isso é legado de tratar programação como atividade humana, não ritual de máquina.

Otimização é outra vitória silenciosa: compiladores podem tornar o código mais rápido ou menor sem obrigar desenvolvedores a ajustar cada instrução manualmente.

Análise estática (frequentemente embutida em compiladores ou ferramentas associadas) captura problemas cedo — incompatibilidades de tipo, código inatingível, possíveis nulos — antes de o software chegar aos clientes.

Como isso aparece no trabalho diário

Tudo isso resulta em ciclos de desenvolvimento mais rápidos: você escreve código mais claro, ferramentas sinalizam problemas mais cedo e builds produzem saídas confiáveis em diferentes ambientes. Mesmo quando você nunca fala a palavra “compilador”, você sente seu efeito toda vez que seu IDE sublinha um bug, seu CI falha com um diagnóstico preciso ou sua release roda mais rápido depois de uma atualização de toolchain.

Essa é a visão de Hopper ecoando na prática diária.

O trabalho de compilador de Grace Hopper não só tornou computadores mais fáceis de programar — mudou o que o software podia ser. Antes dos compiladores, cada melhoria dependia de esforço minucioso e de baixo nível. Depois dos compiladores, uma porção maior do tempo humano pôde ser dedicada a ideias, regras e comportamento em vez de tradução instrução por instrução.

O que realmente mudou — e por que durou

Duas mudanças fizeram a diferença:

- Automação: o compilador assumiu a tarefa repetitiva de transformar instruções significativas em passos prontos para a máquina. Isso reduziu erros manuais e acelerou iterações.

- Legibilidade: o código aproximou-se da linguagem humana e da lógica de negócio. Programas tornaram-se documentos que equipes podiam discutir, revisar e manter — não apenas enigmas que só o autor original decodificaria.

Esses benefícios se reforçaram mutuamente. Quando o código é mais fácil de ler, é mais fácil melhorá-lo. Quando a tradução é automatizada, equipes podem refatorar e adaptar software conforme as necessidades mudam. Por isso os compiladores não foram um truque pontual — tornaram-se base para linguagens, ferramentas e colaboração modernas.

A principal lição: compiladores ampliam o esforço humano

Um compilador é menos sobre “tornar a programação fácil” e mais sobre tornar a programação escalável. Ele permite que a intenção de uma pessoa viaje mais longe: através de projetos maiores, equipes maiores, prazos mais longos e mais máquinas.

Uma rápida reflexão para o seu próprio código

Se alguém novo entrasse na sua equipe amanhã, qual pequena mudança você poderia fazer para que entendessem seu código mais rápido — melhores nomes, estrutura mais clara ou um comentário curto explicando o “porquê”?