O que são REST e gRPC (em termos simples)

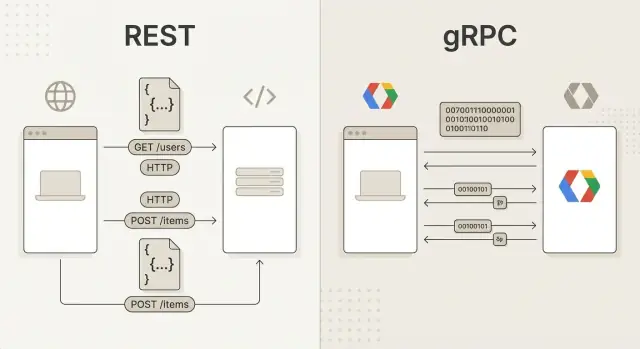

Quando as pessoas comparam REST e gRPC, na verdade estão comparando duas formas distintas de software “conversar” pela rede.

REST: APIs HTTP orientadas a recursos

REST é um estilo de design de API construído em torno de recursos — coisas que sua aplicação gerencia, como usuários, pedidos ou faturas. Você interage com esses recursos usando pedidos HTTP familiares:

- GET para ler dados (por exemplo,

GET /users/123)

- POST para criar algo (por exemplo,

POST /orders)

- PUT/PATCH para atualizar

- DELETE para remover

As respostas costumam ser JSON, que é fácil de inspecionar e amplamente suportado. REST tende a ser intuitivo porque mapeia bem com a web — e porque você pode testá-lo com um navegador ou ferramentas simples.

gRPC: chamar funções em outro serviço

gRPC é um framework para remote procedure calls (RPC). Em vez de pensar em “recursos”, você pensa em métodos que quer executar em outro serviço, como CreateOrder ou GetUser.

Por baixo dos panos, o gRPC normalmente usa:

- HTTP/2 para conexões eficientes

- Protocol Buffers (um formato binário compacto) para mensagens

- Um contrato fortemente definido (um arquivo

.proto) que pode gerar código cliente e servidor

O resultado costuma se parecer com chamar uma função local — exceto que ela está rodando em outro lugar.

O que este guia vai ajudar você a decidir

Este guia ajuda a escolher com base em restrições reais: expectativas de desempenho, tipos de clientes (navegador vs mobile vs serviços internos), necessidades em tempo real, fluxo de trabalho da equipe e manutenção a longo prazo.

Não existe uma resposta única. Muitas equipes usam REST para APIs públicas ou de terceiros e gRPC para comunicação interna entre serviços — mas suas restrições e objetivos devem guiar a escolha.

Fatores-chave de decisão para considerar primeiro

Antes de comparar recursos, fique claro sobre o que você está otimizando. REST e gRPC podem funcionar bem, mas brilham sob restrições diferentes.

1) Quem vai usar a API?

Comece pelos clientes.

- Se sua API precisa ser chamada diretamente de navegadores (incluindo sites de terceiros) ou precisa de acessibilidade simples para “testar com curl”, REST é geralmente a escolha mais segura.

- Se a maioria dos chamadores são serviços internos que você controla (chamadas serviço-a-serviço em microserviços), gRPC frequentemente se encaixa melhor porque foi projetado em torno de contratos tipados e clientes gerados.

2) Onde vai rodar: internet pública ou rede privada?

Na internet pública, você vai se preocupar com proxies, camadas de cache e compatibilidade com ferramentas diversas. REST sobre HTTP é amplamente suportado e tende a transitar por redes empresariais com mais previsibilidade.

Dentro de uma rede privada (ou entre serviços na mesma plataforma), você pode aproveitar o protocolo mais fechado do gRPC e a comunicação mais estruturada — especialmente quando você controla ambos os lados.

3) Quais são seus padrões de dados e chamadas?

Pergunte como é o “tráfego normal”:

- CRUD simples com pedidos ocasionais: REST é direto e fácil de raciocinar.

- Chamadas pequenas e frequentes (interações chatty) ou tráfego interno de alto volume: gRPC pode reduzir overhead e manter cliente/servidor alinhados.

- Payloads grandes: ambos podem funcionar, mas seja explícito sobre limites, paginação/chunking e timeouts.

4) Você precisa de comportamento em tempo real?

Se precisa de streaming (eventos, atualizações de progresso, feeds contínuos), considere isso desde cedo. Dá para montar padrões em cima de REST, mas o modelo de streaming do gRPC costuma ser mais natural quando ambos os lados podem suportá-lo.

5) Restrições e padrões da equipe

Escolha o que sua equipe consegue entregar e operar com confiança. Considere padrões de API existentes, hábitos de depuração, cadência de releases e quão rápido novos desenvolvedores ficam produtivos. Um protocolo “melhor” que atrase a entrega ou aumente o risco operacional não é realmente melhor para seu projeto.

Noções básicas do protocolo: HTTP, contratos e como as chamadas funcionam

No nível do protocolo, REST e gRPC ambos se reduzem a “um cliente chama um servidor”, mas descrevem essa chamada de forma diferente: REST centra-se em recursos HTTP e códigos de status, enquanto gRPC centra-se em métodos remotos e um esquema estrito.

APIs REST tipicamente rodam sobre HTTP/1.1, e cada vez mais sobre HTTP/2 também. A “forma” de uma chamada REST é definida por:

- Caminhos URL como recursos (por exemplo,

/users/123)

- Verbos HTTP que descrevem a intenção:

GET, POST, PUT, PATCH, DELETE

- Códigos de status que comunicam o resultado:

200, 201, 400, 401, 404, 500, etc.

- Headers para metadados (tokens de auth, cache, content type) e negociação de conteúdo (

Accept, Content-Type)

O padrão típico é request/response: o cliente envia uma requisição HTTP, e o servidor retorna uma resposta com código de status, headers e corpo (frequentemente JSON).

gRPC sempre usa HTTP/2, mas não expõe “recursos + verbos” como interface primária. Em vez disso, você define services com métodos (como CreateUser ou GetUser) e os chama como chamadas remotas de procedimento.

Além do payload de mensagem, o gRPC suporta:

- Metadados (pares chave/valor semelhantes a headers)

- Deadlines/timeouts como conceito de primeira classe, para que clientes possam dizer “essa chamada deve terminar em 200ms” e servidores possam interromper o trabalho quando o prazo estourar

Como o modelo de chamada difere: request/response vs RPC

REST pergunta: “Em qual recurso você está operando, e qual verbo HTTP se encaixa?”

gRPC pergunta: “Qual método você está chamando, e qual mensagem tipada ele aceita/retorna?”

Essa diferença afeta nomenclatura, tratamento de erros (códigos HTTP vs status gRPC) e como os clientes são gerados.

O que “contrato” significa em cada abordagem

- Contrato REST: muitas vezes documentado com OpenAPI + convenções (endpoints, campos, códigos de status). É flexível, mas a consistência depende da disciplina.

- Contrato gRPC: um esquema

.proto é o contrato. Define serviços, métodos e mensagens fortemente tipadas, permitindo geração confiável de código e regras de compatibilidade mais claras conforme a API evolui.

Desempenho e eficiência: ganhos e trocas

Desempenho é uma das razões mais citadas para considerar gRPC — mas a vitória não é automática. A questão real é que tipo de “desempenho” você precisa: menor latência por chamada, maior throughput sob carga, menor custo de largura de banda ou maior eficiência do servidor.

REST: JSON legível, mas mais overhead

A maioria das APIs REST usa JSON sobre HTTP/1.1. JSON é fácil de inspecionar, logar e depurar, o que é uma eficiência prática para equipes.

O trade-off é que JSON é verboso e exige mais CPU para parsear e gerar, especialmente quando payloads ficam grandes ou chamadas são frequentes. HTTP/1.1 também pode adicionar overhead de conexão quando clientes fazem muitas requisições paralelas.

REST também pode ser vantagem em arquiteturas de leitura intensiva: cache HTTP (via headers como ETag e Cache-Control) pode reduzir requisições repetidas dramaticamente — especialmente quando combinado com CDNs.

gRPC: mensagens menores e melhor uso de conexão

gRPC normalmente usa Protocol Buffers (binário) sobre HTTP/2. Isso costuma significar:

- Payloads menores que JSON (menos largura de banda)

- Serialização/deserialização mais rápida (menos CPU)

- Multiplexação HTTP/2 (muitas chamadas compartilham uma conexão)

Esses benefícios aparecem com mais clareza em chamadas serviço-a-serviço com alto volume de requisições, ou quando você está movendo muitos dados dentro de um sistema de microserviços.

Latência vs throughput: o que esperar

Em um sistema tranquilo, REST e gRPC podem parecer igualmente rápidos. As diferenças ficam mais evidentes quando a concorrência aumenta.

- Latência (tempo por chamada): gRPC frequentemente melhora a latência tail porque evita overhead de repetição de conexões e usa payloads compactos.

- Throughput (chamadas por segundo): gRPC costuma escalar melhor no mesmo hardware sob carga pesada.

Quando importa (e quando não importa)

Diferenças de desempenho importam mais quando você tem chamadas internas de alta frequência, payloads grandes, restrições de banda em mobile ou SLOs rígidos.

Importam menos quando sua API é dominada por tempo de banco de dados, chamadas a terceiros ou uso em escala humana (dashboards administrativos, CRUD típico). Nesses casos, clareza, cacheabilidade e compatibilidade de clientes podem valer mais do que eficiência bruta do protocolo.

Streaming e comunicação em tempo real

Prototipe REST e gRPC rápido

Estruture ambos os estilos em um pequeno aplicativo e compare latência, ferramentas e esforço do cliente.

Recursos em tempo real — dashboards ao vivo, chat, colaboração, telemetria, notificações — dependem de como sua API lida com comunicação “contínua”, não apenas requisições pontuais.

REST: request/response, mais padrões assíncronos comuns

REST é fundamentalmente request/response: o cliente pergunta, o servidor responde e a conexão termina. Você pode construir comportamento quase em tempo real, mas normalmente usando padrões ao redor de REST:

- Polling: o cliente pergunta “tem algo novo?” a cada N segundos. Simples, mas desperdiça banda e bateria quando atualizações são raras, e adiciona latência quando N é grande.

- Long polling: o servidor segura a requisição até ter uma atualização (ou timeout), então o cliente reconecta. Menos desperdiçoso que polling, mas ainda reconexões pesadas.

- Webhooks: o servidor chama você quando algo muda. Ótimo para integrações de terceiros e notificações, mas requer endpoints públicos, verificação de assinatura, retries e idempotência cuidadosa.

(Para web em tempo real, times frequentemente adicionam WebSockets ou SSE junto com REST; esse é um canal separado com seu próprio modelo operacional.)

gRPC: streaming é recurso de primeira classe

gRPC suporta múltiplos tipos de chamada sobre HTTP/2, e streaming está integrado ao modelo:

- Unary: uma requisição, uma resposta (semelhante ao REST).

- Server streaming: uma requisição, várias respostas (o servidor envia atualizações).

- Client streaming: várias requisições, uma resposta (o cliente envia um fluxo de dados).

- Bidirectional streaming: ambos os lados enviam mensagens independentemente (conversa em tempo real).

Isso torna gRPC um ajuste forte quando você quer fluxo sustentado de mensagens com baixa latência sem criar novas requisições HTTP a todo momento.

Casos de uso que se beneficiam de streaming

Streaming é ideal para:

- Métricas e logs ao vivo (dispositivos ou serviços reportando continuamente)

- Chat, presença, cursores de colaboração (atualizações bidirecionais)

- Dados de mercado / feeds ao vivo (server streaming)

- Uploads de mídia ou arquivos grandes (client streaming)

- Notificações em fan-out dentro de microserviços (streams de eventos serviço-a-serviço)

Considerações operacionais para conexões de longa duração

Streams de longa duração mudam como você opera sistemas:

- Load balancing: precisa de estratégias que funcionem bem com conexões HTTP/2 longas e sticky.

- Timeouts/keepalives: ajuste para evitar desconexões silenciosas e detectar peers mortos.

- Backpressure: streaming pode sobrecarregar consumidores lentos; projete controle de fluxo e limites de mensagens.

- Uso de recursos: cada stream aberto consome memória e concorrência; defina cotas e monitore saturação.

Se “tempo real” é central ao seu produto, o modelo de streaming do gRPC pode reduzir complexidade comparado a empilhar polling/webhooks (e possivelmente WebSockets) sobre REST.

Experiência do desenvolvedor, ferramentas e manutenibilidade

Escolher entre REST e gRPC não é só sobre velocidade — sua equipe viverá com a API todo dia. Ferramentas, onboarding e quão seguro você pode evoluir uma interface frequentemente importam mais que throughput bruto.

REST: ferramentas acessíveis e depuração fácil

REST parece familiar porque usa HTTP puro e geralmente JSON. Isso significa que a caixa de ferramentas é universal: devtools do navegador, curl, Postman/Insomnia, proxies e logs legíveis sem visualizadores especiais.

Quando algo quebra, depurar costuma ser direto: reproduza uma requisição no terminal, inspecione headers e compare respostas lado a lado. Essa conveniência é um grande motivo para REST ser comum em APIs públicas e para times que esperam muito teste ad-hoc.

gRPC: contratos fortes, clientes gerados, menos surpresas

gRPC normalmente usa Protocol Buffers e geração de código. Em vez de montar requisições manualmente, desenvolvedores chamam métodos tipados na sua linguagem favorita.

O ganho é segurança de tipos e um contrato mais claro: campos, enums e formas de mensagem são explícitos. Isso pode reduzir bugs “stringly-typed” e desalinhamentos entre cliente e servidor — especialmente em comunicação serviço-a-serviço.

Curva de aprendizado e onboarding

REST é mais fácil de pegar rapidamente: “envie um pedido HTTP para esta URL.” gRPC pede que novos membros entendam arquivos .proto, geração de código e às vezes fluxos de depuração diferentes. Times confortáveis com tipagem forte e esquemas compartilhados tendem a se adaptar mais rápido.

Com REST/JSON, gestão de mudanças muitas vezes depende de convenções (adicionar campos, depreciar endpoints, URLs versionadas). Com gRPC/Protobuf, regras de compatibilidade são mais formais: adicionar campos geralmente é seguro, mas renomear/remover campos ou mudar tipos pode quebrar consumidores.

Em ambos os estilos, a manutenibilidade melhora quando você trata a API como um produto: documente, automatize testes de contrato e publique uma política clara de depreciação.

Compatibilidade de clientes: web, mobile e terceiros

Escolher entre REST e gRPC muitas vezes se resume a quem vai chamar sua API — e de que ambientes.

REST: o caminho mais fácil para “qualquer cliente”

REST sobre HTTP com JSON é amplamente suportado: navegadores, apps mobile, ferramentas de linha de comando, plataformas low-code e sistemas parceiros. Se você está construindo uma API pública ou espera integrações de terceiros, REST minimiza fricção porque consumidores podem começar com requisições simples e depois adotar melhores ferramentas.

REST também se encaixa naturalmente com restrições web: navegadores lidam bem com HTTP, caches e proxies entendem, e depuração é simples com ferramentas comuns.

gRPC: ótimo para clientes controlados, mais complexo em ecossistemas abertos

gRPC brilha quando você controla ambos os lados (seus serviços, apps internos, equipes de backend). Usa HTTP/2 e Protocol Buffers, o que pode ser grande vantagem para desempenho e consistência — mas nem todo ambiente consegue adotá-lo facilmente.

Navegadores, por exemplo, não suportam chamadas gRPC “completas” diretamente. Você pode usar gRPC-Web, mas isso adiciona componentes e restrições (proxies, tipos de conteúdo específicos e ferramentas diferentes). Para terceiros, exigir gRPC pode ser um obstáculo maior do que fornecer um endpoint REST.

Se precisar dos dois: use um gateway

Um padrão comum é manter gRPC internamente para comunicação entre serviços e expor REST externamente via um gateway ou camada de tradução. Isso permite que parceiros usem HTTP/JSON familiar enquanto seus sistemas internos mantêm um contrato tipado.

SDKs e suporte a clientes: como pensar nisso

- Com REST, SDKs são opcionais mas úteis; muitos consumidores vão te chamar sem eles.

- Com gRPC, bibliotecas cliente geradas fazem parte do modelo. Isso é vantagem (tipagem, menos bugs manuais) contanto que seus consumidores consigam gerar e atualizar clientes de forma confiável.

Se seu público inclui terceiros desconhecidos, REST costuma ser o padrão mais seguro. Se seu público são majoritariamente seus próprios serviços, gRPC geralmente é mais adequado.

Segurança, observabilidade e operações

Adicione streaming gRPC com segurança

Use o modo de planejamento para projetar streams e depois itere com instantâneos e reversões.

Segurança e operabilidade são frequentemente onde “funciona numa demo” vira “difícil em produção”. REST e gRPC podem ser seguros e observáveis, mas se encaixam em padrões de infraestrutura diferentes.

Segurança: transporte e autenticação

REST normalmente roda sobre HTTPS (TLS). Autenticação costuma ser transportada em headers HTTP padrão:

- OAuth 2.0 / OpenID Connect (Bearer tokens) para aplicações com usuários

- Chaves de API para integrações mais simples (geralmente combinadas com rate limiting)

- Assinatura de requisições opcional (para maior garantia)

Como REST usa semântica HTTP familiar, é fácil integrar com WAFs, reverse proxies e gateways que já entendem headers, paths e métodos.

gRPC também usa TLS, mas a autenticação é comumente passada via metadados (pares chave/valor semelhantes a headers). É comum adicionar:

- Identidade serviço-a-serviço (mTLS, SPIFFE/SPIRE ou certificados emitidos por malha)

- Tokens em metadados (por exemplo,

authorization: Bearer …)

- Deadlines por chamada para limitar quanto tempo uma requisição pode rodar (vantagem para confiabilidade e segurança)

Observabilidade: logs, métricas e tracing

Para REST, a maioria das plataformas tem logs de acesso prontos, códigos de status e tempo de requisição. Você pode avançar com logs estruturados mais métricas padrão como percentis de latência, taxas de erro e throughput.

Para gRPC, a observabilidade é excelente quando instrumentada, mas pode ser menos “automática” em algumas stacks porque você não está lidando com URLs simples. Priorize:

- Nomenclatura consistente de métodos (service/method) nos logs

- Métricas para códigos de status RPC, latência, retries e tamanhos de mensagens

- Tracing distribuído (OpenTelemetry) para seguir uma requisição de usuário através de vários serviços

Operações: gateways, ingress e malhas de serviço

Setups comuns de REST colocam um ingress ou API gateway na borda, lidando com TLS termination, auth, rate limiting e roteamento.

gRPC funciona bem atrás de um ingress também, mas você frequentemente precisa de componentes que suportem HTTP/2 e recursos do gRPC. Em ambientes de microserviços, uma service mesh pode simplificar mTLS, retries, timeouts e telemetria para gRPC — especialmente quando muitos serviços internos se comunicam entre si.

Resumo operacional: REST normalmente se integra mais suavemente com ferramentas web padrão, enquanto gRPC brilha quando você está pronto para padronizar deadlines, identidade de serviço e telemetria uniforme em chamadas internas.

Cenários comuns e o que escolher

A maioria das equipes não escolhe REST ou gRPC no vácuo — escolhem o que se ajusta ao formato de seus usuários, clientes e tráfego. Esses cenários deixam as trocas mais claras.

Quando REST é o padrão pragmático

REST é frequentemente a escolha segura quando sua API precisa ser amplamente consumível e fácil de explorar.

Use REST quando estiver construindo:

- APIs públicas ou para parceiros onde terceiros desconhecidos vão integrar

- APIs estilo CRUD (usuários, pedidos, produtos) que mapeiam bem para GET/POST/PUT/DELETE

- Endpoints voltados ao navegador onde JSON sobre HTTP é o esperado

- Produtos em estágio inicial em que você quer fricção mínima para clientes e depuração simples (curl, Postman, logs)

REST tende a brilhar nas bordas do seu sistema: é legível, amigável a cache em muitos casos e funciona bem com gateways, documentação e infraestrutura comum.

Quando gRPC é uma vitória clara

gRPC costuma ser mais adequado para comunicação serviço-a-serviço onde eficiência e contratos fortes importam.

Escolha gRPC quando você tiver:

- Comunicação entre microserviços com muitas chamadas internas por requisição

- Fluxos de alta QPS ou sensíveis à latência (recomendações, precificação, checagens antifraude)

- Necessidade de streaming (server, client ou bidirecional)

- Contratos estritos que quer compartilhar entre equipes e linguagens (via Protocol Buffers)

Nesses casos, a codificação binária do gRPC e recursos do HTTP/2 (como multiplexação) frequentemente reduzem overhead e tornam o desempenho mais previsível conforme o tráfego interno cresce.

Quando misturar os dois faz sentido

Uma arquitetura prática comum é:

- REST na borda para clientes web/mobile/parceiros

- gRPC internamente para microserviços e backends de alto throughput

Esse padrão limita as restrições de compatibilidade do gRPC ao seu ambiente controlado, enquanto ainda dá aos sistemas internos os benefícios de contratos tipados e chamadas eficientes.

Anti-padrões para evitar

Algumas escolhas causam dor no futuro:

- “Over-RPC REST”: forçar tudo em endpoints como

/doThing e perder a clareza do design orientado a recursos.

- Adoção prematura de gRPC: migrar para gRPC porque parece mais rápido, quando o problema real são limites mal definidos, serviços chatty ou falta de cache.

- Usar gRPC para acesso amplo de terceiros sem um plano para suporte a navegadores, bibliotecas cliente e onboarding.

Se estiver inseguro, escolha REST para APIs externas e adote gRPC onde conseguir provar que ajuda: dentro da sua plataforma, em caminhos críticos ou onde streaming e contratos rígidos têm valor real.

Checklist prático de decisão para seu próximo projeto

Exporte o código-fonte

Mantenha controle total exportando o código gerado para sua própria pipeline.

Escolher entre REST e gRPC fica mais fácil quando você começa por quem vai usar a API e o que precisam realizar — não pelo que está na moda.

1) Comece pelos consumidores e casos de uso

Pergunte:

- Quem são os consumidores? Apps no navegador, mobile, serviços internos, parceiros externos.

- O que significa “fácil” para eles? Requisições simples com

curl, clientes gerados, documentação estável, SDKs.

- Como a API vai evoluir? Mudanças frequentes, compatibilidade estrita, múltiplas equipes liberando independentemente.

2) Checklist rápido (marque o que importa)

- Necessidades de desempenho: tamanho de payload e latência são críticos (alto QPS, objetos grandes, SLAs apertados)?

- Streaming: precisa de server streaming, client streaming ou updates bidirecionais (chat, telemetria, progresso ao vivo)?

- Compatibilidade de clientes: deve funcionar diretamente em navegadores sem gateways extras? Terceiros precisam de acesso simples?

- Ferramentas & fluxos: suas equipes querem contratos fortemente tipados e clientes gerados, ou JSON flexível e integração manual?

- Operações: sua plataforma consegue rodar HTTP/2 end-to-end e lidar com balanceamento, retries, timeouts e regras de versionamento?

- Observabilidade: tracing, logs e reporting de erro serão simples com suas ferramentas existentes?

Escolha um endpoint representativo (não “Hello World”) e construa:

- REST (JSON sobre HTTP)

- gRPC (protobuf sobre HTTP/2)

Meça:

- Latência (p50/p95), tamanho de payload e CPU no servidor

- Esforço do cliente (linhas de código de glue, tempo de integração)

- Atrito operacional (depuração, proxies/gateways, monitoramento)

Se quiser acelerar esse piloto, um fluxo de prototipagem pode ajudar: por exemplo, no Koder.ai você pode scaffoldar um pequeno app e backend a partir de um prompt de chat, então testar tanto uma superfície REST quanto um serviço gRPC internamente. Como o Koder.ai gera projetos reais (React para web, backends em Go com PostgreSQL, Flutter para mobile), é uma forma prática de validar não só benchmarks de protocolo, mas também a experiência do desenvolvedor — documentação, integração de cliente e deploy. Recursos como modo de planejamento, snapshots e rollback também são úteis ao iterar na forma da API.

4) Documente — e revise

Documente a decisão, as suposições (consumidores, tráfego, streaming) e as métricas usadas. Reavalie quando requisitos mudarem (novos consumidores externos, aumento de throughput, necessidades em tempo real).

FAQ: respostas rápidas a perguntas comuns

“O gRPC é mais rápido que REST?” — o que afeta os resultados

Frequentemente sim — especialmente para chamadas serviço-a-serviço — mas não automaticamente.

gRPC tende a ser eficiente porque usa HTTP/2 (multiplexação muitas chamadas sobre uma conexão) e um formato binário compacto (Protocol Buffers). Isso pode reduzir CPU e banda comparado a JSON-over-HTTP.

O desempenho real depende de:

- Tamanho e forma do payload: campos JSON grandes e repetitivos podem ser mais lentos que Protobuf.

- Condições de rede: latência e estabelecimento de conexão importam tanto quanto throughput.

- Implementação do servidor/cliente: overhead de frameworks, middleware e logging podem dominar.

- Caching e proxies: REST aproveita padrões de cache HTTP mais naturalmente.

Se desempenho é objetivo-chave, faça benchmarks com endpoints e dados realistas.

“Posso usar gRPC em navegadores?” — possibilidades e limitações

Navegadores não conseguem usar gRPC “nativo” diretamente porque não expõem os recursos HTTP/2 em baixo nível que o gRPC espera.

Opções:

- gRPC-Web: funciona no navegador via um proxy compatível, mas tem limitações comparado ao gRPC nativo.

- Gateway REST/JSON: exponha REST para clientes web enquanto mantém gRPC internamente.

Se tiver muitos clientes em navegadores, REST costuma ser a escolha mais direta.

“Preciso de Protobuf?” — quando ajuda

gRPC é projetado em torno de contratos Protobuf, geração de código e tipagem estrita. Você pode usar outros formatos, mas perderá muitos benefícios.

Protobuf ajuda quando você quer contratos claros, payloads menores e código cliente/servidor consistentes.

“Como versionar APIs?” — diretrizes simples para ambos

Para REST, abordagens comuns são /v1/ no caminho ou versionamento via headers; mantenha mudanças compatíveis sempre que possível.

Para gRPC, prefira evoluir mensagens de forma segura: adicione novos campos, evite renomear, e não reutilize números de campo removidos. Quando mudanças forem realmente breaking, publique um novo serviço ou nome de pacote (nova versão major).