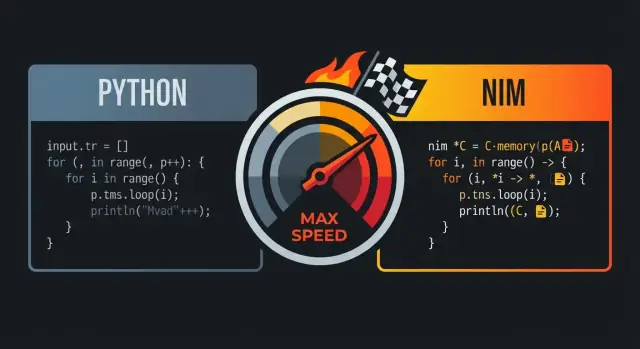

Почему Nim сравнивают с Python и C

Nim сравнивают с Python и C, потому что он стремится занять «золотую середину»: код, который читается как на языке высокого уровня, но компилируется в быстрые нативные исполняемые файлы.

Главное обещание: читаемость плюс скорость

С первого взгляда Nim часто кажется «по- Python‑овски»: чистая структура с отступами, понятный контроль потока и выразительные возможности стандартной библиотеки, которые поощряют ясный компактный код. Ключевое отличие — то, что происходит после написания: Nim спроектирован так, чтобы компилироваться в эффективный машинный код, а не выполняться на тяжёлой runtime‑среде.

Для многих команд это и есть смысл: можно писать код, похожий на то, что вы бы прототипировали на Python, но отгружать как один нативный бинарник.

Для кого это важно

Это сравнение особенно резонирует с:

- Python‑разработчиками, упирающимися в потолок производительности (интенсивные по CPU задачи, tight‑циклы, обработка данных)

- продуктовыми командами, которые хотят быстро итератироваться без привязки к медленному рантайму

- инженерами, которым нравится скорость C, но не хочется повседневно писать низкоуровневый шаблонный код

Что на практике значит «производительность уровня C»

«Производительность уровня C» не означает, что каждая программа на Nim автоматически сравнима с вручную оптимизированным C. Это значит, что Nim может сгенерировать код, конкурентоспособный с C для многих рабочих нагрузок — особенно там, где важны издержки: числовые циклы, парсинг, алгоритмы и сервисы с предсказуемой задержкой.

Наибольшие выигрыши вы увидите, когда убрать накладные расходы интерпретатора, минимизировать аллокации и держать горячие пути простыми.

Ожидания: скорость по-прежнему зависит от выборов

Nim не спасёт неэффективный алгоритм — вы всё ещё можете написать медленный код, если бездумно аллоцируете, копируете большие структуры или игнорируете профайлинг. Обещание в том, что язык даёт путь от читаемого к быстрому коду без необходимости переписывать всё в другой экосистеме.

Результат: язык, который ощущается дружелюбно как Python, но готов «подойти ближе к железу», когда производительность действительно имеет значение.

Синтаксис как у Python: читаемый код без накладных расходов

Nim часто описывают как «похожий на Python», потому что код выглядит и читабельно знакомым образом: блоки через отступы, минимум пунктуации и склонность к понятным высокоуровневым конструкциям. Отличие в том, что Nim остаётся статически типизированным компилируемым языком — вы получаете чистый внешний вид, не платя «налог» рантайма.

Блоки через отступы и чистая структура

Как и в Python, Nim использует отступы для определения блоков, что делает контроль потока удобным для обзора и сравнения изменений. Скобки не нужны повсюду, и редко нужны круглые скобки, если они не повышают понятность.

let limit = 10

for i in 0..<limit:

if i mod 2 == 0:

echo i

Эта визуальная простота важна, когда вы пишете чувствительный к производительности код: меньше времени уходит на борьбу с синтаксисом и больше — на выражение намерения.

Знакомые строительные блоки: циклы, срезы, строки

Многие привычные конструкции очень близки к ожиданиям пользователей Python.

- Циклы:

for по диапазонам и коллекциям ощущается естественно.

- Срезы: последовательности и строки поддерживают операции в стиле срезов.

- Строки: работа со строками простая, стандартная библиотека практична.

let nums = @[10, 20, 30, 40, 50]

let middle = nums[1..3] # slice: @[20, 30, 40]

let s = "hello nim"

echo s[0..4] # "hello"

Ключевое отличие от Python — то, что происходит «под капотом»: эти конструкции компилируются в эффективный нативный код, а не интерпретируются VM.

Статическая типизация, которая не мешает

Nim статически типизирован, но сильно опирается на выведение типов, так что вам не приходится писать громоздкие аннотации, чтобы делать дело.

var total = 0 # inferred as int

let name = "Nim" # inferred as string

Когда вам нужны явные типы (для публичных API, ясности или критичных по производительности границ), Nim поддерживает это аккуратно — без принуждения везде.

Полезные ошибки компилятора и предупреждения

Большая часть поддерживаемого читаемого кода — возможность безопасно поддерживать его. Компилятор Nim строг в полезных смыслах: он выявляет несоответствия типов, неиспользуемые переменные и сомнительные преобразования рано, часто с действенными сообщениями. Эта обратная связь помогает держать код простым как в Python, но с проверками на этапе компиляции и возможностью выпускать быстрые, предсказуемые бинарники — без превращения кода в бойлерплейт.

Если вам нравится читаемость Python, синтаксис Nim покажется родным. Разница в том, что компилятор Nim может проверить ваши допущения и затем выдать быстрый, предсказуемый нативный бинарник.

Как Nim компилируется: от исходников до нативного бинарника

Nim — компилируемый язык: вы пишете .nim‑файлы, а компилятор превращает их в нативный исполняемый файл. Самый распространённый путь — бэкенд C (также возможны C++ или Objective‑C), где Nim‑код транслируется в код бэкенда, а затем компилируется системным компилятором вроде GCC или Clang.

Что на самом деле значит «нативный бинарник»

Нативный бинарник запускается без виртуальной машины и без интерпретатора, проходящего по коду построчно. Это большая часть причины, почему Nim может казаться высокоуровневым, но избегать многих накладных расходов рантайма: время старта обычно быстрое, вызовы функций — прямые, а горячие циклы выполняются близко к железу.

Возможности оптимизации на уровне всей программы

Поскольку Nim компилируется заранее, цепочка инструментов может оптимизировать программу целиком. На практике это даёт лучшее инлайнинг, удаление мёртвого кода и оптимизации на этапе линковки (в зависимости от флагов и вашего C/C++ компилятора). В результате часто получаются меньшие и более быстрые исполняемые файлы — особенно по сравнению со сборкой, которая требует доставки рантайма.

Типичный рабочий цикл: компиляция, запуск, деплой

В ходе разработки вы обычно итеративно выполняете команды вроде nim c -r yourfile.nim (скомпилировать и запустить) или используете разные режимы сборки для отладки и релиза. Когда приходит время деплоя, вы распространяете полученный исполняемый файл (и любые требуемые динамические библиотеки, если вы линковали их). Нет отдельного шага «развёртывать интерпретатор» — ваш результат уже программа, которую ОС может исполнить.

Сила на этапе компиляции: делать работу до запуска программы

Одно из больших преимуществ Nim — возможность выполнять некоторую работу на этапе компиляции (CTFE). Проще говоря: вместо того чтобы вычислять что‑то при каждом запуске, вы просите компилятор вычислить это один раз при сборке и вложить результат в бинарник.

Почему работа на этапе компиляции важна

Временная производительность часто «съедается» затратами на установку: создание таблиц, парсинг известных форматов, проверка инвариантов или предвычисления, которые не меняются. Если результаты предсказуемы из констант, Nim может перенести эти усилия в компиляцию.

Это даёт:

- меньше времени на старте (нет нужды «разогреваться»)

- меньше аллокаций и ветвлений во время выполнения

- более простые пути выполнения (их легче оптимизировать компилятору)

Практические примеры

Генерация таблиц поиска. Если нужен быстрый маппинг (например, классы ASCII‑символов или небольшой хеш‑мап известных строк), таблицу можно сгенерировать во время компиляции и хранить как константный массив. Программа затем делает O(1) поиск без установки.

Ранняя валидация констант. Если константа выходит за допустимый диапазон (номер порта, фиксированный размер буфера, версия протокола), можно провалить сборку вместо того, чтобы выпускать бинарник, который обнаружит проблему позже.

Предвычисление производных констант. Маски, битовые шаблоны или нормализованные значения конфигурации можно посчитать один раз и переиспользовать.

Предостережение: не жертвуйте читаемостью

Логика на этапе компиляции мощна, но это всё ещё код, который должен понимать человек. Предпочитайте небольшие понятные хелперы; добавляйте комментарии, объясняющие «почему сейчас» (компиляция) vs «почему позже» (время выполнения). Тестируйте CTFE‑хелперы так же, как обычные функции, чтобы оптимизации не превращались в трудноотлаживаемые ошибки сборки.

Макросы и метапрограммирование без потери ясности

Макросы Nim — это «код, который пишет код» во время компиляции. Вместо того чтобы выполнять рефлектирную логику во время выполнения (и платить за это каждый запуск), вы можете сгенерировать специализированный типобезопасный Nim‑код один раз, а затем отгрузить быстрый бинарник.

Убираем бойлерплейт (и runtime‑проверки)

Обычное применение — замена повторяющихся паттернов, которые иначе раздули бы кодовую базу или добавили бы накладные расходы при каждом вызове. Например, можно:

- генерировать функции сериализации/десериализации для типа, вместо ручного написания по‑полю

- производить проверку ввода на основе компактной схемы, вместо разбросанных

if по программе

- строить оптимизированную логику диспетчеризации (сопоставление команд с обработчиками) без runtime‑таблиц поиска

Поскольку макрос разворачивает обычный Nim‑код, компилятор всё ещё может инлайнить, оптимизировать и удалять мёртвые ветви — часто абстракция «исчезает» в финальном бинарнике.

Домен‑специфичный синтаксис без кастомного компилятора

Макросы позволяют сделать лёгкий DSL внутри проекта. Команды применяют это для понятного выражения намерения:

- быстрые парсеры: декларативное описание грамматики, макрос эмитит плотный парсер

- сериализаторы: указываете тэги/форматы полей, макрос генерирует упаковку/распаковку

- мини‑DSL для роутинга, построения SQL‑запросов или маппинга конфигураций

При хорошей реализации вы получаете место вызова, читающееся как Python — чисто и прямо — при этом в финале генерируются эффективные циклы и безопасные операции с указателями.

Как сделать макросы поддерживаемыми

Метапрограммирование становится беспорядочным, если превращается в скрытый язык внутри проекта. Несколько правил:

- документируйте, что генерирует макрос, и приводите пример развернутого кода

- держите макросы узкими: решайте одну понятную задачу

- предпочитайте обычные generic/template, когда они подходят; обращайтесь к макросам, когда действительно нужна трансформация AST

Управление памятью: ARC/ORC и предсказуемая производительность

Управление памятью по‑умолчанию в Nim — одна из причин, почему он может ощущаться «как Python», оставаясь языком системного уровня. Вместо классического трассирующего сборщика Nim обычно использует ARC (Automatic Reference Counting) или ORC (Optimized Reference Counting).

ARC/ORC vs трассирующий GC (вкратце)

Трассирующий GC работает «всплесками»: он приостанавливает обычную работу, чтобы пройти по объектам и выяснить, что можно освободить. Эта модель может быть удобна, но паузы сложно предсказать.

С ARC/ORC память чаще освобождается сразу, когда последняя ссылка исчезает. На практике это даёт более предсказуемую задержку и упрощает рассуждения о времени освобождения ресурсов (память, дескрипторы файлов, сокеты).

Почему предсказуемость помогает производительности

Предсказуемое поведение с памятью уменьшает «неожиданные» замедления. Если аллокации и освобождения происходят локально и постоянно — а не в редких глобальных циклах очистки — временные характеристики программы легче контролировать. Это важно для игр, серверов, CLI‑утилит и всего, что должно оставаться отзывчивым.

Это также помогает компилятору оптимизировать: когда времена жизни ясны, компилятор иногда может держать данные в регистрах или на стеке и избегать дополнительной учётной работы.

Стек против кучи, времена жизни и копирование vs перемещение

Упрощённо:

- Значимые (stack) значения короткоживущие и дешёвы в создании; они исчезают при выходе из области видимости.

- Heap‑значения живут дольше и могут шариться между областями, но их аллокация дороже.

Nim позволяет писать высокоуровневый код, при этом контролируя время жизни. Обращайте внимание, копируете ли вы большие структуры (дублирование данных) или перемещаете их (передача владения без копирования). Избегайте ненужных копий в горячих циклах.

Практические советы, чтобы избежать лишних аллокаций

Если хотите «скорость как в C», самая быстрая аллокация — та, которой вы не делаете:

- переиспользуйте буферы (строки, seq, IO) вместо их постоянного пересоздания

- предпочитайте обновления на месте в горячих путях

- строите данные инкрементально с предвыделённой вместимостью, когда это возможно

Эти привычки сочетаются с ARC/ORC: меньше объектов на куче — меньше трафика счётчиков ссылок, больше времени на реальную работу.

Структуры данных и компоновка: скорость от простоты

Nim может быть высокоуровневым, но производительность часто сводится к низкоуровневому вопросу: что выделяется, где это хранится и как расположено в памяти. Правильный выбор формы данных даёт скорость «даром», без написания нечитаемого кода.

Значимые типы vs ref: где происходят аллокации

Большинство типов Nim по умолчанию — значимые: int, float, bool, enum, а также обычные object‑значения. Значимые типы обычно живут inline (на стеке или встроенными в другие структуры), что делает доступ к памяти плотным и предсказуемым.

Когда вы используете ref (например, ref object), вы добавляете уровень косвенности: значение обычно живёт в куче, и вы оперируете указателем на него. Это полезно для шарируемых, длительно живущих или опциональных данных, но в горячих циклах добавляет накладные расходы, потому что процессору приходится переходить по указателям.

Правило: отдавайте предпочтение plain object‑значениям для критичных по производительности данных; используйте ref, когда действительно нужны семантика ссылок.

seq и string: удобно, но знайте издержки

seq[T] и string — динамические изменяемые контейнеры. Они хороши для повседневного программирования, но могут аллоцировать и реаллоцировать при росте. Шаблон издержек:

- добавление может иногда триггерить ресайз (копирование элементов)

- множество маленьких

seq/строк создают много отдельных блоков на куче

Если размеры известны заранее — предустанавливайте (newSeq, setLen) и переиспользуйте буферы, чтобы уменьшить турбулентность.

Почему компоновка важна: простая модель кеша CPU

CPU быстрее работает с смежной памятью. seq[MyObj], где MyObj — plain value, обычно дружелюбен к кешу: элементы лежат рядом. Но seq[ref MyObj] — это список указателей на разбросанные блоки кучи; итерация по такому списку приводит к прыжкам по памяти и замедлению.

Практические советы для горячих путей

Для tight‑циклов и критичных участков кода:

- предпочитайте

array (фиксированный размер) или seq значимых объектов

- держите часто используемые поля вместе в одном

object

- избегайте «цепочек указателей» (

ref в ref), если это не необходимо

Эти решения делают данные компактными и локальными — то, что любят современные CPU.

Абстракции, которые «компилируются в ноль"

Одна из причин, почему Nim позволяет писать высокоуровневый код без большого рантайм‑налога — многие «приятные» языковые возможности спроектированы так, чтобы компилироваться в прямой машинный код. Вы пишете выразительно; компилятор понижает это до плотных циклов и прямых вызовов.

Что означает «нулевая стоимость абстракции" в Nim

Нулевой по стоимости абстрактный слой — это фича, которая облегчает чтение и переиспользование кода, но не добавляет работы во время выполнения по сравнению с ручной низкоуровневой реализацией.

Интуитивный пример — итератор‑API для фильтрации значений, который в финальном бинарнике даёт простой цикл.

proc sumPositives(a: openArray[int]): int =

for x in a:

if x > 0:

result += x

Хотя openArray выглядит гибко и «высокоуровнево», это обычно компилируется в простую проходную итерацию по памяти (без Python‑подобного объектного накладного кода).

Инлайнинг, generics и специализация (по‑простому)

Nim активно инлайнит небольшие процедуры, когда это полезно — тело функции может исчезнуть и быть вставлено в вызов. С generics вы пишете одну функцию для разных типов; компилятор затем специализирует её под каждый конкретный тип, что даёт код столь же эффективный, как вручную написанный подтип‑специфичный вариант.

«Хорошие API», которые всё ещё превращаются в плотные циклы

Паттерны вроде мелких хелперов (mapIt, filterIt), типов‑обёрток и проверок диапазонов могут быть оптимизированы, если компилятор видит через них. В итоге вы получите один цикл с минимальными ветвлениями.

Главное исключение: абстракции, которые заставляют аллоцировать

Абстракции перестают быть бесплатными, когда они создают аллокации или скрытое копирование. Возврат новых последовательностей в циклах, построение временных строк в горячих путях или захват больших замыканий может добавить значимую накладную.

Правило: если абстракция аллоцирует на каждом шаге, она может доминировать в затратах времени. Предпочитайте соответствующие по стеку структуры, переиспользуйте буферы и следите за API, которые молча создают seq или string в горячих путях.

Интероперабельность с C: переиспользование производительности и экосистемы

Практическая причина, по которой Nim может «чувствоваться высокоуровневым», оставаясь быстрым — возможность напрямую вызывать C. Вместо переписывания надёжной C‑библиотеки, вы можете импортировать её заголовки, линковать с скомпилированной библиотекой и вызывать функции почти как родные Nim‑процедуры.

Как выглядит FFI Nim (вкратце)

FFI Nim основывается на описании C‑функций и типов, которые вы хотите использовать. В большинстве случаев вы либо:

- объявляете C‑символы в Nim с

importc (указывает на точное имя в C), либо

- используете инструменты для генерации Nim‑описаний из заголовков C

После этого компилятор Nim линкует всё в единый бинарник, и накладные расходы на вызов минимальны.

Почему это важно: переиспользование без переписывания

Это даёт доступ к зрелым экосистемам: сжатие (zlib), криптопримитивы, кодеки изображений/звука, клиенты баз данных, API ОС и производительные утилиты. Вы сохраняете читаемую структуру приложения на Nim и при этом опираетесь на проверенный C для тяжёлой работы.

Подводные камни: владение и преобразования

Ошибки в FFI обычно возникают из несовпадающих ожиданий:

- Правила владения: кто выделяет и кто освобождает память? Если C возвращает указатель, который надо освободить — нужно явно это делать в Nim. Если C хранит указатель на вашу память, нужно гарантировать её жизнь.

- Строки и буферы: Nim‑строки не равны C‑строкам. Конвертация в

cstring проста, но нужно обеспечить нуль‑терминацию и время жизни. Для бинарных данных лучше явные пары ptr uint8 + длина.

Оборачивайте C‑API безопасно (и тестируемо)

Хорошая практика — написать небольшую Nim‑обёртку, которая:

- экспортирует идиоматичные Nim‑процедуры и типы,

- централизует конверсии и обработку ошибок,

- прячет сырые указатели за RAII‑подобными хелперами (

defer, деструкторы) при необходимости.

Это упрощает юнит‑тестирование и снижает шанс утечки низкоуровневых деталей в остальной код базы.

Набор инструментов производительности: режимы сборки, флаги и профилирование

Nim может казаться быстрым «по‑умолчанию», но последние 20–50% часто зависят от того, как вы строите и как измеряете. Хорошая новость: компилятор Nim открывает контролируемые возможности оптимизации доступным способом, даже если вы не эксперт по системному программированию.

Режимы сборки, которые имеют значение

Для реальных замеров избегайте debug‑сборок. Начните с релизной сборки и включайте дополнительные проверки только при поиске багов.

nim c -d:release --opt:speed myapp.nim

nim c -d:danger --opt:speed myapp.nim

nim c -d:release --opt:speed --passC:-march=native myapp.nim

Простое правило: используйте -d:release для бенчмарков и продакшна, а -d:danger — только когда вы уже уверены тестами.

Профилирование: измеряйте сначала, оптимизируйте потом

Практический поток:

- Измерьте end‑to‑end в первую очередь (время выполнения, память, пропускная способность). Инструменты вроде

hyperfine или просто time часто достаточны.

- Найдите горячие точки. Nim поддерживает встроенное профилирование (

--profiler:on) и хорошо работает с внешними профайлерами (Linux perf, macOS Instruments, Windows‑инструменты), потому что вы получаете нативный бинарник.

- Оптимизируйте самые горячие 1–2 функции, затем снова измерьте.

При использовании внешних профайлеров собирайте с debug‑информацией для читабельных стектрейсов:

nim c -d:release --opt:speed --debuginfo myapp.nim

Микро‑оптимизации, которых стоит избегать

Искушение править мелочи (ручной разворот циклов, перестановка выражений, «умные» трюки) до появления данных велико. В Nim более значимые выигрыши обычно приходят от:

- лучшего алгоритма,

- уменьшения аллокаций и копирований,

- улучшения компоновки данных (смежные последовательности там, где возможно),

- уменьшения накладных в критичных циклах.

Бенчмарки в CI и регрессии производительности

Регрессии легче фиксировать, когда их ловят рано. Лёгкий подход — добавить небольшой набор бенчмарков (например, задачей Nimble nimble bench) и запускать их в CI на стабильном раннере. Храните базовые значения (хоть в JSON) и фейлите сборку, если ключевые метрики уходят за допустимый порог. Это помогает не допустить «быстро сегодня» → «медленно завтра».

Где Nim хорош (и где стоит быть осторожным)

Nim отлично подходит, когда вы хотите код, читаемый как на высокоуровневом языке, но отгружаемый как быстрый нативный исполняемый файл. Он вознаграждает команды, которые заботятся о производительности, простоте деплоя и контроле зависимостей.

Идеальные сценарии

Для многих команд Nim хорош в «продуктовых» инструментах — том, что вы компилируете, тестируете и распространяете.

- CLI и dev‑утилиты: один нативный бинарник, быстрый старт, низкие накладные для старта.

- Сетевые инструменты и сервисы: хорошая пропускная способность и предсказуемая задержка при сохранении читабельности.

- Инструменты для игр и пайплайны: конвертеры ассетов, билд‑утилиты, редакторы и автоматизация, где нужна скорость, но не хочется сложности C/C++.

Случаи, требующие осторожности

Nim может быть менее подходящим, когда успех зависит от высокой динамичности рантайма, а не от компилируемой производительности.

- Сильно динамичные плагинные системы: загрузка/выгрузка множества сторонних расширений на ходу может добавить трения в модель компилируемого кода.

- Быстрые одноразовые скрипты: если рабочий цикл — «правлю, запускаю сразу, выбрасываю», Python или shell‑скрипты быстрее для совсем мелких задач.

Командные соображения

Nim доступен, но у него есть кривая обучения.

- Договоритесь о стилях рано (структура модулей, обработка ошибок, нейминг), чтобы не получилось «кто пишет Nim — тот пишет по‑своему».

- Планируйте онбординг: парное программирование и внутренняя краткая шпаргалка помогают больше, чем толстые руководства.

- Будьте реалистичны по экосистеме: некоторых библиотек может не быть так много, как в Python.

Подход пилотного проекта

Выберите маленький измеримый проект — например, переписать медленный шаг CLI или сетевую утилиту. Определите метрики успеха (время выполнения, память, время сборки, размер деплоя), отдеструйте для небольшой внутренней аудитории и решите по результатам, а не по хайпу.

Если Nim‑части нужны внешние «окраины» продукта — админка, UI для бенчмарков или шлюз — инструменты вроде Koder.ai могут помочь быстро «обвязать» эти части. Вы можете сделать React‑фронтенд и бэкенд на Go + PostgreSQL, а Nim‑бинарник — как сервис по HTTP, сохранив критичное ядро в Nim.

Практический чек‑лист: Python‑подобный код при C‑скорости

Nim заслужил репутацию «как Python, но быстрый», сочетая понятный синтаксис с оптимизирующим нативным компилятором, предсказуемым управлением памятью (ARC/ORC) и культурой внимания к компоновке данных и аллокациям. Если хотите выгоды по скорости, не превращая кодовую базу в низкоуровневую мешанину, используйте этот чек‑лист как повторяемый рабочий процесс.

Чек‑лист, ориентированный на скорость (без потери ясности)

- Компилируйте как надо: используйте релизную сборку для реальных измерений.

- стартуйте с

-d:release и рассмотрите --opt:speed.

- включайте оптимизации на этапе линковки при необходимости (

--passC:-flto --passL:-flto).

- Выбирайте структуры данных осознанно: отдавайте предпочтение простым, смежным представлениям.

seq[T] удобен, но tight‑циклы часто выигрывают от array, openArray и избегания лишних ресайзов.- держите горячие данные маленькими и рядом; меньше указателей — меньше промахов кеша.

- Будьте внимательны к аллокациям: ARC/ORC помогает, но он не уберёт лишнюю работу.

- переиспользуйте буферы, предвыделяйте (

newSeqOfCap), избегайте времен��х строк в циклах.

- следите за скрытыми копиями при срезах или конкатенации.

- Дайте абстракциям «скомпилироваться в ноль»: пишите чистый код, а потом проверяйте его.

- предпочитайте итераторы/шаблоны для выразительности, но проверьте их инлайнинг в релиз‑сборках.

- Измеряйте до оптимизации: профилируйте, чтобы найти реальные горячие точки.

- если вы новичок в профилировании, смотрите /blog/performance-profiling-basics.

Следующие шаги: проверьте это на своей машине

- Попробуйте небольшой бенчмарк: выберите функцию, которая реально что‑то делает (парсинг, фильтрация, математика) и сравните debug vs release.

- Отправьте одну реальную фичу в продакшн: реализуйте небольшой модуль целиком, потом оптимизируйте только горячий путь (а не весь код).

Если вы всё ещё выбираете между языками, /blog/nim-vs-python поможет сопоставить компромиссы. Для команд, оценивающих инструменты и поддержку, можно также посмотреть /pricing.