12 нояб. 2025 г.·4 мин

От некоммерческой лаборатории к лидеру ИИ: история OpenAI

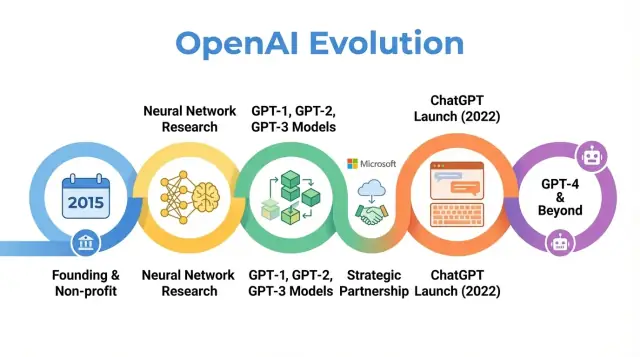

Изучите историю OpenAI — от некоммерческой лаборатории и ключевых исследований до запуска ChatGPT, GPT‑4 и эволюции её миссии.

Обзор: почему история OpenAI важна

OpenAI — компания по исследованию и развёртыванию ИИ, чья работа сформировала представления о том, как люди думают об искусственном интеллекте: от ранних научных статей до продуктов вроде ChatGPT. Понимание того, как OpenAI эволюционировала — от небольшой некоммерческой лаборатории в 2015 году до центрального игрока в сфере ИИ — помогает объяснить, почему современный ИИ выглядит так, как он выглядит сегодня.

История OpenAI — это не просто последовательность выпусков моделей. Это пример того, как миссия, стимулы, технические прорывы и общественное давление взаимодействуют. Организация начинала с сильным акцентом на открытые исследования и широкую пользу, затем реструктурировалась, чтобы привлечь капитал, сформировала глубокое партнёрство с Microsoft и запустила продукты, которыми пользуются сотни миллионов людей.

Почему эта история важна

Прослеживание истории OpenAI освещает несколько более широких тенденций в ИИ:

-

Миссия и ценности: OpenAI была основана с заявленной целью обеспечить, чтобы AGI приносил пользу всему человечеству. То, как эта миссия интерпретировалась и пересматривалась со временем, показывает напряжение между идеалистическими целями и коммерческими реалиями.

-

Исследовательские прорывы: Переход от ранних проектов к системам вроде GPT‑3, GPT‑4, DALL·E и Codex отражает более широкое смещение в сторону крупномасштабных foundation‑моделей, которые сегодня лежат в основе многих приложений ИИ.

-

Управление и структура: Переход от чисто некоммерческой структуры к организации с ограниченной прибылью и создание сложных механизмов управления подчёркивают, какие новые организационные формы испытываются для управления мощными технологиями.

-

Общественное влияние и контроль: С выпуском ChatGPT и других продуктов OpenAI превратилась из лаборатории, известной в узких AI‑кругах, в общеизвестный бренд, что привлекло внимание к вопросам безопасности, согласования и регулирования, формирующим нынешние политические дискуссии.

Эта статья прослеживает путь OpenAI с 2015 года до её последних событий, показывая, как каждый этап отражает более широкие сдвиги в исследованиях, экономике и управлении ИИ — и что это может значить для будущего отрасли.

Основание OpenAI: миссия и ранняя команда

Момент 2015 года в ИИ

OpenAI была основана в декабре 2015 года, в момент, когда машинное обучение — особенно глубокое обучение — быстро развивалось, но всё ещё было далеко от общей интеллекта. Падали рекорды в задачах распознавания изображений, улучшались речевые системы, и компании вроде Google, Facebook и Baidu активно инвестировали в ИИ.

У многих исследователей и лидеров отрасли росла обеспокоенность, что продвинутый ИИ может оказаться в руках нескольких крупных корпораций или государств. OpenAI задумывалась как противовес: исследовательская организация, ориентированная на долгосрочную безопасность и широкое распределение выгод ИИ, а не на узкое коммерческое преимущество.

Миссия: AGI на благо всех

С первого дня OpenAI определяла свою миссию в терминах искусственного общего интеллекта (AGI), а не только поэтапного прогресса в машинном обучении. Основное утверждение заключалось в том, что OpenAI будет работать над тем, чтобы AGI, если он будет создан, «приносил пользу всему человечеству».

Эта миссия влекла за собой несколько конкретных последствий:

- Приоритет на исследования по безопасности и долгосрочным вопросам согласования

- Обязательство по максимально широкому распространению исследований, кода и идей там, где это возможно

- Избегание динамики «победитель получает всё» через сотрудничество с другими институтами

Ранние публичные блоги и учредительная хартия подчёркивали одновременно открытость и осторожность: OpenAI публиковала многое из своей работы, но также учитывала общественные последствия выпуска мощных возможностей.

Основатели, ранние лидеры и структура

OpenAI стартовала как некоммерческая исследовательская лаборатория. Первоначальные финансовые обязательства оценивались примерно в $1 млрд в виде обещанных инвестиций, хотя это были долгосрочные обещания, а не единовременные выплаты. Ключевые ранние спонсоры включали Илона Маска, Сэма Олтмана, Рейда Хоффмана, Питера Тиля, Джессику Ливингстон и YC Research, а также поддержку со стороны компаний вроде Amazon Web Services и Infosys.

Ранняя руководящая команда сочетала опыт стартапов, исследований и операционной деятельности:

- Сэм Олтман — сооснователь и первоначальный председатель правления (впоследствии CEO)

- Илон Маск — сооснователь и ранний донор, член правления в начальный период

- Грег Брокман — бывший CTO Stripe, присоединился как CTO и сооснователь

- Илья Сутскевер — ведущий исследователь по глубокому обучению, занял пост главного учёного

- Войцех Заремба и Джон Шульман — сооснователи и ключевые руководители исследований

Это сочетание предпринимательского духа Кремниевой долины и ведущих исследовательских кадров сформировало раннюю культуру OpenAI: амбициозность в продвижении границ возможностей ИИ при сохранении миссии не ради немедленной коммерциализации, а ради долгосрочного глобального влияния.

Эра некоммерческой деятельности: ранние исследования и открытая наука

Когда OpenAI стартовала в 2015 году как некоммерческая лаборатория, её публичное обещание было простым, но амбициозным: развивать искусственный интеллект, максимально делясь результатами с научным сообществом.

Открытость по умолчанию

Ранние годы характеризовались философией «открытость по умолчанию». Научные статьи публиковались оперативно, код обычно выкладывался в открытый доступ, а внутренние инструменты перерабатывались в публичные проекты. Идея заключалась в том, что ускорение общего научного прогресса — вместе с общественной проверкой — будет безопаснее и полезнее, чем концентрация возможностей в одной компании.

В то же время вопросы безопасности уже присутствовали в обсуждении. Команда рассуждала о том, когда открытость может повысить риск злоупотреблений, и начала формировать идеи для поэтапного выпуска и политических обзоров, пусть эти механизмы были ещё более неформальными по сравнению с последующими процессами управления.

Флагманские направления исследований

Ранние научные направления OpenAI охватывали несколько ключевых областей:

- Подкрепляющее обучение (RL): работа над агентами, осваивающими игры вроде Dota 2 и сложные задачи управления, способствовала развитию алгоритмов RL, методов исследования и масштабируемости.

- Робототехника: эксперименты с роботизированными руками и задачами манипуляции показывали, как RL и симуляция могут переноситься в физический мир.

- Безнадзорное и самонаблюдаемое обучение: исследования о том, как модели могут учиться на больших неразмеченных данных, предвосхищали появление foundation‑моделей.

Эти проекты были направлены не на готовые продукты, а на проверку возможного с помощью глубокого обучения, вычислений и продуманных режимов обучения.

Инструменты, формировавшие сообщество

Два самых влиятельных результата этой эпохи — OpenAI Gym и Universe.

- OpenAI Gym предоставил стандартный набор сред и бенчмарков для RL. Он упростил сравнение алгоритмов и резко снизил входной порог для новых лабораторий и студентов.

- Universe ставил задачу обучать и оценивать агентов в большом разнообразии существующего программного обеспечения — от игр до веб‑приложений. Хотя Universe со временем был свернут, он кристаллизовал интерес к универсальным агентам.

Оба проекта отражали приверженность к совместной инфраструктуре, а не к проприетарному преимуществу.

Восприятие OpenAI сообществом и СМИ

В этот некоммерческий период OpenAI часто изображали как организацию, движимую миссией, и как противовес крупным технологическим лабораториям. Коллеги ценили качество исследований, доступность кода и сред, а также готовность обсуждать вопросы безопасности.

Медиа подчёркивали необычное сочетание известных финансистов, некоммерческой структуры и обещания публиковать материалы открыто. Эта репутация — влиятельной открытой лаборатории, озабоченной долгосрочными последствиями — сформировала ожидания, которые позже повлияли на реакцию на каждое стратегическое изменение внутри организации.

Создание мощных моделей: от GPT‑1 до GPT‑3

Итерации с безопасными откатами

Сохраняйте прогресс с помощью снимков и откатывайтесь, если эксперимент пойдёт не по плану.

Поворотный момент в истории OpenAI — решение сосредоточиться на крупных трансформер‑моделях для обработки языка. Этот сдвиг превратил OpenAI из в первую очередь исследовательской лаборатории в компанию, известную foundation‑моделями, на которых строят другие.

GPT‑1: доказательство идеи трансформера (2018)

GPT‑1 был скромным по современным меркам — 117 миллионов параметров, обучен на BookCorpus — но он дал важное доказательство концепции.

Вместо обучения отдельных моделей для каждой NLP‑задачи GPT‑1 показал, что единая трансформер‑модель, обученная задаче предсказания следующего слова, может с минимальной донастройкой решать задачи вроде вопросно‑ответных систем, анализа тональности и дедукции текста.

Для внутренней дорожной карты OpenAI GPT‑1 подтвердил три идеи:

- Масштаб имеет значение: большие модели на большем объёме данных показывают лучшие и более общие результаты.

- Предобучение + донастройка превосходит узконаправленные системы.

- Трансформеры — мощная архитектура для работы с языком.

GPT‑2: возможности и опасения по поводу злоупотреблений (2019)

GPT‑2 значительно расширил ту же идею: 1.5 миллиарда параметров и гораздо больший набор данных, собранный из интернета. Его тексты часто были поразительно связными: многоабзацные статьи, художественные рассказы и сводки, похожие на человеческую авторскую работу.

Такие возможности вызвали тревогу по поводу потенциальных злоупотреблений: автоматизированная пропаганда, спам, домогательства и фальшивые новости в масштабе. Вместо немедленного полного выпуска OpenAI приняла стратегию поэтапного релиза:

- Первичный выпуск уменьшенной модели с технической статьёй и примерами

- Продолжение внутреннего и внешнего ред‑тиминга для изучения рисков

- Постепенный выпуск более крупных версий по мере оценки рисков

Это был один из первых заметных примеров того, как OpenAI явно связывала решения о развертывании с вопросами безопасности и социального воздействия.

GPT‑3: масштаб, универсальность и API (2020)

GPT‑3 снова увеличил масштаб — до 175 миллиардов параметров. Вместо активного использования донастройки для каждой задачи GPT‑3 продемонстрировал способность «few‑shot» и даже «zero‑shot» обучения: модель часто могла выполнять новую задачу просто по инструкциям и нескольким примерам в подсказке.

Такая универсальность изменила представления OpenAI и всей отрасли о системах ИИ. Вместо множества узких моделей одна большая модель могла служить общим движком для:

- Копирайтинга и генерации контента

- Автодополнения и фрагментов кода

- Ответов на вопросы, чата и дополнения к поиску

Ключевым решением было не публиковать GPT‑3 в открытом доступе. Доступ предоставлялся через коммерческое API. Это означало стратегический поворот:

- От публикации моделей к их эксплуатации как управляемого сервиса

- От чистой исследовательской лаборатории к платформенному провайдеру с платящими клиентами

- От демонстраций к развитию экосистемы разработчиков, строящих решения на моделях OpenAI

GPT‑1, GPT‑2 и GPT‑3 демонстрируют явную траекторию в истории OpenAI: масштабирование трансформеров, обнаружение неожиданных способностей, борьба за безопасность и злоупотребления и создание коммерческой базы, которая позже поддержит продукты вроде ChatGPT и развитие GPT‑4.

FAQ

Почему была основана OpenAI?

OpenAI была основана в 2015 году как некоммерческая исследовательская лаборатория с миссией обеспечить, чтобы искусственный общий интеллект (AGI), если он будет создан, приносил пользу всему человечеству.

На формирование её создания повлияли несколько факторов:

- Ожидание, что мощный ИИ может оказаться под контролем небольшого числа компаний или правительств

- Желание ставить безопасность и согласование целей на долгосрочную перспективу выше краткосрочной прибыли

- Интерес к ускорению открытых и совместных исследований вместо закрытых проприетарных систем

Эта история основания продолжает влиять на структуру OpenAI, её партнёрства и публичные обязательства по сей день.

Что OpenAI понимает под AGI и в чём состоит её миссия?

AGI (artificial general intelligence) — это термин для систем ИИ, способных выполнять широкий набор когнитивных задач на уровне человека или выше, а не узкие инструменты, оптимизированные для одной задачи.

Миссия OpenAI заключается в том, чтобы:

- Помогать в создании AGI, который будет широко полезен, а не захвачен небольшой группой

- Сосредоточиться на безопасности и согласовании, чтобы мощные системы вели себя в соответствии с человеческими ценностями

- Распределять выгоды как можно шире — через исследования, партнёрства и программы доступа

Эта миссия формализована в и влияет на ключевые решения о направлениях исследований и развертывании.

Почему OpenAI перешла от некоммерческой модели к модели с ограниченной прибылью?

OpenAI перешла от чисто некоммерческой организации к структуре "capped‑profit" (ограниченная прибыль), OpenAI LP, чтобы привлечь большие капиталы, необходимые для передовых исследований в ИИ, не теряя формально приоритет миссии.

Ключевые моменты:

- Инвесторы и сотрудники могут получить доход, но только до заранее установленного потолка

- Некоммерческий центр остаётся материнской структурой и должен ставить интересы человечества выше частных выгод

- Эта модель пытается сочетать доступ к финансам и талантам с механизмами сдерживания бесконтрольной коммерциализации

Это эксперимент в области управления — его эффективность остаётся предметом обсуждения.

Что Microsoft получает от партнёрства с OpenAI?

Microsoft предоставила OpenAI масштабные облачные мощности через Azure и вложила миллиарды долларов.

Партнёрство включает:

- Специальную суперкомпьютерную инфраструктуру для обучения крупных моделей, таких как GPT‑4

- Исключительные лицензионные права на некоторые технологии (например, GPT‑3) для продуктов Microsoft

- Интеграцию моделей OpenAI в сервисы Microsoft — GitHub Copilot, Bing, Microsoft 365 и др.

В обмен OpenAI получает ресурсы, необходимые для обучения и развертывания передовых моделей в глобальном масштабе, а Microsoft — дифференцированные ИИ‑возможности для своей экосистемы.

Как GPT‑1, GPT‑2, GPT‑3 и GPT‑4 повлияли на траекторию OpenAI?

Серия GPT изменила траекторию OpenAI по масштабу, возможностям и стратегии развертывания:

- GPT‑1 (2018): Небольшая по сегодняшним меркам модель, но доказала, что трансформеры, обученные продолжению текста, могут обобщать на разные NLP‑задачи.

- GPT‑2 (2019): Значительно больше; тексты становились убедительными, что вызвало опасения по поводу злоупотреблений и привело к поэтапным выпускам.

Почему OpenAI сегодня менее «открыта», чем в начале?

OpenAI начинала с принципа «открытость по умолчанию»: публикация статей, кода и инструментов вроде OpenAI Gym. По мере роста возможностей моделей компания смещалась в сторону:

- Ограниченных или отсроченных выпусков полных весов моделей

- Доступа через API вместо скачивания моделей

- Увеличения внимания к оценкам безопасности и системным картам вместо публикации всех технических деталей

OpenAI объясняет это необходимостью снижать риски злоупотреблений и повышать безопасность. Критики считают, что это подрывает первоначальные обещания, заложенные в названии «OpenAI», и концентрирует власть в одной компании.

Как OpenAI пытается сделать свои системы безопасными и согласованными?

OpenAI применяет сочетание организационных и технических мер для управления безопасностью и согласованием:

- Хартия, подтверждающая обязательство по созданию широко полезного AGI и сотрудничеству по безопасности

- Выделенные команды по безопасности, согласованию, политике и ред‑тимингу, влияющие на решения о запуске и доступе

- Технические методы: reinforcement learning from human feedback (RLHF), фильтры контента и системы мониторинга

- Поэтапные запуски и дифференцированные уровни доступа для более рискованных возможностей

Эти меры снижают риски, но не устраняют такие проблемы, как галлюцинации, смещения и потенциальное злоупотребление — это остаётся активной областью исследований и управления.

Почему выпуск ChatGPT стал таким важным событием для OpenAI и ИИ в целом?

Запуск ChatGPT в конце 2022 года стал поворотным моментом, потому что сделал крупные языковые модели доступными широкой публике через простой чат‑интерфейс.

Это изменило принятие ИИ следующим образом:

- Превратило исследовательскую технологию в повседневный инструмент для письма, кодирования и обучения

- Быстро познакомило миллионы людей с возможностями разговорного ИИ

- Принудило институты (школы, компании, регуляторы) решать практические вопросы о плагиате, приватности, предвзятости и зависимости от ИИ

Публичная видимость усилила внимание к управлению, бизнес‑модели и практикам безопасности OpenAI.

Как технологии OpenAI могут повлиять на занятость и творческую работу?

Технологии OpenAI, особенно Codex и GPT‑4, уже меняют части знаний и творческой работы:

Потенциальные выгоды:

- Автоматизация рутинных задач письма и программирования

- Помощь в создании набросков, мозговых штурмах и переводах

- Расширение доступа к образованию и экспертным знаниям через разговорные тьюторы

Риски и опасения:

Как людям и организациям ответственно взаимодействовать с OpenAI сегодня?

Вы можете взаимодействовать с экосистемой OpenAI несколькими способами:

- Как пользователь: пробуйте ChatGPT и другие инструменты, изучайте их сильные и слабые стороны и рассматривайте ответы как черновики, требующие проверки.

- Как разработчик или бизнес: используйте API OpenAI для создания продуктов, но добавляйте собственные проверки безопасности, логирование и доменные правила.

- Как гражданин или исследователь: следите за документацией, отчётами по безопасности и Хартией OpenAI; участвуйте в публичных консультациях, аудите и критических исследованиях.

Во всех случаях полезно оставаться информированным о том, как обучаются модели и как они управляются, а также добиваться прозрачности, подотчётности и справедливого доступа к этим системам.

Почему OpenAI создала структуру OpenAI LP и модель с "capped‑profit"?

Переход к OpenAI LP в 2019 году был ответом на потребность в крупном финансировании и талантах для обучения масштабных моделей. Обучение передовым моделям требует десятков и сотен миллионов долларов на вычисления и инфраструктуру, а также конкурентных условий для найма исследователей.

Модель с ограниченной прибылью позволяла:

- Привлекать внешние инвестиции и предложить сотрудникам механизмы вознаграждения

- Сохранить контроль за миссией через некоммерческий материнский орган, который контролирует LP

Эта структура — компромисс, стремящийся сочетать доступ к капиталу и защиту миссии, но её долгосрочная эффективность остаётся предметом дебатов.

Как изменилась практика раскрытия исследований и почему?

OpenAI в ранние годы публиковала исследования, открывала код и предоставляла инструменты вроде OpenAI Gym. По мере того как модели становились мощнее, компания ввела более осторожный подход к раскрытию:

- Стадированный выпуск больших моделей (пример — GPT‑2)

- Доступ через коммерческое API вместо открытого распространения весов

- Публикация оценок безопасности, карт систем и политик вместо всех технических деталей

OpenAI объясняет это стремлением снизить риски злоупотреблений и обеспечить безопасность. Критики считают, что это расходится с первоначальными обещаниями открытости и концентрирует влияние.

Какие направления исследований были ключевыми в первые годы OpenAI?

Главные направления ранних исследований OpenAI включали:

- Подкрепляющее обучение (RL): агенты, обучающиеся в сложных играх и задачах управления, что продвигало методы исследования и масштабируемость.

- Робототехника: эксперименты с манипуляторами и симуляцией, которые демонстрировали перенос RL в физический мир.

- Самообучение и безнадзорное обучение: изучение моделей, способных извлекать знания из больших нерелевантно размеченных данных — предтеча foundation‑моделей.

Эти направления были направлены не на коммерческие продукты, а на исследование пределов возможного с глубинным обучением и вычислительными ресурсами.

Что дали миру CLIP, DALL·E и Codex?

CLIP, DALL·E и Codex показали, что подход OpenAI можно применить не только к тексту:

- CLIP: связал изображения и язык, обучившись на парах «изображение‑подпись», и стал универсальным визуальным бэком для других систем.

- DALL·E / DALL·E 2: генерировали изображения по текстовым подсказкам, добавив возможности редактирования (inpainting) и расширения (outpainting).

- Codex: адаптировал GPT для кода, переводя естественный язык в рабочие фрагменты кода; на его основе появился GitHub Copilot.

Эти разработки расширили влияние OpenAI на дизайн, творчество и разработку ПО.

Как партнёрство с Microsoft повлияло на инфраструктуру OpenAI?

Партнёрство с Microsoft привело к созданию крупной вычислительной инфраструктуры на Azure, специально оптимизированной под обучение больших моделей:

- Azure предоставил масштаб и специализированное оборудование для кластеров обучения

- Совместная разработка ускорила оптимизацию сети, хранения и оркестрации для больших моделей

- Microsoft получил эксклюзивные права на некоторые технологии, а OpenAI — доступ к ресурсам и каналам распространения

Это сделало Azure де‑факто базовой платформой для обучения и развёртывания моделей OpenAI.

Как ChatGPT быстро стал таким популярным и что последовало за запуском?

ChatGPT первоначально запустили как бесплатный «исследовательский превью» 30 ноября 2022 года, чтобы снизить трение и собрать отзывы о провалах, злоупотреблениях и недостатках.

Первые недели показали взрывной рост использования: миллионы пользователей попробовали сервис в краткие сроки. Это быстро привело к:

- Массовому использованию в образовании, на работе и в быту

- Давлению по инфраструктурным расходам и потребности в более надёжном доступе

В феврале 2023 года появился платный план ChatGPT Plus для обеспечения приоритетного доступа и средств на поддержку сервиса, а позже — корпоративные и API‑решения.

Какая критика и противоречия сопровождали рост OpenAI?

Среди вызовов и критики OpenAI часто упоминают вопросы власти, данных и коммерциализации:

- Концентрация вычислительных ресурсов и передовых моделей в руках нескольких компаний вызывает опасения по поводу централизации влияния.

- Коммерциализация (подписки, корпоративные продукты, эксклюзивные лицензии) вызывает вопросы о соответствии первоначальной миссии широкого блага.

- Внутренние трения и уходы ключевых сотрудников подчёркивают разногласия по скорости развертывания и приоритетам безопасности.

Руководство OpenAI отстаивает доходы как необходимое условие для финансирования дорогостоящих исследований, одновременно сохраняя формальные механизмы контроля для защиты миссии.