12 нояб. 2025 г.·8 мин

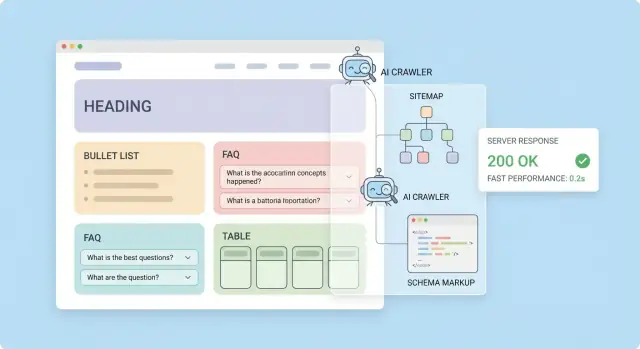

Подготовьте сайт для AI‑краулеров и индексации LLM

Узнайте, как структурировать контент, метаданные, правила обхода и производительность, чтобы AI‑краулеры и инструменты LLM могли надёжно обнаруживать, парсить и цитировать ваши страницы.

Что на самом деле означает «оптимизация под AI»

«Оптимизация под AI» часто звучит как модное словосочетание, но на практике это означает, что ваш сайт легко для автоматических систем находить, читать и точно повторно использовать.

Когда говорят про AI‑краулеры, обычно имеют в виду ботов, которыми управляют поисковые системы, AI‑продукты или провайдеры данных, — они извлекают страницы для функций вроде сводок, ответов, тренировочных наборов данных или систем поиска. Индексация для LLM обычно означает превращение ваших страниц в поискуемый хранилище знаний (часто «разбитое» на отрывки с метаданными), чтобы AI‑ассистент мог найти нужный отрывок и корректно процитировать или привести его.

Реальные цели

Оптимизация для AI — это меньше про «рейтинг», больше про четыре результата:

- Обнаружение: краулеры могут надёжно добраться до ваших важных URL.

- Разбор: контент читается без догадок (чистый HTML, предсказуемая структура).

- Атрибуция/цитирование: явно видно, кто написал материал, когда он обновлён и на какие источники опирается.

- Качество поиска: отрывки самодостаточны, конкретны и легко сопоставимы с запросом.

Установите ожидания (и что вы можете контролировать)

Никто не может гарантировать включение в конкретный AI‑индекс или модель. Разные провайдеры сканируют по‑разному, следуют разным правилам и обновляются с разной частотой.

То, что вы можете контролировать — это сделать контент простым для доступа, извлечения и атрибуции — чтобы, если его используют, использовали правильно.

Что вы реализуете к концу процесса

- Сайт, доступный для обхода с понятными правилами доступа (robots и мета‑директивы)

- Чистая практика URL и каноникализации для снижения дубликатов

- Карты сайта и внутренние ссылки, которые быстро выводят важные страницы

- Контент, форматированный на «чанки», понятные машинам

- Структурированные данные, помечающие, о чём каждая страница

- Простой файл

llms.txtдля ориентирования LLM‑фокусированных краулеров - Производительность и ответы сервера, которые избегают таймаутов краулеров

- Сигналы доверия (авторы, даты, источники, владение), поддерживающие цитирование

- Рутинные тесты для проверки того, что боты действительно видят

Если вы часто создаёте новые страницы и потоки, полезно выбирать инструменты, которые не противоречат этим требованиям. Например, команды, использующие Koder.ai (чат‑ориентированную платформу в стиле кодинга, которая генерирует React‑фронтенды и бэкенды на Go/PostgreSQL), часто изначально встраивают шаблоны, дружественные к SSR/SSG, стабильные маршруты и последовательные метаданные — так «готовность к AI» становится правилом, а не переделкой.

Структура контента, которую LLM легко разбирают

LLM и AI‑краулеры не интерпретируют страницу как человек. Они извлекают текст, выводят отношения между идеями и пытаются сопоставить вашу страницу с одной ясной целью. Чем предсказуемее структура, тем меньше неверных предположений им придётся делать.

Как выглядит «идеальная» страница

Начните с того, чтобы страницу было легко сканировать в простом тексте:

- Явный H1, отражающий основное обещание страницы

- Короткие разделы с описательными заголовками

- Минимум бокового шума и меньше «плавающих» вставок, которые прерывают основную линию изложения

Полезный паттерн: обещание → краткое содержание → объяснение → доказательство → следующие шаги.

Добавьте TL;DR для быстрого понимания

Разместите краткое резюме ближе к началу (2–5 строк). Это помогает системам AI быстро классифицировать страницу и зафиксировать ключевые утверждения.

Пример TL;DR:

TL;DR: Эта страница объясняет, как структурировать контент, чтобы AI‑краулеры могли надёжно извлекать основную тему, определения и ключевые выводы.

Держите одну основную тему на страницу

Индексация LLM лучше работает, когда каждый URL отвечает одному интенту. Если вы смешиваете несвязанные цели (например, «цены», «документация по интеграции» и «история компании» на одной странице), страницу сложнее категоризировать, и она может показываться по неуместным запросам.

Если нужно покрыть связанные, но отдельные интенты, разделите их на отдельные страницы и свяжите внутренними ссылками (например, /pricing, /docs/integrations).

Определяйте неоднозначные термины и добавляйте контекст

Если аудитория может понимать термин по‑разному, дайте определение в начале.

Пример:

Оптимизация AI‑краулера: подготовка контента сайта и правил доступа так, чтобы автоматические системы могли надёжно обнаруживать, читать и интерпретировать страницы.

Используйте единообразные названия сущностей

Выберите одно название для каждого продукта, функции, плана и ключевой концепции — и используйте его везде. Последовательность улучшает извлечение («Функция X» всегда означает одно и то же) и уменьшает путаницу сущностей при суммаризации или сравнении страниц моделями.

Заголовки, списки и таблицы: делайте страницы удобными для разбиения на чанки

Большинство конвейеров индексации разбивает страницы на чанки и хранит/извлекает лучшие соответствующие куски позже. Ваша задача — сделать эти чанки очевидными, самодостаточными и лёгкими для цитирования.

Используйте чёткую иерархию H1–H3

Держите один H1 на страницу (главное обещание), затем H2 для крупных разделов, по которым кто‑то может искать информацию, и H3 для подтем.

Простое правило: если вы можете превратить H2 в оглавление, описывающее всю страницу, вы на верном пути. Такая структура помогает системам поиска прикреплять нужный контекст к каждому чанку.

Пишите заголовки, которые можно понять отдельно

Избегайте расплывчатых меток вроде «Overview» или «More info». Делайте заголовки так, чтобы они отвечали на намерение пользователя:

- «Цены и что включено»

- «Поддерживаемые форматы файлов и ограничения по размеру»

- «Сколько обычно занимает настройка (типичные сроки)»

Когда чанки извлекают вне контекста, заголовок часто становится «названием» отрывка. Сделайте его информативным.

Предпочитайте короткие абзацы, списки и таблицы

Используйте короткие абзацы (1–3 предложения) для удобочитаемости и чтобы чанки оставались сфокусированными.

Маркированные списки хорошо подходят для требований, шагов и ключевых особенностей. Таблицы отлично подходят для сравнений, потому что сохраняют структуру.

| Plan | Best for | Key limit |

|---|---|---|

| Starter | Trying it out | 1 project |

| Team | Collaboration | 10 projects |

Добавьте FAQ для прямых ответов

Небольшой раздел FAQ с краткими полными ответами улучшает извлекаемость:

Q: Поддерживаете ли вы загрузку CSV?

A: Да — CSV до 50 МБ на файл.

Включите «Следующие шаги» и «Связанное чтение»

Завершайте ключевые страницы навигационными блоками, чтобы и пользователи, и краулеры могли следовать пути по намерениям:

- Следующие шаги: /pricing, /signup

- Связанное чтение: /blog/technical-seo-for-ai, /docs/sitemaps

Рендеринг: убедитесь, что контент существует без JavaScript

AI‑краулеры не всегда ведут себя как полноценный браузер. Многие сразу скачивают и читают сырой HTML, но не выполняют JavaScript, не ждут API‑вызовов и не собирают страницу после гидратации. Если важный контент появляется только после клиентской отрисовки, вы рискуете стать «невидимым» для систем, делающих LLM‑индексацию.

HTML‑краулинг против страниц, рендерящихся через JavaScript

При традиционной HTML‑странице краулер скачивает документ и может сразу извлечь заголовки, абзацы, ссылки и метаданные.

На JS‑тяжёлой странице первый ответ может быть тонкой оболочкой (несколько div и скриптов). Содержательный текст появляется только после выполнения скриптов, загрузки данных и рендеринга компонентов. На этом этапе покрытие падает: некоторые краулеры не запускают скрипты; другие запускают с таймаутами или с частичной поддержкой.

Отдавайте предпочтение серверной отрисовке (или гибриду) для критичного контента

Для страниц, которые вы хотите индексировать — описания продуктов, цены, FAQ, документация — предпочитайте:

- Server‑Side Rendering (SSR): контент в исходном HTML‑ответе

- Static generation (SSG/ISR): предсобранный HTML с периодическим обновлением

- Гибридная отрисовка: рендерьте основной контент на сервере, дополняйте JS для интерактивности

Цель не в «ноль JavaScript», а в том, чтобы сначала был смысловой HTML, а JS — потом.

Не прячьте важный текст за «невидимым» UI

Табы, аккордеоны и «читать далее» — это нормально, если текст присутствует в DOM. Проблемы возникают, когда контент вкладок подгружается только по клику или вставляется после клиентского запроса. Если такой контент важен для обнаружения AI, включите его в первоначальный HTML и управляйте видимостью через CSS/ARIA.

Быстрые тесты для обнаружения проблем с рендерингом

Выполните обе проверки:

- View Source: показывает HTML, который отправляет сервер (то, что видят многие краулеры)

- Inspect Element: показывает пост‑JS DOM (то, что в итоге рендерит браузер)

Если заголовки, основной текст, внутренняя навигация или ответы FAQ видны только в Inspect Element, считайте это риском и переносите контент в серверный рендеринг.

Контроль доступа для краулеров: robots.txt и Meta Robots

AI‑краулеры и традиционные поисковые боты нуждаются в понятных и согласованных правилах доступа. Если вы случайно заблокируете важный контент — или позволите краулерам заходить в приватные или «грязные» разделы — вы потратите бюджет обхода и загрязните то, что попадает в индекс.

robots.txt: регулятор трафика для сайта

Используйте robots.txt для общих правил: какие папки (или шаблоны URL) можно индексировать или нет.

Практическая база:

- Allow/Disallow: блокируйте непубличные разделы вроде

/admin/,/account/, внутреннего поиска или URL с большим количеством параметров. - Crawl‑delay: добавляйте только если сервер страдает от бот‑трафика. Многие крупные боты игнорируют эту директиву, так что не полагайтесь на неё как на основную меру.

- Sitemap directive: указывайте расположение канонического sitemap, чтобы обнаружение было предсказуемым.

Пример:

User-agent: *

Disallow: /admin/

Disallow: /account/

Disallow: /internal-search/

Sitemap: /sitemap.xml

Важно: блокировка в robots.txt предотвращает обход, но не всегда гарантирует, что URL не появится в индексе, если на него ссылаются с других мест. Для управления индексацией используйте директивы на уровне страницы.

Meta robots и X‑Robots‑Tag: решения об индексировании на уровне страницы

Используйте meta name="robots" в HTML‑страницах и X‑Robots‑Tag в заголовках для не‑HTML файлов (PDF, фиды, экспортированные файлы).

Распространённые сценарии:

- Тонкие или утилитарные страницы (фильтры, варианты сортировки, печатные версии):

noindex,follow, чтобы ссылки передавали вес, но сама страница оставалась вне индексов. - Приватные или чувствительные области: не полагайтесь только на

noindex— защищайте аутентификацией и подумайте о блокировке обхода. - Дублирующиеся версии (например, превью‑URL):

noindexплюс корректная каноникализация (см. ниже).

Простое правило для окружений (prod vs staging)

Документируйте и применяйте правила для каждого окружения:

- Production: по умолчанию доступно для обхода; блокируйте только явно не‑публичные или низкоценные разделы.

- Staging/preview: требуйте логин; также добавьте глобальный

noindex(проще всего через заголовки), чтобы избежать случайного индексирования.

Если ваши правила доступа затрагивают пользовательские данные, убедитесь, что публичная политика совпадает с реальностью (см. /privacy и /terms при актуальности).

Канонические URL, дубликаты и гигиена редиректов

Отделите стейджинг от продакшена

Настройте корректные дефолты для production и staging, включая глобальный noindex там, где нужно.

Если вы хотите, чтобы AI‑системы (и поисковые краулеры) надёжно понимали и цитировали страницы, нужно сократить ситуации «один контент — много URL». Дубликаты тратят бюджет обхода, дробят сигналы и могут привести к тому, что в индекс попадёт неправильная версия страницы.

Создавайте чистые, стабильные URL

Старайтесь, чтобы URL оставались актуальными годами. Избегайте включения лишних параметров вроде session ID, опций сортировки или трекинговых кодов в индексируемые URL (например: ?utm_source=..., ?sort=price, ?ref=). Если параметры нужны для функциональности (фильтры, пагинация, внутренний поиск), убедитесь, что «основная» версия доступна по стабильному чистому URL.

Стабильные URL улучшают долгосрочные цитаты: когда LLM учит или сохраняет ссылку, вероятность того, что она продолжит указывать на ту же страницу, выше, если структура URL не меняется при каждом редизайне.

Используйте канонические теги для свёртывания дубликатов

Добавляйте \u003clink rel="canonical"\u003e на страницах, где ожидаются дубликаты:

- Варианты товаров, у которых совпадает контент

- Просмотры категорий с фильтрами

- URL с параметрами трекинга

Канонические теги должны указывать на предпочтительный индексируемый URL (и желательно, чтобы этот канонический URL возвращал 200).

Гигиена редиректов: просто и предсказуемо

Когда страница перемещается навсегда, используйте 301 редирект. Избегайте цепочек редиректов (A → B → C) и петель; они замедляют краулеров и могут привести к частичному индексированию. Перенаправляйте старые URL прямо на окончательный ресурс и поддерживайте согласованность между HTTP/HTTPS и www/non‑www.

Используйте hreflang только для реальных эквивалентов

Реализуйте hreflang только когда у вас действительно есть локализованные эквиваленты (не просто перевод отдельных фрагментов). Неправильный hreflang может создать путаницу относительно того, какая страница должна цитироваться для какой аудитории.

Карты сайта и внутренние ссылки для надёжного обнаружения

Sitemap и внутренние ссылки — это ваша «система доставки» для обнаружения: они говорят краулерам, что существует, что важно и что следует игнорировать. Для AI‑краулеров и LLM‑индексации цель проста — сделайте ваши лучшие, чистые URL лёгкими для нахождения и трудными для пропуска.

Стройте XML‑sitemap, перечисляя только нужные URL

Ваша sitemap должна включать только индексируемые, канонические URL. Если страница блокирована robots.txt, помечена noindex, редиректится или не является канонической версией, она не должна попадать в sitemap. Это концентрирует бюджет обхода и снижает шанс того, что LLM возьмёт дубликат или устаревшую версию.

Будьте последовательны с форматами URL (заканчивающийся слеш, нижний регистр, HTTPS), чтобы sitemap зеркалировал ваши канонические правила.

Разбивайте большие sitemap и используйте индекс sitemap

Если у вас много URL, разделите их на несколько файлов sitemap (обычный лимит: 50 000 URL на файл) и опубликуйте sitemap index, перечисляющий каждый sitemap. Организуйте по типам контента, если это помогает, например:

/sitemaps/pages.xml/sitemaps/blog.xml/sitemaps/docs.xml

Это упрощает поддержку и помогает мониторить обнаружение.

Используйте lastmod как сигнал доверия, а не как отметку деплоя

Обновляйте lastmod осознанно — только когда страница изменяется по смыслу (контент, цены, политика, ключевые метаданные). Если каждый URL обновляется при каждом деплое, краулеры научатся игнорировать поле, и действительно важные обновления могут быть пересмотрены позже, чем хотелось бы.

Внутренние ссылки: делайте сайт навигируемым как карта

Сильная структура хаб‑и‑спицы помогает пользователям и машинам. Создавайте хабы (страницы категорий, продуктов или тем), которые ссылаются на важные «спицы», и следите, чтобы каждая спица ссылалась назад на свой хаб. Добавляйте контекстные ссылки в теле текста, не только в меню.

Если вы публикуете обучающий контент, держите основные точки входа очевидными — отправляйте пользователей в /blog для статей и в /docs для глубокой справки.

Структурированные данные: помогите машинам понять ваши страницы

Запустите индексируемую структуру сайта

Преобразуйте карту сайта и план внутренних ссылок в рабочее React-приложение в чат-управляемом процессе.

Структурированные данные — способ пометить, чем является страница (статья, продукт, FAQ, организация) в формате, который машины читают надёжно. Поисковые системы и AI‑системы не вынуждены угадывать, какой текст — заголовок, кто автор или какая основная сущность — они могут разобрать это напрямую.

Выбирайте правильный тип Schema.org

Используйте типы Schema.org, соответствующие вашему контенту:

- Article (блоги, новости, руководства)

- FAQPage (вопрос/ответ)

- HowTo (пошаговые инструкции)

- Product (страницы цен и карточки товаров)

- Organization (идентичность вашей компании)

Выбирайте один основной тип для каждой страницы, затем добавляйте вспомогательные свойства (например, Article может ссылаться на Organization как издателя).

Синхронизируйте разметку с тем, что видно пользователю

AI‑краулеры и поисковики сверяют структурированные данные с видимой страницей. Если ваша разметка заявляет FAQ, которого нет на странице, или указывает имя автора, не показанное пользователю, это создаёт несоответствие и риск, что разметка будет проигнорирована.

Для страниц с контентом указывайте author, а также datePublished и dateModified, когда они реальны и значимы. Это делает свежесть и ответственность понятнее — два фактора, на которые LLM часто опираются при решении, чему доверять.

Если у вас есть официальные профили, добавьте ссылки sameAs (например, верифицированные социальные профили) в Organization schema.

Пример: Article JSON‑LD

{

"@context": "https://schema.org",

"@type": "Article",

"headline": "Build a Website Ready for AI Crawlers and LLM Indexing",

"author": { "@type": "Person", "name": "Jane Doe" },

"datePublished": "2025-01-10",

"dateModified": "2025-02-02",

"publisher": {

"@type": "Organization",

"name": "Acme",

"sameAs": ["https://www.linkedin.com/company/acme"]

}

}

Наконец, валидируйте через общие инструменты (Rich Results Test от Google, Schema Markup Validator). Исправляйте ошибки и относитесь к предупреждениям прагматично: приоритизируйте те, которые связаны с вашим выбранным типом и ключевыми свойствами (заголовок, автор, даты, информация о продукте).

llms.txt: простой гид для ориентирования LLM

Файл llms.txt — это небольшой человекочитаемый «карточка» для краулеров, ориентированных на языковые модели (и для людей, которые их настраивают), указывающая важнейшие точки входа: документацию, ключевые страницы продуктов и любые справочные материалы, которые объясняют вашу терминологию.

Это не стандарт с гарантированным поведением для всех краулеров, и не следует рассматривать его как замену sitemaps, каноникалам или robots. Думайте о нём как об удобной подсказке для обнаружения и контекста.

Где разместить

Кладите в корень сайта, чтобы его было легко найти:

/llms.txt

Та же идея, что и для robots.txt: предсказуемое место, быстрая выборка.

Что включать (и чего избегать)

Держите файл коротким и отборным. Подходят:

- Ключевые точки входа: обзор продукта, цены, начало работы

- Хабы документации: главная страница docs, API‑референс, SDK‑гайды, туториалы

- Глоссарий/терминология: страница с определениями терминов и предпочитаемыми названиями

- Политики, важные для повторного использования: лицензии, ожидания по атрибуции, заметки по использованию данных

Также можно добавить краткие стилевые заметки, снижающие неоднозначность (например, «В UI мы называем клиентов «workspaces»»). Избегайте длинных маркетинговых текстов, дампов URL или того, что конфликтует с вашими каноническими URL.

Простой пример:

# llms.txt

# Purpose: curated entry points for understanding and navigating this site.

## Key pages

- / (Homepage)

- /pricing

- /docs

- /docs/getting-started

- /docs/api

- /blog

## Terminology and style

- Prefer “workspace” over “account”.

- Product name is “Acme Cloud” (capitalized).

- API objects: “Project”, “User”, “Token”.

## Policies

- /terms

- /privacy

Согласованность с sitemap и канониками

Согласованность важнее объёма:

- Перечисляйте только URL, которые вы хотите обнаруживать и цитировать.

- Убедитесь, что страницы возвращают 200 и имеют корректный canonical.

- Если страницу заменили, обновите ссылку вместо полагания на редиректы.

- Не включайте URL, заблокированные robots.txt (это создаёт смешанные сигналы).

Лёгкий процесс поддержки (ежеквартально)

Практичная рутина, которую легко поддерживать:

- Квартальный обзор (15 минут): пройдитесь по каждой ссылке в

llms.txtи подтвердите, что это всё ещё лучшая точка входа. - После крупных релизов: добавляйте/удаляйте хабы документации при реструктуризации навигации.

- Связывайте с существующими проверками: обновляйте

llms.txtпри изменении sitemap или каноников.

Если всё сделано хорошо, llms.txt остаётся маленьким, точным и действительно полезным — без обещаний о том, как поведёт себя конкретный краулер.

Производительность и ответы сервера, которые нравятся краулерам

Краулеры (включая AI‑ориентированные) ведут себя как нетерпеливые пользователи: если ваш сайт медленный или ненадёжен, они будут реже скачивать страницы, реже повторять попытки и дольше обновлять индекс. Хорошая производительность и надёжные ответы сервера повышают вероятность того, что ваш контент будет обнаружен, повторно обойдён и актуализирован.

Скорость и аптайм: что «чувствуют» краулеры

Если сервер часто таймаутит или возвращает ошибки, краулер может автоматически отступить. Это значит, что новые страницы появятся дольше, а обновления отразятся медленнее.

Стремитесь к стабильному аптайму и предсказуемому времени ответа в пиковые часы — не только к высоким результатам в лабораторных тестах.

Улучшите TTFB и уменьшите размер полезной нагрузки

Time to First Byte (TTFB) — сильный сигнал здоровья сервера. Несколько действенных приёмов:

- Используйте CDN‑кэширование для публичных страниц и включите кэширование на источнике, где возможно.

- Включите компрессию (Brotli или gzip) для HTML, CSS и JS.

- Держите HTML лёгким: избегайте огромных inline‑скриптов и лишних трекинговых тегов.

- Оптимизируйте изображения: изменяйте размеры и сжимайте, чтобы страницы не требовали больших загрузок просто для понимания контента.

Хотя краулеры не «видят» изображения как люди, большие файлы всё равно тратят время обхода и пропускную способность.

Возвращайте правильные HTTP‑коды

Краулеры опираются на коды статуса, чтобы решать, что хранить, а что удалять:

- 200 — валидные страницы с контентом.

- 301 — постоянные перемещения (и сокращайте цепочки).

- 404 — страницы не существует.

- 410 — страница намеренно удалена и должна быть удалена быстрее.

- Обращайтесь с 5xx: быстро исправляйте коренные причины и рассматривайте лёгкую fallback‑страницу, только если она всё ещё возвращает корректный код ошибки.

Не прячьте основной контент за логином

Если основной текст статьи требует аутентификации, многие краулеры индексируют лишь оболочку. Держите основной доступ для чтения публичным или предоставьте сканируемый превью, включающий ключевой контент.

Ограничение скорости без блокиров легитимных краулеров

Защищайте свой сайт от злоупотреблений, но избегайте грубых блокировок. Предпочтительнее:

- Лимиты по токен‑ведру с разумными всплесками

- Белые списки для известных диапазонов IP‑краулеров (когда доступны)

- Чёткие ответы 429 с заголовком

Retry-After

Это защищает сайт и позволяет ответственным краулерам выполнять свою работу.

Сигналы доверия: источники, авторы и явное владение

Развёртывайте, не нарушая индексирование

Безопасно тестируйте изменения, влияющие на краулинг, и откатывайте релиз, если он ухудшает обнаруживаемость.

E‑E‑A‑T не требует грандиозных заявлений или значков. Для AI‑краулеров и LLM это в основном означает, что сайт ясно говорит, кто написал материал, откуда взяты факты и кто отвечает за поддержку.

Делайте источники очевидными (и проверяемыми)

Когда вы утверждаете факт, прикрепляйте источник рядом с утверждением. Отдавайте приоритет первичным и официальным ссылкам (законы, стандарты, документация вендоров, рецензируемые публикации) над вторичными обзорами.

Например, при обсуждении структурированных данных цитируйте документацию Google («Google Search Central — Structured Data») и, если уместно, определения схем («Schema.org vocabulary»). При обсуждении robots‑директив — ссылайтесь на соответствующие стандарты и официальные документы краулеров (например, «RFC 9309: Robots Exclusion Protocol»). Даже если вы не ссылаетесь на каждое упоминание, давайте достаточно деталей, чтобы читатель мог найти оригинал.

Показывайте авторство и редакционную ответственность

Добавьте подпись автора с короткой биографией, квалификациями и зоной ответственности. Затем сделайте владение явным:

- Чёткий владелец сайта (компания/юридическое лицо) в футере

- Страница контактов с реальными каналами (не только форма)

- Страница «О нас», объясняющая миссию и редакционный процесс (см. /about)

Держите утверждения конкретными — и храните «квитанции»

Избегайте слов вроде «лучший» или «гарантированный». Опишите, что вы тестировали, что изменилось и какие ограничения есть. Добавляйте примечания об обновлениях вверху или внизу ключевых страниц (например, «Обновлено 2025‑12‑10: уточнена обработка каноников для редиректов»). Это создаёт след поддержания, который понимают люди и машины.

Поддерживайте единый глоссарий

Определите ключевые термины один раз и используйте их последовательно по сайту (например, «AI‑краулер», «индексация LLM», «rendered HTML»). Лёгкая страница‑глоссарий (например, /glossary) снижает неоднозначность и облегчает корректную суммаризацию.

Тестирование, мониторинг и постоянные улучшения

Готовность к AI — это не одноразовая задача. Малейшие изменения — обновление CMS, новый редирект или переработка навигации — могут незаметно ломать обнаружение и индексацию. Простая проверочная рутина избавит от догадок, когда трафик или видимость изменятся.

Следите за сигналами проблем с обнаружением

Начните с базовых вещей: отслеживайте ошибки обхода, покрытие индекса и страницы с наибольшим количеством внутренних ссылок. Если краулеры не могут достать ключевые URL (таймауты, 404, заблокированные ресурсы), индексация LLM быстро ухудшается.

Также контролируйте:

- Страницы, внезапно выпадающие из индекса

- Важные URL, переставшие получать внутренние ссылки

- Неожиданные всплески «дубликатов» или «исключённых» страниц

Проверяйте релизы как инженер надёжности

После релизов (даже «малых») просмотрите, что изменилось:

- Редиректы: старые URL правильно отправляют пользователей и ботов на новое место?

- Каноники: не сломали ли шаблоны и не начали ли каноники указывать неверно?

- Sitemaps: валидны ли они, актуальны ли и нет ли битых ссылок?

15‑минутный пост‑релиз аудит часто ловит проблемы до того, как они превратятся в долгосрочные потери видимости.

Тестируйте, как ваши страницы суммируются

Выберите несколько высокоценных страниц и проверьте, как их суммируют AI‑инструменты или внутренние скрипты суммаризации. Обращайте внимание на:

- Отсутствующие определения («что это?» предложение не ясно)

- Заголовки, не соответствующие фактическим разделам

- Ключевые детали, спрятанные в длинных абзацах без меток

Если суммаризация расплывчата — доработка обычно редакционная: сильнее H2/H3, ясные первые абзацы и более явная терминология.

Создайте повторяющийся чек‑лист «AI‑готовности»

Перенесите полученные знания в периодический чек‑лист и назначьте владельца (реальное имя, не просто «маркетинг»). Держите его живым и выполнимым — и ссылкой на самый свежий вариант внутри команды, чтобы все использовали одинаковую практику. Опубликуйте лёгкую справку вроде /blog/ai-seo-checklist и обновляйте её по мере развития сайта и инструментов.

Если команда быстро шипует (особенно с AI‑помощью в разработке), подумайте о включении проверок «AI‑готовности» прямо в билд/релизный процесс: шаблоны, которые всегда выводят каноники, последовательные поля автор/дата и серверно‑отрисованный основной контент. Платформы вроде Koder.ai могут помочь, делая эти настройки повторяемыми для новых React‑страниц и поверхностей приложения — а также позволяя итерации через planning‑режим, снимки и откаты, когда изменения случайно влияют на краулируемость.

Маленькие, стабильные улучшения дают эффект сложных процентов: меньше сбоев обхода, чище индексация и контент, который проще понять людям и машинам.

FAQ

Что на самом деле означает «оптимизировано для AI» для сайта?

Это значит, что ваш сайт прост для автоматических систем в части обнаружения, разбора и корректного повторного использования.

На практике это сводится к доступным URL, чистой HTML‑структуре, явной атрибуции (автор/дата/источники) и контенту, оформленному в самостоятельные «чанки», которые системы извлечения могут сопоставить с конкретными вопросами.

Можете ли вы гарантировать, что мой контент попадёт в AI‑индексы или модели?

Никаких гарантий. Разные провайдеры сканируют по-разному, придерживаются разных политик и могут вообще не сканировать вашу площадку.

Сосредоточьтесь на том, что вы можете контролировать: делайте страницы доступными, однозначными, быстрыми в получении и простыми для атрибуции, чтобы в случае использования они применялись корректно.

Как сделать так, чтобы AI‑краулеры читали мой контент, если сайт использует JavaScript?

Стремитесь к осмысленному HTML в первоначальном ответе.

Используйте SSR/SSG/гибридную отрисовку для важных страниц (цены, документация, FAQ), а потом добавляйте JavaScript для интерактивности. Если основной текст появляется только после гидратации или API‑вызовов, многие краулеры его не заметят.

Как быстро проверить, невидим ли мой контент для некоторых краулеров?

Сравните:

- View Source: что сервер отдаёт (то, что видят многие краулеры).

- Inspect Element: готовый DOM после выполнения JS (то, что видит полноценный браузер).

Если ключевые заголовки, основной текст, ссылки или ответы в FAQ есть только в Inspect Element, переместите этот контент в серверный HTML.

Когда использовать robots.txt, meta robots и X-Robots-Tag?

Используйте robots.txt для широких правил обхода (например, блокировать /admin/), а meta robots / X-Robots-Tag — для решений об индексировании на уровне страницы или файла.

Обычная схема: noindex,follow для тонких утилитарных страниц, а для приватных зон — аутентификация (не только ).

Как лучше обрабатывать дублирующие URL, параметры и редиректы?

Используйте стабильный канонический URL для каждого фрагмента контента.

- Добавьте

rel="canonical"там, где ожидаются дубликаты (фильтры, параметры, варианты). - Применяйте 301 для постоянных перемещений.

- Избегайте цепочек редиректов и следите, чтобы каноники указывали на страницы с кодом 200.

Это уменьшит раздробление сигналов и сделает цитирование более стабильным во времени.

Что должно (и не должно) попадать в мой XML‑sitemap для дружелюбного обнаружения AI?

Включайте только канонические, индексируемые URL.

Исключите страницы, которые редиректятся, помечены noindex, заблокированы robots.txt или являются неканоническими дубликатами. Поддерживайте единообразие форматов (HTTPS, слеши, регистр) и обновляйте lastmod только при значимых изменениях.

Что такое llms.txt и как его использовать?

Рассматривайте его как курируемую «карточку» с лучшими точками входа (хабы документации, начало работы, глоссарий, политики).

Держите файл коротким, перечисляйте только URL, которые хотите, чтобы обнаруживали и цитировали, и убедитесь, что каждая ссылка возвращает 200 и имеет корректный канонический URL. Не заменяйте им sitemap, каноники или robots‑директивы.

Как структурировать контент, чтобы LLMs извлекали нужные отрывки?

Пишите страницы так, чтобы чанки могли существовать самостоятельно:

- Один главный интент на URL

- Чёткая иерархия H1→H2→H3

- Короткий TL;DR вверху

- Заголовки, которые конкретно отвечают на запрос (не «Overview»)

- Короткие абзацы, списки и таблицы для ограничений и сравнений

Это повышает точность извлечения и снижает вероятность неверных сводок.

Какие сигналы доверия улучшают точную атрибуцию и цитирование AI‑систем?

Добавляйте и поддерживайте видимые сигналы доверия:

- Подпись автора и биография

datePublishedи осмысленныйdateModified- Источники рядом с фактическими утверждениями

- Ясная информация о владельце сайта и каналы связи

- Структурированные данные (Article/Organization), соответствующие видимому контенту

Эти подсказки делают атрибуцию и цитирование более надёжными для краулеров и пользователей.