05 พ.ย. 2568·2 นาที

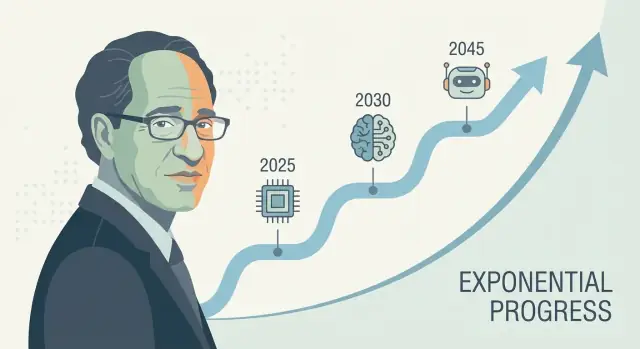

เส้นเวลา AGI ของ Ray Kurzweil: เขาพยากรณ์ล่วงหน้าหลายสิบปีอย่างไร

สำรวจการพยากรณ์ AGI ระยะยาวของ Ray Kurzweil: เส้นเวลา วิธีการทำนาย ผลที่ถูก/ผิด คำวิจารณ์ และสัญญาณที่ควรติดตามในอนาคต

สำรวจการพยากรณ์ AGI ระยะยาวของ Ray Kurzweil: เส้นเวลา วิธีการทำนาย ผลที่ถูก/ผิด คำวิจารณ์ และสัญญาณที่ควรติดตามในอนาคต

Ray Kurzweil เป็นหนึ่งในเสียงที่โดดเด่นที่สุดด้านการพยากรณ์เทคโนโลยีระยะยาว—โดยเฉพาะเรื่องปัญญาประดิษฐ์และ technological singularity เมื่อเขาทำนาย AGI อย่างชัดเจน (มักระบุเป็นปี ไม่ใช่แค่คำว่า “สักวันหนึ่ง”) ข้อความเหล่านั้นมักกระจายออกไป: นักลงทุนอ้างถึงมัน นักข่าวถกเถียง และนักวิจัยถูกถามให้ตอบสนอง

อิทธิพลของ Kurzweil ไม่ได้มาจากความมองโลกในแง่ดีเพียงอย่างเดียว แต่มาจากการเสนอกรอบซ้ำได้สำหรับ เหตุผลที่ ความก้าวหน้าควรเร่งขึ้น—มักเชื่อมโยงกับการเติบโตแบบทวีคูณในการคอมพิวติ้งและแนวคิดที่ว่าแต่ละรุ่นของเครื่องมือช่วยสร้างรุ่นต่อไป ไม่ว่าคุณจะเห็นด้วยหรือไม่ เขาให้วิธีมีโครงสร้างในการพูดถึงเส้นเวลา artificial general intelligence แทนที่จะมองเป็นนิยายวิทยาศาสตร์บริสุทธิ์

การพยากรณ์ล่วงหลายสิบปีไม่ใช่แค่เดาปฏิทิน แต่เป็นการฉายชุดแนวโน้มไปข้างหน้า: การคำนวณ ต้นทุน ข้อมูล อัลกอริธึม และความสามารถเชิงปฏิบัติในการสร้างระบบที่สามารถทั่วไปได้ การเดิมพันคือเส้นโค้งเหล่านี้จะยังเคลื่อนต่อไป—และ "ชิ้นส่วนที่ขาด" ในวันนี้เป็นปัญหาวิศวกรรมที่แก้ได้เมื่อปัจจัยนำเข้าเติบโตขึ้น

บทความนี้สรุปให้:

แม้แต่ผู้เชี่ยวชาญที่จริงจังก็มีเส้นเวลา AGI แตกต่างกันมากเพราะขึ้นกับสมมติฐาน: "AGI" หมายถึงอะไร คอขวดใดสำคัญที่สุด และความก้าวหน้าทำให้เกิดผลิตภัณฑ์ที่เชื่อถือได้เร็วแค่ไหน เส้นเวลาของ Kurzweil มีอิทธิพลไม่ใช่เพราะรับประกัน แต่เพราะมันเฉพาะเจนพอที่จะทดสอบ—และยากที่จะมองข้าม

Ray Kurzweil เป็นนักประดิษฐ์ ผู้เขียน และนักฟิวเจอริสต์ชาวอเมริกันที่มีชื่อเสียงในการพยากรณ์เทคโนโลยีระยะยาว—และมักสนับสนุนคำพยากรณ์ด้วยแผนภูมิ ข้อมูลประวัติศาสตร์ และเดดไลน์ที่กล้าแสดงออก

Kurzweil เป็นที่รู้จักครั้งแรกจากผลงานเชิงปฏิบัติ โดยเฉพาะเทคโนโลยีเสียงและข้อความ เขาสร้างบริษัทที่มุ่งเน้น OCR (optical character recognition), text-to-speech และเครื่องมือดนตรี และใช้เวลาหลายทศวรรษใกล้กับข้อจำกัดของผลิตภัณฑ์จริง: คุณภาพข้อมูล ต้นทุนฮาร์ดแวร์ และสิ่งที่ผู้ใช้ยอมรับ แนวคิดของคนที่สร้างผลิตภัณฑ์นี้มีอิทธิพลต่อการพยากรณ์ของเขา—เขามักมองความก้าวหน้าเป็นสิ่งที่สามารถวิศวกรรมและขยายได้

เขายังเคยทำงานภายในองค์กรเทคโนโลยีใหญ่ (รวมถึง Google) ซึ่งเสริมมุมมองที่ว่าการก้าวกระโดดมักมาจากการลงทุนอย่างต่อเนื่อง เครื่องมือที่ดีขึ้น และการปรับปรุงที่ทบต้น—ไม่ใช่แค่ความสำเร็จเดี่ยวๆ

เส้นเวลา AGI ของ Kurzweil มักถูกพูดถึงผ่านหนังสือยอดนิยมของเขา โดยเฉพาะ The Age of Spiritual Machines (1999) และ The Singularity Is Near (2005) งานเหล่านี้โต้แย้งว่าเทคโนโลยีสารสนเทศพัฒนาขึ้นตามรูปแบบเร่งขึ้นทบต้น—และการเร่งขึ้นนี้จะทำให้เครื่องจักรมีความสามารถระดับมนุษย์ (แล้วก็เกินกว่ามนุษย์)

ไม่ว่าคุณจะเห็นด้วยหรือไม่ งานเขียนของเขาช่วยกำหนดกรอบการสนทนาสาธารณะ: ความก้าวหน้าของ AI เป็นสิ่งที่วัดได้ ขับเคลื่อนด้วยแนวโน้ม และ (อย่างน้อยในหลักการ) พยากรณ์ได้

AGI (Artificial General Intelligence): ระบบ AI ที่เรียนรู้และทำงานได้หลากหลายประมาณระดับมนุษย์ ปรับตัวเข้ากับปัญหาใหม่ๆ โดยไม่ถูกจำกัดเฉพาะงานแคบๆ

Singularity: คำของ Kurzweil สำหรับช่วงเวลาที่ความก้าวหน้าทางเทคโนโลยีเร็วมาก (และ AI มีความสามารถสูงมาก) จนเปลี่ยนสังคมในทางที่คาดเดาได้ยากและยากที่จะสร้างแบบจำลอง

Timeline: การพยากรณ์ที่มีวันที่และขั้นตอนสำคัญ (เช่น "AI ระดับมนุษย์ภายในปี X") ไม่ใช่แค่การกล่าวทั่วไปว่าความก้าวหน้าจะดำเนินต่อไป

Kurzweil แย้งซ้ำแล้วซ้ำเล่าว่า AGI ระดับมนุษย์มีแนวโน้มจะมาภายในครึ่งแรกของศตวรรษที่ 21—ที่พูดถึงมากที่สุดคือช่วงปลายทศวรรษ 2020 จนถึง 2030s ในการพูดและหนังสือสาธารณะ เขาอาจไม่ยึดติดกับปีเดียว แต่ข้อเรียกร้องหลักคงที่: เมื่อกำลังการประมวลผล ข้อมูล และอัลกอริธึมข้ามเกณฑ์หนึ่งๆ ระบบจะเทียบได้กับความกว้างและการปรับตัวของการรับรู้ของมนุษย์

ตามกรอบของ Kurzweil, AGI ไม่ใช่เส้นชัย—มันเป็นทริกเกอร์ เมื่อเครื่องจักรถึง (และเกิน) ความฉลาดทั่วไประดับมนุษย์ ความก้าวหน้าจะทบต้น: ระบบที่ฉลาดขึ้นช่วยออกแบบระบบที่ฉลาดขึ้นอีก ทำให้การค้นพบทางวิทยาศาสตร์ การทำงานอัตโนมัติ และการผสานคน-เครื่องเร่งขึ้น ไดนามิกการทบต้นนี้คือสิ่งที่เขาเชื่อมโยงกับแนวคิด technological singularity: ช่วงเวลาที่การเปลี่ยนแปลงเร็วมากจนสัญชาตญาณประจำวันไม่ใช่เครื่องมือชี้นำที่เชื่อถือได้

ความละเอียดอ่อนสำคัญในคำกล่าวอ้างของเขาคือคำนิยามของ AGI ระบบชั้นนำในปัจจุบันแม้จะแสดงผลเยี่ยมในหลายงาน แต่ยังมีแนวโน้มที่จะ:

Kurzweil’s "AGI" หมายถึงระบบที่สามารถถ่ายโอนการเรียนรู้ข้ามโดเมน กำหนดและติดตามเป้าหมายในสถานการณ์ใหม่ และจัดการความหลากหลายแบบเปิดของโลกจริงได้อย่างน่าเชื่อถือ—ไม่ใช่แค่ทำคะแนนได้ดีในเบนช์มาร์ก

การพยากรณ์เป็นวันปฏิทินง่ายต่อการถกเถียงและใช้งานได้ยาก ขั้นตอนสำคัญ (milestones) ใช้งานได้จริงกว่า: การเรียนรู้อิสระอย่างต่อเนื่อง การใช้เครื่องมือและวางแผนที่เชื่อถือได้ ประสิทธิภาพสูงในสภาพแวดล้อมจริงที่ยุ่งเหยิง และการทดแทนทางเศรษฐกิจอย่างชัดเจนในหลายบทบาทงาน แม้คุณไม่เห็นด้วยกับการกำหนดเวลาที่แน่นอน ขั้นตอนเช็คพอยต์เหล่านี้ทำให้คำพยากรณ์ทดสอบได้—และมีประโยชน์กว่าการเดิมพันกับปีเดียว

Kurzweil มักถูกเรียกว่า "นักพยากรณ์ต่อเนื่อง" ชื่อเสียงนั้นเป็นส่วนหนึ่งของเหตุผลที่เส้นเวลา AGI ของเขาได้รับความสนใจ แต่ผลการทำนายของเขามีทั้งด้านบวกและลบ ซึ่งเป็นประโยชน์ต่อการเข้าใจการพยากรณ์: บางการคาดการณ์ชัดเจนและวัดได้ บางอย่างถูกทิศทางแต่คลุมเครือ และบางอันไม่ได้คำนึงถึงข้อจำกัดสำคัญ

ตลอดหนังสือและการบรรยาย เขามักเชื่อมโยงกับการคาดการณ์เช่น:

การพยากรณ์ที่ชัดเจนและตรวจสอบได้ ถูกผูกกับวันที่และผลลัพธ์ที่วัดได้: “ภายในปี X เทคโนโลยี Y จะถึงประสิทธิภาพ Z” หรือ “อุปกรณ์ส่วนใหญ่จะมีฟีเจอร์ F” สิ่งเหล่านี้สามารถทดสอบกับเบนช์มาร์กสาธารณะ (อัตราความแม่นยำ ยอดขาย/การนำไปใช้ ต้นทุนคอมพิวต์)

การพยากรณ์ที่คลุมเครือ ฟังดูเป็นไปได้แต่ยากจะหักล้าง เช่น “คอมพิวเตอร์จะอยู่ทุกหนทุกแห่ง” “AI จะเปลี่ยนสังคม” หรือ “มนุษย์จะผสานกับเทคโนโลยี” ข้อความเหล่านี้ยากจะพิสูจน์หรือปฏิเสธโดยตรง

วิธีปฏิบัติในการประเมินผู้พยากรณ์คือแยก ทิศทาง, การกำหนดเวลา, และ ความเฉพาะเจาะจง ออกจากกัน

ประเด็นไม่ใช่การติดป้ายคำพยากรณ์ว่า “ดี” หรือ “แย่” แต่เป็นการสังเกตว่าคำทำนายที่มั่นใจและขับเคลื่อนด้วยข้อมูลยังพึ่งพิงสมมติฐานที่ซ่อนอยู่อย่างไร—โดยเฉพาะเมื่อเกี่ยวกับการนำไปใช้ในสังคมที่ซับซ้อน ไม่ใช่แค่ฮาร์ดแวร์หรืออัลกอริธึมที่ดีขึ้นเพียงอย่างเดียว

"Law of Accelerating Returns" ของ Kurzweil คือแนวคิดว่าเมื่อเทคโนโลยีหนึ่งพัฒนา การปรับปรุงเหล่านั้นมักทำให้การพัฒนาในครั้งต่อไปง่ายขึ้น ซึ่งสร้างวงจรป้อนกลับที่ทำให้ความก้าวหน้าเร่งขึ้นตามเวลา

แนวโน้มแบบเส้นตรงเหมือนการเพิ่มจำนวนเท่าเดิมทุกปี: 1, 2, 3, 4

แนวโน้มแบบทวีคูณเหมือนการคูณ: 1, 2, 4, 8 ตอนแรกดูช้า—แล้วอยู่ดีๆ ก็รู้สึกว่าทุกอย่างเกิดขึ้นพร้อมกัน Kurzweil โต้แย้งว่าเทคโนโลยีหลายชนิด (โดยเฉพาะเทคโนโลยีสารสนเทศ) ตามรูปแบบนี้ เพราะแต่ละรุ่นของเครื่องมือช่วยสร้างรุ่นถัดไป

Kurzweil ไม่เพียงถามว่า "เราทำ X ได้ไหม?" แต่ถามว่า "เราทำ X ได้ถูกแค่ไหน?" รูปแบบทั่วไปในการคอมพิวติ้งคือ: ประสิทธิภาพเพิ่มขึ้นขณะที่ต้นทุนลดลง เมื่อต้นทุนในการรันโมเดลที่มีประโยชน์ลดลง คนจำนวนมากขึ้นสามารถทดลอง นำไปใช้ในผลิตภัณฑ์ และระดมทุนสำหรับคลื่นถัดไป—เร่งความก้าวหน้า

นี่คือเหตุผลที่เขาให้ความสนใจกับเส้นโค้งระยะยาวเช่น "การคำนวณต่อดอลลาร์" ไม่ใช่แค่เดโมที่เป็นหัวข้อข่าว

Moore’s law เป็นตัวอย่างคลาสสิก: เป็นเวลากว่าทศวรรษจำนวนทรานซิสเตอร์บนชิปเพิ่มขึ้นเป็นสองเท่าในช่วงเวลาหนึ่งๆ ผลักดันให้คอมพิวเตอร์เร็วขึ้นและถูกลง

ข้อโต้แย้งของ Kurzweil ไม่ใช่ว่า "Moore’s law จะดำเนินต่อไปตลอดไป" แต่กว้างกว่า: แม้ว่าวิธีการฮาร์ดแวร์หนึ่งจะช้าลง พวกวิธีอื่น (ชิปที่ดีขึ้น GPU/TPU การทำงานขนาน สถาปัตยกรรมใหม่ ประสิทธิภาพซอฟต์แวร์) ก็สามารถรักษาแนวโน้มต้นทุน/ประสิทธิภาพโดยรวมให้ดีขึ้นต่อไปได้

ผู้คนมักทำนายอนาคตโดยการขยายการเปลี่ยนแปลงล่าสุดในอัตราเดียวกัน นั่นทำให้มองข้ามการทบดอก เมื่อมองช่วงต้นการพัฒนาอาจดูไม่มาก—และความก้าวหน้าภายหลังจะดู "ฉับพลัน" ทั้งที่มันอาจถูกสร้างมาหลายปีตามเส้นโค้งที่คาดเดาได้

คำพยากรณ์แบบ Kurzweil มักเริ่มจากแนวโน้มที่วัดได้—สิ่งที่คุณใส่ลงในแผนภูมิได้ นั่นเป็นความแข็งแรง: คุณสามารถถกเถียงอินพุตแทนการโต้เถียงด้วยสัญชาติญาณเพียงอย่างเดียว แต่ก็เป็นจุดที่ข้อจำกัดใหญ่ปรากฏ

ผู้พยากรณ์เทคโนโลยีมักติดตาม:

เส้นโค้งเหล่านี้น่าเชื่อเพราะมีข้อมูลยาวนานและอัปเดตบ่อย หากมุมมองของคุณต่อ AGI คือ "ฮาร์ดแวร์พอควบคู่ซอฟต์แวร์ที่ถูกต้อง" ชุดข้อมูลเหล่านี้อาจให้พื้นฐานที่มั่นคง

ช่องว่างสำคัญคือ: ฮาร์ดแวร์มากขึ้นไม่ทำให้ระบบฉลาดขึ้นอัตโนมัติ ความสามารถของ AI ขึ้นกับอัลกอริธึม คุณภาพข้อมูล สูตรการฝึก เครื่องมือ และการป้อนกลับจากมนุษย์—ไม่ใช่แค่ FLOPs

วิธีที่มีประโยชน์คือคิดว่าฮาร์ดแวร์เป็น งบประมาณ ขณะที่ความสามารถเป็น ผลลัพธ์ ความสัมพันธ์ระหว่างสองอย่างมีจริง แต่ไม่ตายตัว บางครั้งการเปลี่ยนแปลงอัลกอริธึมเล็กๆ ปลดล็อกการก้าวกระโดด บางครั้งการขยายทรัพยากรโดนผลตอบแทนลดลง

เพื่อเชื่อม "อินพุต" (compute เงิน) กับ "เอาต์พุต" (สิ่งที่โมเดลทำได้) ผู้พยากรณ์ต้องการ:

เบนช์มาร์กอาจถูกเล่นได้ สัญญาณที่น่าโน้มน้าวที่สุดคือการรวมคะแนนทดสอบกับหลักฐานการใช้งานที่ทนทาน

สองความผิดพลาดบ่อยคือ คัดเลือกเส้นโค้งที่ดูทวีคูณ (เลือกหน้าต่างเวลาที่ดูดีที่สุด) และ มองข้ามคอขวด เช่น ข้อจำกัดด้านพลังงาน ข้อมูล หน่วงเวลา การกำกับดูแล หรือลักษณะยากของการเปลี่ยนความสามารถแคบเป็นความสามารถทั่วไป สิ่งเหล่านี้ไม่ทำให้การพยากรณ์หมดความหมาย—แต่ทำให้ช่วงความคลาดเคลื่อนกว้างขึ้น

เส้นเวลา AGI ระยะยาว—รวมถึงของ Kurzweil—พึ่งพามากกว่าช่องว่างของ "เหตุการณ์เฉลย" เดียว แต่มากับกองสมมติฐานที่ต้องเป็นจริงพร้อมกัน หากชั้นใดชั้นหนึ่งอ่อนลง วันที่อาจเลื่อนได้ แม้ความก้าวหน้าจะยังดำเนินต่อไป

คำพยากรณ์ส่วนใหญ่สมมติว่า 3 เส้นโค้งเพิ่มขึ้นพร้อมกัน:

สมมติฐานซ่อนเร้นสำคัญ: ทั้งสามตัวขับเคลื่อนนี้ไม่ได้ทดแทนกันได้อย่างสมบูรณ์ หากคุณภาพข้อมูลติดเพดาน การเพิ่มแค่ compute อาจให้ผลน้อยลง

คำพยากรณ์มักถือว่าการคำนวณเป็นเส้นโค้งราบเรียบ แต่โลกจริงผ่านโรงงานและโครงข่ายพลังงาน

ต้นทุนพลังงาน ความสามารถการผลิตชิป การควบคุมการส่งออก แบนด์วิดท์หน่วยความจำ อุปกรณ์เครือข่าย และช็อกซัพพลายเชน ทั้งหมดอาจจำกัดความเร็วที่การฝึกและการปรับใช้ขยาย แม้ทฤษฎีจะบอกว่า "เพิ่มการคำนวณ 10×" เส้นทางไปสู่จุดนั้นอาจขรุขระและแพง

คำพยากรณ์ระยะยาวยังสมมติว่าสังคมจะไม่ชะลอการนำไปใช้มากเกินไป:

การกำกับดูแล ความรับผิดชอบ ความไว้วางใจของสาธารณะ และผลตอบแทนการลงทุน ล้วนมีผลต่อว่าระบบขั้นสูงถูกฝึกและนำไปใช้ในวงกว้างหรือถูกจำกัดไว้ในสภาพแวดล้อมที่มีแรงเสียดทานสูง

สมมติฐานสำคัญที่สุดอาจเป็นว่า ความก้าวหน้าด้านความสามารถจากการขยายสเกล (การให้เหตุผลดีขึ้น การวางแผน การใช้เครื่องมือ) จะค่อย ๆ บรรจบสู่ สติปัญญาทั่วไป

"เพิ่มแค่ compute" อาจทำให้โมเดลคล่องแคล่วและมีประโยชน์ขึ้น แต่ไม่ได้หมายความว่าจะเป็น ทั่วไป ในความหมายของการถ่ายโอนข้ามโดเมน ความเป็นอิสระระยะยาว หรือเป้าหมายที่มั่นคง เส้นเวลาระยะยาวมักสมมติว่าช่องว่างเหล่านี้เป็นปัญหาทางวิศวกรรม—ไม่ใช่อุปสรรคพื้นฐาน

แม้ปริมาณการคำนวณและขนาดโมเดลยังเพิ่มขึ้น AGI อาจมาช้ากว่าที่พยากรณ์ไว้ด้วยเหตุผลที่ไม่เกี่ยวกับความเร็วเพียงอย่างเดียว คอขวดหลายอย่างเกี่ยวกับ สิ่งที่ เรากำลังสร้างและ วิธี ที่เรารู้ว่ามันใช้งานได้

"AGI" ไม่ใช่ฟีเจอร์เดียวที่ปิด/เปิด นิยามที่ใช้งานได้มักหมายถึงตัวแทนที่สามารถ เรียนรู้งานใหม่อย่างรวดเร็ว ถ่ายโอนทักษะข้ามโดเมน วางแผนระยะยาว และ จัดการเป้าหมายที่ยุ่งเหยิงเปลี่ยนแปลงได้ ด้วยความน่าเชื่อถือสูง

ถ้าเป้าหมายยังเปลี่ยน—ผู้ช่วยคุยโต้ vs. คนทำงานอัตโนมัติ vs. ผู้ให้เหตุผลระดับนักวิทยาศาสตร์—ความก้าวหน้าจะดูน่าประทับใจแต่ยังขาดความสามารถสำคัญเช่น หน่วยความจำระยะยาว การให้เหตุผลเชิงสาเหตุ หรือการตัดสินใจที่สม่ำเสมอ

เบนช์มาร์กสามารถถูกเล่น เกิดการ overfit หรือล้าสมัยได้ ผู้สงสัยมักต้องการหลักฐานว่า AI สำเร็จใน งานที่ไม่เคยเห็นมาก่อน ภายใต้ ข้อจำกัดใหม่ๆ โดยมี อัตราความผิดพลาดต่ำ และ ผลลัพธ์ซ้ำได้

ถ้าชุมชนไม่เห็นพ้องกันในแบบทดสอบที่แยก "การเติมลวดลาย" ออกจาก "ความสามารถทั่วไป" เส้นเวลาจะกลายเป็นการเดา—และความระมัดระวังอาจชะลอการนำไปใช้

ความสามารถอาจเพิ่มเร็วกว่าการควบคุม หากระบบมีแนวโน้มจะเป็นตัวแทนจริงจัง ระดับมาตรฐานในการป้องกันการหลอกลวง การเบี่ยงเบนเป้าหมาย และผลกระทบอันตรายจะสูงขึ้น

การกำกับดูแล การตรวจสอบ และวิศวกรรมความปลอดภัยอาจใช้เวลา แม้ว่าพื้นฐานโมเดลจะดีขึ้นเร็ว—โดยเฉพาะการใช้งานที่ความเสี่ยงสูง

หลายคำนิยามของ AGI นำมาโดยนัยถึงความสามารถในโลกกายภาพ: การจัดการวัตถุ การทำการทดลอง การใช้เครื่องมือ และการปรับตัวตามฟีดแบ็กแบบเรียลไทม์

ถ้าการเรียนรู้ในโลกจริงต้องใช้ข้อมูลมาก ช้า หรือมีความเสี่ยง AGI อาจติดที่ระดับ "เก่งบนหน้าจอ" ขณะที่ความทั่วไปเชิงปฏิบัติรอการพัฒนาด้านหุ่นยนต์ การจำลอง และวิธีการฝึกที่ปลอดภัยกว่า

คำพยากรณ์ของ Kurzweil มีอิทธิพลเพราะชัดเจนและเชิงปริมาณ—แต่ความชัดเจนนี้ก็เปิดรับคำวิจารณ์

ข้อโต้แย้งทั่วไปคือ Kurzweil พึ่งพาการขยายเส้นโค้งทางประวัติศาสตร์ (compute, storage, bandwidth) ไปอนาคต ผู้วิจารณ์โต้ว่าเทคโนโลยีไม่ได้โตอย่างราบเรียบเสมอไป: ความก้าวหน้าชิปอาจช้าลง ต้นทุนพลังงานอาจกัดกิน แรงจูงใจทางเศรษฐกิจอาจเปลี่ยน แม้ทิศทางระยะยาวจะขึ้น แต่ อัตรา อาจเปลี่ยนแบบที่ทำให้วันที่เฉพาะไม่เชื่อถือได้

AGI ไม่ได้ขึ้นกับฮาร์ดแวร์เร็วนิดเดียว แต่มันเป็นปัญหาระบบซับซ้อนที่รวมอัลกอริธึม ข้อมูล วิธีการฝึก การประเมิน ข้อจำกัดด้านความปลอดภัย และการนำไปใช้ของมนุษย์ ความก้าวหน้าอาจถูกคอขวดด้วยความคิดเดียวที่ขาดหาย—สิ่งที่คุณไม่สามารถใส่ในปฏิทินได้ ผู้สงสัยชี้ว่าวิทยาศาสตร์มักก้าวผ่านขั้นไม่สม่ำเสมอ: ช่วงหยุดยาวตามด้วยกระโดดฉับพลัน

คำวิจารณ์เชิงจิตวิทยาอีกอย่างคือ เราจำการทำนายที่โดดเด่นได้มากกว่าความผิดพลาด ถ้าคนหนึ่งทำคำทำนายยาวๆ จำนวนหนึ่ง สักไม่กี่ครั้งที่โดดเด่นอาจครอบงำการรับรู้สาธารณะ นี่ไม่ใช่หลักฐานว่าผู้พยากรณ์ผิด แต่ทำให้ความมั่นใจในความแม่นยำของเส้นเวลาเกินจริงได้

แม้ผู้เชี่ยวชาญยอมรับความก้าวหน้าของ AI ต่างเห็นต่างกันว่าคุณสมบัติใดคือ AGI ทักษะอะไรต้องทั่วไป และจะวัดมันอย่างไร ความแตกต่างเล็กน้อยในคำนิยาม (ความกว้างของงาน อิสระ ความน่าเชื่อถือ การเรียนรู้ในโลกจริง) สามารถเลื่อนเส้นเวลาได้เป็นสิบปีโดยที่ใครก็ยังไม่เปลี่ยนมุมมองพื้นฐานของความก้าวหน้าปัจจุบัน

Kurzweil เป็นเสียงดังหนึ่ง แต่เส้นเวลา AGI เป็นการถกเถียงกันมาก พื้นที่แบ่งโดยคร่าวคือ กลุ่มระยะใกล้ (AGI ในไม่กี่ปีถึงสองทศวรรษ) กับกลุ่มระยะไกล (หลายทศวรรษหรือ "ไม่ใช่ศตวรรษนี้") พวกเขามักมองแนวโน้มเดียวกันแต่เห็นต่างกันในสิ่งที่ยังขาด: ผู้พยากรณ์ระยะใกล้มักเน้นการสเกลอย่างรวดเร็วและความสามารถเกิดขึ้นเอง ขณะที่ผู้พยากรณ์ระยะไกลเน้นปัญหาที่ยังไม่แก้เช่น การให้เหตุผลที่เชื่อถือได้ ความเป็นอิสระ และความทนทานในโลกจริง

การสำรวจผู้เชี่ยวชาญ รวบรวมความเชื่อจากนักวิจัยและผู้ปฏิบัติงาน (เช่น โพลที่ถามเมื่อมีโอกาส 50% สำหรับ "human-level AI") ซึ่งเผยความเห็นที่เปลี่ยนไปตามเวลา แต่ขึ้นกับว่าใครถูกสำรวจและตั้งคำถามอย่างไร

การวางแผนสถานการณ์ ไม่เลือกวันที่เดียว แต่ร่างอนาคตเป็นหลายแบบ (ความก้าวหน้าเร็ว ความก้าวหน้าช้า คอขวดด้านกฎระเบียบ ข้อจำกัดฮาร์ดแวร์) แล้วถามว่าสัญญาณใดจะบอกเส้นทางแต่ละแบบ

การพยากรณ์แบบเบนช์มาร์กและความสามารถ ติดตามขั้นตอนที่เป็นรูปธรรม (งานการเขียนโค้ด การให้เหตุผลทางวิทยาศาสตร์ ความน่าเชื่อถือของตัวแทน) และประเมินอัตราการปรับปรุงที่ต้องการเพื่อให้ถึงความสามารถที่กว้างขึ้น

"AGI" อาจหมายถึงการผ่านชุดทดสอบกว้าง การทำงานแทนงานส่วนใหญ่ การปฏิบัติเป็นตัวแทนอิสระ หรือเทียบชั้นมนุษย์ข้ามโดเมนด้วยการดูแลน้อยลง นิยามเข้มงวดมักทำให้เส้นเวลายาวขึ้น และความไม่เห็นด้วยตรงนี้อธิบายความแตกต่างมากมาย

แม้ผู้มองโลกในแง่ดีและผู้สงสัยมักเห็นต่าง แต่ทั้งคู่มักเห็นพ้องกันในประเด็นหนึ่ง: เส้นเวลา ไม่แน่นอนสูง และคำพยากรณ์ควรถูกมองเป็นช่วงและสมมติฐาน—ไม่ใช่สัญญาปฏิทิน

คำพยากรณ์ AGI อาจดูเป็นนามธรรม จึงช่วยได้ถ้าติดตามสัญญาณที่ควรเปลี่ยน ก่อน "ช่วงเวลาใหญ่" หากเส้นเวลาในสไตล์ Kurzweil ถูกต้อง ทศวรรษหน้าควรแสดงการเพิ่มขึ้นอย่างสม่ำเสมอในความสามารถ ความน่าเชื่อถือ เศรษฐกิจ และการกำกับ

จับตาโมเดลที่สามารถ วางแผนหลายขั้นตอนอย่างน่าเชื่อถือ ปรับเมื่อตัวแผนล้มเหลว และ ใช้เครื่องมือ (โค้ด เบราว์เซอร์ แอปข้อมูล) โดยไม่ต้องคอยดูแลตลอดเวลา สัญญาณที่สำคัญไม่ใช่เดโมฉูดฉาด แต่คือ ความเป็นอิสระที่มีขอบเขตชัดเจน: ตัวแทนที่ทำงานหลายชั่วโมง ถามคำถามชี้แจง และส่งต่องานต่อเมื่อไม่แน่ใจได้อย่างปลอดภัย

ความก้าวหน้าจะแสดงเป็น อัตราความผิดพลาดที่ต่ำลงในเวิร์กโฟลว์จริง ไม่ใช่แค่คะแนนเบนช์มาร์ก ตรวจสอบว่าการเกิด "hallucination" ลดลงเมื่อระบบถูกขอให้ อ้างแหล่งที่มา ทำการตรวจเช็ค หรือยืนยันตัวเอง ขั้นตอนสำคัญคือประสิทธิภาพภายใต้การตรวจสอบ—งานเดียวกัน หลายรอบ ผลลัพธ์สม่ำเสมอ

มองหาการเพิ่มผลผลิตที่วัดได้ในบทบาทเฉพาะ (ซัพพอร์ต การวิเคราะห์ ซอฟต์แวร์ การดำเนินงาน) พร้อมกับ ประเภทงานใหม่ ที่เกิดจากการคุมและผสาน AI ต้นทุนสำคัญ: หากผลลัพธ์คุณภาพสูงมีราคาถูกลง (ต่อภารกิจ ต่อชั่วโมง) การนำมาใช้จะเร่ง—โดยเฉพาะกับทีมเล็กๆ

หากความสามารถเพิ่มขึ้น การกำกับควรย้ายจากหลักการสู่การปฏิบัติ: มาตรฐาน การตรวจสอบโดยบุคคลที่สาม รายงานเหตุการณ์ และกฎที่ชัดเจนเกี่ยวกับความรับผิดชอบ อีกสิ่งที่ควรจับตาคือ การตรวจสอบการใช้ compute และกฎการรายงาน—สัญญาณว่ารัฐและอุตสาหกรรมมองการสเกลเป็นคันโยกที่ติดตามได้และควบคุมได้

ถ้าคุณต้องการใช้สัญญาณพวกนี้โดยไม่ตอบสนองเกินเหตุกับหัวข้อข่าว ลองดู /blog/ai-progress-indicators.

เส้นเวลา AGI ควรถูกมองเหมือนการพยากรณ์อากาศสำหรับวันที่ห่างออกไป: มีประโยชน์สำหรับการวางแผน แต่น่าเชื่อถือไม่นานเป็นคำสัญญา คำพยากรณ์ในสไตล์ Kurzweil ช่วยให้คุณสังเกตแนวโน้มระยะยาวและทดสอบการตัดสินใจ แต่ไม่ควรเป็นจุดล้มเหลวเดียวในกลยุทธ์ของคุณ

ใช้คำพยากรณ์เพื่อสำรวจ ช่วง และ สถานการณ์ แทนปีเดียว ถ้ามีคนบอกว่า "AGI ภายใน 203X" ให้แปลงเป็น: "จะต้องมีการเปลี่ยนแปลงอะไรบ้างเพื่อให้เป็นจริง—และถ้าไม่เกิด เราจะทำอย่างไร?" แล้ววางแผนหลายผลลัพธ์

สำหรับบุคคล: สร้างทักษะที่ทนทาน (การกรอบปัญหา ความเชี่ยวชาญโดเมน การสื่อสาร) และรักษานิสัยเรียนรู้เครื่องมือใหม่ๆ

สำหรับธุรกิจ: ลงทุนในการรู้เท่าทัน AI คุณภาพข้อมูล และโครงการนำร่องที่มี ROI ชัด—ในขณะเดียวกันเตรียมแผน "ไม่ขาดทุน" ที่ยังทำงานได้ถ้า AGI มาช้ากว่า

วิธีปฏิบัติหนึ่งในการแปลง "จับตาสัญญาณและวนรอบ" เป็นการย่อวงจรการสร้าง: ทำโปรโตไทป์เวิร์กโฟลว์ ทดสอบความน่าเชื่อถือ และวัดผลการเพิ่มผลผลิตก่อนจะเดิมพันใหญ่ แพลตฟอร์มอย่าง Koder.ai เหมาะกับวิธีนี้โดยให้ทีมสร้างเว็บ เบื้องหลัง และแอปมือถือผ่านอินเทอร์เฟซแชท (มีโหมดวางแผน สแนปช็อต และการย้อนกลับ) ดังนั้นคุณสามารถทดลองกระบวนการที่ตัวแทนช่วยได้อย่างรวดเร็ว ส่งออกซอร์สโค้ดเมื่อจำเป็น และเลี่ยงการล็อกกลยุทธ์ไว้กับคำพยากรณ์เดียว

ข้อสรุปที่สมดุล: เส้นเวลาช่วยชี้นำการเตรียมพร้อม แต่ไม่ใช่ความแน่นอน ใช้มันเพื่อจัดลำดับความสำคัญการทดลองและลดช่องว่างความไม่รู้—แล้วทบทวนสมมติฐานของคุณเป็นประจำเมื่อมีหลักฐานใหม่ปรากฏ

Kurzweil’s forecasts matter because they’re specific enough to test and widely cited, which shapes how people talk about AGI timelines.

Practically, they influence:

Even if the dates are wrong, the milestones and assumptions he highlights can be useful planning inputs.

In this context, AGI means an AI that can learn and perform a wide range of tasks at roughly human level, including adapting to new problems without being narrowly specialized.

A practical checklist implied by the article includes:

Kurzweil’s most discussed public view places human-level AGI in the late 2020s to 2030s, framed as a likely window rather than a guaranteed single year.

The actionable way to use this is to treat it as a scenario range and track whether the prerequisite trends (compute cost, algorithms, deployment) keep moving in the needed direction.

He argues that progress accelerates because improvements in a technology often make it easier to improve it again—creating a compounding feedback loop.

In practice, he points to trends like:

The core claim isn’t “one law explains everything,” but that compounding can make slow-looking early progress turn into rapid change later.

Compute is a key input, but the article emphasizes that hardware progress ≠ capability progress.

More compute helps when paired with:

A good mental model is: hardware is the ; capability is the —the mapping between them can change.

Useful supporting data includes long-run, measurable curves:

Key limits:

Major assumptions called out in the article include:

If any layer weakens, the date can slip even if progress continues.

Several delay factors don’t require trends to reverse:

These can slow timelines even while models keep improving on paper.

The article highlights critiques such as:

A practical takeaway: treat precise dates as , not promises.

Watch signals that move before any “AGI moment,” especially:

Using signals like these helps you update beliefs without overreacting to flashy demos.