Ölçeklenince “Soyutlama Sızıntısı” Ne Anlama Gelir

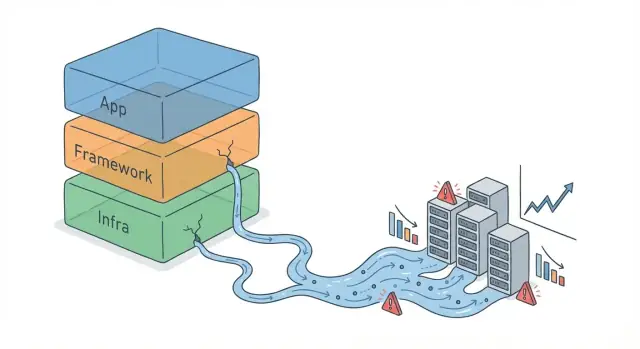

Soyutlama, işleri basitleştiren bir katmandır: bir framework API'si, ORM, mesaj kuyruğu istemcisi veya tek satırlık bir cache yardımcı fonksiyonu. Size daha yüksek seviyede kavramlarla düşünme imkânı verir ("bu nesneyi kaydet", "bu olayı yolla") ve alt seviye mekanikleri sürekli yönetmek zorunda bırakmaz.

Bir soyutlama sızıntısı, bu gizlenen detaylar nihayetinde sonuçları etkilemeye başladığında olur—yani soyutlamanın saklamaya çalıştığı şeyleri anlamak ve yönetmek zorunda kalırsınız. Kod hâlâ “çalışıyor” gibi görünür, ama basitleştirilmiş model gerçek davranışı artık öngörmez.

Neden ilk başta sızıntılar görünmez kalır

Erken büyüme hoşgörülüdür. Düşük trafik ve küçük veri setleriyle verimsizlikler, boş CPU, sıcak önbellekler ve hızlı sorguların arkasına saklanır. Gecikme sıçramaları nadirdir, retry'ler yığılmaz ve hafifçe israf eden bir log satırı önem taşımaz.

Hacim arttıkça aynı kestirmeler şiddetlenir:

- Daha fazla istek küçük ek yükleri sürekli bir darboğaza çevirir.

- Daha büyük tablolar "kolay" sorguları pahalı hale getirir.

- Daha fazla servis, zaman aşımlarının, retry'lerin ve kısmi hataların zincirlenme ihtimalini artırır.

Sızıntılar sadece hızla ilgili değildir

Sızan soyutlamalar genellikle üç alanda görünür:

- Performans: yavaş sorgular, thread tükenmesi, aşırı serileştirme, beklenmeyen N+1 çağrılar.

- Güvenilirlik: retry fırtınaları, kuyruk birikimi, kademeli hataları tetikleyen zaman aşımları.

- Maliyet: çok konuşan servisler, gereksiz logging, verimsiz caching ve önlenebilir depolama/ağ kullanımı nedeniyle artan bulut faturaları.

Bu rehberde ne beklemelisiniz

Sonraki bölümlerde, bir soyutlamanın sızdığına dair pratik sinyaller, altta yatan nedeni (sadece semptomları değil) nasıl teşhis edeceğiniz ve yapılandırma düzeltmelerinden soyutlamanın ötesine bilinçli olarak "düşmeye" kadar uygulanabilir mitigasyon seçeneklerine odaklanacağız.

Ölçek Kuralları Nasıl Değiştirir

Pek çok yazılım benzer bir yol izler: bir prototip fikri kanıtlar, bir ürün çıkar, sonra kullanım ilk mimariden daha hızlı büyür. Erken dönemde framework'ler sihirli gelir çünkü varsayılanlar hızlı hareket etmenizi sağlar—routing, veritabanı erişimi, loglama, retry'ler ve arka plan işleri çoğu zaman "bedava" gibi görünür.

Ölçeklendiğinizde bu faydaları hâlâ istersiniz—ama varsayılanlar ve kolay API'ler varsayımlara dönüşür.

Varsayılanlar "normal" iş yüküne göre ayarlanmıştır

Framework varsayılanları genellikle şunları varsayar:

- mütevazi veri boyutu

- dengeli trafik

- sınırlı eşzamanlılık

- öngörülebilir yürütme süresi

Bu varsayımlar erken dönemde geçerlidir, bu yüzden soyutlama temiz görünür. Ama ölçek "normal"in ne olduğu değiştirdiğinde sorun başlar. 10.000 satır için uygun olan bir sorgu 100 milyon satırda yavaşlar. Basit görünen bir senkron handler trafik sıçramalarında zaman aşımına uğramaya başlar. Arada sırada başarısızlığı yumuşatan bir retry politikası, binlerce istemci aynı anda retry yaptığında kesintileri büyütebilir.

Hacim, patlamalar ve eşzamanlılık gizli maliyetleri açığa çıkarır

Ölçek sadece "daha fazla kullanıcı" demek değildir. Daha yüksek veri hacmi, patlayıcı trafik ve aynı anda gerçekleşen daha fazla eşzamanlı iş demektir. Bunlar soyutlamaların gizlediği kısımlara baskı yapar: bağlantı havuzları, thread zamanlayıcıları, kuyruk derinliği, bellek baskısı, I/O limitleri ve bağımlılıklardan gelen hız sınırları.

Framework'ler genellikle güvenli, genel ayarlar seçer (havuz boyutları, zaman aşımları, batch davranışı). Yük altında bu ayarlar içeride rekabete, uzun kuyruk gecikmesine ve kademeli hatalara dönüşebilir—her şey margin'ler içinde rahatça sığdığında görünmeyen problemler.

Production, sadece ekstra trafik olan bir staging değildir

Staging ortamları nadiren production koşullarını tam olarak yansıtır: daha küçük veri setleri, daha az servis, farklı cache davranışı ve daha az "karmaşık" kullanıcı etkinliği. Production'da ayrıca gerçek ağ değişkenliği, gürültülü komşular, rolling deploy'lar ve kısmi hatalar vardır. Bu yüzden testlerde sıkı görünen soyutlamalar, gerçek dünya koşulları baskı uyguladığında sızmaya başlar.

Bir Soyutlamanın Sızdığının Yaygın Sinyalleri

Bir framework soyutlaması sızdığında, semptomlar nadiren temiz bir hata mesajı olarak ortaya çıkar. Bunun yerine desenler görürsünüz: düşük trafikte iyi çalışan davranış, yüksek hacimde öngörülemez veya pahalı hale gelir.

Sızan bir soyutlama genellikle kullanıcı tarafından görülen gecikmelerle kendini duyurur:

- Ortalama değerler "tamam" görünürken p95/p99'ların patlaması

- Sadece yoğun yük altında ortaya çıkan zaman aşımları

- İşin geldiğinden daha yavaş işlendiği kuyruk birikimi (arka plan işler, mesaj tüketicileri, thread havuzları)

- Ani throughput tavanları: örnek ekleseniz bile RPS neredeyse artmaz

Bunlar, soyutlamanın bir darboğazı gizlediğinin klasik işaretleridir—gerçek sorguları, bağlantı kullanımını veya I/O davranışını incelemeden çözemezsiniz.

Fatura gibi görünen maliyet semptomları

Bazı sızıntılar önce panoya değil faturaya yansır:

- Belirgin özellik değişikliği olmadan veritabanı CPU'sunun veya IOPS'unun yükselmesi

- Cache thrash: hit rate'in dalgalanması, evictions'ın artması veya hot key'lerin hakimiyeti

- Beklenmedik bölge/zonlar arası trafiğe neden olan ara katman veya proxy yolları yüzünden yükselen egress ücretleri

- Aynı yükü tutmak için daha fazla node'a ihtiyaç duyulması; çünkü serileştirme, loglama, retry gibi overhead hacimle birlikte büyür

Altyapıyı büyütmek performansı orantılı olarak geri getirmiyorsa, genellikle ham kapasite eksikliği değil—ödemekte olduğunuz farkına varmadığınız overhead vardır.

Güvenilirlik semptomları (en korkutucu olanlar)

Sızıntılar, retry'ler ve bağımlılık zincirleriyle etkileştiğinde güvenilirlik sorunlarına dönüşür:

- Kademeli hatalar: bir yavaş bağımlılık yukarı akışı zaman aşımına sokar, bu da başka yerlere yük bindirir

- Retry'ler yükü artırır: bir zaman aşımı istemcileri/işçileri tekrar denemeye zorlayıp zayıf bileşenin üzerindeki baskıyı ikiye veya üçe katlar

- Circuit breaker'lar ve hız limitleri "rastgele" tetiklenir çünkü gecikme varyansı artar

- Olaylar "sadece yavaş" olarak başlar, kısmi kesintilerle biter

Hızlı kontrol listesi: sızıntı mı yoksa yetersiz sağlama mı?

Satın almadan önce sağduyu için kullanın:

- Kaynakları ikiye katladığınızda performans doğrusal olarak iyileşiyor mu? Eğer hayırsa, sızıntıyı şüpheleyin.

- Uygulama sunucularındaki CPU ılımlı kalırken p95/p99 gecikme ve hata oranları kötüleşiyor mu? Genelde gizli bağımlılık darboğazı.

- İstek hacmine göre orantısız veritabanı/cache/ağ büyümesi görüyor musunuz? Muhtemelen soyutlama ekstra iş üretiyor.

- Retry'ler/kuyruklar sıçramalarla korelasyon gösteriyor mu (yük daha fazla yük üretiyor mu)? Bu genelde sızıntının hata işleme ile etkileşimi.

Semptomlar tek bir bağımlılıkta yoğunlaşıyorsa ve "daha fazla sunucu" etkili bir şekilde çözmüyorsa, soyutlamanın altına bakmanız gerektiğinin güçlü bir göstergesidir.

Veritabanı Soyutlamaları: ORM'ler, Sorgular ve Gizli Maliyetler

ORM'ler boilerplate'ten kurtarır, ama her nesnenin sonunda bir SQL sorgusuna dönüştüğünü unutturmayı da kolaylaştırır. Küçük ölçekte bu takas görünmez olabilir. Daha yüksek hacimlerde veritabanı genellikle "temiz" bir soyutlamanın faiz talep etmeye başladığı ilk yer olur.

N+1 sorgularının aniden belirmesi

N+1, bir ana kayıt listesini yüklediğinizde (1 sorgu) ve döngü içinde her ana için ilişkili kayıtları yüklediğinizde (N ek sorgu) olur. Lokal testte bu sorun görünmeyebilir—N belki 20'dir. Prod'da N 2.000'e çıkar ve uygulamanız sessizce bir isteği binlerce round-trip'e dönüştürür.

Zor kısım, hiçbir şeyin hemen "bozulmaması"; gecikme yavaş yavaş artar, bağlantı havuzları dolar ve retry'ler yükü büyütür.

Fazla veri çekme, eksik indeksler ve pahalı join'ler

Soyutlamalar genellikle varsayılan olarak tam nesneleri çekmeyi teşvik eder; oysa sadece iki alan gerekebilir. Bu I/O, bellek ve ağ transferini artırır.

Aynı zamanda ORM'ler varsaydığınız indeksleri atlayan sorgular üretebilir (ya da indeks hiç yoktur). Tek bir eksik indeks seçici bir aramayı tablo taramasına dönüştürebilir.

Join'ler başka bir gizli maliyettir: "ilişkiyi dahil et" diyerek okunan şey büyük ara sonuçlara sahip çoklu join sorgularına dönüşebilir.

Bağlantı havuzları ve transaction rekabeti

Yük altında veritabanı bağlantıları kıt kaynaktır. Eğer her istek birden fazla sorguya yayılıyorsa, havuz çabucak sınırına ulaşır ve uygulama kuyruğa girer.

Bazen kazara uzun transaction'lar da rekabete yol açar—kilitler daha uzun sürer ve eşzamanlılık çöker.

Daha iyi ölçeklenen mitigasyonlar

- Bilinen ilişkiler için eager loading kullanın, ama kasıtlı olun: sadece ihtiyacınız olanı çekin.

- Sorguları şekillendirin: belirli sütunları seçin, sayfalandırma uygulayın ve sınırsız "hepsini yükle" desenlerinden kaçının.

- Mümkünse toplu operasyonlar (bulk insert/update) kullanın.

- Okuma ağırlıklı sistemler için read replica'lar ekleyin ve güvenli sorguları onlara yönlendirin.

- ORM tarafından üretilen SQL'i

EXPLAIN ile doğrulayın; indeksleri uygulama tasarımının bir parçası olarak ele alın.

Eşzamanlılık Modelleri ve Backpressure

Eşzamanlılık, soyutlamaların geliştirmede "güvenli" hissettirdiği ve sonra yük altında yüksek sesle başarısız olduğu alandır. Bir framework'ün varsayılan modeli genellikle gerçek kısıtı gizler: sadece istekleri servis etmiyorsunuz—CPU, thread, socket ve downstream kapasitesi için rekabet yönetiyorsunuz.

Thread-başına-istek vs async: farklı hata biçimleri

Thread-başına-istek (klasik web yığını) basittir: her istek bir worker thread alır. I/O yavaşladığında thread'ler birikir. Thread havuzu tükendiğinde yeni istekler kuyruğa girer, gecikme yükselir ve zaman aşımları görülür—sunucu "meşgul" görünür ama aslında çoğunluğu beklemektedir.

Async/event-loop modelleri az thread ile çok sayıda eşzamanlı isteği idare eder, bu yüzden yüksek eşzamanlılıkta iyidir. Onlar farklı şekilde kırılır: bir bloklayıcı çağrı (senkron kütüphane, ağır JSON parsing, yoğun logging) event loop'u durdurabilir ve "bir yavaş istek"i "her şey yavaş"a çevirebilir. Async ayrıca çok fazla eşzamanlılık oluşturmaya eğilimlidir; bu, thread limitlerinin yapacağından daha hızlı bir şekilde bağımlılığı boğabilir.

Backpressure: eksik olan sözleşme

Backpressure, çağıranlara "yavaşla; daha fazlasını güvenle kabul edemem" demektir. Olmazsa, yavaş bir bağımlılık sadece yanıtları yavaşlatmaz—aynı zamanda in-flight iş, bellek kullanımı ve kuyruk uzunluğunu artırır. Bu ekstra iş bağımlılığı daha da yavaşlatır.

Zaman aşımları ve retry fırtınaları

Zaman aşımları açık ve katmanlı olmalıdır: client, servis ve bağımlılık. Zaman aşımları çok uzun ise kuyruklar büyür; retry'ler otomatik ve agresif ise retry fırtınası tetiklenebilir: bir bağımlılık yavaşlar, çağrılar zaman aşımına girer, tekrar denenir, yük katlanır ve bağımlılık çöker.

Ölçeklendikçe işe yarayan mitigasyonlar

- Bulkhead'lar kullanın: kaynakları izole edin (her bağımlılık için ayrı thread/connection pool) ki tek bir yavaş bileşen her şeyi tüketemesin.

- Circuit breaker'lar ekleyin ki başarısız bir bağımlılığa çağrı kesilsin ve onun toparlanma zamanı olsun.

- Kuyruklar güvenli sınırı aştığında hızlıca reddetme (request shedding) uygulayın—bir kısmı düşürmek, tüm trafiğin belirsiz şekilde zaman aşımına uğramasından iyidir.

Ağ ve Middleware Overhead'i

Sezgiden kanıta geçin

Üretim ipuçlarını ölçülebilir bir yapıya dönüştürün: inşa edin, ayarlayın ve geri alın.

Framework'ler ağ çağrılarını "sadece bir endpoint çağrısı" gibi hissettirir. Yük altında bu soyutlama çoğu zaman middleware yığını, serileştirme ve payload işleme tarafından yapılan görünmez iş aracılığıyla sızar.

"Basit" middleware'in her hop'ta yarattığı vergi

Her katman—API gateway, auth middleware, rate limiting, istek doğrulama, gözlemlenebilirlik kancaları, retry'ler—biraz zaman ekler. Geliştirmede bir milisaniye önemsizdir; ölçeklendiğinde birkaç middleware hop'u 20 ms olan isteği 60–100 ms'e çıkarabilir, özellikle kuyruklar oluştuğunda.

Sorun, gecikmenin sadece eklenmekle kalmayıp amplifiye olmasıdır. Küçük gecikmeler eşzamanlılığı artırır (daha fazla in-flight istek), bu da rekabeti artırır (thread/connection havuzları), bu da tekrar gecikmeleri artırır.

Serileştirme maliyetleri ve payload boyutu sürprizleri

JSON pratiktir, ama büyük payload'ların encode/decode edilmesi CPU'yu domine edebilir. Sızıntı genelde "ağ" yavaşlığı gibi görünür ama aslında uygulama CPU zamanı ve buffer tahsisi nedeniyle oluşur.

Büyük payload'lar ayrıca çevrelerindeki her şeyi yavaşlatır:

- Transit süreleri ve buffer kopyalama süreleri artar

- Yönetilen runtime'larda GC baskısı yükselir

- Birkaç büyük yanıtın paylaşılan kaynakları bloke ettiği uzun kuyruk kuyruk gecikmeleri oluşur

Header'lar (cookie, auth token, tracing header) isteği gizlice şişirebilir. Bu büyüme her çağrıda ve her hop'ta katlanır.

Sıkıştırma bir takastır: bant genişliğinden tasarruf sağlar ama CPU maliyeti getirir ve küçük payload'larda/çoklu proxy'lerde gecikmeyi artırabilir.

Ayrıca streaming vs buffering önemlidir. Birçok framework varsayılan olarak tüm gövdeyi buffer'lar (retry, logging veya content-length gereksinimleri için). Bu kullanışlıdır, ama yüksek hacimde bellek kullanımını artırır ve head-of-line blocking oluşturur. Streaming bellek kullanımını öngörülebilir tutar ve time-to-first-byte'ı azaltır, ama daha dikkatli hata yönetimi gerektirir.

Pratik mitigasyonlar

Payload boyutu ve middleware derinliğini bir bütçe olarak ele alın:

- Payload ve header bütçeleri belirleyin; limit ve uyarılarla uygulayın

- "Hepsini döndür" endpoint'leri yerine sayfalandırma ve kısmi yanıtları tercih edin

- Büyük yüklemeleri/indirmeleri stream edin; tam gövdeleri loglamaktan kaçının

- Gecikme/CPU kritikse ikili formatlar (ör. Protobuf) düşünün

- Sıkıştırmayı seçici kullanın (boyut eşiklerine göre, zincirde tek bir yerde)

Ölçek ağ overhead'ini açığa çıkardığında, düzeltme genellikle "ağı optimize et"ten ziyade "her istekte yapılan gizli işleri durdur" olur.

Önbellekleme: "Kolay" Çözüm Yeni Hata Modları Yaratabilir

Cache genellikle basit bir anahtar gibi görülür: Redis (veya CDN) ekle, gecikmenin düştüğünü gör, işi bitir. Gerçek yük altında caching bir soyutlama olarak kötü sızar—çünkü işin nerede, ne zaman ve nasıl gerçekleştiğini değiştirir ve hataların yayılma şeklini etkiler.

Cache ücretsiz hız artışı değildir

Bir cache ek ağ hop'ları, serileştirme ve operasyonel karmaşıklık getirir. Ayrıca ikinci bir "gerçeklik kaynağı" oluşturur: eski, kısmen dolu veya kullanılamaz olabilir. Bir şeyler ters gittiğinde sistem sadece yavaşlamaz—farklı davranır (eski veri sunmak, retry'leri çoğaltmak veya veritabanını aşırı yüklemek).

Yaygın hata modları: stampede, anahtarlar ve invalidasyon

Cache stampede bir çok isteğin aynı anda cache miss yaşaması (genellikle expiry'den sonra) ve aynı değeri yeniden oluşturmak için yarışmasıdır. Ölçekte bu küçük bir miss oranını veritabanı sıçramasına dönüştürebilir.

Kötü anahtar tasarımı sessiz bir sorundur. Anahtarlar çok genişse (ör. user:feed parametreleri içermeden) yanlış veri sunarsınız. Anahtarlar çok spesifikse (zaman damgaları, rastgele ID'ler veya sırasız query parametreleri dahil edilirse) hit rate sıfıra yakın olur ve gereksiz overhead ödersiniz.

Invalidasyon klasik tuzaktır: veritabanını güncellemek kolaydır; ilgili tüm cache görünümlerini güncel tutmak zor. Kısmi invalidasyon "bende düzelmiş" ama diğer kullanıcıya yansımayan hatalara ve tutarsız okumalara yol açar.

Hot key'ler ve düzensiz trafik

Gerçek trafik eşit dağılmaz. Bir ünlü profil, popüler ürün veya ortak konfig endpoint tek bir cache girdisi ve onun backing store'u üzerinde yük yoğunlaştırabilir. Ortalama performans iyi görünse bile tail gecikmesi ve node seviyesinde baskı patlayabilir.

Pratik mitigasyonlar

- TTL'e jitter ekleyin ki expirasyonlar hizalanmasın.

- Request coalescing (single-flight) uygulayın ki eksik anahtarı sadece bir istek yeniden oluştursun, diğerleri beklesin.

- Ağ payını azaltmak ve Redis'i korumak için katmanlı cache'ler düşünün (process içi LRU + paylaşılan cache).

- Cache miss yollarına rate limit ve circuit breaker uygulayın ki bir cache olayı hemen veritabanı olayına dönüşmesin.

Bellek, Garbage Collection ve Kaynak Sızıntıları

Versiyonlanabilir tutun

Tanıyı gerçek kod olarak saklamak için tam kaynağı dışa aktarın.

Framework'ler belleği "yönetilen" hissettirir; bu rahatlatıcıdır—ta ki trafik artıp gecikme CPU grafikleriyle uyuşmayan şekilde sıçramaya başlayana dek. Birçok varsayılan ayar geliştirici rahatlığı için tune edilmiştir, uzun süre çalışan süreçlerde sürdürülebilir olmayabilir.

Varsayılanlar nasıl bellek büyümesini ve GC duraklamalarını gizler

Yüksek seviyeli framework'ler her istek için kısa ömürlü nesneler allocate eder: istek/yanıt sarıcıları, middleware context nesneleri, JSON ağaçları, regex matcher'lar ve geçici string'ler. Tek tek bunlar küçüktür. Ölçeklendiğinde sürekli tahsis baskısı yaratır ve runtime'ı daha sık GC çalıştırmaya iter.

GC duraklamaları kısa ama sık gecikme sıçramaları olarak görünür. Heap büyüdükçe, duraklamalar genellikle uzar—bu mutlaka bir sızıntı olduğu anlamına gelmez, ama runtime'ın belleği tarayıp sıkıştırmak için daha çok zaman harcaması gerekir.

Tahsis desenleri, büyük heap'ler ve parçalanma

Yük altında bir servis, kuyruklarda, buffer'larda, bağlantı havuzlarında veya in-flight isteklerde birkaç GC döngüsünü atlattığı için nesneleri daha uzun yaşayan bölgelere (older generation) promosyon edebilir. Bu, uygulama "doğru" olsa bile heap'i şişirebilir.

Parçalanma başka bir gizli maliyettir: bellek serbest olabilir ama ihtiyaç duyduğunuz boyutlarda yeniden kullanılabilir değil, bu yüzden süreç OS'den daha fazla bellek ister.

Sızıntı mı yoksa yüksek ama istikrarlı bellek mi?

Gerçek bir sızıntı zamanda sınırsız büyümedir: bellek yükselir, geri dönmez ve sonunda OOM kill veya aşırı GC thrash'e yol açar. Yüksek ama stabil kullanım farklıdır: bellek ısınmadan sonra bir plato oluşturur ve sonra yaklaşık olarak sabit kalır.

Geri tepme yaratmayacak mitigasyonlar

Önce profil çıkarın (heap snapshot'lar, tahsis flame grafikleri) ki sıcak tahsis yollarını ve tutulan nesneleri bulun.

Pooling'e temkinli yaklaşın: tahsisleri azaltabilir ama yanlış boyutlandırılmış bir pool belleği sabitleyip parçalanmayı kötüleştirebilir. Önce tahsisleri azaltmaya (buffer yerine streaming, gereksiz nesne yaratımından kaçınma, istek başına cache sınırlama) odaklanın, sonra ölçümler net bir kazanç gösteriyorsa pooling ekleyin.

Gözlemlenebilirlik Sızıntıları: Loglama, Metrikler ve Tracing Yükte

Gözlemlenebilirlik araçları genellikle "bedava" hissi verir çünkü framework size kolay varsayılanlar sunar: istek logları, otomatik metriğe enstrümantasyon ve tek satırlık tracing. Gerçek trafik altında bu varsayılanlar, gözlemlemeye çalıştığınız işin bir parçası haline gelebilir.

Gözlemlenebilirliğin darboğaz olması

İstek başına log atma klasik örnektir. Her istek için tek bir satır masum görünür—ta ki saniyede binlerce isteğe ulaşana kadar. O zaman string formatlama, JSON encode, disk veya ağ yazımı ve downstream ingest için ödeme yaparsınız. Sızıntı, üst kuyruk gecikmesinin, CPU sıçramalarının, log pipeline'larının geride kalmasının ve bazen eşzamanlı log flush'ların neden olduğu zaman aşımlarının artmasıyla ortaya çıkar.

Metrikler daha sessiz bir şekilde sistemleri boğabilir. Sayaçlar ve histogramlar, az sayıda time series ile ucuzdur. Ama framework'ler genellikle user_id, email, path veya order_id gibi etiketler eklemeyi teşvik eder. Bu, cardinality patlamasına yol açar: tek bir metrik yerine milyonlarca benzersiz seri. Sonuç: metrics client ve backend'te bellek şişmesi, dashboard sorgularında yavaşlık, sample düşürme ve sürpriz faturalar.

Tracing: görünürlük bir bedel ister

Dağıtık tracing trafikle ve istek başına span sayısıyla birlikte büyüyen depolama ve compute overhead'i getirir. Her şeyi varsayılan olarak trace ederseniz iki kere ödeyebilirsiniz: uygulama üzerinde (span oluşturma, context propagation) ve tracing backend üzerinde (ingest, index, retention).

Örnekleme, kontrolü geri kazandırır—ama yanlış yapılması kolaydır. Çok agresif örnekleme nadir hataları gizler; çok az örnekleme tracing'i maliyetli hale getirir. Pratik yol, hatalar ve yüksek gecikmeli istekler için daha fazla örnekleme, sağlıklı hızlı yollar için daha az örnekleme yapmaktır.

Eğer hangi veriyi toplamanız gerektiğine dair bir başlangıç noktası isterseniz, /blog/observability-basics metnine bakabilirsiniz.

Sızıntıyı gördüğünüzde ne yapmalı

Gözlemlenebilirliği production trafiği gibi ele alın: log hacmi, metrik seri sayısı ve trace ingest için bütçeler belirleyin; etiketleri cardinality riskine göre gözden geçirin; enstrümantasyon açıkken load-test yapın. Amaç "daha az gözlemlenebilirlik" değil—yük altındayken de çalışmaya devam eden gözlemlenebilirliktir.

Dağıtık Sistemler: "Basit"in Bağlantılama Olduğu Yer

Framework'ler başka bir servisi çağırmayı yerel bir fonksiyon çağrısıymış gibi hissettirebilir: userService.getUser(id) çabucak döner, hatalar "sadece exception"tır ve retry'ler zararsız görünür. Küçük ölçekte bu illüzyon işe yarar. Büyük ölçekte soyutlama sızar çünkü her "basit" çağrı gizli bağlılıklar taşır: gecikme, kapasite limitleri, kısmi hatalar ve sürüm uyumsuzlukları.

Servisler arası gizli bağlanma

Uzak bir çağrı iki ekibin release döngülerini, veri modellerini ve uptime'ını birbirine bağlar. Eğer Servis A, Servis B'nin her zaman erişilebilir ve hızlı olduğunu varsayarsa, A'nın davranışı artık kendi kodu tarafından değil—B'nin en kötü gününe göre tanımlanır. Bu, kod modüler görünse bile sistemlerin sıkı bağlanmasına nasıl yol açtığını gösterir.

Transaction'lar, tutarlılık ve idempotentlik

Dağıtık transaction'lar yaygın bir tuzaktır: "kullanıcıyı kaydet, sonra kartı çek" gibi görünen şey veri tabanları ve servisler arası çok adımlı bir iş akışına dönüşür. İki fazlı commit üretimde nadiren basit kalır; bu yüzden birçok sistem eventual consistency'ye geçer (ör. "ödeme kısa süre içinde onaylanacak"). Bu, retry'ler, tekrarlar ve sıra dışı olaylarla başa çıkmayı zorunlu kılar.

Idempotentlik kritik olur: bir istek zaman aşımı nedeniyle tekrar denendiğinde ikinci bir ücretlendirme veya ikinci bir sevkiyat yaratmamalıdır. Framework seviyesindeki retry yardımcıları, endpoint'leriniz açıkça tekrar edilebilir değilse sorunları büyütebilir.

Hata yayılması

Bir yavaş bağımlılık thread pool'ları, bağlantı havuzlarını veya kuyrukları tüketerek bir dalga etkisi yaratabilir: zaman aşımları retry'leri tetikler, retry'ler yükü artırır ve kısa sürede alakasız endpoint'ler bozulur. "Sadece daha fazla örnek ekle" herkes aynı anda retry yaparsa fırtınayı daha da kötüleştirebilir.

Bağlantıyı açık tutacak mitigasyonlar

Açık sözleşmeler tanımlayın (şemalar, hata kodları, sürümlendirme), çağrı başına zaman aşımları ve bütçeler koyun ve uygun yerlerde fallbacks (önbellekli okuma, degrade yanıtlar) uygulayın.

Son olarak, bağımlılık başına SLO'lar belirleyin ve uygulayın: eğer Servis B SLO'sunu karşılayamazsa Servis A hızlıca hata versin veya nazikçe düşsün; tüm sistemi sessizce sürüklemesin.

Tahmin Yürütmeksizin Sızıntıları Nasıl Teşhis Edersiniz

Niyetle yük testi

Basit bir yük testi altyapısı ekleyin ve her değişiklikten sonra p95 ile p99'u görün.

Bir soyutlama ölçek altında sızdığında genellikle belirsiz bir semptom (zaman aşımları, CPU sıçramaları, yavaş sorgular) olarak görünür ve ekipleri acele bir yeniden yazmaya sürükler. Daha iyi yaklaşım, sezgiyi kanıta dönüştürmektir.

Pratik, adım adım iş akışı

1) Yeniden üretin (hata oluşturan durumu tetikleyin).

Sorunu tetikleyen en küçük senaryoyu yakalayın: endpoint, arka plan işi veya kullanıcı akışı. Üretimdeki gibi yapılandırma ile (feature flag'ler, zaman aşımları, bağlantı havuzları) lokal veya staging'de yeniden üretin.

2) Ölçün (iki-üç sinyal seçin).

Zamanın ve kaynakların nereye gittiğini söyleyen birkaç metrik seçin: p95/p99, hata oranı, CPU, bellek, GC süresi, DB sorgu süresi, kuyruk derinliği. Olay sırasında onlarca yeni grafik eklemekten kaçının.

3) İzole edin (şüpheli alanı daraltın).

Aracı kullanarak "framework overhead'i" kodunuzdan ayırın:

- Profiler'lar (CPU, bellek, allocation) ile sıcak yolları ve churn'ı bulun

- Tracing (OpenTelemetry, vendor APM) ile hop başına süre ve çağrı derinliğini görün

- DB query planner / EXPLAIN ile ORM tarafından üretilen SQL'i ve indeks kullanımını doğrulayın

- Load testler (k6, Gatling, Locust) ile kontrollü baskı altında yeniden üretin

4) Onaylayın (neden-sonuç ispat edin).

Her seferinde bir değişken değiştirin: bir sorguyu ORM'den kaçırıp doğrudan DB'ye çekin, bir middleware'i devre dışı bırakın, log hacmini azaltın, eşzamanlılığı sınırlayın veya havuz boyutlarını değiştirin. Semptom öngörülebilir şekilde hareket ediyorsa sızıntıyı bulmuşsunuz demektir.

Gerçekçi verilerle stres testi yapın, demo gibi değil

Gerçekçi veri boyutları (satır sayıları, payload boyutları) ve gerçekçi eşzamanlılık (patlamalar, uzun kuyruklar, yavaş istemciler) kullanın. Birçok sızıntı sadece cache soğukken, tablolar büyükken veya retry'ler yükü büyütürken görünür.

"Yeniden yazmadan önce" kontrol listesi

- Bir load test ile yeniden üretebiliyor ve bir trace yakalayabiliyor musunuz?

- En çok tüketenleri gösteren bir profiler snapshot'ınız var mı?

- En kötü sorguları query planer ile incelediniz mi?

- Katmanı izole eden küçük, geri alınabilir bir değişiklik denediniz mi?

- Düzeltmeden sonra (p95/p99, maliyet, hata oranı) iyileşmeyi nicel olarak ölçebiliyor musunuz?

Mitigasyon Stratejileri ve Ne Zaman Alt Seviyeye İnmelisiniz

Soyutlama sızıntıları framework'ün ahlaki bir başarısızlığı değildir—sisteminizin ihtiyaçlarının "varsayılan yol"u aştığının bir işaretidir. Amaç framework'lerden vazgeçmek değil; ne zaman onları tune edeceğinize ve ne zaman aşamalarından geçip alttan müdahale edeceğinize kasıtlı karar verebilmektir.

Önce framework'ü tune edin (hala doğru işi yapıyorsa)

Sorun yapılandırma veya kullanım kaynaklıysa framework içinde kalın. İyi adaylar:

- İndeksler, sorgu şekillendirme ve bağlantı havuzu ayarlarıyla düzelmeyle iyileşen yavaş endpoint'ler

- Örneklemeyle veya log seviyeleri ile çözülebilen aşırı loglama

- Eşzamanlılık açlığı, zaman aşımları ve limitlerle çözüldüğünde düzelten starvasyon

Bunları ayarlayarak tutmak, yükseltmeleri kolay tutar ve "özel durum" sayısını azaltır.

Kaçış yolları kullanın (kesinlik gerektiğinde)

Olgun framework'lerin soyutlamanın dışına çıkmanıza izin veren yolları vardır. Yaygın desenler:

- Escape hatches: tek bir hot sorgu için raw SQL, özel HTTP istemci ayarları, tek bir payload için özel serileştirme

- İnce adaptörler: framework bileşeni etrafında küçük bir sarmalayıcı ki ileride implementasyonu değiştirebilin

- Boundary layer'lar: framework'ü kenarlarda (routing, auth) tutup çekirdek iş mantığını net arayüzlerin arkasına izole edin

Bu, framework'ü bir araç olarak tutar; mimariyi dayatan bir zorunluluk haline getirmez.

Operasyonel uygulamalar: "düzeltmeler" risk olmasın

Mitigasyon koddan çok operasyoneldir:

- Kapasite planlama: her sürüm için bütçeler (p95 gecikme, CPU, DB süresi) tanımlayın ve takip edin

- Canary ve güvenli açılımlar: önce küçük bir dilimde yayınlayın, hata oranı/gecikmeyi karşılaştırın, sonra genişletin

- Gerçekçi load testing: zirve desenlerini, retry'leri ve downstream yavaşlıklarını dahil edin

İlişkili rollout uygulamaları için /blog/canary-releases yazısına bakabilirsiniz.

Basit bir karar çerçevesi

Alt seviyeye inin (drop down a level) quando: (1) sorun kritik yol üzerinde, (2) kazanımı ölçebilirsiniz ve (3) değişiklik ekibinizin uzun vadede sürdürebileceği bir bakım vergisi yaratmayacak. Eğer sadece bir kişi bu bypass'i anlıyorsa, bu "düzeltme" değil—kırılgan bir çözümdür.

Koder.ai burada nasıl yer alır (görünmeyen daha fazla soyutlama katmaz)

Sızıntıları ararken hız önemlidir—ama değişiklikleri geri alabilmek de. Ekipler sıklıkla Koder.ai kullanarak üretim sorunlarının küçük, izole edilmiş yeniden üretimlerini hızla kurar (minimal bir React UI, bir Go servisi, PostgreSQL şeması ve bir load-test harness) ve scaffolding için günler harcamazlar. Onun planning modeu yaptığınız değişiklikleri ve nedenini belgelemeye yardımcı olur; snapshots ve rollback ise ORM sorgusunu raw SQL ile değiştirmek gibi "alt seviyeye inme" deneylerini güvenle denemeyi ve veri desteklemezse geri almayı kolaylaştırır.

Çoklu ortamda bu işi yapıyorsanız, Koder.ai'ın yerleşik deployment/hosting ve dışa aktarılabilir kaynak kodu teşhis artefaktlarını (benchmark'lar, repro uygulamalar, dahili dashboard'lar) gerçek yazılım olarak saklamaya yardımcı olabilir—versiyonlanmış, paylaşılabilir ve birinin yerel klasöründe sıkışıp kalmamış.