2025年11月02日·3 分钟

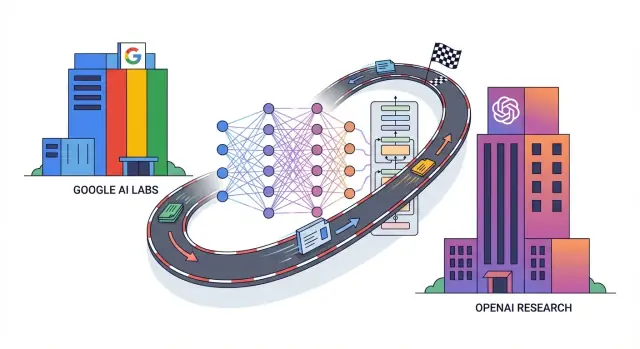

谷歌如何催生 GPT 却让 OpenAI 赢得人工智能竞赛

探讨谷歌如何发明了 GPT 背后的 Transformer 技术,却让 OpenAI 抢占生成式 AI 聚光灯;并分析这对创新者的启示。

概览:谷歌如何催生 GPT 却失去风头

谷歌并非简单地“错过”了 AI,而是发明了让当前浪潮成为可能的一大部分技术——然后让别人把它变成了定义性的产品。

谷歌研究人员创造了 Transformer 架构,这是 GPT 模型背后的核心思想。那篇 2017 年的论文——“Attention Is All You Need”——展示了如何训练能以极高流利度理解和生成语言的超大模型。没有那项工作,我们今天所知的 GPT 很可能不存在。

OpenAI 的成就并非出自魔法般的新算法,而是一系列战略决策:把 Transformer 按远超多数人认为可行的规模放大,结合巨量训练运行,并把结果打包为易用的 API,最终推出 ChatGPT——一个让数亿人直观感受到 AI 的消费级产品。

本文关注的是这些选择和权衡,而非隐秘的戏剧或个人英雄与反派。它梳理了谷歌的研究文化与商业模式如何使其偏向 BERT 式模型和对搜索的增量改进,而 OpenAI 则押注于更危险的通用生成系统。

我们将逐步讲到:

- 谷歌如何建立早期的 AI 主导地位与世界级研究机构

- Transformer 论文为何是突破性进展——以及它真正改变了什么

- OpenAI 如何把这一基础变为 GPT 与 ChatGPT

- 分歧策略:谷歌的 BERT 与搜索优化 vs OpenAI 的大规模 GPT 与 API

- “ChatGPT 时刻”:OpenAI 在公众面前超越谷歌的节点

- 塑造两家公司决策的文化与激励差异

- 谷歌以 Bard 与 Gemini 进行的重整

- 对于不想重复谷歌错误的建设者的具体教训

如果你关心 AI 策略——研究如何转化为产品,产品如何转化为持久优势——这个故事证明了比拥有最好的论文更重要的东西:有最清晰的押注并有敢于交付的勇气。

谷歌的早期 AI 主导地位与研究文化

谷歌进入现代机器学习时拥有两个巨大结构性优势:海量的数据和已被优化用于大规模分布式系统的工程文化。当这些机器被用于 AI 时,它迅速成为该领域的引力中心。

从 Google Brain 到 DeepMind

Google Brain 起始于 2011–2012 年左右的一个侧项目,由 Jeff Dean、Andrew Ng 和 Greg Corrado 领衔。团队专注于大规模深度学习,利用谷歌的数据中心训练对大多数大学而言难以企及的模型。

DeepMind 于 2014 年通过高调收购加入。Google Brain 更贴近产品与基础设施,而 DeepMind 则倾向于长期研究(强化学习、博弈与通用学习系统)。

两者合力为谷歌提供了无与伦比的 AI 发动机:一个植入生产堆栈、服务于产品的团队,另一个则攻关“登月”式研究。

象征 AI 主导地位的里程碑

若干公开里程碑巩固了谷歌的地位:

- ImageNet 突破: 虽然 2012 年的 AlexNet 来自多伦多大学,谷歌很快招揽多位顶尖研究人员,并用 Inception 等模型推动视觉基准的前沿。视觉基准成为展示谷歌规模与工具链的舞台。

- AlphaGo 及其继任者: DeepMind 的 AlphaGo 在 2016 年击败李世石,随后 AlphaGo Zero 和 AlphaZero 展示了深度强化学习能在最小人工设计下掌握复杂领域。

- “AI‑first” 论调: 大约在 2016–2017 年,Sundar Pichai 开始把谷歌称为“AI‑first 公司”。AI 支撑了 Search、Ads、YouTube 推荐、Photos、Maps 与 Android——触达数十亿用户,即便大多数人并未直接“看见”模型本身。

这些胜利让许多研究者认为:若想研究最雄心勃勃的 AI 问题,就去谷歌或 DeepMind。

人才密度带来的创新引擎

谷歌聚集了非凡比例的世界级 AI 人才。图灵奖得主如 Geoffrey Hinton,以及 Jeff Dean、Ilya Sutskever(离开后加入 OpenAI 前)、Quoc Le、Oriol Vinyals、Demis Hassabis 和 David Silver 等资深人物在少数组织与大楼内共事。

这种人才密度创造了强大的反馈回路:

- 新思想可通过内部讲座、邮件列表与共享代码迅速传播。

- 团队可以临时组合攻克难题,所需专长通常只需内部一声召唤即可找到。

- 研究者得益于生产级基础设施——数据管道、分布式训练系统与专用硬件——无需从零构建一切。

精英人才与重投入基础设施的结合,使谷歌成为前沿 AI 研究常常起源之地。

一个以论文与平台为导向的文化

谷歌的 AI 文化偏向发表与平台构建,而不是打造打磨到极致的消费级 AI 产品。

在研究方面,常态是:

- 在 NeurIPS、ICML、ICLR 等会议上发表论文。

- 开源工具(如 TensorFlow),反映谷歌内部系统。

- 发布在视觉、序列建模、强化学习与大规模训练领域有影响力的论文。

在工程方面,谷歌大量投向基础设施:

- 张量处理单元(TPU) 为神经网络工作负载定制。

- 受内部系统(如 Borg)启发的复杂训练与服务堆栈。

- 让巨大实验变得可行的数据与试验平台。

这些选择与谷歌的核心业务高度一致。更好的模型与工具直接提升了搜索相关性、广告定向与内容推荐。AI 被视为通用能力层,而非独立的产品类别。

结果是:一家在科学与底层架构上占据主导的公司,将 AI 深度整合到现有服务中,并通过有影响力的研究广播其进展——同时对将新型面向消费者的 AI 体验产品化持谨慎态度。

Transformer 的诞生:谷歌的突破性论文

2017 年,一小队来自 Google Brain 与 Google Research 的研究者低调发表了一篇重塑整个领域的论文:“Attention Is All You Need”,作者包括 Ashish Vaswani、Noam Shazeer、Niki Parmar、Jakob Uszkoreit、Llion Jones、Aidan Gomez、Łukasz Kaiser 与 Illia Polosukhin。

核心思想看似简单却极具颠覆性:可以舍弃循环与卷积,仅用注意力(attention)构建序列模型。该架构被命名为Transformer。

Transformer 解决了 RNN 与 LSTM 的哪些问题

在 Transformer 出现之前,最先进的语言系统基于 RNN 与 LSTM。它们存在两个主要问题:

- 顺序瓶颈: RNN 逐步处理 token,训练与推理难以并行化。GPU 在等待上一时刻完成时处于空闲。

- 长程依赖: 随序列增长,RNN 即便带有 LSTM 与注意力层,也越来越难记住很久之前的信息。

Transformer 解决了这两个问题:

- 自注意力(self-attention) 让每个 token 能在单层中直接“查看”序列中的所有其他 token。

- 模型并行处理所有 token,把训练转化为对 GPU 友好的矩阵乘法问题。

- 多头注意力(multi-head attention) 允许模型同时学习不同的上下文“视角”(句法、指代、主题等)。

位置信息通过**位置编码(positional encodings)**加入,使模型在无需循环的情况下知晓序列顺序。

为什么这为可扩展与多模态模型打开了大门

由于所有操作都可并行且基于稠密矩阵乘法,Transformer 能清晰地随数据与算力扩展。这种可扩展性正是 GPT、Gemini 与其他前沿模型所依赖的。

相同的注意力机制也可以推广到图像 patch、音频帧、视频 token 等,使得该架构成为多模态模型(能读、看、听的统一骨干)的自然基础。

开放发表与通往 GPT 的道路

更关键的是,谷歌公开发表了论文,并通过后续工作与像 Tensor2Tensor 这样的库让该架构易于复现。全球的研究者与创业公司能够阅读细节、复制设计并将其放大。

OpenAI 正是这么做的。GPT‑1 在结构上是一个Transformer 解码器堆栈,采用语言建模目标。GPT 的直接技术祖先是谷歌的 Transformer:相同的自注意力块、相同的位置编码、相同的可扩展押注——只是应用在不同的产品与组织背景下。

从 Transformer 到 GPT:OpenAI 如何构建在谷歌工作的基础上

当 OpenAI 推出 GPT 时,它并非从零发明新的范式,而是采纳了谷歌的 Transformer 蓝图,并把它推进到大多数研究团队不愿或无法达到的程度。

把 Transformer 变成 GPT

最初的 GPT(2018)本质上是一个用简单目标训练的 Transformer 解码器:在长文本上预测下一个 token。这一想法直接源自谷歌 2017 年的 Transformer,但谷歌当时更关注翻译等基准任务,而 OpenAI 把“尺度化的下一个词预测”视为通用文本生成器的基础。

GPT‑2(2019)将同一配方扩展到 15 亿参数并使用更大的网络语料。GPT‑3(2020)跃升到 1750 亿参数,在万亿级 token 上训练,使用大规模 GPU 群集。GPT‑4 延续这一模式:更多参数、更多数据、更精细的策划与更多算力,并辅以安全层与 RLHF,使其在对话中更有用且更可控。

在整个演进过程中,算法核心仍与谷歌的 Transformer 十分接近:自注意力块、位置编码与堆叠层。飞跃之处在于 sheer scale(纯粹的规模)与不懈的工程实现。

把规模化当作战略,而不仅是研究实验

谷歌早期的语言模型(如 BERT)面向理解任务——分类、搜索排序、问答;OpenAI 则为开放式生成与对话进行优化。谷歌发表了许多最先进模型,然后进入下一个论文课题;OpenAI 把单一思路做成了产品管线。

来自谷歌、DeepMind 与学术界的开放研究直接滋养了 GPT:Transformer 变体、优化技巧、学习率日程、尺度定律和更好的分词。OpenAI 吸收这些公开成果,然后在专有训练运行与基础设施上大量投资。

知识火花(Transformers)来自谷歌。把这一思想作为公司级押注、发布 API 并推出面向消费者的聊天产品的是 OpenAI。

为什么谷歌把 BERT 与搜索置于 GPT 式产品之上

更快推出移动端

通过对话构建 Flutter 移动应用,从 v1 快速迭代到 v2。

谷歌早期在深度学习上的商业成功来自让其核心赚钱机器——搜索与广告——更聪明。这个背景塑造了它如何评估像 Transformer 这样的新架构。与其竞相打造开放式文本生成器,谷歌更倾向于加倍下注能使排序、相关性与质量提升的模型,BERT 就是完美契合者。

BERT:面向搜索的 Transformer

BERT(Bidirectional Encoder Representations from Transformers)是一个仅编码器的模型,训练目标为掩码语言建模:句子的一部分被屏蔽,模型需在两侧上下文的帮助下推断被遮挡的 token。

这一训练目标几乎完美契合谷歌的问题:

- 查询理解: 搜索查询短、混乱且含糊,BERT 的双向上下文让谷歌能更细腻地理解查询意图(如“附近无月费的银行”或“如何上诉停车罚单 nyc”)。

- 文档理解: 对数十亿页面排序需要细粒度的语义相似性。BERT 的嵌入让谷歌能更好地把查询与段落匹配,而非仅匹配整页。

- 质量与垃圾检测: 掩码 LM 天然擅长发现“不合群”的文本,这对过滤低质内容很有用。

更关键的是,编码器式模型能无缝嵌入谷歌已有的检索与排序堆栈。它们可作为成百上千个特征中的相关性信号,提升搜索而无需重写整个产品。

掩码语言建模为何契合谷歌的商业需求

谷歌需要的是可靠、可追溯且能变现的答案:

- 可靠: 搜索结果必须有真实页面和来源作为锚点。掩码语言建模训练模型理解语言,而不是去生成不可靠的长篇输出。

- 可追溯: 每个结果都链接到发布者,支持开源网络生态并让用户能核验信息。

- 可变现: 搜索广告能整齐地围绕链接列表展示。更好的相关性意味着更高的点击率与更高的每次查询价值。

BERT 在不破坏既有搜索界面或广告模型的前提下改进了这三点。相比之下,基于 GPT 的自回归生成对现有业务的直接价值不那么显而易见。

内部风险权衡:安全、错误信息与品牌

开放式生成引发了公司内部的尖锐关注:

- 错误信息与幻觉(hallucinations): 生成式模型有时会自信地编造事实。对被视为权威的信息来源而言,这是直接的品牌风险。

- 有害内容: 未筛选的生成可能产生有毒或危险文本。以谷歌规模部署会招致公众反弹与监管关注。

- 监管暴露: 在反垄断与内容监管升温的时期,推出一个全球开放式聊天机器人看起来风险极高。

能通过政策审查的大多数内部用例都是辅助且受限的:Gmail 自动补全、智能回复、翻译和排序提升。相比之下,编码器式模型更容易被约束、监控与证明合理性,而不是把一个可以回答健康或政治问题的对话系统大规模公开。

对于“可能蚕食搜索现金牛”的担忧

即便谷歌拥有可运行的聊天与生成原型,一个核心问题仍未解决:优秀的直接答案会否减少搜索查询与广告点击?

一次就给出完整答案的聊天体验会改变用户行为:

- 点击外部网站减少 → 发布商不满,网页生态弱化

- 传统搜索广告的意图与空间减少 → 收入不确定

高层倾向把 AI 当作搜索的增强,而非替代。这意味着通过排名优化、丰富摘要与逐步的语义理解来部署 AI——正是 BERT 擅长的方向——而不是冒险推出一个独立又可能破坏商业模式的对话产品。

这些选择如何放慢面向公众的生成式产品进程

单个决策各自看起来理性:

- 优先采用能直接提升搜索与广告指标的模型

- 注重安全、可靠性与监管谨慎

- 保护搜索体验与变现模式

总体上,它们导致谷歌在把 GPT 式自回归生成大规模产品化方面投入不足。研究团队确实探索了解码器式大模型与对话系统,但产品团队缺乏强烈的激励去发布一个:

- 对关键搜索 KPI 没有明显提升,

- 可能威胁广告收入与出版商关系,

- 带来重大安全与公关风险

而 OpenAI 没有需要保护的搜索王国,它相反押注:一个高度能干、公众可访的聊天界面——即便并不完美——会创造巨大的新需求。谷歌对 BERT 与搜索的聚焦延后了其面向消费者的生成式工具的进入,为 ChatGPT 率先定义这一品类留下了空间。

OpenAI 对规模、API 与消费级聊天体验的押注

从研究实验室到“有上限的盈利”公司

OpenAI 于 2015 年创立为非营利研究实验室,由数位科技创始人资助,他们既看到 AI 的机会也看到风险。最初几年它看起来类似 Google Brain 或 DeepMind:发表论文、开源代码、推动学术前沿。

到 2019 年,领导层意识到前沿模型将需要数十亿美元的算力与工程投入。纯非营利难以筹集这类资金。解决办法是结构性创新:OpenAI LP,即一个在非营利之下的“有上限盈利”公司。

投资人现在可以获得(有限上限的)回报,同时董事会保持对广泛有益 AGI 的任务关注。该结构使得签署大规模融资与云算力协议成为可能,而不至于完全变成传统创业公司。

把规模化当作核心假说

许多实验室优化的是巧妙的架构或高度专业化的系统,而 OpenAI 做了一个直截了当的押注:如果你持续增加数据、参数与算力,极其大型的通用语言模型可能会出乎意料地强大。

GPT‑1、GPT‑2 与 GPT‑3 遵循一个简单公式:大部分都是标准的 Transformer 架构,但更大、更长时间训练并用更多样的文本数据。它们不为每个任务单独定制模型,而是依靠“一个大模型,多种用途”的想法,通过 prompt 与微调实现多样化应用。

这不仅是研究立场,也是商业策略:如果一个 API 能支持从文案工具到编码助手的数千个用例,OpenAI 就能成为一个平台,而不仅仅是研究实验室。

API‑first:把模型变成平台

2020 年推出的 GPT‑3 API 使该策略具体化。与其把大量软件放在本地或推出范围窄的企业产品,OpenAI 暴露了一个简单的云 API:

- 发送文本,接收模型输出。

- 按 token 计费。

- 在此之上构建你想要的一切。

这种“API‑first”方法让初创公司与企业去负责 UX、合规与领域专业性,而 OpenAI 专注于训练更大模型与改进对齐。

API 也很早就创造了明确的收入引擎。OpenAI 不必等到完美的整品再出手,而是让生态系统去发现用例,并替它做产品研发。

愿意上线不完美的产品

OpenAI 一贯选择在模型尚不完美时就发布。GPT‑2 曾因安全顾虑采取分阶段发布;GPT‑3 通过受控内测进入世界,带着明显缺陷(幻觉、偏见、不一致性)。

这一理念最明显的体现是 2022 年末的 ChatGPT。它并不是 OpenAI 最先进的模型,也不算非常精细,但它提供了:

- 一个几乎人人都能理解的简洁聊天界面;

- 刚开始的免费访问,吸引大量试验;

- 基于真实用户对话的快速迭代回路。

OpenAI 把公众当作巨大反馈引擎,而不是在私下无限调优模型。护栏、内容审查与 UX 随周而变,根据观察到的行为演进。

与微软的战略合作与算力获取

OpenAI 对规模的押注需要巨大的算力预算。与微软的合作在这点上至关重要。

从 2019 年开始并于随后几年加深,微软提供了:

- 对 OpenAI LP 的数十亿美元投资;

- 在 Azure 上为 OpenAI 的模型提供专属云托管;

- 在 Bing Chat 与 Copilot 等产品上的联合商业化路径。

对 OpenAI 来说,这解决了一个核心瓶颈:能在专用 AI 超级计算机上进行训练,而无需自建云或自筹全部资金。

对微软而言,这是差异化 Azure 并将 AI 快速注入 Office、GitHub、Windows 与 Bing 的方式。

反馈回路:用户 → 数据 → 收入 → 更大模型

所有这些选择——规模、API‑first、消费级聊天与微软交易——构成了自我强化的循环:

- 更好的模型 吸引开发者与用户。

- API 与 ChatGPT 让集成与试验变得容易。

- 使用量带来收入,资助更大的训练与更好基础设施。

- 真实交互 产生高价值数据用于微调与人类反馈的强化学习(RLHF)。

- 改进的模型 支撑新功能(插件、多模态)并吸引更多用户。

OpenAI 并非优化为发表完美论文或做谨慎的内部试点,而是为这个复合循环做优化。规模不仅仅是更大的模型,而是快速扩张用户、数据与现金流,以持续推动前沿。

ChatGPT 震撼:OpenAI 在执行上超越谷歌的时刻

当 OpenAI 于 2022 年 11 月 30 日推出 ChatGPT,看起来像一次低调的研究预览:一个简单的聊天框、无遮挡的免费访问和一篇短博文。五天内用户超过一百万,数周内 Twitter、TikTok 与 LinkedIn 上到处都是截图与用例。人们用它写文章、调试代码、起草法律邮件、头脑风暴商业点子——仅靠一个工具就能做到许多事情。

该产品并不像“基于 Transformer 的大语言模型演示”;它就是:问任何问题,得到答案。这个清晰性使技术对非专业用户瞬间可读。

谷歌内部的震惊

在谷歌内部,反应更像是警报而非赞许。公司宣布进入“code red”。Larry Page 与 Sergey Brin 被重新召回参与产品与战略讨论。长期致力于对话模型的团队突然受到强烈审视。

工程师们知道谷歌拥有大致可比的系统。LaMDA、PaLM 与早期的 Meena 已在内部基准上展示了流畅对话与推理能力。但这些系统被封存在受限工具与严格审核背后。

在外界看来,谷歌被突袭了。

ChatGPT 与 LaMDA:相似的技术,不同的产品化

在技术层面,ChatGPT 与谷歌的 LaMDA 是近亲:都是基于 Transformer 的大型语言模型并针对对话微调。差距主要来自产品决策,而非架构本身。

OpenAI:

- 上线了单一、清晰的界面;

- 接受现实世界的混乱并快速迭代;

- 大力投入对齐与 RLHF,从数百万对话中学习。

谷歌:

- 把 LaMDA 藏在受限演示后;

- 以规避风险与保护声誉为优先;

- 难以把研究原型转化为面向消费者的产品。

Bard 的匆忙发布与公开失误

在被迫展示应对之策时,谷歌于 2023 年 2 月公布了 Bard。这次预览试图模仿 ChatGPT 的对话魔力:向 Bard 提问,得到妙答。

但其中一个重点回答——关于詹姆斯·韦伯太空望远镜的发现——是错误的。该错误出现在谷歌自己的宣传材料中,几分钟内被发现,并在一天内抹去了数十亿美元的市值。这强化了一个严酷叙述:谷歌来得晚、犹豫且草率,而 OpenAI 显得自信且准备充分。

对谷歌员工而言,讽刺性极强。模型的幻觉与事实性错误是大语言模型的已知问题。差别在于 OpenAI 已经用清晰的 UI 提示、免责声明与“可试验”定位让用户接受这些问题,而谷歌却以完美发布的包装对外,错误暴露时代价更大。

速度、用户体验与叙事:OpenAI 的执行优势

ChatGPT 相较谷歌内部系统的优势,既不是因为更大的模型,也不是更新颖的算法,而是执行速度与体验清晰度。

OpenAI:

- 把一条研究线变成单一、病毒式产品;

- 采取公开测试心态:“试试、弄坏它、告诉我们”;

- 设计了一个与人们用文本互动习惯直接匹配的 UX:问与答、反复迭代。

谷歌动作更慢,优化为“零差错”,并以光鲜的发布包装 Bard,而非把它当作学习阶段。到 Bard 推向用户时,ChatGPT 已成为学生、知识工作者与开发者的日常习惯。

谷歌内部的震惊不仅来自 OpenAI 的好模型,而是一个更小的组织把谷歌帮助发明的想法打包成了大众喜爱的产品,并在数周内重塑了公众对谁领导 AI 的看法。

文化、激励与风险:谷歌 vs OpenAI

发布你的第一个 AI 产品

通过对话将想法变成可运行的应用,然后像产品团队一样迭代。

谷歌与 OpenAI 起点有相似的技术基础,但组织现实极为不同,这种差异决定了围绕 GPT 式系统的几乎所有决策。

激励:摇钱树 vs 生存模式

谷歌的核心业务是搜索和广告,这一引擎产生稳定而可观的现金流,大部分高层激励与保护它相关联。

推出一个强大的对话模型可能会:

- 减少广告展示,

- 用答案替代搜索,

- 并以幻觉等方式损害信任,

因此默认策略是谨慎。对于 OpenAI 而言,没有现金牛,其激励更接近生存:上线有价值的模型、赢得开发者注意、签下大算力协议,把研究尽快变现。

文化:风险容忍度与公关敏感度

谷歌经历过反垄断审查、隐私争议与全球监管,这段历史形成了一种文化:

- 公关、政策与法律团队拥有强势否决权;

- 安全审查漫长且多层级;

- 把声誉损害视为最高级风险。

OpenAI 接受强模型在公开场景下会显得混乱这一事实。公司更强调在护栏下迭代而非长期封闭完善。两者都谨慎,但产品风险容忍度相差甚远。

结构与速度:委员会决策 vs 集中权力

在谷歌,大型上线通常需通过多重委员会、跨组织签核与复杂 OKR 协商。这会拖慢横跨 Search、Ads、Cloud 与 Android 的任何产品进度。

OpenAI 的决策集中在小范围领导层与聚焦产品团队。关于 ChatGPT、定价与 API 的决定可以迅速做出,再根据真实使用调整。

当仅靠研究不再足够

多年来,谷歌凭借发表最好论文与训练最强模型占优。但当他人能复现这些研究时,优势转向研究加上:产品设计、开发者体验、数据反馈回路与上市速度。

OpenAI 把模型当作产品基底:发布 API、发布聊天界面、从用户处学习,然后把反馈用于下一代模型。

谷歌则多年把最强系统作为内部工具或有限演示封存。等到尝试规模化产品化时,OpenAI 已经建立了习惯、期望与围绕 GPT 的生态。

差距不是谁更懂 Transformer,而是谁有意愿且结构上能把这种理解迅速转化为面向数亿人的产品。

技术创新 vs 产品创新:谁做了什么

谷歌:技术引擎

在技术层面,谷歌始终是强国。它在基础设施方面领先:定制 TPU、先进的数据中心网络与内部工具,使得训练超大模型在数年前就变得常态化。

谷歌研究推动了模型架构(Transformer、注意力变体、专家混合、检索增强模型)、尺度定律与训练效率的前沿。许多定义现代大规模 ML 的关键论文来自谷歌或 DeepMind。

但大量创新停留在论文、内部平台与在 Search、Ads 与 Workspace 中的狭义功能里。用户看到的更多是若干小而分散的改进,而不是一个统一的“AI 产品”。

OpenAI:产品与平台引擎

OpenAI 走了不同的路。技术上它构建在他人已发表的思想上(包含谷歌的工作)。它的优势在于把这些思想打包为清晰的产品线:

- 一个旗舰体验:ChatGPT,门槛低且直观;

- 一个主平台:API,稳定的端点与可预测的定价;

- 一个给开发者的故事:良好文档、示例与简单的心智模型——“把模型当函数调用”。

这种统一的包装把原始模型能力变成用户能立刻采用的东西。谷歌以多品牌、多表面发布强模型,而 OpenAI 把注意力集中在少数名称与流程上。

分发胜过单纯的技术领先

一旦 ChatGPT 成功,OpenAI 获得了谷歌曾经占有的心智默认地位。开发者优先在 OpenAI 上试验,写教程、基于其 API 构建产品、向投资人推介“基于 GPT 的创业点子”。

底层模型质量的差距(如果有的话)比不上分发差距重要。谷歌在基础设施与研究上的技术优势并没有自动转化为市场领导地位。

教训是:赢得科学不足以万无一失。没有清晰的产品、定价、故事与整合路径,即便最强的研究引擎也会被专注的产品公司超越。

警醒之后:Bard、Gemini 与谷歌的 AI 重整

快速验证你的假设

快速原型化用户体验,在过度思考前测试假设。

当 ChatGPT 暴露出谷歌在产品执行上的滞后,公司触发了公开的“code red”。随之而来的是加速、有时混乱但确实认真的 AI 战略重整。

从 Bard 到 Gemini:承认需要重置

谷歌的第一步回应是 Bard,一个基于 LaMDA(随后升级到 PaLM 2)的聊天界面。Bard 既显得匆忙又谨慎:访问受限、推送慢、产品约束明显。

真正的重置出现在 Gemini:

- Gemini Ultra、Pro、Nano 作为云端、消费端与设备端的连贯模型系列;

- Bard 改名为 Gemini(和 Gemini Advanced),以示与实验时代的断裂;

- 公开承诺把 Gemini 作为贯穿谷歌产品的 AI 旗舰品牌。

这一转变把谷歌从“试验聊天机器人的搜索公司”重新定位为“以 AI 为先的平臺与旗舰模型系列”,尽管这一定位落后于 OpenAI 的先发优势。

把 Gemini 编织进谷歌的核心产品

谷歌的优势在于分发,因此重整聚焦于把 Gemini 嵌入用户已有习惯所在:

- Search: Search Generative Experience 与 AI Overview 直接给出答案,而非仅返回链接;

- Workspace: 在 Gmail、Docs、Sheets、Slides 与 Meet 中加入 Gemini 助手,助力草拟、摘要与分析;

- Android: 把 Gemini 作为系统级助手,多模态输入,以及用于隐私敏感任务的 Nano 端侧模型;

- Chrome: 在浏览器内提供 Gemini 驱动的写作辅助、标签管理与开发者功能。

策略是:若 OpenAI 赢得了“新鲜感”与品牌,谷歌仍能凭借默认存在与与日常工作流的深度整合来取胜。

安全、治理与有节制的开放

在扩大访问时,谷歌强调其 AI 原则与安全姿态:

- 在发布更高能力模型前进行广泛的红队攻击与评估;

- 区域性逐步放量,并按年龄与账户类型对某些功能设门槛;

- 在对齐研究、内容过滤与拒绝策略上投入;

- 在媒体与作品来源可溯性上做水印与来源标识(如 SynthID)。

权衡是:更强的护栏与更慢的试验速度,对比 OpenAI 更快的迭代但偶有公开失误。

谷歌真的追上了吗?

在纯模型质量上,Gemini Advanced 与顶级 Gemini 模型在许多基准与开发者反馈中与 GPT‑4 竞争性相当。在某些多模态与编码任务中,Gemini 甚至领先;在其他任务上,GPT‑4(及其继任者)仍然设定基准。

谷歌仍落后的,是心智占有率与生态:

- OpenAI 仍是许多初创公司与研究者的默认选择;

- “ChatGPT” 已成为主流对 AI 的代名词;

- OpenAI 的 API、插件與工具生态更早成熟。

谷歌可以以其庞大的分发(Search、Android、Chrome、Workspace)为杠杆,把 Gemini 转化为令人愉悦的 AI 原生体验,从而缩小或逆转感知差距。

多极化的未来,而非二马之争

重整发生在一个不再只是谷歌对 OpenAI 的领域:

- OpenAI: 消费者心智占有、快速迭代、强大的开发者生态;

- 谷歌: 基础设施、数据、分发与把 Gemini 融进产品;

- 开源阵营(Meta 的 Llama、Mistral 等): 发展迅速、成本低且对许多用例“足够好”;

- Anthropic 与其他公司: 在安全、可靠性与特定垂直领域上做差异化。

谷歌虽晚但认真地重置,意味着它不再“错过”生成式 AI 的时刻。但未来更可能是多极化:没有单一赢家,也没有某家公司能完全控制模型或产品创新方向。

对建设者而言,这意味着要设计策略,假定会有若干强劲提供者、强大的开源模型与持续的竞相超越——而不是把全部赌注押在单一 AI 堆栈或品牌上。

给建设者的关键教训:如何不重蹈谷歌的覆辙

谷歌证明了:你可以发明突破却输掉第一波价值。对于建设者来说,关键不是为这种悖论感到惊叹,而是避免重演它。

1. 发布产品,而不仅是论文

把每个重大研究成果当作一个产品假设,而非终点。

- 给每项重大成果配备一个明确负责的产品负责人。

- 在数周内确定具体用户问题与 v1 体验,无论多窄。

- 设定上线期限,默认结果是:向真实用户发布,即便仅面向一千人。

如果值得发表,就值得为客户做原型。

2. 把激励与已发布影响对齐

人们倾向于做被奖励的事。

- 让晋升与声望与已上线的用户影响挂钩,而不只是论文引用、专利或内部演示。

- 庆祝跨职能团队(研究、工程、产品、法律)把冒险想法推进到生产环境。

- 赋予单一线程(single‑threaded)领导者对试验与上线的权力,防止决策在委员会中夭折。

3. 对新原语做明确的产品押注

Transformer 是一种新的计算原语。谷歌主要把它当内部基础设施升级,而 OpenAI 把它当产品发动机。

当你遇到类似深刻的想法时:

- 指定 1–2 个旗舰产品来充分检验该原语;

- 为团队划拨 12–24 个月的预算与资源;

- 接受与遗留产品的重叠乃至内部竞争,当潜在上行巨大时要敢于冒险。

4. 在安全与现实学习之间取得平衡

品牌与安全顾虑合理,但以此为由无限期拖延并不可取。

构建分级风险模型:

- 高风险用例(健康、金融、选举)设严格门槛;

- 低风险、带标签的实验可早期上线并配备监控与一键回滚。

不要等待确定性,而要设计受控暴露:渐进放量、强日志记录、快速回退路径、红队测试与公开沟通。

5. 拥有你所启用的平台

谷歌通过开源思想与工具启发了他人构建 GPT 式系统,然后在许多方面旁观别人把标志性体验做出来。

当你暴露强大能力时:

- 构建一个示范性产品,展示能力天花板;

- 早期提供 API,但保留旗舰第一方体验并持续打磨;

- 把外部开发者当作扩展平台的伙伴,而不是指望他们替你理解用户需求。

6. 制度化“从论文到产品”的路径

不能依赖某位高管或某个英雄团队的个人努力。

把转化过程嵌入公司运作:

- 标准化管线:想法 → 内部演示 → 有限外部试点 → 广泛发布;

- 设立专门团队,职责是把顶级研究输出变成产品或 API;

- 让资深研究者轮值进入产品领导岗位,以便理解能力的人也负责其应用。

7. 承诺被自己技术所惊讶

谷歌最大的失误不是没预见到 AI,而是低估了自家发明在消费者手中会演化为何种样子。

对创始人、产品经理与高管的实用心态是:

- 假设你的突破比内部能看到的应用面更广;

- 早把它交给用户,让用户展示那些意外、高价值且混乱的用例;

- 当这些用例与原有路线图冲突时,要愿意调整优先级并快速转向。

未来的突破——无论在模型、交互界面还是全新计算原语——都会被那些愿意迅速把“我们发现了这个”转变为“我们负责把它交付”的团队商品化的组织所拥有。

谷歌的教训不是少发表或隐藏研究,而是要把世界级发现与同样雄心勃勃的产品所有权、明确激励与公开学习倾向配对。能做到这一点的组织将拥有下一波,而不仅仅是写出开启这一波的论文。

常见问题

Did Google actually invent GPT, or is that an overstatement?

不完全是。 但谷歌确实发明了让 GPT 成为可能的核心技术。

- 谷歌研究团队在 2017 年提出了Transformer 架构(“Attention Is All You Need”)。

- GPT 系列(GPT‑1、2、3、4)本质上是大规模的Transformer 解码器,在海量数据上训练而成。

- OpenAI 并没有替代谷歌的想法;它是对该思想进行规模化并把它产品化。

因此,谷歌奠定了大量知识和基础设施。OpenAI 则把这些基础变成了第一波商业价值(ChatGPT 与 API)。

If Google had the core tech, why didn’t it launch something like ChatGPT first?

谷歌偏向于研究、基础设施和对搜索的渐进式改进,而 OpenAI 更专注于推出大胆的通用产品。

主要差异:

What’s the practical difference between Google’s BERT and OpenAI’s GPT?

BERT 和 GPT 都基于 Transformer,但针对的是不同任务:

Why was Google so cautious about releasing a powerful public chatbot?

因为生成式模型会自由输出内容,谷歌认为它带来了风险且难以直接变现。

主要顾虑:

- 品牌与信任: 一个会“编造事实”的聊天机器人可能削弱 Google 作为权威信息来源的信任。

- 安全与政策: 开放式生成可能产生有害或带偏见的内容,吸引监管和公众的批评。

- 商业模式:

- 直接答案可能减少用户点击外部网站 → 出版商不满。

- 页面浏览量下降意味着广告库存减少 → 收入受影响。

What exactly did OpenAI do differently to turn Google’s research into a winning product?

OpenAI 在三方面做了不同的重大押注,并持续执行:

-

将规模化作为战略而不是实验

把标准 Transformer 推向极限(数据、参数、算力),基于 scaling laws 而不是频繁更换架构。 -

API‑first 平台策略

早早把模型以简单的云 API 形式暴露出来,让成千上万的开发者发现使用场景并在其之上构建业务。

Was Google actually behind OpenAI in AI capability when ChatGPT launched?

不是主要在能力上落后,而是在产品和叙事上被超越。

- 谷歌在 ChatGPT 发布前已经有可比的内部系统(如 LaMDA、PaLM)。

- 令外界震惊的是,一个更小的组织:

- 采用了类似的底层技术;

- 用一个清晰、病毒式的产品(ChatGPT)包装出来;

- 接受公开环境中的不完美并进行迭代。

这种做法把“谁引领 AI” 的公众印象从“谷歌领先”转变为“ChatGPT/OpenAI 定义了 AI”。谷歌真正的失算,是低估了自家发明放到简单用户界面后能产生的影响。

Why did ChatGPT feel so much better than Google’s Bard and other early responses?

ChatGPT 的优势更多来自执行与定位,而不是独有的新算法。

关键要素:

- 简单的 UX: 一个聊天框,免配置,用户易上手。

- 免费和开放的试用期: 低门槛,促成大量实验。

- 预期管理: 把产品定位为“研究预览”,用户对缺陷容忍度更高。

- 快速迭代: 利用真实对话做 RLHF、安全改进与功能设计。

谷歌的 Bard 则显得:

What are the main lessons from Google vs OpenAI for founders and product teams?

对大多数构建者而言,这个故事强调了如何把深度技术转化为持久优势:

- 别只停在论文或原型上。 把突破当作产品假设,尽早让真实用户检验。

- 把激励与交付挂钩。 奖励以已上线的用户影响,而不仅仅是内部演示或学术引用。

- 对新计算原语做明确押注。 当你遇到像 Transformer 这样深刻的想法时,至少打造一款旗舰产品来推进它的极限。

How can a smaller company or startup avoid repeating Google’s mistakes around AI?

任何规模的公司都有可能犯“谷歌的错误”——把研究当终点而不是产品起点,或让风险规避流程阻止受控上线。

避免方法:

- 给每个重大突破指定一个有权决策的负责人,把它变成面向用户的试点。

- 设计标准化流程:想法 → 内部演示 → 有限公开测试 → 更大范围发布。

- 接受新产品可能与现有业务产生竞争——要给它们足够时间证明能否开启更大的未来。

你不需要像谷歌那样大才能被卡住;只要组织结构与恐惧感超过了好奇与速度,就会出问题。

Has Google permanently lost the AI race to OpenAI, or is it catching up with Gemini?

谷歌仍然是技术强国,并通过 Gemini 做出了积极的策略重置:

- 提供了连贯的模型系列(Ultra、Pro、Nano),并把 Bard 更名为 Gemini。

- 将 Gemini 嵌入 Search、Workspace、Android、Chrome,拥有巨大的分发渠道。

- 在许多基准和开发者反馈中,顶级 Gemini 模型在能力上与 GPT‑4 具有可比性。

谷歌仍然落后的方面: