2025年10月02日·1 分钟

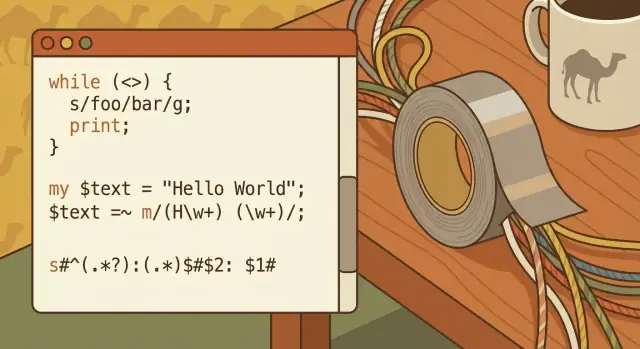

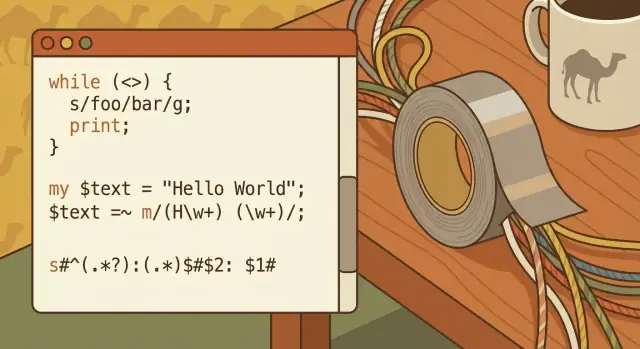

Larry Wall、Perl 与文本处理的胶带心态

Larry Wall 的“胶带”哲学如何把 Perl 打造成网页自动化主力——以及它今天对实用文本处理仍然有哪些教训。

Larry Wall 的“胶带”哲学如何把 Perl 打造成网页自动化主力——以及它今天对实用文本处理仍然有哪些教训。

sh、grep、sed、awk、管道和过滤器。但真实的工作很少能用一行整洁的命令解决。你可能从一个管道开始,接着发现需要一个小的状态机、更好的字符串处理、可重用的脚本,以及一种能在下周还能读懂它的可读性。\n\nLarry 的动机很务实:降低“胶合工作”的摩擦,这项工作既不光鲜却又持续不断——把工具连起来、转换文本,直到有用的东西从里头出来。\n\n### “让文本操作比 shell + awk + sed 更容易”\n\nPerl 的最初目标不是取代 Unix 工具——而是在一行管道变成小程序时让整体更容易协调。与其在多个各有引号规则和边缘情形的工具之间跳来跳去,Perl 提供了一个地方来:\n\n- 按行读取文件,\n- 切片与重塑字符串,\n- 应用模式匹配,\n- 快速且可预测地写回结果。\n\n这就是“胶带心态”:不是追求完美,而是一个快速、耐用的修补让事情继续运作。\n\n### 文化:务实与表达力\n\nPerl 的文化接受了与日常现实相符的价值观:务实胜过纯粹,表达力胜过形式化,以及著名的“有不止一种方法去做”。这些并非口号——而是允许你用最少的痛苦去解决眼前问题的许可。\n\n### 避免神话:Perl 并非魔法\n\n回头看,Perl 早期的流行似乎很神秘,但其实不然。它正好满足了当时团队的需要:一门能容忍混乱输入、能与现有系统整合,并让疲惫的人能在下一个告警响起前把可运行的脚本交付的语言。\n\n## 为什么早期网页自动化需要一门胶合语言\n\n早期网站并不是由应用框架和托管服务驱动。许多网站只是一个 web 服务器加上一堆 CGI 脚本、若干平面文件,可能还有一个还未成为“中心”的简单数据库。\n\n运维工作以日志为中心:访问日志、错误日志、上传文件夹、接收表单提交的邮箱,以及悄然成为数据库的文本文件。当问题发生时,你常常通过 grep 昨天的日志并修一下脚本来诊断它。\n\n### 那时的“自动化”用通俗话说就是\n\n自动化就是:一个可重复运行的任务,不需要每次人工执行。\n\n该任务可能由网页请求触发(有人提交表单、点击“搜索”、下载报告),也可能由计划任务触发(cron 每小时轮转日志、重建页面、发送摘要)。\n\n### 为什么重要\n\n即便是小网站也需要:\n\n- 在多页间更新内容,而无需逐页手工编辑\n- 处理表单:校验字段、发送邮件、保存结果\n- 生成页面:每日列表、搜索结果、“最新更新”版块\n- 解析日志:查找断链、发现流量峰值、检测滥用\n\n手工做这些不仅浪费时间,还会引入错误与延迟。\n\n### Perl 的位置\n\nPerl 恰好位于已有工具之间:\n\n- 启动 CGI 脚本的 web 服务器这是一种务实的做法:用能快速解决实际痛点的最小改动来完成工作,尤其在面对混乱的输入和不完整的需求时。

它不是纵容马虎。所谓“胶带”意在快速达到可用的结果,然后再添加足够的安全措施(测试、备份、说明),以免修补变成日后的陷阱。

使用 “再做一次” 规则:如果你对同一类手工清理做了两次,就应该自动化。

适合自动化的任务示例:

如果任务会影响生产数据,请在执行前增加保护措施(先做演练、备份、验证)。

把单行命令当作“微小脚本”来对待:

如果命令变长、需要错误处理或会被重复使用,就把它做成真正的脚本,带上参数和明确的输入/输出路径。

正则表达式适合处理“半结构化”文本(日志、邮件、ID、不一致分隔符),它能用于验证、提取或重写模式。

为保持可维护性:

快速修补会变成“长期方案”的情形是:它被反复使用、被他人依赖,或嵌入到工作流(cron、管道、文档)里。

提示你需要加固的信号:

应对策略:加入验证、日志、测试,并写清楚假设与使用说明(README)。

CPAN 能在日常工作中节省数天时间,但每个依赖都是一种承诺。

选择模块的实用检查表:

同时规划部署:锁定版本、记录安装步骤,并跟踪安全更新。

CGI 时代的最大教训是:速度如果没有边界,会产生漏洞。

如果接受来自用户或其他系统的输入:

这些习惯对现代脚本、无服务器函数与 Web 接口同样适用。

常见问题包括:

建议早期规范化(编码、换行),验证假设(列数、必需字段),并在失败时大声报错,附上出问题的样例行/记录。

经验法则:如果是“真实格式”,就用真正的解析器。

正则与临时拆分适用于模式提取和轻量清洗,但当出现边界情况(例如名字里有逗号)时,盲用会悄悄损坏结果。

选择你团队能在真实约束下运行和维护的工具:

Perl 的遗产不是“总是用 Perl”,而是“选择适合你实际混乱程度的工具”。

grep、sed、awk、sort)split、join、替换)以匹配真实的清洗任务sort、uniq 或 grep。Perl 不是取代 Unix 工具,而是在 awk + sed + shell 开始变得尴尬时把它们粘合起来。\n\n### 从终端到 CGI\n\n这种先写脚本的思路延伸到早期的网页开发。Perl 脚本可以接受表单输入,把它当作任意文本流处理,并打印 HTML 作为输出——使其成为系统工具与网页之间的实用桥梁。\n\n### 可移植性很重要\n\n因为 Perl 能在许多类 Unix 系统上运行,团队常常可以在机器间以最小改动迁移相同脚本——这在部署简单、手工且频繁的年代尤其有价值。\n\n## 正则表达式:实用解析背后的超能力\n\n正则表达式(通常简称为“regex”)是一种描述文本模式的方法——像“查找并替换”工具,但用规则而非精确词语。比方说,不是搜索字面字符串 [email protected],而是说“找所有看起来像电子邮件地址的东西”。这种从精确匹配到模式匹配的转变,成就了早期大量自动化可能性。\n\n### 用通俗话说的正则\n\n把正则当作一个迷你语言,可以回答类似的问题:\n\n- “这个输入看起来合法吗?”12/26/25 转为 2025-12-26,或识别多种日期风格。\n- 日志行:抽出 IP、时间戳、请求与响应码。\n- 类 CSV 数据:处理“多数情况是逗号分隔”的文件——直到某个字段包含额外空格、奇怪引号或缺失值。\n\n### 权衡:能力与可读性\n\n正则强大到会变得晦涩。一段短小巧妙的模式可能难以审查、难以调试,并且在输入格式变更时容易被打破。\n\n可维护的做法是把模式保持简短、在语言支持时添加注释,并在下月可能有人维护时代选择两步清晰的处理而非一步“天才式”表达。\n\n## Perl 单行命令:日常文本清理的快速捷径\n\nPerl 单行命令可以被看作很小的脚本:你在终端中直接运行、用于转换文本的小巧命令。它们在你需要快速清理、一次性迁移或在写完整程序前做个快速检查时非常有用。\n\n### “微小脚本”长什么样\n\n单行命令通常从标准输入读取、做出修改并打印结果。例如,从文件中移除空行:\n\nsh\nperl -ne 'print if /\\S/' input.txt > output.txt\n\n\n或者从以空格分隔的文本中提取特定“列”字段:\n\nsh\nperl -lane 'print \"$F[0]\\t$F[2]\"' data.txt\n\n\n再比如批量重命名,用 Perl 对文件操作做更多控制,而不是仅用基础重命名工具:\n\nsh\nperl -e 'for (@ARGV){(my $n=$_)=~s/\\s+/_/g; rename $_,$n}' *\n\n\n(最后一个例子把空格替换成下划线。)\n\n### 什么时候单行命令足够,什么时候不够\n\n单行命令合适的情况:\n\n- 转换简单,可以一句话说明清楚。\n- 可以先在小样本上测试。\n- 你不是在为他人构建可复用工具。\n\n需要写脚本的情况:\n\n- 命令变得冗长或你要串联多个步骤。\n- 需要明确的错误处理(缺失文件、意外格式)。\n- 这项工作会被重复、审计或移交给他人。\n\n### 让快速修复可重现\n\n“快速”不等于“不可追溯”。保存你的 shell 历史行(或把它粘到代码库的笔记文件中),包含前/后示例,并记录发生了什么与为何更改。\n\n如果你两次运行同一条单行命令,那就是把它封装成小脚本(带文件名、注释和可预测的输入/输出路径)的信号。\n\n## CPAN:让小团队跑得更快的复用生态\n\nCPAN(Comprehensive Perl Archive Network)简单来说是 Perl 的共享模块书架:一个公共的可复用模块集合,任何人都可以下载并使用。\n\n不必把每个功能从头写起,小团队可以拿现成的、经过实战检验的模块,专注解决实际问题——把能在今天工作的脚本交付出去。\n\n### 对早期网页工作的“加速”作用\n\n很多日常网页任务因为 CPAN 而变得单人可完成。一些常见例子包括:\n\n- 模板:把 HTML 与逻辑分离,避免页面变成难以阅读的打印语句。\n- HTTP 客户端/服务器:从其他服务获取数据、处理请求并处理头信息。\n- 邮件:发送通知、解析入站邮件、处理 MIME 附件。\n- 数据库连接器:与 MySQL/PostgreSQL 通信并执行查询,而无需手写网络代码。\n\n这之所以重要,是因为早期的网页自动化常常就是“再写一个脚本”加入到已经繁忙的系统中。CPAN 允许用已有在野外使用过的代码快而且更安全地组装脚本。\n\n### 便利性与依赖管理之间的权衡\n\n代价是真实存在的:依赖是一种承诺。拉入模块立刻能节省时间,但也意味着你需要考虑版本兼容、安全修复,以及模块可能不再维护时的后果。今天的快速胜利可能变成明天令人困惑的升级问题。\n\n### 如何选择值得信赖的模块\n\n在依赖 CPAN 模块前,优先选择那些明确在维护的模块:\n\n- 阅读文档并浏览更新日志/发布说明。\n- 检查近期活动(是否有更新、是否回应 issue)。\n- 寻找健康的用户群与清晰的示例。\n\n当 CPAN 被审慎使用时,它是“胶带心态”的最佳体现之一:复用可行的东西,继续前进,不为不必要的基础设施耗费时间。\n\n## CGI 时代的模式:快速脚本,真实后果\n\nCGI(Common Gateway Interface)是网页的“就运行程序”阶段。请求到服务器,服务器启动你的 Perl 脚本,脚本读取输入(通常来自环境变量与 STDIN),然后打印响应——通常是 HTTP 头和一堆 HTML。\n\n### 典型的 CGI 流程\n\n最简单时,脚本:\n\n- 接收参数(如 name=Sam&age=42)Content-Type: text/html)然后输出 HTML\n\n这种模型让快速交付变得容易,也让快速交付变得危险。\n\n### 人们用 CGI 脚本自动化什么\n\nPerl CGI 成了实用网页自动化的捷径:\n\n- 表单处理:联系表单、注册表单、内部请求$_,以及那些省行数但降低可理解性的技巧(副作用、嵌套三元表达式、魔法默认值)。\n\n### 实用的风格指导,至今仍然有效\n\n几条习惯能显著提升可读性而不拖慢你:\n\n- 即使是小脚本也要使用一致的格式与缩进。\n- 选择有意义的变量与子例程名;除非在极短循环否则避免单字母名。\n- 优先用清晰步骤替代“全包式”表达;把复杂正则拆成阶段处理。\n- 限制华而不实的捷径,除非它们让代码更明显。\n\n### 社区实践:保护实际项目的护栏\n\nPerl 社区规范了一些简单的护栏,许多语言后来也把这些变成默认:启用 use strict; 与 use warnings;,写些基本测试(即便只是一些健康检查),并用内联注释或 POD 记录假设。\n\n这些做法不会让代码变得“企业化”——它们让代码可存活。\n\n更广泛的教训适用于任何语言:为未来的你和你的同事编写代码。最快的脚本是能在需求不可避免变化时安全被修改的那个脚本。\n\n## 仍然有价值的文本处理技能\n\n文本工作并没有变干净——只是换了地方。你可能不再维护 CGI 脚本,但仍要处理 CSV 导出、SaaS Webhook、日志文件和“临时”集成流,这些往往变成永久存在的东西。使 Perl 有效的那些实用技能今天仍能节省时间并防止安静的数据损坏。\n\n### 你仍会遇到的文本陷阱\n\n大多数问题不是“难以解析”,而是输入不一致:\n\n- 编码:UTF-8 与遗留 Windows 编码混用,或文件声称一种编码但实际不是。\n- 换行:Windows 与 Unix 行尾,或带有多余回车的粘贴数据。\n- 分隔符:逗号 vs 分号、制表符、多空格,或包含逗号导致的“CSV”错误。\n- 转义与引用:反斜杠、嵌入引号、CSV 内的 JSON、导出中的 HTML 实体。\n- 区域设置问题:1,234 vs 1.234,像 03/04/05 这样的日期,或不同语言的月份名称。\n\n### 防御性习惯:小规则,大回报\n\n把每个输入都当作不可信的,即便它来自“我们的系统”。尽早规范化:选定编码(通常 UTF-8)、统一换行、修剪明显的噪音,并转换成一致的 schema。\n\n然后明确验证假设:“这个文件有 7 列”,“ID 是数字”,“时间戳是 ISO-8601”。当出错时要大声失败并记录你见到的内容(样例行、行号、源文件)。\n\n### 解析,而不是猜测\n\n能用真实解析器时就优先使用:如果给你的是 JSON,就解析 JSON;如果是 CSV,就用 CSV 解析器,理解引号规则。盲目猜测在客户名里出现逗号时就会出问题。\n\n### 这些技能现在出现在哪儿\n\n这些技能在日常任务中很有用:事故时过滤应用日志、清理财务导出、转换CRM 导入、桥接API 集成,以及做一次性的数据迁移,因为“差不多正确”往往仍然是错误的。\n\n## Perl 的遗产与现代脚本语言并存\n\nPerl 的“胶带”声誉不是在说它随意——而是在说它有用。每当团队需要一段小脚本去对账导出、规范日志或把半结构化文本变成表格或数据库能消化的东西时,Perl 的遗产都会显现。\n\n### Perl 与当今常用脚本选择的比较\n\n现代脚本常偏向 Python、Ruby 或 JavaScript(Node.js)。它们的高层角色有重叠:快速自动化、与其他系统集成、以及作为工具间的胶合代码。\n\nPerl 的经典优势(并依然存在)是对操作系统的直接访问、富有表现力的文本处理以及“把工作做掉”的文化。Python 更强调可读性与广泛的标准库;Ruby 在开发者体验和 Web 习惯上常有优势;JavaScript 带来无处不在的部署能力(凡 Node 可运行处即能跑)。\n\n### 自 Perl 巅峰以来的变化\n\n今天很多工作受框架、稳定 API、云服务和更好工具的影响。曾需自定义脚本的任务现在可能有托管服务、现成队列和开箱即用的连接器。\n\n部署也不同:容器、CI 管道和依赖锁定从可选变成了常态。\n\n### 未曾改变的事实\n\n现实世界的文本依然混乱。日志会给你惊喜,导出会有“创造性”格式,数据仍需小心转换才能可靠。\n\n这就是 Perl 教给我们的恒久教训:自动化中不光鲜的 80% 是解析、清洗、校验并输出可预测的结果。\n\n### 今天如何挑选合适工具\n\n最好的选择通常是团队能维护的工具:团队对语言的熟悉程度、生态系统对任务的支持、以及现实的部署约束(什么已安装、什么安全策略允许、运维能支持什么)。Perl 的遗产并不是“总用 Perl”,而是“选择适合你实际混乱的工具”。\n\n另外值得一提的是,“胶带”本能也在现代 AI 辅助的工作流中出现。例如像 Koder.ai 这样的 vibe-coding 平台在你需要快速内部工具(比如日志查看器、CSV 规范化器或小型管理 UI)而更愿意通过聊天迭代而不是手工搭建时,会很有用。但同样的谨慎仍然适用:快速交付,要保证结果可读、可测试、并且易于回滚,以免今天的临时修补成明日的关键路径。\n\n## 下次自动化时的实用清单\n\nPerl 最大的馈赠不是特定语法,而是一种面对混乱文本问题的工作态度。当你准备自动化某件事(重命名任务、日志清理、数据导入),使用这个“胶带”清单在务实的同时避免制造未来的麻烦。\n\n### 胶带清单(以问题为先,而非混乱为先)\n\n- 解决真实问题:写下“完成”是什么样(文件格式、报告、已清理的列)。\n- 保证安全:先复制,做演练,限制范围(单个文件夹、单个日期范围、单个输入样本)。\n- 保持可读:选用乏味但清晰的名字,避免花哨技巧,在意图不明显处加注释。\n- 可逆:输出到新文件,保留原件,记录改动内容。\n- 处理丑陋情况:空白、奇怪字符、意外行、缺失字段。\n\n### 一个简单的实践计划(每次 30–60 分钟)\n\n从小处开始:\n\n1. 学习正则基础:锚点(^ / $)、分组、字符类,以及“贪婪 vs 非贪婪”匹配。\n2. 写微小脚本,把单个转换做好(例如,规范化日期、提取 ID、移除重复)。\n3. 为棘手转换添加测试:保留一组“恶劣”输入样例,确认输出保持正确。\n\n### 像你下周会忘记一样记录每次自动化\n\n包含:输入、输出、几条 前/后示例、假设(编码、分隔符)以及 回滚计划(“从备份 X 恢复”或“用以前的版本重新运行”)。\n\nPerl 既是网页时代文本工作的历史基石,也是持续的老师:务实、小心,并留下另一位能信任的人的脚本。