Qué significa realmente la IA "design to code"

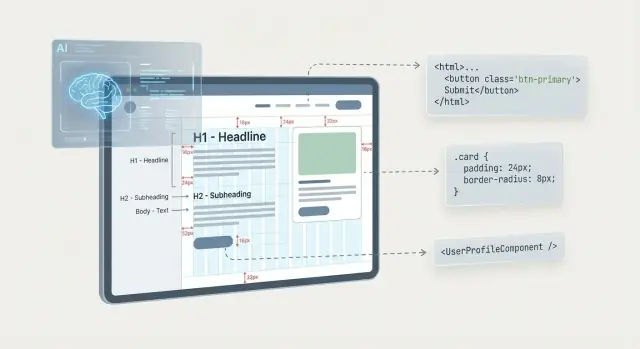

“Design to code” con IA traduce una idea visual de diseño —normalmente un frame de Figma o una captura de pantalla— en código UI ejecutable. La idea no es obtener "código perfecto", sino un primer borrador útil que capture la estructura, el estilo y comportamientos básicos para que un humano lo refine.

Lo que realmente traduce

En esencia, el sistema mapea lo que puede observar a cómo se construyen típicamente las UIs.

- Layout: Dónde están los elementos, cómo se alinean, espaciados, grids y agrupaciones de contenedores.

- Jerarquía: Qué parece primario frente a secundario (titulares vs. pies de foto, botones principales vs. enlaces) y cómo se anidan las secciones.

- Intención: Para qué sirve un elemento (botón de envío, tarjeta de detalle, campo de entrada).

- Componentes: Patrones repetidos que pueden convertirse en bloques reutilizables (botones, barras de navegación, cards, filas de formularios).

Lo que la IA puede inferir vs. lo que debes especificar

La IA puede inferir patrones comunes: una fila de iconos probablemente es una toolbar; una etiqueta apilada + campo suele ser un elemento de formulario; estilos consistentes sugieren un componente reutilizable. También puede adivinar comportamiento responsive basándose en constraints y espaciado.

Pero normalmente debes especificar lo que los píxeles no garantizan: nombres reales de componentes, tokens de diseño (colores/escalas tipográficas), estados (hover/disabled/error), puntos de ruptura y reglas de datos e interacciones reales (validación, destinos de navegación, analítica).

Ajustar expectativas

Trata la salida como punto de partida. Espera revisar la estructura, reemplazar estilos ad hoc por tokens, alinearla con tu librería de componentes e iterar. “Design to code” acelera el trabajo, pero no reemplaza el juicio de diseño e ingeniería.

Qué entradas usa la IA para entender un diseño

La IA no puede inferir reglas de producto desde una “pantalla bonita”. Parte de la evidencia que le das: algunas entradas describen píxeles, otras describen estructura. Esa diferencia suele determinar si obtienes código UI limpio o posicionamiento absoluto frágil.

Capturas y mockups estáticos: qué falta

Una captura es el input más limitado: contiene colores y formas, pero no hechos explícitos sobre qué es un botón o una etiqueta, qué es reusable o cómo debe adaptarse el layout.

A partir de píxeles, la IA debe adivinar límites (dónde termina un elemento y comienza otro), estilos tipográficos, reglas de espaciado e incluso si una “card” es un componente único o varias piezas separadas. Tampoco puede inferir constraints, así que el comportamiento responsive es mayormente especulativo.

Exports de Figma/Sketch: frames, capas, constraints, estilos

Si la IA puede acceder al archivo de diseño (o a una exportación que preserve estructura), gana metadatos cruciales: frames, grupos, nombres de capas, ajustes de Auto Layout, constraints y definiciones de texto/estilo.

Aquí el layout deja de ser solo geometría. Por ejemplo, un frame de Figma con Auto Layout comunica intenciones como “apilar estos items verticalmente con 16px de separación” mucho mejor que cualquier captura. Un nombrado consistente de capas también ayuda a mapear elementos a roles de UI (por ejemplo, “Primary Button”, “Nav Item”, “Input/Error”).

Sistemas de diseño: tokens, componentes, convenciones de nombres

Un design system conectado reduce las conjeturas. Los tokens (colores, espaciados, tipografía) permiten que la IA genere código que referencia una fuente de verdad compartida en lugar de valores hard-coded. Componentes publicados (botones, campos, modales) proporcionan bloques listos y fronteras más claras para el reuso.

Incluso pequeñas convenciones —como nombrar variantes (Button/Primary, Button/Secondary) y usar tokens semánticos (text/primary) en vez de #111111— mejoran el mapeo de componentes.

Especificaciones escritas: flujos, criterios de aceptación, casos límite

Las specs agregan el “por qué” detrás de la UI: comportamiento hover, estados de carga y vacíos, reglas de validación, comportamiento por teclado y mensajes de error.

Sin esto, la IA tenderá a generar una instantánea estática. Con specs, la salida puede incluir hooks de interacción, manejo de estados y APIs de componentes más realistas —más cerca de algo que un equipo pueda entregar y mantener.

Cómo interpreta la IA layout y estructura

Las herramientas design-to-code no perciben una pantalla como una persona; intentan explicar cada capa como reglas de layout: filas, columnas, contenedores y espaciados. Cuanto más claras sean esas reglas, menos dependerá la salida de posicionamientos frágiles.

Detectar grids, columnas y espaciados

La mayoría de modelos inicia buscando alineaciones repetidas y huecos iguales. Si varios elementos comparten el mismo borde izquierdo, baseline o centro, la IA suele tratarlos como una columna o track de grid. Espaciados consistentes (p. ej., patrones 8/16/24px) sugieren que el layout puede expresarse con gaps en stacks, gutters de grid o espaciados tokenizados.

Cuando el espaciado varía ligeramente (15px aquí, 17px allí), la IA puede concluir que el layout es “manual” y recurrir a coordenadas absolutas para preservar distancias pixel-perfect.

Reconocer contenedores y grupos anidados

La IA también busca “encierre” visual: fondos, bordes, sombras y huecos tipo padding que sugieran un contenedor. Una card con fondo y padding interno es una señal clara de un elemento padre con hijos.

A partir de ahí suele mapear la estructura en primitivas como:

- pilas verticales (listas, formularios)

- filas horizontales (toolbars, nav)

- grupos anidados (card → cabecera → acciones)

Una agrupación limpia en el archivo de diseño ayuda a distinguir padres de hermanos.

Interpretar constraints: fijo vs. fluido

Si el diseño incluye constraints (pinning, hugging, fill), la IA las usa para decidir qué se estira y qué permanece fijo. Los elementos “fill” suelen convertirse en anchos flexibles (p. ej., flex: 1), mientras que “hug” se mapea a elementos con tamaño según el contenido.

Por qué aparece posicionamiento absoluto (y por qué es riesgoso)

El posicionamiento absoluto suele aparecer cuando el modelo no puede expresar con confianza relaciones mediante layouts en flujo —a menudo por espaciados inconsistentes, capas solapadas o elementos desalineados. Puede verse correcto en un tamaño de pantalla, pero romper la responsividad y el reflujo de texto.

Un triunfo rápido: consistencia en el espaciado

Usar una pequeña escala de espaciado y alinearse a una cuadrícula clara aumenta dramáticamente la probabilidad de que la IA genere código limpio basado en flex/grid en lugar de coordenadas. La consistencia no es solo estética: es un patrón legible por máquina.

Cómo se infiere la jerarquía a partir de señales visuales

La IA no “entiende” la jerarquía; la infiere a partir de patrones que normalmente la señalan. Cuanto más claramente tu diseño comunique esas señales, más probable es que la UI generada coincida con tu intención.

Tipografía como sistema de rankings

La tipografía es una de las pistas más fuertes. Texto más grande, peso mayor, mayor contraste y line-height generoso suelen indicar mayor prioridad.

Por ejemplo, un título de 32px en negrita sobre un párrafo de 16px regular es un patrón claro de “heading + body”. Donde se complica es cuando los estilos se confunden —p. ej., dos bloques de texto que difieren solo 1–2px o usan el mismo peso con distintos colores. En esos casos, la IA puede etiquetarlos ambos como texto simple o elegir un nivel de encabezado incorrecto.

Agrupación: proximidad y contenedores compartidos

La jerarquía también se infiere por relaciones espaciales. Elementos más cercanos, alineados y separados del resto por espacio en blanco se tratan como un grupo.

Fondos comunes (cards, paneles, secciones tintadas) actúan como corchetes visuales: la IA suele interpretarlos como contenedores como section, aside o un wrapper de componente. Un padding desigual o espaciado inconsistente puede causar reagrupaciones accidentales —por ejemplo, un botón unido a la card equivocada.

Repetición sugiere componentes

Patrones repetidos —cards idénticas, items de lista, filas o campos de formulario— son evidencia fuerte de un componente reutilizable. Incluso pequeñas diferencias (tamaño de icono, radio de esquina, estilo de texto) pueden llevar a la IA a generar múltiples versiones puntuales en vez de un único componente con variantes.

Énfasis: acciones primarias vs. secundarias

Los botones comunican intención mediante tamaño, relleno, contraste y posición. Un botón relleno con alto contraste suele tratarse como acción primaria; los outlined o text buttons pasan a secundarios. Si dos acciones se ven igual de enfatizadas, la IA puede adivinar mal cuál es la “primaria”.

De la jerarquía visual a la estructura semántica

Finalmente, la IA intenta mapear jerarquía a semántica: encabezados (h1–h6), regiones agrupadas (section) y clusters significativos (como “detalles del producto” vs. “acciones de compra”). Pasos tipográficos claros y agrupación consistente hacen esta traducción mucho más fiable.

Cómo la IA supone intención del usuario e interacciones

Los modelos predicen intención emparejando lo que ven con patrones aprendidos de muchas UIs: formas comunes, etiquetas, iconografía y convenciones de colocación.

Reconocer patrones familiares de UI

Ciertas disposiciones sugieren componentes específicos. Una franja horizontal arriba con logo a la izquierda y elementos de texto a la derecha suele ser una barra de navegación. Una fila de items de ancho igual con uno destacado suele mapear a tabs. Boxes repetidos con imagen, título y texto corto se leen como cards. Grids densos con cabeceras alineadas se convierten en tablas.

Estas conjeturas importan porque afectan la estructura: una “pestaña” implica estado seleccionado y navegación por teclado, mientras que una “fila de botones” quizá no.

Inferir qué es interactivo

La IA busca pistas que suelen indicar interactividad:

- Formas tipo botón (fondos rellenos, rectángulos redondeados, alto contraste)

- Estilo de enlace (texto azul, subrayado) o colocación en navs

- Inputs (bordes, texto placeholder, indicadores de caret)

- Iconos de affordance (chevrons para dropdowns, lupas para búsqueda, “⋯” para menús)

A partir de ahí asigna comportamientos: click, abrir menú, navegar, submit, expandir/colapsar. Cuanto más el diseño diferencie elementos interactivos de estáticos, más precisa será la salida.

Entender estados (y cuándo la intención es ambigua)

Si el diseño muestra variantes —hover, activo/seleccionado, disabled, error, loading— la IA puede mapearlos a componentes con estado (p. ej., disabled buttons, mensajes de validación, skeleton loaders). Cuando los estados no son explícitos, la IA puede omitirlos.

La ambigüedad es común: ¿una card es clickable o informativa? ¿un chevron es decorativo o un control de disclosure? En esos casos, clarifica mediante nombres, anotaciones o frames separados que demuestren la interacción.

Convertir diseño en primitivas UI y componentes

Una vez que la IA tiene una lectura plausible del layout, el siguiente paso es traducir “lo que parece” a “lo que es”: HTML semántico, componentes reutilizables y estilos coherentes.

De capas a estructura (y roles)

La mayoría de herramientas mapean capas y grupos de diseño a un árbol DOM: frames → contenedores, capas de texto → headings/párrafos y elementos repetidos → listas o grids.

Cuando la intención es clara, la IA puede asignar una semántica mejor —p. ej., una barra superior se convierte en un \u003cheader\u003e, un logo y enlaces en un \u003cnav\u003e, y una card clickable en un \u003ca\u003e o \u003cbutton\u003e. A veces pueden inferirse roles ARIA (como role="dialog" para un modal), pero solo cuando el patrón es inequívoco; de lo contrario, la salida más segura es HTML simple más TODOs para revisión de accesibilidad.

Delimitar fronteras de componente

Para evitar generar un único archivo gigante, la IA trata de cortar la UI en primitivas:

- Átomos: botones, inputs, iconos, tags

- Moléculas: barras de búsqueda, filas de formularios, items de lista

- Templates/secciones: bloques hero, tablas de precios, shells de página

Señales comunes para un “componente” son repetición, padding/typografía consistente y un área clickable agrupada. Fallos habituales son sobre-fragmentar (componentes demasiado pequeños) o sub-fragmentar (todo hardcoded en una sola vez).

Estilos: CSS vs utilidades vs CSS-in-JS

El generador suele elegir un enfoque según el stack objetivo o sus valores por defecto:

- CSS plano / módulos: separación clara, fácil de editar a mano

- Clases utility: rápido de generar y consistente, pero markup más verboso

- CSS-in-JS: estilos co-localizados con componentes, pero puede ser ruidoso sin disciplina de tokens

Tokens en vez de píxeles

La salida de alta calidad recurre a tokens de diseño —colores, espaciados, radius, sombras— para que el código sea consistente cuando el diseño evolucione. Un ajuste estrictamente pixel-perfect produce valores puntuales (p. ej., gaps de 13px, grises casi idénticos) que lucen bien pero son difíciles de mantener.

Un equilibrio práctico: preservar jerarquía y ritmo de espaciado, luego normalizar en tokens y componentes reutilizables (y refactorizar más en la revisión —ver /blog/how-to-review-and-refactor-generated-ui-code).

Responsividad: de frames fijos a UIs adaptativas

Los archivos de diseño a menudo parecen "terminados" porque están dibujados en tamaños fijos (como 1440 y 375). El código no puede asumir eso. Una herramienta design-to-code debe decidir cómo se comporta la UI en anchuras intermedias, usando pistas y valores por defecto.

Cómo se infieren (o adivinan) los breakpoints

Si tu diseño incluye múltiples versiones de la misma pantalla (desktop/tablet/mobile) y la estructura es consistente, la IA puede alinearlas e inferir dónde cambian las reglas de layout. Sin variantes, normalmente recurre a breakpoints comunes y trata el tamaño del frame como la “base”, lo que puede provocar saltos incómodos.

Decisiones de wrap, stack y reflow

La IA busca patrones: cards repetidas en un grid, espaciado igual y alineación. A partir de eso puede decidir que un grid de 3 columnas pase a 2 y luego a 1. Se complica cuando el diseño usa nudges manuales: elementos que parecen alineados pero no lo están realmente, porque no puede saber si eso fue intencional.

Contenido dinámico: texto largo y localización

La mayoría de diseños usa copias cortas y ordenadas. Los productos reales no. El código generado a menudo establece anchos/altos fijos o trunca demasiado.

Una prueba rápida:

- Títulos 2–3× más largos (compuestos largos en alemán, nombres legales)

- Botones y mensajes de error multilínea

- Tamaños de texto más grandes (ajustes de accesibilidad del S.O.)

Imágenes y medios responsivos

La IA puede preservar el crop pixel-perfect del diseño, pero las UIs responsivas necesitan reglas: mantener ratio, decidir cómo recortar y cuándo las imágenes deben escalar versus cambiar de posición. Si el diseño no lo especifica, espera comportamiento “fill” que recorte partes importantes.

Comprobaciones prácticas

Antes de confiar en la salida, prévisualiza en anchuras muy pequeñas, pantallas muy grandes y tamaños intermedios. Si algo se solapa, se corta o se vuelve ilegible, el problema suele ser falta de intención de layout —no “código malo”— y es señal de que hay que añadir constraints más claras en el diseño.

Accesibilidad: señales, huecos y mejoras rápidas

La IA puede convertir píxeles en código UI sorprendentemente bien, pero accesibilidad es donde “se ve bien” suele divergir de “funciona para todos”. Muchas exigencias no son visibles en un frame estático, así que el modelo necesita señales explícitas.

Lo que la IA puede inferir desde un diseño

Algunas elecciones amigables con la accesibilidad sí se muestran visualmente y la IA puede mapearlas a mejor HTML:

- Contraste y énfasis: texto grande y negritas tiende a convertirse en encabezados; botones de alto contraste en acciones primarias.

- Etiquetas cerca de inputs: una etiqueta situada justo encima/a la izquierda de un campo suele inferirse como label del campo.

- Pistas de orden de foco: un layout limpio de izquierda a derecha y de arriba a abajo puede producir un orden DOM razonable.

Lo que la IA no puede inferir con fiabilidad

Otros requisitos no son visibles:

- Flujo de teclado y trampas: modales, menús y widgets personalizados necesitan gestión explícita de foco.

- Labels significativos: “Email” como placeholder no equivale a una label accesible; la intención (p. ej., “Buscar productos” vs. “Buscar en el sitio”) puede ser ambigua.

- Anuncios de estado: errores, cargas y actualizaciones dinámicas necesitan patrones ARIA que no son obvios por apariencia.

Errores comunes en el código generado

Es frecuente encontrar faltas como conexiones label/for ausentes, niveles de encabezado incorrectos, div clickable sin soporte por teclado, estilos de foco débiles e iconos sin alternativas textuales.

Lista rápida antes de enviar

- Los encabezados forman un esquema lógico (

h1 → h2 → h3).

- Existen landmarks (

header, nav, main, footer) y no están duplicados.

- Imágenes/iconos tienen

alt apropiado (o alt="" cuando son decorativas).

- Hay estilos de foco visibles que cumplen requisitos de contraste.

- Inputs tienen labels asociados y mensajes de error claros.

Cuándo añadir una spec de accesibilidad explícita

Añade una spec corta cuando haya modales, drawers, formularios complejos, selects personalizados, drag-and-drop o cualquier cosa con estados no triviales. Incluso unas notas como “trap focus en modal”, “Esc cierra” y “anunciar errores inline” mejoran mucho el código generado.

Dónde suele fallar el código UI generado por IA

La IA puede producir código que parece correcto a primera vista, pero pequeños errores de interpretación se acumulan. La mayoría vienen de conjeturas razonables cuando el diseño no codifica reglas claramente.

Espaciado que no coincide con el diseño

Una queja habitual es el espaciado desajustado: botones que parecen un poco fuera, secciones con respiración extra o cards apretadas. Sucede cuando el padding de elementos similares es inconsistente o cuando Auto Layout/constraints se mezclan con nudges manuales. El modelo puede inferir un patrón (p. ej., “16px en todas partes”) y sobreescribir excepciones —o preservar excepciones accidentales.

Over-nesting y DOM desordenado

El markup generado a menudo tiene demasiados wrappers. Cada agrupación visual inferida se convierte en otro \u003cdiv\u003e. El resultado es más difícil de estilizar, depurar y a veces más lento de renderizar. Lo notarás cuando una card simple se vuelva cinco contenedores anidados solo para alinear un icono y un título.

División de componentes que no tiene sentido

La IA puede fragmentar en exceso (cada label es un componente) o ser demasiado monolítica (toda la pantalla en un solo componente). La causa raíz son límites poco claros: si los patrones repetidos no son idénticos, el modelo no puede extraer con confianza un componente compartido.

Deriva tipográfica

La tipografía suele “derivar” porque los estilos de texto en diseño no siempre casan con el código. Diferencias sutiles en line-height, tracking o peso pueden perderse, y las fuentes de fallback cambian métricas entre entornos. Por eso un titular que encajaba en Figma de pronto hace wrap en el navegador.

Estados de interacción ausentes

Si hover, focus, error, loading o empty no están representados en el diseño, la IA rara vez los inventa. La UI puede verse correcta en una captura estática pero fallar cuando los usuarios interactúan.

Cómo preparar diseños para que la IA genere mejor código

Los generadores no “ven” tu diseño como un humano: leen un archivo estructurado lleno de capas, constraints, estilos y instancias de componente. Cuanto más limpia sea esa estructura, menos tendrá que adivinar el modelo (y menos sopa de divs deberás deshacer después).

1) Usa el nombrado para transmitir intención

Los nombres de capa son una de las señales más fuertes para intención y mapeo de componentes. Prefiere patrones consistentes y descriptivos que coincidan con cómo construyes UI:

Button/Primary, Button/SecondaryCard/Product, Card/ArticleForm/Input/Text, Form/Checkbox

Evita dejar todo como “Rectangle 12” o “Group 5”: eso empuja a la IA a envolver con genéricos en lugar de componentes reutilizables.

2) Usa Auto Layout y constraints (no coreografía pixel a pixel)

El posicionamiento manual suele convertirse en coordenadas absolutas en código. Si quieres output basado en flex/grid, tu diseño debe comportarse como flex/grid:

- Emplea Auto Layout para filas/columnas, espaciado, alineación y padding.

- Aplica constraints para que los elementos se redimensionen predeciblemente (p. ej., texto que crece, botones anclados, cards que se estiran).

Cuando el diseño responde bien dentro de la herramienta, el código generado tenderá a ser responsivo por defecto.

3) Define tokens y reusa estilos

Valores puntuales de color, tamaño de fuente y espaciado fomentan CSS one-off. En su lugar:

- Crea y reutiliza estilos de color/texto (o variables) para tipografía, superficies, bordes y estados.

- Estandariza pasos de espaciado (p. ej., 4/8/12/16) para que los layouts traduzcan a tokens coherentes.

Esto mejora la consistencia y facilita refactorizar hacia un design system.

4) Incluye estados, variantes y notas breves de intención

La IA no puede inferir lo que no encuentra. Añade variantes clave como hover/pressed/disabled, estados de error para inputs, loading y empty states.

Cuando el comportamiento importa, anótalo brevemente: “abre modal”, “validación en servidor”, “muestra toast en éxito”. Una línea junto a un componente puede evitar código de interacción incorrecto.

Si estandarizas el flujo del equipo, captura estas convenciones en una checklist ligera y enlázala internamente (p. ej., /blog/design-to-code-checklist).

Cómo revisar y refactorizar la salida generada

El código UI generado por IA es mejor tratarlo como un primer borrador: ahorra horas pero necesita una pasada humana para garantizar que la UI se comporte correctamente, sea mantenible y cumpla estándares de producto.

1) Verifica la semántica antes que los píxeles

Empieza leyendo el markup como si fueras un lector de pantalla.

- Revisa el orden de encabezados (un

\u003ch1\u003e, luego \u003ch2\u003e/\u003ch3\u003e).

- Confirma que las listas son listas reales (

\u003cul\u003e/\u003col\u003e) y no \u003cdiv\u003es apilados.

- Inspecciona formularios: cada input debe tener una label y el texto de ayuda/error debe estar asociado.

- Asegúrate de que los elementos interactivos sean correctos: buttons para acciones, links para navegación.

Si la semántica está mal, arreglar CSS no rescatará accesibilidad ni usabilidad.

2) Refactoriza el layout para estabilidad

Muchos generadores usan posicionamiento absoluto o wrappers profundamente anidados para “clavar” la captura. Eso tiende a romper cuando cambia el contenido.

Prefiere reglas flex/grid sobre coordenadas y reduce el anidamiento hasta que cada wrapper tenga una razón clara (agrupación para layout, espaciado o límite de componente). Si ves patrones repetidos de style={{ left, top, width, height }}, reescribe esa zona primero.

Busca patrones UI repetidos (cards, filas de input, items de nav) y convértelos en componentes reutilizables. Sustituye valores hard-coded por tokens: espaciado, radius, tipografía y colores. Si tu equipo ya tiene guía de tokens, alinea la salida; si no, empieza con un conjunto mínimo y amplíalo deliberadamente (ver /blog/design-tokens).

4) Añade pruebas rápidas para evitar regresiones

No necesitas una suite pesada para obtener valor.

- Añade historias en Storybook para componentes clave y checks de snapshot/visuales.

- Haz un QA corto: navegación por teclado, estados de foco, puntos de ruptura responsivos y escenarios de “texto largo”.

5) Documenta supuestos

Los generadores adivinan intención. Captura las ediciones que hiciste (reglas de interacción, breakpoints, decisiones de mapeo de componentes) para que la próxima generación o el siguiente desarrollador no las reviertan.

Elegir el flujo de trabajo correcto y ajustar expectativas

La IA “design to code” funciona mejor cuando la tratas como acelerador, no piloto automático. Los equipos más rápidos eligen un flujo que coincida con la madurez de su design system y el nivel de riesgo de la pantalla que construyen.

Dos flujos comunes

1) Asistencia IA dentro de la herramienta de diseño (p. ej., plugins de Figma): Ideal para mantenerse cerca del archivo fuente. Obtienes andamiaje rápido mientras los diseñadores iteran y es más fácil mantener nombres, componentes y tokens alineados con el archivo.

2) Convertidores externos (exportar/subir → código): Útiles cuando necesitas una canalización repetible a través de muchos archivos o equipos. Puede ser más rápido para conversiones masivas, pero a menudo pasas más tiempo limpiando la estructura y enlazando interacciones.

En la práctica, muchos equipos combinan design-to-code con un flujo más amplio “spec a app entregada”. Por ejemplo, plataformas como Koder.ai aplican el mismo principio —convertir intención en implementación— y lo extienden más allá del scaffolding UI: puedes describir features en chat, generar frontends React con backends Go/Postgres (y Flutter para móvil), iterar con modo planning, snapshots, rollback y exportar código cuando toca integrar con un repo existente.

Cuándo la IA ayuda más

La IA brilla en:

- Prototipos y MVPs donde la rapidez importa más que la arquitectura perfecta

- Scaffolding: grids, espaciado, mapeo básico de componentes y contenido placeholder

- UI repetitiva (tablas, cards, pantallas de settings) donde los patrones se repiten

Cuándo limitar o evitar la IA

Ten precaución con:

- Flujos complejos multi-paso donde estados, validación y casos límite importan

- Pantallas con fuertes requisitos de accesibilidad (gestión de teclado, matices ARIA, focus)

- UI con muchos datos y renderizado condicional donde el rendimiento es crítico

Construye un bucle de feedback

Trata cada generación como un borrador: revisa la salida, anota problemas recurrentes (nombres, estados faltantes, semántica incorrecta), actualiza tu prompt/spec y las convenciones de diseño. En unas pocas rondas, la calidad mejora más de lo que esperarías.

Próximos pasos y criterios de evaluación

Antes de comprometerte, ejecuta un piloto pequeño y puntúa resultados en: fidelidad al layout, reutilización de componentes, responsividad, fundamentos de accesibilidad y tiempo de refactorización. Si comparas herramientas y planes, revisa /pricing.