16 oct 2025·8 min

REST vs gRPC: elegir el estilo de API adecuado para tu app

Compara REST y gRPC para proyectos reales: rendimiento, herramientas, streaming, compatibilidad y ajuste al equipo. Usa una lista práctica para decidir con confianza.

Compara REST y gRPC para proyectos reales: rendimiento, herramientas, streaming, compatibilidad y ajuste al equipo. Usa una lista práctica para decidir con confianza.

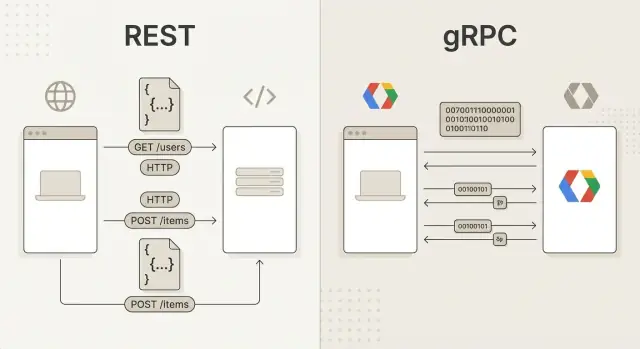

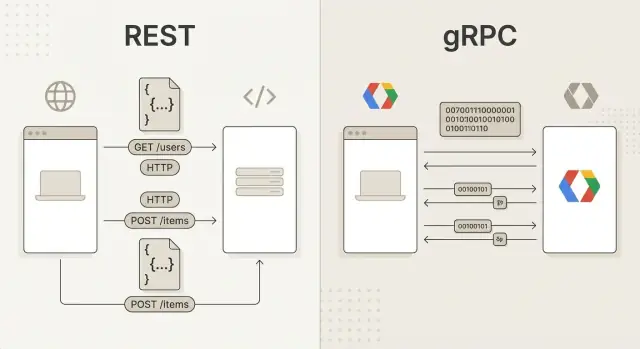

Cuando la gente compara REST y gRPC, en realidad está comparando dos formas diferentes de que el software “hable” a través de la red.

REST es un estilo de diseño de API centrado en los recursos—las cosas que tu app gestiona, como usuarios, pedidos o facturas. Interactúas con esos recursos usando solicitudes HTTP familiares:

GET /users/123)POST /orders)Las respuestas suelen ser JSON, fácil de inspeccionar y ampliamente soportado. REST tiende a sentirse intuitivo porque se mapea bien con cómo funciona la web—y porque puedes probarlo con un navegador o herramientas simples.

gRPC es un framework para remote procedure calls (RPC). En lugar de pensar en “recursos”, piensas en métodos que quieres ejecutar en otro servicio, como CreateOrder o GetUser.

Bajo el capó, gRPC normalmente usa:

.proto) que puede generar código cliente y servidorEl resultado suele sentirse como llamar a una función local—excepto que se ejecuta en otra máquina.

Esta guía te ayuda a elegir según restricciones reales: expectativas de rendimiento, tipos de clientes (navegador vs móvil vs servicios internos), necesidades en tiempo real, flujo de trabajo del equipo y mantenimiento a largo plazo.

No hay una respuesta única. Muchos equipos usan REST para APIs públicas o de terceros y gRPC para comunicación interna entre servicios—pero tus restricciones y objetivos deben guiar la elección.

Antes de comparar características, aclara qué estás optimizando. REST y gRPC pueden funcionar bien, pero destacan bajo diferentes condiciones.

Empieza por los clientes.

En internet público te preocuparán proxies, capas de caché y compatibilidad con herramientas diversas. REST sobre HTTP es ampliamente soportado y suele navegar mejor las redes empresariales.

Dentro de una red privada (o entre servicios en la misma plataforma) puedes aprovechar el protocolo más cerrado de gRPC y la comunicación más estructurada—especialmente si controlas ambos extremos.

Pregunta cómo es el “tráfico normal”:

Si necesitas streaming (eventos, actualizaciones de progreso, feeds continuos), factorízalo desde el inicio. Puedes construir patrones en torno a REST, pero el modelo de streaming de gRPC suele encajar mejor cuando ambos lados lo soportan.

Elige lo que tu equipo pueda entregar y operar con confianza. Considera estándares de API existentes, hábitos de depuración, cadencia de releases y la rapidez con la que los nuevos desarrolladores se vuelven productivos. Un protocolo “mejor” que ralentiza la entrega o aumenta el riesgo operativo no es la mejor opción para tu proyecto.

A nivel de protocolo, REST y gRPC se reducen a “un cliente llama a un servidor”, pero describen esa llamada de forma distinta: REST se centra en recursos HTTP y códigos de estado, mientras gRPC se centra en métodos remotos y un esquema estricto.

Las APIs REST suelen correr sobre HTTP/1.1, y cada vez más sobre HTTP/2. La “forma” de una llamada REST se define por:

/users/123)GET, POST, PUT, PATCH, DELETE200, 201, 400, 401, 404, 500, etc.Accept, Content-Type)El patrón típico es request/response: el cliente envía una petición HTTP y el servidor devuelve una respuesta con código de estado, headers y un cuerpo (a menudo JSON).

gRPC siempre usa HTTP/2, pero no expone “recursos + verbos” como interfaz principal. En su lugar, defines servicios con métodos (como CreateUser o GetUser) y los llamas como llamadas remotas.

Además del payload, gRPC soporta:

REST pregunta: “¿Sobre qué recurso operas y qué verbo HTTP aplica?”

gRPC pregunta: “¿Qué método estás llamando y qué mensaje tipado acepta/devuelve?”

Esa diferencia afecta el naming, el manejo de errores (códigos HTTP vs códigos gRPC) y cómo se generan los clientes.

.proto es el contrato. Define servicios, métodos y mensajes tipados, permitiendo generación de código fiable y reglas de compatibilidad más claras al evolucionar la API.El rendimiento es una de las razones más citadas para considerar gRPC—pero la ganancia no es automática. La pregunta real es qué tipo de “rendimiento” necesitas: menor latencia por llamada, mayor throughput bajo carga, menor consumo de ancho de banda o mejor eficiencia del servidor.

La mayoría de APIs REST usan JSON sobre HTTP/1.1. JSON es fácil de inspeccionar, registrar y depurar, lo cual es una eficiencia práctica para los equipos.

La contrapartida es que JSON es verboso y requiere más CPU para parsear y generar, especialmente cuando los payloads son grandes o las llamadas son frecuentes. HTTP/1.1 también puede añadir sobrecarga de conexión cuando los clientes realizan muchas peticiones paralelas.

REST puede ser una ventaja de rendimiento en arquitecturas de solo lectura: el caching HTTP (ETag, Cache-Control) puede reducir drásticamente las peticiones repetidas—especialmente en combinación con CDNs.

gRPC suele usar Protocol Buffers (binario) sobre HTTP/2. Eso normalmente significa:

Esos beneficios se notan sobre todo en llamadas entre servicios con alto volumen de peticiones, o cuando mueves muchos datos dentro de un sistema de microservicios.

En un sistema tranquilo, REST y gRPC pueden parecer igual de rápidos. Las diferencias se hacen más evidentes con más concurrencia.

Las diferencias de rendimiento importan más cuando tienes llamadas internas de alta frecuencia, payloads grandes, restricciones estrictas de ancho de banda móvil o SLOs muy ajustadas.

Importan menos cuando tu API está dominada por tiempo de base de datos, llamadas a terceros o uso a escala humana (dashboards, CRUD típico). En esos casos, claridad, cacheabilidad y compatibilidad de clientes pueden pesar más que la eficiencia del protocolo.

Características en tiempo real—dashboards en vivo, chat, colaboración, telemetría, notificaciones—dependen de cómo tu API maneja comunicación “continua”, no solo peticiones puntuales.

REST es por naturaleza request/response: el cliente pregunta, el servidor responde y la conexión termina. Puedes construir comportamiento cercano al tiempo real, pero normalmente depende de patrones alrededor de REST:

(Para tiempo real en navegador, los equipos a menudo añaden WebSockets o SSE junto a REST; ese es un canal separado con su propio modelo operativo.)

gRPC soporta varios tipos de llamadas sobre HTTP/2, y el streaming está integrado en el modelo:

Esto hace que gRPC sea una buena opción cuando quieres flujo sostenido y baja latencia sin crear nuevas peticiones HTTP continuamente.

El streaming brilla en:

Las conexiones largas cambian la operación:

Si el “tiempo real” es central en tu producto, el modelo de streaming de gRPC puede reducir la complejidad frente a montar polling/webhooks (y posiblemente WebSockets) encima de REST.

Elegir entre REST y gRPC no es solo velocidad: tu equipo convivirá con la API a diario. Herramientas, onboarding y cómo evolucionas interfaces con seguridad suelen importar más que el throughput bruto.

REST se siente familiar porque viaja sobre HTTP y suele hablar JSON. Esto significa que la caja de herramientas es universal: devtools del navegador, curl, Postman/Insomnia, proxies y logs que puedes leer sin visores especiales.

Cuando algo falla, depurar suele ser directo: reejecuta una petición desde la terminal, inspecciona headers y compara respuestas lado a lado. Esta conveniencia es una gran razón por la que REST es común en APIs públicas y en equipos que esperan muchas pruebas ad-hoc.

gRPC suele usar Protocol Buffers y generación de código. En lugar de ensamblar peticiones a mano, los desarrolladores llaman métodos tipados en su lenguaje preferido.

La ganancia es seguridad de tipos y un contrato explícito: campos, enums y formas de mensajes son explícitas. Esto reduce errores por “strings” y desajustes entre cliente y servidor—especialmente en llamadas entre servicios y en comunicación de microservicios.

REST es más fácil de aprender rápido: “envía una petición HTTP a esta URL.” gRPC pide a los nuevos entender archivos .proto, generación de código y a veces flujos de depuración diferentes. Los equipos cómodos con tipado fuerte y esquemas compartidos suelen adaptarse más rápido.

Con REST/JSON, la gestión de cambios suele apoyarse en convenciones (añadir campos, deprecar endpoints, versionar URLs). Con gRPC/Protobuf, las reglas de compatibilidad son más formales: añadir campos suele ser seguro, pero renombrar/eliminar o cambiar tipos puede romper consumidores.

En ambos estilos, la mantenibilidad mejora cuando tratas la API como un producto: documéntala, automatiza tests de contrato y publica una política clara de deprecación.

Elegir entre REST y gRPC suele reducirse a quién llamará tu API y desde qué entornos.

REST sobre HTTP con JSON está ampliamente soportado: navegadores, apps móviles, herramientas de línea de comandos, plataformas low-code y sistemas de partners. Si construyes una API pública o esperas integraciones de terceros, REST minimiza fricción porque los consumidores pueden empezar con peticiones simples y, con el tiempo, adoptar mejores herramientas.

REST también encaja naturalmente con restricciones web: los navegadores manejan HTTP bien, los proxies y caches lo entienden y es sencillo depurarlo con herramientas comunes.

gRPC brilla cuando controlas ambos extremos (tus servicios, apps internas, equipos backend). Usa HTTP/2 y Protocol Buffers, lo que mejora rendimiento y consistencia—pero no todos los entornos pueden adoptarlo fácilmente.

Los navegadores, por ejemplo, no soportan gRPC nativo; puedes usar gRPC-Web, pero añade componentes y restricciones (proxies, tipos de contenido específicos y herramientas distintas). Para terceros, exigir gRPC puede ser una barrera mayor que ofrecer un endpoint REST.

Un patrón común es mantener gRPC internamente para llamadas entre servicios y exponer REST externamente mediante un gateway o capa de traducción. Eso permite a los partners usar HTTP/JSON mientras tus sistemas internos conservan un contrato tipado.

Si tu audiencia incluye terceros desconocidos, REST suele ser la opción más segura. Si la audiencia son principalmente tus propios servicios, gRPC suele encajar mejor.

La seguridad y operabilidad son a menudo donde lo "bonito en una demo" se convierte en "difícil en producción". REST y gRPC pueden ser seguros y observables, pero encajan en patrones de infraestructura distintos.

REST normalmente va sobre HTTPS (TLS). La autenticación suele estar en headers HTTP:

Como REST se basa en semántica HTTP familiar, es fácil integrarlo con WAFs, reverse proxies y gateways que ya entienden headers, paths y métodos.

gRPC también usa TLS, pero la autenticación suele pasarse vía metadata (pares clave/valor similares a headers). Es común añadir:

authorization: Bearer …)Para REST, muchas plataformas ofrecen logs de acceso, códigos de estado y tiempos de petición. Puedes avanzar mucho con logs estructurados y métricas estándar (percentiles de latencia, tasas de error y throughput).

Para gRPC, la observabilidad es excelente una vez instrumentada, pero en algunas pilas no es tan “automática” porque no trabajas con URLs planas. Prioriza:

Las arquitecturas REST suelen colocar un ingress o API gateway en el borde, manejando TLS, auth, rate limiting y enrutado.

gRPC también funciona detrás de un ingress, pero a menudo necesitarás componentes que soporten HTTP/2 y características gRPC. En entornos de microservicios, un service mesh puede simplificar mTLS, reintentos, timeouts y telemetry para gRPC—especialmente cuando muchos servicios internos se comunican entre sí.

Resumen operativo: REST suele integrarse más suavemente con herramientas web estándar, mientras gRPC destaca cuando estás listo para estandarizar deadlines, identidad de servicio y telemetría uniforme en llamadas internas.

La mayoría de equipos no eligen REST o gRPC en abstracto: eligen lo que encaja con sus usuarios, clientes y tráfico. Estos escenarios aclaran las compensaciones.

REST es a menudo la opción “segura” cuando tu API debe ser ampliamente consumible y fácil de explorar.

Usa REST cuando construyas:

curl, Postman, logs)REST brilla en los bordes de tu sistema: es legible, cache-friendly en muchos casos y encaja bien con gateways, documentación e infraestructura común.

gRPC suele ser mejor para comunicación entre servicios cuando importan eficiencia y contratos fuertes.

Elige gRPC cuando tengas:

En estos casos, la codificación binaria y las características de HTTP/2 de gRPC suelen reducir la sobrecarga y hacer el rendimiento más predecible conforme crece el tráfico interno.

Una arquitectura práctica común es:

Este patrón limita las restricciones de compatibilidad de gRPC a tu propio entorno controlado, mientras que los sistemas internos obtienen los beneficios de contratos tipados y llamadas eficientes.

Algunas decisiones que causan dolor más adelante:

/doThing y perder la claridad del diseño orientado a recursos.Si dudas, usa REST en APIs externas y adopta gRPC donde puedas demostrar su beneficio: dentro de tu plataforma, en rutas calientes o donde el streaming y contratos estrictos aporten valor real.

Elegir entre REST y gRPC es más fácil cuando empiezas por quién usará la API y qué necesita lograr—no por lo que está de moda.

Pregúntate:

curl, clientes generados, documentación estable, SDKs.Usa esto como filtro de decisión:

Elige un endpoint representativo (no “Hello World”) y constrúyelo como:

Mide:

Si quieres moverte rápido en este piloto, un flujo de trabajo de tipo "vibe-coding" puede ayudar: por ejemplo, en Koder.ai puedes esbozar una app pequeña y backend desde un prompt de chat, y luego probar tanto una superficie REST como un servicio gRPC internamente. Como Koder.ai genera proyectos reales (React para web, backends en Go con PostgreSQL, Flutter para móvil), es una forma práctica de validar no solo benchmarks de protocolo, sino también la experiencia de desarrollador—documentación, integración cliente y despliegue. Funciones como modo de planificación, snapshots y rollback también son útiles al iterar en la forma de la API.

Documenta la decisión, las suposiciones (clientes, tráfico, streaming) y las métricas que usaste. Revisa la decisión cuando cambien los requisitos (nuevos consumidores externos, mayor throughput, características en tiempo real).

A menudo sí—especialmente para llamadas entre servicios—pero no automáticamente.

gRPC tiende a ser eficiente porque usa HTTP/2 (multiplexación) y un formato binario compacto (Protocol Buffers). Eso puede reducir CPU y ancho de banda frente a JSON sobre HTTP.

El rendimiento real depende de:

REST suele ser la opción por defecto para APIs públicas porque prácticamente cualquier cliente puede llamarla con HTTP y JSON.

Elige REST si esperas:

curl/PostmangRPC suele encajar mejor cuando controlas ambos extremos de la conexión y quieres un contrato fuertemente tipado.

Es una opción sólida para:

No siempre. gRPC suele ganar en tamaño de payload y eficiencia de conexión (multiplexación de HTTP/2 + Protobuf), pero los resultados dependen de los cuellos de botella reales.

Haz benchmarks con datos realistas porque el rendimiento puede estar dominado por:

REST soporta caché HTTP de forma natural con Cache-Control y ETag, además de CDNs y proxies compartidos.

gRPC no es tan amigable con el caché estándar porque las llamadas se tratan por método y no suelen considerarse cacheables por la infraestructura HTTP tradicional.

Si el caching es un requisito clave, REST suele ser el camino más sencillo.

Los navegadores no pueden usar gRPC “nativo” directamente debido a que no exponen ciertas funciones de HTTP/2 que gRPC necesita.

Opciones comunes:

Si tienes clientes en navegador o terceros, REST suele ser el camino más simple.

gRPC está pensado para usar Protobuf como contrato (.proto) que genera código y define tipos. Eso habilita muchas ventajas.

Técnicamente puedes usar otros formatos, pero pierdes muchas ventajas (safety de tipos, mensajes compactos, herramientas estándar).

Si quieres las principales ventajas de gRPC, trata Protobuf como parte del paquete.

REST suele comunicar resultados mediante códigos de estado HTTP (por ejemplo, 200, 404, 500) y cuerpos de respuesta.

gRPC devuelve un código de estado gRPC (como OK, NOT_FOUND, UNAVAILABLE) y puede incluir detalles de error.

Consejo práctico: estandariza el mapeo de errores pronto (errores reintentables vs no reintentables) para que los clientes se comporten de forma consistente entre servicios.

El streaming es una característica de primera clase en gRPC, con soporte integrado para:

REST es primordialmente request/response; el “tiempo real” normalmente requiere patrones adicionales como polling, long polling, webhooks, WebSockets o SSE.

Para REST, prácticas habituales son:

/v1/... o mediante headersPara gRPC/Protobuf:

Sí, es común y práctico:

Una capa gateway o backend-for-frontend puede traducir REST/JSON a gRPC/Protobuf. Así reduces la fricción para clientes externos mientras mantienes los beneficios de gRPC dentro de tu plataforma.