17 jun 2025·8 min

Theo de Raadt, OpenBSD y la mentalidad “seguro por defecto”

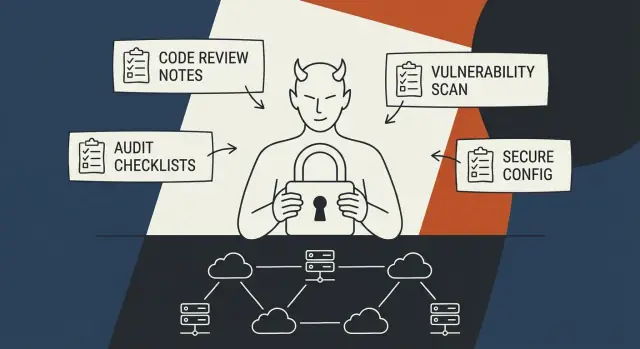

Cómo Theo de Raadt y OpenBSD moldearon el pensamiento “seguro por defecto” mediante auditorías, diseño conservador y mitigaciones prácticas que hoy usan los sistemas modernos.

Qué significa “seguro por defecto” en la práctica

"Seguro por defecto" significa que un sistema arranca en su estado razonablemente más seguro sin que tengas que buscar entre menús, leer una larga lista de verificación o ya saber qué puede fallar. La primera instalación debe minimizar los servicios expuestos, limitar permisos y escoger opciones más seguras automáticamente. Aún puedes abrir cosas —pero lo haces deliberadamente y con los ojos abiertos.

Los valores por defecto son una decisión, no una casilla para marcar

Un valor por defecto es el camino que la mayoría de la gente tomará. Eso lo convierte en un control de seguridad: moldea los resultados del mundo real más que cualquier guía opcional de endurecimiento. Si la configuración por defecto habilita silenciosamente servicios de red adicionales, acceso permisivo a archivos o características arriesgadas, muchas implantaciones heredarán ese riesgo durante mucho tiempo.

OpenBSD aparece con frecuencia en las discusiones de seguridad porque trató esta idea como un objetivo central de ingeniería durante décadas: enviar defaults conservadores, reducir la superficie de ataque y hacer que el comportamiento arriesgado sea opt-in. Ese enfoque influyó en cómo muchos ingenieros piensan sobre sistemas operativos, servicios de red y diseño de aplicaciones.

Qué esperar en este artículo

Veremos las prácticas que soportaron la mentalidad “seguro por defecto”, incluyendo:

- Valores por defecto que reducen la exposición (menos servicios en escucha, permisos más estrictos).

- Una cultura de auditoría ("leer el código" como hábito cotidiano, no como eslogan).

- Mitigaciones de exploits que elevan el coste de los ataques comunes.

- Proceso y cultura—estándares, revisiones y a veces aristas que empujan la calidad.

Principios por encima de personalismos

El papel de Theo de Raadt importa históricamente, pero el objetivo aquí no es la adoración de un héroe. La lección útil es cómo un proyecto puede convertir la seguridad en un conjunto de decisiones repetibles: decisiones que aparecen en los defaults, en los hábitos de revisión de código y en la disposición a decir “no” a la comodidad cuando crea un riesgo innecesario.

Theo de Raadt y los orígenes de OpenBSD

Theo de Raadt es un desarrollador canadiense conocido por su atención prolongada a la ingeniería cuidadosa de sistemas dentro de la familia BSD. Antes de OpenBSD fue una figura central en los primeros esfuerzos de BSD en PC y cofundador de NetBSD a principios de los 90. Ese trasfondo importa: los BSD no eran "aplicaciones", eran sistemas operativos pensados como cimientos de confianza.

Por qué se creó OpenBSD

OpenBSD comenzó en 1995 después de que de Raadt dejara el proyecto NetBSD. El nuevo proyecto no nació para buscar novedad ni para construir un “BSD con todo”. Se creó para construir un sistema donde la corrección y la seguridad fueran prioridades explícitas, incluso cuando eso implicara decir “no” a la conveniencia.

Desde el principio, OpenBSD puso energía en cosas que muchos proyectos consideran poco glamurosas:

- auditar código en busca de patrones inseguros y bugs sutiles

- apretar los valores por defecto para que una instalación fresca sea más difícil de malconfigurar

- diseñar características para que puedan mantenerse y revisarse en el tiempo

Un conjunto de objetivos distinto a “características primero”

Muchos sistemas y distribuciones compiten por amplitud: más controladores, más servicios incluidos, más opciones de configuración, entrega rápida de funciones. Esas son metas legítimas y útiles para usuarios.

La historia de origen de OpenBSD refleja una apuesta distinta: que una base más pequeña y comprensible—entregada con defaults conservadores—puede reducir las probabilidades de errores críticos de seguridad.

Eso no hace que otros enfoques sean "equivocados". Significa que los compromisos aparecen en decisiones diarias: si habilitar un servicio por defecto, aceptar un subsistema complejo o rediseñar una interfaz para que sea más difícil de usar mal.

Objetivos de seguridad vs. resultados de seguridad

El énfasis fundacional de OpenBSD fue un objetivo de seguridad: tratar la seguridad como una restricción de diseño, no como un añadido. Pero los objetivos no son lo mismo que los resultados. La seguridad real se mide con los años: por las vulnerabilidades encontradas, la rapidez en corregirlas, la claridad de la comunicación y la capacidad del proyecto para aprender de sus errores.

La cultura de OpenBSD creció desde esa premisa: asume que el software puede fallar y entonces diseña defaults y procesos para fallar menos.

Los defaults como control de seguridad (no solo una opción)

OpenBSD trata la “instalación por defecto” como una promesa de seguridad: un sistema nuevo debería ser razonablemente seguro antes de que hayas leído una guía de ajuste, añadido una regla de firewall o buscado en archivos de configuración oscuros. Eso no es conveniencia, es un control de seguridad.

Si la mayoría de las máquinas se mantienen cerca de sus valores por defecto (como suele pasar), entonces los defaults son el lugar donde el riesgo se previene o se multiplica en silencio.

Seguro sin ajustes adicionales

Un enfoque seguro por defecto asume que los nuevos administradores cometerán errores, estarán ocupados o seguirán consejos desactualizados. Así que el sistema apunta a comenzar desde una base defendible: exposición mínima, comportamiento predecible y configuraciones que no te sorprendan.

Cuando cambias algo, deberías hacerlo deliberadamente—porque necesitas un servicio—no porque el sistema base "amablemente" lo habilitara.

Características conservadoras, servicios mínimos

Una expresión práctica de esta mentalidad es la selección conservadora de características y una preferencia por menos servicios que escuchen en red por defecto. Cada demonio en escucha es un lugar nuevo para bugs, malas configuraciones y credenciales olvidadas.

Los defaults de OpenBSD buscan mantener la superficie de ataque inicial pequeña, de modo que la primera victoria en seguridad provenga de no ejecutar cosas que no pediste.

Esta conservadurismo también reduce la cantidad de “pistolas al pie”—características poderosas pero fáciles de usar mal cuando estás aprendiendo.

Documentación como parte del control

Los defaults solo ayudan si la gente puede entenderlos y mantenerlos. La cultura de OpenBSD enfatiza documentación clara y archivos de configuración directos para que los administradores puedan responder preguntas básicas con rapidez:

- ¿Qué está corriendo?

- ¿Por qué está corriendo?

- ¿Dónde está configurado?

- ¿Cuál es la forma más segura de cambiarlo?

Esa claridad importa porque las fallas de seguridad suelen ser operativas: un servicio dejado encendido sin querer, una configuración copiada con opciones inseguras o la suposición de que “alguien más ya lo endureció”.

OpenBSD intenta hacer que el camino seguro sea el camino fácil y obvio—empezando desde el primer arranque.

Cultura de auditoría: “Lee el código” y revisión sistemática

La reputación de seguridad de OpenBSD no se basa solo en mitigaciones ingeniosas o defaults estrictos—también se basa en un hábito: asumir que la seguridad mejora cuando la gente lee y cuestiona el código repetida y deliberadamente.

"Leer el código" es menos un eslogan que un flujo de trabajo: revisa lo que envías, sigue revisándolo y trata la ambigüedad como un bug.

Cómo se ve la auditoría (más allá de la corrección superficial)

La revisión sistemática no es solo escanear en busca de errores obvios. Normalmente incluye:

- Modelado de amenazas en términos claros: ¿Qué entradas puede controlar un atacante? ¿Qué pasa si envían los peores datos en el peor momento?

- Revisión de APIs e interfaces: ¿Son las funciones fáciles de usar mal? ¿Fallan de manera segura? ¿Son los defaults conservadores?

- Limpieza y simplificación: Eliminar código muerto, apretar límites, reducir comportamientos implícitos y hacer el flujo de control más fácil de razonar.

Una idea clave es que las auditorías a menudo apuntan a prevenir clases enteras de bugs, no solo a arreglar un problema reportado.

Objetivos de alto valor: dónde se esconden los bugs

Las auditorías se centran en componentes que parsean entradas no confiables o manejan operaciones de alto riesgo. Objetivos comunes incluyen:

- Parsers y formatos de archivo (cualquier cosa que lea datos complejos controlados por un atacante)

- Criptografía y manejo de llaves (especialmente rutas de error y casos frontera)

- Demonios expuestos en red (autenticación, gestión de sesiones y máquinas de estado de protocolos)

Estas áreas tienden a combinar complejidad con exposición—justo donde prosperan las vulnerabilidades sutiles.

Compromisos y límites

La revisión continua lleva tiempo y requiere experiencia concentrada. Puede ralentizar el trabajo de características y no es una garantía: los revisores también pierden cosas y el código nuevo puede reintroducir viejos problemas.

La lección práctica de OpenBSD no es mágica: la auditoría disciplinada reduce el riesgo cuando se trata como trabajo de ingeniería continuo, no como una "pasada de seguridad" puntual.

Menor privilegio y separación de privilegios como defaults de diseño

Comienza seguro por defecto

Inicia una nueva app en Koder.ai con valores conservadores y abre el acceso solo cuando sea necesario.

La seguridad no es solo añadir protecciones después de que algo falla. OpenBSD impulsó otro instinto: empezar por asumir que el software tendrá bugs y diseñar el sistema para que esos bugs tengan poder limitado.

Menor privilegio (versión en lenguaje llano)

"Menor privilegio" significa que un programa (o usuario) debe tener solo los permisos necesarios para hacer su trabajo y nada más. Si un servidor web solo necesita leer su propia configuración y servir archivos desde un directorio, no debería poder leer las carpetas personales de todos, cambiar ajustes del sistema o acceder a dispositivos crudos.

Esto importa porque cuando algo se rompe (o es explotado), el daño queda limitado por lo que ese componente comprometido puede hacer.

Separación de privilegios: no darle las llaves de la puerta principal

Los programas expuestos a la red reciben entrada no confiable todo el día: peticiones web, intentos de login SSH, paquetes malformados.

La separación de privilegios divide un programa en partes más pequeñas:

- Un ayudante “privilegiado” mínimo y fuertemente controlado que puede realizar acciones sensibles.

- Uno o varios procesos no privilegiados que manejan el parsing y la interacción de red.

Así, aunque un atacante encuentre un bug en la porción expuesta a Internet, no gana automáticamente control total del sistema. Aterriza en un proceso con pocos derechos y menos formas de escalar.

Sandboxing y aislamiento de procesos como contención

OpenBSD reforzó esta división con herramientas de aislamiento adicionales (como chroot y otras restricciones a nivel de SO). Piénsalo como ejecutar un componente riesgoso en una habitación cerrada: puede hacer su tarea estrecha, pero no puede pasear por toda la casa.

Modelo mental antes/después

Antes: un gran demonio corre con amplios privilegios → compromete una pieza, compromete todo el sistema.

Después: componentes pequeños y separados con privilegios mínimos → compromete una pieza, consigues un punto de apoyo limitado y te encuentras con barreras en cada paso.

Mitigaciones de exploits que cambiaron expectativas

Durante años, una gran parte de las intrusiones reales empezaban con una clase de defectos simple: fallos de seguridad de memoria. Desbordamientos de búfer, use-after-free y errores similares pueden permitir a un atacante sobrescribir datos de control y ejecutar código arbitrario.

OpenBSD trató esa realidad como un problema de ingeniería práctico: asume que algunos bugs se colarán, y entonces diseña el sistema para que explotarlos sea más difícil, haga más ruido y sea menos fiable.

Elevar el coste de la explotación

OpenBSD ayudó a normalizar mitigaciones que hoy mucha gente da por sentadas:

- W^X (Write XOR Execute): las páginas de memoria deben ser escribibles o ejecutables, no ambas. Esto frustra ataques clásicos de "inyectar shellcode y saltar a él".

- ASLR (aleatorización del diseño del espacio de direcciones): aleatorizar dónde viven el código y los datos en memoria dificulta predecir direcciones para técnicas como return-oriented programming.

- Protecciones de pila: defensas del compilador y tiempo de ejecución (como canarios de pila) que intentan detectar o prevenir la corrupción de la pila antes de que el flujo de control sea secuestrado.

Estos mecanismos no son "escudos mágicos". Son resaltes en el camino —a menudo muy efectivos— que obligan a los atacantes a encadenar más pasos, necesitar mejores fugas de información o aceptar menor fiabilidad.

Defensa en profundidad, no pase libre

La lección más profunda es la defensa en profundidad: las mitigaciones compran tiempo, reducen el radio del daño y transforman algunas vulnerabilidades en crashes en lugar de tomas de control. Eso importa operativamente porque puede reducir la ventana entre descubrimiento y parche, y evitar que un error se convierta en incidente total.

Pero las mitigaciones no sustituyen corregir vulnerabilidades. La filosofía de OpenBSD combinó resistencia a la explotación con arreglo implacable de bugs y revisión: dificulta la explotación hoy y sigue eliminando los bugs subyacentes mañana.

Criptografía, aleatoriedad e interfaces más seguras

Construye desde el chat, con intención

Convierte tus requisitos en una aplicación web funcional desde el chat, sin saltarte decisiones de seguridad.

La reputación de seguridad de OpenBSD no se basa en "más criptografía por todas partes". Se basa en la corrección primero: menos sorpresas, APIs claras y comportamientos que puedas razonar bajo presión.

Esa mentalidad afecta cómo se integra la criptografía, cómo se genera la aleatoriedad y cómo se diseñan interfaces para que las elecciones inseguras sean más difíciles de tomar por accidente.

Corrección y APIs claras ganan a la ingeniosidad

Un tema recurrente en OpenBSD es que las fallas de seguridad suelen empezar como bugs ordinarios: casos frontera de parsing, flags ambiguos, truncamientos silenciosos o defaults "útiles" que enmascaran errores.

El proyecto tiende a preferir interfaces más pequeñas y auditables con modos de fallo explícitos, incluso si eso implica eliminar o rediseñar comportamientos antiguos.

APIs claras también reducen las "pistolas al pie" en configuración. Si una opción segura requiere un laberinto de toggles, muchas implantaciones acabarán inseguras a pesar de las buenas intenciones.

Elecciones criptográficas conservadoras

El enfoque de OpenBSD hacia la criptografía es conservador: usar primitivas bien entendidas, integrarlas con cuidado y evitar habilitar comportamientos legados que existen solo por compatibilidad.

Esto aparece en defaults que favorecen algoritmos fuertes y en la disposición a deprecar opciones antiguas y débiles en lugar de mantenerlas por si acaso.

La meta no es ofrecer todos los suites de cifrado posibles: es hacer que la ruta segura sea la normal.

Aleatoriedad, parsing y complejidad oculta

Muchas fallas reales se rastrean hasta aleatoriedad débil, parsing inseguro o complejidad oculta en capas de configuración.

La aleatoriedad débil puede minar criptografía que por lo demás es fuerte, así que los sistemas seguros por defecto tratan la entropía y las APIs de azar como infraestructura crítica, no como algo secundario.

El parsing inseguro (de llaves, certificados, archivos de configuración o entradas de red) es otro repetido culpable; formatos previsibles, validación estricta y manejo seguro de cadenas reducen la superficie de ataque.

Finalmente, la complejidad de configuración “oculta” es en sí misma un riesgo: cuando la seguridad depende de reglas de orden sutiles o interacciones no documentadas, los errores se vuelven inevitables.

La preferencia de OpenBSD es simplificar la interfaz y escoger defaults que no hereden silenciosamente comportamientos inseguros legados.

OpenSSH y la difusión del pensamiento de seguridad de OpenBSD

OpenSSH es uno de los ejemplos más claros de cómo la filosofía de seguridad de OpenBSD salió del proyecto y se convirtió en una expectativa por defecto en otros lugares.

Cuando SSH se volvió la forma estándar de administrar Unix y Linux de forma remota, la pregunta no era "¿Deberíamos cifrar accesos remotos?"—era "¿Qué implementación podemos confiar para ejecutar en todas partes, todo el tiempo?"

De un fork de SSH a una base de seguridad

OpenSSH surgió cuando la implementación libre original de SSH (SSH 1.x) enfrentó cambios de licencia y el ecosistema necesitaba una alternativa permisiva y mantenida activamente.

OpenBSD no solo proporcionó un reemplazo; entregó una versión moldeada por su cultura: cambios conservadores, claridad de código y una preferencia por el comportamiento seguro sin exigir que cada admin sea un experto.

Eso importó ampliamente porque SSH está en el camino más sensible en muchos entornos: acceso privilegiado, automatización de flotas y recuperación de emergencias. Una debilidad en SSH no es “un bug más”—puede convertirse en una llave universal.

Defaults seguros habilitan administración remota segura

OpenBSD trató la administración remota como un flujo de trabajo de alto riesgo.

La configuración de OpenSSH y las características soportadas empujaron a los administradores hacia patrones mejores: criptografía fuerte, opciones de autenticación sensatas y rieles que reducen la exposición accidental.

Esto es lo que “seguro por defecto” parece en la práctica: reducir las pistolas al pie disponibles para un operador bajo presión. Cuando estás haciendo SSH a una caja de producción a las 2 a.m., los defaults importan más que los documentos de políticas.

La portabilidad es cómo las ideas de seguridad se esparcen

OpenSSH fue diseñado para viajar. Los puertos a Linux, *BSDs, macOS y Unix comerciales significaron que las decisiones de seguridad de OpenBSD—APIs, convenciones de configuración y actitudes de endurecimiento—se movieron con el código.

Incluso organizaciones que nunca ejecutaron OpenBSD adoptaron sus suposiciones sobre acceso remoto porque OpenSSH se convirtió en el denominador común.

Resultados operativos palpables

El mayor impacto no fue teórico: se notó en patrones diarios de administración. Equipos estandarizaron en gestión remota cifrada, mejoraron flujos basados en llaves y obtuvieron una herramienta bien auditada desplegable casi en cualquier lugar.

Con el tiempo esto elevó la línea base de lo que se considera administración segura y dificultó justificar accesos remotos inseguros.

Ingeniería de releases, parcheo y confianza

Crea un cliente móvil

Crea una app móvil en Flutter desde el chat y mantén intencionales los permisos y el acceso a datos.

"Seguro por defecto" no es solo un objetivo de diseño: es una promesa que mantienes cada vez que distribuyes.

La reputación de OpenBSD descansa en gran medida en la ingeniería de releases disciplinada: releases predecibles, cambios cuidadosos y una preferencia por la claridad sobre la ingeniosidad.

Los defaults pueden ser seguros el primer día, pero los usuarios experimentan la seguridad durante meses y años a través de actualizaciones, avisos y de qué tan confiados están aplicando fixes.

Cadencia de parches y avisos claros

La confianza crece cuando las actualizaciones son regulares y la comunicación es concreta. Un buen aviso de seguridad responde cuatro preguntas sin drama: ¿Qué está afectado? ¿Cuál es el impacto? ¿Cómo lo remedio? ¿Cómo puedo verificarlo?

La comunicación al estilo OpenBSD tiende a evitar hablar de severidad de forma ambigua y se centra en detalles accionables—rangos de versiones, referencias de parches y workarounds mínimos.

Las normas de divulgación responsable importan también. Coordinar con los reporteros, fijar plazos claros y acreditar investigadores ayuda a mantener los arreglos ordenados sin convertir cada problema en titular.

Sencillez en herramientas reduce errores en la cadena de suministro

La ingeniería de releases es también gestión de riesgo. Cuanto más complejo es el chain de build y release, más oportunidades hay para firmar mal, publicar artefactos equivocados o depender de dependencias comprometidas.

Una canalización más simple y bien entendida—builds repetibles, pocas piezas móviles, prácticas fuertes de firma y procedencia clara—reduce las probabilidades de enviar lo incorrecto.

Comunicar riesgo sin sensacionalismo

Evita mensajes basados en el miedo. Usa lenguaje claro, define qué significan “remoto”, “local” y “escalada de privilegios”, y sé honesto sobre la incertidumbre. Cuando debas especular, márcalo.

Proporciona un camino "haz esto ahora" (actualiza o aplica parche) y un "haz esto después" (revisión de configuración, monitoreo).

Cuando los procesos de release, parcheo y comunicación son coherentes, los usuarios aprenden a actualizar con rapidez—y ahí es donde los defaults seguros se convierten en confianza duradera.

Cultura: altos estándares, responsabilidad y fricción

La reputación de seguridad de OpenBSD no es solo por mitigaciones ingeniosas: también es por cómo trabaja la gente.

El proyecto normalizó la idea de que la seguridad es una responsabilidad compartida y que "suficiente" por defecto (o parches descuidados) no son aceptables simplemente porque funcionan.

Ingredientes culturales que hacen que la seguridad perdure

Algunos hábitos aparecen con frecuencia en equipos de ingeniería seguros, y OpenBSD los dejó explícitos:

- Altos estándares como base: se espera código legible, conservador y, en el buen sentido, aburrido.

- Retroalimentación directa y propiedad clara: las revisiones se centran en corrección y riesgo, no en preferencias personales.

- Responsabilidad compartida: si algo se envía, es “nuestro” problema—revisores y mantenedores son parte del resultado.

Cuando las opiniones fuertes ayudan—y cuando dañan

Las opiniones firmes pueden mejorar la seguridad evitando la degradación gradual de calidad: los atajos arriesgados se desafían temprano y el razonamiento vago (“debería estar bien”) se trata como bug.

Pero esa misma intensidad también puede reducir contribuciones si la gente no se siente segura para preguntar o proponer cambios. La seguridad se beneficia del escrutinio; el escrutinio requiere participación.

Construir hábitos de revisión sin copiar el estilo interpersonal

Puedes tomar la mecánica de una cultura exigente sin replicar la fricción.

Rituales prácticos que funcionan en la mayoría de organizaciones:

- Gates antes del merge: exige al menos una revisión independiente para áreas sensibles (auth, parsing, crypto, networking).

- Rotaciones de revisión: asigna un “capitán de revisión” semanal para mover colas y repartir conocimiento.

- Checklists ligeros: una lista corta y consistente (validación de entrada, manejo de errores, límites de privilegio, logging) adjunta a cada PR.

- Comentarios de “explica el riesgo”: los revisores piden un párrafo que resuma el riesgo cuando se cambian defaults o fronteras de confianza.

La conclusión: la seguridad no es una característica que añades después. Es un estándar que haces cumplir—repetidamente, visiblemente y con procesos que hacen la opción correcta la más fácil.

Preguntas frecuentes

¿Qué significa realmente “seguro por defecto” al instalar un sistema?

"Seguro por defecto" significa que la configuración inicial, tal como sale de la caja, parte de una base defendible: servicios expuestos al mínimo, permisos conservadores y opciones de protocolo/criptografía más seguras.

Aún puedes relajar restricciones, pero lo haces de forma intencionada: el riesgo queda explícito en lugar de heredarse por accidente.

¿Por qué se consideran las configuraciones por defecto un control de seguridad y no solo una comodidad?

Porque los valores por defecto son el camino que la mayoría de las instalaciones siguen. Si un servicio está habilitado por defecto, muchos sistemas lo ejecutarán durante años—a menudo sin que nadie recuerde que está ahí.

Trata la configuración por defecto como un control de seguridad de alto impacto: determina la superficie de ataque real para la mayoría de las instalaciones.

¿Cómo puedo evaluar rápidamente si las configuraciones por defecto de un sistema son arriesgadas?

Empieza con comprobaciones básicas de exposición:

- Lista puertos/servicios en escucha y confirma que cada uno sea necesario.

- Identifica qué procesos se ejecutan con privilegios elevados.

- Revisa permisos de archivos en rutas sensibles (configuraciones, llaves, logs).

- Busca opciones de “compatibilidad legado” que debiliten la seguridad.

El objetivo es garantizar que nada sea accesible o privilegiado “solo porque vino así”.

¿Cómo es una cultura real de “leer el código” y auditoría?

La auditoría es una revisión sistemática orientada a reducir clases enteras de errores, no solo a arreglar un problema reportado. Actividades comunes de auditoría incluyen:

- Comprobar cómo se parsean y validan entradas no confiables.

- Revisar APIs en busca de valores por defecto inseguros o usos fáciles de equivocarse.

- Simplificar rutas de código para que el comportamiento sea más fácil de razonar.

Es trabajo de ingeniería continuo, no una única "pasada de seguridad".

¿Cómo aplico el principio de menor privilegio sin volver las operaciones dolorosas?

Privilegio mínimo significa que cada servicio (y cada componente dentro de él) obtiene solo los permisos necesarios.

Pasos prácticos:

- Ejecuta servicios con usuarios dedicados sin root.

- Limita el acceso al sistema de archivos a los directorios estrictamente requeridos.

- Usa credenciales de corta duración y roles con permisos acotados.

- Separa las acciones privilegiadas en helpers/herramientas explícitas en lugar de conceder amplios derechos administrativos.

¿Qué es la separación de privilegios y por qué importa en servicios de red?

La separación de privilegios divide un programa expuesto a la red en partes:

- Un proceso no privilegiado maneja parsing e interacción de red.

- Un pequeño ayudante privilegiado y controlado realiza operaciones sensibles.

Si la parte expuesta se compromete, el atacante queda en un proceso con derechos limitados, reduciendo el radio de daño y dificultando la escalada.

¿Cómo ayudan en la práctica las mitigaciones de exploits (W^X, ASLR, protecciones de pila)?

Mitigaciones como W^X, ASLR y protecciones de pila intentan que los bugs de corrupción de memoria sean más difíciles de explotar de forma fiable.

En la práctica:

- Algunos bugs que antes permitían ejecución de código se convierten en crashes.

- Obligan al atacante a encadenar más pasos (por ejemplo, fugas de información).

- Dan tiempo a los defensores para parchear y detectar comportamiento anómalo.

Son defensa en profundidad, no un sustituto de corregir la vulnerabilidad subyacente.

¿Por qué se suele citar a OpenSSH como la contribución de seguridad más influyente de OpenBSD?

OpenSSH se convirtió en la implementación de facto para administración remota, así que su postura de seguridad afecta a una gran parte de Internet.

Operativamente es crítico porque SSH frecuentemente maneja el acceso privilegiado, la automatización del parque y la recuperación de emergencias. Defaults más seguros y cambios conservadores reducen la probabilidad de que el uso normal se convierta en un punto débil a nivel organizacional.

¿Cómo debe ser la ingeniería de releases y la comunicación de parches en seguridad?

La confianza se construye haciendo que las actualizaciones y los avisos sean fáciles de aplicar.

Un proceso práctico de avisos/actualizaciones debe:

- Decir claramente qué está afectado y cómo remediarlo.

- Proveer referencias de versiones/parches y pasos de verificación.

- Mantener la herramienta de release lo suficientemente simple como para reducir errores en artefactos o firmas.

Un parchado coherente más comunicación clara son la forma en que “seguro por defecto” se mantiene con el tiempo.

¿Cómo aplico las lecciones “seguro por defecto” de OpenBSD a Linux, nube y Kubernetes?

Haz que el camino seguro sea el predeterminado y exige revisión para cualquier cosa que aumente la exposición.

Ejemplos:

- Usa imágenes base endurecidas; deshabilita servicios innecesarios por defecto.

- Red de entrada por defecto denegar; seguridad de red mínima abierta.

- Ejecuta cargas como no-root; elimina capacidades innecesarias; usa sistemas de archivos de solo lectura cuando sea posible.

- Trata IAM, reglas de firewall y configuraciones como código con revisión por pares.

Registra excepciones con responsables y fechas de expiración para que el riesgo no se vuelva permanente.