১২ নভে, ২০২৫·8 মিনিট

ননপ্রফিট ল্যাব থেকে এআই নেতা: OpenAI‑র ইতিহাস

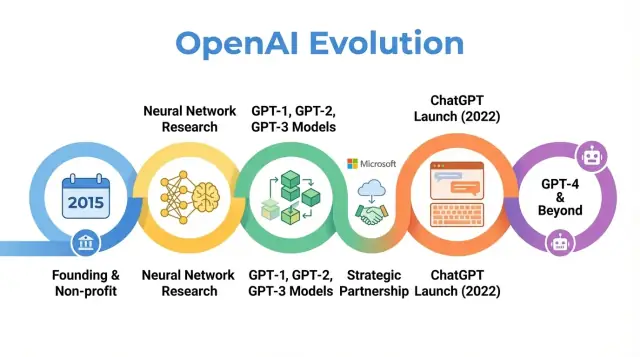

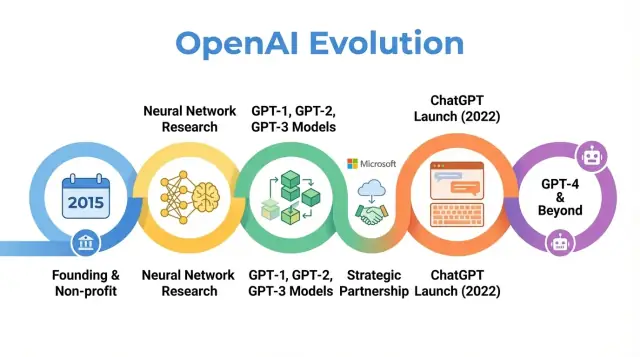

OpenAI‑র ইতিহাস অন্বেষণ করুন: ২০১৫‑এর ননপ্রফিট উৎপত্তি, প্রধান গবেষণা মাইলস্টোনগুলো, ChatGPT‑এর উদ্বোধন, GPT‑4 পর্যন্ত প্রবৃদ্ধি এবং সংস্থাটির বিবর্তিত মিশন।

OpenAI‑র ইতিহাস অন্বেষণ করুন: ২০১৫‑এর ননপ্রফিট উৎপত্তি, প্রধান গবেষণা মাইলস্টোনগুলো, ChatGPT‑এর উদ্বোধন, GPT‑4 পর্যন্ত প্রবৃদ্ধি এবং সংস্থাটির বিবর্তিত মিশন।

OpenAI একটি এআই গবেষণা ও মোতায়েন কোম্পানি, যার কাজটি কৃত্রিম বুদ্ধিমত্তা নিয়ে মানুষের ভাবনাকে প্রভাবিত করেছে—প্রাথমিক গবেষণা পেপার থেকে শুরু করে ChatGPT-এর মতো প্রোডাক্ট। 2015‑এ একটি ছোট ননপ্রফিট ল্যাব থেকে শুরু করে কেন্দ্রীয় এআই খেলোয়াড়ে পরিণত হওয়ার যাত্রাটি বোঝা আধুনিক এআই কীভাবে আজকের রূপ নেয় তার ব্যাখ্যা দেয়।

OpenAI‑র গল্প শুধুই মডেল রিলিজের ক্রম নয়। এটি একটি কেস স্টাডি যে কিভাবে মিশন, প্রোসেকিউটিভস (incentives), প্রযুক্তিগত অগ্রগতি এবং জনচাপ একসাথে কাজ করে। সংস্থাটি প্রাথমিকভাবে ওপেন গবেষণায় জোর দিয়েছিল এবং বিস্তৃত সুবিধা নিশ্চিত করতে চেয়েছিল, পরে তা কাঠামো পরিবর্তন করে পুঁজি আকর্ষণের জন্য, মাইক্রোসফটের সঙ্গে গভীর অংশীদারিত্ব গড়ে তোলে, এবং এমন প্রোডাক্ট চালু করে যা শতকোটি ব্যবহারকারীর কাছে পৌঁছায়।

OpenAI‑র ইতিহাস ট্রেস করলে কয়েকটি বিস্তৃত প্রবণতা পরিষ্কার হয়:

মিশন ও মূল্যবোধ: OpenAI গঠনকালে ঘোষণা করেছিল যে AGI হলে সেটি "মানুষজাতির সর্বজনীন কল্যাণে" ব্যবহার করা হবে। সময়ের সঙ্গে কিভাবে মিশন ব্যাখ্যায় এবং সংশোধন করা হয়েছে তা আদর্শবাদী লক্ষ্য ও বাণিজ্যিক বাস্তবতার মধ্যে টানাপোড়েন তুলে ধরে।

গবেষণার অগ্রগতি: প্রাথমিক প্রকল্প থেকে GPT‑3, GPT‑4, DALL·E ও Codex–এর মতো সিস্টেম পর্যন্ত অগ্রগতি বৃহৎ‑স্কেলের ফাউন্ডেশন মডেলের দিকে শিল্পটিকে স্থানান্তর করে, যা আজকের অনেক এআই অ্যাপ্লিকেশনের চালক।

শাসন ও কাঠামো: বিশুদ্ধ ননপ্রফিট থেকে ক্যাপড‑প্রফিট সত্তা পর্যন্ত রূপান্তর এবং জটিল পরিচালনামূলক প্রক্রিয়া নতুন ধরনের সাংগঠনিক ফর্মগুলোকে তুলে ধরে, যা শক্তিশালী প্রযুক্তি নিয়ন্ত্রণের চেষ্টা করে।

সর্বজনীন প্রভাব ও নজর: ChatGPT ও অন্যান্য রিলিজের মাধ্যমে OpenAI একটি গবেষণা ল্যাব থেকে সাধারণ মানুষের কাছে পরিচিত নাম হয়ে ওঠে, এবং নিরাপত্তা, অ্যালাইনমেন্ট ও নিয়ন্ত্রণ নিয়ে বিতর্কগুলো নীতিনির্ধারণকে প্রভাবিত করে।

এই নিবন্ধটি OpenAI‑র 2015 থেকে সাম্প্রতিক উন্নয়নের জার্নি অনুসরণ করে, দেখায় প্রতিটি ধাপ কিভাবে AI গবেষণা, অর্থনীতি ও শাসনের বিস্তৃত পরিবর্তনগুলোর প্রতিফলন এবং এ থেকে ভবিষ্যৎ ক্ষেত্রে কী শিখা যেতে পারে।

OpenAI ডিসেম্বর 2015‑এ প্রতিষ্ঠিত হয়েছিল, সেই সময় মেশিন লার্নিং—বিশেষত ডিপ লার্নিং—দ্রুত উন্নতি করছিল কিন্তু এখনও সাধারণ বুদ্ধিমত্তার কাছাকাছি ছিল না। ইমেজ রিকগনিশনে বেঞ্চমার্ক পড়ছিল, স্পিচ সিস্টেম উন্নত হচ্ছিল, এবং Google, Facebook, Baidu মতো কোম্পানিগুলো এআইতে প্রচুর বিনিয়োগ করছিল।

গবেষক ও প্রযুক্তি নেতাদের মধ্যে বাড়তে থাকা উদ্বেগ ছিল যে উন্নত এআই কয়েকটি শক্তিশালী কর্পোরেশন বা সরকারের নিয়ন্ত্রণে চলে যেতে পারে। OpenAI‑কে একটি প্রতিপক্ষ হিসেবে কল্পনা করা হয়েছিল: একটি গবেষণা প্রতিষ্ঠান যা দীর্ঘমেয়াদি নিরাপত্তা ও এআই‑এর সুবিধার বিস্তারে মনোযোগ দেবে, সরু বাণিজ্যিক সুবিধার চেয়ে।

প্রতিষ্ঠন থেকেই OpenAI‑র মিশন কৃত্রিম সাধারণ বুদ্ধিমত্তা (AGI)‑কে ঘিরে নির্ধারিত ছিল, শুধুমাত্র ধাপে ধাপে মেশিন লার্নিং অগ্রগতি নয়। মূল বক্তব্য ছিল—OpenAI যদি AGI তৈরি করে, তা "মানুষজাতির সর্বজনীন কল্যাণে" কাজে লাগবে।

এই মিশনের কিছু বাস্তব অর্থ ছিল:

প্রাথমিক ব্লগ পোস্ট ও প্রতিষ্ঠাতার চার্টারও ওপেননেস ও সতর্কতার উপর জোর দিয়েছিল: অনেক কাজ প্রকাশ করা হবে, কিন্তু শক্তিশালী সক্ষমতা উন্মোচনের সামাজিক প্রভাব বিবেচনা করেই সিদ্ধান্ত নেওয়া হবে।

OpenAI একটি ননপ্রফিট গবেষণা ল্যাব হিসেবে শুরু হয়। প্রাথমিক তহবিল অঙ্গীকার প্রায় $1 বিলিয়ন হিসেবে ঘোষণা করা হয়েছিল, যদিও তা এককালীন নগদ নয়, বরং দীর্ঘমেয়াদী প্রতিশ্রুতি ছিল। প্রধান প্রাথমিক সমর্থকদের মধ্যে ছিলেন Elon Musk, Sam Altman, Reid Hoffman, Peter Thiel, Jessica Livingston এবং YC Research, সঙ্গে Amazon Web Services ও Infosys-এর মতো কোম্পানির সহায়তা।

প্রাথমিক নেতৃত্বে স্টার্টআপ, গবেষণা ও অপারেশনাল অভিজ্ঞতার মিশ্রণ ছিল:

এই সিলিকন ভ্যালি উদ্যোগ ও শীর্ষস্থানীয় এআই গবেষণার মিশেল OpenAI‑র প্রাথমিক সংস্কৃতিকে আকার দেয়: এআই সক্ষমতায় উচ্চাভিলাষী, কিন্তু স্বল্পকালীন বাণিজ্যিকীকরণ নয়, বরঞ্চ দীর্ঘমেয়াদী বৈশ্বিক প্রভাবকে কেন্দ্র করে সংগঠিত।

2015‑এ OpenAI যখন একটি ননপ্রফিট ল্যাব হিসেবে শুরু করে, তখন এটি একটি সহজ কিন্তু উচ্চাভিলাষী প্রতিশ্রুতি করেছিল: যতটা সম্ভব ভাগ করে নিয়ে কৃত্রিম বুদ্ধিমত্তার উন্নতি করা।

প্রারম্ভিক বছরগুলোকে সংজ্ঞায়িত করেছিল "ডিফল্টভাবে ওপেন" দার্শনিকতা। গবেষণা পেপার দ্রুত পোস্ট করা হতো, কোড সাধারণত মুক্তি করা হতো, এবং অভ্যন্তরীণ টুলগুলো পাবলিক প্রজেক্টে পরিণত হতো। ধারণা ছিল—বৈজ্ঞানিক অগ্রগতি ও তদনুযায়ী সমালোচনা ত্বরান্বিত করা একক কোম্পানিতে ক্ষমতা কেন্দ্রীভূত করার চেয়ে নিরাপদ ও উপকারী।

একই সময়ে নিরাপত্তা কথোপকথনের অংশ ছিল। দলটি কখন ওপেননেস অপব্যবহারের ঝুঁকি বাড়ায় তা নিয়ে আলোচনা করত এবং স্তরভিত্তিক মুক্তি ও পলিসি রিভিউয়ের ধারণা চিহ্নিত করেছিল, যদিও পরে যে শাসনপ্রকਿਰ্যাগুলো গড়ে উঠেছে সেগুলো তখনো অপেক্ষাকৃত অনানুষ্ঠানিক ছিল।

OpenAI‑র প্রাথমিক বৈজ্ঞানিক ফোকাস ছিল কয়েকটি কেন্দ্রীয় এলাকা জুড়ে:

এই প্রকল্পগুলো সুন্দর পণ্য তৈরির চাইতে কী সম্ভব তা পরীক্ষা করার বিষয়ে বেশি ছিল: ডিপ লার্নিং, কম্পিউট ও চতুর প্রশিক্ষণ নিয়মগুলোর ক্ষমতা যাচাই করা।

এই যুগের সবচেয়ে প্রভাবশালী আউটপুটগুলোর মধ্যে ছিল OpenAI Gym ও Universe।

উভয় প্রজেক্টই ভাগ করা ইনফ্রাস্ট্রাকচারের প্রতি প্রতিশ্রুতি প্রতিফলিত করেছিল, ব্যক্তিগত সুবিধার বদলে।

এই ননপ্রফিট সময়ে OpenAI‑কে প্রায়শই বৃহৎ টেক ফার্মগুলোর AI ল্যাবগুলোর বিরুদ্ধে মিশন‑চালিত একটি প্রতিপক্ষ হিসেবে দেখা হত। সহকর্মীরা তার গবেষণার মান, কোড ও পরিবেশের অ্যাক্সেসিবিলিটি, এবং নিরাপত্তা আলোচনায় নিযুক্ত থাকার ইচ্ছাকে মূল্যায়ন করত।

মিডিয়া কভারেজ উচ্চ‑প্রোফাইল তহবিলদাতা, অ-বাণিজ্যিক কাঠামো এবং খোলামেলা প্রকাশের প্রতিশ্রুতিকে গুরুত্বিয়ে করেছিল। এই খ্যাতি—একটি প্রভাবশালী, ওপেন গবেষণা ল্যাব যার দীর্ঘমেয়াদী পরিণতি নিয়ে উদ্বিগ্ন—ভবিষ্যৎ কৌশলগত পরিবর্তনে প্রতিক্রিয়াগুলোকে আকার দেয়।

OpenAI‑র ইতিহাসে গুরুত্বপূর্ণ মোড় ছিল বড় ট্রান্সফর্মার‑ভিত্তিক ভাষা মডেলগুলোর দিকে মনোযোগ কেন্দ্রীভূত করা। এই বদল OpenAI‑কে একটি প্রধান ফাউন্ডেশন মডেল প্রদানকারী কোম্পানিতে পরিণত করে, যাদের উপর অন্যরা তৈরি করে।

GPT‑1 পরবর্তীর তুলনায় ছোট ছিল—117 মিলিয়ন প্যারামিটার, BookCorpus‑এ ট্রেন—কিন্তু এটি একটি গুরুত্বপূর্ণ প্রমাণ ছিল।

অलग‑অলগ NLP টাস্কের জন্য পৃথক মডেল ট্রেন করার বদলে GPT‑1 দেখিয়েছিল যে একটি একক ট্রান্সফর্মার মডেল, সহজ উদ্দেশ্যে (পরবর্তী শব্দ পূর্বানুমান) ট্রেন করে, কয়েকটি উদাহরণ দিয়ে সামান্য ফাইন‑টিউনিং করে বিভিন্ন টাস্কে মানিয়ে নেওয়া যায়।

OpenAI‑র অভ্যন্তরীণ রোডম্যাপের জন্য GPT‑1 তিনটি ধারণা বৈধ করেছিল:

GPT‑2 একই মূল রেসিপি অনেকটাই সামনে নিয়ে গিয়েছিল: 1.5 বিলিয়ন প্যারামিটার ও অনেক বড় ওয়েব‑সংকলিত ডেটাসেট। এর আউটপুট প্রায়শই আশ্চর্যজনকভাবে সঙ্গতিপূর্ণ: বহু‑প্যারাগ্রাফ নিবন্ধ, কাল্পনিক গল্প এবং সারাংশ‑যা প্রথম দৃষ্টিতে মানুষের লেখা মনে হত।

এই সক্ষমতাগুলো স্বয়ংক্রিয় প্রচার, স্প্যাম, হয়রানি এবং ভুয়ো সংবাদ প্রচারের বিষয়ে সতর্কতা বাড়িয়েছিল। সম্পূর্ণ মডেলটি তৎক্ষণাৎ মুক্তি না দিয়ে OpenAI একটি স্তরভিত্তিক মুক্তি কৌশল গ্রহণ করেছিল:

এটি OpenAI‑এর প্রথম বড় উদাহরণ ছিল যেখানে মোতায়েন সিদ্ধান্তগুলোকে নিরাপত্তা ও সামাজিক প্রভাবের সঙ্গে স্পষ্টভাবে যুক্ত করা হয়।

GPT‑3 আবার বড় পরিসরে—এবার 175 বিলিয়ন প্যারামিটার। এটি মূলত প্রতিটি টাস্কের জন্য ফাইন‑টিউনিংয়ের উপর নির্ভর না করে "few‑shot" ও এমনকি "zero‑shot" শেখার প্রদর্শন করেছিল: প্রম্পটে নির্দেশনা ও কয়েকটি উদাহরণ দিলেই মডেল প্রায়ই নতুন টাস্ক সম্পাদন করতে পারত।

এই স্তরের সার্বজনীনতা OpenAI ও বিস্তৃত শিল্পকে এআই সিস্টেম সম্পর্কে ভাবার ধরণ বদলে দিল। অনেক সঙ্কীর্ণ মডেল তৈরির বদলে, একটি বড় মডেল সাধারণ উদ্দেশ্য ইঞ্জিন হিসেবে কাজ করতে পারে:

তিসত্বেও, OpenAI GPT‑3‑কে ওপেন‑সোর্স করেনি। অ্যাক্সেস একটি বাণিজ্যিক API‑র মাধ্যমে অফার করা হয়েছিল। এই সিদ্ধান্ত ছিল একটি কৌশলগত মোড়:

GPT‑1, GPT‑2 ও GPT‑3 OpenAI‑র ইতিহাসে একটি স্পষ্ট ধারা দেখায়: ট্রান্সফর্মার‑স্কেল বৃদ্ধি, উদ্ভুত সক্ষমতার আবিষ্কার, নিরাপত্তা ও অপব্যবহারের সঙ্গে খেলা, এবং ChatGPT ও পরবর্তী GPT‑4‑এর মতো পণ্যগুলোর বাণিজ্যিক ভিত্তি তৈরি করা।

২০১8‑এর মধ্যেই OpenAI‑র নেতৃত্বরা বিশ্বাস করেছিল যে ছোট, দান‑ভিত্তিক ল্যাব হিসেবে থাকা সীমিত থাকবে, এবং খুব বড় AI সিস্টেম গড়ে তোলা ও নিরাপদভাবে পরিচালনা করার জন্য পর্যাপ্ত নয়। ফ্রন্টিয়ার মডেল ট্রেনিং ইতিমধ্যেই কোটি কোটি ডলারের কম্পিউট এবং প্রতিভা দাবি করছিল, এবং কস্ট কর্ব আরও বাড়ার দিকে ইঙ্গিত করছিল। শীর্ষ গবেষক আকর্ষণ, স্কেল পরীক্ষা ও ক্লাউড অবকাঠামোর দীর্ঘমেয়াদী অ্যাক্সেস নিশ্চিত করতে OpenAI‑কে এমন একটি কাঠামো প্রয়োজন পড়েছিল যা বড় বিনিয়োগ আকর্ষণ করতে পারে, অথচ মূল মিশন ত্যাগ করে না।

২০১৯‑এ OpenAI একটি নতুন "ক্যাপড‑প্রফিট" সীমিত পার্টনারশিপ চালু করে—OpenAI LP। লক্ষ্য ছিল বড় বাহ্যিক বিনিয়োগ আনলক করা, একই সঙ্গে ননপ্রফিটের মিশন—AGI যাতে সার্বজনীনভাবে মানবজাতির কল্যাণে ব্যবহৃত হয়—ফিরে দেখার শীর্ষে রাখা।

পরিবর্তিত ভেঞ্চার‑ব্যাকড স্টার্টআপগুলো মূলত শেয়ারহোল্ডারদের অনন্ত রিটার্নের দিকে বিবেচিত হয়; OpenAI‑র প্রতিষ্ঠাতারা উদ্বিগ্ন ছিলেন যে তা হলে নিরাপত্তা, ওপেননেস বা সতর্ক মোতায়েনের চেয়ে লাভ বাড়ানোর চাপ বাড়বে। LP কাঠামো একটি আপস: এটি ইক্যুইটি‑সদৃশ অংশ ইস্যু করে বড় অবধি তহবিল তুলতে পারে, কিন্তু আলাদা নিয়মের অধীনে।

ক্যাপড‑প্রফিট মডেলে, বিনিয়োগকারী ও কর্মচারীরা তাদের বিনিয়োগের উপর রিটার্ন পেতে পারে, কিন্তু একটি নির্দিষ্ট গুণগত সীমার মধ্যে (প্রাথমিক বিনিয়োগকারীদের জন্য প্রায় 100x পর্যন্ত উদাহরণস্বরূপ উল্লিখিত হয়েছে, পরে ট্র্যাঞ্চে নিম্নতর ক্যাপ থাকতে পারে)। সেই ক্যাপ ছাড়িয়ে গেলে অতিরিক্ত তৈরি হওয়া মূল্য ননপ্রফিট প্যারেন্টের দিকে প্রবাহিত হওয়ার কথা, যা তার মিশন অনুযায়ী ব্যবহার করা হবে।

এটি প্রচলিত স্টার্টআপের থেকে ভিন্ন, যেখানে ইক্যুইটির মূল্য তাত্ত্বিকভাবে সীমাহীনভাবে বাড়তে পারে এবং শেয়ারহোল্ডার ভ্যালু সর্বোচ্চ করা আইনি ও সাংস্কৃতিক ডিফল্ট মোড।

OpenAI ননপ্রফিট নিয়ন্ত্রণকারী সত্বা হিসেবে রয়ে যায়। এর বোর্ড OpenAI LP‑কে তদারকি করে এবং মিশন‑মুখী সিদ্ধান্তকে অন্যান্য বিনিয়োগকারী বা কর্মচারীর আগেই রাখার জন্য চার্টারকৃত।

ফর্মালি:

এই শাসন নকশা OpenAI‑কে বাণিজ্যিক সংস্থার তহবিল ও নিয়োগের নমনীয়তা দেয়ার চেষ্টা করে, তবু আনুষ্ঠানিকভাবে ননপ্রফিট উত্সের দিকে নিয়ন্ত্রণ রাখে।

পুনর্গঠনটি সংগঠনের ভিতরে ও বাইরে বিতর্ক উসকে দিয়েছিল। সমর্থকরা বলেছিলেন এটি কাটা‑হটি করে frontier AI গবেষণা অর্থায়নের একমাত্র বাস্তব উপায়, একই সঙ্গে লাভ‑প্রেরণা বিরুদ্ধে কিছু বাঁধা রেখে দেয়। সমালোচকরা প্রশ্ন তুলেছিলেন যে কোনো কাঠামোই বড় রিটার্ন অফার করলে বাণিজ্যিক চাপকে প্রকৃতপক্ষে প্রতিহত করতে পারে কি না, এবং ক্যাপ যথেষ্ট বা সঠিকভাবে প্রয়োগ হচ্ছে কি না।

প্রায়োগিকভাবে, OpenAI LP বড় কৌশলগত বিনিয়োগের দরজা খুলে দেয়—বিশেষ করে Microsoft‑এর মত—এবং প্রতিযোগিতামূলক ক্ষতিপূরণ প্যাকেজ দেয়ার ক্ষমতা বাড়ায়। ফলে OpenAI গবেষণা দলগুলো বাড়াতে, GPT‑3 ও GPT‑4‑র মতো মডেলের ট্রেনিং বাড়াতে এবং ChatGPT‑এর মতো সিস্টেম গ্লোবাল স্কেলে ডিপ্লয় করতে প্রয়োজনীয় অবকাঠামো তৈরিতে সক্ষম হয়—এবং সবকিছুর উপরে আনুষ্ঠানিকভাবেই ননপ্রফিটে নিয়ন্ত্রণ রাখা হয়।

২০১৯‑এ OpenAI ও Microsoft একটি বহু-বছরের অংশীদারিত্ব ঘোষণা করে, যা উভয় কোম্পানির AI‑এ ভূমিকা পুনর্গঠন করে। Microsoft প্রায় $1 বিলিয়ন বিনিয়োগ করেছিল বলে রিপোর্টড—নগদ ও Azure ক্লাউড ক্রেডিট মিলিয়ে—বদলে OpenAI‑কে প্রাধান্যপ্রাপ্ত ব্যবসায়িক অংশীদার হিসেবে করে তোলে।

চুক্তি OpenAI‑র জন্য বিশাল স্কেল রিসোর্সের প্রয়োজনীয়তা মিটিয়েছে, এবং Microsoft‑কে কাটিং‑এজ AI পেতে সাহায্য করেছে যা তার প্রোডাক্ট ও ক্লাউড প্ল্যাটফর্মকে আলাদা করতে পারে। পরবর্তী বছরগুলোতে সম্পর্কটি আরও গভীর হয়—আরও অর্থায়ন ও প্রযুক্তিগত সহযোগিতার মাধ্যমে।

OpenAI কয়েকটি কারণে Microsoft Azure‑কে তার প্রধান ক্লাউড প্ল্যাটফর্ম হিসেবে বেছে নেয়:

এটি GPT‑3, Codex, এবং পরে GPT‑4‑এর মতো মডেল ট্রেন ও সার্ভ করার ডিফল্ট পরিবেশ করে তোলে।

ভাগীদারিত্বটি বিশ্বের অন্যতম বৃহৎ এআই সুপারকম্পিউটিং সিস্টেম তৈরি করে, যা OpenAI‑র ওয়ার্কলোডের জন্য Azure‑এ নির্মিত। Microsoft এই ক্লাস্টারগুলোকে Azure‑এর AI সক্ষমতার ফ্ল্যাগশিপ উদাহরণ হিসেবে তুলে ধরে, আর OpenAI এগুলোর ওপর নির্ভর করে মডেল সাইজ, ট্রেনিং ডেটা ও পরীক্ষার গতি বাড়াতে পেরে।

এটি গ্রাহক ও অংশীদারের মধ্যকার সীমানা ঝাপসা করে দেয়: OpenAI কার্যত Azure‑এর AI রোডম্যাপে প্রভাব ফেলেছে, এবং Azure OpenAI‑র চাহিদা অনুযায়ী টিউন করা হয়েছে।

Microsoft‑কে কিছু OpenAI প্রযুক্তির অনন্য লাইসেন্সিং অধিকার দেওয়া হয়েছে, বিশেষ করে GPT‑3‑এর মতো প্রযুক্তির ক্ষেত্রে। এর ফলে Microsoft OpenAI মডেলগুলো Bing, Office, GitHub Copilot, Azure OpenAI Service‑এ এম্বেড করতে পারে, অন্য কোম্পানিরা OpenAI‑র নিজস্ব API‑র মাধ্যমে অ্যাক্সেস পায়।

এই একচেটিয়া অধিকার নিয়ে বিতর্কও জন্মায়: সমর্থকরা বলেছিলেন যে এটি নিরাপদভাবে স্কেল করার জন্য অর্থায়ন ও বিতরণ নিশ্চিত করে; সমালোচকরা এটাকে frontier মডেলগুলোর ওপর একটি বড় প্রযুক্তি কোম্পানির প্রভাব কেন্দ্রীভূত করার দিকে ইঙ্গিত করে দেখেছেন।

একই সময়ে, অংশীদারিত্ব OpenAI‑কে প্রধানধারার দৃশ্যমানতা দিয়েছিল। Microsoft‑এর ব্র্যান্ডিং, প্রোডাক্ট ইন্টিগ্রেশন ও এন্টারপ্রাইজ সেলস চ্যানেলগুলো OpenAI সিস্টেমগুলোকে গবেষণামূলক ডেমো থেকে প্রতিদিন ব্যবহার্য টুলে রূপান্তর করতে সাহায্য করেছে, ফলে জনসাধারণে OpenAI‑কে স্বাধীন ল্যাব ও Microsoft‑এর মূল AI অংশীদার—উভয় হিসাবে দেখা শুরু করে।

OpenAI‑র মডেলগুলো ভাষা বোঝা ও জেনারেট করতে উন্নত হওয়ার সঙ্গে সঙ্গে, দলটি নতুন মোডালিটিতে—ইমেজ ও কোড—প্রবেশ করে। এই বিস্তৃতিকরণ OpenAI‑র কাজকে লেখা ও কথোপকথনের বাইরে শিল্প ও সফটওয়্যার উন্নয়নের দিকে বিস্তৃত করে।

CLIP (Contrastive Language–Image Pretraining), ২০২১‑এর শুরুতে ঘোষিত, এমন মডেলের বড় ধাপ ছিল যেগুলো মানুষের মত জগতকে আরও সামগ্রিকভাবে বুঝতে পারে।

লেবেল করা ইমেজ নয়, বরং ওয়েব থেকে সংগ্রহীত সঙ্খ ত মিলিয়ন ইমেজ–ক্যাপশন জোড়া থেকে CLIP শিখেছিল। এটি ইমেজকে সবচেয়ে সম্ভাব্য টেক্সট বর্ণনায় মিলিয়ে প্রশিক্ষিত হয় এবং ভুল বর্ণনা থেকে পৃথক করতে শিখে।

এর ফলে CLIP‑এর অপ্রত্যাশিতভাবে সাধারণ ক্ষমতাগুলি দেখতে পাওয়া যায়:

CLIP পরে জেনারেটিভ ইমেজ কাজের ভিত্তি তৈরি করে।

DALL·E (2021) GPT‑স্টাইল আর্কিটেকচারকে ছবিতে প্রয়োগ করে, টেক্সট প্রম্পট থেকে সরাসরি ছবি জেনারেট করেছিল: “অ্যাভোকাডোর আকারের আর্মচেয়ার” বা “একটি দোকানের সাইন যা বলে ‘openai’” ইত্যাদি। এটি দেখিয়েছিল ভাষা মডেল কীভাবে বিস্তীর্ণ, প্রায় কল্পকাহিনীধর্মী ইমেজ তৈরি করতে পারে।

DALL·E 2 (2022) রেজোলিউশন, বাস্তবসম্মততা ও নিয়ন্ত্রণযোগ্যতায় বড় উন্নতি এনে দেয়। এতে বৈশিষ্ট্যগুলো যোগ হয় যেমন:

এই সিস্টেমগুলো ডিজাইনার, মার্কেটার, শিল্পী ও শখের মানুষেরা দ্বারা আইডিয়া প্রোটোটাইপ করতে পরিবর্তন আনে—কিছু সৃজনশীল কাজ ম্যানুয়াল ড্রাফ্টিং থেকে প্রম্প্ট‑চালিত আবর্তনশীল অনুসন্ধানে সরে যায়।

Codex (2021) GPT‑3 পরিবারের একটি অনুকরণ এবং এটি সোর্স কোডে অভিযোজিত—বড় পাবলিক কোডবেস থেকে প্রশিক্ষিত। এটি পাইথন, জাভাস্ক্রিপ্টসহ বহু ভাষায় কার্যকর কোড স্নিপেট তৈরি করতে পারে।

GitHub Copilot, Codex‑এর উপর ভিত্তি করে, প্রতিদিনের ডেভেলপমেন্ট টুলে এটি নিয়ে আসে। প্রোগ্রামাররা সম্পূর্ণ ফাংশন, টেস্ট এবং বয়লারপ্লেট সুপারিশভাবে পেতে শুরু করে, প্রাকৃতিক‑ভাষার কমেন্টকে নির্দেশনা হিসেবে ব্যবহার করে।

সফটওয়্যার ডেভেলপমেন্টের জন্য Codex একটি ধীর পরিবর্তনের ইঙ্গিত দেয়:

CLIP, DALL·E ও Codex একত্রে দেখায় OpenAI‑র ধরণ শুধু টেক্সটেই সীমাবদ্ধ নয়—এটি ভিশন ও কোডে বিস্তৃত, যা শিল্প, ডিজাইন ও ইঞ্জিনিয়ারিংয়ে গবেষণার প্রভাব বাড়ায়।

OpenAI ChatGPT‑কে একটি বিনামূল্যের "গবেষণা প্রিভিউ" হিসেবে 30 নভেম্বর 2022‑এ চালু করে, যা ছোট ব্লগ পোস্ট ও টুইটের মাধ্যমে ঘোষণা করা হয়—বড় প্রোডাক্ট ক্যাম্পেইন নয়। মডেলটি GPT‑3.5‑ভিত্তিক এবং কথোপকথ্যের জন্য অপ্টিমাইজড ছিল, এবং কিছু ক্ষতিকর বা অনিরাপদ অনুরোধ প্রত্যাখ্যান করার গার্ডরেইল ছিল।

ব্যবহার প্রাথমিকেই দ্রুত বৃদ্ধি পায়। কয়েক দিনের মধ্যে লক্ষাধিক মানুষ সাইন আপ করে, এবং ChatGPT হয়ে ওঠে সবচেয়ে দ্রুত গ্রোথ হওয়া কনজিউমার অ্যাপ্লিকেশনগুলোর মধ্যে একটি। কথোপকথনের স্ক্রিনশট সামাজিক মিডিয়ায় ছড়িয়ে পড়ে, যেখানে ব্যবহারকারীরা রচনা লেখা, কোড ডিবাগ করা, ইমেইল খসড়া করা এবং জটিল বিষয় সরল ভাষায় ব্যাখ্যা করানোর ক্ষমতা পরীক্ষা করছিল।

ChatGPT‑র আকর্ষণ একক বিস্তৃত ব্যবহারের কারণে—কোনো এক নির্দিষ্ট ব্যবহারকেস নয়।

শিক্ষায় ছাত্ররা পড়া সারাংশ করা, অনুশীলন প্রশ্ন তৈরি করা, একাডেমিক আর্টিকেল অনুবাদ বা সহজ করা এবং গণিত/বিজ্ঞান সমস্যার ধাপে‑ধাপে ব্যাখ্যা পাওয়ার জন্য ব্যবহার করেছে। শিক্ষকরা সিলেবাস ডিজাইন, রুব্রিক খসড়া ও ভিন্ন স্তরের শিক্ষার উপকরণ তৈরিতে পরীক্ষা করে, যদিও অনেক স্কুলে এটি অনুমোদন বা দ্বন্দ্বের বিষয় হয়ে ওঠে।

কাজে পেশাজীবীরা ChatGPT‑কে ইমেইল, মার্কেটিং কপি ও রিপোর্ট খসড়া করা, প্রেজেন্টেশন আউটলাইন তৈরি করা, কোড স্নিপেট ও টেস্ট কেস লেখা এবং আইডিয়াবাজি সঙ্গী হিসেবে ব্যবহার করেছে। ফ্রিল্যান্সার ও ছোট ব্যবসাগুলো বিশেষ করে এটি নিম্ন‑খরচের সহকারী হিসেবে কাজে লাগিয়েছে।

দৈনন্দিন সমস্যার সমাধানে মানুষ ChatGPT‑কে ভ্রমণ পরিকল্পনা, রেডিঙে থাকা উপকরণ থেকে রান্নার আইডিয়া, মৌলিক আইনগত ও চিকিৎসা ব্যাখ্যা (সাধারণত পেশাদার পরামর্শ নেওয়ার সতর্কতা সহ) এবং নতুন দক্ষতা শেখার সহায়ক হিসেবে ব্যবহার করেছে।

প্রাথমিক রিসার্চ প্রিভিউটা বিনামূল্যে রাখা হয়েছিল—ত্রুটি, অপব্যবহার ও সক্ষমতাগত ফাঁক সম্পর্কে প্রতিক্রিয়া সংগ্রহ করতে। ব্যবহার বাড়ার সঙ্গে সাথে OpenAI উচ্চ অবকাঠামো খরচ ও নির্ভরযোগ্য অ্যাক্সেসের চাহিদার সম্মুখীন হয়।

ফেব্রুয়ারি 2023‑এ OpenAI ChatGPT Plus নামে একটি সাবস্ক্রিপশন চালু করে, যা দ্রুত প্রতিক্রিয়া, শিখরের সময়ে অগ্রাধিকার অ্যাক্সেস এবং GPT‑4‑এর মতো নতুন মডেল ও বৈশিষ্ট্যে প্রাথমিক অ্যাক্সেস দেয়। এটি পুনরাবৃত্ত রাজস্ব স্রোত তৈরি করে, একই সঙ্গে বিস্তৃত অ্যাক্সেসের জন্য একটি ফ্রি টিয়ার রাখে।

ধীরে ধীরে OpenAI ব্যবসায়ী মনোভাব নিয়েও এসেছে: কনভার্সেশনাল মডেলে API অ্যাক্সেস, প্রোডাক্ট ও ওয়ার্কফ্লোতে একীভূত করার টুলস, এবং ChatGPT Enterprise ও টিম প্ল্যানের মতো অফার—যারা উচ্চতর নিরাপত্তা, প্রশাসনিক নিয়ন্ত্রণ ও সম্মতি বৈশিষ্ট্য চাই।

ChatGPT‑এর তীব্র দৃশ্যমানতা দীর্ঘদিনের AI বিতর্কগুলোকে তীব্র করে তোলে।

নিয়ন্ত্রক ও নীতিনির্ধারকরা গোপনীয়তা, ডেটা সুরক্ষা ও বিদ্যমান আইন মেনে চলার বিষয়ে উদ্বিগ্ন ছিলেন—বিশেষত ইউরোপীয় ইউনিয়নের মতো অঞ্চলে। কিছু কর্তৃপক্ষ ChatGPT‑কে সাময়িকভাবে সীমাবদ্ধ বা তদন্ত করে দেখেছে যে ডেটা সংগ্রহ ও প্রক্রিয়াকরণ আইনগত মানদণ্ড পূরণ করে কিনা।

শিক্ষাবিদরা প্ল্যাজারিজম ও একাডেমিক সততার বিষয়ে দ্বিধায় পড়ে—ছাত্ররা সহজেই এমন রচনাপত্র বা হোমওয়ার্ক তৈরি করতে পারে যা শনাক্ত করা কঠিন। ফলে কিছু স্কুলে ব্যবহার নিষিদ্ধ করা হয়েছে বা কঠোর নীতি প্রয়োগ করা হয়েছে, অন্যরা অ্যাসাইনমেন্ট এমনভাবে ডিজাইন করেছে যাতে প্রক্রিয়া, মৌখিক পরীক্ষা বা ইন‑ক্লাস কাজকে বেশি গুরুত্ব দেওয়া হয়।

নেতিবাদী ও গবেষকরা মিথ্যাবাদ, সিদ্ধান্তে অতিরিক্ত নির্ভরতা, প্রতিক্রিয়ার পক্ষপাত এবং এমন পেশায় প্রভাব নিয়ে উদ্বিগ্ন হয়েছেন যা সৃজনশীল ও জ্ঞানোদ্ধৃত কাজ করে। ট্রেনিং ডেটা, কপিরাইট ও শিল্পী ও লেখকদের অধিকার সম্পর্কিত প্রশ্নও উঠেছে যাঁদের কাজ মডেল আচরণকে প্রভাবিত করতে পারে।

OpenAI‑র জন্য ChatGPT একটি মোড়: এটি সংস্থাটিকে গবেষণা‑কেন্দ্রিক ল্যাব থেকে এমন একটি কোম্পানিতে পরিণত করে দিয়েছে যা শক্তিশালী ভাষা মডেল পরিচালনা, শাসন এবং একীভূত করার বিষয়ে গ্লোবাল আলোচনার কেন্দ্রে রয়ে গেছে।

OpenAI মার্চ 2023‑এ GPT‑4 চালু করে—GPT‑3.5‑এর চেয়ে গুরুত্বপূর্ণ উন্নতি; GPT‑3.5 ছিল ChatGPT‑এর প্রাথমিক শক্তি। GPT‑4 যুক্তি, জটিল নির্দেশনা অনুসরণ এবং দীর্ঘ কথোপকথনে সামঞ্জস্য বজায় রাখতে উন্নত। এটি কোর্ট ক্লজ ব্যাখ্যা করা, প্রযুক্তিগত পেপার সারাংশ করা বা অস্পষ্ট চাহিদা থেকে কোড লেখা—এসব নজিরে আরও সাবলীলতা দেখিয়েছে।

GPT‑3.5‑এর তুলনায় GPT‑4 অনেক সাধারণ ব্যর্থতা মোড কমিয়েছে: উদ্ধৃতি চাইলে উৎস উদ্ভাবনা করার প্রবণতা কম, গাণিতিক ও যুক্তি সমস্যায় প্রান্তিক কেসগুলো ভালভাবে সামলায়, এবং পুনরাবৃত্ত প্রশ্নে বেশি ধারাবাহিক আউটপুট দেয়।

GPT‑4 মাল্টিমোডাল সক্ষমতা উপস্থাপন করে: কিছু কনফিগারেশনে পাঠ্য ছাড়াও ছবি ইনপুট হিসাবে গ্রহণ করতে পারে। এর ফলে চার্ট বর্ণনা করা, হাতলিখিত নোট পড়া, UI স্ক্রিনশট বিশ্লেষণ বা ছবি থেকে কাঠামোগত তথ্য নিষ্কাশন সম্ভব।

স্ট্যান্ডার্ডাইজড বেঞ্চমার্কে GPT‑4 পূর্বের মডেল অপেক্ষা উল্লেখযোগ্যভাবে ভালো করেছে। বার পরীক্ষা, SAT ও বিভিন্ন অ্যাডভান্স প্লেসমেন্ট পরীক্ষার মতো সিমুলেটেড পেশাদার পরীক্ষায় এটি প্রায় শীর্ষ‑পারসেন্টাইল স্কোর অর্জন করেছে। কোডিং ও যুক্তি বেঞ্চমার্কেও উন্নতি দেখা গেছে, যা ভাষা বোঝা ও সমস্যার সমাধানের ক্ষমতা দুটোই বাড়িয়েছে।

GPT‑4 দ্রুত OpenAI‑র API‑র মেরুদন্ড হয়ে ওঠে এবং তৃতীয় পক্ষের পণ্যে একটি নতুন তরঙ্গ চালায়: প্রোডাক্টিভিটি স্যুটে AI কপাইলট, কডিং সহায়ক, কাস্টমার সাপোর্ট টুল, শিক্ষা প্ল্যাটফর্ম এবং আইন, ফাইনান্স ও হেলথকেয়ারের মতো ভাটাতে নির্দিষ্ট অ্যাপ্লিকেশন।

এই অগ্রগতির পরও GPT‑4 হ্যালুসিনেট করে, অনুপ্রবেশে প্ররোচিত হলে অনিরাপদ বা পক্ষপাতপূর্ন আউটপুট দিতে পারে, এবং সত্যিকারের বোঝাপড়া বা সর্বদা আপ‑টু‑ডেট তথ্য রাখে না। OpenAI GPT‑4‑এর জন্য অ্যালাইনমেন্ট গবেষণায় ব্যাপকভাবে ফোকাস করে—RLHF, রেড‑টিমিং, এবং সিস্টেম‑স্তরের নিরাপত্তা নিয়মের মতো কৌশল ব্যবহার করে—কিন্তু বলে করে যে ঝুঁকি ও অপব্যবস্থাপন পরিচালনার জন্য যত্নশীল মোতায়েন, মনিটরিং ও চলমান গবেষণা এখনও প্রয়োজন।

প্রারম্ভ থেকেই OpenAI নিরাপত্তা ও অ্যালাইনমেন্টকে মিশনের একটি মূল অংশ হিসেবে তুলে ধরেছে, না যে তা প্রোডাক্ট লঞ্চের পরে মাথায় আনা হচ্ছে। সংগঠনটি বারবার জানিয়েছে যে তাদের লক্ষ্য হলো অত্যন্ত সক্ষম AI সিস্টেম তৈরি করা যা মানবিক মূল্যবোধের সঙ্গে সারিবদ্ধ এবং এমনভাবে মোতায়েন করা যাতে শুধুমাত্র শেয়ারহোল্ডার বা প্রাথমিক অংশীদারদের উপকার না হয়, বরং সকলের জন্য উপকারী হয়।

২০১৮‑এ OpenAI OpenAI Charter প্রকাশ করে, যা তাদের অগ্রাধিকারগুলো আনুষ্ঠানিকভাবে স্থাপন করে:

চার্টারটি নীতিনির্দেশনার মতো কাজ করে, গবেষণা দিক, মোতায়েনের গতি ও বাহ্যিক অংশীদারিত্ব সম্পর্কে সিদ্ধান্তগুলোকে প্রভাবিত করে।

মডেলগুলোর সক্ষমতা বাড়ার সঙ্গে সঙ্গে OpenAI নিরাপত্তা ও শাসন কার্যাবলীর জন্য নির্দিষ্ট ইউনিট গড়ে তোলে:

এই গ্রুপগুলো GPT‑4 ও DALL·E‑র মত মডেলগুলোর লঞ্চ সিদ্ধান্ত, অ্যাক্সেস স্তর ও ব্যবহারের নীতিতে প্রভাব ফেলে।

একটি সংজ্ঞায়িত প্রযুক্তিগত পদ্ধতি হলো reinforcement learning from human feedback (RLHF)। মানব লেবেলাররা মডেল আউটপুট পর্যালোচনা করে, সেগুলো র্যাঙ্ক করে এবং একটি রিওয়ার্ড মডেল তৈরি করে। প্রধান মডেলটিকে তারপর এমন আউটপুট দিতে প্রশিক্ষণ করা হয় যা মানব‑প্রাধান্যপ্রাপ্ত আচরণের কাছে যায়, ফলে বিষাক্ত, পক্ষপাতমূলক বা অনিরাপদ আউটপুট কমে।

সময়ক্রমে OpenAI RLHF‑কে সিস্টেম‑স্তরের নীতি, কনটেন্ট ফিল্টার, ডোমেইন‑নির্দিষ্ট ফাইন‑টিউনিং ও মনিটরিং টুলের সঙ্গে যুক্ত করেছে।

OpenAI নিরাপত্তা কাঠামো, মডেল রিপোর্টিং অনুশীলন ও ফ্রন্টিয়ার মডেল সুরক্ষা মানদণ্ডের মতো পাবলিক ফ্রেমওয়ার্কে অংশ নিয়েছে। এটি একাডেমিয়া, সিভিল‑সোসাইটি অর্গানাইজেশন এবং সিকিউরিটি গবেষকদের সঙ্গে মূল্যায়ন, রেড‑টিমিং ও অডিটে সহযোগিতা করেছে।

এই সহযোগিতা ও আনুষ্ঠানিক দলিলগুলো—চার্টার ও বিবর্তিত ব্যবহারের নীতিসহ—OpenAI‑র ক্রমবর্ধমান শক্তিশালী এআই সিস্টেম শাসনের মূল কাঠামো গঠন করে।

OpenAI‑র দ্রুত উত্থান সমালোচনা ও অভ্যন্তরীণ চাপের ছায়ায় রয়ে গেছে, বেশিরভাগই প্রতিষ্ঠানটি কিভাবে তার মূল মিশনের সঙ্গে মেল খায় না খায়—এটিই কেন্দ্রীয় বিষয়।

শুরুতে OpenAI গবেষণা ও কৌশলগত উপকরণ উন্মুক্ত করে—কিন্তু মডেলগুলো শক্তিশালী হওয়ার সঙ্গে সঙ্গে সংস্থা সীমিত মুক্তি, API‑মাত্র অ্যাক্সেস ও কম প্রযুক্তিগত বিবরণ প্রকাশের পথে এগোয়।

সমালোচকরা বলছেন যে এই পরিবর্তন "OpenAI" নামে সন্নিহিত প্রতিশ্রুতির বিরুদ্ধাচরণ করে। প্রতিষ্ঠানের অভ্যন্তরীণ সমর্থকরা যুক্তি দেন যে পূর্ণ মডেল ওয়েটস ও প্রশিক্ষণ বিবরণী প্রকাশ করলে অপব্যবহার ও নিরাপত্তা ঝুঁকি বাড়বে।

OpenAI নিরাপত্তা মূল্যায়ন, সিস্টেম‑কার্ড ও নীতিপত্র প্রকাশের মাধ্যমে প্রতিক্রিয়া দেয়, তবু মূল মডেল ওয়েটস গোপন রেখেছে। এটি ওপেননেস, নিরাপত্তা ও প্রতিযোগিতামূলক চাপে ভারসাম্য রক্ষার প্রচেষ্টা হিসেবে উপস্থাপন করে।

OpenAI Microsoft‑এর সঙ্গে অংশীদারিত্ব গভীর করার ফলে—Azure ও Copilot‑এর মতো অঙ্গনে—অবজার্ভাররা কম্পিউট, ডেটা ও সিদ্ধান্ত‑গ্রহণ ক্ষমতার কেন্দ্রীভূতকরণ নিয়ে উদ্বিগ্ন হয়েছেন।

সমালোচকরা ভয় পাচ্ছেন যে কয়েকটি কোম্পানি frontier মডেল ও তাদের পেছনের বিশাল অবকাঠামোর ওপর নিয়ন্ত্রণ রাখে। অন্যরা বলছেন যে অতিরিক্ত বাণিজ্যিকীকরণ (ChatGPT Plus, এন্টারপ্রাইজ অফার, একচেটিয়া লাইসেন্সিং) মূল ননপ্রফিট মিশন থেকে বিচ্যুতি।

OpenAI‑র নেতৃত্ব রাজস্বকে জরুরি বলে উপস্থাপন করেছে—গবেষণা চালানোর জন্য এটি দরকারি—একই সঙ্গে একটি ক্যাপড‑প্রফিট কাঠামো ও চার্টারের মাধ্যমে মানবতার স্বার্থকে অগ্রাধিকার দেওয়ার প্রতিশ্রুতি রেখেছে। মুক্ত অ্যাক্সেস টিয়ার, গবেষণা অংশীদারিত্ব ও কিছু ওপেন‑সোর্স টুলের মাধ্যমে তারা জনসাধারণ উপকার দেখানোর চেষ্টা করেছে।

ভিতরে কিভাবে দ্রুত চলা উচিত, কতটা ওপেন হওয়া উচিত এবং নিরাপত্তাকে কতো অগ্রাধিকার দেওয়া উচিত—এগুলি নিয়ে বিতর্ক বারবার surfaced হয়েছে।

Dario Amodei ও অন্যান রা 2020‑এ Anthropic প্রতিষ্ঠা করে বেরিয়ে যান—নিরাপত্তা ও শাসন সম্পর্কে ভিন্ন দৃষ্টিভঙ্গি উল্লেখ করে। পরবর্তীতে 2024‑এ Jan Leike‑র মত কিছু মূল সেফটি গবেষকের পদত্যাগ স্বরোজভাবে উদ্বেগ প্রকাশ করে যে স্বল্পকালীন প্রোডাক্ট লক্ষ্যে দীর্ঘমেয়াদি সেফটি কাজ পিছিয়ে পড়ছে।

সর্বাধিক দৃশ্যমান ভাঙন ঘটে 2023 সালের নভেম্বর মাসে, যখন বোর্ড সাময়িকভাবে সিইও Sam Altman‑কে অপসারণ করে—"ট্রাস্টের অভাব" বলে উল্লেখ করে। কর্মচারীদের জোরালো প্রতিবাদ ও Microsoft সহ অন্যান্য স্টেকহোল্ডারদের মধ্যস্থতা পরবর্তীতে Altman‑কে ফিরিয়ে আনে, বোর্ড পুনর্গঠিত হয়, এবং OpenAI গভর্ন্যান্স সংস্কার—নতুন সেফটি ও সিকিউরিটি কমিটি—প্রতিশ্রুত করে।

এই ঘটনাগুলো দেখায় যে সংগঠনটি দ্রুত মোতায়েন, বাণিজ্যিক সাফল্য ও বিস্তৃত কল্যাণ নিয়ে কিভাবে সামঞ্জস্য রক্ষা করবে তা নিয়ে এখনও সংগ্রাম করছে।

OpenAI ছোট গবেষণা‑কেন্দ্রিক ননপ্রফিট থেকে একটি কেন্দ্রীয় ইনফ্রাস্ট্রাকচার প্রদানকারীতে পরিণত হয়েছে, যা নতুন টুল কীভাবে তৈরি, নিয়ন্ত্রিত ও বোঝা হবে—এগুলি নির্ধারণে ভূমিকা রাখে।

সাধারণভাবে মডেলগুলো প্রকাশ করার বদলে OpenAI এখন একটি সম্পূর্ণ প্ল্যাটফর্ম পরিচালনা করে, যা স্টার্টআপ, এন্টারপ্রাইজ ও একক ডেভেলপাররা ব্যবহার করে। GPT‑4, DALL·E ও ভবিষ্যৎ সিস্টেমের API‑র মাধ্যমে এটি হয়ে উঠেছে:

এই প্ল্যাটফর্ম ভূমিকা মানে OpenAI কেবল গবেষণা এগোয় না—এটি লক্ষ লক্ষ মানুষের প্রথম অভিজ্ঞতা কিভাবে শক্তিশালী এআই হয় তার ডিফল্ট নিয়মগুলোও স্থাপন করে।

OpenAI‑র কাজ প্রতিদ্বন্দ্বী ও ওপেন‑সোর্স কমিউনিটিগুলোর প্রতিক্রিয়া তাড়া করে—নতুন মডেল, প্রশিক্ষণ পদ্ধতি ও নিরাপত্তা কৌশল উদ্ভাবনে। সেই প্রতিযোগিতা অগ্রগতিকে ত্বরান্বিত করে, একই সময়ে ওপেননেস, কেন্দ্রীকরণ ও বাণিজ্যিকীকরণ নিয়ে তীক্ষ্ণ বিতর্ককে তীব্র করে।

সরকারগুলো ও নিয়ন্ত্রকরা ক্রমশ OpenAI‑র অনুশীলন, স্বচ্ছতা রিপোর্ট ও অ্যালাইনমেন্ট গবেষণার দিকে নজর দিচ্ছে যখন তারা AI মোতায়েন, নিরাপত্তা মূল্যায়ন ও দায়িত্বশীল ব্যবহারের জন্য নিয়মাবলী লেখে। ChatGPT, GPT‑4 ও ভবিষ্যৎ সিস্টেম সম্পর্কে জনসংলাপ এই ধারণাগুলোকে প্রভাবিত করে যে AI কীভাবে ঝুঁকি ও সুবিধা আনতে পারে।

মডেলগুলো যত সক্ষম হবে, OpenAI‑র ভূমিকা নিয়ে অনির্ধারিত বিষয়গুলো আরও গুরুত্বপূর্ণ হয়ে উঠবে:

এই প্রশ্নগুলো ভবিষ্যৎ AI সিস্টেমগুলো কি বিদ্যমান বৈষম্য বাড়াবে না কি তা কমাবে—এটা নির্ধারণে উল্লেখযোগ্য ভূমিকা রাখবে।

ডেভেলপার ও ব্যবসাগুলো করতে পারে:

ব্যক্তিরা করতে পারেন:

OpenAI‑র ভবিষ্যৎ প্রভাব নির্ভর করবে কেবল তার অভ্যন্তরীণ সিদ্ধান্তে নয়, বরং সরকার, প্রতিদ্বন্দ্বী, সিভিল সমাজ ও প্রতিদিনের ব্যবহারকারীরাও কিভাবে এগুলোকে যুক্তি, সমালোচনা ও জবাবদিহিতার দাবি করে অংশগ্রহণ করে তার ওপর।

OpenAI ২০১৫ সালে একটি ননপ্রফিট গবেষণা ল্যাব হিসেবে প্রতিষ্ঠিত হয়েছিল যার উদ্দেশ্য ছিল সম্ভাব্য কৃত্রিম সাধারণ বুদ্ধিমত্তা (AGI) মানবজাতির সর্বজনীন কল্যাণে কাজে লাগানো।

কয়েকটি কারণ প্রতিষ্ঠায় ভূমিকা রেখেছিল:

এই উৎপত্তি কাহিনী আজও OpenAI-এর গঠন, অংশীদারিত্ব এবং জনসম্মুখে করা অঙ্গীকারকে প্রভাবিত করে।

AGI (artificial general intelligence) এমন এআই সিস্টেমকে বোঝায় যা মানুষের সমতুল্য বা তার উপরের পর্যায়ে বিভিন্ন ধরণের জ্ঞানগত কাজ করতে পারে, একক টাস্কের জন্য সীমাবদ্ধ সিস্টেম নয়।

OpenAI-এর মিশন হলো:

এই মিশনটি OpenAI Charter-এ আনুষ্ঠানিককরণ করা আছে এবং গবেষণা দিকনির্দেশনা ও মোতায়েনের বড় সিদ্ধান্তগুলোকে আকৃত করে।

OpenAI একটি বিশুদ্ধ ননপ্রফিট থেকে “ক্যাপড‑প্রফিট” সীমিত পার্টনারশিপ (OpenAI LP)/'কল-স্ট্রাকচার' এ রূপান্তরিত হয়েছিল, যাতে অত্যাধুনিক এআই গবেষণার জন্য প্রচুর মূলধন সংগ্রহ করা যায় এবং একই সঙ্গে মূল মিশনকে ওপরেই রাখা যায়।

মূল দিকগুলো:

এটি শাসনব্যবস্থায় একটি পরীক্ষামূলক ধারা, এবং এর কার্যকারিতা নিয়ে বিতর্ক চলছে।

Microsoft OpenAI-কে বিস্তিষ্ঠ ক্লাউড কম্পিউটিং (Azure) এবং কয়েকশো কোটি/বিশাল পর্যায়ের বিনিয়োগ দিয়েছে।

চুক্তির অন্তর্ভুক্ত বিষয়গুলো:

বদলে, OpenAI এমন রিসোর্স পেয়েছে যা গোলকধাঁধার মতো frontier মডেল ট্রেন ও মোতায়েন করতে প্রয়োজনীয়, এবং Microsoft পেয়েছে তার প্রোডাক্ট ইকোসিস্টেমে উন্নত AI যোগ করার ক্ষমতা।

GPT সিরিজ OpenAI-র দিকনির্দেশ ও ব্যবসায়িক কৌশল উভয়কেই বদলেছে:

শুরুতে OpenAI “ডিফল্টভাবে ওপেন” হওয়ার প্রতিশ্রুতি করেছিল—পেপার, কোড ও টুল দ্রুত প্রকাশ করা হতো। মডেলগুলো শক্তিশালী হওয়ার সাথে সাথে তারা নিচের দিকে সরে এসেছে:

OpenAI বলছে এটি অপব্যবহার ঝুঁকি কমাতে প্রয়োজনীয়। সমালোচকেরা মনে করেন এটি “OpenAI” নামের দ্বারা তুলে ধরা আসল প্রতিশ্রুতিকে ক্ষুণ্ণ করে এবং ক্ষমতাগুলো একটি কোম্পানির মধ্যে কেন্দ্রভূত করে।

OpenAI নিরাপত্তা ও অপব্যবহার নিয়ন্ত্রণে রাখতে নানান সাংগঠনিক ও প্রযুক্তিগত পদ্ধতি ব্যবহার করে:

এই পদক্ষেপগুলো ঝুঁকি কমায়, কিন্তু হ্যালুসিনেশন, পক্ষপাত এবং অপব্যবহার—এসব সমস্যা পুরোপুরি দূর করে না; এগুলো এখনো সক্রিয় গবেষণা ও শাসনগত চ্যালেঞ্জ।

ChatGPT (প্রারম্ভে ২০২২) সাধারণ জনগণের কাছে বড় ভাষার মডেলকে সরল কথোপকথ্য ইন্টারফেসে তুলে এনেছিল—এটি একটি বড় মোড়টান ছিল কারণ:

এই দৃশ্যমানতা OpenAI-এর শাসন, ব্যবসায়িক মডেল ও সুরক্ষা অনুশীলনগুলোর উপর তীব্র নজর আকর্ষণ করেছিল।

OpenAI-এর মডেলসমূহ—বিশেষত Codex ও GPT‑4—জ্ঞানভিত্তিক ও সৃজনশীল কাজের কিছু অংশে পরিবর্তন আনছে:

সম্ভাব্য সুবিধা:

ঝুঁকি ও উদ্বেগ:

OpenAI-র ইকোসিস্টেমের সাথে দায়িত্বশীলভাবে জড়িতব্য হওয়ার কিছু উপায়:

সব ক্ষেত্রেই, মডেলগুলো কিভাবে ট্রেন করা হয় এবং শাসন করা হয় তা নিয়ে সজাগ থাকাই গুরুত্বপূর্ণ; আরো স্বচ্ছতা, জবাবদিহিতা ও সমঅধিকার অ্যাক্সেস চাওয়া উচিত।

প্রতিটি পর্যায় না কেবল প্রযুক্তিগত সীমানা টেনে নিয়েছে, বরং নিরাপত্তা, অ্যাক্সেস এবং বাণিজ্যিকীকরণ নিয়ে নতুন সিদ্ধান্তও চাপিয়েছে।

নেট প্রভাব নীতিনির্ধারণ, সংস্থাগত সিদ্ধান্ত ও ব্যক্তিগত ও কর্পোরেটভাবে AI একত্রিত করার উপায়ের ওপর অনেকটা নির্ভরশীল হবে।